面向低照度图像增强的注意力曝光融合网络

包易峰,杨德刚

重庆师范大学 计算机与信息科学学院,重庆 401331

高质量图像对于计算机视觉任务至关重要。例如在视频监控、目标检测、自动驾驶等领域对高质量图像的需求越来越高,原因在于高质量的图像能够提供大量有价值的信息给机器视觉任务利用,从而确保机器视觉任务能够顺利进行。然而,在低光照条件下获取的图像可能会在暗部区域丢失大量关键信息,同时由于噪声的影响产生颜色失真。低质量图像可能会显著降低计算机视觉方法的性能[1]。大量的计算机视觉任务越来越依赖于输入图像的质量。低照度图像增强工作的重点在于减少颜色偏差并充分挖掘图像的隐藏信息。因此,低照度图像增强在计算机视觉领域受到了更多的关注。

典型的图像增强方法假设用户在拍摄图像时具有良好的摄影技巧,以便这些方法可以专注于学习调整图像的色调、颜色和对比度,因此忽略了实际低照度环境拍摄时的噪声问题。导致这些方法在增强带有大量噪点的真实低照度图像时,信噪比较低。尽管一些方法取得了一些进展,但仍然存在很多问题。首先,当低照度图像中存在曝光不足或曝光过度的区域时,很难从原始传感器数据到低照度图像的映射中学习有效的参数。因此现有方法无法从曝光不足或曝光过度的区域恢复曝光良好的图像细节。其次,如果没有曝光合理的图像信息,现有方法可能会因为过度的噪声产生颜色偏差。

针对以上问题,提出了多尺度注意力曝光融合网络(multi-scale attention exposure fusion,MAEF)来增强低照度图像并恢复逼真的图像细节。受到自注意力机制相关研究文献[2-3]的启发,提出了多尺度注意力模块(multi-scale attention block,MAB),包含残差上下文模块(residual context block,RCB)和选择性内核(selective kernel block,SKB)模块,多尺度注意力模块利用并行的双分支提取大小不同的感受野,一条分支利用适当增大网络感受野捕获更多的上下文信息,同时另一条分支用小感受野来规避更大的感受野可能会导致空间上细节信息的损失、图像增强质量的下降的问题。残差上下文模块对输入特征进行全局上下文建模,获取丰富的深层特征和浅层特征。选择性内核模块利用注意力机制结合具有不同感受野的特征,同时保留了它们独特的互补特征。融合模块(fusion block,FB)将一组图像中每张图像中曝光良好的部分融合为一张曝光准确的图像,充分挖掘每张图像中有价值的信息。

注意力机制通过提取不同感受野的重要特征,并动态组合不同感受野的独特特征,融合了丰富的上下文信息。曝光融合机制充分挖掘了丰富的图像原始信息,多尺度注意力曝光融合网络通过引入多尺度注意力模块与融合模块兼具了两者的优点,一定程度上减少了低照度图像细节的丢失,减少了颜色偏差。实验结果表明,提出的方法达到了优于现有方法的性能。

1 相关工作

1.1 图像去噪

图像去噪是一个基础和活跃的研究领域,在计算机视觉领域有着悠久的历史。它去除噪声,重建结构内容细节,然后生成高质量的图像。其用途广泛,如医学图像去噪[4]、卫星图像去噪[5]和压缩噪声去噪[6]。在许多应用中,自动驾驶车辆中的目标检测[7]和识别[8]显著增加了研究人员对图像去噪的关注。这是因为去除图像中的噪声可以显著提升图像质量,对提高目标识别性能至关重要。

已经提出了许多方法,使用的技术有小波域处理[9]、稀疏编码[10]、3D变换域过滤(BM3D)[11]。这些方法通常基于特定的图像先验,例如平滑度、稀疏度、低秩或自相似性。研究人员还探索了深度网络在图像去噪中的应用,包括可训练非线性反应扩散TNRD[12]、多层感知器[13]、深度自动编码器[14]和卷积网络[15]。卷积神经网络(convolutional neural network,CNN)与传统的手工方法(如非局部平均)[16]和BM3D相比,取得了显著的性能优势,这得益于大量的图像数据集和深入研究的学习技术。

1.2 低照度图像增强

在低光照条件下拍摄的低照度图像无疑会降低计算机视觉算法的性能。因此,已经提出了各种低照度图像增强方法来恢复高质量的图像。传统方法可以分为两大类:一类是基于直方图的方法[17]与伽马校正。第二类是基于Retinex的方法[18]。例如,直方图均衡化[19]试图将整个图像的直方图映射为简单的数学分布。然而,这些方法在不考虑周围像素的情况下单独恢复每个像素。基于Retinex的方法首先根据Retinex理论估计光照图,然后使用构建良好的光照图增强每个像素。文献[20]提出基于单个图像动态调整曝光时间并使用光照估计技术融合图像。然而很难估计具有严重噪声的低照度图像的光照图。

最近,基于深度学习的方法在低照度图像增强方面取得了显著改进。LLNet[14]由对比度增强模块和去噪模块组成。LLCNN[21]应用特殊设计的卷积模块来利用多尺度特征图进行图像增强。Retinex-Net[22]由一个用于分解的Decom-Net 和一个用于光照调整的Enhance-Net组成。CAN[23]近似于各种处理运算符。与现有方法对sRGB 图像的操作不同,Chen 等人[24]采用全卷积网络[16]基于原始传感器数据进行极低照度图像增强相对sRGB图像取得了显著的性能提升。

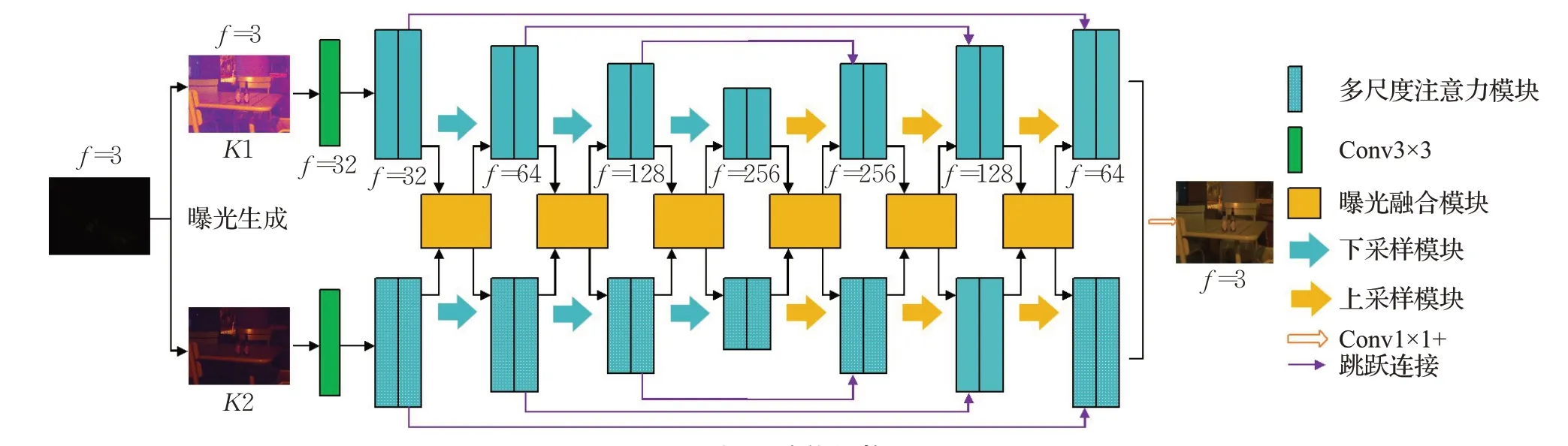

2 多尺度注意力曝光融合网络

多尺度注意力曝光融合网络是经过改进的双分支U-Net[25]结构,如图1 所示,两个U-Net 分支具有完全一致的网络结构,两个U-Net分支之间通过融合模块进行信息的交互与整合,U-Net 分支保留了原始U-Net 结构的基本框架,包括编码器部分、解码器部分、跳跃连接。同时添加三种类型的模块:(1)多尺度注意力模块;(2)下采样模块和上采样模块;(3)融合模块。

图1 总体架构Fig.1 Overall architecture

当输入图像进入每个U-Net 分支后,首先执行3×3卷积运算,为多尺度注意力模块生成特征图。接下来,两个多尺度注意力模块的输出特征图被下采样模块下采样,其中图1 中的f表示特征图的数量。同时,融合模块将融合信息传递到下一层。网络重复上述过程三次后输入到两个多尺度注意力模块,然后输出的特征图被上采样模块上采样。其中上采样模块采用子像素插值方法[26]。重复上述过程三次之后所有U-Net分支的特征图串联到一起,输入到1×1卷积用于调整输出特征图的深度,当输出彩色图像时,深度设置为3,当输出灰度图像时,深度设置为1。U-Net 分支中通过添加跳跃连接以帮助重建不同尺度的细节,在编码器部分,输入图像通过下采样模块将图像分辨率降低,但同时会损失大量高分辨率细节,利用跳跃连接将编码器部分的特征图中高分辨率的细节信息融合到与之对应的解码器部分的特征图,跳跃连接为网络提供了多层次多尺度信息,增强了网络各层之间的信息交互,提高了信息利用率,有利于低照度图像恢复细节丰富的高分辨率信息。同时,跳跃连接的引入缓解了梯度消失问题,使得深层神经网络的训练更容易。

多尺度注意力曝光融合网络继承了U-Net 结构的特点,同时将普通卷积层替换为多尺度注意力模块增强特征提取、转化能力。并且利用融合模块充分挖掘隐藏于阴影与高光中丰富的图像原始信息,提升低照度图像增强性能。

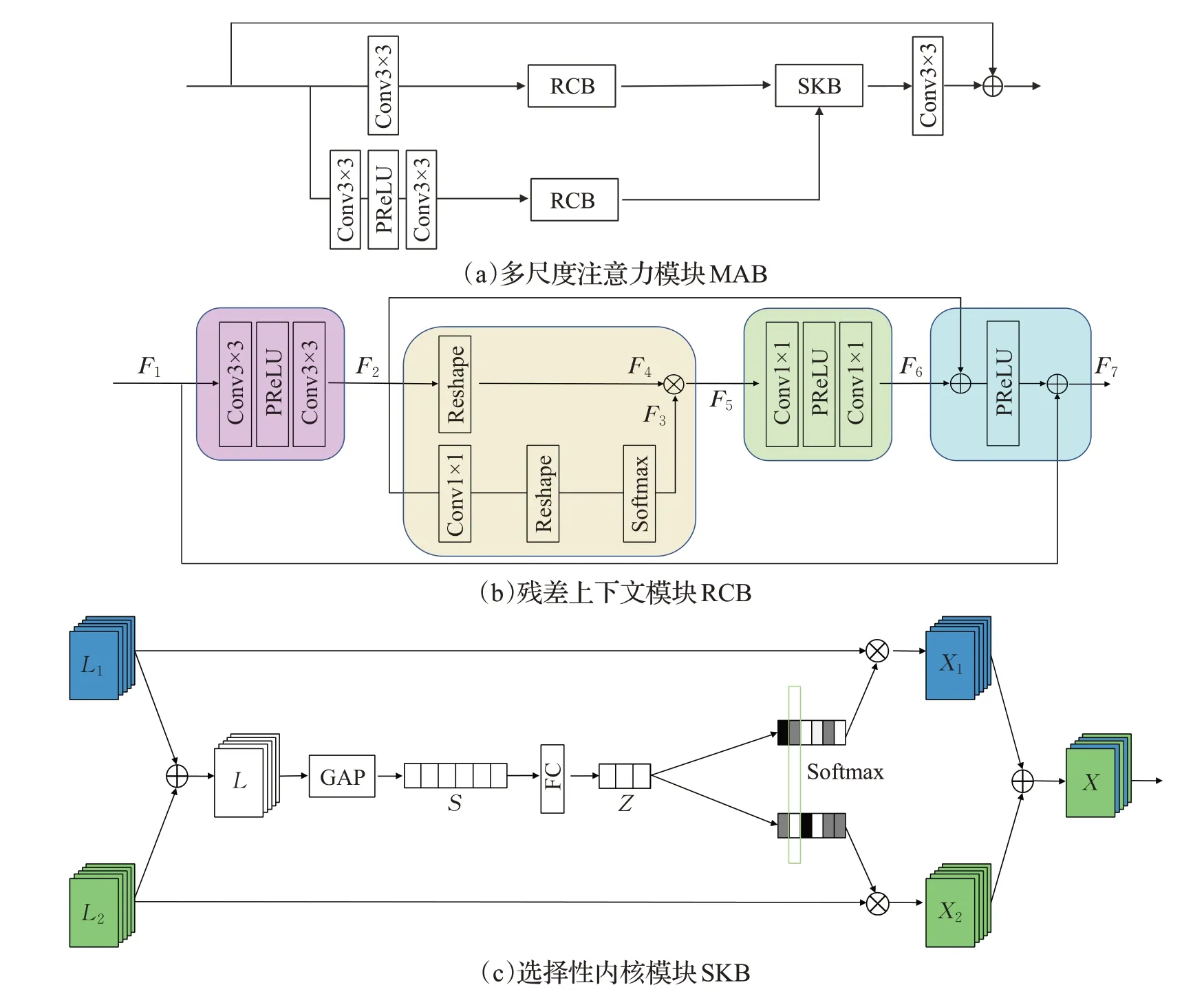

2.1 多尺度注意力模块(MAB)

视觉注意力机制是人类视觉通过快速扫描全局图像,筛选出需重点关注的区域,从而获取需要的有用信息,淡化不需要的无用信息。受到人类视觉注意力机制的启发,深度学习领域通过引入注意力机制来实现忽略无关信息关注有用信息,提高计算视觉信息处理的效率与准确性。

低照度图像增强的一个重要课题在于如何充分利用图像中某个缺失有效信息的像素区域周围其他像素提供的信息对图像进行恢复,因此感受野对低照度图像增强至关重要。适当增大网络感受野能够捕获更多的上下文信息,提高图像增强效果,然而过大的感受野又会导致空间细节的损失。因而本文提出的多尺度注意力模块利用不同尺寸卷积提取不同尺寸的感受野。如图2(a)所示,其采用的双分支分别利用一个3×3卷积和两个3×3 卷积,其中两个3×3 卷积可以等效一个5×5 卷积的感受野,同时比一个5×5 卷积有效降低运算量,提升运算速度,增强非线性表达能力。卷积运算之后分别通过残差上下文模块提取其中的重要信息,最后同时输入选择性内核模块中动态地选择有用的信息。更重要的是,选择性内核模块结合了具有不同感受野的特征,同时保留了它们独特的互补特征。

图2 多尺度注意力模块MABFig.2 Multiscale attention block MAB

2.2 残差上下文模块(RCB)

残差上下文模块可对图像信息中的重要特征进行提取,同时抑制无关信息的进一步传递。如图2(b)所示残差上下文模块由四部分组成。(1)两个3×3卷积,用以增大感受野,生成特征矩阵F2。(2)上下文建模,特征矩阵F2∈RH×W×C作为输入,依次经过权重参数为W1的1×1卷积、reshape操作和非线性激活函数softmax,得到特征矩阵F3,接下来将特征矩阵F2执行reshape 操作生成F4∈R1×HW×C并与F3执行矩阵乘法,得到全局上下文特征矩阵F5∈R1×1×C:

Z为全局注意力池化权值,W1为1×1卷积的权重参数,Xi和Xj表示特征矩阵任意位置,N=H·W表示特征矩阵位置数量,其中H为图像的高度,W为图像的宽度。(3)特征转换,为了获取通道间的依赖关系,将特征矩阵F5经过权重参数为W2的1×1 卷积,生成1×1×C/r的特征矩阵,以减少参数量降低计算资源需求。在卷积层后加入非线性激活函数PReLU,后接权重参数为W3的1×1 卷积卷积,用以计算每个特征通道的权重比例。最后输出特征矩阵F6∈R1×1×C:

其中,W2、W3分别为两个1×1卷积的权重参数,P为非线性激活函数PReLU。(4)特征融合,将F2和F6利用element-wise addition操作相加,结果输入到非线性激活函数PReLU,输出结果再与F1相加,输出最终结果F7:

2.3 选择性内核模块(SKB)

选择性内核模块利用自注意力机制整合来自不同感受野特征图的特征,重建增强图像。如图2(c)所示,选择性内核模块通过融合操作融合多感受野特征图信息以生成全局特征描述,选择操作根据不同权重对不同分支的特征进行重新聚合。

融合操作。首先多分支特征图用元素求和合并到一个特征:

接下来应用全局平局池化操作(GAP)编码全局信息,进而产生channel-wise统计信息:

Sc代表S的第c个元素,Lc代表L的第c个元素生成的S∈R1×1×c,然后通过降低维数来提高效率,使其能够进行精确和自适应的选择特征,这是通过一个全连接(fully connected layers,FC)层实现的:

式中,σ表示ReLU 激活函数;γ表示批归一化(batch normalization,BN)操作;W∈Rd×C表示全连接层矩阵;d表示压缩特征的维度,其值设置为通道数的一半。

选择操作。首先,在压缩特征描述向量z的引导下,使用softmax运算自适应选择信息的不同空间尺度,得到表征特征图选择权重的通道注意力向量(channel attention vector,CAV)为:

其中,X1、X2表示L1、L2的软注意力向量A,B∈RC×d表示全连接层矩阵,然后,使用注意力向量与对应分支的特征图进行逐元素相乘。最后,将选择后的多分支特征图逐元素相加,上述过程可表述为:

其中,·表示逐元素相乘。+表示逐元素相加。选择性内核模块通过引入注意力机制,对不同感受野下提取到的多路特征图进行了重新选择、校准,增强有用特征信息的传递并且抑制无用信息,提高了网络对低照度图像的处理能力。

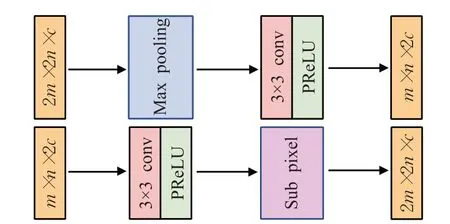

2.4 下采样模块和上采样模块

图3 上半部分显示了下采样模块的结构。下采样块由两层组成:一个2×2最大池化层和一个3×3卷积层,后跟PReLU。当特征图作为输入时,步长为2的2×2最大池化操作会减小特征图的大小。然后,3×3卷积层将特征图的数量加倍,以防止信息量严重减少。因此,下采样块的输出特征图的大小是输入特征图的二分之一,特征图数量是其两倍。

图3 下采样模块和上采样模块Fig.3 Downsampling block and upsampling block

图3 下半部分显示了上采样模块的结构。下采样块由两层组成:带有PReLU的3×3卷积层和子像素插值层。与反卷积层不同,子像素插值层能更有效和准确地扩展特征图的大小。在亚像素插值层扩大特征图的尺寸之前,3×3 卷积层对特征图进行细化,使亚像素插值层能够准确地对特征图进行插值。因此,上采样块的输出特征图的大小是输入特征图的两倍,通道数是输入特征图的二分之一。

2.5 曝光融合

通过为不同的区域分配不同的曝光系数,从单个低照度图像生成一组具有不同曝光时间的多重曝光图像。融合操作以互补的方式组合每个单曝光图像的中曝光良好的区域,最后将多张图像融合为一张曝光合理的高动态范围图像。融合操作通过融合模块来实现,融合模块采用一种置换不变技术[27],可以从图像黑暗区域与高光区域恢复准确的图像细节,减少颜色偏差使颜色分布更接近真实场景,输出高质量图像。

2.5.1 生成

在曝光生成步骤中,通过不同的曝光比值k来生成一组不同光照条件下的多曝光图像,其中k表示参考图像和低照度图像之间的曝光时间比。图1 举例了生成两张不同曝光图像K1、K2 的过程。对于给定的一张图像Iimg∈RH×W×1和一组给定曝光比值k∈{k1,k2,…,kn},可以生成一组多重曝光图像I∈{I1,I2,…,In},对于其中的第n张图像In有以下定义:

该操作执行图像逐像素裁切,*代表乘法操作。考虑到多重曝光图像中的信息冗余,将所有图像都进行操作可能不会带来明显的性能提升,但是资源需求会显著提升。因此本文将多重曝光图像数量设定为2。

2.5.2 融合

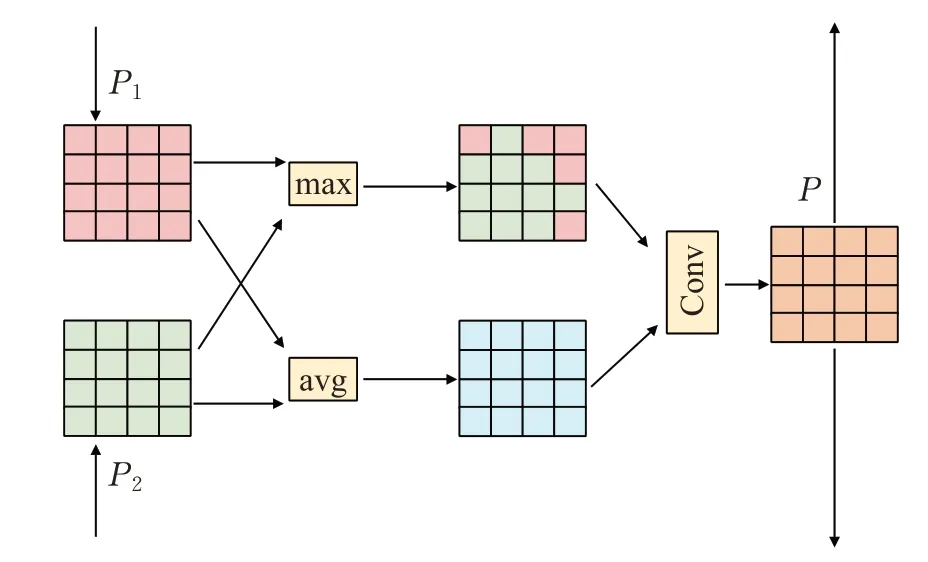

图1举例了两张不同曝光图像K1、K2 进行融合操作的过程,融合块通过获取不同分支获得的图像特征,利用其中有价值的信息,图4显示了融合模块的结构。

图4 融合模块Fig.4 Fusion block

每个融合块以来自n张图像P1,P2,…,Pn作为输入,并执行最大值和平均值操作以提取有价值的信息:

然后,将特征Pmax和Pavg连接到一起并将它们输出:

其中,[Pmax,Pavg]表示连接操作,Pout表示输出特征,W表示学习到的权重矩阵。最后,所有分支的最后一个特征连接在一起,后接一个1×1卷积层,输出最终特征图。

3 实验及结果分析

3.1 数据集及训练

本文数据集选择SID[24]数据集:此数据集包含了5 094张原始的短曝光RAW格式原始图像,每张都有相应的长曝光时间的参考图像。这些图像由两台相机进行收集。一个是SONY A7SIⅠ相机,一个是Fujifilm X-T2相机。SONY 相机分辨率为4 240×2 832,Fujifilm 相机分辨率为6 000×4 000。

此数据集将长曝光图像作为无噪声标准图像,包含了室内、室外多个场景的图像,其室外图像一般在月光和街灯条件下获取,亮度为0.2~5 lux。室内图像亮度为0.03~0.3 lux。其中短曝光图像的曝光时间为1/30~1/10 s,与之相对应的长曝光图像的曝光时间是短曝光图像曝光时间的100到300倍。此数据集采集图像的过程是先采集长曝光图像,调节相机的各项参数来获得一张清晰的长曝光图像,然后用手机远程改变相机的曝光时间来获得几张短曝光时间的图像。

实验在Intel e3 1230 v5 3.4 GHz,64 GB RAM,NVIDIA GTX2080TIGPU平台,Tensorflow1.14框架上完成。在每次训练的迭代过程中,将数据集中提取的图像随机裁剪成尺寸为64×64的图像块,并且对其进行随机的翻转和旋转来进行数据增强,训练使用Adam优化器[28]和L1损失[29]作为损失函数,初始学习率10-4,在训练到4 000 轮后,学习率减小为10-5。训练总共持续8 000轮。

3.2 对比实验

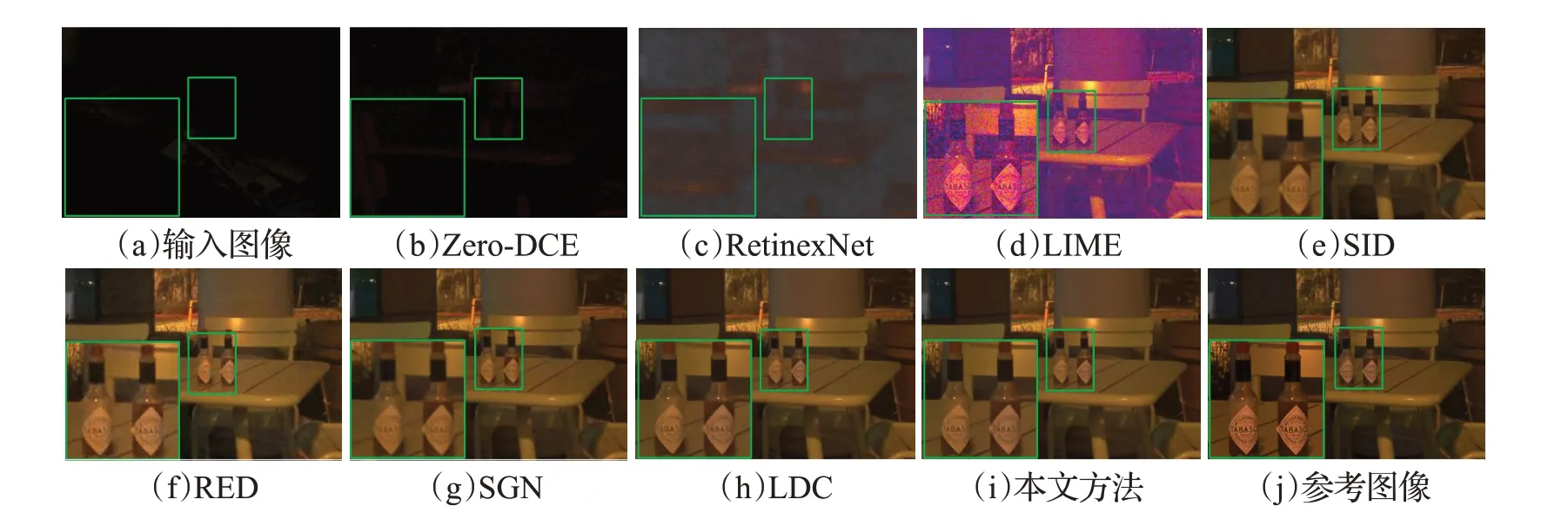

本文方法与现阶段主流的方法均做了比较,对比方法有RetinexNet[22]、LIME[30]、Zero-DCE[31]、SID[24]、RED[32]、SGN[33]、LDC[34]。图5 显示了一些具有代表性的视觉比较结果。展示了参考图像、输入图像、传统方法和基于深度学习的方法及其改进的结果。Zero-DCE无法恢复极低照度图像,因为噪声会使HDR 重建和色调映射过程难以实现。RetinexNet 也未能恢复这些图像。由于Retinex 基于将输入图像分解为反射率和照明度,因此当输入图像为极低照度图像,它们无法准确分解两者。LIME 的原理是直接估计光照图而不分解输入图像,它的缺点是虽然它可以增强低照度图像但同时增强了细节和噪声导致图像噪声严重。因此仅通过LIME 校正曝光可能无法有效恢复带有噪声的图像,因为它很难恢复被噪声干扰的单像素中的原始细节。同时该方法不能很好地恢复由噪声引起的颜色偏差,例如图中阴影处的紫色。

图5 视觉效果比较Fig.5 Comparison of visual effects

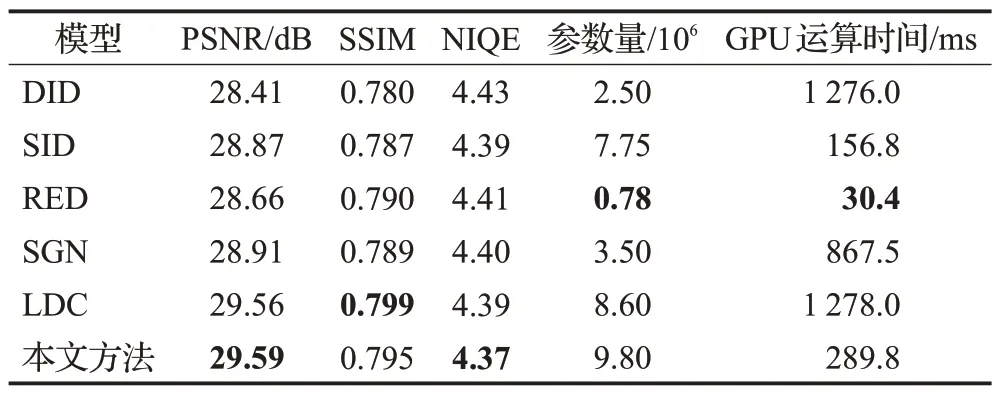

基于学习的方法和本文方法可以有效抑制噪声并恢复颜色。其中SID 模型更倾向于同时去除噪声和细节,从而导致图像变得模糊。虽然噪声被有效去除但细节会缺失。RED模型为了提高运算速度,牺牲了一定的图像分辨率,相比之下本文方法有更清晰的细节和更自然的颜色。除了主观视觉上的效果以外,采用峰值信噪比(PSNR[35])、结构性检验标准(SSIM[36])、NIQE[37]、参数量、GPU 运算时间等客观评价结果。如表1 所示,最佳结果用加粗字体表示,与最近的方法相比,本文方法取得了0.03 dB 的PSNR 和0.02 NIQE 的性能优势,虽然SSIM性能不及LDC方法,但本文方法GPU运算时间显著短于LDC方法,仅为其四分之一。

表1 与现有方法对比Table 1 Comparison with existing methods

3.3 消融实验

为了全面了解提出的网络,进行了消融实验来探究提出的改进所取得的性能提升。

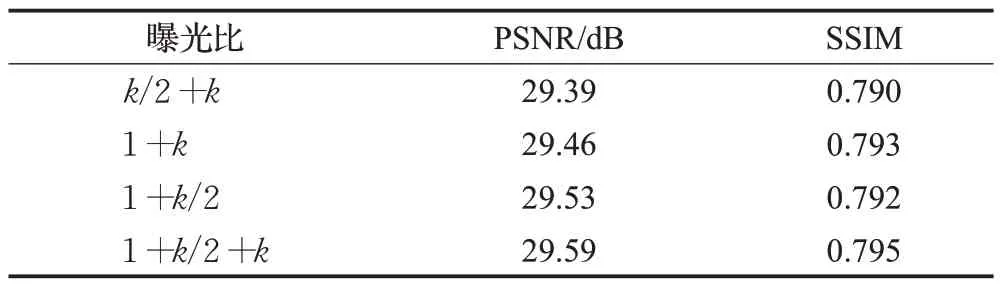

3.3.1 曝光比率

首先,评估曝光倍率的影响。如表2 所示,曝光比例为k代表输入为单张曝光率为k的图像,当曝光比例为k/2+k,1+k/2,1+k时,代表输入为两张曝光率为相应数值的图像,当曝光比例为1+k/2+k时,代表输入为三张曝光率分别为1,k/2,k的图像。当生成更多的多重曝光图像时,可以获得更高的性能。性能从单张图像到两张图像再到三张图像依次提升。详细研究两张图像时的曝光率分配问题,发现当曝光率分别为1 和k/2时性能最好,考虑三张图像不能显著提高性能并且消耗资源明显多于两张图像。因此,本文模型选择曝光比为1和k/2。

表2 不同曝光比率及其组合对比Table 2 Comparison of different exposure ratios and their combinations

3.3.2 曝光融合模块

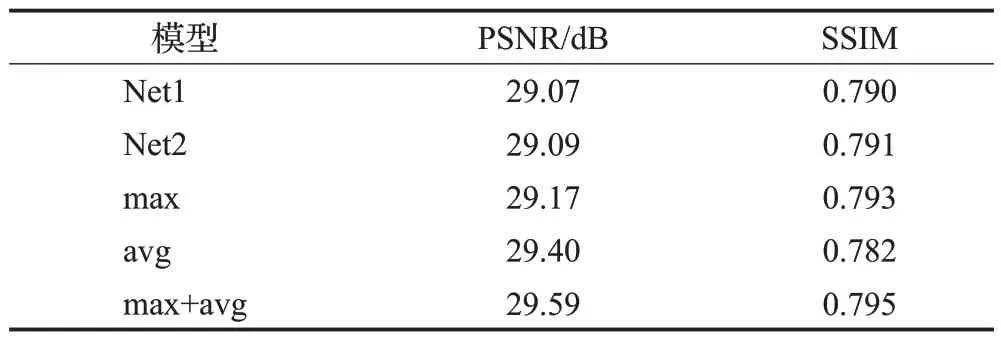

研究曝光融合模块及其变体的有效性。为此,进行以下实验:(1)NET1,表示移除曝光生成、曝光融合步骤和曝光融合模块,将图像直接送入网络。(2)NET2,表示一个没有曝光融合模块的网络,在最后一层融合两个分支的信息。(3)max,表示移除avg 操作只采用max 操作的融合块。(4)avg,表示移除max操作只采用avg操作的融合块。(5)max+avg,表示在曝光融合模块中同时采用max和avg操作。

表3 显示了曝光融合模块及其组合的评价结果。其中所有模型都以曝光比率1和k作为输入,在移除曝光融合模块后,网络性能将受到损失。同时采用max和avg操作的曝光融合模块性能优于单一的max或avg操作,通过组合两种聚合操作可以充分利用互补信息,进一步提高性能。

表3 曝光融合模块及其组合对比Table 3 Comparison of exposure fusion blocks and their combinations

3.3.3 多尺度注意力模块

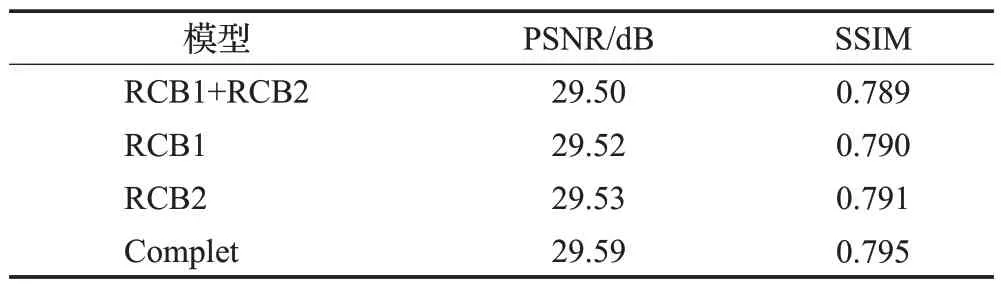

首先评估多尺度注意力模块内部模块的影响,如表4所示,RCB1+RCB2 为移除所有残差上下文模块的网络,RCB1 为移除第一个残差上下文模块的网络,RCB2为移除所有残差上下文模块的网络,Complet 为完整的网络。移除所有残差上下文模块将损失0.09 dB的PSNR,移除第一个残差上下文模块将损失0.07 dB的PSNR,移除第二个残差上下文模块将损失0.06 dB的PSNR。

表4 多尺度注意力模块及其组合对比Table 4 Comparison of multi-scale attention blocks and their combinations

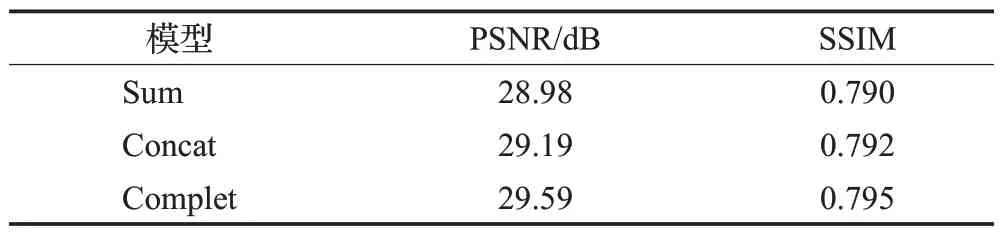

3.3.4 选择性内核模块

如表5所示,Sum为移除选择性内核模块并将其替换为Sum操作的网络,Concat为移除选择性内核模块并将其替换为Concat操作的网络,Complet为完整模块,与Sum操作和Concat操作相比,所提出的选择性内核模块获得了较好的结果。

表5 选择性内核模块与其组合对比Table 5 Comparison of selective kernel blocks and their combinations

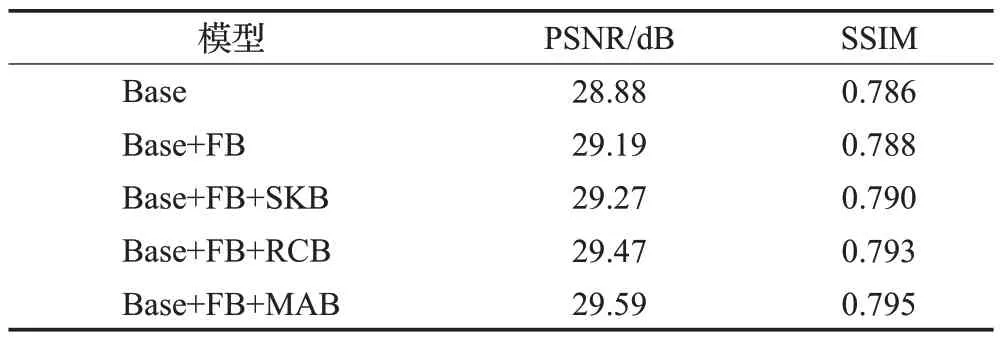

3.3.5 不同模块及其组合

为进一步验证融合模块、选择性内核模块、残差上下文模块的有效性,对不同模块与其组合进行消融研究,如表6 所示,Base 表示将注意力曝光融合网络移除融合模块、将多尺度注意力模块替换为3×3卷积层的网络,Base+FB表示将Base网络加入融合模块,Base+FB+RCB 表示将Base 网络加入融合模块、多尺度注意力模块并移除选择性内核模块将其替换为Concat 操作,Base+FB+SKB 表示将Base 网络加入融合模块、多尺度注意力模块并移除残差上下文模块,Base+FB+MAB表示将Base 网络加入融合模块、多尺度注意力模块。通过逐步在Base网络中加入不同的模块,性能逐步提升,证明了各模块的有效性。

表6 不同模块及其组合对比Table 6 Comparison of different blocks and their combinations

4 结束语

在这项工作中,提出了一种多尺度注意力曝光融合网络用于低照度图像增强。提出的网络同时结合注意力机制与曝光融合方法的优点,在视觉方面和定量评估优于现有的方法,并且可以生成具有细节丰富、色彩偏差小、干净无噪点的高质量图像。未来需要研究的方向是:(1)增强网络的速度,降低网络对硬件性能的依赖,增加网络的实用性。(2)考虑将图像超分辨率网络和图像去模糊网络加入工作中,增强网络的实用性。