基于关系特征交互的方面级情感分类方法

赵 振,朱振方*,王文玲

(1.山东交通学院 信息科学与电气工程学院,山东 济南 250357;2.鲁东大学 文学院,山东 烟台 264025)

0 引 言

随着互联网的迅速发展,越来越多的用户热衷于在网络上发表评论,产生了大量带有情感倾向的评论文本,挖掘并分析这些文本所对应的情感极性,可以帮助政府、商家等做出正确的决策。若要逐个分析文本中多个评价对象的情感倾向,则需要用到基于方面的情感分析(Aspect-Based Sentiment Analysis,ABSA)[1]技术。

基于方面的情感分析主要涉及两个任务,即确定句子的所有方面和计算特定方面的情感极性(如正面、负面、中性)。对于第二个任务,即基于方面的情感分类,常用的方法是通过缩短方面词与观点词之间的单词距离,从而更有效地将观点词传播到方面词。

在ABSA领域,情感文本的组成元素包括评论者、评论主体、体现评论者情感的情感词等,各个组成元素之间存在着各种依存关系,如主谓关系、动宾关系等,利用这些联系,能够更直接地通过句法结构的规则约束筛选出文本中的观点词和方面词,丰富文本的特征表示,进一步提高情感分类的准确率。

句法依存分析是自然语言处理中的关键技术之一,其中“句法”指句子的结构方式,它以词作为基本单位;“依存”指词与词之间支配与被支配的关系,这种关系具有方向。应用该技术可生成具有单词节点和节点关系的句法依存树,它在形式上可看作是一种图结构,并具有以下特点:(1)缩短了句子各个方面与目标方面之间的距离;(2)可以捕捉每个单词之间的句法关系;(3)为依存关系树中的信息传播提供句法识别路径。这种结构有助于使目标方面更接近其相关上下文,从而促进特征表示,对方面情感分类具有一定的辅助作用。

在最近的ABSA任务中,诸多学者对句法依存树进行了研究,取得了优越的成果。他们的方法是将依存树视为邻接矩阵,使用图卷积网络(Graph Convolutional Network,GCN)[2]或图注意力网络(Graph Attention neTwork,GAT)[3]根据这些矩阵对输入句子进行编码。例如,Sun等[4]提出了用于编码句法依存特征的图卷积网络,以建立目标和上下文之间的信息交换;Bai等[5]研究了一种集成类型化句法依存信息的关系图注意力网络,从而可以有效地对句法特征进行编码,实验结果表明了该方法的有效性。然而,之前的研究对单词间的依存关系利用并不充分,忽略了单词之间的依存关系类型信息,从而导致模型可能出现丢失重要情感信息的问题。

为了解决上述问题,该文提出一种关系交互图注意力网络(Relational Interaction Graph Attention Network,RIGAT)模型,该模型将关系特征融入到注意力机制中,使用一个新的扩展注意力来引导信息从目标方面的句法上下文传播到目标方面本身。首先,模型采用图注意力网络来学习依存树中单词节点的向量表示,并捕获其局部位置;其次,使用关系感知网络对依存树中每个单词节点之间的依赖关系进行特征表示,使模型更多地关注方面词;最后,将图注意力网络与关系感知网络的最终表示进行融合,然后通过分类函数计算并输出对应方面的情感极性。实验结果表明,该模型在基于方面的情感分类任务上取得了较高的准确率,进一步验证了模型的有效性。

1 相关工作

近年来,随着深度学习技术的发展,注意力机制逐渐开始应用于方面级情感分析任务。例如,马远等[6]提出一种融合左右双边注意力机制的文本情感分析模型,通过内部注意力机制来处理方面词,并根据方面词和上下文词设计了双边交互注意力机制,最后将上述注意力的处理结果进行级联并分类;程艳等[7]提出一种基于注意力机制的多通道CNN和BiGRU的神经网络模型,该模型通过注意力机制对情感极性分类重要的词语进行关注,并使用CNN与BiGRU分别提取文本的局部特征和上下文语义特征,获得了较好的效果;冯超等[8]提出使用层次注意力机制和门机制处理方面级情感分类任务,层次注意力机制负责更新方面词与上下文词的表示,门机制选择出对于方面词有用的上下文信息,实验结果进一步证明了该方法的有效性。

然而,基于注意力机制的情感分类方法并未考虑到文本的句法依存信息,忽略了文本句法结构对情感分类的重要性。已有学者对注意力机制与句法依存信息做了进一步研究,例如,Lu等[9]提出了一个交互式规则注意力网络,通过模拟句子的句法功能,并使用注意力网络从上下文中学习注意力信息,来考虑句法规则对情感的影响;张文轩等[10]提出一种将注意力机制与句法知识相结合的新方法,他利用依存句法关系和位置关系为每个句子建立面向方面的依存树,然后利用其对注意力权重进行监督,从而在利用语义和句法信息的同时减轻对依存树的依赖程度;Ke等[11]提出了一种新的基于句法依赖的注意力网络,该模型首先对每个单词和方面之间的依赖路径进行建模,随后将生成的句法表示输入注意力层,以进一步推断情感预测的依赖权重。

最近的研究利用图神经网络对句法结构进行编码,它解决了CNN和RNN无法处理非结构化数据的问题,同时对节点信息与结构信息进行端到端学习,从而有效地提取空间特征,增强方面情感分类的性能。例如,Zhang等[12]提出了一个特定于方面的图卷积网络,它将句法信息和长距离单词依赖性纳入分类模型,解决了由于缺乏相关句法约束和长距离词依赖而导致的模型对观点词判断错误问题;Wang等[13]提出了一个关系图注意力网络来编码依存树结构,他们以目标方面为根,重塑和修剪依存树来定义一个面向方面的依存树结构;Li等[14]提出了一种双图卷积网络模型,该模型同时考虑了句法结构和语义的互补性,进一步解决了由于依赖解析结果的不准确性以及文本的非正式表达所带来的问题;王光等[15]提出一种句法信息感知的方面级情感分类模型,该方法使用注意力机制,结合记忆文本语义、词性、方面与位置信息的记忆网络,以及基于依存句法分析树的图卷积神经网络,从而更准确地建立了方面词与观点词之间的联系;夏鸿斌等[16]提出了一种结合图卷积网络和注意-过度注意网络的方面级情感分类模型,他们通过在每个句子的依赖树上建立相应的图卷积网络,并利用注意力机制捕获方面词与上下文之间的交互和表示,实验结果证明了其优越性。

受以上方法启发,该文使用双向门控循环单元、图注意力网络和注意力机制来完成方面级文本情感分类任务,将文本的句法依存关系融合到上下文的语义信息中,再通过注意力机制学习方面词及其上下文之间的交互信息,从而进一步提高情感分类任务的性能。

2 关系交互图注意力网络

对于该文所提模型,每个训练实例由三个组件组成:目标方面、句子和句子的依赖树。形式上,可将这些组件表示为三元组:(a,s,d),其中a={wi,wi+1,…,wi+m-1}表示方面词序列,s={w1,w2,…,wi,…,wi+m,…,wn}表示句子序列,a和s的长度分别是m和n,d={V,A,R}表示句子s上的一个依存树,V包含所有的单词节点,A表示一个邻接矩阵,其中Aij=1表示词wi和wj之间存在依赖关系,否则Aij=0,R表示一个标签矩阵,它记录A中相对应的关系。方面情感分类的目标是通过给定的句子s和方面词a,预测情感极性y={-1,0,1},其中-1、0、1分别表示消极、中性、积极。

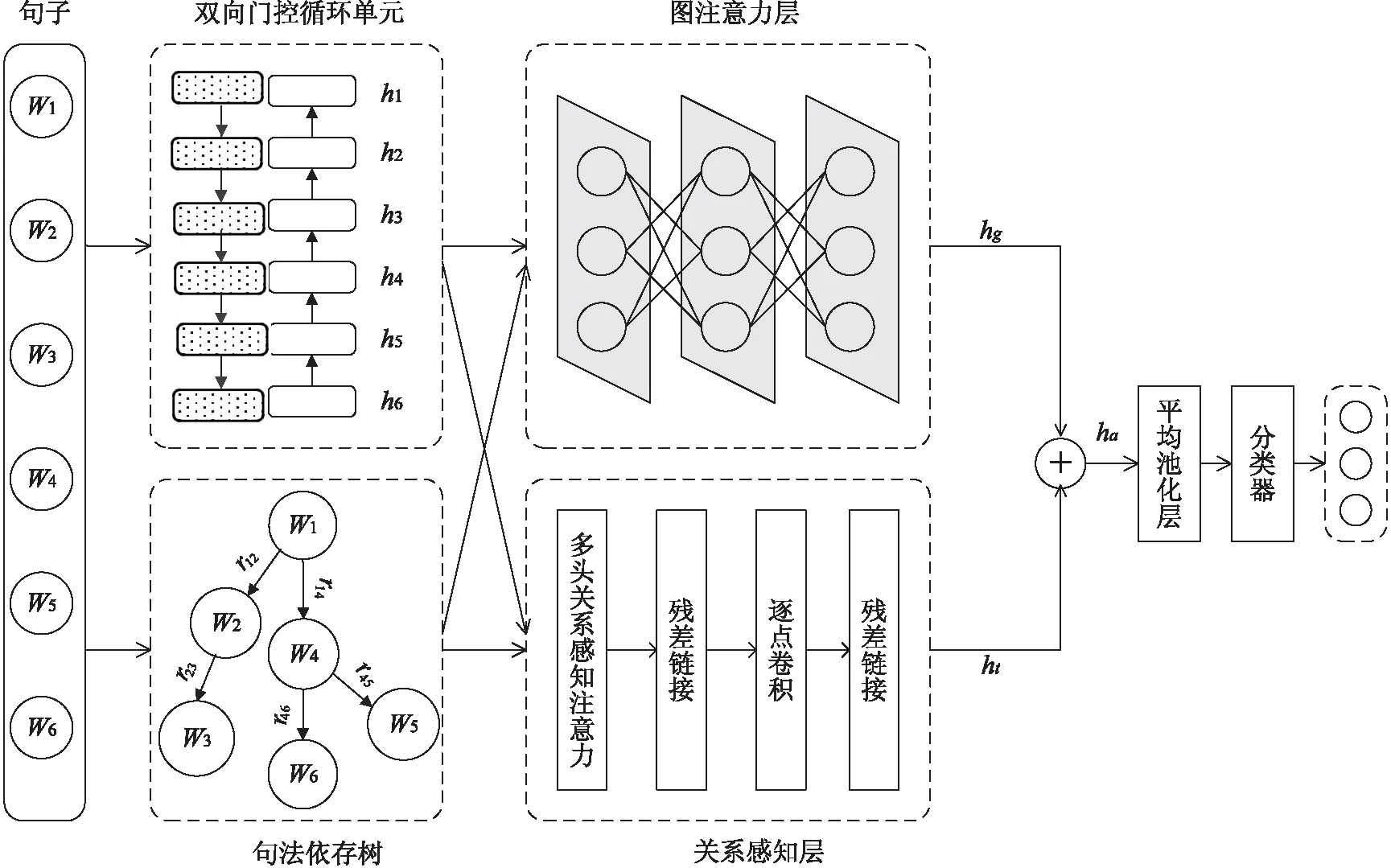

RIGAT模型的整体结构如图1所示,主要由三部分组成:

图1 模型框架

(1)双向门控循环单元:它将句子上下文编码进行特征学习。

(2)图注意力层与关系感知层:前者侧重于将句法信息与上下文信息进行建模,生成上下文感知的单词嵌入;后者侧重于捕获词与词之间的依存关系,生成关系感知的单词嵌入。

(3)特征融合与分类:它用于动态组合上下文和句法表示,并使用简单的池化函数进行特征融合。

2.1 双向门控循环单元

该文使用双向门控循环单元对上下文信息进行双向建模,该结构将具有n个有序词嵌入的句子s作为输入,将上下文信息集成到词嵌入中。其中,输入特征由GloVe嵌入vi、词性嵌入ti和位置嵌入pi组成,因此,一个单词就可以被表示为wi=[vi;ti;pi]。

若给定一个词嵌入序列s={w1,w2,…,wn},前向与后向GRU可以分别学习到词嵌入s传播的隐藏状态h1与h2,这就可以在向前的方向上捕获上下文信息。最后,将前向和后向GRU建模的并行嵌入连接成更高维的表示h={h1;h2}。

2.2 图注意力层与关系感知层

与标准的GAT相比,该文所提出的RIGAT模型还可以利用标签关系,从而产生更多的信息表示。对于未使用标签关系的GAT,其依存树形式表示为d={V,A},它使用相邻的矩阵作为结构信息,因此忽略了依赖特性。RIGAT扩展了原始GAT,将关系特征融入到注意力计算和聚合过程中,使其能对有标签关系的依存树d={V,A,R}进行建模。

(1)

其中,hi表示节点i的最终状态;ρ是激活函数;W是线性权重;A表示图G的一个邻接矩阵。

对于关系感知层,该文将依存树中两个词wi和wj之间的关系Rij转换成一个与依存关系维度一致的向量rij。在计算节点之间的注意力权重时,考虑了节点特征和关系特征,其中第l层节点感知的注意力权重eN和关系感知的注意力权重eR的计算公式分别如下:

(2)

(3)

(4)

通过这种方式,模型得到的注意力分数同时包含了节点特征和关系特征。

2.3 特征聚合与分类

ha=φ∘ht+(1-φ)∘hg

(5)

其中,∘是元素正交运算,φ是由上下文和句法感知表示共同加权并经激活函数σ计算所得:

φ=σ(Wφ[hg;ht]+bφ)

(6)

分类器是一个全连接网络,它将融合表示ha作为输入,并计算每个情感类别c的概率:

(7)

其中,W和b为模型的可调参数,C表示所有情感类别的集合。

2.4 模型训练

该文在损失优化部分,使用的训练方法是L2正则化的交叉熵损失:

(8)

其中,N表示训练案例数;I表示指标函数;λ表示正则化超参数;θ表示模型可调参数的集合。同时,该文采用了自正则化非单调函数Mish[17],其定义为:

F(x)=xtanh(ln(1+ex))

(9)

与常见的激活函数ReLU[18]相比,Mish的梯度更平滑,可以更好地让信息穿透神经网络,从而获得更高的准确性。

3 实验及结果

3.1 实验设置与评估指标

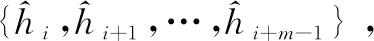

该文在四个公开数据集上进行实验,包括SemEval 2014的Restaurant和Laptop数据集[1]、Twitter提供的推文数据集[19]和一个大规模多方面多情感(MAMS)数据集[20],它们的情感极性可分为正面、负面和中性。表1显示了这些数据集中每个样本类别的统计信息,以及训练集、测试集的划分情况。

表1 数据集统计信息

在实验参数设置方面,该文采用300维的Glove[21]向量,其中包括8 400亿个词嵌入向量,依存关系向量为30维,这些向量在训练过程中会被调整。Batch Size设置为32,学习率设置为0.001,优化器使用Radam[22],句子的依存树使用Stanford[23]解析工具生成。同时,该文在所有公开数据集上使用固定的随机种子进行训练,以尽可能避免随机数对模型的影响。

该文使用准确率对模型性能进行评估,准确率的定义如下:

(10)

其中,P∈[0,1]为模型预测的准确程度,TP表示预测正确的样本数,FP表示预测错误的样本数。

3.2 基线模型

为了验证RIGAT的性能,该文与使用相同数据集的最新模型进行了比较,包括:

(1)CapsNet[20]:利用一种基于胶囊网络的模型来学习方面和上下文之间的复杂关系。

(2)G-ATT[24]:提出一种带有记忆融合的图注意力网络,通过给边缘分配不同的权重来扩展GCN。

(3)R-GAT[13]:通过对普通的依赖解析树进行重塑和剪枝,定义了一个基于目标方面的依赖树结构。

(4)RGAT[5]:提出一种新的关系图注意力网络,通过集成类型化的句法依赖信息,有效地提高了情感分类性能。

(5)UP-CNN[25]:提出一种基于先验知识的方面检测网络,并通过方面掩码来构建具有方面感知的上下文表示。

(6)SPRN[26]:提出一种基于方面的语义感知和细化网络,该方法采用了双门控多通道卷积来获取句子中的方面相关语义特征。

(7)GL-GCN[27]:提出一种全局和局部依赖引导的图卷积网络,通过利用句法依赖结构和句子序列信息来挖掘句子的局部结构信息,通过对整个语料库构图,挖掘单词之间的全局依赖信息。

(8)AFGCN[28]:通过引入依赖树和依赖位置图来增强每个实例的句法依赖,并使用图卷积网络将两者融合以生成交互情感特征。

3.3 结果分析

将该文所提模型与上述基线模型进行对比,以验证方法的有效性。实验结果的准确率如表2所示,其中“-”表示未找到对应数据。

分析表2的对比结果可以发现,RIGAT在四个数据集上的表现均优于其他基线模型,准确率分别达到了85.92%、79.37%、76.65%、83.56%。相较于目前性能最好的RGAT模型,该文所述方法在Laptop数据集上的性能提升最小,原因可能是由于Laptop数据集内的隐式情感表达样本较多,且数据量较少,导致模型不能很好地捕捉并分析方面与观点词之间的内在关系;而对于MAMS数据集,模型的性能提升最大,说明模型可以更好地捕获长距离单词间的依存关系。

表2 RIGAT模型与基线模型在不同数据集下的分类准确率 %

与其他基线模型相比,文中提出的RIGAT模型可以更好地对句法依存关系进行交互,考虑到英文文本具有时序性,通过句法解析的方式缩短了单词之间的依存路径,进一步简化了句子结构。同时,句法关系和注意力机制的融入进一步提高了句法信息的可靠性,使得模型可以更好地对每个单词进行权重分配,并在不同层次之间进行信息传播,从而得到更为准确的情感倾向。

3.4 消融实验

3.4.1 句法关系信息对模型的影响

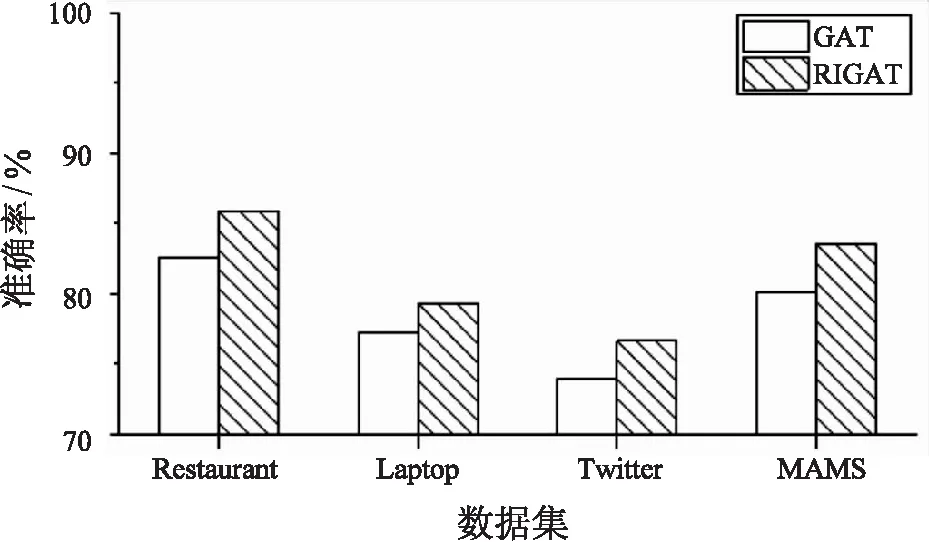

为探究句法关系信息对情感预测的有效性,该文使用传统GAT,去除句法关系信息,仅对方面和上下文进行建模。实验结果如图2所示,相较于仅使用传统的图注意力网络,RIGAT不仅考虑到了方面词与上下文之间的交互信息,而且充分地利用了单词与单词之间的句法关系信息,其在Restaurant数据集上的准确率分别提高了3.28百分点、2.16百分点、2.61百分点和3.44百分点。可见将句法关系信息融入到上下文信息之中,能有效提升情感预测的准确率。

图2 GAT与RIGAT在数据集上的准确率比较

3.4.2 RNN、LSTM与GRU的性能比较

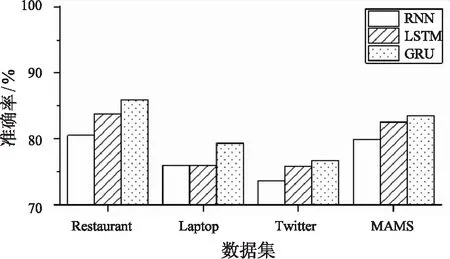

将GRU分别替换为LSTM、RNN网络,以验证GRU在所提模型中的优越性。实验结果如图3所示,可以发现相较于传统的LSTM,GRU在四个Restaurant和Laptop数据集上更具优势,分别提高了2.06百分点和3.37百分点,可能的原因是GRU使用了更新门与重置门存储并过滤信息,这种方式更适合于文本情感分类任务。

图3 LSTM、RNN、GRU分别在数据集上的准确率比较

3.4.3 模型层数的影响

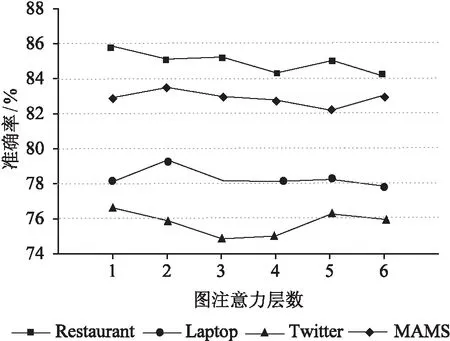

分别调整图注意力网络与关系感知网络的层数,检查对RIGAT准确率的影响。实验结果如图4、图5所示。综合结果分析,可以发现准确率曲线呈现出上下波动的趋势,并且往往在一开始就表现出最高分数。对于Restaurant和Twitter数据集,它们都在图注意力网络和关系感知网络层数为1时表现出最高的准确率;对于Laptop和MAMS数据集,当图注意力网络和关系感知网络层数为2时,模型的准确率最高。

图4 不同数量的图注意力层在数据集上的准确率

图5 不同数量的关系感知层在数据集上的准确率

4 结束语

该文提出一种基于关系交互图注意力网络的情感分类研究方法,利用图注意力网络与句法关系感知相交互的方式,共同提取句子的语义和句法信息,旨在充分利用文本间的句法依存特性,进一步提高方面情感分类的准确率。在公开数据集的实验结果表明,该文所提出的RIGAT模型相对于基线模型有更优越的表现。

尽管该文在情感分类任务上取得了不错的效果,但仍具有进一步改进的空间。一方面,由于该文只着重于公开数据集上的性能提升,而忽略了对模型的鲁棒性研究,在未来的研究中,模型需要结合更多的对抗性文本进行训练,以提升在方面情感分类上的鲁棒性能。另一方面,目前的研究仅局限于英文文本的情感分类研究,而忽视了中文情感文本,下一步将探索模型在中文文本上的可能性。