循环生成对抗网络基于颅脑MR图生成伪CT图模型

奚谦逸,张 钒,李奇轩,焦竹青,倪昕晔

(1.常州大学微电子与控制工程学院,江苏 常州 213164;2.南京医科大学附属常州第二人民医院放疗科,江苏 常州 213003;3.南京医科大学医学物理研究中心,江苏 常州 213003)

放射治疗(简称放疗)是治疗肿瘤的主要方法之一,要求射线准确照射靶组织以消除病灶,同时避免对周围组织造成损伤[1],放疗前精确描绘靶组织与正常组织至关重要。临床多基于CT图像勾画靶组织与正常组织器官,但其区分电子密度相近的软组织结构的效果较差,勾画靶区时或难以确定[2]。与CT相比,MRI可更好地显示软组织,近年已越来越多地用于制定放疗计划;迄今已有多种方法可基于MRI生成伪CT图像,传统方法包括基于分割[3]、图集[4]、统计学习[5]及随机森林的方法[6]。随着深度学习的发展,利用U-net[7]、生成对抗网络(generative adversarial networks,GAN)[8]及循环GAN(cycle-consistent GAN,CycleGAN)[9]等均可基于MRI生成伪CT图像。本研究基于U-net网络改进CycleGAN(UCycleGAN),利用颅脑MRI生成伪CT图,并评估其图像质量。

1 资料与方法

1.1 数据来源 收集2018年6月—2021年3月常州市第二人民医院50例鼻咽癌的颅脑MR图和CT资料,男22例、女28例,年龄35~86岁、平均(62.5±7.9)岁;将其中40例用于训练模型,另10例用于测试。MR图由Philips Achieva Scanner 1.5T MR设备获取,T1WI扫描参数:TR 1 343 ms,TE 80 ms,FA 90°,图像大小640×640×30~640×640×41,体素间距0.664 0 mm×0.664 0 mm×5 mm。CT图由GE Optima CT520设备采集,扫描参数:管电压120 kV,管电流220 mA,图像大小512×512×101~512×512×123,体素间距0.976 5 mm×0.976 5 mm×3 mm。

1.2 图像预处理 因采集2种模态图像时所用扫描条件不同,且相同患者的肌肉及脂肪在2种模态成像中的位置存在明显差异(非配对数据),故以CycleGAN网络对其进行训练。首先对MR图和CT图进行偏置场校准和刚性配准,以使2种模态图像中对应解剖结构的位置相同;再对CT图进行掩膜处理;之后以根据MR图提取的掩膜区域去除CT图中的体位固定装置(图1)。

图1 预处理后的CT图(A)与MRI(B)

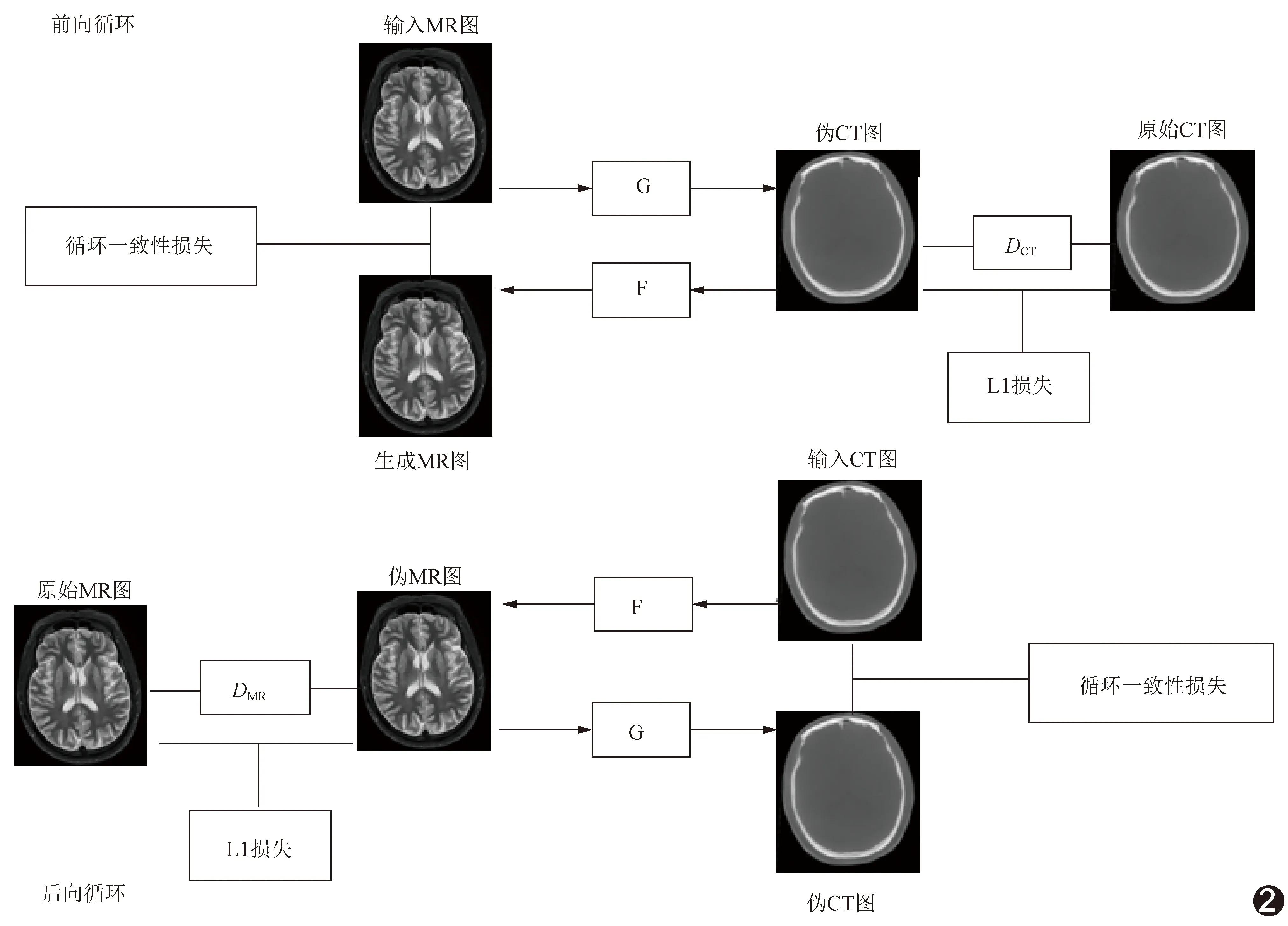

1.3 网络训练与测试 原始CycleGAN由前向循环和后向循环组成,其中分别有2个生成器G和F,以及1个判别器网络D。在前向循环中,生成器G以原始MR图作为输入,输出则为生成的伪CT图,将判别器DCT用于区分生成的伪CT图与原始CT图。将生成器G的输出作为生成器F的输入,F输出相应的伪MR图。将生成器F输出的伪MR图与输入生成器G的MR图进行对比,以构成前向循环的循环一致性。在后向循环中,以CT图作为生成器F的输入,其输出则为伪MR图;将判别器DMR用于区分生成的MR图与原始MR图;生成器G的输入为MR图,输出为伪CT图;将生成器G输出的伪CT图与输入生成器F的原始CT图进行对比,以构成后向循环的循环一致性[9]。

原始CycleGAN的生成器网络部分采用深度残差网络。在UCycleGAN网络中以U-net网络替换原始的深度残差网络,并在CycleGAN中加入L1距离函数,以最小化像素水平的平均误差,提高合成图像精准度(图2)。

图2 UCycleGAN的网络结构 (G、F为生成器,DCT、DMR为判别器)

CycleGAN由2种损失函数构成,分别为生成对抗损失函数和循环一致性损失函数。生成器G和F的生成对抗损失函数如公式(1)和(2)。前向循环一致性损失函数Lforward-cyc和后向循环一致性损失函数Lbackward-cyc组成循环一致性损失函数LCycle-consistency,如公式(3)~(5)。CycleGAN完整损失函数见公式(6)。

LGAN_G_MRto CT=Ect~Pdata(ct)[‖log(DCT(ct))‖1]+

Emr~Pdata(mr)[‖log[1-(DCT(G(mr)))]‖1]

(1)

LGAN_F_CTtoMR=Emr~Pdata(mr)[‖log(DMR(mr))‖1]+

Ect~Pdata(ct)[‖log[1-(DMR(F(ct)))]‖1]

(2)

Lforward-cyc=Emr~Pdata(mr)[‖(F(G(mr))-mr)‖1]

(3)

Lbackward-cyc=Ect~Pdata(ct)[‖(G(F(ct))-ct)‖1]

(4)

LCycle-consistency=Lforward-cyc+Lbackward-cyc

(5)

LCycleGAN=LGAN_G_MRtoCT+LGAN_F_CTtoMR+λLCycle-consistency

(6)

式中,λ是循环一致性损失函数所占的权重[10]。

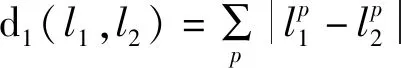

两幅图之间L1距离以公式(7)计算,即两幅图每个对应像素的灰度值差值的绝对值之和。将L1距离添加至CycleGAN中,则可以将L1距离函数以公式(8)改写。将L1距离函数加入CycleGAN原损失函数中,获得新的CycleGAN总损失函数,见公式(9)。

(7)

LL1=EMR,CT~Pdata(MR,CT)[‖G(MR)-CT‖1]+

ECT,MR~Pdata(CT,MR)[‖F(CT)-MR‖1]

(8)

LCycleGAN=LGAN_G_MRtoCT+LGAN_F_CTtoMR+λLCycle-consistency+βLL1

(9)

1.4 对比分析 分别采用ResNet、U-net的CycleGAN及Pix2Pix生成器[11]从MR图生成伪CT图。基于python实现基于不同深度学习模型生成伪CT图的任务,训练参数和UCycleGAN基本一致,均采用Adam优化器对模型进行200个轮次训练,批处理数据大小设置为1,初始固定的学习率为0.000 2,经过200个轮次训练后的学习率逐渐减少为0。

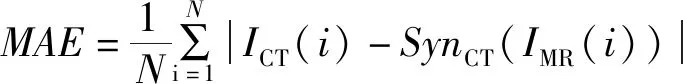

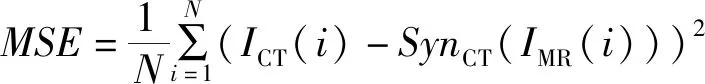

1.5 评估指标 利用平均绝对误差(mean absolute error,MAE)、峰值信噪比(peak signal-to-noise ratio,PSNR)及结构相似性(structural similarity,SSIM)评价不同网络生成的伪CT图与原始CT图之间的差异,见公式(10)~(13)。

(10)

ICT(i)表示原始的CT图某像素点的CT值,SynCT(IMR(i))表示伪CT图与原始CT图严格对齐的像素点的CT值。MAE越小代表伪CT图越接近原始的CT图。

(11)

(12)

式中,MAXI表示图像颜色的最大数值。MSE表示均方误差,PSNR越大就代表伪CT图失真越少,越接近原始CT图。

(13)

1.6 统计学分析 采用SPSS 22.0统计分析软件。以±s表示符合正态分布的计量资料,模型间评价指标比较行配对t检验。P<0.05为差异有统计学意义。

2 结果

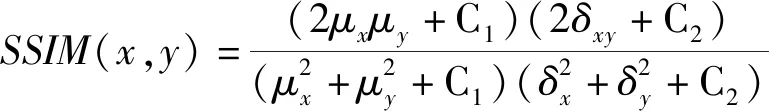

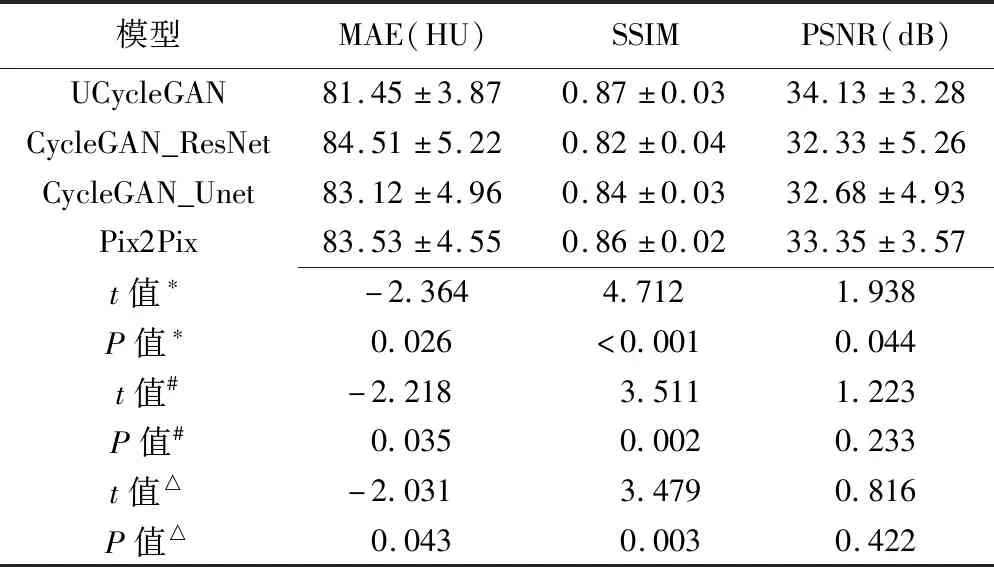

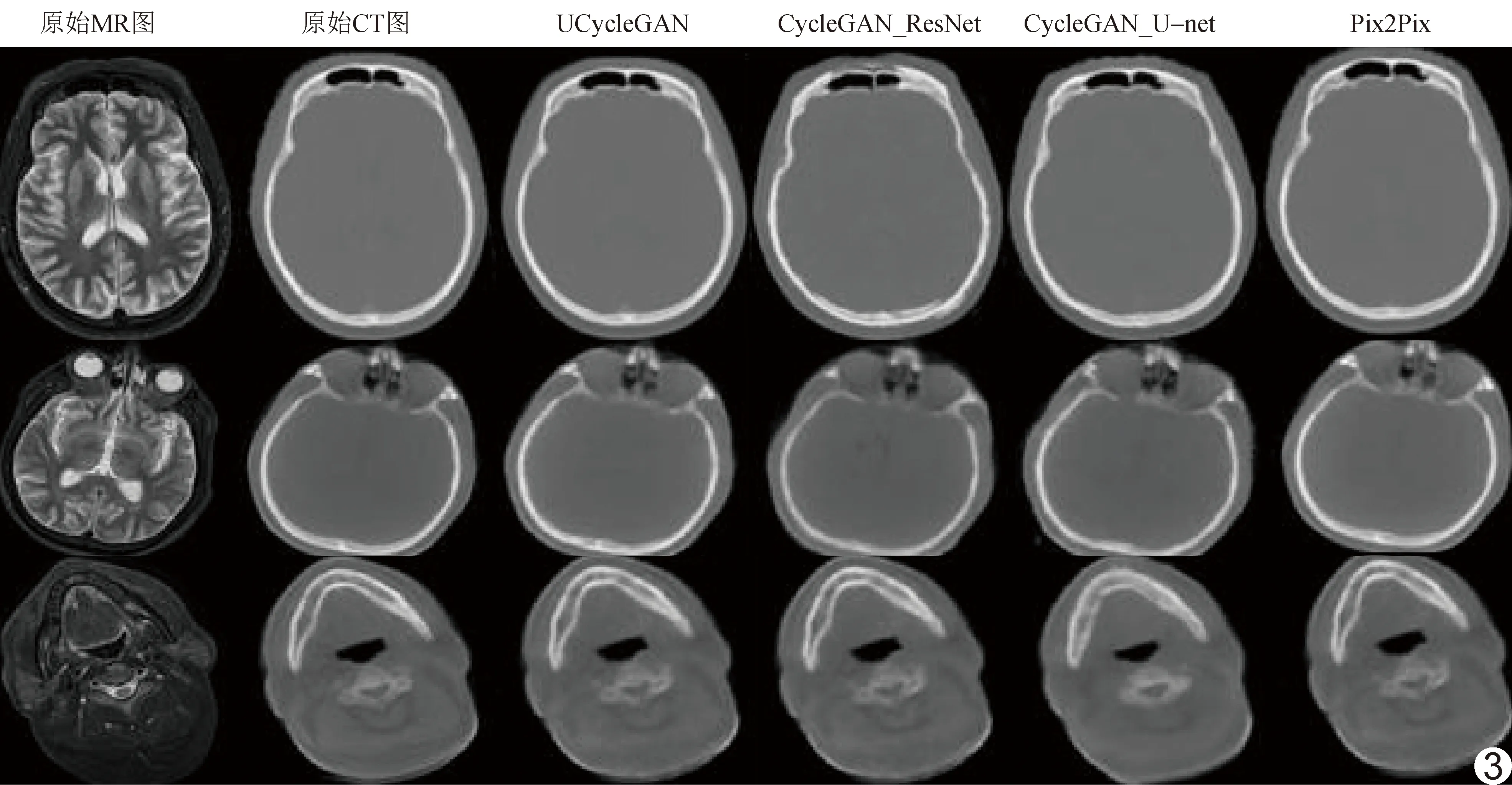

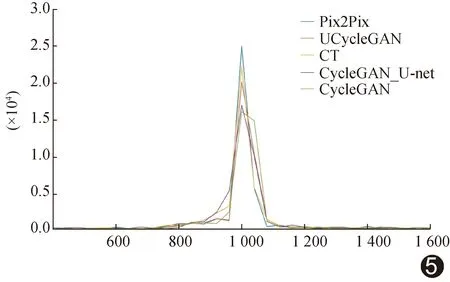

相比其他模型,采用UCycleGAN合成的伪CT图细节更丰富,更加贴近原始图像,见图3。相比原始CT图,以4种模型生成的伪CT图的骨质区域均存在误差;与CycleGAN_ResNet相比,采用UCycleGAN合成的伪CT图与原始CT图的差异最小,见图4。HU直方图(图5)显示,1 000 HU上下,UCycleGAN伪CT图与原始CT图的HU峰值更为接近。相比其他模型,UCycleGAN模型生成的伪CT图与原始CT图更为接近,其体素MAE为(81.45±3.87)HU,PSNR为(34.13±3.28)dB,SSIM为0.87±0.03。以UCycleGAN模型生成的伪CT图的MAE小于、而SSIM明显大于其他3种模型(P均<0.05);UCycleGAN伪CT图的PSNR大于CycleGAN_ResNet(P<0.05),与另2种模型比较差异均无统计学意义(P均>0.05),见表1。

表1 不同模型生成的伪CT图的评价指标

图3 基于MR图生成的伪CT图

图5 伪CT图与原始CT图的HU直方图

3 讨论

相比传统CT引导模式,采用MRI引导放疗具有安全、无辐射、对软组织对比度高等优点,但MR图无法提供电子密度的直接信息,故需先将MR图转换为CT图[12]。既往常以深度学习方法,如U-net[13]、GAN[14]、Pix2Pix[15]等,根据MR图生成CT图,均需要采用经过配对的MRI与CT数据集,且对数据配准精度要求较高;但临床实际工作中,常难以获得经过配对的MRI/CT数据集。

本研究提出在原始CycleGAN基础上更改生成网络,并添加L1距离函数的方法。CycleGAN在GAN的网络结构的基础上增加了1个还原网络用于还原输出,通过将还原后图像的像素与原始输入像素进行比较来确保输出与输入的对应关系,其还原均为提取特征后的还原,并不需要输出与输入在形式上完全一致,而要求其深层次特征保持一致,故可使用未经配对的数据集,即对获取数据的要求较低,可用于解决训练数据集配准精度不高的问题;可同时进行2种不同模态转换,以获得比常规网络更为丰富的图像信息。图像预测任务中,输入图像与生成图像的低级特征存在诸多相似处,利用U-net网络的跳跃连接将编码器和解码器中的对应特征映射并加以连接,可使编码器能够使用这些特征,进而减少损失;来自编码器的特征信息也可用于解码,以在更深层次上积累空间信息,故其相比残差网络更具优势。另外,L1距离函数倾向于最小化像素水平的平均误差,可提高图像合成精度。基于以上各项,与原始采用深度残差网络的CycleGAN及采用U-net的CycleGAN相比,本研究方法可减少在编码时损失的同时降低图像合成误差,提高图像合成质量;相比Pix2pix和原始CycleGAN生成图像,以上述方法生成的伪CT图可提供更多对比信息,显示骨骼更加完整,并更加贴近原始CT图;4个模型的误差均主要见于骨骼区域,可能与CT和MR成像原理差异有关。

尽管本研究采用UCycleGAN使得合成效果得到显著提升,但系将三维图像转换为二维图像,尚未利用图像的三维结构信息,仍需继续改进。

综上所述,利用UCycleGAN可由头颅MR图生成伪CT图,且比常规深度学习方法更为精准,有助于实现MRI引导放疗。