改进的LeNet-5网络在图像分类中的研究

陈恩志,王春阳,李晨晨,吴夏铭

(长春理工大学 电子信息工程学院,长春 130022)

随着图像采集设备的不断进步,以及图像处理技术的逐渐成熟,每一个领域都产生了大量的图片,使得图片以海量的形式存在,因此在海量图片中,每一个人怎么快速找到自己所需要的图片是人们关注的热点[1]。图像分类算法是提高图像检索效率的重点,因此研究图像分类算法具有十分重要的意义。图像分类的一般流程包括图像的预处理[2]、图像的特征提取以及分类器[3]的构建。传统的图像分类方法都是人为采取特征,比较常用的图像特征有颜色、形状等视觉特征,还有局部二值模式、尺度不变特征等。虽然这些特征有一定的普适性,但是对具体的图像针对性不强,尤其对于复杂图像,人工方法有很多明显的缺陷。传统的图像分类方法有支持向量机、k最近邻算法和多层感知器MLP(Multi Layer Perceptron)等,这些算法对一些图像分类简单的任务效果良好,但对处理复杂纹理特征的图像分类问题时,其分类精度一般。

近年来,计算机的快速发展使得深度学习逐渐进入了公众的视野。深度学习中的卷积神经网络在图像分类上的应用[4-7]开始逐渐广泛起来。相较于传统的图像分类方法,卷积神经网络不再需要针对特定的图像数据集或图像分类方式提取具体的人工特征,而是自主的从样本中学习特征和筛选特征,从而很好地解决了人工提取特征的难题,真正实现了智能化[8]。

基于改进的LeNet-5网络来对图像进行分类的优点在于:(1)引入跨链结构,充分地利用网络提取的低层次特征,并将网络提取的高层次特征和低层次特征有效地结合起来。(2)采用重叠池化并在池化层后面加上局部响应归一化操作,增加模型的泛化能力,防止过拟合。在Fer2013、Cifar-10和Fashion-MNIST数据集上进行的实验结果表明,与LeNet-5网络相比,改进的LeNet-5网络表现出了更好的分类能力。

1 卷积神经网络

1998年,LeCun和Bottou等人设计出了LeNet-5卷积神经网络,在手写数字识别与文档识别中取得了很好的效果,模型结构如图1所示。LeNet-5卷积神经网络是一个多隐层的人工神经网络,网络结构包括1个输入层,2个卷积层、2个池化层、2个全连接层和1个输出层。该模型输入的是32像素×32像素大小的图片,经过第1个卷积层之后,图像变为含有6个28像素×28像素大小的卷积特征图,经过第1个池化层之后,图像变为含有6个14像素×14像素大小的池化特征图,经过第2个卷积层之后,图像变为含有16个10像素×10像素大小的卷积特征图,经过第2个池化层之后,图像变为含有16个5像素×5像素大小的池化特征图,然后传递给3个全连接层获得特征的高层含义后由RBF(Radial Basis Function)分类函数分类输出。在LeNet-5卷积神经网络中卷积和池化的padding模式均设置为VSLID。

图1 LeNet-5网络结构图

2 改进的LeNet-5卷积神经网络

2.1 改进的LeNet-5卷积神经网络算法

LeNet-5卷积神经网络的缺点有:(1)没有充分利用网络提取到的低层次特征,只是将提取到的特征传递给下一层进行使用;(2)容易过拟合,泛化能力不强。针对这两个问题,借鉴了李勇等人[9]提出的跨连思想,提出了改进的LeNet-5卷积神经网络,模型结构如图2所示。与李勇等人不同的是,改进的LeNet-5网络的参数在训练中是可以调整学习的,且卷积和池化操作中的padding模式设置为SAME,减少了图像边界信息的丢失。该网络输入的是32像素×32像素大小的图片,经过2个交错的卷积层(H1,H3)和池化层(H2,H4)传递到全连接层H5,然后由全连接层H5和H6获得特征的高层含义后由输出层O分类输出,输出层的节点数代表着最后要分类的类别,3个实验中类别数分别为7、10和10。注意第1个池化层H2和第2个池化层H4向后传播的同时与全连接层H6相连,这样全连接H6既包含了H4和H5的提取的全局特征,又包含了H2提取的低层次特征,使得低层次特征充分的被网络所利用。LeNet-5网络的池化策略是滑动步长和滑动窗口大小相等,重叠池化策略是滑动步长小于滑动窗口大小,这样在相邻池化窗口之间就会出现重叠区域,从而使得池化层既降低了网络的特征维度又充分地提取了特征。为了提高网络的泛化能力,在池化层后面加入了局部响应归一化LRN(Local Response Normalization):

图2 改进的LeNet-5卷积神经网络结构图

表1 改进的LeNet-5卷积神经网络结构参数描述

2.2 多连卷积神经网络的学习过程

整个网络的学习过程分为正向传播和反向传播两个过程。其中前向传播就是利用卷积、池化等操作对图像特征进行提取。反向传播采用BP算法,使用Adam优化器调整更新网络中的参数。

式中,f(·)代表 ReLU 激活函数;downλ,τ(·)表示最大池化操作,滑动窗口的大小为λ×τ;⊗表示内卷积运算[10];wn,i和bn,i(n=1,3)分别表示第n个隐藏层的卷积核和偏置;表示第n个隐藏层的第i个卷积面;表示第n个隐藏层的第i个池化面;w5和b5分别表示第1个全连接层的权值和偏置;w6-1、w6-2、w6-3分别表示前两个池化层H2和H4以及第1个全连接层H5与H6层之间的权值;b6表示第2个全连接层的偏置;w7和b7分别表示输出层的权值和偏置;和O分别表示第1个全连接层、第2个全连接层与输出层的输出。输出层采用softmax分类函数,则损失函数定义为:

式中,sj表示输出分类为类别j的概率;d是类别总数;yj代表的是第j个标签。

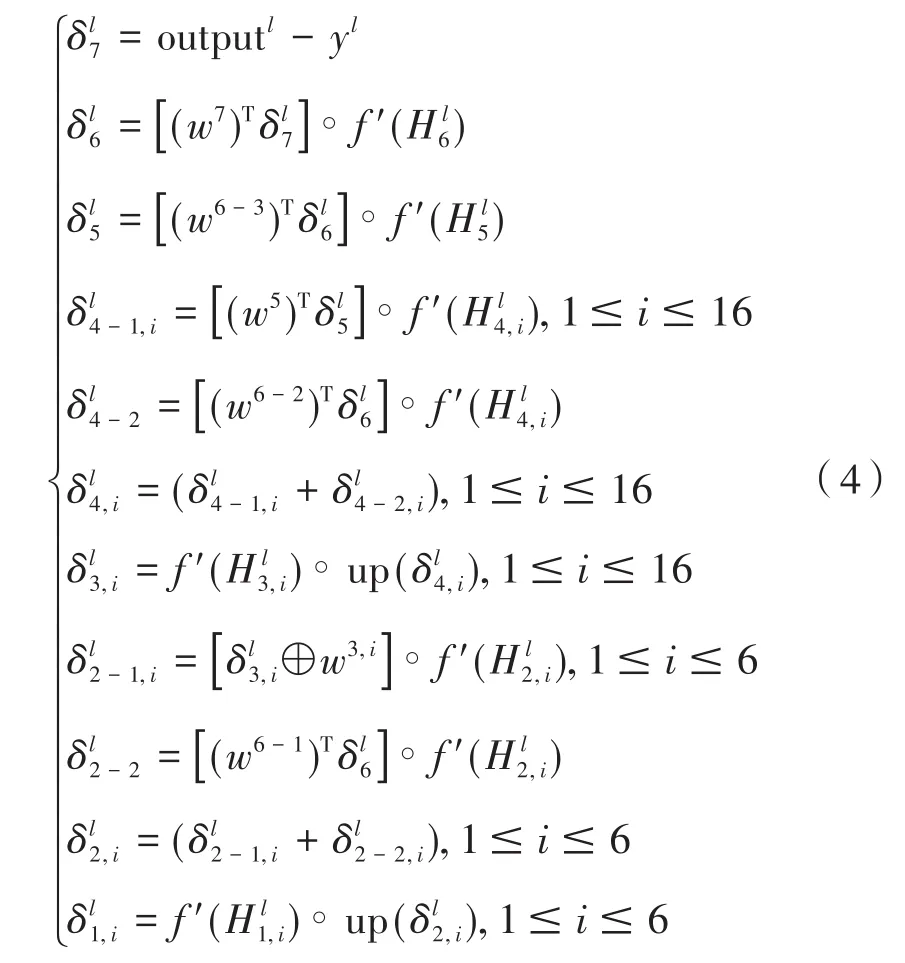

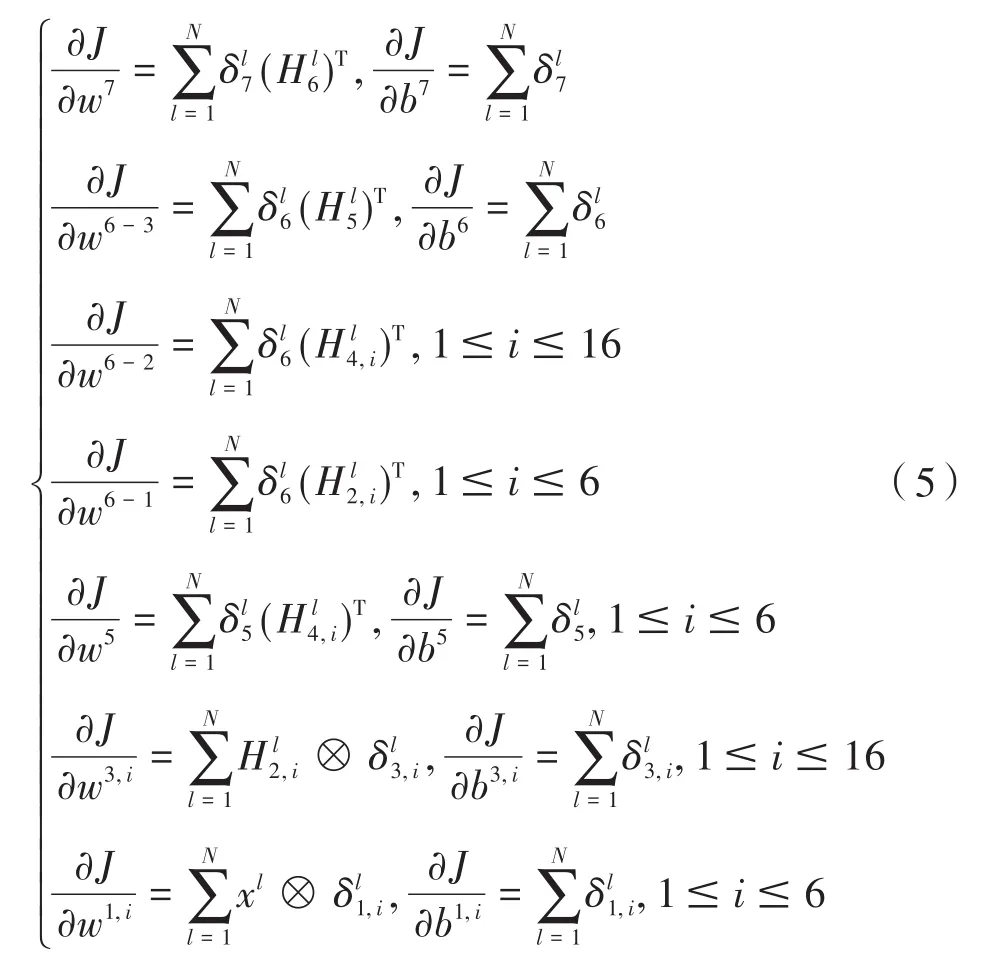

2.2.2 多连卷积神经网络的反向传播过程

式中,outputl和yl分别表示网络的实际输出和期望输出;up表示上采样;∘为哈达玛积;⊕表示外卷积操作;表示输出层与全连接层的反馈传递误差;表示第n个隐藏层的第i个卷积面或池化面的反馈传递误差;和分别表示H6层传递给H4和H2层的反馈传递误差,所以H4和H2层接收到的反馈传递误差为两部分之和。在得到每一层的反馈传递误后,便能求得每一层的权值和偏置的偏导数,如下:

改进的卷积神经网络的整体算法流程如下:

(1)输入迭代次数=30 000、样本批次、初始学习率=0.000 1、网络结构、训练集;

(2)随机初始化网络的卷积核和偏置;

(3)正向传播,计算每个样本的实际输出值;

(4)反向传播,计算每一层的反馈传递误差,以及权值和偏置的偏导数;

(5)使用Adam优化器更新调整网络的权值和偏置值。

3 实验

本实验的硬件配置为 Intel(R)Core(TM)i7-8750H CPU@2.2 GHz,内存32 GB,GPU为NVIDIA GeForce GTX080ti。软件配置为深度学习框架Tensorflow。

3.1 数据集

在Fer2013、Cifar-10和Fashion-MNIST数据集上验证算法的准确率。为了便于处理,将Cifar-10数据集中的彩色图片转换为灰度图片。Fer2013数据集有7个分类,分别由35 886张48×48的灰度图片组成。其中有28 708张训练图片和7 178张测试图片。该数据集中各个样本在年龄、面部等方面都有较大的差异性,具有一定的实际意义,但在分类时造成了巨大的困难。图3为Fer2013数据集中的示例图片。

图3 Fer2013数据集中的示例图片

Cifar-10数据集有10个分类,分别由60 000张32×32的彩色图像组成。其中有50 000张训练图片和10 000张测试图片。该数据集纹理特征较为复杂且图片不够清晰,导致数据集分类困难。图4为Cifar-10数据集中的示例图片。

图4 Cifar-10数据集中的示例图片

Fashion-MNIST数据集有10个分类,分别由70 000张28×28的灰度图像组成。其中有60 000张训练图片和10 000张测试图片。该数据集每个类别纹理之间的差异不大,导致数据集分类不准确。图5为Fashion-MNIST数据集中的示例图片。

图5 Fashion-MNIST数据集中的示例图片

3.2 实验结果及分析

实验过程中2种算法均使用相同的权值和偏置初始化方式、学习率、批次大小、目标损失函数和参数更新方式。在实验中将Fer2013和Fashion-MNIST数据集的图片转换为32×32像素大小。图6、图7和图8分别展示了不同算法在Fer2013、Cifar-10和Fashion-MNIST数据集上的准确率随迭代次数的增加而变化。

图6 不同方法在Fer2013的准确率

图7 不同方法在Cifar-10的准确率

图8 不同方法在Fashion-MNIST的准确率

由图6可知,LeNet-5卷积神经网络在Fer2013数据集上的分类能力最低,准确率为68.75%。与LeNet-5相比,改进的LeNet-5网络的分类准确率提高了20.84%,准确率为89.59%。

由图7可知,LeNet-5卷积神经网络在Cifar-10数据集上的分类能力最低,准确率为57.81%。与LeNet-5相比,改进的LeNet-5网络的分类精度提高了34.38%,准确率为92.19%。

由图8可知,LeNet-5卷积神经网络在Fashion-MNIST数据集上的分类能力最低,准确率为87.06%。与LeNet-5相比,改进的LeNet-5网络的分类精度提高了4.57%,准确率为91.63%。

由图6、图7和图8可知,改进的LeNet-5网络在图像分类中的效果不错,对LeNet-5网络的改进是有效的。给LeNet-5网络多加了跨连结构,充分地利用了网络提取的低层次特征,采用重叠池化并在后面加上局部响应归一化操作,增加模型的泛化能力。在Fer2013和Cifar-10数据集上的实验结果表明与LeNet-5网络相比,改进的卷积神经网络在对复杂纹理图像进行分类时有更好的效果。为更好地验证改进的LeNet-5网络的有效性,将改进的LeNet-5网络与近几年具有代表性的算法在Cifar-10数据集上进行比较,如表2所示。由表2可知,与传统算法Meancovariance RBM以及深度学习算法(Stochastic pooling ConvNet、跨连卷积神经网络)相比,改进的LeNet-5网络有很好的分类效果,与Highway算法相比,改进的LeNet-5网络的分类准确率稍低,主要原因是Highway算法用了19层网络,且进行了长时间的训练。

表2 不同算法在Cifar-10数据集上的分类精度

4 结论

在LeNet-5卷积神经网络的基础上,提出了改进的LeNet-5卷积神经网络。该网络能够通过跨链的方式充分利用网络提取的低层次特征,并有效的将网络提取的低层次特征和高层次特征结合起来。采用重叠池化层并在后面加入局部响应归一化操作增加了网络模型的泛化能力,从而提高网络的分类能力。实验结果表明,改进的LeNet-5网络在3个数据集的分类能力均高于LeNet-5网络,较小的网络结构就有不错的分类能力。但相对于网络结构较大的神经网络,其分类能力略低,下一步研究计划是寻找各层特征之间的深度关系,运用反卷积等方法实现网络各层特征的可视化,努力用较小的网络结构达到与较大的网络结构具有相同的分类准确率。