人工智能在肺癌影像基因组学方面的研究与进展

贾利叶,任雪婷,赵涓涓,,武 炜,杨倩倩

(1.太原理工大学 信息与计算机学院,太原 030024;2.晋中信息学院,山西 晋中 030800;3.山西医科大学 基础医学院,太原 030051)

肺癌是世界范围内导致癌症死亡的主要原因[1-3]。70%的肺癌诊断是在晚期局部或转移性疾病出现症状后进行的,诊断后的5年生存率约为16%[4]。只有当肺癌患者被确诊时仍是局部症状,生存率才会达到50%以上[5]。不幸的是,肺癌患者的疾病进展和对治疗的反应差异很大,只有15%的肺癌在早期阶段被诊断出来[6-7]。因此,准确的诊断与预后对于每个肺癌患者的治疗选择和规划至关重要。

医学图像在肺癌的临床决策过程中起着重要的作用。近年来,从常规临床图像中提取影像学标记物的研究越来越多,都是以非侵入性的方式深入了解肺癌[8],而不同的可用方式越来越被认识到包含高维可挖掘数据,这反过来可用于改善医疗决策[9]。医学图像也可以帮助表征瘤周区域,并可能传递与肿瘤微环境相关的信息[10-11]。例如,肿瘤的影像学特征被越来越多地用于预测基因表达[12]。此外,最近的研究表明,癌症的分子机制与特定的影像学表型有关[13]。因此,通过医学图像提供预后和预测信息,正在成为癌症个性化医学领域的关键参与者。

近年来,人工智能(AI)在解决计算机视觉和图像分析中复杂的现实问题方面显示出了越来越大的能力,特别是在医学图像分析方面取得了显著的成功,如CT图像检索[14]、PET/CT图像重建[15]、MRI图像检测[16]等。通过人工智能技术和计算机视觉的应用,影像组学及影像基因组学的最新进展允许从图像和基因中提取和挖掘许多定量特征[17-18]。先进的机器学习和深度学习算法的发展可以增强图像分析,并帮助临床医生完成具有挑战性的诊断任务,如识别肿瘤基因表型[19-20],检测肿瘤转移[21],肿瘤生存复发预测[22]及疗效评估预后[23]等。

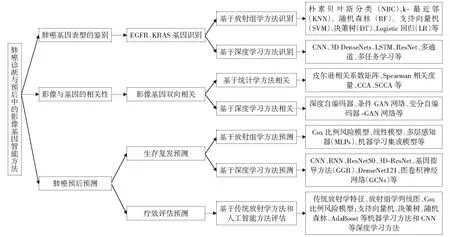

本文重点介绍影像基因组学基于人工智能算法的相关研究进展以及其在肺癌智能诊断与预后中的应用,内容框架如图1所示。在肺癌基因表型鉴别的应用中,分别从放射组学方法和深度学习技术的角度总结与梳理了肺癌中EGFR、KRAS基因识别的应用现状,并且简单分析了后续可继续进行的研究。在肺癌智能诊断中影像与基因的相关性分析方面,分别从统计学方法以及深度学习两个角度进行分析。虽然取得了一定的成果,但大多研究都是统计学意义上的一些相关性,没有呈现直观的视觉效果,而基于深度学习的影像基因双向相关性则可以实现,但仍然处于尝试阶段,需要进一步研究探讨相关技术及方案。在肺癌预后预测方面,简单总结了肺癌基于影像和影像基因进行生存复发预测以及疗效评估预测两个方面的工作,而基于人工智能算法的疗效反应评估研究内容还较少,较分散,需要进一步挖掘。

1 影像基因组学与人工智能

影像基因组学(又称放射基因组学)是一门将医学成像技术与基因组学技术相结合的交叉学科[24],是一种将成像特征与基因组数据相关联的高通量研究方法。它不仅从图像数据中提取反映诊断的定量图像表型特征,而且从生物学数据中提取基因型特征,进而分析肿瘤的影像学特征与分子表型之间的关系[25]。影像基因组学具有医学成像的无创、廉价、可重复的特点,具有利用分子技术直接探索疾病根源的优势[26]。因此,影像基因组学被应用于疾病的成像诊断、基因表型鉴别、预后预测及疗效评估等。其方法主要分为以下4个步骤:a.图像采集和处理;b.感兴趣区域(ROI)分割;c.特征提取和量化;d.构建预测和预后模型[27]。在肺癌的诊断和治疗过程中,产生了大量丰富的具有不同数据类型的数据,包括文本、图像、生命体征数据、基因组数据等[28]。随着计算硬件和深度学习算法的发展,影像基因组学与人工智能的结合已经用于各种预测和预后模型[29]。

图1 影像基因智能方法在肺癌诊断与预后中的应用Fig.1 Application of intelligent imaging genomics in diagnosis and prognosis of lung cancer

在人工智能的悠久历史中,对人工智能的定义有很多。一般来说,人工智能的定义非常宽泛,涵盖了大量的计算机技术。如今,人工智能代表了一种新兴的、快速发展的模型,它涉及不同的科学领域,也致力于癌症患者的管理[30]。它可以被视为一个一般概念,表明机器能够学习和识别足够数量的代表性模型的模式和交互,并使用这些信息来改进当前对特定领域决策过程的方法[31-32]。在人工智能的应用中,机器学习和深度学习被广泛应用于肺癌的筛查[33]、诊断[34]和治疗[35],发挥着至关重要的作用。在精确肿瘤学领域,人工智能旨在将来自当前高性能计算设备的大量多组学数据与深度学习方面的进展相结合[36],这使得人工智能的应用逐步扩大,包括癌症影像基因组学的特征、肿瘤微环境的分析、具有预后和预测目的的生物标志物的评估,以及后续疗效研究和药物发现的策略等[37]。

为了更好地理解在影像基因组学中人工智能当前的角色和未来的前景,首先应该理解机器学习和深度学习。机器学习是一个通用概念,表明机器的学习能力,即计算机程序可以在给定某种类别的任务和性能度量下学习经验,从而改进分析模式和模型。而深度学习是机器学习的一种,主要是使用多层非线性处理单元构建复杂的深度网络进行特征提取和转换,进而确定模型预测性能[38]。值得注意的是,在影像基因组学中,一般运用机器学习算法分析影像特征,并与其基因组学相关联,运用深度学习方法训练大量图像和基因数据构建预测算法。这两种方法都便于在分析定量数据时考虑一个特定的临床问题,在人工智能的肺癌患者管理中也是核心的[39]。因此,基于机器学习和深度学习的肺癌影像基因组学方法对识别肿瘤基因表型、分析影像基因双向相关性、预测肿瘤生存复发及评估疗效预后等也具有重大的潜力和应用价值。

2 影像基因智能方法在肺癌基因表型方面的鉴别

基因表型在肺癌的治疗决策中起着核心作用,基于影像预测肺癌中2个基本致病基因表皮生长因子受体(EGFR)和鼠类肉瘤病毒(KRAS)的突变状态是一种无创、成本较低的方法,具有靶向治疗的价值,检测肺癌患者的多种基因改变是决定靶向治疗适用性的关键。

肿瘤的特征是体细胞突变,例如特定的基因突变,可以影响参与肿瘤发展和进展的生物过程,最终反映在肿瘤表型[40]。人工智能方法可以通过使用预定义的机器学习算法或深度学习方法自动量化表型特征,这一过程也被称为放射组学。随着放射组学在临床实践中的引入,越来越多的癌症治疗决策不仅基于患者的临床特征和肿瘤形态,而且还基于个体突变图谱[41-43]。放射组学提取并分析了大量先进的高通量定量图像特征,是一种很有前途的非侵入性方法,并广泛用于评估肺癌中的基因突变。EGFR和KRAS的突变状态对于NSCLC患者的靶向治疗至关重要,因为它们是靶向治疗前了解肺癌致病的关键基因,尤其EGFR-TKIS抑制剂为敏感突变的患者带来了更长的生存期[44]。一些研究已经报道了使用放射组学来鉴别EGFR、KRAS突变的研究进展[45-46]。

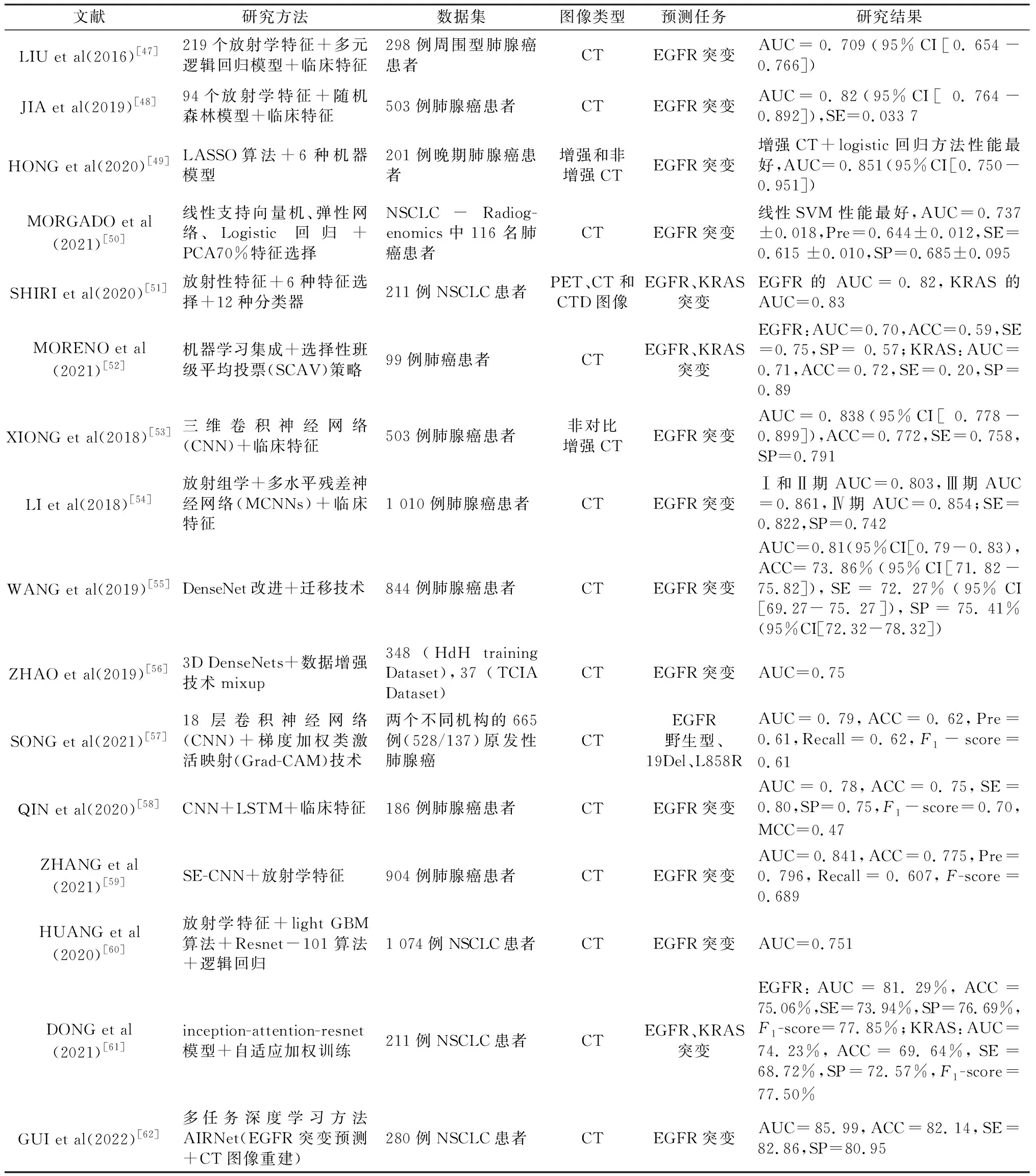

针对肿瘤表型中单一基因突变,LIU et al[47](2016)基于298例手术切除的周围型肺腺癌患者,从CT图像每个肿瘤的分割体积中提取219个大小、边缘、透明度和均匀性等定量三维特征,利用多元逻辑回归模型以识别EGFR突变状态,最终AUC为0.647.JIA et al[48](2019)收集并分析503例手术前的肺腺癌CT扫描结果,提取其定量放射组学特征,并建立随机森林分类模型识别EGFR突变体。结果发现具有94个放射组学特征的随机森林模型的性能AUC达到了0.802,并通过增加性别和吸烟史,其AUC进一步提高到0.828.HONG et al[49](2020)基于201例晚期肺腺癌患者的增强和非增强CT成像,人工分割并提取396个特征,采用LASSO算法进行特征选择,并用6种机器学习方法:朴素贝叶斯分类器(NBC)、k-最近邻(KNN)、随机森林(RF)、支持向量机(SVM)、决策树(DT)和Logistic回归(LR)构建放射组学模型无创地识别晚期肺腺癌中的EGFR突变。结果发现基于增强CT成像放射组学特征的logistic回归方法取得了最佳效果,其AUC为0.851.MORGADO et al[50](2021)利用各种线性、非线性和集成预测分类模型,以及几种特征选择方法,对野生型或突变型EGFR突变状态的二元结果进行分类。结果发现使用包含肺结节ROI的综合方法可以捕获更充分的相关信息,并且基于线性支持向量机、弹性网络、Logistic回归和结合特征集方差为70%的主成分分析特征选择方法构建的模型,是性能最好的分类器,AUC值为0.725~0.737.针对肿瘤表型中多基因突变,SHIRI et al[51](2020)利用NSCLC癌症患者的186例PET和175例低剂量CT和CTD图像,从不同的图像特征集中提取了2万多个放射性特征,采用6种特征选择方法和12种分类器来预测患者的EGFR和KRAS基因突变状态。结果发现机器学习算法比常规临床放射特征方法有更高的预测能力,EGFR的AUC为0.82,KRAS的AUC为0.83.MORENO et al[52](2021)提出了一种新的基于选择性班级平均投票(SCAV)的机器学习集成方法,并利用小的数据集提高了EGFR和KRAS突变预测的性能。结果发现所提出的模型,对于EGFR突变,AUC从0.68增加到0.70,对于KRAS突变,其性能也显著提高,AUC为0.65~0.71.

虽然上述放射组学、机器学习和统计方法已经成功地识别了肺癌患者基因突变,但它们需要复杂和严格的程序,需要经验丰富的成像医生的全面指导,从检测分割到特征提取和特征选择,非常耗时耗力,且结果是不可重复的。此外,在一些提取语义信息的研究中,需要有经验丰富的医生来指导,而语义特征本身较难提取。近年来,深度学习由于具有强大的特征提取和分类能力,在人工智能领域取得了巨大的成功,在基因突变图像预测研究中也逐渐发展。例如,已经有一些研究探索了几种深度学习方法来预测NSCLC患者的CT图像上的EGFR突变状态。XIONG et al[53](2018)基于503例肺腺癌患者的非对比增强CT图像,构建了三维卷积神经网络(CNN)来分析CT图像中人眼看不见的潜在模式,进而从野生型中识别出EGFR突变的患者,CNN模型识别EGFR突变状态的准确性为71.5%,而CNN与临床特征(性别、吸烟史)的融合模型识别准确性可达77.2%.LI et al[54](2018)使用放射组学和多水平残差神经网络(MCNNs)在1 010例肺腺癌患者的胸部CT图像上检测EGFR突变的能力,发现放射组学和MCNNs都可以预测肺腺癌患者CT图像上的EGFR突变,且MCNNs在检测EGFR突变方面性能优于放射组学。WANG et al[55](2019)收集了来自两家医院的844例肺腺癌患者的术前CT图像、EGFR突变和临床资料,基于迁移学习技术提出了一种端到端深度学习模型,从CT图像中自动学习与EGFR突变相关的特征,并预测肿瘤为EGFR突变的概率,在独立验证集(241例)上准确性为73.86%,在训练集和验证集上AUC分别为0.85和0.81.同时深度学习模型还可以发现与EGFR突变状态密切相关的可疑肿瘤亚区域。ZHAO et al[56](2019)分析了579个(348个训练,116个验证)具有突变型或野生型的EGFR突变状态标记结节的数据集,提出了一个深度学习模型3D DenseNets,并采用数据增强技术mixup来处理CT数据中的三维结节斑块,进而通过监督训练学习强表征来预测EGFR突变。SONG et al[57](2021)以两个不同机构的665例(528/137)原发性肺腺癌为研究对象,采用18层卷积神经网络(CNN)直接区分EGFR突变的三种常见亚型:野生型、19Del和L858R,并采用梯度加权类激活映射(Grad-CAM)技术对CNN模型进行视觉解释,证实了深度学习在预测肺腺癌中EGFR突变状态方面的潜力。这些方法主要采用多层卷积神经的方法使用CT图像作为输入,并自动提取高级特征表示,用于EGFR突变状态预测。

为了继续改善性能,研究者们开始考虑结合放射组学特征与深度学习方法,从多类型特征、多基因关联角度去识别基因突变状态。QIN et al[58](2020)基于先验医学知识的临床特征和由卷积神经网络(CNN)提取的CT图像定量特征,利用LSTM分析了特征间的依赖性,并进行融合,以提供更全面、更详细的EGFR突变状态描述,同时生成了一种新的计算机辅助诊断特征表示方法。结果表明,与单类型特征表示相比,基于多类型依赖的特征表示表现出更好的性能(精度为75%,AUC=0.78).ZHANG et al[59](2021)从每个病变区域提取1 037个基于肺腺癌CT的放射组学特征后,选择784个特征进行分析,构建特征映射,设计并训练了一种挤压和激励(SE)卷积神经网络(SE-CNN),从放射组学特征映射中识别EGFR状态,内部和外部测试数据集的AUC分别为0.910和0.841.HUANG et al[60](2022)手工分割1074例非小细胞肺癌CT图像的VOI(感兴趣区域),捕获临床病理特征,分析传统的放射学特征,提取放射组学和深度学习特征,进行了特征筛选;然后应用Light GBM算法、Resnet-101算法、逻辑回归建立单一模型,并应用融合模型预测EGFR突变条件,发现融合模型(CNN+radiomic+clinical)展示了最高的性能(AUC为0.751).DONG et al[61](2021)基于非小细胞肺癌(NSCLC)CT图像提出了一种多通道、多任务的端到端深度学习(MMDL)模型,用于同时预测EGFR和KRAS突变状态。该模型首先将每个三维肺结节分解为9个视图;然后,对每个视图使用预先训练的inception-attention-resnet模型来学习结节的特征,再通过结合9个inception-attention-resnet模型进行自适应加权训练来预测肺结节的基因突变类型。

现有的基于深度学习的方法通常采用单一任务学习策略,在有限训练数据的情况下设计和训练EGFR、KRAS突变状态预测模型,这可能不足以学习可区分的模型来提高预测性能。为此,GUI et al[62](2022)提出了一种新的多任务深度学习方法AIRNet,集成了EGFR突变状态预测和辅助图像重建任务,可以从共享编码器中学习可区分的肿瘤特征,充分利用多层次信息准确预测EGFR突变状态,同时引入特征一致性损失函数,有助于获得增强的图像重建,从而在训练过程中为AIRNet提供了更有效的正则化。该方法在EGFR突变状态预测方面具有显著的性能。这项研究为我们后续研究非侵入式基因突变预测任务提供了新思路,将无监督图像重建、图像分割等作为辅助任务,重建输入的CT、PET等图像,同时结合EGFR、KRAS突变状态预测的主要任务,构建模型捕获不同任务之间的可泛化特征。这将在训练过程中产生额外的监督,以更好地理解NSCLC肿瘤的内在特征。另外,还可以结合其他表达性语义特征,可以定量地呈现已知的语义信息,并充分考虑模型的可解释性。

将人工智能和放射组学应用于肺癌基因突变识别任务的进一步研究正在进行中,临床上迫切需求智能诊断技术加以辅助。表1详细描述了基于非侵入图像处理在肺癌基因突变状态识别中的应用现状,研究图像类型主要包括肺癌CT、PET图像等,预测任务包括识别EGFR、KRAS基因突变等。研究方法主要包括放射组学方法(朴素贝叶斯分类器、k-最近邻、随机森林、支持向量机、决策树、Logistic回归等)以及深度神经网络(CNN、ResNet、LSTM、DenseNet、Inception V-等)。评价指标主要采用准确率(ACC)、精确度(Pre)、敏感性(SE)、特异性(SP)、AUC值、召回率(Recall)、F1-score、马修斯相关系数(MCC)等。虽然利用放射组学方法和深度学习技术已经逐步实现了基于影像预测肺癌基因的突变状态,但是放射组学方法要依靠有经验医生的标注及分割,进而手工提取特征,耗时耗力。深度学习技术虽然避免了手工特征的提取,实现了端到端训练,但是提取的深度特征具有不可解释性。大多这些方法只考虑了单任务预测基因突变,多基因之间的关联性是否影响预测结果还不清楚,需要通过实验进一步验证。在后续的研究中,可以侧重基于多类型影像数据、多基因、多任务(如重建+预测、自动分割+预测等)等去鉴别肺癌基因的表型,并考虑增强模型的可解释性与泛化性能。

表1 影像基因智能方法在肺癌基因表型鉴别方面的应用Table 1 Application of intelligent imaging genomics in gene phenotype identification of lung cancer

3 影像与基因在肺癌智能诊断方面的相关性分析

临床常规影像学检查通常是捕捉肿瘤行为最直接和最好的方法,有可能帮助提供疗程中整个肿瘤和所有肿瘤的更全面的视图。基因测序技术的进步使我们能够识别分子特征,这些特征有助于监测肿瘤生长,以指导疾病的预防和治疗。然而,由于肿瘤的异质性,这些技术受到活检的局限。因此,图像特征与基因组数据相结合的方法在提供更好的个性化决策支持方面具有巨大的前景。

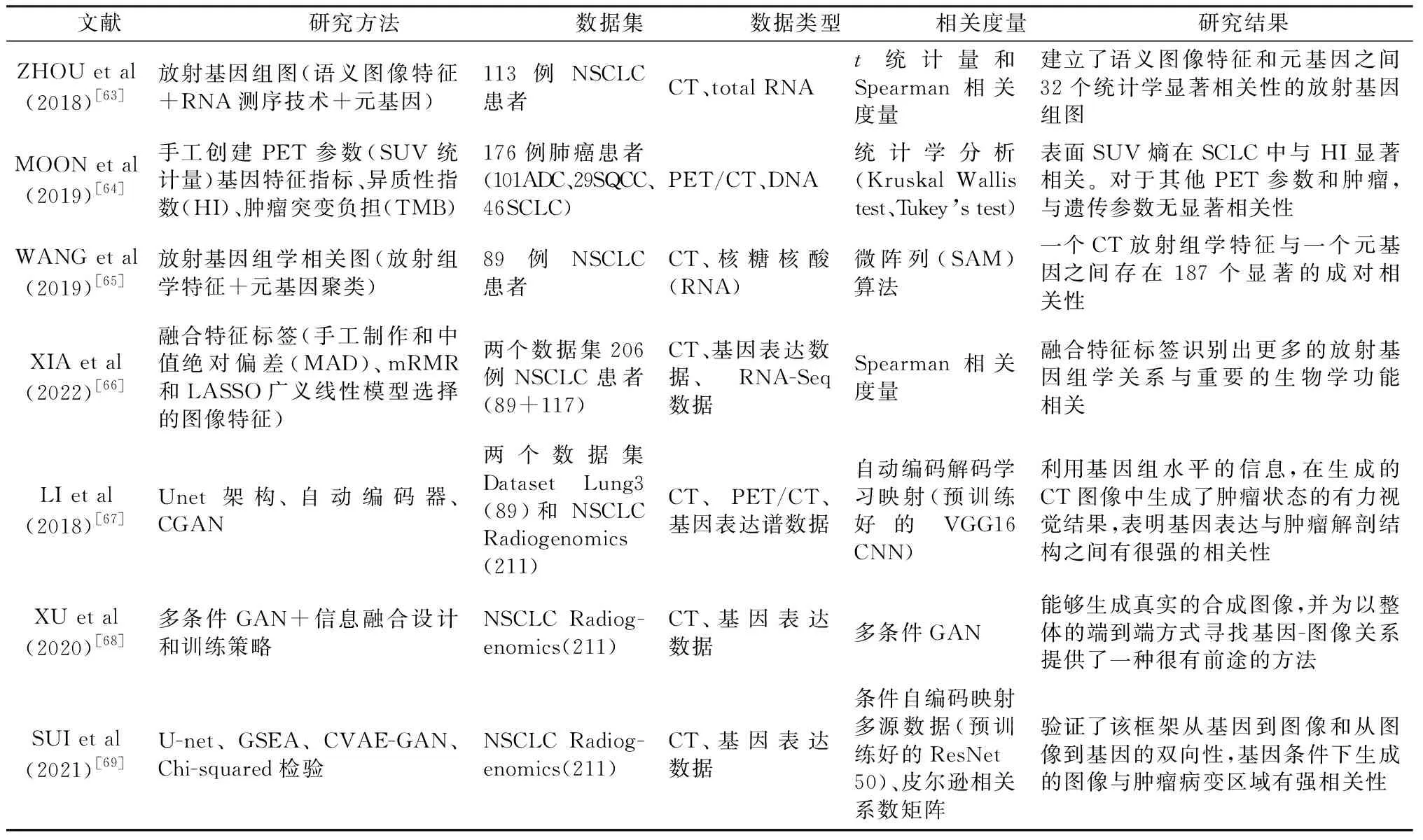

从肺癌病变中提取的图像特征为筛查诊断、治疗计划和临床分析提供了一个高度交互信息的途径。然而,只有少数研究整合了基因组数据和图像数据,构建了这些信息相关性的放射基因组学框架。传统上,连接图像特征和基因表达谱的放射基因组图谱在非侵入识别特定类型疾病的分子特性方面具有巨大的潜力。这种图谱可以分为三个独立的步骤:1) 对元基因的基因聚类;2) 图像特征的提取;3) 元基因与图像特征之间统计相关性的分析。每一步都是单独执行的,并依赖于各自的度量方法,而不考虑彼此之间的相关性。例如,ZHOU et al[63](2018)基于113例含术前CT数据和肿瘤组织的NSCLC患者,提取了87个语义图像特征来反映结节形状、边缘、纹理、肿瘤环境和整体肺特征。然后,从组织中提取总RNA,用RNA测序技术进行分析,选出10个高共表达的基因簇(元基因),利用t统计量和Spearman相关度量,建立了语义图像特征和元基因之间具有32个统计学显著相关性的放射基因组图。MOON et al[64](2019)对176名研究对象的每个肿瘤部位制作了106个PET参数,用统计学方法研究了肺癌患者的遗传特征指标、异质性指数(HI)、肿瘤突变负担与FDG PET/CT特征之间的相关性。WANG et al[65](2019)对89例NSCLC患者提取并选择放射组学特征来量化CT扫描上的肿瘤表型,同时共表达的基因也被聚类,且聚类的第一个主成分被定义为一个元基因。然后,进行统计学分析,以评估CT放射组学特征与元基因的相关性。验证发现CT放射组学特征与NSCLC的元基因之间存在187个显著的成对相关性。然而,以往的放射基因组学研究主要依赖于单一类别的图像特征提取技术,未能利用融合特征所获得的互补信息。XIA et al[66](2022)利用从图像中提取的手工特征和深度学习特征提出了一种融合特征标签,并用两个公共数据集评估了融合特征表示放射基因组学关系的能力。结果显示,融合特征标签编码了肿瘤的互补成像特征,并识别出更多的放射基因组学关系与重要的生物学功能相关,这有助于未来的肺癌诊断和治疗。

以上研究大多是通过分析组织样本来识别医学图像特征和分子特征之间的统计学意义上的显著相关性,不能给出直观的病理情况的视觉结果。此外,具有手工制作特征的放射基因组学研究是模糊的,对临床医生没有解剖学意义,且这些特性大多是冗余的,并强烈地依赖于领域知识。随着深度学习的发展,研究者们开始考虑整体和端到端的策略去寻找影像基因间的相关性。LI et al[67](2018)设计了一个以深度学习为中心的放射基因组学框架来表征图像特征和基因表达谱数据,并量化它们的相关性。首先将基因表达和CT/PET图像中的肿瘤生长信息结合到自动编码器网络中,以关联图像和基因组特征;再利用基因组水平的信息基于条件GAN(CGAN)生成基于CT图像肿瘤状态的直观视觉结果,该结果可以证明基因表达与肿瘤解剖结构之间有很强的相关性。XU et al[68](2020)基于NSCLC数据集开发了一个以背景图像和基因表达编码为条件的多条件GAN,使得图像和基因特征在不同的尺度上进行融合,合成了相应的图像,同时具有学习放射基因组图的潜力。结果表明,该方法能够生成逼真的合成图像,揭示了基因只控制病变对象,并为以端到端方式寻找基因-图像关系提供了一种可行的方法。SUI et al[69](2021)提出了一个基于深度学习的放射基因组框架,构建肺肿瘤图像与基因组数据的关系,进而实现生成过程,形成一个双向框架来表征多源医学数据。首先,采用基于U-Net的分割方法从原始CT图像中获得肿瘤区域(TR);然后,利用自动编码器对基因条件下的图像进行编码,从不同层次的编码器中提取图像特征,将这些特征、预后数据和基因用于一系列分析实验,证明这些多源数据之间的相关性。最后,改进的CVAE-GAN将基因转化为相应的TR,并给出了直观的结果。

端到端框架消除了手工制作特征的需要,以寻找影像和基因数据之间的关系。然而,由于数据集规模可能存在局限性和数据不平衡问题,基于深度学习模型研究影像基因间的相关性,获得的视觉结果倾向于将肿瘤定位在肺边缘附近,这就需要我们后续进一步探讨和解决。同时,考虑到影像基因间的相关性也影响着肺癌患者的预后与生存结果,为了获取更精确的视觉结果辅助临床医生,数据增强技术和新的生成模型策略是必要的。目前已有一些临床研究探讨了肺结节的特征及其与相关基因编码的相关性。此外,基于深度学习基因编码和图像数据的相关性研究也展示了有希望的结果,并且有可能产生临床影响。现阶段这方面的探索较少,仍有许多未解的问题。表2详细描述了影像与基因在肺癌智能诊断方面的相关性分析应用,数据类型包括CT、PET/CT、DNA、total RNA、RNA、基因表达数据等,相关性度量方法包括统计学分析(t统计量和Spearman相关度量、Kruskal Wallis 检验、Tukey’s 检验、皮尔逊相关系数矩阵等)和深度学习(自编码器、条件自编码器等学习映射关系),研究方法包括放射基因组图谱、融合特征标签、CGAN、多条件GAN以及CVAE-GAN等。

表2 影像与基因在肺癌智能诊断方面的相关性分析应用Table 2 Application of correlation analysis between imaging and gene in intelligent diagnosis of lung cancer

4 影像基因智能方法在肺癌预后预测方面的研究

大多数肺癌目前是在晚期被发现和诊断的,生存率较低。虽然早期肿瘤发现和治疗可以提高肺癌患者的生存率,但如既往研究报道,恶性肿瘤手术切除后的肺癌复发率仍在30%~60%之间[70]。因此,为了更有效地治疗和管理肺癌患者,建立有效的临床标志物或预测模型对更准确地预测肿瘤手术预后至关重要。

4.1 生存复发预测

研究人员已经探索了不同的基因组生物标志物来识别肺癌发展和生存复发预测[71-73]。尽管结果很有希望,但使用基因组生物标记物仍面临多种挑战,并存在一些局限性,如具有较高的成本、仪器检测错误、主观评分的处理错误以及较低的特异性[74-75]。在目前的临床实践中,影像学检查仍然在肺癌的检测、诊断和预后评估中起着至关重要的作用,但是阅读和解释大量肺癌病例图像对放射科医生来说是困难的。因此,随着计算机辅助技术的快速发展,各种机器学习和深度学习方法的应用在癌症预后预测中发挥着越来越重要的作用[76]。人们对基于从肺癌图像中计算出新的定量图像标记物预测癌症生存复发的研究越来越感兴趣,各种预测算法正被不断探索[77-78]。例如,WANG et al[79](2019)基于NSCLC患者的CT成像特征提出了一种预后复发分析方法。首先,分割肺肿瘤区域并提取特征。其次,对提取的特征数据进行优化,以去除冗余特征。然后,以优化后的特征数据和患者的预后作为输入,采用机器学习方法进行训练,并构建分析模型来预测NSCLC患者的预后。实验结果表明,基于CT图像灰度、形状和纹理的随机森林分类器的预后复发模型的预测准确率高达84.7%,可有效地帮助医生对NSCLC患者做出更准确的预后。ASTARAKI et al[80](2019)对30例NSCLC患者的PET/CT图像进行了尺寸感知纵向模式(SALoP)分析,即根据其大小将肿瘤划分为1-10个同心区域,对每个区域分别计算PET和CT图像两次扫描之间的平均强度变化,形成所提出的新特征集,并对所提出的新特征集和经典的放射组学特征相结合进行评估。利用特征选择算法识别最优特征,并训练线性支持向量机进行总体生存预测,与利用单一类型特征预测相比,取得了更高的AUC值(0.90).AMINI et al[81](2020)提出了基于PET和CT图像的特征层次融合和图像层次融合的多层次多模态放射组学模型,来提高NSCLC患者的总体生存预测。结果表明3D小波变换融合策略预测生存风险的一致性指数最高(C-index=0.708).WANG et al[82](2018)利用深度卷积神经网络CNN,开发了一种基于肺癌病理图像的肿瘤区域自动识别系统,建立并验证了一个基于肿瘤区域形状的预后风险预测模型。MUKHERJEE et al[83](2020)开发了一个浅层卷积神经网络(LungNet)用于分析跨4个医疗中心的CT图像,来预测NSCLC患者的总生存率,各独立生存数据集的总生存率的一致性指数分别为0.62、0.62、0.62和0.58.此外,将生存模型通过迁移学习,用于肺图像数据库(n=1010)的良性和恶性结节的分类,性能(AUC=0.85)有所提高。WU et al[84](2021)提出了一种用于NSCLC生存分析的多模态深度学习方法(DeepMMSA),该方法利用CT图像结合临床数据,基于3D ResNets实现了全自动的端到端的肺癌生存分析,使医学图像中保存的丰富信息与生存信息相关联,提供了足够粒度的个性化预后和决策。表3详细描述了影像智能方法在肺癌生存复发预测方面的应用,数据类型包括CT、PET/CT、临床数据等,研究方法主要包括放射组学方法(SVM、RF、DT、KNN、Cox比例风险、Logistic回归、多层感知器等)以及深度神经网络(CNN、ResNet、DenseNet等)。评价指标主要采用ACC、AUC、SE、SP、一致性指数(C-index)、平均绝对误差(MAE)、风险比例(HR)等。

表3 影像智能方法在肺癌生存复发预测方面的应用Table 3 Application of intelligent imagingin survival and recurrence prediction of lung cancer

然而,上述技术仅使用图像信息,其预测性能是有限的。许多研究试图使用临床可接受的基因表达信息和图像相结合的方法(影像基因组学)来最大限度地提高肺癌生存复发的预测性能[85]。一方面,研究者们利用非深度学习方法在肺癌影像基因数据的基础上开展肿瘤生存复发预测。GEVAERT et al[86](2012)针对26例NSCLC患者,为图像特征和元基因之间的成对关联创建了一个放射基因组学相关图,然后利用稀疏线性回归的方法,基于图像特征建立了元基因的预测模型。类似地,图像特征的预测模型也是根据元基因来建立的。最后,当预测的图像特征被映射到具有生存结果的公共基因表达数据集时,肿瘤大小、边缘形状和清晰度的预后意义排名最高。EMAMINEJAD et al[87](2016)分别训练了8个图像特征的朴素贝叶斯网络分类器和2个基因组生物标志物的多层感知器分类器来预测早期肺癌复发风险,AUC值达到0.84.SUBRAMANIAN et al[88](2020)通过结合CT图像和RNA测序等基因组学,使用具有弹性网络正则化的线性Cox比例风险模型对NSCLC患者的术后复发进行了预测,同时基于C-index量化风险评分的正确排序程度和基于时间相关的AUC曲线衡量模型的分类能力。WANG et al[89](2021)提出了一种新的联合标签融合方法,在估计不同模态产生的预测之间的相关性时,考虑了含不同隐藏层全连接神经网络模型的不确定性。通过CT图像和基因表达数据对NSCLC手术切除患者一年生存预测的实验研究,证明了该方法的良好性能。SINGH et al[90](2021)基于85例NSCLC患者开发一种放射基因组模型来识别高危患者,并预测生存期。使用Mann-Whitney U检验识别224个稳健特征的子集(p值>0.05)来鉴别各属性(扫描切片厚度、重建核和对比度增强)的差异。采用主成分分析方法,从放射性特征和基因组特征中提取10个主成分。最后使用一个5折交叉验证的多变量Cox比例风险模型(200次迭代)来计算一致性指数(C-index=0.62),以衡量模型预测总体生存率的能力。另一方面,人们也在探索利用深度学习方法在肺癌影像基因数据上预测肿瘤的生存复发风险。AONPONG et al[91](2021)提出了一种基因型引导的放射组学方法(GGR),以获得低成本的NSCLC患者术后复发高预测精度。该方法是使用两个模型的两步方法,第一个模型是基因估计模型,利用从放射组学特征和CT图像中提取的深度特征来估计基因表达,第二个模型使用估计的基因来预测复发。实验表明GGR方法预测复发的准确率达到83.28%.

将医学图像处理和计算机视觉技术应用于肺癌生存复发预测任务的研究正在进行中。临床上迫切需要智能化辅助手段来帮助医生减轻负担,快速找到合适的诊疗方案。表4详细描述了影像基因智能方法在肺癌生存复发预测方面的应用现状,研究图像类型主要包括肺癌CT、PET/CT图像、基因表达数据等,预测任务包括预测早晚期肺癌的生存复发等。研究方法主要包括放射组学方法(朴素贝叶斯分类器、多层感知器、SVM、无监督聚类、Logistic回归、Cox比例风险回归、全连接神经网络等)以及深度神经网络(CNN、ResNet等)。评价指标主要采用一致性指数(C-index)、时间依赖的AUC(TD-AUC)、ACC、SE、SP、AUC、HR等。虽然已有不少研究利用放射组学方法探讨了影像基因在肺癌生存复发预测的可行性,但是由于肿瘤的异质性、快速生长可变性引起的不可预知病变或转移情况,还需进一步的研究去提高模型的预测性能。此外,基于影像基因相结合的策略,将深度学习技术应用于肺癌生存复发预测已经开始了尝试性的研究,这是未来研究的一个有趣的方向。后续可以将数据迁移学习、多模态融合和多阶段融合(是一种以结构化的方式模拟成像和基因组学之间的生物相互作用的方法)等机制引入各种深度学习模型中,去构建更好的预后模型,以便进行更全面的评估,辅助临床医生制定诊疗方案。

表4 影像基因智能方法在肺癌生存复发预测方面的应用Table 4 Application of intelligent imaging genomics in survival and recurrence prediction of lung cancer

4.2 疗效评估预测

在肺癌诊治过程中,有效的疗效评估预测对于制定和调整临床治疗方案具有重要价值[92]。近年来,肺癌的治疗工作取得了前所未有的进展。影像组学和影像基因组学将临床、基因以及影像大数据结合起来,对肺癌患者的分子和基因改变以及癌细胞免疫逃避机制的不断了解,为新的靶向药物、免疫治疗药物及个体化治疗(术后特异性化疗、放疗)铺平了道路[93]。随着研究的不断深入和拓展,人工智能结合医学图像分析和数据挖掘方法的无创技术,在肺癌治疗反应评估中的潜在应用也引起了相当大的关注[94]。

肺癌治疗结果评估和影像学检查需要进行常规随访和肿瘤复发监测[95]。然而,为了充分解决肺癌的异质性本质和治疗完成后可能的复发,还需要更个性化的监测[96]。不少学者将目光置于影像组学及影像基因组学对肺癌治疗疗效反应的预测。对于放射组学方法,HUYNH et al[97](2016)分析了113例接受立体定向身体放疗(SBRT)治疗的Ⅰ~Ⅱ期NSCLC患者CT图像。首先根据稳定性和方差选择了12个放射性组学特征,然后将放射组学特征与常规影像学指标(肿瘤体积和直径)和临床参数进行比较。发现一个放射学特征(小波LLH统计数据范围)对远处转移有显著的预后(C-index=0.67,q值<0.1),而常规和临床参数都没有。LI et al[98](2017)基于92例Ⅰ期或ⅡA期NSCLC患者,研究治疗前CT扫描的影像学特征是否与立体定向体放疗(SBRT)后的总生存期(OS)、无复发生存期(RFS)和局部无复发生存期(LR-RFS)相关。首先除临床特征外,还对24个语义图像特征进行手工评分(选择最高的5个),基于全肿瘤分割提取219个计算机衍生的“放射学”特征。然后采用Cox比例风险模型和Harrell’s C指数进行统计学分析,评估最终预后模型的稳健性,结果发现2年OS、RFS和LR-RFS的AUC分别为72.8%、74.7%和69%.YAN et al[99](2020)通过分析100例肺癌放疗患者的CT图像来评估机器学习(SVM、DT、RF、AdaBoost)预测肿瘤反应的效果。首先对CT图像进行放射组学分析,对特征进行筛选,训练50名患者的机器学习分类器,然后在测试数据集中进行训练。结果发现具有2个放射性特征(平整度和变异系数)的SVM分类器在测试集上的AUC为0.91.从肺肿瘤的感兴趣体积来看,平整度和变异系数可以作为基于CT图像预测肿瘤反应的生物标志物。LIU et al[100]通过识别影像生物标志物评估放射组学列线图,对接受抗PD1免疫治疗的197例晚期NSCLC患者的治疗反应状态(有应答者/无应答者)进行预测。首先根据基线和首次随访(TP1)CT影像数据对靶向病变(TL)方法和最大靶向病变(LL)方法进行了放射组学表征,基线和TP1之间放射组学特征的相对净变化表示为Delta-放射组学特征,最后采用最小冗余最大相关性(mRMR)和LASSO逻辑回归进行特征选择和放射组学标签构建。结果发现基线时的放射组学特征对LL(P=0.10)、TL(P=0.27)方法的反应状态均没有显著的预测价值,而结合Delta放射组学特征与有远处转移临床因素的Delta放射组学列线图,针对靶向病变在区分有应答者和无应答者方面有令人满意的表现。在训练集和测试集中,AUC分别为0.83(95%CI:0.75~0.91)和0.81(95%CI:0.68~0.95)。放射组学试图从患者的医学图像(包括预处理和随访图像)中提取大量有价值的信息,并定量地将图像特征与诊断和治疗结果联系起来,取得了一定的研究成果。

深度学习可以整合多个时间点的扫描图像,自动提取图像特征和识别复杂数据中的非线性关系,以改善临床结果预测。例如,HOSNY et al[101](2018)使用3D卷积神经网络(3D CNN)确定了接受放疗的771例肺癌患者的预后特征;然后,采用迁移学习方法对391例手术患者进行相同的操作。结果发现,3D CNN预测2年总生存率与放疗治疗开始后的(AUC=0.70[95%CI:0.63~0.78],P<0.001)和手术后的(AUC=0.71[95%CI:0.60~0.82],P<0.001)患者显著相关。此外,为了更好地理解3D CNN所捕获的特征,还确定了对预测贡献最大的肺部区域,并强调了肿瘤周围组织在患者分层中的重要性。XU et al[102](2019)通过分析局部晚期NSCLC患者的时间序列CT图像,训练深度学习网络来预测临床结果。具体包括:基于179例接受明确放化疗的Ⅲ期NSCLC患者,使用CNN与循环神经网络(RNN)对1、3和6个月的随访和治疗后的CT图像进行迁移学习,并使用单种子点定位肿瘤。随后又对另外89例接受放化疗和手术治疗的NSCLC患者进行了病理反应验证。发现CNN模型性能得到增强(2年总生存率:AUC=0.74,P<0.05)。结果表明使用时间序列扫描的深度学习模型可以显著预测生存率和癌症特异性结果(进展、远处转移和局部-区域复发)。MU et al[103](2020)提出了一个基于PET/CT的深度学习模型,通过对深度学习的特征进行无监督层次聚类,识别对EGFR突变的酪氨酸激酶抑制剂(TKIs)或免疫检查点抑制剂(ICIs)治疗敏感的NSCLC患者。结果表明,在接受EGFR-TKIs治疗的患者中,深度学习评分(EGFR-DLS)与较长的无进展生存期(PFS)显著正相关,而在接受ICIs治疗的患者中,EGFR-DLS与更高的持久临床获益、更低的高进展和较长的PFS显著负相关。因此,EGFR-DLS为精确定量NSCLC患者的治疗策略选择提供了一种无创的方法。

虽然医学影像一直能提供对疾病的个人评估,但基于影像生物标记物的人工智能算法有望准确地对患者进行分层,并为个性化医疗服务提供新的研究途径。这种新兴的方法允许早期诊断和定制患者特定的治疗,从而在正确的时间为正确的患者提供适当的医疗护理。表5详细描述了影像基因智能方法在肺癌疗效评估预测方面的应用现状,研究图像类型主要包括肺癌CT、PET/CT图像、临床数据等,疗效评估包括预测接受SBRT治疗的反应、放化疗及手术后的反应、接受抗PD1免疫治疗的反应状态、TKIs或ICIs治疗敏感反应等。研究方法主要包括放射组学方法(统计学分析、SVM、DT、RF、AdaBoost、无监督聚类、LASSO逻辑回归、Cox比例风险回归等)以及深度神经网络(3D CNN、RNN等)。评价指标主要采用C-index、AUC、HR等。从综述来看,基于人工智能算法进行疗效评估还存在许多障碍,包括需要标准化的数据收集方法、评估标准、前瞻性验证和报告协议等,这些在精确医学内的最大临床预期影响都需要进一步的研究。此外,基于影像基因组学的人工智能算法在疗效评估预测方面的研究还较少,后续也可以进行尝试性的探讨研究。

表5 影像基因智能方法在肺癌疗效评估预测方面的应用Table 5 Application of intelligent imaging genomics in efficacy evaluation and prediction of lung cancer

5 挑战与展望

综上所述可以看出,基于人工智能的影像基因组学在肺癌基因表型识别、双向相关分析、预后预测等方面都有突出的表现,为肺癌的智能诊断与预后预测提供了重要的理论基础和技术支撑,在精准医学和个性化治疗等领域都具有很强的应用前景。然而,智能影像基因组学快速发展的背后依旧存在许多问题。

1) 多源、复杂、未标准化的数据集。越来越多的人认识到许多癌症的特征对癌症患者的预后都有影响,包括基因组学、蛋白质组学、临床参数和肿瘤的侵入性和非侵入性生物标志物。随着精准医疗海量数据时代的到来,数据来源也在迅速扩大,不仅是多源医疗中心的数据,甚至包括来自可穿戴设备、非结构化电子健康记录等。此外,不同中心不同设备采集的数据没有统一标准,数据质量也是差异较大,且只有有限的少数注释良好的数据集被公开。这就给人工智能模型训练这些数据增加了难度,且即使能够训练,模型的泛化能力也比较弱。因此,采集参数的标准化,使用一致的放射组学方法,通过数据增强方式增加标注质量良好的数据样本量,对来自基因组学、蛋白质组学、临床参数和放射组学分析的患者数据进行一致、有意义和准确的解释,都可以改进患者预后的预测模型,从而实现精准医疗的目标。

2) 缺乏可重复性和再现性。随着医学领域人工智能的兴起,特别是深度学习,结合多个数据源的更复杂的模型可以一定程度上克服影像基因组学和临床实施之间的许多挑战。但是由于模型如卷积核的可变性、训练数据的过拟合或欠拟合等,都会造成从研究中识别出与预后预测相关的生物标志物的不可重复性和不可再现性。因此,构建一个稳健的影像基因组特征将进一步有助于对影像基因组学进行稳健性分析。更大的数据集、更优的神经网络结构等都可以提高模型的稳定性,有望帮助提高预测性能。

3) 模型的不可解释性。基于人工智能的非侵入性放射组学生物标志物由于其低成本和对人力输入的要求最小,可以在临床中产生重大影响,尤其深度学习已在多个领域被证明其成功价值。然而,网络功能背后的理论尚未建立,模型的输入和输出可以非常直观,但其隐藏的中间层则不是,这样导致人类专家在查看人工智能生成的结果时可能总是一个“黑盒子”,可解释性差。因此,确定网络性能背后的原因以及某些参数是否有积极或消极的影响是非常具有挑战性的。如何将领域知识合并到这些抽象特性中也是需要解决的一个非常重要的问题。在这个方向上的进一步研究可以使这些自动学习的特征表示更具可解释性。此外,数据可视化工具越来越多,可以研究算法如何在某种程度上做出决策,给出可视化效果以便进一步增强可解释性。

6 结语

基于影像基因组学的人工智能算法在提高肺癌基因表型鉴别、预后评估和预测治疗反应的准确性方面具有重要意义,为整个疾病过程中的患者护理提供了有价值的信息。影像基因组学结合人工智能有很大的前景,可以通过利用基因表达和分子谱信息来帮助理解放射性表型的生物学基础,还可能显示放射组特征、生物途径和基因表达状态之间的相关性。同时它能帮助建立放射组生物标志物作为基因组预后生物标志物的替代物,提高了预测模型的性能。影像基因智能算法的研究需要更大的数据集和更准确的信息标准化,进而提供有意义的和临床适用的结果,为精准医疗和个性化治疗策略的选择提供支持。