基于CFAR和CNN的SAR图像目标识别技术

张官荣, 赵 玉, 陈 相, 李 波, 王建军, 刘 丹

(1.空军工程大学航空工程学院,西安 710000; 2.西北工业大学电子信息学院,西安 710000; 3.中国人民解放军93046部队,沈阳 110000)

0 引言

合成孔径雷达(Synthetic Aperture Radar,SAR)技术是一种主动式微波遥感探测技术,它利用脉冲压缩和合成孔径同时提高雷达距离向和方位向的分辨率,从而获得全天候、全天时、大面积、高分辨率SAR图像[1]。SAR图像自动目标识别(Automatic Target Recognition,ATR)技术旨在自动从输入SAR图像中判断出有无目标信息,提高SAR图像解译效率和精度。近年来,SAR ATR技术已经在全世界得到广泛研究,并形成了固定的三级流程,即检测、鉴别和分类[2]。检测模块主要基于检测算法获取包含SAR图像目标的切片;鉴别模块用于剔除目标切片虚警值;分类模块选取最佳决策机制判断类别。

随着深度学习在机器视觉中的飞速发展,其模型实现了从海量的样本数据中自主学习数据的内在规律。在图像的分类识别任务中,研究人员提出了众多典型的深度学习网络模型,如AlexNet[3],VGG[4],Googlenet[5], ResNet[6],DenseNet[7]等,这些网络模型在大规模视觉识别挑战赛上取得了卓越的成绩。

为了加速实现深度学习在SAR目标的高效分类和识别,国内外众多学者对其展开了一系列的研究。文献[8]联合卷积神经网络和支持向量机对MSTAR数据库中10类目标分类,最终得到98.6%的识别率;文献[9]采用8层深度卷积神经网络(Deep Convolutional Neural Network,DCNN)结构对10类车辆目标分类,其网络结构设计与AlexNet类似,最终识别率为92.3%;文献[10]以VGG为参考对象,设计了一个具有大卷积核、全卷积映射的5层CNN网络(A-ConvNet),从MSTAR数据集的目标切片中裁剪并作为训练样本,在标准环境下识别率达到99%,17°~30°扩展环境下识别率为96%;文献[11]研究了SAR仿真数据集和真实数据集之间的迁移学习效果,通过在聚焦之前对单个点散射体的地物模型中添加仿真目标雷达反射特性来获得仿真数据集,实验结果表明,用仿真数据集预训练的网络比仅用真实数据训练的网络具有更好的测试识别率和更快的收敛速度;文献[12]提出基于卷积自编码器(Convolutional Auto-Encoder,CAE)学习卷积核和偏置,将学习结果输入CNN结构,该方法在保证识别率较高的情况下,识别速度大约是单独采用CNN结构的27倍;文献[13]研究了SAR图像中相干斑对CNN用于SAR目标识别的影响,在此基础上提出了一种双极耦合CNN结构,先利用去噪子网络进行去噪,然后通过分类子网络学习剩余散斑特性和目标信息,该结构可以提高网络的噪声鲁棒性。

虽然SAR图像目标识别技术已经取得了较大进展,但在实际应用场景中,SAR图像识别精度容易受到噪声干扰、目标多尺度变换等因素影响,为了获取有效的战场态势感知信息,研究先进的SARATR技术意义重大。本文基于深度学习提出新颖的模型框架研究SAR图像自动目标识别技术,通过改进恒虚警率(Constant False-Alarm Rate,CFAR)检测算法和卷积神经网络实现目标的高效识别。实验结果表明,本文方法相比于传统算法识别效果更好。

1 SAR图像目标识别方法

1.1 深度卷积自编码网络

卷积自编码器(CAE)[14]将自编码器中的全连接神经元替换为卷积神经元,自编码网络由编码器与解码器两部分组成,编码器用于提取图像特征,解码器用于生成图像。在编码过程中,保存图像的特征信息,删除冗余信息[15]。特征提取能力随着网络层数的加深而增强,因此,深度卷积自编码网络应用于图像任务时,通常将编码器和解码器的层数同时加深,对输入特征进行提取、编码与解码。

1.2 CFAR目标检测和识别

目标检测算法主要利用感兴趣目标的几个简单特征或特征组合,在分割的结果中剔除虚假目标,尽可能地降低目标虚警率。恒虚警率(CFAR)算法[16-18]是指保持目标虚警率不变的情况下采用数理统计理论对检测模型进行参数估计,不但减小了算法的计算量,而且在复杂背景环境中可自适应调整阈值。

CFAR算法对目标图像进行目标检测时通常采用滑窗法遍历检测估计目标尺度。以双参数CFAR算法为例[15],若用H0表示假设背景窗口中杂波像素值的统计分布为高斯分布,即

(1)

式中:σ为高斯分布的标准差;μ为均值;xi为杂波背景中的像素点的值。由此可以得出双参数CFAR的虚警率算式为

(2)

(3)

当虚警率Pfa给定时,令φ(α)=1-Pfa,可以计算α,即阈值因子。双参数CFAR对应的阈值VT为

VT=μ+ασ。

(4)

式(4)同时满足恒虚警率条件。高斯分布统计量μ和σ的估计值为

(5)

(6)

(7)

在使用CFAR检测器对目标进行检测识别时,需要对待检测图像的背景杂波进行建模,估计背景杂波的统计分布模型。

2 SAR目标识别

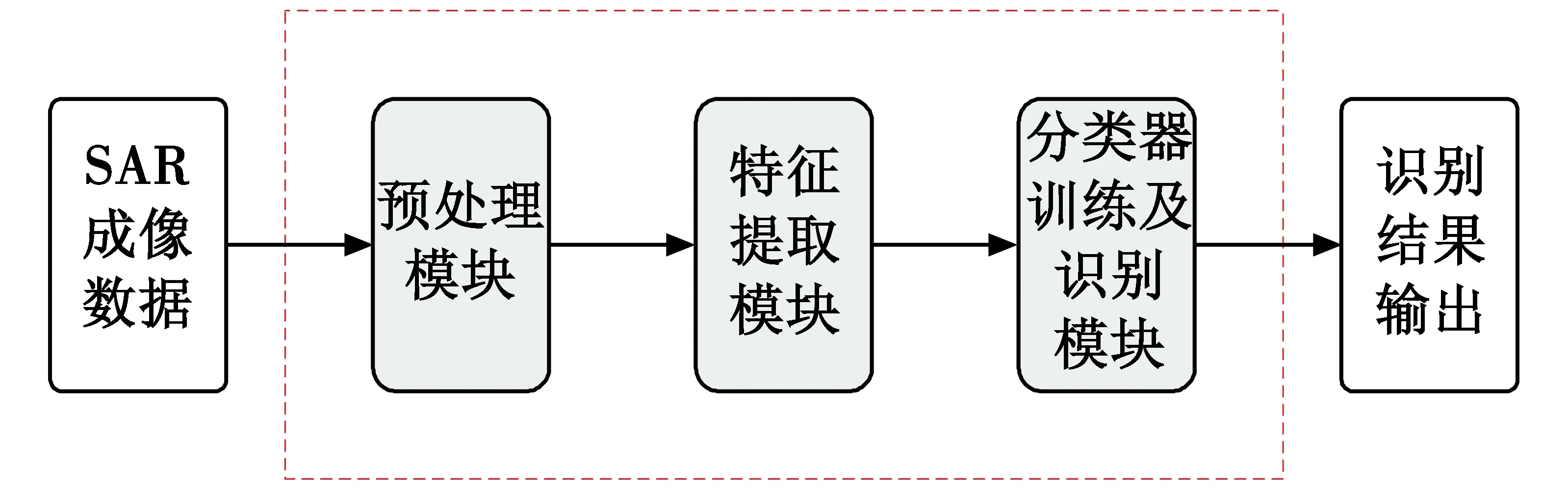

为了有效提高SAR图像自动识别目标系统的效率,本文将深度学习技术应用于SAR图像识别领域实现模型优化,提出了一套完整、有效的SAR图像目标识别框架,如图1所示。

图1 SAR图像自动识别框架Fig.1 Automatic SAR image recognition framework

2.1 基于卷积自编码网络的SAR图像相干斑抑制

由于许多基本散射体反射的雷达波的相干干扰,SAR图像自身受到相干斑噪声的影响,这将降低图像的空间分辨率,模糊了图像的边缘和纹理特征,极大地影响了SAR图像的解译工作[19]。因此,对SAR图像进行相干斑噪声建模和抑制是目标识别中的重要组成部分。

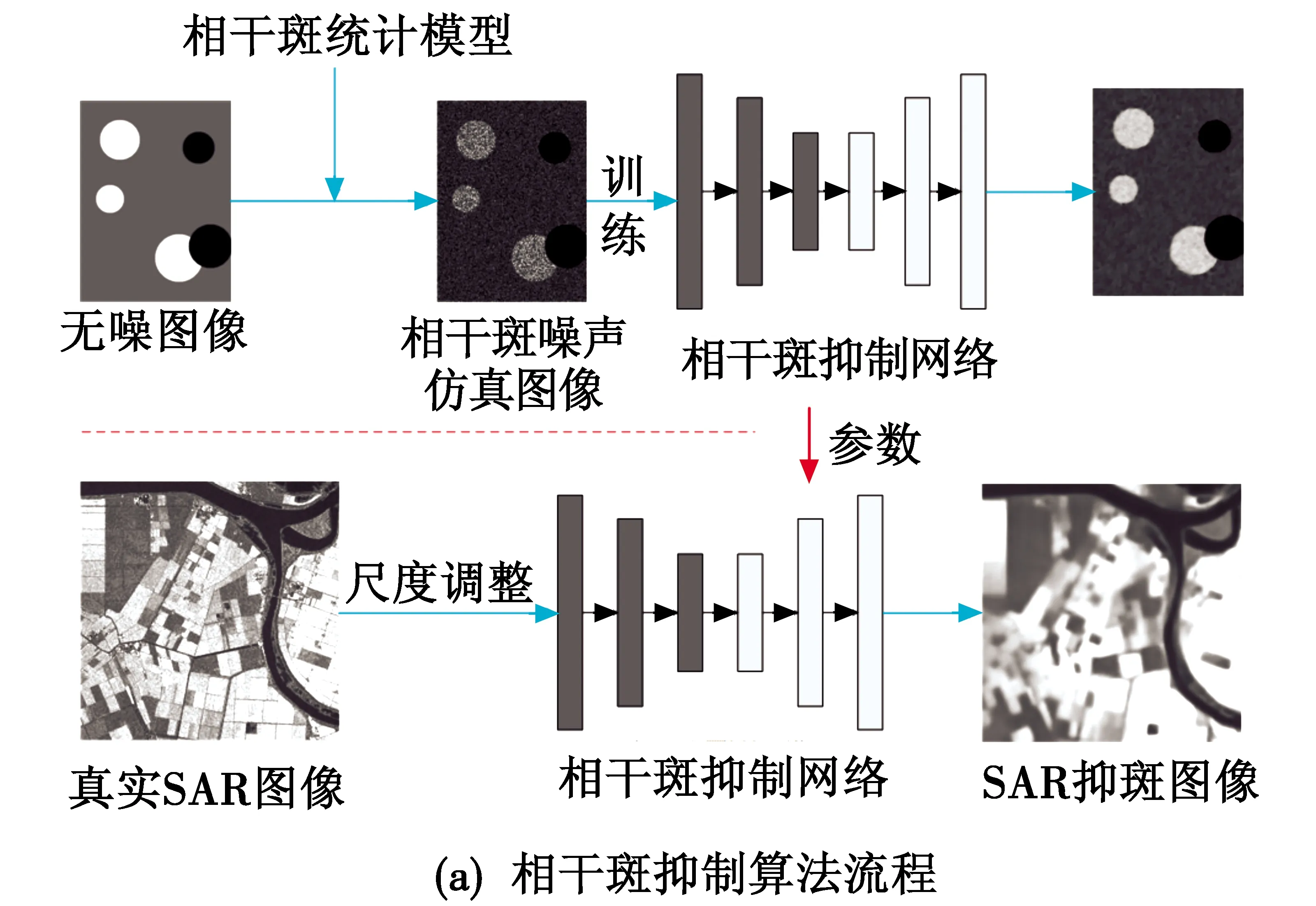

本文提出的SAR图像相干斑抑制网络是一个深度卷积自编码结构,如图2(a)所示,其算法流程主要分为训练阶段和预测阶段。训练阶段基于相干斑统计模型和无噪光学图像模拟SAR相干斑图像,用于训练相干斑抑制网络;预测阶段通过仿真数据训练好的相干斑抑制网络对真实的SAR图像进行相干斑抑制。

图2 相干斑抑制算法流程和网络结构Fig.2 Flow chart of speckle suppression algorithm and network structure

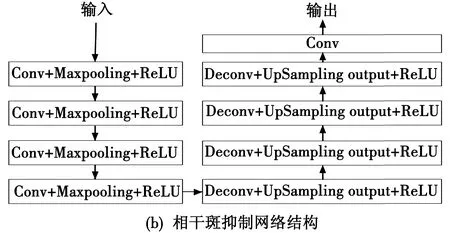

针对SAR图像中存在的与信号相关的噪声,深度卷积自编码网络的SAR图像相干斑噪声抑制模型的网络结构如图2(b)所示,模型为一个带残差连接的深度卷积自编码网络。图中,Conv表示卷积层,ReLU表示线性整流激活函数,Maxpooling表示最大池化层,UpSampling表示上采样层,Deconv表示反卷积层。

由于SAR图像相干斑抑制一般无法获取噪声水平,为了使网络泛化性能提升,本文采取混合噪声的仿真相干斑数据对网络进行训练,然后通过softmax分类层对权重进行微调,既有效地避免网络过拟合,又使模型能够更好地适应SAR图像分类去噪任务。微调优化代价函数为

(8)

L=LCoAE+β·Lsoftmax

(9)

2.2 基于CFAR算法和卷积神经网络的目标特征提取

SAR图像目标场景区域提取旨在提取待检测图像上一系列感兴趣区域列表。本文针对待检测图像提取感兴趣区域问题提出CFAR检测算法和图像形态学处理生成区域列表,设计用于SAR图像分类特征提取的卷积神经网络,并通过分类任务从训练数据中自动学习有效的分类特征。针对数据多样性不足带来的网络过拟合和泛化性能差的问题,此处设计Fisher损失函数对网络权重进行微调,实现网络映射的特征空间的聚集。训练好的网络模型可以作为一个有效的分类特征提取器。

2.2.1 CFAR检测算法

CFAR算法检测图像后输出一个与待检测图像大小相同的逻辑矩阵,图像掩模的像素值为0表示背景,值为1表示目标。

实际环境中,SAR图像的目标检测背景环境较为复杂,且目标相对于杂波而言所占像素数目比较小,因此需要设计自适应调整阈值的CFAR检测算法,本文对整幅SAR图像通过滑窗法遍历像素点检测背景和目标,滑窗大小根据估计的目标尺度获取。检测算法首先计算背景区域的杂波统计特性,建立背景杂波分布概率密度函数;然后自适应估计目标检测的阈值,最后对待检测像素点进行类别判断,判别标准为:当像素值大于或等于阈值时被判定为目标,反之则被判定为背景。

2.2.2 形态学处理

对掩模图像进行图像形态学处理主要目的是去除CFAR检测图像掩模中的孤立虚警点,包括腐蚀、膨胀和去除小连通域技术。对图像掩模进行腐蚀处理可以切断掩模中相邻目标的细小连接。膨胀处理能够弥补图像掩模中目标的细小空洞。去除小连通域利用先验知识对可能存在目标的连通域大小进行估计,小于一定阈值的连通域可以判断为虚警目标,应该去除该连通域。本文通过先腐蚀后膨胀(图像开运算),最后进行小连通域去除孤立虚警点。

2.2.3 生成感兴趣区域

感兴趣区域生成包括目标聚类、虚假目标剔除和感兴趣区域获取。由于SAR图像中目标的像素值大小不一定连续,同时受噪声影响可能出现目标区域内存在像素值低于CFAR检测阈值的像素点,导致一个目标被检测为几个小目标,因此,通过目标聚类将多个小目标组合成一个大目标使目标特征更加明显,目标分割更为准确。本文通过欧氏距离小于某个阈值的像素被判断为目标来实现聚类,目标像素的邻域集合为

Ni={j∈S|dist(i,j)≤dmax}

(10)

式中:dist(i,j)为像素点(xi,yi)和像素点(xj,yj)之间的欧氏距离;S为像素点(xi,yi)的空间邻域集合;dmax为判断两个像素点是否属于同一个目标的欧氏距离阈值,若像素间距离小于该阈值则两点属于同一个目标,反之则不是同一个目标的点。dmax根据目标先验信息设定,通常取目标的最大尺度所占像素数,即

(11)

式中:H为目标的长度所占像素数;W为目标的宽度所占像素数。

虚警目标剔除是通过聚类生成目标区域,根据先验知识估计目标尺寸,判别像素点超出聚类的阈值时剔除虚假目标。此模块先获得目标区域的中心点位置,然后以该中心点为感兴趣区域的中心点,从待检测图像中切片出固定大小区域,并输出感兴趣区域的坐标信息。

2.3 SAR图像自动目标分类识别

2.3.1 基于Fisher判别约束的网格优化

一般而言,CNN网络通过softmax交叉熵损失进行优化,在训练样本有限或者多样性不足时,网络很容易过拟合,导致模型泛化能力差。将Fisher判别分析的类内散度矩阵和类间散度矩阵融合到网络优化的目标方程中,用于微调整个网络权重,提高在训练样本有限的情况下,特征空间的类内紧凑性和类间可分性,提高整个网络的泛化性能。

Fisher约束分类网络优化流程如图3所示。

图3 Fisher约束分类网络优化流程图Fig.3 Flow chart of Fisher constrained classification network optimization

分类网络训练的损失函数由softmax分类损失和Fisher判别约束组成,即

L=Lsoftmax+λLFisher

(12)

式中:Lsoftmax表示分类交叉熵损失;LFisher为约束类间和类内距离的Fisher损失。

2.3.2 目标分类识别

本文基于CNN提出了一个SAR图像目标分类特征学习框架,通过分类任务训练网络模型。训练好的网络对SAR图像中感兴趣的区域进行特征提取,最终将特征信息输入到分类器内实现目标分类。分类器类别概率算式为

P=max(softmax(wi·n+bi))i=1,2,…,K

(13)

式中:wi为全连接层第i个神经元与输入连接的权重向量;n为输入向量;b为偏置向量;K为类别数。

2.3.3 后处理技术

后处理的功能主要是剔除一些虚假目标,主要由于检测模块输入到目标分类识别模块的感兴趣区域中存在虚假目标。训练分类器时没有设置负样本,分类器输出数目等于所有样本的类别数,导致虚假目标也会被分类器判定为某一个真实目标。因此,通过设定概率阈值PT作为判定是否为真实目标的条件,即当P 为了评估本文所提出的SAR图像目标识别框架的有效性,本文实验部分主要利用提出的识别系统对合成的待检测目标场景SAR图像进行目标识别并对实验结果进行分析。 本节实验数据使用MSTAR数据集,包括10类目标的SAR图像切片和同一区域的背景图。因为背景图和目标切片中的背景可以看作是同质区域且二者通过同一个雷达成像,所以MSTAR数据集推荐利用目标切片和背景合成含有目标的场景图。 实验合成了2张待检测场景图,合成流程如图4(a)所示;图4(b)为带有标签的合成场景1,包含10类总计34个目标,图像尺寸为1478×1784(单位为像素);图4(c)为合成场景2,包含10类总计17个目标,图像尺寸为1474×1784(单位为像素)。 图4 场景图像合成流程和合成场景图Fig.4 Process of scene image synthesis and the results 3.2.1 相干斑抑制 图5所示为相干斑抑制结果。 图5 相干斑抑制结果Fig.5 Results of speckle suppression 图5(a)中海域数据分辨率比较低,红框部分为局部放大图,包括农田和马路,农田的边缘较为清晰。图5(b)的农田数据是经过直方图匹配合成的结果图,去噪前的图像(左)中存在着密密麻麻的相干斑噪声,去噪后的图像(右)中斑点被平滑,图像整体对比度得到提升。图5(c)为两个场景图相干斑抑制后的结果,相比于图5(b),其区域更加平滑,目标和背景区对比更明显,有利于降低目标检测虚警率。 3.2.2 目标特征学习和检测结果 图6所示为场景1目标识别结果。 图6 场景1目标识别结果Fig.6 Target detection results in Scenario 1 图6(a)为场景1的目标检测结果以及对应的图像掩模,实验结果表明,总共检测出了43个目标区域,其中包括6个虚警目标,无漏检。 图7所示为场景2目标识别结果。图7(a)为场景2的目标检测结果和对应图像掩模,图中共检测出33个目标,其中包含14个虚警目标,无漏检,几乎所有的虚警目标都出现在灌木丛内,由于灌木丛的灰度值比较大,且在整个场景中灌木丛的比例较高,因此导致较多虚警。 图7 场景2目标识别结果Fig.7 Target detection results in Scenario 2 图6(b)和图7(b)分别为场景1和场景2输入到目标检测模块通过后处理输出的感兴趣区域(ROI)以及对应的图像掩模,可以看出,此时的感兴趣区域形状为正方形,目标之间有重叠。 3.2.3 目标识别结果 识别结果如图8所示。通过对分类器设置阈值来判别虚警,阈值为0.5,即当前类别的概率大于0.5时判断为真实类别,否则为虚警。结果显示,场景1中虚警数量为0,且所有类别成功识别,场景2中虚警数量为1,仅左下角的树丛识别有误,其他类别全部准确识别。 图8 识别结果图Fig.8 Diagram of detection results 本文对比了传统CFAR算法,其实验结果如表1所示,通过比较2个场景下的检测类别数量和真实类别数量,结果表明,本文提出的算法在识别不同场景下的目标效果较好。传统的CFAR算法在场景1和场景2中均出现虚警,而本文提出的算法在场景2中虚警数量为1,无漏警,达到了较好的识别效果。 表1 不同检测识别算法结果对比Table 1 Results of different detection algorithms 本文针对SAR图像自动目标识别问题展开了较为深入的研究,设计出一种基于深度卷积自编码CNN的SAR图像分类特征提取网络框架,采用CFAR算法检测出目标位置的一系列感兴趣区域,通过分类任务从训练数据中自动学习有效的分类特征。对于因数据多样性不足带来的网络过拟合和泛化性能差的问题,基于Fisher判别准则设计损失函数,利用该损失函数对网络权重进行微调,可以使网络映射的特征空间中不同类别样本之间的距离更离散,同类样本更加聚集。训练好的网络模型可以作为一个有效的分类特征。 随着深度学习技术的不断深入发展,在普通图像自动目标识别领域已有诸多发展成熟的端到端优化识别系统,如何将这些算法和SAR图像自动目标识别结合起来是一个值得期待的研究方向。3 实验结果与分析

3.1 实验数据

3.2 实验结果与分析

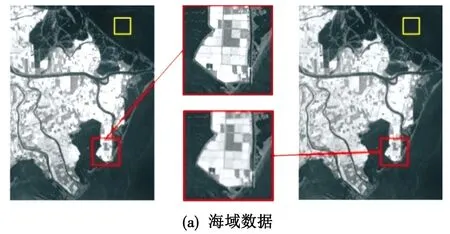

4 总结与展望