基于多特征融合的中医症候舌象分类方法研究

徐雍钦,杨晶东,姜 泉,韩 曼,宋梦歌

(1上海理工大学 光电信息与计算机工程学院 自主机器人实验室,上海 200093;2中国中医科学院广安门医院 风湿病科,北京 100053)

0 引 言

近年来,深度学习方法已被广泛运用到医学图像分类领域。张晓彤等将ResNet50应用到更年期泌尿生殖系统综合症的分类,高效地实现病灶识别;增思涛等则将ResNet应用到肺灌注图像分类,并有效地检测了肺栓塞病变;刘张等人将EfficientNet用于消化道常见病变,平均值达0.94;赵晓平等,将DenseNet网络应用于乳腺癌病理的八分类研究,在亚型八分类表现上准确率达95.5%,且在数据不均衡的条件下取得了较好的分类效果。

近年来,许多学者已将深度学习应用于舌象分类。汤一平等在舌象分类中引入多任务结构,使用多个二分类网络来消除多标签的歧义性;孙萌等基于Inception-ResNet-V1网络改进了损失函数,对提取特征形成了有效的映射空间,并取得了较好的分类效果;李渊彤等采用VGG16网络对舌象进行多分类,并使用迁移学习降低网络训练成本;宋超等采用多分支网络结构进行舌象分类,并且在每个分支网络中采用不同策略的迁移学习参数,提高网络分类性能;翟鹏博等将注意力机制引入舌象分类,降低样本噪声,并针对每种特征建立单独分支网络,构建一种简单网络结构;邱童将浅层特征和深层语义特征融合后,采用传统机器学习方法进行舌象分类,但传统机器学习分类器无法充分学习融合特征,无法充分利用特征间的差异性提高分类精度。

本文针对临床中医证候六分类舌象样本,构建一种自适应注意力机制的迁移学习舌象分类网络,提取舌象深层特征,并融合舌象边缘特征、纹理特征,实现多特征融合舌象分类。

1 基于多特征融合的舌象自主分类模型

1.1 基于自适应注意力机制的迁移学习网络FusionNet

注意力机制被广泛应用于深度学习网络,提高网络特征提取能力,Hu等将通道注意力机制SE引入计算机视觉领域,提出SE(Squeeze-and-Excitation)网络,该结构基于通道维度构建特征相关性;Woo等提出CBAM(Convolutional Block Attention Module)注意力机制,在通道注意力机制基础上引入了空间注意力机制,通过通道和空间两个维度提取特征,保证了图像通道域和空间域上的信息关联;Li等参考Inception结构提出SK(Selective Kernel)网络,通过多分支并行结构,学习图像不同尺度下的多层次特征;Yang等受脑科学中神经元放电模式启发,提出SimAM(Simple,Parameter-Free Attention Module)注意力机制,能够通过一种轻量无参方法直接得出三维权重。

传统神经网络为了提升分类精度,会选择对网络深度或宽度进行一定比例的缩放,即通过增加网络深度、特征层数来获得更好效果。而迁移学习EfficientNet网络通过对网络深度、宽度以及输入图像分辨率的统一缩放,在等量资源下取得更好的分类性能。EfficientNetV2则在EfficientNet的基础上引入Fused-MBConv结构,逐步增加特征图尺寸,以提高模型分类性能。

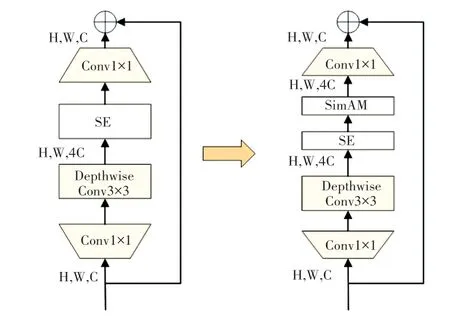

本文在EfficientNetV2的基础上引入SimAm注意力机制,提出一种自适应迁移学习网络FusionNet,采用SimAm-MBConv结构替换原网络中的MBConv结构,改进后的网络结构如图1所示。SimAm-MBConv注意力机制是一种SE+SimAm串联结构,原始注意力机制SE可以提取图像通道域上的特征,但难以提取空间域特征,即图像通道内平面位置上的特征,而SimAM注意力机制的轻量无参特性,虽能提取舌象三维特征,但空间域特征关联性不足。因此,本文串联SE和SimAM两种注意力机制,在不额外引入参数的情况下将混合注意力机制应用到本文网络,使得FusionNet具有更好的分类效果和更高的精度。

图1 MBConv模块与改进后的SimAM-MBConv模块Fig.1 MBConv module and improved SimAM-MBConv module

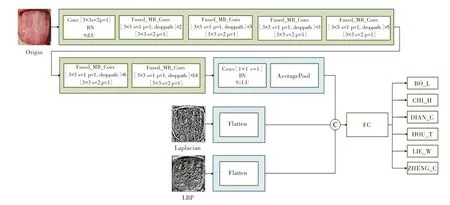

本文采用FusionNet网络提取舌象多维度深层语义特征,并利用迁移学习预训练网络,加快网络收敛速度,增强网络分类精度,自适应的迁移学习FusionNet网络结构如图2所示。

图2 自适应的迁移学习FusionNet网络结构Fig.2 Adaptive transfer learning network structure of FusionNet

1.2 基于多特征融合的舌象分类网络

中医证候舌象样本具有多样性和浅层特征差异性,传统网络难以感知多维度深层特征,且训练过程中的浅层噪声难以剔除,本文分别采用Laplacian算子、LBP算子提取舌象边缘特征、纹理特征,并与FusionNet网络提取深层特征融合,实现基于多特征融合的舌象自主分类。基于多特征融合的舌象分类网络结构如图3所示。

图3 基于多特征融合的舌象分类网络结构Fig.3 Tongue image classification network structure based on multi-feature fusion

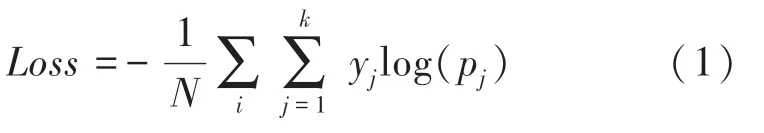

本文根据全连接层输出权重,采用Softmax函数进行分类,交叉熵损失函数如式(1):

其中,为样本数;为图像数据类的个数;y为图像分类结果的符号函数,正确分类取1,否则取0;p为对应图像被预测为类的概率。

她对着那双鞋潸然泪下,原来简东亮给她的是一份正版的爱情,是她太贪心了。灰姑娘也只有一双水晶鞋,而她却想要更多,更多。

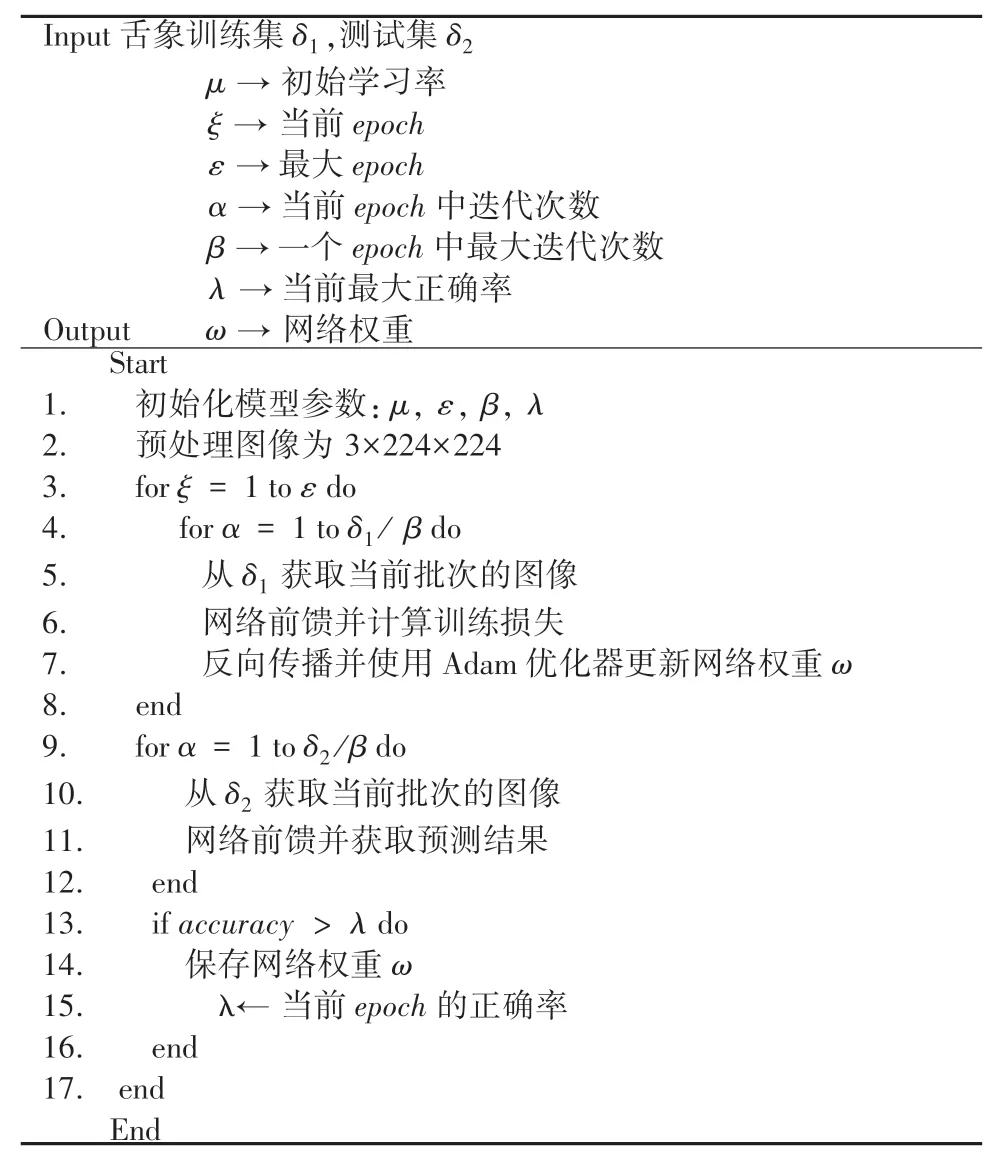

本文采用Adam优化器,总训练为100(),前50学习率为13(),后50学习率为0.000 1,batch-size为16()。在每个中,为训练样本数,为验证样本数,当前正确率大于时则更新,并保存当前网络权重。训练和验证算法流程见表1。

表1 模型训练和验证流程Tab.1 Model training and validation process

2 实验结果与分析

2.1 数据预处理和数据增强

本文采用的数据集来自于北京广安门医院中医证候临床舌象样本,该数据集共分为6个类别:正常、裂纹、厚苔、点刺、齿痕、剥落苔,每个类别30张,共180张。由于样本数量较少,本文对该数据集进行了数据增强处理。预处理原始图像像素为224×224,其对应的纹理特征和边缘特征图像像素为1×448,并将数据集划分为训练集和测试集,其比例为4:1。数据增强过程如图4所示。

图4 数据增强Fig.4 Data augmentation

将舌象旋转30°,进行0值填充处理,使得数据集每类样本数量均扩展12倍,即每类360张图像样本;将原始图像样本水平和垂直翻转,每类得到60张样本,共得到每类420张舌象样本,6类共2 520张。本文将256×256原始图像通过双线性插值变换为224×224。

2.2 评估方法与超参数

本文使用正确率;精确率;灵敏度;1,值(ROC曲线与坐标轴围成的面积)对模型进行评估,其公式如式(2)~(4)。

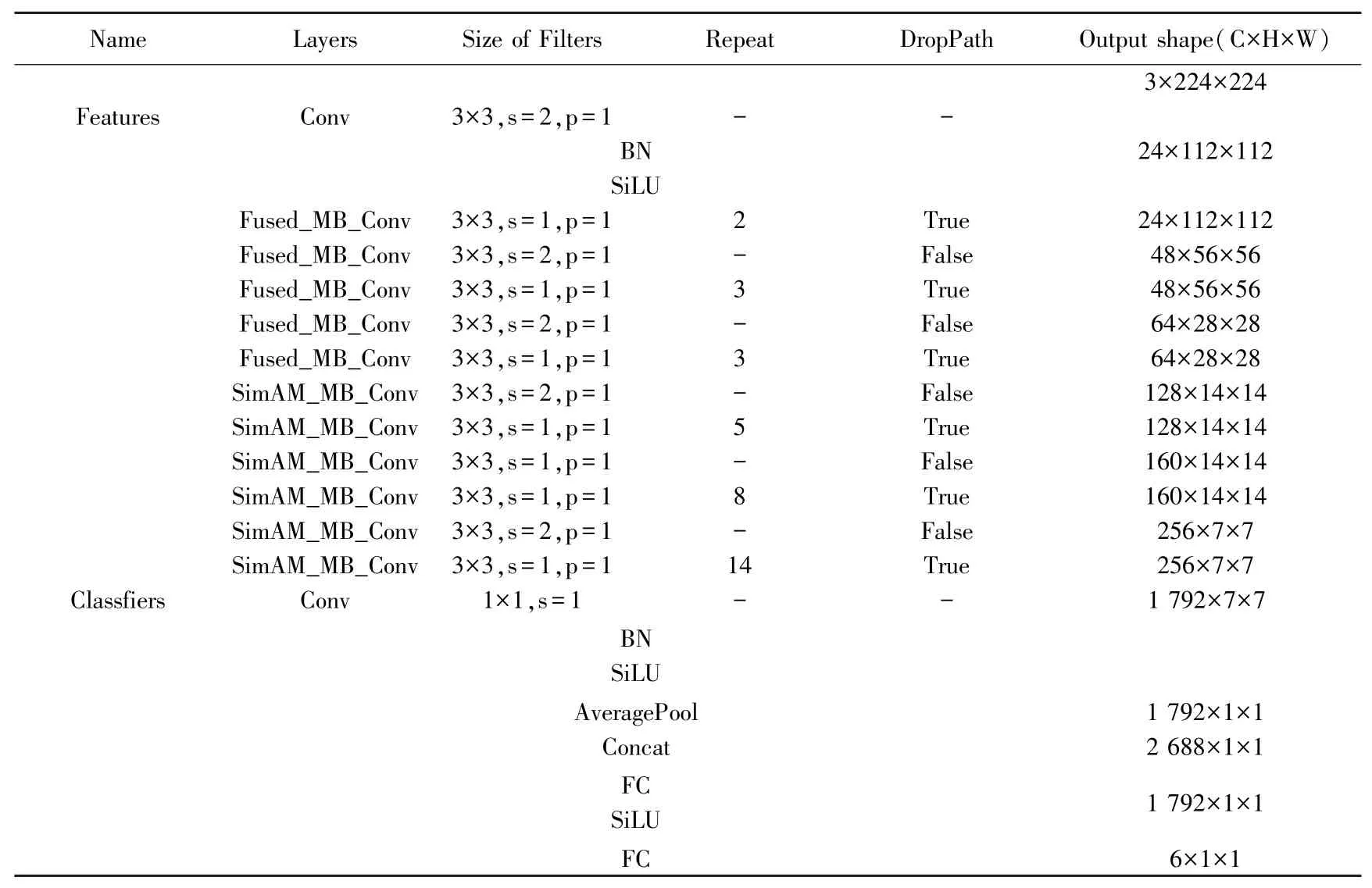

本文FusionNet网络由若干Fused_MB_Conv和SimAM_MBConv组成,见表2,网络输入为三通道224×224尺寸图像,分别重复2、3、3次的Fused_MB_Conv结构,输出格式为64×28×28,其中通道加深发生在每次重复前一个未经DropPath失活的Fused_MB_Conv结构。同理,SimAM_MB_Conv结构重复5、8、14次,最终输出格式为256×7×7,分别再经过1×1卷积,BN层,SiLU激活函数,下采样层后与舌象边缘特征和纹理特征进行通道维度拼接,再经过全连接层和SiLU激活后,通过最后全连接层输出分类结果。

表2 FusionNet模型超参数Tab.2 Hyperparameters of FusionNet model

2.3 消融实验

为分析各种注意力机制对于舌象分类精度影响,本文对EfficientNetv2网络原有注意力机制模块进行改进,分别采用SE、CBAM、SK、SimAM 4种典型注意力机制组合形式,共设计了7种注意力机制进行消融实验,并比较测试集上的曲线和曲线,如图5所示。可以看出无论对于曲线,还是曲线,SE+SimAM和CBAM具有最好的分类性能,SimAM和SE+CBAM次之,SE、SE+SK、SK的分类效果较差。说明混合注意力机制分类性能优于单一注意力机制,这是由于舌象样本深层特征具有多样性和空域特性,单一注意力机制难以提取舌象多维度空域特征,降低了模型分类精度。

图5 各种注意力机制的ROC、PR曲线Fig.5 ROC and PR curve of various model based on different attention mechanism

本文在网络浅层加入SimAM模块,并对不同注意力机制组合进行比较,如图6所示。可以看出,SimAM+SE+SK、SimAM+SE+SimAM的组合取得了较好的分类结果,分类性能均优于没有在浅层添加SimAM的网络结构。这是由于SimAM作为一种轻量无参的注意力机制可以提取舌象浅层多维度的特征,且不会增加运算负担,在浅层添加注意力机制可以更好地消除浅层噪声,减小其在后续卷积中的比重,从而优化分类结果。

图6 在网络浅层加入SimAM,不同注意力机制的比较Fig.6 Comparison of different attention mechanisms after adding SimAM in shallow layers

本文在网络浅层加入SimAM模块,并对不同注意力机制组合进行比较,如图6所示。可以看出,SimAM+SE+SK、SimAM+SE+SimAM的组合取得了较好的分类结果,优于没有在浅层添加SimAM的网络结构。这是由于SimAM作为一种轻量无参的注意力机制可以提取舌象浅层多维度的特征,且不会增加运算负担,在浅层添加注意力机制可以更好地消除浅层噪声,减小其在后续卷积中的比重,从而优化分类结果。

本文设计了多种组合形式,以测试多特征融合对分类性能影响。本文首先以LBP算子提取的纹理特征结合FusionNet网络提取的深层特征进行融合,并添加各种注意力机制进行消融实验。同样对比各模型测试集ROC曲线、PR曲线,分析舌象分类模型性能。如图7所示。可以看出,SE+LBP和SimAM+SE+LBP的组合具有最好的分类性能。

图7 双特征融合下不同注意力机制的比较Fig.7 Comparison of different attention mechanisms with two-feature fusion

这是由于注意力机制SimAM模块可以提取舌象深层空域特征,消除部分浅层噪声,与LBP算子提取的浅层纹理特征进行融合,获得了较好分类精度。而SimAM+SE+CBAM+LBP、SimAM+SE+SK+LBP、SE+CBAM+LBP的组合分类性能较差,这是由于过多注意力机制组合影响了舌象深层特征提取,导致分类精度下降。分析可知,浅层舌象纹理特征有利于提高网络分类精度。

此外,本文在双特征基础上融合Laplacian算子提取的边缘特征,采用三特征融合模式实现舌象分类。各模型测试集曲线、曲线分类精度对比曲线如图8所示。 可以看出,SE+SimAM+LBP+LAPLACIAN的组合获得了最好的分类性能。这是由于诸如剥裂苔、齿痕类数据的边缘特征较为明显,因此,多特征融合提升了网络分类性能;而SE+SimAM+CBAM+LBP+LAPLACIAN等组合由于过多的注意力机制影响了深层特征提取,导致网络整体分类性能降低。

图8 三特征融合下不同注意力机制的比较Fig.8 Comparison of different attention mechanisms with three-feature fusion

综上所述,本文选取SE+SimAM的注意力机制,并结合LBP算子提取纹理特征和拉普拉斯算子提取的边缘特征,实现舌象自主分类。

2.4 分类性能

2.4.1 交叉验证

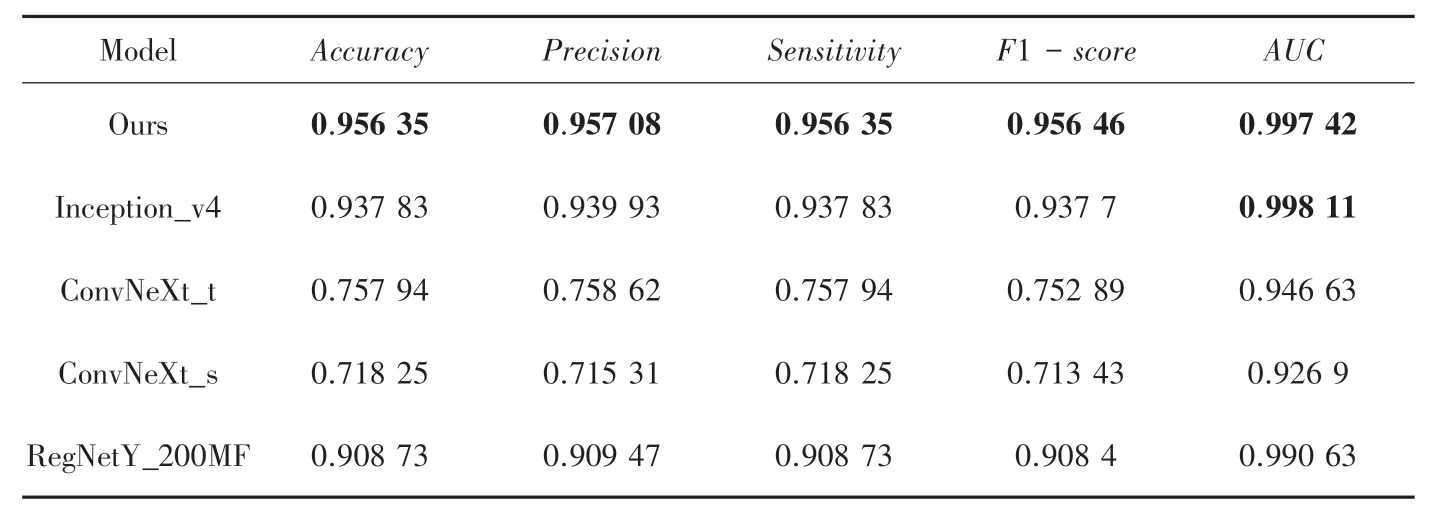

将本文方法与现有模型对比,进一步分析本文网络的分类性能。采用Inception_v4、ConvNeXt_t、ConvNeXt_s和RegNetY_200MF作为对照模型,并进行5-2折交叉验证,每折506张舌象样本共6类均匀分布,对比、、、1和值,ROC曲线和PR曲线以及混淆矩阵评估模型分类性能,不同模型在测试集下分类性能,见表3。与Inception_v4网络相比,本文方法准确率增加0.018 52,精度增加0.017 15,灵敏度增加0.018 52,1增加0.018 76,在减少0.000 69。

表3 不同模型的分类性能对比Tab.3 Comparison of classification performance of different models

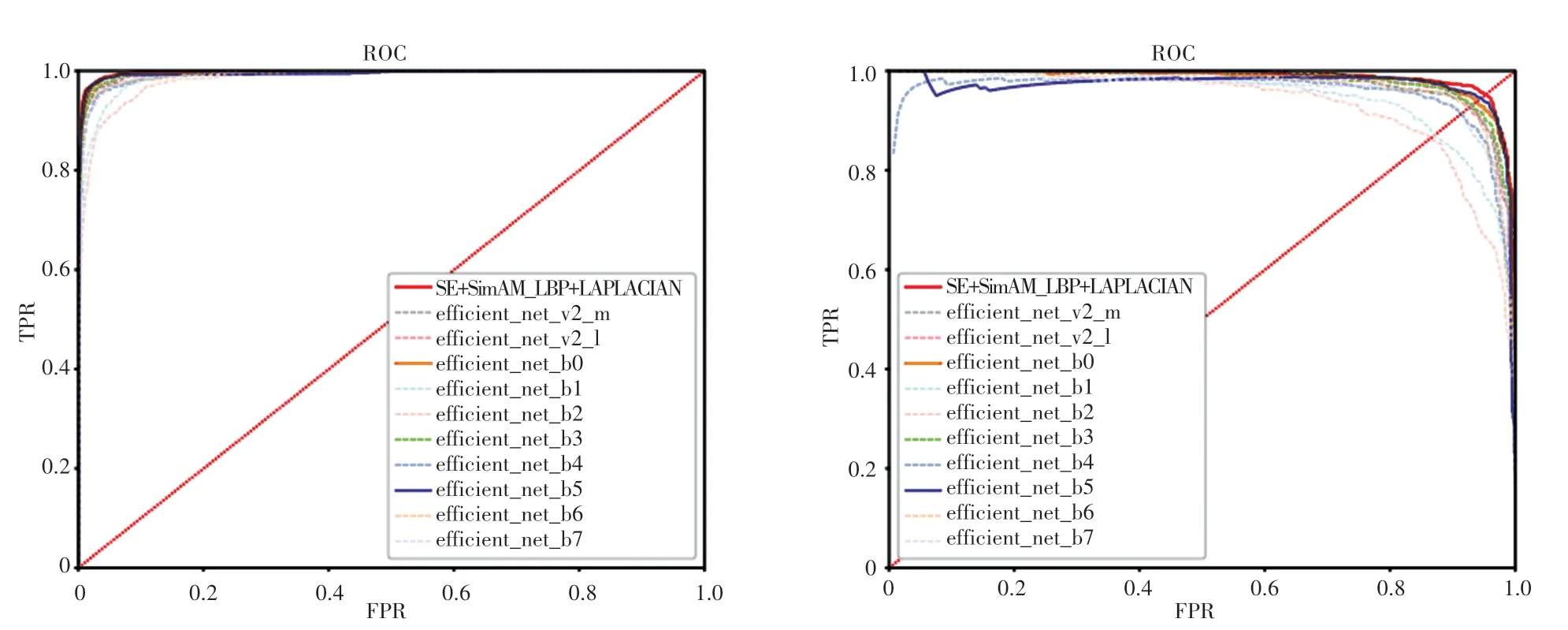

5折交叉验证实验下5种模型的ROC曲线和PR曲线,以及本文模型分类结果的混淆矩阵如图9所示。与5种典型模型相比,本文模型具有最好的分类精度和泛化性能。

图9 5折交叉验证下不同模型的混淆矩阵、ROC曲线和PR曲线Fig.9 Confusion matrix,ROC curve and PR curve under 5-fold cross validation

2.4.2 性能分析

为进一步验证本文模型分类性能,首先选取了与本文模型主干网同系列的其他网络进行对比,共选取了EfficientNet系列b0~b7共8种模型,EfficientNet v2系列medium和large两种模型,并对比测试集分类模型ROC曲线和PR曲线,实验结果如图10所示。

图10 EfficientNet不同结构网络比较Fig.10 Comparison of different Efficient Net

可以看出,本文模型具有最好的分类精度。这是因为EfficientNet系列网络结构简单,单SE通道注意力机制难以提取舌象深层特征。而EfficientNet v2系列两种网络结构EfficientNet v2 medium和EfficientNet v2 large网络结构过于复杂,无法提取舌象浅层特征,降低模型泛化性能。本文采用混合注意力机制提取舌象多维度的特征,并融合浅层纹理和边缘特征进行综合分类决策,具有更高分类精度和泛化性。

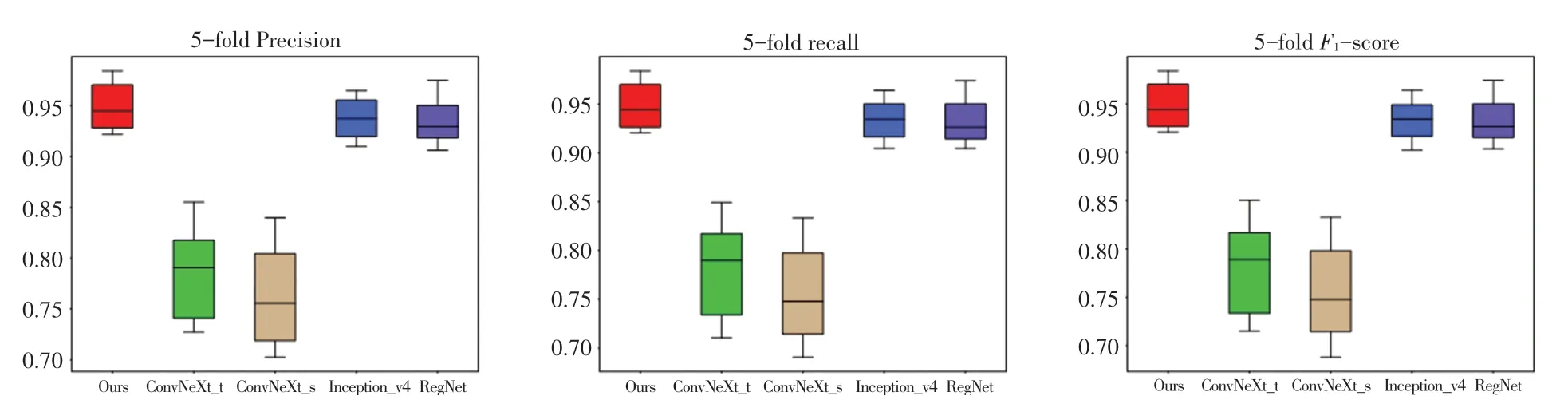

5折交叉验证各模型评估参数箱线图如图11所示,本文方法具有最好分类精度。本文还统计了模型分类精度、计算复杂度和卷积层和全连接层参数量,见表4。可以看出本文模型虽然具有较高计算复杂度和参数量,但具有最高的分类精度和泛化性能。与Inception_v4、ConvNeXt_t、ConvNeXt_s、RegNetY_200MF相比,本文方法的增加0.015、0.162、0.182、0.013,灵敏度增加0.017、0.172、0.190、0.013,1增加0.019、0.169、0.192、0.013。

表4 5折交叉验证不同模型的分类结果和计算复杂度Tab.4 Classification result and computational complexity of different models under 5-fold cross-validation

图11 各模型分类性能对比Fig.11 Comparison of classification performance on different models

3 讨 论

为可视化各模型对舌象特征提取能力,本文引入了grad-CAM方法可视化了网络关注的特征区域。各种模型特征关注度热力图如图12所示,图12(a)分别为剥裂苔、点刺、裂纹舌象原图,图(b)~图(f)分别为本文方法、Inception_v4、ConvNeXt_t、ConvNeXt_s、RegNetY_200MF在grad-CAM下的特征热力图。对于剥裂苔类舌象,本文模型提取特征均处在舌象边缘明显剥裂的位置;对于点刺类舌象,本文方法提取特征集中于舌象中下部点刺区域;对于裂纹类舌象,本文方法所提取的特征范围能精确覆盖裂纹部分。可见,本文模型特征提取更精确,更适合于中医证候舌象样本分类。

图12 不同模型对舌象样本的特征关注度Fig.12 The feature attention of different models to tongue samples

4 结束语

本文提出了一种基于多特征融合和改进注意力机制的中医证候舌象迁移学习分类网络。与当前主流分类网络相比,具有更好的分类精度和泛化性能。由于本文舌象样本属于宏观类医学样本,舌象浅层特征(纹理、边缘特征)对舌象分类具有较大影响,为此,本文采用自适应注意力机制的迁移学习网络提取舌象深层特征;采用LBP算子、Laplacian算子分别提取纹理特征、边缘特征;最后,将深层特征与浅层特征融合,确定舌象的最终分类。实验结果证明,本文模型可以有效提取中医证候舌象多维度深层、浅层特征,有利于加速网络收敛。今后将针对更多舌象样本进行研究,改进模型结构和泛化性能。