基于边缘保持滤波的多聚焦图像融合仿真

雷光波,万 方

(湖北工业大学计算机学院,湖北 武汉 430068)

1 引言

作为交流沟通的主要途径,图片在日常生活中占据着重要地位。为了更全面、更细致地描述图像中的目标对象,基于对应的融合规则,利用图像融合技术对片面化、表面化的图像目标进行信息重组,使其与人眼与机器感知更匹配。由于光学系统[1]的景深问题限制了目标区域的聚焦范围,导致同一场景中仅图像聚焦点周围足够清晰,需应用多聚焦图像融合技术融合处理不同聚焦度图像,因此,众多相关领域的研究人员对多聚焦图像融合技术展开广泛的深入研究。

文献[2]提出的四通道不可分提升小波下多聚焦图像融合方法中,通过提升分解二维四通道不可分小波滤波器组的多相位矩阵与二维提升小波逆变换,加快了融合速度;文献[3]利用FFST(Fast Finite Shearlet Transform,快速有限剪切波变换)、拉普拉斯能量以及NSML(Novell mirror server link Novell,镜像服务器连接),构建一种主观视觉效果较好的图像融合算法;而文献[4]则将多聚焦融合与Retinex结合,架构出改进双边滤波的多聚焦融合算法,该算法对图像泛灰、光晕、边界突出等现象存在有效的抑制作用,具有明显的细节强化优势。

通过对上述文献方法的优劣势取长补短,本文以边缘保持滤波为基础,设计一种多聚焦图像融合方法。通过自适应梯度联合约束及边缘保持滤波算法复原处理模糊图像,获取初始图像微分信息,提升多聚焦图像融合质量;利用快速傅里叶变换与傅里叶逆变换方法,使复原图像的边缘信息与初始图像的相似度更高;经边缘保持滤波阶段,提升边缘保持滤波效果,使梯度降噪处理与图像轮廓信息保留更加优越;引入深度神经网络模型的自编码器,降低运算复杂度,提升运行效率。

2 基于边缘保持滤波的多聚焦图像融合

2.1 边缘保持滤波下模糊图像复原

因无法获取初始图像微分信息,所以在融合前需要基于自适应梯度联合约束,先对模糊图像进行复原处理。模糊图像复原的具体流程描述如下:

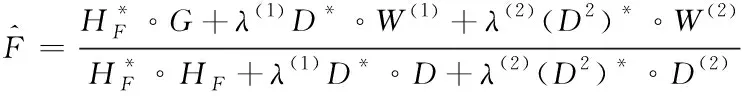

1)初步复原阶段:假设初始图像f(x,y)的灰度值序列为[fr(0),fr(1),…,fr(Nr-1)]T,其复原估计是,对应加权比例系数分别是λ(1)、λ(2),若令梯度先验序列均是0,且空间相关约束条件设定成最小化相邻像素差分[5],则采用下列模糊图像复原方程退化表达式,即可得到图像的初步复原结果(0)

(1)

式中,利用快速傅里叶变换[6]处理r半径下一维点扩散函数hr、模糊图像g、稀疏序列阶数d与d2,得到的Nr长复数序列分别是HF、G、D、D2,D2的复数共轭为(D2)*,元素相乘算子用∘表示,F1指代傅里叶逆变换形式。

2)边缘保持滤波阶段:若反馈系数是k,转换域中两个相邻像素的间距为u,则采用下列基于域变换的边缘保持滤波方程,滤除噪声信号,保持图像边缘细节,取得复原结果(0)的平滑图像(1)

(1)[n]=(1-ku)(0)[n]+ku(1)[n-1]

(2)

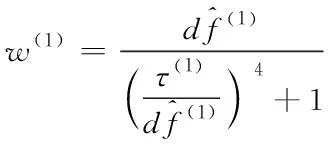

3)梯度先验估计阶段:图像一阶和二阶梯度的先验序列分别是w(1)、w(2),可通过平滑图像(1)的微分稀疏序列公式解得,如下所示

(3)

(4)

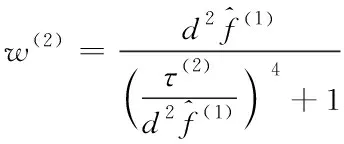

式(3)、(4)中,预设阈值为τ(*),与|d*(1)[n]|之间满足下列取值条件表达式

(5)

经合理设定阈值τ(*),可在一定程度上提升边缘保持滤波效果,使梯度降噪处理与图像轮廓信息保留更加优越。

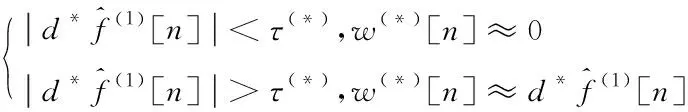

4)最后复原阶段:傅里叶变换[8]处理估计的一、二阶梯度先验序列w(1)、w(2)后,将处理结果与下列复原估计的相应频域解及其傅里叶逆变换[9]表达式进行整合,取得最终的复原图像:

(6)

(7)

式(6)、(7)中,快速傅里叶变换处理先验序列w(1)、w(2)所得的Nr长复数序列为W(1)、W(2)。

2.2 多聚焦图像融合

为解决低频子带信息损失问题,利用深度神经网络模型(deep neural network model,DNNM)含有的自编码器(auto encoder,AE)[10]来构建低频子带,并将其设定成网络输入,根据自编码器的学习属性,获取输入子带特征,取得隐藏层神经元权重,通过权重对比选取适宜的低频子带,所得的低频子带即融合后子带,融合完成。多聚焦图像的具体融合流程描述如下:

1)分解阶段:假设fA与fB是两个配准后的源图像,利用具有平移不变性的WKF(wavelet kernel filter,小波核滤波器)分解源图像为L层,得到数量是L的第j次分解多尺度高频子带WAj、WBj与低频子带PA、PB,其中,j=1,2,…,L,源图像特征用子带系数指代;

2)融合高频子带阶段:假设点(x,y)的小波核滤波器系数是Wj(x,y),邻域窗口是(s,t),则提取高频子带邻域间的局部能量表达式如下所示

Sj(x,y)=∑∑Wj(x+s,y+t)2

(8)

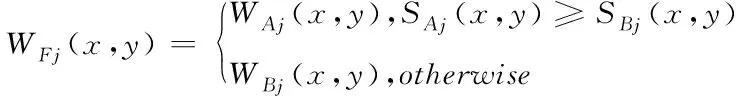

从提取出的局部能量中选择最大值作为融合后特征,利用下列表达式求取融合后的高频子带WFj(x,y)

(9)

3)融合低频子带阶段:划分源图像的低频子带PA与PB为多个子块,规格是n*n,将其作为自编码器输入后,构建与低频子带对应的自编码模型;在学习过程中,编码输入层数据,重构最小误差,取得理想的编码输入表达;若存在3层隐藏层,且神经元表达的是初始输入,隐藏层权重分别是EA、EB,融合后图像fF的低频子带是PF,则低频子带PF(x,y)的选取可通过下列条件式完成:

(10)

4)利用小波核滤波器重构所得的低频子带PF(x,y)与高频子带WFj(x,y),获取多聚焦图像的融合后图像f′。

3 多聚焦图像融合模拟实验

3.1 多聚焦图像融合平台与评估指标

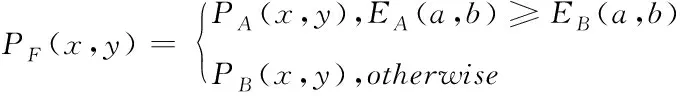

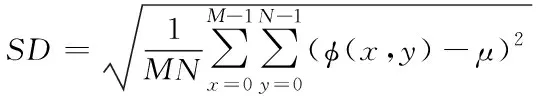

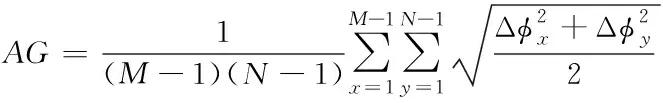

为验证基于边缘保持滤波的多聚焦图像融合算法的有效性,设计仿真对比实验。仿真平台选用proteus7.10软件,硬件为4GHz频率、8GB内存的英特尔双核处理器。多聚焦图像融合评估指标分别采用SD(Standard Deviation,标准差)、AG(Average Gradient,平均梯度)、MI(Mutual Information,互信息量)以及边缘信息保持度QAB/F,定量评估不同融合图像质量,四个指标分别用于反映图像的对比度、清晰度、融合图像含有的源图像信息量以及源图像边缘信息融入最终图像的融合量,各指标对应表达式如下所示

(11)

(12)

(13)

(14)

式(14)中,像素点(x,y)的灰度值为φ(x,y),融合图像的边长分别是M,N,图像灰度均值为μ;不同方向上的像素点一阶差分分别是Δφx与Δφy;源图像像素灰度值分别是a,b,其与融合图像的像素灰度值概率密度函数分别是pA(a)、pB(b)、pF(φ),两种图像的联合概率密度函数分别是pAF(a,φ)、pBF(b,φ);融合图像对源图像边缘信息保留值与感知保留值的乘积为QAF(n,m)、QBF(n,m),边缘强度函数是wA(n,m)、wB(n,m)。

将多聚焦图像分解层数设定成3,区域模板规格为5*5,采用文献[2]方法、文献[3]方法与所提方法融合多聚焦图像,验证方法的实践性与有效性。

3.2 多聚焦图像融合效果分析

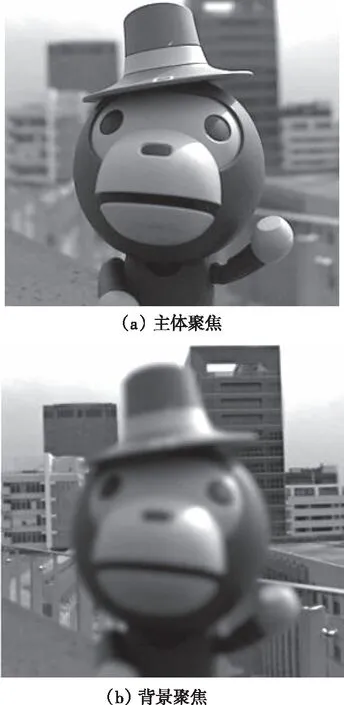

在lytro 数据集(https:∥www.irisa.fr/temics/demos/lightField/index.html)中选取一幅声多聚焦源图像作为实验对象,如图1所示。

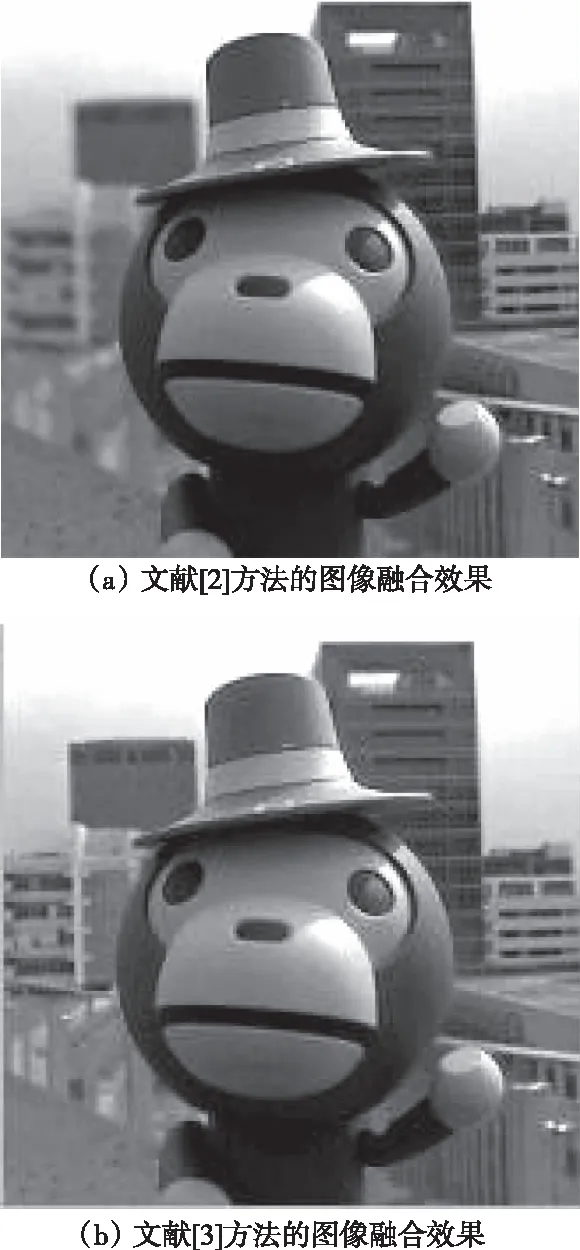

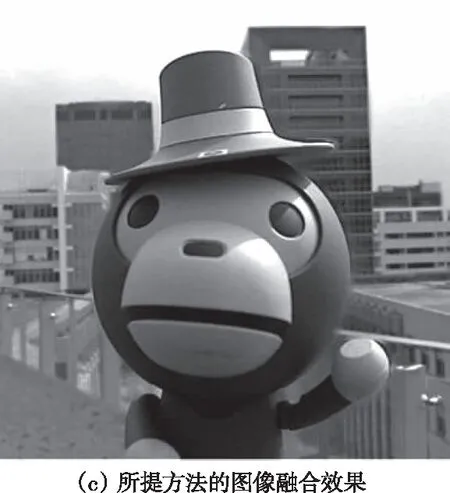

采用不同方法对图1实验图像进行融合,得到融合结果如图2所示。

图1 声多聚焦源图像

图2 不同方法的融合图像对比

根据以上各图像融合结果可以看出,文献[2]方法的融合图像中存在伪影现象[11],边缘模糊且有波纹与虚假信息出现,未较好地保留图像纹理细节,导致视觉效果较差,文献[3]方法所得的融合图像虚影有所减少,纹理细节相对清晰,而所提方法由于运用了具有平移不变性的小波核滤波器,使伪吉布斯现象[12]得到较好克服,因此,大幅提升了融合图像质量,获取了更高的对比度与更好的视觉效果;对比文献方法,所提方法充分提取出源图像清晰像素,并进行有效融合,具有极佳的融合图像效果。这是因为基于自适应梯度联合约束,对模糊图像进行了复原处理,因此,获得了更好的图像视觉效果。

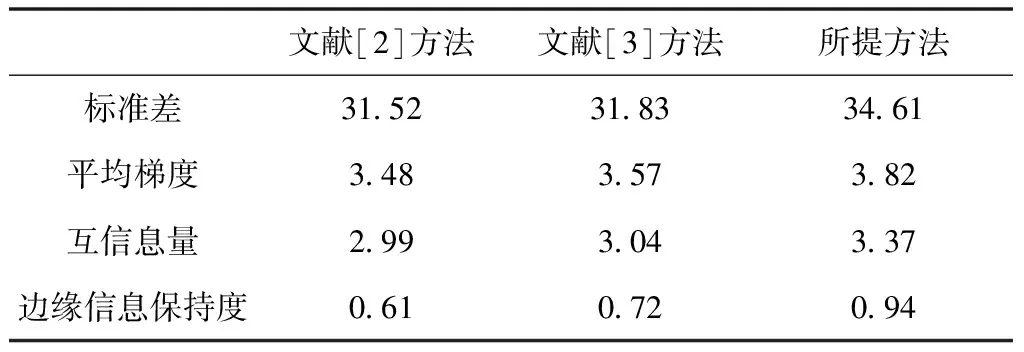

表1所示为图像融合评估指标的定量评价结果,对各融合方法的多聚焦图像融合性能做出了客观评价。

表1 多聚焦图像客观评估指标数据统计表

根据表中数据对比结果可以看出,相比文献[2]方法、[3]方法,所提方法具有最优的评估指标结果,既避免了伪吉布斯现象的出现,大幅度提升边缘特征,也在清晰度、对比度、纹理信息保留度等方面都取得了较好的融合效果,与标准图像最为接近。

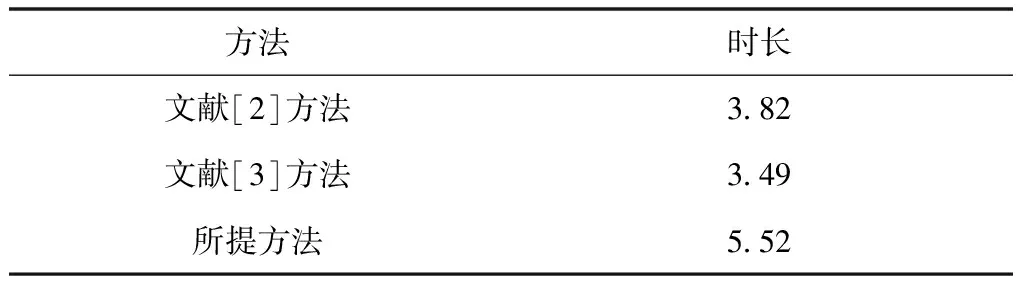

经统计各方法在融合多聚焦图像时所用的时长,整合得到下表2所示。

表2 各方法图像融合时长(单位:s)

各方法的融合时长结果表明,所提方法因使用深度神经网络模型含有的自编码器来构建低频子带,并学习输入子带特征,降低了计算复杂度,所以,对比文献方法的融合时长更短,而文献[2]方法、[3]方法则通过减小图像对比度与清晰度,用下降图像融合质量来换取快速融合。综合以上分析,所提方法既确保了融合的有效性,也相对缩减了融合时长。

由以上图像结果可知,本文方法对比文献方法具有更理想的噪声抑制性能,由于所提方法利用快速傅里叶变换、傅里叶逆变换等方法,高度复原了带噪的模糊图像,使图像噪声得到有效抑制,故其融合性能仍显著优于其它文献方法,提升了图像融合性能,具有较好的实际应用意义。

4 结论

图像融合技术以生成与人类视觉特性相符、与计算机处理性能匹配的新图像为目标,逐渐演变成图像处理、计算机视觉等领域中的热点研究课题。因光学镜头受限,导致无法实现聚焦全部清晰目标图像,故多聚焦图像融合策略应时而生。融合问题具有一定的复杂性,基于本文研究成果,从以下几个方面展开进一步改进:滤波参数决定了图像融合方法性能,为获取更好的融合质量,应将探索出更理想参数作为今后的研究侧重点;针对融合图像没有对源图像细节信息做较好保留的问题,应尝试结合新型技术与算法,构建更优越的融合方法;因时间限制,在未来的工作中,需采用更多的客观评价指标实施仿真,分析、评估方法性能;下一步应探究彩色图像的多聚焦融合效果,将图像融合层级从像素级扩展至特征级、决策级,拓宽方法应用领域;从融合时长角度出发,探究一种确保融合质量下缩减融合时间的方法,实现融合实时性。