基于深度学习的大田甘蓝在线识别模型建立与试验

翟长远 付 豪 郑 康 郑申玉 吴华瑞 赵学观

(1.北京市农林科学院智能装备技术研究中心,北京 100097;2.广西大学机械工程学院,南宁 530004)

0 引言

甘蓝是我国广泛种植的蔬菜之一,种植面积超过2.53×106hm2,位居所有蔬菜种植面积第3位。其产量与质量受到病虫害影响,目前病虫害防治最有效的手段依然是化学农药喷施[1-3]。目前甘蓝植保作业中多采用连续均一的喷药方式,导致田间残留量大,不仅增加生产成本,同时严重污染环境。对靶施药是提高农药利用率的有效方式,而靶标精准识别定位是实现对靶施药技术的首要条件。目前常用的大田靶标识别技术,主要有机器视觉技术[4-5]、超声波传感器探测技术[6]、三维激光雷达探测技术[7],超声波传感器及三维激光雷达能判断区域内靶标是否存在,但其难以准确区分出大田中的作物与杂草。机器视觉技术凭借获取信息量大、准确和智能的优点,在甘蓝识别中具备一定的优势。

甘蓝和杂草颜色相近,且土壤受湿度、光照、枯草等因素影响,背景复杂多变,使得利用单一的图像特征来检测甘蓝存在很大的困难,为了提高识别精度,研究者相继采用多特征融合的特征分类器进行靶标识别[8],主要包括支持向量机[9]、神经网络[10]、遗传算法[11]等,取得了优异的识别效果。与特征分类器的思想相比,深度学习最大的优势在于不依赖图像预处理与数据转换,自主获取图像中的有用特征信息。近年被越来越多的应用于农业靶标识别[12-13]。

采用深度学习技术进行田间甘蓝在线识别,面临两个主要问题:田间环境复杂,作物识别准确率低;深度学习模型推理过程计算量大,对于移动端部署设备要求算力高、体积小、功耗低。针对以上问题研究人员探索了深度学习模型优化与模型应用方法。在模型的优化过程中侧重于提高模型的识别精度而忽略了识别速度[14-16],通过对网络模型的优化[17-19],一定程度上提高了作物识别准确率,但图像处理时间增加较大,对于高速行驶下的实时操作,较长的模型图像处理时间,不可避免地影响作业性能,田间实际应用存在一定困难[20]。在深度学习模型的应用方面众多学者将模型部署于配备GPU的高性能计算机进行目标识别[21-23]。上述研究推动了深度学习在对靶施药领域的应用,但研究中使用的GPU功率高,不能满足大田条件下长时间持续工作要求。

本文以甘蓝为靶标,结合其生长早期及中早期病虫害对靶施药的需求,针对基于深度学习的甘蓝识别模型图像处理时间长,田间在线识别时使用高功率GPU,不能长时间持续工作的问题,基于深度学习方法搭建一种甘蓝在线靶标识别模型,对深度学习模型进行轻量化优化,以提高甘蓝识别速度,满足实际生产需要。同时模型部署于低功率嵌入式设备上,实现大田甘蓝实时识别与定位,并输出甘蓝直径数据,为后续甘蓝病害防治与对靶施药提供依据。

1 甘蓝识别模型构建

1.1 数据采集与数据集制作

于2021年5月1日—6月10日,在北京小汤山国家精准农业研究示范基地,从甘蓝定植后第5天开始,分6次进行采集,主要采集甘蓝幼苗期到莲座期前期,甘蓝之间存在间隙,无相互交叠时期的图像,如图1所示,采集设备为大恒工业相机,分辨率为2 592像素×1 944像素,USB 3.0接口,采用垂直向下的方式进行图像及视频采集。为保证样本的全面性,图像视频采集时间分别为晴天、多云、阴雨3种室外光照条件,共采集图像1 380幅。获得的甘蓝图像数据集杂草生长位置及密度多样,图像中均包含多个甘蓝目标以及不同杂草,与实际应用情况相同。为提高数据样本的丰富性,本研究采用图像旋转90°、亮度调整、模糊、对比度增强4种方式增强数据集,将数据总数扩充为原来的4倍,采用LabelImg软件手动标注为YOLO文件格式,获取到每幅图像中目标的边界框坐标矩阵。按照COCO数据集格式,根据比例4∶1∶1将数据集划分为训练集、测试集和验证集。训练集用于训练网络参数,测试集用于模型训练后模型的泛化误差评估,验证集用于对训练过程中所用到的超参数进行调优,以提高模型的性能。

图1 不同生长阶段甘蓝图像Fig.1 Cabbage images at different growth stages

1.2 甘蓝目标检测模型构建

本研究选择目前3种主流目标检测模型Faster R-CNN[24]、YOLO v5s[25]、SSD[26]进行对比研究,以选择最优甘蓝识别迁移学习模型。Faster R-CNN是二阶段检测模型,首先通过RPN网络(Region proposal network)生成甘蓝目标候选框,将候选框映射到特征图上,输入全连接层进行目标分类;相较于Faster R-CNN的二阶段检测,YOLO v5s算法将甘蓝的分类、定位功能融合于一个神经网络当中,输入甘蓝图像只需经过一次网络计算即可得到图像中目标边界框位置以及目标种类。SSD模型结合多尺度检测的思想,采用多个不同尺度的甘蓝特征图进行检测,能显著提高大目标的检测效果[27]。

根据对比试验结果,选择YOLO v5s神经网络进行优化,搭建针对复杂大田环境中甘蓝识别速度快、准确率高的甘蓝目标检测模型。主要优化内容包括:优化卷积计算方式以及甘蓝主干特征提取网络。

1.2.1融合深度可分离卷积

传统神经网络使用普通卷积,卷积计算过程如图2a所示,采用多个3维卷积核对输入的3通道彩色甘蓝图像进行卷积运算,运算过程中卷积核作用于输入图像或者特征图的每一个通道,其计算量计算公式为

图2 卷积计算示意图Fig.2 Convolution calculation diagram

FLOPs=WHCD2K

(1)

式中FLOPs——浮点运算次数

W——图像像素列数

H——图像像素行数

C——图像(特征图)通道数

D——卷积核尺寸

K——输出特征图数量

计算量与输入图像分辨率W、H成正比,输入图像像素数越大,计算量越大,同时计算量是导致图像处理时间变长的决定性因素之一。甘蓝识别定位中,图像处理时间限制了图像处理帧率,同一运动速度下处理帧率越低定位精度越差。同时,嵌入式部署要求模型计算量较小。本文采用深度可分离卷积[28](Depthwise separable convolution)进行甘蓝特征提取,深度可分离卷积计算过程如图2b所示,首先采用二维卷积核分别对彩色甘蓝图像中每一个通道进行卷积运算,得到单通道图像的甘蓝特征,接着使用1×1×M卷积核对通道卷积结果进行卷积运算,融合不同通道下的甘蓝特征信息,深度可分离卷积的计算量计算公式为

FLOPs=WHCD2+D2CK

(2)

以采集的3通道彩色甘蓝图像为例,分辨率为480像素×360像素,进行一次卷积时输出特征图数量为16,卷积核尺寸为3×3,使用传统卷积计算量为7.46×107,使用深度可分离卷积计算量为4.67×106。使用深度可分离卷积进行甘蓝特征提取相对于传统卷积计算量减少了93.7%。因此本文使用深度可分离卷积代替YOLO v5s中的传统卷积。

1.2.2甘蓝主干特征提取网络

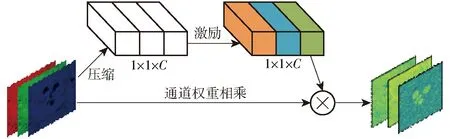

主干特征提取网络用于自动提取图像中甘蓝特征,对识别准确率有重要影响,同时主干特征提取网络的深度决定模型识别的速度,网络深度越浅识别速度越快,根据实时识别的要求,本研究通过对比YOLO v5s、MobileNet v3s[29]、ShuffleNet v2[30]轻量化主干特征提取网络对甘蓝特征的提取效果,根据试验结果选择MobileNet v3s作为甘蓝识别模型的主干特征提取网络。MobileNet v3s使用H-SWISH代替传统计算耗时较长的SWISH激活函数,提高了网络的运算速度。针对甘蓝与背景土壤颜色差异较大的特点,采用轻度注意力模块(Squeeze-and-excitation,SE),SE模块来源于SENet[31],通过学习不同图像通道之间的相关性,提高模型对甘蓝图像绿色通道的注意力,SENet模块计算如图3所示,甘蓝特征图经过全局池化压缩成大小1×1×C特征图,将特征图输入两个全连接层组成的激励网络,最后输出的各通道权重参数与原特征图对应通道相乘得到经注意力机制处理的特征图,以提高对图像中甘蓝目标的关注度,提高识别准确率。

图3 SE模块Fig.3 SE module

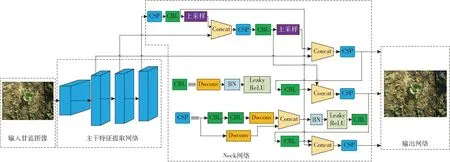

1.2.3甘蓝检测模型整体结构

本研究采用YOLO-mdw,模型结构如图4所示。YOLO-mdw由主干特征提取网络、Neck网络和输出网络构成。本文采用轻量级主干特征提取网络MobileNet v3s代替原始YOLO v5s中的主干特征提取网络,MobileNet v3s采用深度可分离卷积,相较于传统卷积计算量大幅度减小;Neck网络部分采用特征金字塔网络(Feature pyramid networks,FPN)和金字塔注意力网络(Pyramid attention network,PAN),FPN提取不同尺度下的甘蓝特征信息,并将其融合,在不增加计算量的情况下,提高对小个体甘蓝的检测精度,PAN网络将甘蓝图像深浅层语意特征进行融合,避免了经过多次卷积操作后特征信息丢失的问题。输出网络部分输出检测目标边界框的坐标以及目标种类和置信度。

图4 甘蓝目标识别模型Fig.4 Cabbage target detection model

1.3 模型训练

本文在对比Faster R-CNN、SSD、YOLO v5s深度学习模型以及测试YOLO v5s、YOLO v5+ShuffleNet v2、YOLO v5+MobileNet v3s、YOLO-mdw不同主干特征提取网络对甘蓝的识别效果时,采用获取到的甘蓝图像数据集训练模型。

1.3.1训练平台

模型训练平台为台式工作站,工作站配置为:48 GB内存,搭载Intel(R)Core(TM)i9-10900K CPU,主频3.70 GHz,GPU为NVIDIA RTX 3090,运行环境为Windows 10(64位)操作系统,Python 3.8编程语言版本,Pytorch 1.7深度学习框架。

1.3.2训练策略

系统实时检测要求图像处理速度较快,通过对比不同输入图像像素对模型性能影响,选择训练输入图像尺寸为480像素×360像素,训练时以16幅图像作为一个批次进行训练,每训练一次更新一次权重,通过前期试验得到,不同模型收敛时最大迭代次数为500次,为保证试验时参数的统一性,所有模型训练迭代次数均为500次,为提升模型性能防止过拟合,选择随机梯度下降法(Stochastic gradient descent,SGD)作为训练优化方法,初始学习率为0.025,动量因子0.6,权重衰减系数0.001。模型训练完成后,采用Pytorch框架部署于NVIDIA Xavier NX开发板上。

1.3.3评价指标

为全面评估模型性能,采用基于精准率和召回率计算的模型综合性能评价参数——识别准确率与平均图像处理时间作为模型评价指标。

1.4 模型测试结果分析

1.4.1目标检测模型选择与结果分析

Faster R-CNN、SSD、YOLO v5s目标检测模型在甘蓝数据集上的试验结果如表1所示。

表1 不同模型性能测试结果Tab.1 Performance test results for different models

由表1可知,YOLO v5s的甘蓝识别准确率为95.10%,比Faster R-CNN高3.14个百分点,比SSD高5.21个百分点;YOLO v5s的单帧图像平均处理时间为7.20 ms,是Faster R-CNN的19%,比SSD快0.95 ms。综上所述,在甘蓝识别准确率以及图像处理速度上YOLO v5s相对于Faster R-CNN和SSD都有一定的优势,因此本文选择YOLO v5s为甘蓝目标识别迁移学习模型。

1.4.2不同主干特征网络模型测试结果与分析

YOLO v5s采用不同主干特征网络以及本文提出的YOLO-mdw甘蓝目标检测模型,在甘蓝数据集上的试验结果如表2所示。

表2 不同主干特征网络模型测试结果Tab.2 Cabbage recognizes model test results

从表2可以看出,本文提出的融合MobileNet v3s主干特征提取网络与深度可分离卷积的YOLO-mdw模型,平均图像处理时间低于YOLO v5s以及采用ShuffleNet v2和MobileNet v3s主干网络的目标检测模型,在识别准确率方面YOLO-mdw的识别准确率为95.67%,高于YOLO v5s、YOLO v5+ShuffleNet v2、YOLO v5+MobileNet v3s。因此本文提出的甘蓝目标检测算法相对于传统YOLO v5s、YOLO v5+ShuffleNet v2、YOLO v5+MobileNet v3s算法,在甘蓝识别准确率和图像处理时间上有一定优势。

模型部署于NVIDIA Xavier NX开发板上,性能参数如表3所示。

表3 模型在NVIDIA Xavier NX开发板上性能Tab.3 Model performance on NVIDIA Xavier NX development boards

从表3可以看出,在NVIDIA Xavier NX开发板上模型识别准确率与计算机上相同,在模型图像处理时间方面,YOLO-mdw模型为53.30 ms,低于YOLO v5s、YOLO v5+ShuffleNet v2、YOLO v5+MobileNet v3s。试验表明在移动端部署后YOLO-mdw模型在识别准确率和图像处理时间方面,仍然比YOLO v5s、YOLO v5+ShuffleNet v2、YOLO v5+MobileNet v3s模型有一定优势。

1.4.3不同图像分辨率模型测试结果与分析

测试了YOLO-mdw甘蓝目标检测模型在1 296像素×972像素、640像素×480像素、480像素×360像素、360像素×240像素4种不同分辨率下模型的识别准确率和图像处理时间,试验结果如表4所示。

从表4可以看出,分辨率为360像素×240像素时,识别准确率相对于1 296像素×972像素下降了3.99个百分点。分辨率为480像素×360像素时识别准确率下降不超过1个百分点,图像处理时间缩短了154.03 ms,因此选择480像素×360像素作为识别系统的输入图像分辨率。

表4 不同分辨率模型测试结果Tab.4 Results of model performance at different resolutions

2 甘蓝定位方法

本文提出的甘蓝定位方法流程如图5所示,主要包括4个步骤:①使用目标检测模型对相机拍摄到的甘蓝视频中每一帧图像进行处理,目标检测模型输出甘蓝目标的边界框坐标。②将获取的t帧甘蓝目标边界框坐标使用卡尔曼滤波算法进行处理,对目标在t+1帧中的位置进行预测,同时该预测结果结合目标检测中的检测结果,更新t+1帧中的目标结果。③采用匈牙利算法对比t、t+1两帧图像中甘蓝目标边界框的马氏距离,进行最优匹配,建立两帧图像中同一个目标的运动关系,避免了同一甘蓝在不同帧图像中重复识别。④在相机视场固定位置设置虚拟线,如图6所示,当满足前帧甘蓝边界框前端中点在虚线前,下一帧图像甘蓝边界框前端中点在虚线后的条件时,判定甘蓝运动到指定位置,控制器发出信号,为后续对靶施药提供信号依据。

图5 甘蓝定位算法流程图Fig.5 Flow chart of cabbage positioning algorithm

图6 虚拟线定位示意图Fig.6 Schematic of virtual line positioning

3 台架试验

3.1 光照强度影响试验

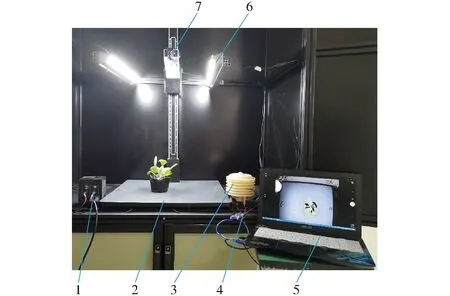

为验证算法在不同光照强度下的鲁棒性,搭建了可调光照强度试验台,获取不同光照强度下的甘蓝图像。其组成如图7所示,包括载物台、相机(PSNSSX5268-1080P型)、LED条形光源(沃德普公司,HDL3型)、光源控制器(科麦视觉公司,ACS2.0-2C060W-24PS型)、光照强度传感器、单片机(Arduino UNO)、计算机(FX-PLUS)。夏季太阳光直射下光照强度为60 000~100 000 lx,选择的LED条形光源光照强度在0~124 000 lx之间可调。参考文献[32]将光照强度分级为50、24 800、49 600、74 400、99 200、124 000 lx 6个等级,每个等级拍摄100幅甘蓝图像,使用甘蓝目标检测模型进行识别检测,并统计识别准确率及目标平均置信度。

图7 可调光照强度试验台Fig.7 Adjustable light intensity test bench1.光源控制器 2.载物台 3.光照强度传感器 4.单片机 5.计算机 6.LED条形光源 7.相机

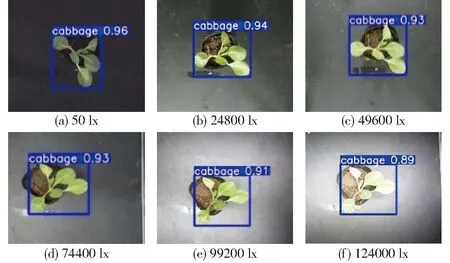

将采集到的6个等级光照下的图像,每个等级100幅,输入甘蓝目标检测模型,进行识别验证,识别结果如图8所示。

图8 不同光照强度下目标识别结果Fig.8 Target recognition results under different illumination intensities

不同光照强度下相机采集到的图像表明,当光照强度低于99 200 lx时,图像纹理特征较为清晰,当光照强度增加到124 000 lx,甘蓝叶片表现出整体或局部反光现象,纹理特征减弱,增加了模型识别难度。

表5为每个光照强度等级下识别准确率和置信度结果,每个光照等级下识别准确率均为100%,但识别置信度有区别,置信度为甘蓝目标检测模型输出的每个检测框的种类是甘蓝的概率,本文设置置信度阈值为0.5,即检测框置信度大于0.5时,判定检测框中目标种类为甘蓝,光照强度在50~124 000 lx之间,最小平均识别置信度为0.87,所以在实验室中,YOLO-mdw模型输入的图像光照强度为50~124 000 lx之间时,静态条件下光照强度变化对甘蓝识别准确率无影响。

表5 不同光照条件下识别结果Tab.5 Recognition results of different lighting conditions

3.2 甘蓝识别定位精度试验

为检测甘蓝靶标识别系统的识别、定位准确性以及甘蓝识别直径误差,搭建了甘蓝识别定位试验台,其结构如图9所示。

图9 甘蓝识别定位试验台构成图Fig.9 Composition diagram of cabbage identification and positioning test bench1.同步带 2.甘蓝 3.电机 4.电机调速器 5.示波器 6.光栅传感器 7.NVIDIA Xavier NX开发板 8.显示器 9.相机

工作时,在电机的驱动下同步带可按照设定速度运动,调速范围在0~1 m/s。同步带两侧安装有苏州固函机械科技公司生产的A06-20型对射式光栅传感器,传感器响应时间小于10 ms,光束间距20 mm,常开类型,传感器对射光线与定位方法设置的虚拟线位于同一位置,当有物体遮挡对射光线时输出12 V高电平信号,反之输出低电平。运动甘蓝开始遮挡光栅传感器光幕时,传感器输出信号出现上升沿,甘蓝离开光幕时刻,信号出现下降沿,通过示波器记录,同时位于同步带正上方的摄像头采集甘蓝视频信息,相机像素100万像素,帧率为30 f/s,部署于NVIDIA Xavier NX开发板的甘蓝靶标识别系统对下方运动甘蓝进行实时识别定位处理,开发板的具体参数如下:功率为15 W,集成384个CUDA核心、48个Tensor 核心和2个NVDLA引擎,操作系统为Ubuntu 20.10,同时配置有Pytorch深度学习框。当识别定位系统识别定位到甘蓝时,输出高电平,反之输出低电平,同时将电平信号保存于示波器(TDS2000型)。试验台实物如图10所示。

图10 试验台实物图Fig.10 Physical view of test bench

试验时,通过电机调速器调节同步带分别以速度0.2、0.4、0.6、0.7、0.8 m/s运动,当同步带速度运行平稳后,选择10棵种植于育苗杯中的甘蓝,人工平放于同步带上,随同步带运动,在运动到同步带尽头时,人工从同步带上取下甘蓝,每棵甘蓝重复放置10次,放置顺序随机,根据大田中甘蓝株距为30 cm,相邻放置的两颗甘蓝距离范围在10~50 cm之间,每个速度下采集100组数据。将同步带运动方向记为正方向,示波器采集光栅传感器及甘蓝识别系统的输出信号。

使用甘蓝识别定位试验台进行试验,采集到光栅传感器与识别系统信号,如图11所示,图中D1为甘蓝实际直径,D2为系统检测到的甘蓝直径;ΔL为定位误差。

图11 光栅传感器与识别定位系统输出信号Fig.11 Output signal of grating sensor and identification and positioning system

光栅传感器检测到甘蓝时输出的高电平信号时间乘以同步带速度得到甘蓝实际直径D1,识别系统输出的高电平信号时间乘以同步带速度得系统检测到的甘蓝直径D2,两信号的时间差乘以速度,得到甘蓝靶标识别系统的定位误差ΔL。

不同速度下甘蓝识别准确率如表6所示,试验结果表明,本文提出的模型能在甘蓝运动速度低于0.6 m/s时有较高的识别效果。当速度提升至0.7 m/s时,由于产生运动模糊,影响甘蓝特征提取,识别准确率降低。

(1)还需通过实验分析改变温度,实验时长等条件的变化下对SiBCN先驱体进行分子动力学模拟,并分析结果规律。

表6 甘蓝识别准确率Tab.6 Cabbage identification accuracy

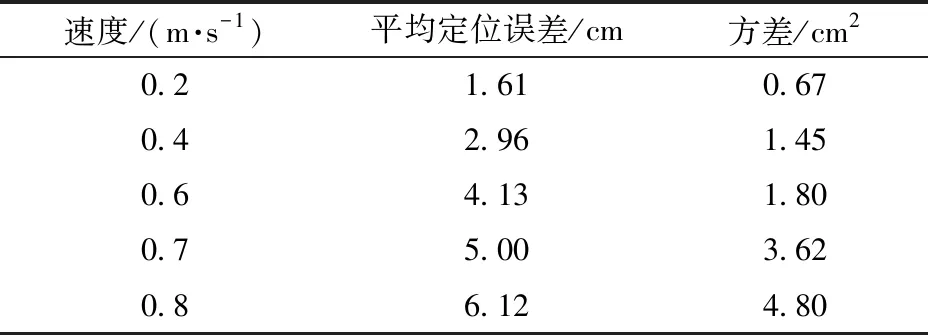

在验证识别准确率的同时,根据光栅传感器与甘蓝识别系统输出信号的时间差计算甘蓝定位误差,结果如表7所示,试验表明甘蓝平均定位误差随速度的增加而增大,该定位误差主要由图像处理时间产生。

表7 甘蓝定位误差Tab.7 Cabbage positioning error

甘蓝直径识别误差如表8所示,可以看出在不同速度下,甘蓝直径识别平均误差范围为1.33~1.56 cm,采用SPSS Statistics26数据分析软件对所得识别直径误差数据进行单因素方差分析,分析结果如表9所示,取显著性水平α=0.05,表中计算得P=0.351,大于著性水平0.05。在实验室条件下,甘蓝直径识别平均误差不超过1.56 cm,且误差与甘蓝运动速度无显著关系。

表8 甘蓝直径识别误差Tab.8 Detection error of cabbage diameter

表9 单因素方差分析结果Tab.9 Results of one-factor variance analysis

甘蓝识别定位准确性试验表明,在实验室中甘蓝直径识别误差与运动速度无显著关系,甘蓝运动速度不大于0.6 m/s时,本文提出的甘蓝识别系统对甘蓝识别准确率为94%,当速度提升至0.7 m/s时,识别准确率下降为61%,考虑喷雾作业质量要求,作业速度应小于0.6 m/s,此时平均定位误差为4.13 cm。

4 田间试验

为验证甘蓝识别模型在大田条件下识别准确性,于2021年9月18日(天气多云,北风2级,气温15~24℃)、2021年9月23日(天气小雨,东风2级,气温17~27℃)、2021年9月29日(天气晴,东风1级,气温16~27℃)在北京市小汤山国家精准农业研究示范基地进行田间试验。试验主要采集不同光照条件下的甘蓝视频,采集时将相机安装于田间移动平台前端,相机垂直向下拍摄,移动平台以速度0.5 m/s匀速行进,将视频输入甘蓝识别模型,统计田间条件下甘蓝识别准确率。

不同天气条件下甘蓝识别模型识别结果如图12所示。多云条件下,光照较均匀,甘蓝与杂草颜色相近,但纹理差异较明显;晴天条件下,光照强度大,图像亮度大,甘蓝叶片叶脉部分反光情况较为严重;阴雨天气条件下,光照较均匀,甘蓝纹理轮廓特征清晰,地面存在水印,背景较为复杂。3种天气条件下均有较好识别效果。

图12 不同天气识别结果Fig.12 Results for different weather recognition results

表10为田间甘蓝识别准确率结果,其中晴天条件下识别准确率相较于多云天气低1.61个百分点。晴天条件下识别准确率略低的原因是,强光环境下,作物与杂草表面反光较为严重,获取到的图像纹理特征变弱,降低了作物与杂草的区分度,增加了目标检测的难度。本研究中未识别甘蓝中存在部分甘蓝苗较小,相邻的杂草较大,对甘蓝产生了遮挡,影响了靶标准确识别,进而造成了漏识别。

表10 大田环境甘蓝识别准确率Tab.10 Identification accuracy of cabbage in field environment

5 讨论

本研究以大田甘蓝为研究对象,实现大田复杂环境下甘蓝实时识别定位,分析不同光照条件以及不同速度对模型识别定位性能的影响。YOLO-mdw模型部署于NVIDIA Xavier NX开发板上,图像处理时间为53.30 ms,相对于原始模型提高了19.69 ms,根据识别定位方法原理,速度为0.6 m/s时定位误差可减小1.18 cm。在0.6 m/s时,平均定位误差为4.13 cm,定位误差与图像处理时间成正相关,该方法用于田间对靶施药时可进行定位误差补偿,即

L=0.053 3v

(3)

v——喷雾机作业速度,m/s

本文甘蓝检测模型部署采用功率为15 W的嵌入式设备,相较于文献[21,23]采用高功率的英伟达显卡进行模型部署,在田间无外接电源情况下,能大幅度提高设备工作时间。

在构建甘蓝目标识别系统时,本文采用甘蓝视频输入甘蓝目标模型的方式,结合卡尔曼滤波以及匈牙利算法,通过对识别目标进行跟踪,建立两帧图像间同一个甘蓝目标的运动关系,解决摄像头视场内帧间目标重复识别的问题,相较于姜红花等[22]采用相机每间隔0.5 s拍摄一幅图像进行目标识别的方式,本文提出的方法不会因平台移动速度变化而重复识别甘蓝目标,系统使用普适性更具有优势;本文甘蓝识别系统在工作速度为0.6 m/s时,仍有超过94%的识别准确率。相较于文献[22]中采用计算量较大的Mask R-CNN的对靶施药系统时工作速度只有0.2 m/s,有效提高了喷药作业的效率。在速度进一步提高时,识别准确率急剧下降,提取不同速度下相机拍摄到的图像,如图13所示,在速度0.2、0.4 m/s时相机拍摄到图像中的甘蓝目标纹理特征以及轮廓特征相对清晰,甘蓝运动速度提升到0.6 m/s后,轮廓特征出现一定的模糊,受相机曝光时间影响,速度提升到0.7 m/s和0.8 m/s时,甘蓝目标出现严重运动模糊,造成甘蓝目标检测模型提取到的有效特征变少,降低甘蓝的辨识度,导致识别准确率降低,与文献[21]得出结论相同。可在图像输入深度学习模型前增加图像去模糊算法,来解决高速运动状态下识别准确率低的问题。

图13 不同速度下甘蓝拍摄图像Fig.13 Cabbage shooting effects at different speeds

大田试验结果显示本文模型在不同天气条件下平均识别准确率为94.03%,有5.97%的甘蓝未识别或错误识别,未识别甘蓝如图14所示。

图14 未识别甘蓝Fig.14 Unrecognized cabbage

从图14可以看出,甘蓝受到恶劣天气或病虫害影响,叶片出现残缺情况,如图14a所示,这类情况导致甘蓝特征数量少、模糊,影响模型识别准确性;对于补栽甘蓝,如图14b,幼苗未成活,叶片数量少,面积小,相机拍摄到甘蓝特征少,大部分为甘蓝叶片背面特征,模型训练使用的数据集图像均为垂直拍摄,更多是甘蓝叶片正面特征,导致补栽未成活甘蓝识别准确率较低。晴天条件下,如图14c,对于叶片出现残缺的甘蓝,白色叶脉占比增大,在强光照下,反光严重,获取甘蓝纹理特征少,导致出现未识别现象。

3组试验中总共将179株杂草识别为甘蓝,识别错误情况如图15所示。在强光条件下,叶片较光滑类型杂草反光严重,与甘蓝相似度高,且输入模型的图像尺寸为480像素×360像素,分辨率较低,目标特征模糊,进一步降低甘蓝与杂草的差异,导致出现识别错误现象。

图15 错误识别Fig.15 Error identification

针对小目标、甘蓝残缺信息量少的问题,可构建包含受气候灾害或病虫害影响和健康甘蓝的均匀的综合性大型数据集,或在输入甘蓝目标检测模型前,使用相应的图像处理技术将小目标或残缺甘蓝进行放大,再合并到原图位置,增加信息量,提高检测精度。

6 结论

(1)提出一种融合MobileNet v3s主干特征提取网络与深度可分离卷积的YOLO-mdw甘蓝识别模型,并结合卡尔曼滤波、匈牙利算法设计了甘蓝定位方法。

(2)实验室试验表明,甘蓝目标检测模型输入图像尺寸为480像素×360像素,部署于嵌入式设备NVIDIA Xavier NX开发板时推理时间为53.30 ms,光照强度在50~124 000 lx之间识别准确率不受光照强度影响。识别定位试验表明,甘蓝运动速度对甘蓝直径检测无显著影响,对识别准确率以及定位准确性有一定影响,速度不大于0.6 m/s时,平均定位误差为4.13 cm,识别准确率为94%。

(3)田间试验表明,晴天、多云、阴雨天气条件下甘蓝识别准确率分别为93.14%、94.75%和94.23%,图像处理时间为54.09 ms,识别效果满足实际生产中在线精准识别的要求,该方法可为大田甘蓝中早期对靶施药提供技术支撑。