一种基于混合变压器的医学图像分割方法

穆应晨,王学军,王怡雯,卢 琳

(石家庄铁道大学 信息科学与技术学院,河北 石家庄 050043)

世界卫生组织国际癌症研究机构(IARC)发布了2020年全球最新癌症负担数据,这份数据报告显示,2020年全球1 930万人新确诊癌症,近1 000万人死亡,中国新发癌症数与癌症死亡数均位居全球第一。其中肺癌是发病率和死亡率最高的恶性肿瘤,所以尽早发现和诊断是治疗肺癌的第一步。现如今CT影像学检查是诊断肺癌的主要手段。肺癌早期,CT影像可清晰显示支气管壁的不规则增厚、管腔狭窄、管腔内结节等改变[1]。晚期时,通过CT影像可看清肿块的边缘、形态、瘤周表现、内部结构及密度变化等[2]。将医学图像处理技术应用于肺部诊断的辅助治疗,对医生更快地判断患者的肺部疾病具有重要意义。

医学图像分割技术是医学图像处理中最常用的方法之一。常用的图像分割技术包括手工分割方法、半自动分割方法和全自动分割方法[3]。其中带有自动分割的分割方法已经是医学图像分割方法的支柱,利用深度学习实现医学图像的自动分割已经成为了新的趋势。Long J等[4]在2015年提出全卷积神经网络(Fully Convolutional Networks,FCN),并用于自然图像的语义分割领域。基于全卷积神经网络的医学图像分割方法是一种端到端的分割方法,有效地避免了卷积神经网络中计算量大等问题[5]。随后Ronneberger O等[6]提出了一个编码器-解码器的对称网络U-Net,它真正意义上将全卷积网络应用到医学图像分割领域,通过跳跃连接(Skip Connection)将浅层和深层的图像信息进行融合。Gu Z等[7]在2019年提出了上下文编码网络(Context Encoder Networks,CE-Net),利用上下文信息对特征进行捕获。Vaswani A等[8]提出的Transformer模型早在2107年就开始流行起来,它将注意力机制的思想发挥到了极致,抛弃了以往深度学习任务里面使用到的卷积神经网络(Convolutional Neural Network,CNN)[9]和循环神经网络(Recurrent Neural Network,RNN)[10]。Transformer目前已经成为了自然语言处理(Natural Language Processing,NLP)领域的标准配置,也为计算机视觉领域开拓了一条新的道路。Dosovitskiy A等[11]在2020年提出将Transformer框架应用到计算机视觉中,提出了Vision Transformer(ViT),证明了不需要依赖CNN也可以进行图像的处理。Transformer的优势就在于利用多个自注意力机制的方式来捕获全局的上下文信息从而对目标建立起远距离的依赖,提取出更强有力的特征。

为了减少肺部CT影像的分割损失,提高神经网络对肺部CT影像的分割能力,研究提出了TCU-Net(U-Net with Transformer and Context Encoder for Image Segmentation,TCU-Net)算法。TCU-Net是基于混合Transformer的一种图像分割算法,将混合Transformer的编码结构代替了U-Net中的编码结构,编码和解码之间加入了上下文信息编码模块(Context Encoder Block,CE-Block)[7],保留转置卷积(Transposed Convolution)[12]上采样解码部分不变,使网络结构聚焦于肺部图像的细节,提高了模型的分割能力。

1 研究算法

作为人体最重要的呼吸器官,肺承载着呼吸调节功能、免疫功能、肺循环功能、造血功能等多种重要的功能[13]。精准分割肺的大小以及边缘,对临床诊断、提前发现病变有着重要的作用。TCU-Net算法是在U-Net基础上,结合了混合Trasformer结构与上下文信息编码模块,利用多尺度特征有针对性地对不同大小的形状进行分割,从而提高了分割算法的准确率和肺部分割精度。该网络在编码层引入了混合Transformer结构,并利用多头自注意力机制(Multi-Head Self Attention,MHSA)更好地实现了全局特征学习。在像素恢复过程中,使用跳跃连接将图像的低层特征与高层特征结合,最终实现图像分割任务。

1.1 混合变压器结构

混合Transformer结构采用了ResNet50[14]作为特征图提取的主干网络,相比Transformer结构,混合Transformer模型结合了CNN与Transformer的优势:卷积运算擅长提取局部特征,但在捕获全局特征方面具有一定的局限性,而Transformer中的级联自注意力模块可以捕获长距离的特征依赖,弥补了CNN的缺陷。

图1 混合Transformer模型结构 图2 Transformer-Encoder层的内部结构

对于Transformer-Encoder的输入,z0计算过程如式(1)所示:

(1)

式中,C代表图片的通道数。

Transformer-Encoder层的内部结构如图2所示。由图2可知,其是由L层的多头自注意力机制块和多层感知机(Multi-Layer Perceptron,MLP)[15]块组成的,因此第l层的输出记为zl,计算过程如式(2)、(3)所示:

(2)

(3)

式中,LN代表LayerNorm层。

1.2 CE模块

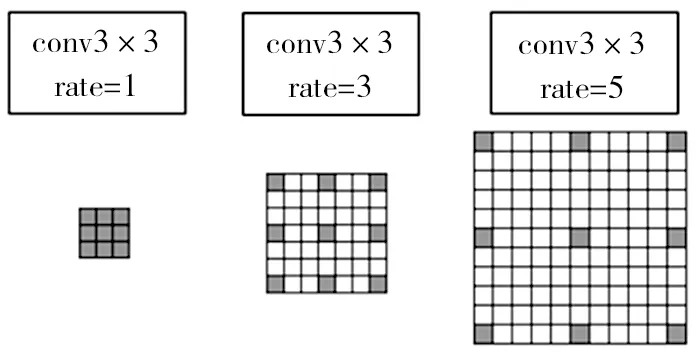

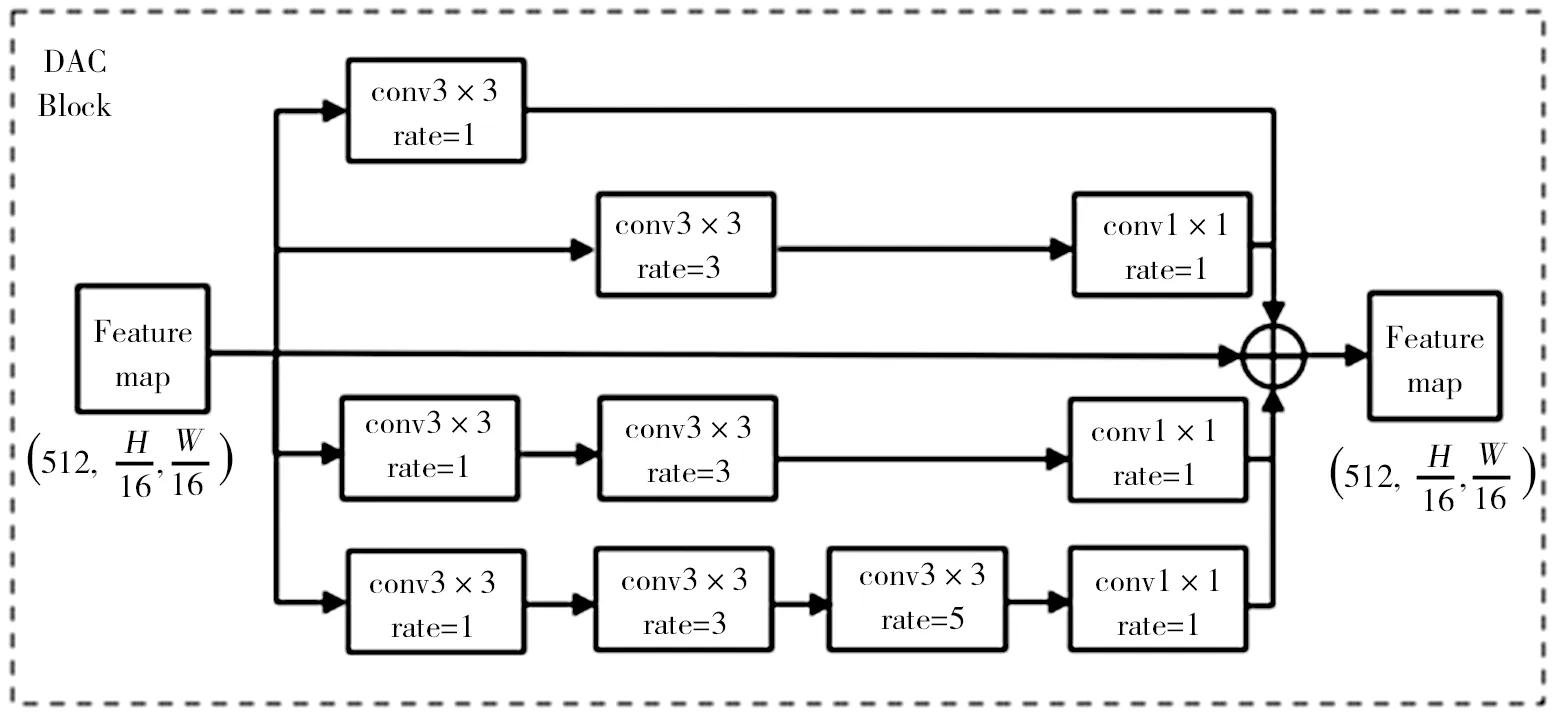

CE模块(CE-Block)是由密集空洞卷积(Dense Atrous Convolution,DAC)模块和残差多核池化(Residual Multi-kernel Pooling,RMP)模块两部分组成。DAC模块使用多尺度空洞卷积来提取丰富的特征信息,RMP模块使用多尺度池化操作保留更多的空间信息。该模块可以捕获更多抽象特征和保留更多空间信息从而提高分割的性能。

空洞卷积(Atrous Convolution)[16]应用在语义分割和目标检测任务中可以得到更大的感受野,获得更加密集的数据,它最初是为提高小波变换的计算效率而提出的,空洞卷积的计算如式(4)所示:

y[i]=∑x[i+rk]w[k],

(4)

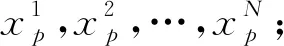

式中,输出特征y是由输入特征x和滤波器w的卷积产生的;空洞率rate对应输入的步幅;k代表卷积核的大小。通过调整不同的rate可以获得不同的感受野,如图3所示。

图3 空洞卷积

DAC模块如图4所示。由图4可以看出,DAC模块有4个级联分支,是空洞卷积以级联方式堆叠而成的。每个分支使用不同rate进行卷积,感受野分别是3、7、9、19。DAC模块采用了不同大小的空洞卷积获取不同的感受野。在每个卷积分支后,使用一个RELU激活函数。最后将原始特征直接添加到其他特征中。

图4 DAC模块

RMP模块主要依靠多个有效视野来检测不同大小的目标。一般的最大池化操作只使用单个池化核,而RMP模块通过4个不同大小的池化核 (2×2,3×3,5×5和6×6)对全局上下文信息进行编码。输出包含不同大小的特征映射。并在每一级池化后使用1×1卷积对特征图进行降维,再对低维特征图进行上采样,使用双线性插值得到与原始特征图相同大小的特征。最后将原始特征与上采样特征图连接起来,如图5所示。

图5 RMP模块

1.3 TCU-Net模型

TCU-Net网络模型如图6所示,该模型的输入是H×W×C的数据,首先,使用ResNet50网络提取特征图,将尺寸缩小到原尺寸的1/16,因为Transformer网络的输入必须是向量序列,所以将特征图转化为向量的形式输入到Transformer Layer层。其次,将向量转化为张量,送入CE-Block中,提取上下文信息。最后,使用跳跃连接和转置卷积的上采样操作,输出最终结果,优化模型分割结果。

图6 TCU-Net网络模型

2 实验准备

2.1 实验数据集

实验的数据集是2017年Lung Nodule Analysis (LUNA)竞赛中的公开数据集,LUNA竞赛是为了检测结节和减少假阳性,而分割肺部是进一步筛选肺结节的基础。实验选取二维CT图像中的肺部进行分割,该数据集包含534个2D样本,带有各自的标签图像,全部为512×512像素,使用80%的图像进行训练,其余的用于测试,并进行交叉验证。

2.2 评价指标

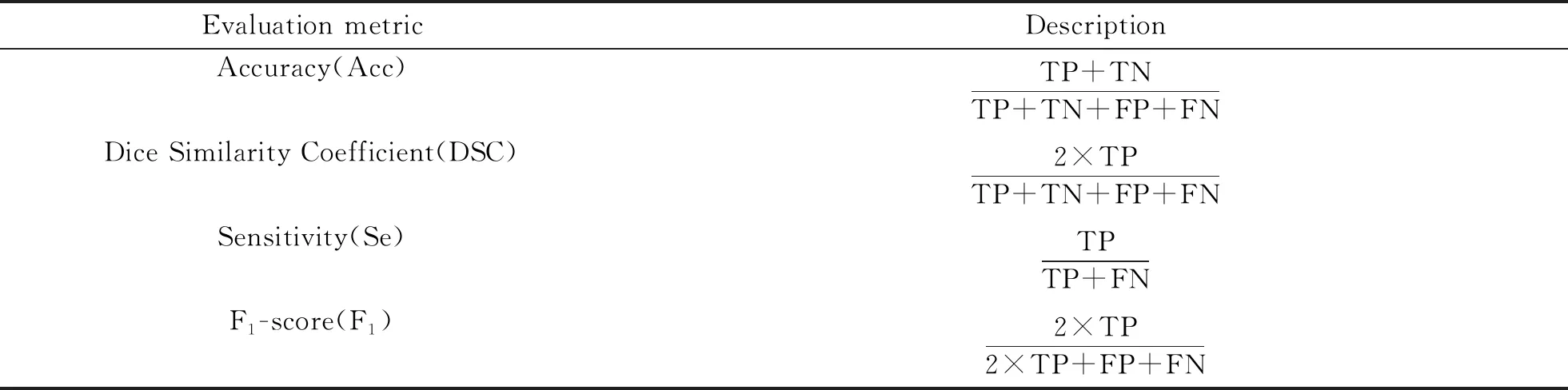

为了验证模型的分割性能,研究选取了4种常用的医学图像分割中的评价指标:精确率(Accuracy,Acc),相似性系数(Dice Similarity Coefficient,DSC),敏感度(Sensitivity,Se)和F1-score(F1),各项评价指标的定义如表1所示。True Positive(TP)表示分类正确的肺部像素个数,Ture Negative(TN)表示分类正确的背景像素个数,False Positive(FP)表示背景像素被分成肺部像素的个数,False Negative(FN)表示肺部像素被分成背景像素的个数。

表1 评价指标

3 实验与分析

3.1 预处理

由于LUNA 2017数据集的2D图像存在一些噪声,因此在输入网络前首先对图像使用了高斯滤波进行去噪操作,并且对图像进行腐蚀操作,加强了前景与背景间的区分度,处理之后的CT图像如图7所示。

图7 图像预处理 图8 ROC曲线

3.2 实验结果

根据混淆矩阵中的TP、TN、FP、FN参数,以敏感度(Sensitivity,Se)为纵坐标,特异性(Specificity)为横坐标画出ROC曲线,如图8所示。

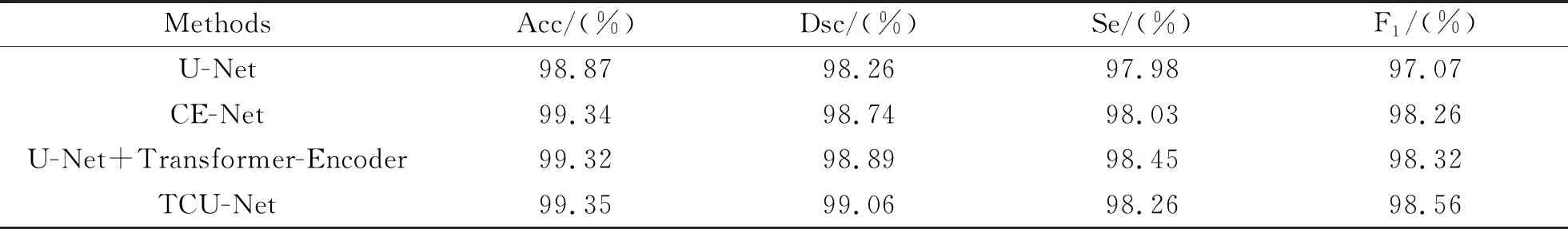

为了验证各个模块对整体模型的影响,对U-Net网络、添加了CE-Block的CE-Net网络、加入Transformer-Encoder模块的网络以及TCU-Net网络进行对比实验,实验结果如表2所示。U-Net作为原始网络,精确率为98.87%,Dice系数为9826%,敏感度为97.98%,F1分数为97.07%;分别添加了CE-Block和Transformer模块的U-Net网络,其评价指标有着不同程度的提升;当结合两个模块后,精确率为99.35%,Dice系数为99.06%,敏感度为98.26%,F1分数为98.56%,相比原始的U-Net网络,各项指标分别提高了0.48%、0.8%、0.28%、1.49%,充分证明了研究提出模型具有一定有效性。

表2 各个模块对整体模型的影响

由此看出加入了Transformer-Encoder和CE-Block的模型,其分割效果明显优于未加模型,Transformer-Encoder运用在图像分割网络,能够有效减少连续下采样带来的信息损失。CE-Block从编码器中获取了上文信息,加强了目标区域的输出,从而提高了分割性能。分割结果如图9所示。

图9 分割结果

4 结束语

针对肺部大小不一、细小位置分割精度低等问题提出了改进算法TCU-Net,它的整体结构为编码-解码的U型结构,使用混合Transformer结构作为编码部分,CNN与Transformer的优点相互结合,使用CNN获取局部特征,使用多头自注意力机制获取全局特征。采用具有多尺度信息的CE-Block充分提取了上下文特征信息,使用转置卷积网络作为解码器,保留了跳跃连接,结合低层特征和高层特征,加强信息的捕捉。在公开数据集LUNA 2017上进行实验,实验结果表明,相比U-Net算法,改进算法在精确率、Dice系数、敏感度、F1分数上分别提高了0.48%、0.8%、0.28%、1.49%。该方法能对2D图像中的肺部区域实现更精确的分割,对后续的肺结节检测提供了更好的医学辅助诊断技术。