增强感受野的轻量化合成孔径雷达船舶检测算法

王燕妮,孙雪松,余丽仙

(西安建筑科技大学信息与控制工程学院,西安710055)

0 引言

随着人类对海洋资源的过度开采,海洋生态环境持续遭到破坏,世界各国纷纷采取措施应对现状。为保护近海生态环境,我国也开始实施对领海和近岸海域内船舶进行监测。但是在天气、海浪等自然界不可控因素的影响下,派遣海警船等监测手段非常耗费人力物力。合成孔径雷达(Synthetic Aperture Radar,SAR)是一种全天时、全天候、多维度获取信息的主动式微波成像雷达,为海洋上多尺度的船舶检测提供了强有力的数据保障和技术支持,在遥感图像船舶检测领域占有重要地位[1-2]。

传统的SAR 船舶检测方法主要有基于变换域[3],基于视觉显著性[4],恒虚警率方法[5],模板匹配法[6]等方法,虽然这些方法在某些特定场景下能够取得较好的效果,但这些方法都是采用手工设计的方法提取船舶特征,计算量大,泛化能力弱,并且手工特征提取也较为困难。

随着人工智能技术的兴起,深度学习技术以其更高的精度、更快的速度、更少的人为干预等优势几乎占据了SAR 船舶检测领域的主导地位。当前主流的目标检测方法分为三类:一类是基于区域推荐的两阶段检测方法,首先生成输入图像的建议框,然后对建议框进行分类和位置回归操作,最终得到检测结果。典型的两阶段检测算法包括区域卷积神经网络(Region Convolutional Neural Networks,RCNN)[7]和Faster-RCNN[8]等,此类方法在精度上有明显提高,但是因其占用较多的计算资源,在实时性上有一定程度的降低。另一类是基于回归的单阶段目标检测方法,此类方法将目标检测问题视为回归问题,从输入图像上直接预测边界框和具体物体类别,YOLO[9]和SSD((Single Shot MultiBox Detector))[10]是经典的单阶段目标检测算法,由于不再需要中间选取候选区域的操作,检测速度较快。还有一类是基于关键点的检测方法。该方法解决了锚框存在的缺点,不需要锚框,同时可以取得良好的检测的速度和精度,主要算法有CenterNet[11]和FCOS[12]等。

基于深度学习的SAR 图像的船舶检测算法已取得显著的成果。周雪珂等[13]从多尺度特征融合与通道关系校准的角度出发,检测精度在改进模型上达到了89.4%;JIN Liang 等[14]在SSD 网络中每个特征层添加注意机制挤压激励网络模块,有效提升了检测精度;刘竞升等[15]基于FCOS 引入更多特征层,增加跳跃连接改进特征金字塔,更好地利用低层特征,提升了船舶检测效果;ZHOU Long 等[16]结合密集连接、残余连接和组卷积的思想,提出了轻量级的卷积神经网络Lira-YOLO,降低了网络运行的复杂性,方便部署在移动设备上。

目前应用于海上船舶的SAR 成像速度不断地提高,算法能够实时快速的检测显得尤为重要。海上船舶检测的实际应用环境难以部署模型复杂的算法。因此,算法模型的计算量,决定了能否实现该算法的轻量化和实时性。如张筱晗等[17]提出精简网络结构数据驱动的目标分布聚类算法,结合双向高低层特征融合机制,减少了训练和测试时间,但检测精度较低,同时模型复杂度较高。

为了能同时兼顾检测精度和速度,便于模型部署,本文提出一种有效增强感受野的轻量级SAR 图像船舶目标检测算法。首先,采用ShuffleNetV2[18]网络进行主干特征提取,降低了模型尺寸;其次,结合改进的特征金字塔池化模块,有效增强网络的感受野;然后,添加空间注意力模块,增强模型对空间位置信息的关注,提升船舶目标定位能力;再者,引入改进型路径聚合网络,进一步融合船舶位置信息和语义信息;最后,使用轻量化检测头,实现算法的高速和高效的检测。

1 算法原理

本文提出一种有效增强感受野的轻量级SAR 图像船舶目标检测算法。主干网络使用ShuffleNetV2,对特征信息进行高质量的高效提取。在主干网络之后,引入改进的空间金字塔池化模块(Spatial Pyramid Pooling,SPP),将其命名为SSPP,该模块有利于增强网络感受野,丰富特征信息。在颈部网络中融入空间注意力模块(Spatial Attention Module,SAM),提高网络对船舶目标的定位能力。采用改进的路径聚合网络(Path Aggregation Network,PAN),进行双向多尺度特征融合,进一步增强网络特征图。在检测头部分,使用轻量级卷积结构,输出船舶的位置和类别置信度信息。本文网络整体结构如图1所示。

图1 本文网络结构Fig.1 The proposed network structure

1.1 ShuffleNetV2

为了满足嵌入式等移动设备高效运行深层神经网络的同时保持精度的需求,ZHANG Xiangyu 等[19]引入ShuffleNetV1 模型,该模型基本单元由组卷积和通道洗牌组成。虽然组卷积具有减少参数量的作用,但信息缺少融合。为了克服这个问题,提出了通道洗牌操作,该方法可以实现不同组之间通道信息的交流,操作过程如图2所示。

图2 通道洗牌的操作过程Fig.2 The operation process of channel shuffle

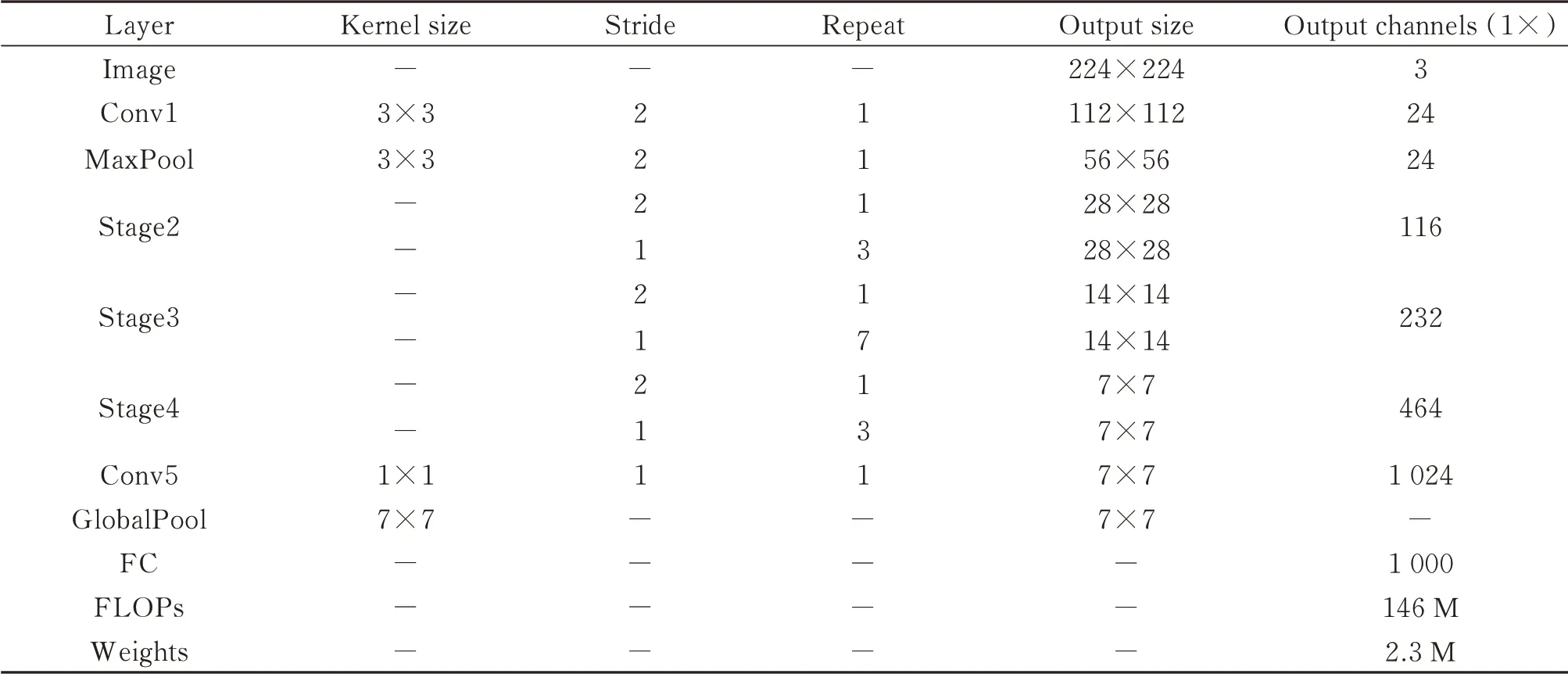

MA Ningning 等[18]提出四种高效轻量化网络设计指导方针,并按照指导方针对ShuffleNetV1 进行了改进,引入通道分割结构,重新设计Block 模块,最终得到ShuffleNetV2 轻量化模型。Block 模块结构如图3所示,图3(a)是步距为1 时的基本单元,图3(b)是步距为2 时的降采样单元。图1 主干网络中的每个Stage 层由这2 个Block 模块堆叠而成。ShuffleNetV2 详细网络参数如表1所示。

表1 ShuffleNetV2 网络结构Table 1 Overall architecture of ShuffleNetV2

图3 ShuffleNetV2 的构建模块Fig.3 Building blocks of ShuffleNetV2

1.2 空间注意力机制模块

在认知科学中,人类视网膜的不同部位具有不同的敏感性。当看到事物时,人类会有选择地将注意力集中在关键信息上,而忽略其他无用信息,这种特性被称为注意力机制。当前,注意力机制被广泛应用在图像分割、图像识别等各种计算机视觉任务中,并取得了显著的效果。卷积块注意力模块(Convolutional Block Attention Module,CBAM)[20]是由通道注意力与空间注意力串联而成的混合域注意力机制。通道注意力增强了网络对有意义的输入特征的关注度,有利于提高卷积通道间资源分配的粒度。空间注意力在将原始图像中的空间信息转换到另一个空间时保留关键信息,有助于网络更多地关注特征位置信息。

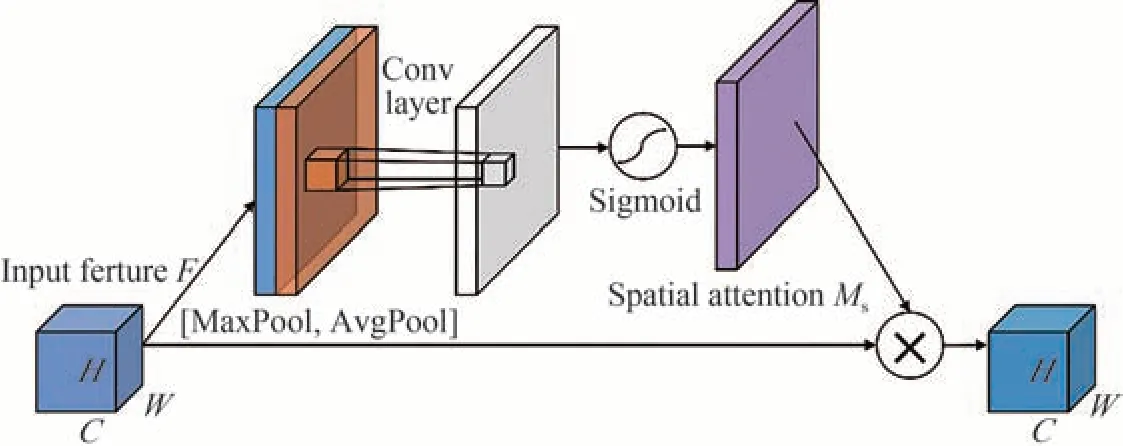

考虑到本文检测只有一个类别,对网络模型的分类能力要求较低,但是定位能力要求较高。结合轻量化思想,本文只使用CBAM 中的空间注意力模块(Spatial Attention Module,SAM),如图4所示。SAM 是对输入特征图在通道维度上进行最大池化和平均池化操作生成两个2 维的空间特征图矩阵,将两个特征图在通道维度上进行拼接,之后使用7×7 卷积层进行权重的优化,优化后的特征图经过Sigmoid 激活函数获得空间注意力图,最后将两者逐点相乘便可得到空间注意力的新特征。SAM 表示为

图4 空间注意力模块Fig.4 Spatial Attention Module

式中,Pmax和Pavg分别表示最大池化和平均池化操作,f7×7表示7×7 的卷积层,σ()表示Sigmoid 激活函数,F代表输入特征图,Ms表示空间注意力图。

将SAM 添加在主干网络8 倍和16 倍下采样输出的特征图处,船舶图片经过SAM 处理的热力图如图5所示。其中,图5(a)为输入图像,图5(b)为普通卷积输出的热力图,图5(c)为SAM 热力图。可以看出,与普通卷积输出热力图对比,经过空间注意力机制的热力图,船舶目标位置信息被显著放大,背景噪声被明显抑制,有利于网络学习到关键目标的信息。

图5 SAM 热力图Fig.5 SAM heatmap

1.3 改进型感受野增强模块

SAR 图像中远海的船舶目标尺寸相对较小,近岸的船舶目标尺寸较大,对于多尺度船舶的检测一直是研究的重点。一般来说,高层特征的感受野表达强烈语义信息,而低层特征的感受野具有良好的空间位置信息和高分辨率表达能力。文献[21]提出了一种SPPNet,是一种通过多尺度聚合操作将特征映射融合为一个固定长度特征向量的结构,解决了信息丢失和尺度不统一的问题。为了能够提高不同尺度的船舶检测,增加高层语义特征的感受野,本文在主干网络32倍下采样后添加改进的SPP 和SAM 组合而成的SSPP 模块,如图6所示。

图6 SSPP 模块结构图Fig.6 The structure of SSPP

由于远海小尺寸船舶数量相对较多,空间金字塔池化结构的最大的池化核要尽可能与需要池化的特征图的大小相等,因此对原SPP 的最大池化核改进为7、5 和3,最大池化操作可以在不同尺度上保留最显著的特征,增加了局部区域特征图的感受野,使得网络获得更丰富的局部特征信息,捕获更多的船舶特征。在SSPP 模块,输入特征图(H,W,C)分别用3×3、5×5 和7×7 三种不同大小的核做最大池化操作,池化步长为1,在特征图周围进行padding 操作来保证特征图输入输出尺寸不变,把经过最大池化后的多尺度局部感受野特征图和输入特征图在通道上用Concat 方式拼接到一起,再输入SAM 对船舶空间位置进行优化输出结果(H,W,4C)。图7 为SSPP 模块处理后的特征图,图7(a)是原图,图7(b)是普通卷积输出特征图,图7(c)是SSPP 处理后特征图。

图7 SSPP 特征图Fig.7 Feature map of SSPP

从图7 可以看出,采用SSPP 模块的特征图,相比普通卷积输出的特征图感受野有明显增强,船舶边缘轮廓信息和主要位置特征更加清晰,背景噪声也有显著抑制。SSPP 模块能够有效增强网络感受野,提炼出更关键的船舶目标上下文特征,为后面的路径聚合网络输入更加丰富的特征信息,提高对不同尺度船舶的检测效果。

1.4 改进型路径聚合网络

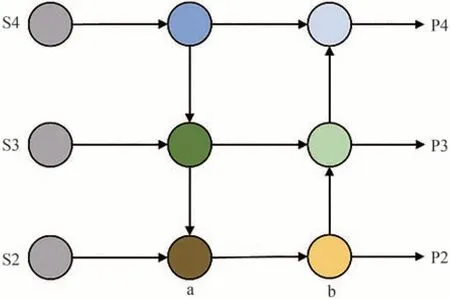

在目标检测任务中,为了使模型学习多样性的特征,提高检测性能,颈部网络对骨干网络提取的特征进行重新处理,将不同尺度的学习分散到多个层次的特征图中,并将不同感受野大小的特征图进行融合。本文引入了双向路径聚合的特征金字塔网络PANet[22],如图8所示。图8 中,FPN 层是融合路径a,通过自上而下上采样与高层特征信息进行融合,增强了网络高层强大的语义特征,但没有增强定位信息;在FPN 层后面添加了一个自下而上的特征金字塔b,使得低层特征提供的更准确位置信息通过下采样方式与高层特征进行融合,聚合了不同主干层的参数,提高了网络的特征提取性能。

图8 PANet 结构Fig.8 PANet structure

本文从轻量化和特征提取能力出发,对PANet 进行改进,如图9所示。在自下而上的路径b 上,融合经过SAM 处理后的特征,如图9 中的虚线箭头,SAM 重点关注船舶位置特征信息,通过与低层特征图的定位信息融合,使得网络在检测小尺度船舶时对低层高分辨率信息有更好的利用,对船舶目标的定位能力更加精确,进一步提高了小目标船舶的检测能力。融合方式采用element sum 将多尺度的特征图直接相加,相比Concat 操作,没有改变通道数,更节省计算量。为了将检测头轻量化,本文采用了深度可分离卷积,相比普通卷积,该操作可以在保持网络精度的同时使用更少的计算成本。

图9 改进的PANet 结构Fig.9 Improved PANet structure

2 实验与分析

2.1 实验数据

本文使用的数据集是国内外公开的首个专门用于SAR 图像船舶目标检测的数据集(SAR Ship Detection Dataset,SSDD)[23],共1 160 幅图像,2 456 条船舶,平均每幅图像有2.12 条船舶。该数据集仿照PASCAL VOC 数据集的格式构造,使用LabelImg 软件对所有船舶图像进行xml 格式标注,每个船舶目标的框表示为(x,y,w,h),如图10所示。该数据集包括不同分辨率、极化、海况、大片海域和靠岸等条件的船舶SAR 图像,船舶的多样性能够较好地验证算法的有效性。本文将SSDD 数据集按照7∶2∶1 的比例划分为训练集、验证集和测试集,按照船舶的尺度变化和密集程度的原则进行随机划分,确保划分的数据集在远海和近海的不同尺度的船舶目标均匀分布,以保证实验的有效性。

图10 SSDD 的部分样本和标签Fig.10 Sample images and labels in SSDD

2.2 评价指标

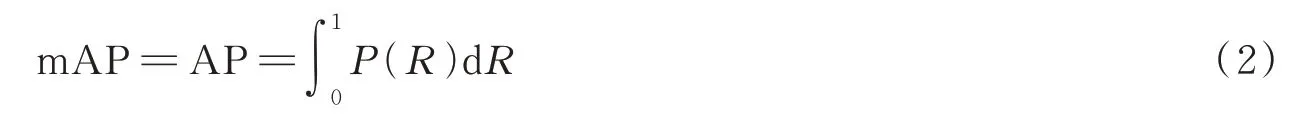

本文采用的算法评价指标为准确率(Precision)、召回率(Recall)、平均精度均值(mAP)、每秒帧数(FPS)、运算浮点数(FLOPs)、参数量(Parameters)和模型大小(Model size)。本文仅有船舶一类目标,因此mAP = AP,取IoU 阈值为0.5 时的mAP 值。mAP 计算公式为

式中,P表示准确率,R表示召回率,mAP 表示所有AP 值的平均值,衡量模型在所有类别上训练效果的好坏。FPS 表示检测速度的快慢,FLOPs 用来衡量算法模型的复杂度,Parameters 表示网络中的参数数量的多少。

2.3 训练过程

本文实验配置环境为:CPU 为AMD Ryzen7 3750H、GPU 为NVIDIA GeForce GTX1060Ti(4 GB 显存)、内存8 GB、硬盘500 GB、Ubuntu 18.04 操作系统。使用Python 3.7 语言,PyTorch 1.2 深度学习框架,并使用cuda 10.0 驱动实现图像矩阵的加速训练。

训练过程的优化参数为:训练的epoch 为120,设置每批次输入网络的图像数为16,训练过程中,epochs 为5 的倍数或者超过100 时,对模型进行验证以保存验证结果最优的模型。初始学习率设为0.001,训练开始采用warm-up 学习率策略,让学习率从0 缓慢地增加到学习率0.001,有助于保持模型深层的稳定性。然后采用余弦退火衰减优化策略更新学习率,权重衰减参数设置为0.000 05,学习率最终减小到0.000 1。采用多尺度训练的策略,提升网络对多尺度船舶检测的能力。本文算法使用迁移学习的方式进行训练,使用ShuffleNetV2 在ImageNet 上的预训练权重初始化网络的参数,对于后面改进的网络层进行权重正态随机初始化,再对网络整体进行训练。

为了使模型的鲁棒性更强,对单通道的SAR 图像的进行数据增强,主要采用了水平翻转、加噪、旋转、尺度变化、改变对比度等随机方案。同时为了解决小数据集训练时泛化能力不足的问题,使用了Mosaic 在线数据增强,丰富了数据集中的小目标船舶,提升小尺度船舶的检测性能。Mosaic 数据增强方案的效果如图11。

图11 马赛克数据增强Fig.11 Mosaic data enhancement

2.4 实验结果

为了验证本文改进算法的有效性,在测试集上选取了四种不同的场景、分辨率和船舶尺度的典型SAR 图像来展示其检测性能,检测效果如图12,图中绿色标记表示真实框,紫色标记表示预测结果。图12(a)和(b)是近岸码头、近岸海湾停靠的船舶目标检测结果,图12(c)是远海水域的小船舶目标检测结果,图12(d)是噪声干扰下导致图像质量降低的船舶图像检测结果。

从图12 可以发现,图12(a)在陆地背景下近岸不同尺度的船舶能够被有效检测识别。图12(b)在海湾中紧挨着排列放置的小船舶目标同样能够被准确识别出来。图12(c)和图12(d)在远海宽阔水域稀疏分布、目标较小的船舶和强噪声干扰下分辨率降低的SAR 图像也可以准确地对船舶目标进行定位识别。图13 是本文算法在SSDD 数据集上的精度召回率图(P-R 曲线图),改进模型的mAP 可达94.7%,由图中可以发现船舶类别的P-R 曲线下面积较大,平衡点取值较高,检测性能较优。从以上结果可以看出,本文算法对近海复杂背景的大小目标、远海水域小目标以及由于噪声干扰下的船舶目标都具有良好的检测能力。

图12 本文算法在不同场景下的目标检测结果Fig.12 Target detection results of the improved algorithm in different scenarios

图13 P-R 曲线(阈值从0.05 变为0.95)Fig.13 P-R curve(the threshold changed from 0.05 to 0.95)

2.5 实验对比分析

2.5.1 消融实验

本文提出的轻量化SAR 图像船舶目标检测算法,包含4 个改进,分别是:采用轻量化ShuffleNetV2 作为主干网络,引入SSPP 模块,引入SAM 模块,以及使用轻量化的PAN。为了评估本文算法中改进的模块对SAR 图像船舶目标的检测影响,以轻量化ShuffleNetV2 主干网络为基础,在SSDD 数据集上进行了消融实验,定量分析了各模块的检测性能,结果如表2所示。

从表2 可以看出,在不加任何改进模块的情况下,基础的主干特征提取网络ShuffleNetV2 在SSDD 测试集上的mAP 值是85.6%。通过添加SSPP 模块,有效扩大了模型感受野,显著地分离了船舶的上下文特征,使得mAP 在ShuffleNetV2 基础上提升了4.6%。通过添加空间注意机制模块(SAM),提高了船舶“在哪里”的定位能力,减少了小尺度船舶的漏检,mAP 提高了1.3%。最后添加轻量化的路径聚合网络(PAN)做特征融合,增加自底向上的细节信息流通路径,提高了船舶目标框坐标的回归精度,增强了对小尺度船舶的检测,相比只使用SSPP 模块,mAP 提升了3.2%。本文算法在ShuffleNetV2 网络的基础上经过3 个方面的改进,检测精度相比基础模型提升了9.1%,检测速度达到46 FPS,满足实时性要求,在检测精度和速度上均达到了令人满意的结果。

表2 不同模块精度对比结果Table 2 Accuracy comparison results of different modules

2.5.2 不同算法两种场景对比

鉴于SAR 图像近岸船舶通常会有复杂背景,远海船舶目标尺度相对较小的特点,将SSDD 测试集的船舶目标分为近岸(Near shore)和远海(Open sea)两类,在SSD、YOLOv3[24]、YOLOv3-tiny[24]、YOLOv4[25]、YOLOv4-tiny[25]和本文算法上分别测试其准确率(Precision)与召回率(Recall),对比算法均采用相同的数据划分和优化参数,使用在ImageNet 上的预先训练好的权重进行训练,测试结果如表3所示。

表3 不同检测算法在近岸与远海场景下的性能对比Table 3 Comparison of different detection algorithms in near shore and open sea scenes

从表3 可以看出,在复杂背景的近岸场景下,本文算法检测效果相比其它五种算法都有一定能力的提高。在远海船舶目标检测的场景下,六种算法的准确率与召回率都较优,这是因为在远海船舶样本的背景都较为简单,只是在尺度大小上有所差异,小目标船舶所占比例较多,SSD 算法对小尺度目标船舶特征描述不充分导致检测效果较差;YOLOv3 使用的网络结构是Darknet53,准确率和召回率都较为理想,但是因其网络的感受野不够大,对小目标特征的学习能力不足,故对小目标检测效果不佳;YOLOv4 采用的了较为复杂的骨干网络CSPdarknet53,能够提取更丰富的特征信息,对远海场景下的小目标船舶的检测效果较好,但在近岸复杂场景下船舶检测的准确率和召回率均低于本文改进算法;YOLOv3-tiny 简化了骨干网络,特征信息提取不充分,并且只有2 个尺度的预测分支,对大目标和中等目标的检测效果较好,对小尺度船舶目标的定位效果较差造成漏检,两种场景下的准确率和召回率都偏低;YOLOv4-tiny 的骨干网络CSPdarknet53_tiny 结构较为简单,网络泛化性不足,对远海场景下的小目标和复杂背景下密集排列的目标漏检较多,故召回率较低。针对Yolov3-tiny 和Yolov4-tiny 网络难以识别小目标船舶,后续研究预引入Focal Loss 损失函数进行改进,由于小尺度的目标船舶所占据的像素区域相对于整个SAR 图像而言比例很小,在训练过程中会出现正负样本不平衡的问题,采用Focal Loss 函数,可以在网络的训练过程中自动对正、负样本,以及简单、复杂样本的不平衡进行调整,减少正负样本分布不平衡所造成的误差,使得网络更加关注难以训练的小目标船舶样本,从而提高小目标的检测精度。

本文算法以轻量化ShuffleNetV2 网络为基础,在网络的颈部添加改进的空间金字塔池化模块,极大地增强了网络的感受视野,降低了网络对船舶尺度的敏感性,使用空间注意力机制和改进路径聚合网络,使得模型更加关注船舶目标的位置,提高了船舶目标的特征定位能力,经过各改进模块的作用,模型对船舶目标的特征表达能力有一定的提高,检测效果表现较为优异。

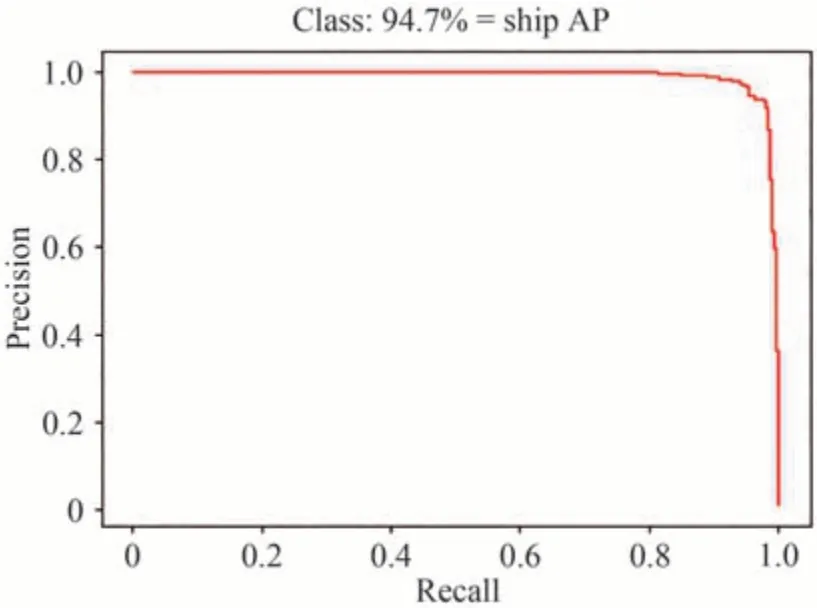

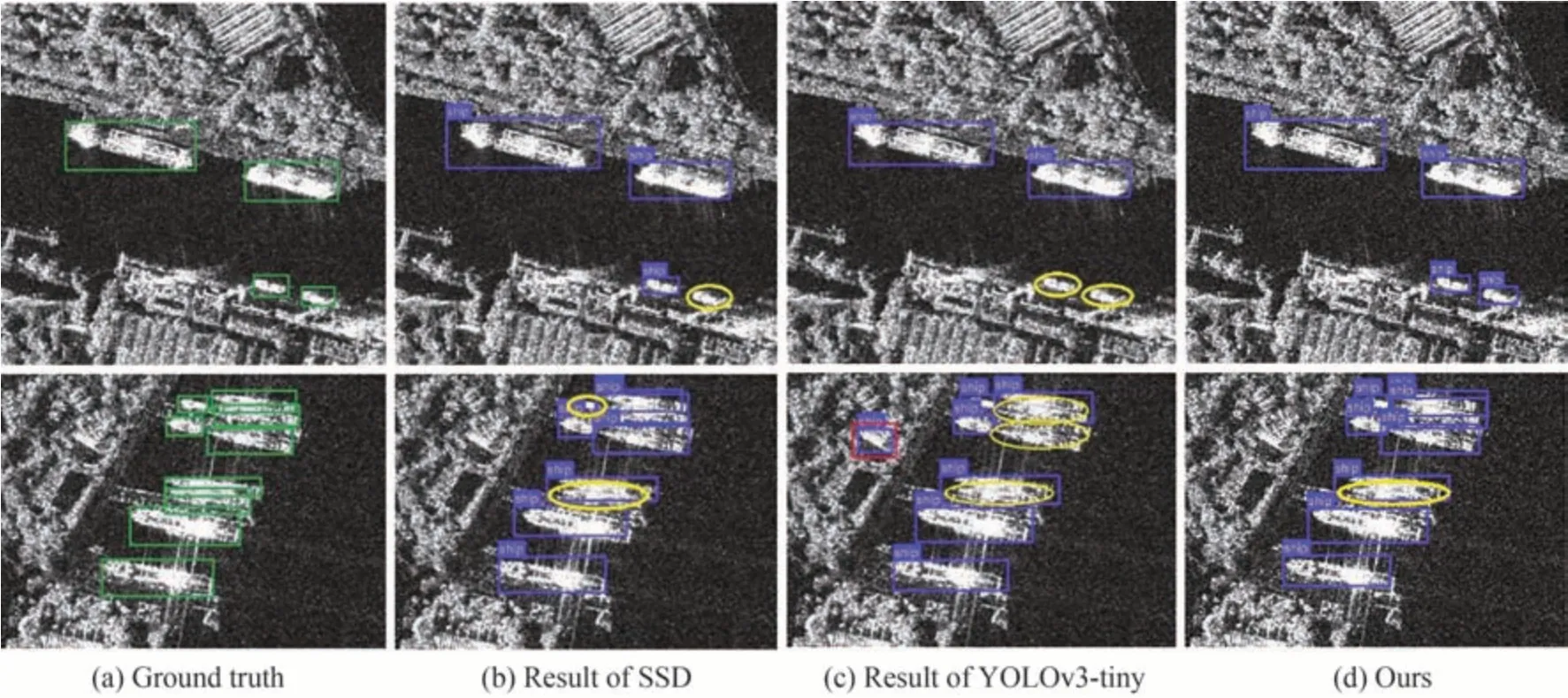

2.5.3 不同算法检测效果对比

为了更直观地比较不同算法的检测结果,从SSDD 中选择近岸密集排列停靠的船舶和远海小目标船舶两种典型场景,分别使用SSD 算法、YOLOv3-tiny 算法和本文算法进行检测,对比效果图如图14 和图15所示。图中黄色圆形框表示漏检的目标,红色矩形框表示虚警(误检)的目标。

图14 近岸船舶复杂背景的检测算法对比Fig.14 Comparison of detection algorithms for complex background of near-shore ships

图15 远海小目标船舶的检测算法对比Fig.15 Comparison of detection algorithms for small target ships in the open sea

从图14 的对比结果可以看出,在近岸复杂背景下,SSD 算法对小尺度船舶特征提取不充分导致检测精度较低,图14(b)中的小目标船舶均有漏检。YOLOv3-tiny 算法由于采用的网络去掉了一些特征层,结构较为简单,只保留了2 个独立预测分支,对小尺度目标不敏感,泛化性较差造成了一定的虚警和小目标的漏检,如图14(c)所示。本文算法通过改进的空间金字塔池化操作,能够提取出更丰富的语义信息并且将多种尺度特征融合,有效提高了模型的感受野,同时结合空间注意力机制,提高了船舶目标的定位能力。在图14(d)中本文算法对上一行图中的4 艘靠岸船舶目标能够全部检出,对下一行图中的密集排列船舶目标有一个漏检,图14(b)和(c)也存在相同的漏检问题,分析其原因,主要是由于该艘船舶与相邻船舶是平行停靠的,模型会把它检测成单一的船舶目标。通过对比,本文算法能够减少复杂背景下船舶检测中的漏检率和误报率,检测效果明显更优。

在图15 的对比结果中,如图15(b)和(c)所示,SSD 算法和YOLOv3-tiny 算法均对远海区域的小尺度目标船舶目标不敏感,都有漏检情况,YOLOv3-tiny 算法网络结构不是很复杂,泛化性较差,导致漏检率较高并且有虚警情况的发生。本文算法,通过使用特征融合模块路径聚合网络,增加自下而上的信息流通路径,来提供坐标回归所需要低层的细节信息,提高船舶特征的定位能力。图15(d)有效降低了小目标的漏检数量,同时也消除了虚警现象,说明其对小目标船舶的检测效果也非常出色。

2.5.4 不同算法的性能对比

为了进一步验证本文算法的目标检测性能,将本文算法与5 种具有代表性的单阶段目标检测算法SSD、YOLOv3、YOLOv4、YOLOv3-tiny 以及YOLOv4-tiny 进行对比实验。均采用相同的数据划分和优化参数进行训练,实验结果的比较如表4所示。

表4 不同检测算法的性能对比Table 4 Performance comparison of different detection algorithms

由表4 可知,相比于其它检测算法,本文提出的轻量化SAR 船舶检测算法能取得很好的检测效果。本文算法在输入为416×416 分辨率的情况下,整个模型的浮点运算量Flops 只有1.52 B,相比YOLOv3-tiny和YOLOv4-tiny 降低了近75%。同时网络的参数量也只有2.34 M,训练完成之后的模型权重文件只有5.3 MB,非常适合在移动端部署。尽管模型非常的轻量,但是性能却依旧强劲,在相同分辨率输入时,能够达到94.7%的mAP,比SSD 和YOLOv3-tiny 分别高5.4%和3.4%,只比YOLOv4 低0.9%。

表4 中,YOLOv3 和YOLOv4 算法都有较高和较快的检测精度,但是其模型尺寸较大、网络参数量较多,难以做到移动端的部署。而本文算法虽然检测精度比YOLOv4 低0.9%,但浮点运算量、网络参数和模型尺寸都是最少的,非常适合FPGA 或移动端的移植。

本文使用轻量化网络方法对SAR 图像船舶进行识别检测,将训练后的模型部署在移动手机端测试验证。测试手机型号为红米K30,移动CPU 处理器为联发科MT6885,CPU 主频为2.6 GHz,结果表明,在近岸复杂背景和远海小目标场景下,能准确对船舶目标进行精准识别,识别准确率为85.7%,部署到手机后模型前向推理计算的时间只要15 ms 左右,加上手机端调用摄像头、图片预处理、检测框后处理以及绘制检测框的时间,测试实时性达到32 FPS,由于手机性能、图像尺寸等因素的影响,并且在移动端的CPU 和GPU 性能不及训练网络的电脑设备端,检测精度和推理速度有所降低,但仍然满足实时性的要求。

3 结论

为解决当前SAR 图像船舶检测模型难以部署在便携式移动设备和嵌入式平台的问题,本文提出一种有效增强感受野的轻量级SAR 图像船舶目标检测算法。主干网络使用ShuffleNetV2 轻量化网络,参数少、复杂度低并且特征表达能力较强。为增强感受野引入改进SSPP 模块,加强轻量化网络整体特征提取能力,并与空间注意力模块SAM 结合,提高船舶目标的定位能力。同时还采用改进的路径聚合网络PAN 做多尺度特征融合,有效利用多层浅层网络特征,丰富特征信息,提高模型检测精度。基于SSDD 数据集实验,本文算法平均检测精度为94.7%,模型大小为5.3 MB,检测速度为46 FPS,与当前主流的检测方法相比,具有更少的参数量、浮点运算次数和更小的模型尺寸,在保证高检测精度的同时,实现了快速检测。在未来工作中,将继续针对近岸复杂场景密集排列的船舶目标检测问题进行深入研究。