一种基于颜色模型的火灾识别系统

刘洲岐,王雷,刘聪,黄晋,王振

(山东理工大学 计算机科学与技术学院, 山东 淄博 255049)

随着生活水平的提高,人们工作及生活中的日常需求不断增长,对各种燃料的应用也随之增加,同时每年发生火灾的频率逐年增长,并造成了严重的损失。据不完全统计,平均每天都会有一万多起的火灾事故发生,产生的伤亡人数也有数百人之多。根据我国消防部门的数据显示,在2020年1月到10月期间,我国接到19.6万起火灾报案,共计造成了一千多人的伤亡,财产损失达到二十五亿元之多[1]。因此,对于火灾检测技术的研究和升级刻不容缓。通过对火灾的实时监测及防控,不仅能够有效地防患于未然,避免各种惨剧的发生,同时也能很大程度上保障人民的生命财产安全。

传统的火灾检测技术,往往是使用基于物理硬件的传感设备,实现对火灾产生的关键参数的实时监测[2]。目前,被广泛使用的火灾报警器大多基于温度检测和烟雾检测[3]。常见的温感报警器大致可以划分为两种,第一种是以基尔霍夫定律为准则的接触式传感器,利用被测环境周围物体的热辐射信号检测实际温度;而第二种是非接触式传感器,为了使被测物体的温度能用温度计表示,主要通过对流传热达到热平衡来实现[4]。光电感烟式和离子感烟式是两种经常使用的烟感报警器。光电感烟式探测器主要利用光的传播可以被火灾现场产生的烟雾而改变这一基本原理。而离子感烟式探测器利用烟雾粒子与电离化区域的离子相联系减弱其中的导电性,当低于一定数值时,就会发出检测信号[5]。这两类传感器分别检测空气中的烟雾浓度和温度数值,通过内部转换将其转换为电信号,并使用单片机检测烟雾浓度和温度是否高出预警值,如果超标就会发出火灾警告[6]。

上述两种火灾检测方法都具有较高的灵敏度,一旦发生火情,周围环境中的某些环境参数(如温度等)会相应地产生不同程度的变化,通过对这些火灾参数进行有效地观测及分析,进而对火灾发生与否做出相应的判断。但是这些基于传感器的火灾检测设备同时也存在相应的弊端,容易受到空气流通、光线变化等环境因素的干扰,产生误报和漏报现象[7]。同时,这些设备对环境的适应性较差而且使用寿命短,很难实现对火情的及时监控和预警。

因此,随着计算机视觉、模式识别等技术不断地发展, 为了更有效地对火灾进行检测,基于视频监控的火灾识别技术得到了广泛认可。相较于传统以传感器为主的火灾识别技术,图像检测方法更为精确,不仅使火灾识别的准确率大幅提升,减少不必要的漏报;同时该系统基本不受外界环境的影响,整体性能相对稳定。针对现有的监控系统,该技术可以将火灾监控加入其中,具有灵敏、准确、便捷等优点,并且使用成本低。

1 基于颜色模型的火灾识别系统

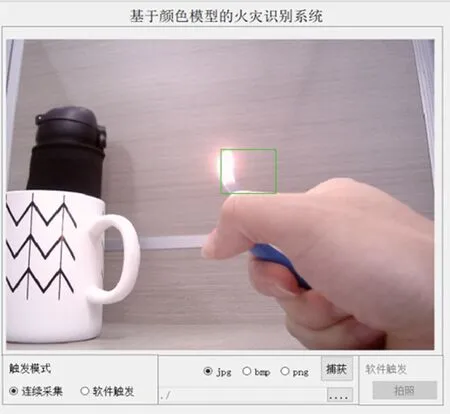

本文设计的可视化的界面如图1所示,实现了基本的视频监控和拍照功能,同时以火灾检测算法为核心,将疑似火焰区域标记并输出到视频中。本设计通过高清摄像头获取图像﹐并传输至计算机中,通过对视频图像的读取及预处理将图像转化为灰度图像,便于后期分析。利用运动目标检测算法提取图像中的前景区域,然后基于颜色检测,判断疑似火灾区域,并进行标注。

图1 系统界面

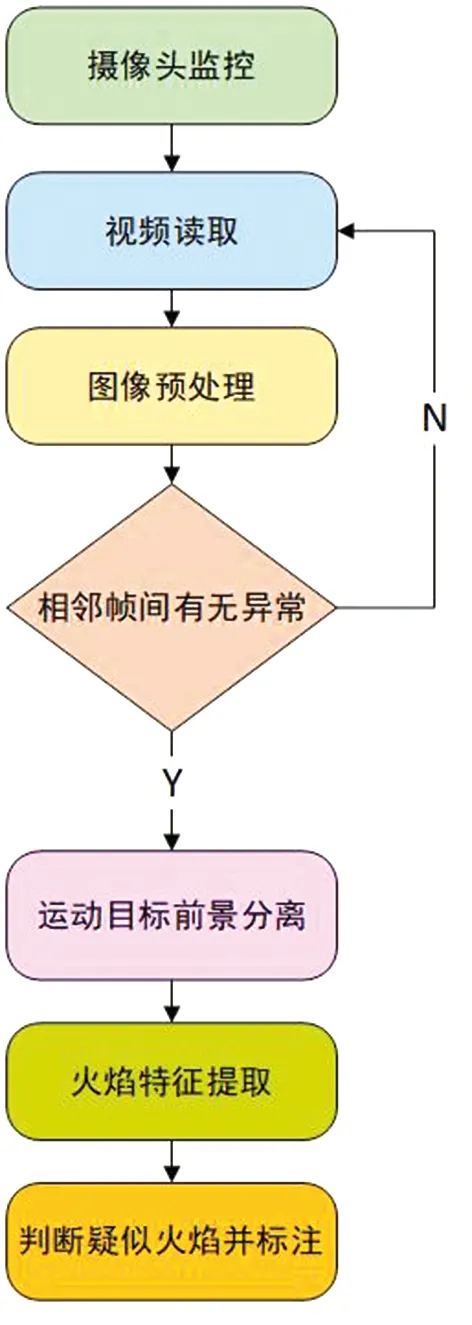

本系统的重点在于对火灾检测算法的研究,具体流程如图2所示。在火灾检测流程中,首先要通过摄像头的视频监控获取图像信息并传输到计算机端,然后对图像进行预处理﹐在检测过程中﹐图像背景的选取很重要,这直接决定了目标检测的准确性。本文采用帧间差分法和高斯混合模型背景建模相结合的方法,从视频图像中分离运动的目标前景不但计算简单﹐工作量少,同时也减少了计算机资源的占用。

图2 基于颜色模型的火灾检测流程

2 视频预处理及运动目标检测

从摄像头的实时监控中读取视频,图像会因为设备、环境等各种因素的干扰,致使后期分析处理时性能下降;所以通过对收集的图像做预处理操作,从众多图像信息中提取有用的特征信息。

2.1 视频图像灰度变换

由于高清摄像头拍摄的RGB格式的图像,一方面占用的计算机存储空间相对大,另一方面在处理时CPU占比也不小[8]。因此对采集的图像进行灰度处理操作,灰度处理后的视频图像仅保存亮度数据。如图3所示,对彩色图像进行灰度处理后,仅保留了亮度数据,方便对图像进行后续处理。

图3 视频图像做灰度化处理前后的结果对比

2.2 视频图像平滑滤波

采集后的视频图像如果没经过处理会存在很多干扰噪声,比如常见的高斯白噪声和椒盐噪声等,要进行图像检测则必须过滤掉这些干扰噪声,便于后续步骤对目标图像的特征提取。对图像进行平滑处理使用的滤波器有中值滤波和邻域平滑滤波等。通过对滤波器的分析,本系统主要采用了Sobel算子和中值滤波对图像进行平滑处理。在图4中,对采集到的视频图像先通过Sobel算子求取图像边缘并滤除高斯噪声,然后通过中值滤波器过滤掉噪声,平滑图像。

图4 视频图像平滑滤波前后结果对比

Sobel算子作为一种用于检测边缘的算子,主要通过离散微分方法求取图像边缘,其中借鉴了高斯滤波的思想,边缘检测效果较好。使用Sobel边缘检测算子提取图像边缘,首先要分别获得X方向和Y方向的边缘信息,然后整合这两个方向上的边缘数据求出完整的图像边缘。

中值滤波的基本实现原理是为了使每个像素周围点的值更容易向真实的值靠拢,用其邻域灰度值的中值来替换,以此来有效抑制噪声[9]。这种方法不仅可以去除噪声,而且也解决了线性滤波导致的一些图像细节的模糊问题。

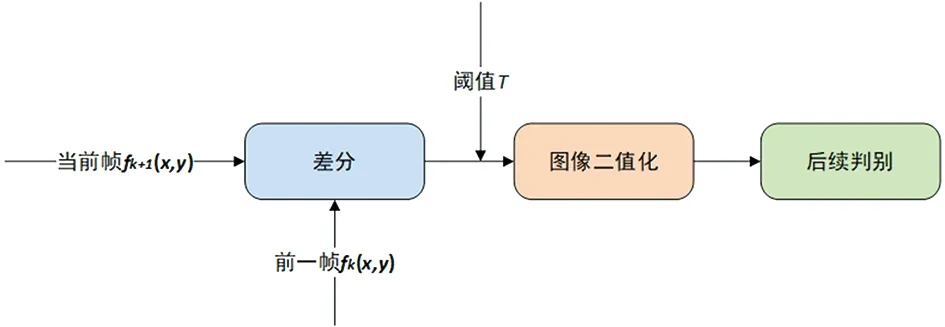

2.3 帧间差分法

帧间差分法的实现原理是对图像序列中邻近的每两帧作差分,当连续的图像中出现移动的物体,两帧之间就会有显著差别,要确定其中有无运动物体,首先将两帧相减,然后比较图像像素差的绝对值和设定的阈值二者大小,以此来检测运动目标[10]。

最常用的帧差法是二帧差分法,将视频流中的前后两帧图像转换为灰度图像,再经过高斯模糊消除噪声干扰,然后将两帧图像进行相减操作得到之间的差异区域,再对差异图像进行二值分割,把差异区域作为前景、不变区域作为背景,并且进行开运算操作消除一些微小干扰。这样,得到了两帧图像中明显不同的区域,也就是运动的目标物体。假设图像中相邻的两帧为第k帧和第k+1帧,用D(x,y)表示两帧图像fk(x,y)和f(k+1)(x,y)之间的变化,公式为

(1)

式中T为差分图像二值化阈值,该二值图像中用0表示前后未变化的背景区域,用1表示变化的运动区域。流程如图5所示。

图5 帧间差分法流程

帧差法的显著特点是在动态环境中的自适应性较好,运算敏捷,实现简单。但缺点是对微小运动物体的检测能力比较差,如果在两帧图像之间变化太小,就很难被检测出来。而且二帧差分法对于噪声、光照等都非常敏感,在检测过程中容易因为环境因素的影响而出现孔洞和重影现象,导致运动目标提取信息不完整,进而引发误检测的问题。

2.4 自适应高斯混合背景建模

高斯混合模型简称为MOG,其原理是以图像中一段时间内的像素样本的概率密度等信息来体现背景,对目标像素位置使用统计差分的方法进行判别,能够对一些丰富的动态背景建模。在序列图像中,每个像素点的变化可以认为是不停地生成像素值的随机过程,即每个像素点的颜色展现规律可以用高斯分布来描述。假设在处理彩色图像时,像素点R、G、B三个颜色的通道有相同且独立的方差。随机变量X的观察数据集合{x1,x2,…,xN},xt=(rt,gt,bt)是t时刻的像素样本,单一采样点xt服从的高斯分布概率密度函数为

(2)

η(xt,μi,t,τi,t)=

(3)

(4)

式中:k是分布模式的总数;η(xt,μi,t,τi,t)表示t时刻的第i个高斯分布;μi,t是均值;τi,t是协方差矩阵;δi,t表示方差;I是三维单位矩阵;wi,t表示t时刻的第i个高斯分布的权重。

MOG2作为MOG的升级算法,在前景连续性及运行时间上具有明显的优势。它一个显著特征是,为每个像素点选择合适的高斯分布,进而适应各种环境中的亮度变化。该算法可以相对较好地适应背景的变化,如光照的明暗影响等,但对于慢速的移动物体不容易检测出来。

2.5 基于自适应高斯混合背景建模的帧差法

为了提高帧差法的鲁棒性和稳定性,同时改善MOG对检测缓慢移动物体的灵敏度,将二者结合提出了基于自适应高斯混合背景建模的帧差法,这个方法主要有高斯混合模型和帧差法这两个重要组成部分[11]。其具体算法流程如下:

1)首先通过帧间差分法对图像进行移动物体检测,并对识别到的运动区域进行图像预处理操作。

2)用高斯混合模型进行背景建模获得背景,对视频图像进行背景减除法,初步获得其中的前景图像。

3)对前两步提取的运动区域执行图像逻辑或操作,得到相对完整的运动区域,并对此进行腐蚀膨胀处理,然后使用孔洞填充增强目标区域的完整性。

该方法可以提高对微小运动物体的检测能力,同时增强对噪声、光照等因素的抗干扰能力,最终能够比较完整地检测出火焰的运动状态。对视频监控中的火焰使用三种方法分别进行运动目标区域识别的效果如图6所示。从图6中3组实验明显看出,基于帧间差分法显示的动态火焰轮廓不明显;基于高斯混合背景模型的方法不易检测出火焰的细微变化;而基于自适应高斯混合背景建模的帧差法在很大程度上弥补了以上两者的缺点,并且检测实时性也有了较大提高。

(a) 帧间差分法

3 基于颜色模型的火灾特征提取

一般来说,RGB颜色模型是肉眼可见的,对于火焰颜色来说,R(红色比重)和G(绿色比重)比较大,并且G大于B(蓝色比重)。HIS模型主要依靠色度(H)、亮度(I) 和饱和度(S)来表示颜色特征[12]。

受温度、燃烧的物质和氧气浓度的影响,大多数的火焰颜色介于红黄之间,其中火焰的中心部分一般呈现为亮白色[13]。颜色随着温度的升高而倾向于冷色,随着温度的降低而倾向于暖色,燃烧温度的高低也会影响火焰颜色饱和度和亮度的变化。因为火焰燃烧的颜色特征相当明显,所以一般通过HIS判据和RGB判据,设置特定的阈值条件,检测疑似火焰区域,把图像二值化,再对其进行平滑滤波等图像处理。详细条件为:

(i)R>RT,

(ii)R≥G≥B,

(iii)S≥(255-R)×ST/RT,

S=(1-3.0×min(R,G,B)),

其中:饱和度的阈值为ST;红色比重的阈值用RT表示,火焰像素大部分依赖于红色的饱和度和色度。如果满足上述条件,就可以认为该区域为疑似火焰的像素,将其设置成白色,不然设置成黑色[14]。针对红黄色的火焰,其色度H在近红黄范围内变化,火焰由内到外,颜色是逐渐由亮白色到黄色到红色,所以饱和度由内到外逐渐增大,而强度由内到外逐渐降低[15]。

最后,把通过RGB、HIS双判据分割的区域进行二值化,然后对其进行预处理操作,剔除异常并找到遗漏的点。由于一些火焰的颜色并非仅限于红色和黄色两种颜色之间,没办法被识别,需要实现区域间的相互连通,因此对二值图像进行数学形态学的操作,对图像执行膨胀运算操作[16]。图7为实时检测的视频图像中画面的截取,为了表示基于颜色模型识别的火焰区域,将其用绿色矩形框标记,不难看出火焰的整体区域都在框内,所选择的阈值检测效果良好。

图7 颜色特征提取及轮廓标记

4 实验结果与分析

为了验证本文系统的整体性能,分别在不同场景、光照、空气流通等环境下进行了15组火焰识别的对照实验。在实验中通过高清摄像头监控场景里的火焰燃烧,并在本系统识别的基础上进行录制视频,后期对实验结果进行逐帧分析并采集了相关图像数据,如图8所示。

图8 部分检测实验结果

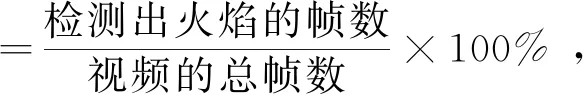

从图8可看出,在不同条件下,本文系统都准确识别了火焰区域。结合实验结果,从准确率、识别灵敏度和误报率三个方面评估系统的火焰检测性能[17],其中准确率和误报率的公式为:

(5)

(6)

在保证高精度的同时,视频监控对突发火灾检测的反应时间也是十分重要的。识别灵敏度通过计算检测出火焰的第一帧位置与起火的第一帧位置的差值来判断反应时间的大小。检测系统对起火的反应直接决定了该系统的性能。识别灵敏度越小,可以认为该系统性能越好[18]。

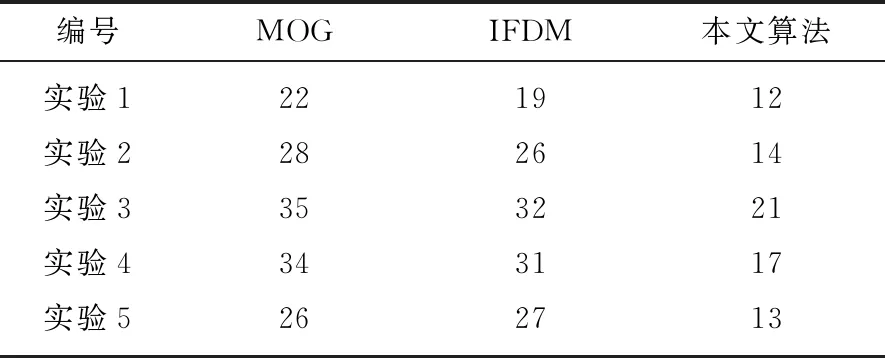

表1—表3,基于混合高斯模型MOG和基于帧间差分法IFDM的火焰识别算法,与本文的算法在准确率、灵敏度和误报率做了对比。分析表中数据可知,本文算法检测火焰的平均准确率在96%以上,远高于MOG和IFDM,与此对应的误报率也是三者之中最低的;从识别灵敏度可以看出对起火的反应时间也是最快的。这验证了本文系统能够降低基于传统火焰识别算法的视频监控检测火灾的漏报和延迟现象,同时具有良好的可靠性和实用性。

表1 火焰识别准确率

表2 火焰识别灵敏度

表3 火焰识别误报率

5 结束语

本文设计并实现了一种基于颜色模型的火灾识别系统,并通过实验验证该系统可以明显识别火焰,而且火灾检测速度远远高于以往的视频监控火灾报警系统。该系统能够充分利用室内原有的视频监控设备,有效弥补了现有火灾报警系统的不足[19],是火灾识别系统发展的主流趋势,具有较广阔的应用前景。未来,将继续优化系统结构和识别过程,完善识别算法性能,例如引入深度学习模型,将此系统应用与监控视频大数据分析结合,以利于更高效、准确地识别火灾。