基于计算机视觉的视频图像关键帧提取及修复方法

林 嵩

(福建技术师范学院 文化传媒与法律学院, 福州 350300)

0 前 言

视频监控录像的崛起带领人们进入了一个数字化社会。由于每时每刻都有大量的视频图像生成,且涉及的事物众多,信息纷繁复杂,为了实现视频图像的高效传输,分析图像关键帧,提取主要特征,学者们进行了深入研究。张航等人提出了一种面向矿山监管的无人机视频关键帧影像动态提取方法,首先对视频影像进行预处理;然后,基于提出的相关信息进行加权处理,得出关键帧的动态间隔;最后,对关键帧的时间间隔进行加权处理,提取关键帧的动态时差[1]。王俊玲等人提出了一种基于语义相关的视频关键帧提取算法,首先利用卷积自编码器提取视频帧的深度特征,并对其进行聚类分析;然后,筛选出最清晰的视频帧作为关键帧;最后,利用密度方法对初次提取的关键帧进行优化[2]。但上述方法需要处理多次才能提取到视频图像关键帧。

计算机视觉任务包括获取、处理、分析和理解数字图像的方法,以及从现实世界中提取高维数据。为了提高视频图像关键帧提取及修复效果,本次研究设计了一种基于计算机视觉的视频图像关键帧提取及修复方法。

1 基于计算机视觉的视频图像关键帧提取

1.1 视频图像分割

人工测量视频图像只能对重点区域进行分割;而基于计算机视觉测量视频图像不仅能够检测物体活动背景,而且能够识别目标移动轨迹。基于计算机视觉的视频图像采集过程如图1所示。

图1 基于计算机视觉的视频图像采集过程

为了实现视频图像的准确切割,采用阈值分割法建立灰度值模型,首先找出视频中的关键帧阈值,然后计算背景与目标的灰度差,最后完成阈值分割[3]。

设原始视频图像为f(x,y),其灰度值范围为[Qmin,Qmax],灰度阈值为Q1。阈值分割后的视频图像如式(1)所示:

(1)

式中:f1(x,y)表示阈值分割后的视频图像。

无论灰度值如何变化,阈值分割都不会丢失原始视频图像的主要信息,其不仅能够过滤掉重复数据,而且能够使还原度达到最高[4]。基于阈值分割的突变性,采用迭代法使灰度值保持在同一水平线上。首先,从绘制的灰度直方图中选取合适的阈值进行视频图像切割,通过不断迭代计算得出新灰度值Q=(Qmax+Qmin)/2;然后,求出迭代n+1次的平均灰度值Qn+1=(Qb+Qm)/2,其中Qb表示背景灰度值,Qm表示目标灰度值;最后,比较Qn和Qn+1,若相等,则Qn+1为最佳阈值,否则继续迭代计算。

1.2 视频图像纹理采集

当视频图像出现相似背景时,容易出现错误识别的情况,从而导致纹理检测失败。为了提高纹理采集效率,利用视频图像中的主要特征窗口获取像素值[5-6]。纹理图像灰度值的计算如式(2)所示:

(2)

式中:Gpixel_A表示纹理图像灰度值;i表示像素点;m表示像素点个数;P表示纹理图像采集概率。

在视频图像纹理采集过程中,需要对关键像素点和模糊视频图像进行重建与融合[7]。采用熵值法采集剩余的局部纹理图像,以原始像素点作为标准求出对应的熵。纹理图像特征向量的计算如式(3)所示:

(3)

式中:c(t)表示纹理图像特征向量;T表示纹理模型;t表示延后时间;K表示灰度系数;t0表示初始时间。

由于像素点的检测会对视频图像产生干扰,导致出现不稳定的噪声[8]。当噪声达到较高分贝时,会在一定程度上影响子区域的融合,从而使视频帧数不稳定,采集的纹理图像不够完整与清晰。为了得到色彩丰富的二维结构[9],使用的函数如式(4)所示:

(4)

式中:P1、P2、P3、P4表示逐渐增加的概率;x1、x2、x3、x4表示视频帧的二维高斯核函数;ϑ表示维度。

当给予不同维度的数值时,纹理图像关键帧的灰度差如式(5)所示:

(5)

式中:z表示纹理图像关键帧的灰度差。

z的3个值代表了3种滤波,利用滤波函数θ将图像中的混合噪声分离出来,通过特征分量去除缘区域的噪声干扰,以确定纹理图像关键帧像素点的分布情况。

1.3 视频图像关键帧提取

视频图像关键帧包括初始帧和终止帧[10]。以初始背景为例,首先找出主要特征分量;然后,在特征分量中找出关键帧信息;最后,通过灰度值曲线图判断关键帧的具体位置[11]。关键帧提取流程如图2所示。

图2 关键帧提取流程

假设存在2个相似的视频图像Ui(x,y)和Uj(x,y),面积均为M×N,则视频图像关键帧中的相似像素值如式(6)所示:

λ(Uj(x,y),w)

(6)

式中:F(r,w)表示像素值函数;r表示颜色特征;w表示亮度特征;λ表示因子系数。

去除所有干扰因素后,相似概率如式(7)所示:

(7)

式中:P(r,w)表示相似概率。

由式(6)、式(7)可知,根据像素点特征分量可以绘制关键帧曲线[12],从而得到Ui(x,y)和Uj(x,y),定义表达式如式(8)所示:

(8)

相关性越高,二者的相似程度越高。正常情况下,相关性的值为0~1,灰度阈值约为0.9。

由于视频图像不受时间和地点的限制,关键帧只随着特征向量的变化而变化,并按照从模糊到清晰的顺序排列[13]。以初始关键帧作为标准,删除重复信息,填补缺失数据,比较相邻关键帧的灰度差[14],求出最后视频图像的关键帧灰度差,如式(9)所示:

(9)

式中:P(xi)表示灰度值概率。

由于灰度值受到阳光等影响,导致关键帧提取出现误差,关键帧序列分布不均匀。只有当信息熵达到最大值时,才会减少关键帧的排列错误。新的视频图像关键帧提取包括以下6个步骤:

(1) 采集视频图像中的主要关键帧,待达到一定数量后,确定该片段的初始帧和终止帧[15];

(2) 将视频图像分成多个小片段,并逐一分析每个片段的关键帧相似度序列U′,U′=(U1,U2,U3,…,Un-1,Un),选取序列中的阈值Q作为主要关键帧,即Q=U1;

(3) 求解像素点之间的相关性,设阈值Q=0.9,进而选出新的关键帧;

(4) 重复上述步骤,直到从剩余关键帧的序列中检测出终止关键帧;

(5) 当|i-j|<20时,得到最大的信息熵值,将获取的关键帧整合到同一个集合中;

(6) 在集合中找出初始帧和终止帧,否则转回步骤(5)。

2 视频图像修复

每个关键帧都具有特定的信息熵,在进行关键帧修复时,首先提取相同关键帧信息备用;然后找到目标移动规律,记录移动轨迹矩阵H=(H1,H2,…,Hn)。由于H中的每个元素都具有相同的背景和目标,因此背景噪声会使目标改变方向。基于噪声的不确定性,建立降噪模型,如式(10)所示:

min‖H‖+λ,s.t.‖P-H-S‖≤ε

(10)

式中:S表示面积矩阵;P表示概率矩阵;ε表示噪声。

经过双层滤波降噪处理后,关键帧的主要信息逐渐被修复,利用加权法还原原始矩阵,如式(11)所示:

(11)

式中:Ws表示视频图像关键帧特征修复函数。

3 实验结果分析

3.1 参数设计

为验证基于计算机视觉的视频图像关键帧提取及修复方法的有效性,将其与视频关键帧影像动态提取方法、基于语义相关的视频关键帧提取方法进行对比实验。实验参数如表1所示。

表1 实验参数

3.2 实验结果分析

3.2.1 关键帧提取效果

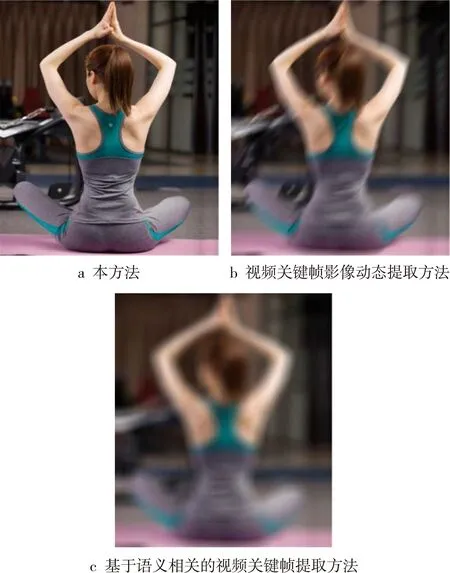

分别采用3种方法提取3种不同视频图像的关键帧,提取效果如图3-图5所示。

图3 视频图像1的关键帧提取效果

图4 视频图像2的关键帧提取效果

图5 视频图像3的关键帧提取效果

由图3 — 图5可知,本方法提取的图像清晰度较高,能够提取到图像的颜色特征和纹理特征;其他2种方法提取的图像清晰度较低,尤其是基于语义相关的视频关键帧提取方法提取的图像最模糊,不能准确获得图像信息。

3.2.2 关键帧修复效果

由视频图像关键帧修复效果(见图6)可知,本方法修复效果较好,其他2种方法修复的图像存在模糊现象。

图6 视频图像关键帧修复效果

3.2.3 关键帧提取时间

由视频图像关键帧提取时间的对比结果(见图7)可知,关键帧提取时间随着视频数量的增加而增加,本方法的关键帧提取时间比其他2种方法少。

图7 视频图像关键帧提取时间的对比结果

3.2.4 关键下帧提取误差

不同λ的视频图像关键帧提取误差如表2所示。当λ为0.05时,本方法的关键帧提取误差为0.01,视频关键帧影像动态提取方法的关键帧提取误差为0.58,基于语义相关的视频关键帧提取方法的关键帧提取误差为0.68。当λ为0.66时,本方法的关键帧提取误差为0.16,视频关键帧影像动态提取方法的关键帧提取误差为0.43,基于语义相关的视频关键帧提取方法的关键帧提取误差为0.52。由此可见,本方法的视频图像关键帧提取误差比其他2种方法低。

表2 不同λ下的视频图像关键帧提取误差

4 结 语

本次研究设计了一种基于计算机视觉的视频图像关键帧提取及修复方法。首先,在智能计算机的基础上还原视频图像,提取数据信息,确定关键帧序列;然后,将灰度值与关键帧序列相结合,复制相似关键帧信息,修复丢失关键帧;最后,利用灰度值与序列之间的联系获取主要特征,对其进行融合与分类,进而完成关键帧修复。