一种新型Mobile-Unet网络的肺结节图像分割方法

陈 铭,梅 雪,朱文俊,周 颖,张梦怡,冯李航

(南京工业大学 电气工程与控制科学学院,江苏 南京 211800)

据癌症中心统计,我国每年死于肺癌的人数接近100万[1],大多肺癌患者被发现时基本处于中晚期,导致肺癌病人死亡率很高,及早诊断肺癌并治疗对降低死亡率具有重要的意义。肺癌前期多表现为小型肺结节[2-4],但在临床上却无特异症状。尽管CT影像技术的出现有助于提前发现病变结节,但是面对日益增加的影像诊断需求,医生需要逐一进行仔细斟酌和筛选,效率低下且易导致医生疲劳,这增加了误诊的概率。

为了解决上述问题,利用深度学习实现肺结节分割的研究[5-10]成为趋势。Kumar等[11]较早地采用了卷积神经网络(CNN)自动提取肺结节图像特征,实现了肺部小结节的分类识别。Shelhamer等[12]则提出了替代CNN全连接层的全卷积神经网络(FCN)来实现图像感兴趣区域(ROI)的分割,解决了语义级别的图像分割问题。Ronneberger等[13]在FCN网络基础上,首次改进并提出了新的网络Unet[14-15],该网络架构呈U形,前半部分用于特征提取,后半部分基于上采样技术实现与前半部分特征通道数的同尺度拼接,使得拼接后的特征表达性极大增强。Unet网络的优异性能使其在医学图像领域得到了极大关注,后来的研究者也多是基于此进行改进,如柳小波等[16]通过结合残差网络(ResNet)的方式,提出了Res-Unet网络进行图像轮廓的优化;钟思华等[17]采用特征层密集连接的方式,建立了Dense-Unet模型用以改善分割性能。然而,医学图像普遍存在着数据量不均衡、分辨率较低、结节不明显等问题,这些改进Unet在应用时,一方面增加了模型复杂度,如高度复杂的残差网络,另一方面也增加了额外的计算量,如Dense密集连接的冗余层在训练时易发生过拟合现象,导致后期测试样本的分割准确率难以提高,且实际应用中计算资源消耗较大。

针对上述问题,本文提出了一种Mobile-Unet网络的肺结节图像分割方法。该方法为了兼顾识别精度和计算效率,采用轻量型MobileNetV3网络[18-19]作为主干网络,以实现深层特征提取,结合针对医学图像分割任务的特定任务型网络Unet来提高整体的分割性能。

1 方法

1.1 图像预处理

本文所使用的数据集来自南京肿瘤医院,图片格式为DICM格式。收集到的数据集共有20例病人,这些病人共有400张CT图像,其中400多张CT图像中可能含有1~2个小结节(一个结节可能对应多张切片),将有结节部分的图片从400多张CT图像中挑选出来组成数据集,最终收集到的图片总计217张。

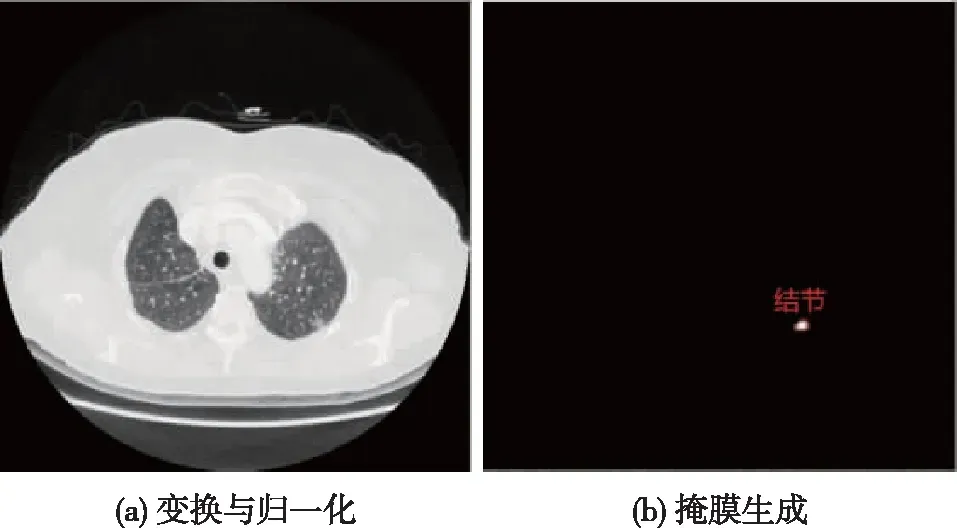

为使不同切片厚度的CT图像运用到网络模型中,可首先对图片进行格式转换,然后将数据集进行归一化处理,图1(a)所示为处理后的结果示例。Unet网络需要用掩膜作为原始图像的标签,使用标注软件对结节位置进行人工标注生成掩膜图像。掩膜中只含2个像素点,分别为0和1,1代表结节所在的像素,0代表非结节所在的像素,图1(b)圈出来的白色区域为根据结节位置所生成的形状。

图1 图像预处理结果Fig.1 Results of data preprocessing

1.2 网络算法架构

为了提高肺结节图像分割的精度和效率,本文提出并设计了主干网络和任务网络相结合的Mobile-Unet网络模型,其中主干网络选用MobileNetV3轻量级网络,任务网络为常用的Unet网络。该网络通过浅层特征融合深层特征的方式提取表达性较强的特征,解决分割精度难以提升的问题;采用MobileNetV3轻量型网络特征提取可以降低模型复杂度、减少训练时的参数量,从而提高网络收敛速度。

1.2.1 Unet网络

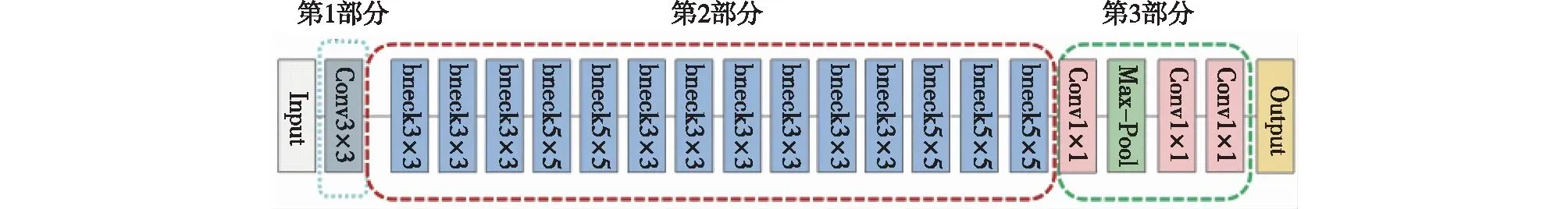

Unet网络是一种全卷积神经网络,是目前比较流行的医学图像分割模型。图2为Unet网络结构。网络由编码器(上采样)和解码器(下采样)两个部分组成。编码部分通过卷积和池化对输入图片进行降维和特征提取;解码部分通过上采样对低像素(浅层特征)图片进行升维和特征放大。编码所得到的不同特征图会以通道融合的方式连接到解码部分的相对应层,其中浅层特征用来分割,深层特征用来定位,二者的有效结合有助于增加特征的多样性。因此,作为特定的任务型网络,能较好地适用于医学图像的分割。

图2 Unet网络结构的构建Fig.2 Construction of Unet network

1.2.2 MobileNetV3网络

MobileNetV3是一种结合了深度可分离卷积[20]、线性瓶颈逆残差结构[21]和轻量级注意力机制[22]的网络。该网络为解决现实场景应用中计算能力受限而专门设计,具有参数量少、速度快、深度适中等优势,常作为主干网络应用于医学图像分割任务。可分离卷积模块的计算复杂度如式(1)—(4)所示。

Md=i×j×k

(1)

Mp=1×1×p×k

(2)

M=Md+Mp

(3)

(4)

式中:Md、Mp和M分别为逐通道卷积参数量、逐点卷积参数量和可分离卷积总参数量,i、j、k和p分别为卷积核的长、宽、数量和通道数,R为深度可分离卷积与普通卷积参数量的比值。由于本文采用卷积核的长和宽均为16,彩色图片的通道数为3,经式(4)计算R约为0.337,通过该比值可以看出深度可分离卷积的参数量远远少于传统卷积参数量,约为传统卷积参数量的30%,从而大大缩短网络训练时间。

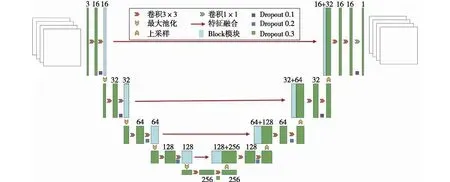

如图3所示,MobileNetV3网络主要分为3个部分。第一部分(Conv3×3)为一个3×3的卷积层,用于提取特征;中间部分(bneck1—4)为多个含有可分离卷积层块(bneck)的网络结构,由多个3×3、5×5的卷积块组成,通常深度越深,提取到的抽象特征越好;最后一部分通过卷积层(Conv1×1)代替全连接层,在经过池化等一系列步骤得到输出结果。

图3 MobileNetV3网络结构的构建Fig.3 Contruction of MobileNetV3 network

1.2.3 Mobile-Unet网络

1.2.3.1 单一独立模型的局限性

1)Unet网络。针对肺结节这种小而不明显的图像分割任务,抽象特征的有效提取有助于提升模型的分割性能。虽然Unet网络能够高效地利用不同层的特征,但是作为独立模型使用时还存在着以下不足:多次使用普通卷积如Conv3×3或Conv5×5,增加了模型设计的难度和普适性;网络层数还较浅(一般为7~10层),使得特征学习次数也有限,表达性不强。

2)MobileNetV3网络。MobileNetV3中bneck模块结构含有多个尺寸和深度的可分离卷积块、批量归一化(BN)层、H-Switch激活函数等,可以根据任务和网络的需求选择不同的搭配方式,具有很强的灵活性,但该网络应用于医疗图像识别时还存在如下的局限性:忽略了特征与特征之间的联系性,如图3中bneck模块提取的深层特征没有以特征融合的方式结合浅层特征,导致部分重要特征的损失;激活函数插入位置一般相对固定,且实验样本数量较少,这导致了精度提升并不明显。

1.2.3.2 Mobile-Unet网络架构与实现

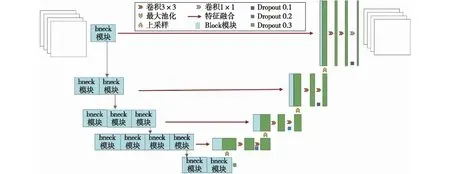

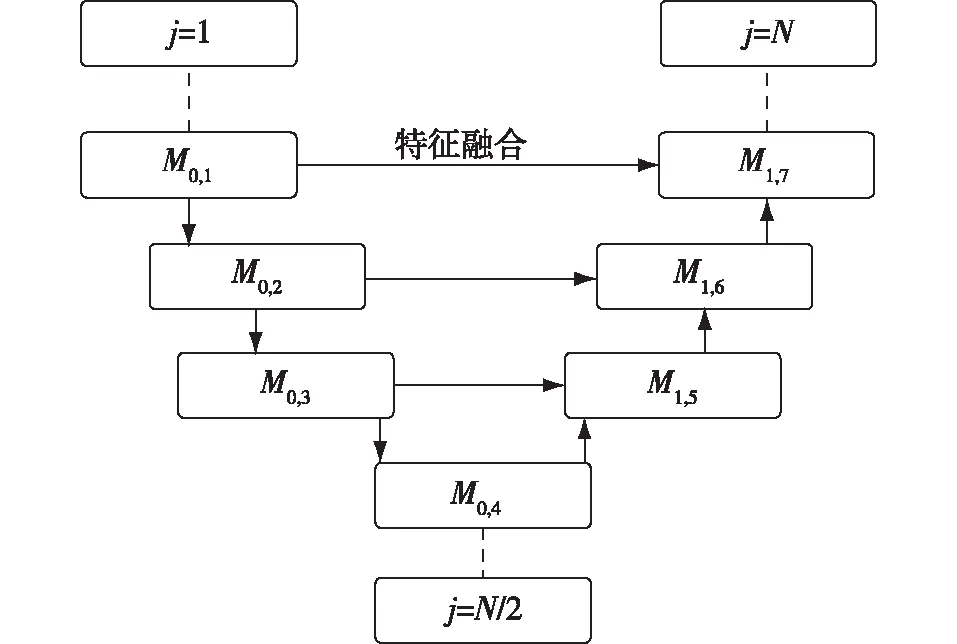

针对上述问题,本文提出并设计了主干网络和任务网络相结合的Mobile-Unet网络模型,其中主干网络选用MobileNetV3轻量级网络,任务网络为常用的Unet网络,网络结构采用图4方式构建。首先,将MobileNetV3中bneck模块移植到Unet网络的编码部分;其次,根据Unet编码部分位置采用不同深度的bneck模块来提取特征,通常位置越深,所需bneck模块量越多,提取到的抽象特征也越高级;最后,将提取后的特征按照图5的方式依次连接到解码器的对应位置进行特征融合,连接过程中需要保证特征图与解码器对应位置的通道数、尺寸保持一致,特征提取的计算见式(5)。

(5)

式中:a控制网络的结构(a=0代表编码部分,a=1代表解码部分);N为网络深度;b控制网络深度(b≤N/2b≤N/2为编码深度,b>N/2为解码深度);f(…)为编码部分运算,每次运算经过特定大小的卷积层、Relu6激活层等;g(…)为解码部分运算;{…}为特征融合;Qa,b为最终特征图。

图4 Mobile-Unet网络结构的构建Fig.4 Construction of Mobile-Unet network

Mobile-Unet网络将MobileNetV3特征提取并结合Unet的特征连接,有助于减少网络层数参数过多和过拟合问题,从而具有了精度高、计算简单和较少参数等优势。

图5 特征融合过程Fig.5 Feature fusion process

2 实验

2.1 数据集与平台

本文将数据集(217张图片)划分为训练集、验证集和测试集,训练集用以训练模型,验证集用以对模型进行调优工作,测试集用以测试模型的性能。首先,取出后200张图片;然后,使用机器学习包中的split方法将图片划分为训练集和验证集,划分比例为9∶1;最后,将图片前17张作为测试集。

实验在Window系统下进行,网络模型架构通过基于tensorflow后台的keras环境实现Mobile-Unet网络的构建,采用一块GTX 1060Ti图形处理器的便携式硬件平台,内存RAM 6.0 GB。网络参数的设置遵循以下规则:根据图片的尺寸选择输入维度为 (256,256,3),优化算法采用下降速度最快、效果最好的Adam优化器,根据显卡性能选择送入网络的图片批次量(batch-size)为10,激活函数选取常规的Relu激活函数,损失函数(L)采用交叉熵损失(式(6))。

(6)

式中:yl为样本l的标签,pl为样本l预测存在物体的概率,S为样本量。

2.2 评价指标

对于分割问题采用准确率(Ac)、召回率(Pr)和相似系数(F1)作为评价指标(式(7)—(9))。

(7)

(8)

(9)

式中:Te为像素e的实际类别;Pe为像素e的预测类别;Tp为真正例;FN为假反例;FP为假正例;TN为真反例;∩为真实类别与预测类别相同的情况,即Tp;∪为所有情况的总概率。

2.3 模型验证

将训练集送入Mobile-Unet网络训练,训练过程的误差曲线如图6所示。由图6可以看出:训练集和验证集的误差都随着步数的增加而下降,最后趋于稳定,并且误差降到1%以下,说明该模型对偏差控制得很好;训练集和验证集稳定后的误差接近说明该模型的方差比较小。

图6 训练过程的误差曲线Fig.6 Error curve of training process

2.4 结果分析

为了进一步验证Mobile-Unet模型的分割性能,本文选取传统的Unet、SegNet、Res-Unet以及Mobile-Unet 4个模型进行对比实验,并采用Ac、Pr和F13个指标来评估分割效果,结果见表1。

表1 模型的评价指标

由表1可知:SegNet和Unet网络仅仅提取层数较浅的特征,特征表达性不高,导致最后的分割结果比较粗糙,相似系数分别为82.63%和83.77%;Res-Unet网络由于网络层数很深,对图像中干扰像素点很敏感,出现了准确率很高,召回率较低的情况,相似系数为89.22%;而Mobile-Unet网络利用MobileNet中深层网络进行抽象特征提取,减少了网络层数参数过多和梯度爆炸问题,准确率由传统Unet网络的85.00%提升为90.00%,同时相似系数较Unet、SegNet、Res-Unet分别提升了6.21%、7.35%、0.76%。

由表1还可知:传统的Unet和SegNet虽然花费的时间较短,均低于1.3 h,但是没有很好地提升模型的性能;Res-Unet依靠深层网络取得了很高的准确率,但花费时间较长,约为2.1 h;而Mobile-Unet模型在模型性能和时间消耗(1.6 h)上均有不错的表现。

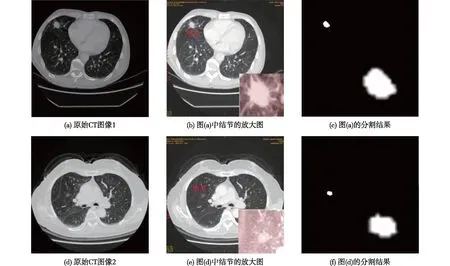

为了观察可视化效果,随机选取了测试集中的两张CT图像进行了显示,结果见图7,图中白色的部分即为分割出的结节位置,黑色部分代表非结节位置。由图7可知:Mobile-Unet网络能够很好地分割出结节位置,尤其是在结节特别小的情况下,模型依然保持着良好的分割性能。

图7 肺结节的分割效果Fig.7 Segmentation rendering of pulmonary nodules

3 结论

1)本文提出了主干网络MobileNetV3与任务型网络Unet相结合的一种新型Mobile-Unet网络进行肺结节图像分割。Mobile-Unet网络通过主干网络进行抽象特征提取并结合任务型网络的特征融合优点,有效缓解了特征利用率低的问题,进而提升了网络的分割性能,实验结果表明新型Mobile-Unet网络相似系数较Unet、SegNet、Res-Unet提升了6.21%、7.35%、0.76%,提升效果显著。

2)本文采用轻量型MobileNetV3网络中可分离卷积代替传统卷积模块,主要体现在网络层数较深的情况下,能极大减少网络的参数量,约为传统卷积模块的30%。缓解模型过拟合现象,有助于提升模型的鲁棒性。

3)轻量型网络在减少参数量的同时,能进一步缩短模型训练时间,较Res-Unet网络节省1 h,降低了计算成本,使模型兼顾识别精度和计算效率以达到最优分割效果。

考虑到本实验样本数据的限制,导致模型对分割细节上的处理不够,进而影响模型的分割效果,后续工作将研究如何扩充实验样本,以进一步提升深度学习在图像分割中的适用性。