基于GAN的遥感图像融合

陈绍兵,陶青川,余艳梅

(四川大学电子信息学院,成都 610065)

0 引言

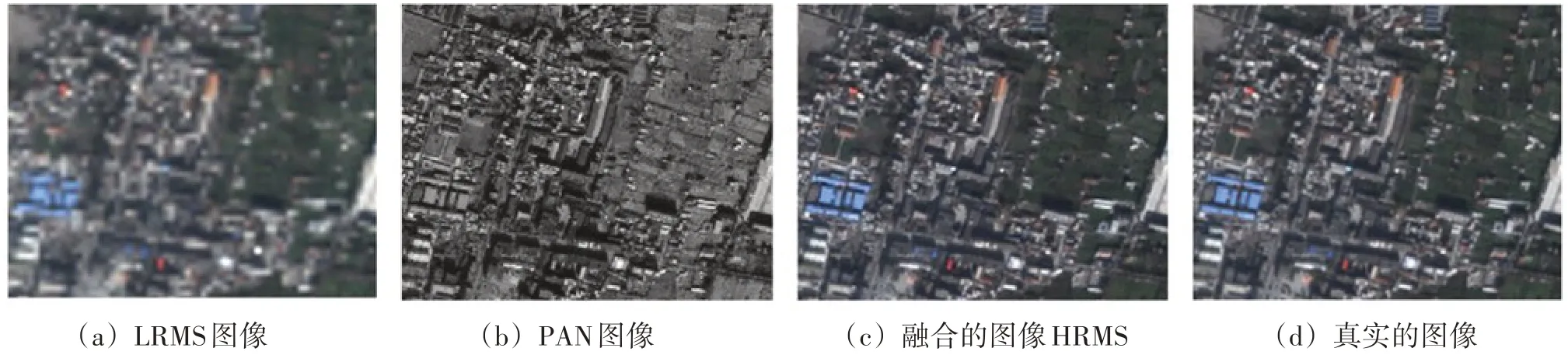

21世纪以来,遥感图像的研究由于诸多高分辨率的卫星的发射得到了巨大的进展,国外的Landsat,Sentinel,WorldView,QuickBird,Geo-Eye-1等系列卫星已经得到了很好的卫星影像[1],并且在遥感图像处理领域有了很快速的发展。相比于国外,国内发展就比较缓慢,1999年10月14日,我国与巴西在航天领域首次合作成功发射“资源一号”卫星[2],2013年4月26日,我国首发高分辨率卫星——高分一号。这些卫星的相继发射使得我国在多光谱与高时间分辨率结合的光学遥感技术方面取得了重要的奠基。卫星捕捉到的遥感图像分成两类,一类是具有高分辨率的全色图像(PAN),另一类是具有低分辨率的多光谱图像(LRMS)。随着研究的需要,如何得到高分辨率的多光谱图像成为了一个重要的研究方向,其本质就是将得到的全色图像和多光谱图像进行融合,得到高质量的多光谱图像(HRMS),这一融合的过程就叫“全锐化”(Pan-sharpening),如图1所示。

图1 遥感图像“全锐化”过程

多源遥感图像融合发展至今,诞生出了许多不同的算法,大致可分为三类:

(1)像素层数据融合。原理是根据像素基于一定的规则进行像素级融合。比较经典的算法是分量替换(component substitution,CS),它是通过分离空间信息和光谱信息,将高分辨率的空间信息替换为PAN图像的空间信息,从而实现全锐化的处理。

(2)特征层数据融合。相较于像素层的融合可以提取出更多的表示遥感图像的几何特征,将这些特征进行分层处理,低层的特征分辨率高,包含更多的位置、细节信息,高层的特征有更强的语义信息,但分辨率低,对两者的优点进行融合是这种算法的研究所在。张等人[3]提出了一种优化的贝叶斯估计多源融合的算法,针对基础贝叶斯进行优化,得到了更好的融合效果。还有聚类分析,神经网络都是解决这一特征层融合的算法。

(3)决策层数据融合。它是通过多个传感器监测同一个目标,每个传感器完成基本的预处理等操作,然后由决策层融合判定需要哪些数据。Jeon等人[4]采用联合似然和主体加权的方法进行决策数据融合,使分类效果得到明显的改善。

最近几年,深度学习由于卷积神经网络的提出飞速发展,诞生出了很多经典的模型:VGG[5]、ResNet[6]、GAN[7]等优秀的网络模型结构都在各自的领域里表现出了良好的效果,这也为本文后面的遥感图像的融合奠定了基础。GAN在遥感图像融合方面也出现了不同的应用,Yang等人[8]提出了将GAN网络运用到遥感图像融合的领域中,得到了比以前传统方法更好的效果。Ma等人[9]设计了两个判别器来分别训练遥感图像的光谱信息和空间信息,最后融合来生成高质量的遥感图像。Liu等人[10]则将GAN网络的输入变成了两分支结构从而很好的提取出了LRMS和PAN图像各自的特征,实验结果表明效果较好。

前面提到的算法虽然能够得到HRMS图像,但是对于一些细节的纹理部分,依然存在不细致的问题,这是因为在提取图像的特征时,没有根据图像的区域整体提取上下文的特征。基于这个问题,本文对于以前的网络进行改进,得到了更高空间分辨率的HRMS图像。这篇文章的主要贡献如下:

(1)本文在输入图像特征提取部分,加入了提取上下文信息的结构,能够更好的提取到图像的细节特征。

(2)本文评估了判别器的不同配置,确定了判别器的残差模块层数。

(3)本文证明了在常用的数据集上得到了很好的效果。

1 本文的方法

1.1 GAN理论

GAN的基本原理其实与一般的神经网络类似,唯一的区别在于GAN分为生成器和判别器两个网络。本文令G为生成器,D为判别器,G通过接收一个随机的噪声z作为输入,生成的噪声图片为G(z)。D判断G的输入是否为真,x是输入的图片,D(x)是判别的概率。在训练过程中,生成器G的目的就是尽量生成真实的图片去欺骗判别网络D,而D的目标就是尽量把G生成的图片与真实图片区分开。这样,G和D就形成了一个“动态博弈”的过程。最终的理想博弈结果就是,G生成了可以以假乱真的图片G(z),判别器D难以判别G生成的图片,最终D(x)=0.5。

最后,其原理公式[7]描述如下:

其中V是D和G的极大极小值函数。

1.2 本文的网络结构

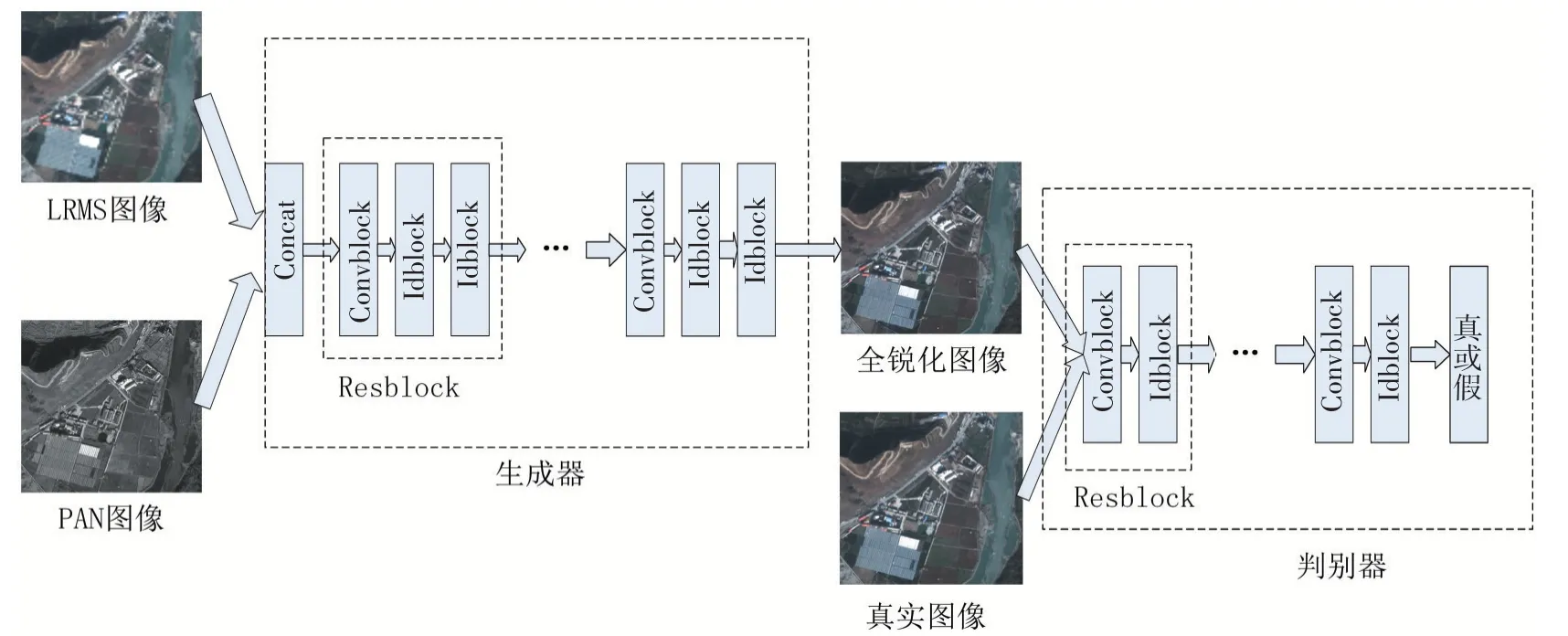

本文网络的整体结构如图2所示。主要的网络结构是基于GAN的,同时受到文献[10]的启发,两分支的GAN比单分支的GAN效果更好,所以本文也采用两分支的GAN作为基础架构,并在其基础上引入了Resblock[6],改进了特征提取的效果。整个训练的流程从左边开始,输入两个图像LRMS和PAN到生成器中融合成全锐化的图像,即HRMS。然后,HRMS和真实的图像再输入到判别器中进行判别,判断HRMS是真或假。两个网络结构互相对抗博弈,从而使生成器生成的图像更加接近真实图像。

1.3 生成器结构

生成器的目的就是生成最逼真的假HRMS来欺骗判别器,与一般的GAN不同,遥感图像有两种类型的图片,因此要分别进行特征提取处理。如图2中左边的虚线框所示,生成器由Concat连接模块和多个Resblock[6]残差模块组成,因为以往的GAN网络都只是通过简单的卷积来提取特征,没有很好的处理局部上下文之间的联系,而残差模块在每三层卷积后融入了最上层的特征,提取到了细节的纹理信息。

图2 整体网络结构

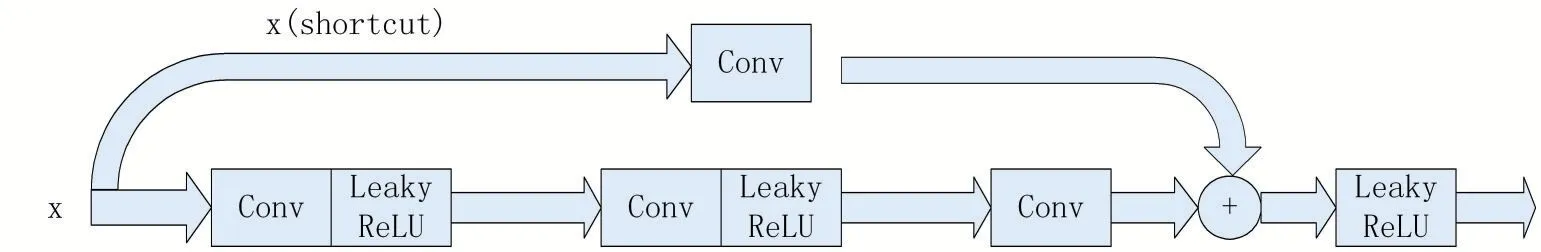

Resblock由两部分组成:①Convblock,它把最上层的特征x再进行卷积提取得到x(shortcut),将其加入到最后一层作为输出,如图3所示。②Idblock,它是直接将最上层的特征x加入到最后一层作为输出,如图4所示。同时在每层卷积后本文使用了泄露整形线性单元LeakyReLU[11],这种激活函数可以很好的处理小于0的特征值,防止了在训练时梯度消失的问题。本文使用一个Convblock加两个Idblock合成为一个Resblock作为生成器的基础特征提取单元。

图3 Convblock模块

图4 Idblock模块

1.4 判别器的结构

与生成器类似,本文也采用了Resblock残差模块来组成,开始设计的时候本文首先使用的是VGG[5]的架构作为判别器的基础,结果发现生成器很快就收敛了,说明判别器判别能力比较弱,无法训练得到最好的结果。所以本文将其替换为Resblock残差模块以便更好的判别生成器的输入。与生成器有点不同,判别器是一个Convblock和一个Idblock合成为Resblock作为基础的特征提取单元。判别器结构如图2右边虚线框所示。

1.5 损失函数

为了更好的平衡生成器和判别器之间的训练,本文采用了文献[10]的损失函数作为训练。生成器和判别器的损失函数如下所示:

其中,N是一批训练样本的数量,α和β是超参数,X和Y分别是LRMS和PAN图像,Θ是模型的参数集合,P是理想的HRMS图像。

2 实验及结果分析

2.1 实验的参数和数据

因为卫星进行采集没有真实的图像作为对照,如同文献[10],根据Wald等人[13]提出的将LRMS下采样作为一个更低质量的图像进行输入,而原来的LRMS图像就作为真实图像作为对比。数据集采用QuickBird(QB)和WorldView-2(WV-2)。两个数据集都由9对图像构成,8对作为训练,1对作为测试,由于遥感图像尺寸很大,本文将LRMS和PAN分别裁剪成64×64和256×256的大小,批次设置成2。裁剪过后两个数据集分别为25038和11552万张图像样本。

训练的环境是TensorFlow来实现的代码,训练的GPU是英伟达GTX1080ti。本文使用Adam优化器来进行模型的优化训练,初始训练率设为0.0002且动量设为0.5。

2.2 评价指标

本文使用5个大多数先进方法使用的评价指标来评估融合后的图像效果,这些指标都显示了融合图像的优劣。

(1)SAM[14]。光谱角图(spectral angle mapper,SAM)是将图像中的每个像元的光谱视为一个高维向量,通过计算两向量间的夹角来度量光谱间的相似性,夹角越小,两光谱越相似。计算公式如下:

其中t和r是两个光谱向量,此数值越小越好。

(2)CC。相关系数(correlation coefficient,CC)表明了两幅图像的相关程度,定义如下:

其中,X和F是两幅输入的图像,大小为M×N,此数值越大越好。

(3)SCC[15]。空间相关系数(spatial correlation coefficient,SCC)表示的是两幅图像的空间信息相关程度,与CC相似,此数值越高越好。计算公式如下:

其中G和F分别表示LRMS和PAN图像,μF和μG分别代表两种图像的均值。

(4)ERGAS[16]。综合相对无量纲全局误差(erreur relative globale adimensionnelle desynthese,ERGAS),定义如下:

其中,h∕l是PAN图像与LRMS图像像素尺寸比,RMSE(k)和μ(k)是RMSE和第k个通道的均值,此数值越小越好。

(5)Q4[17]。Q4是Q的四频带延伸,定义如下:

Z1和Z2是LRMS图像的谱向量组成的四元数,μZ1和μZ1是Z1和Z2的均值,σ表示协方差。

2.3 残差模块层数的影响

根据前人的经验[6],Resnet-101比Resnet-50表现结果要好,而且一般认为网络结构越深能够获取到的特征越丰富,更能够拟合模型,识别出好的结果。然而,在本文的实验中,本文分别测试了判别器1-4层的Resblock模块,每一个Resblock模块由一个Convblock模块,一个Idblock模块和LeakyReLU层组成。本文固定生成器的结构不变,通过修改判别器的结构来测试残差模块层数对整个GAN的影响,如表1所示,“-1”表示用了一个Resblock模块,以此类推,“-4”用了4个Resblock模块。根据在QB和WV-2上的结果可以看到,虽然增加层数会提高整体的效果,但是太多的层数反而会降低表现效果。原因在于GAN不同于以往的深度神经网络,它并不是一方能够主导结果,而是生成器和判别器两方的共同作用才能得到优质的图片。因此,重点是在于平衡两者间的能力,可以从表1中看到,在将层数增加到第二层时,在QB数据集上的CC、SCC和Q4的数值达到了最高,分别为0.9908、0.9920和0.9914。与之相比的WV-2数据集也是类似的效果,但是却是使用一层残差模块效果最好,可能是因为该数据集的光谱信息不如QB数据集上的复杂。

表1 消融实验

2.4 与其他方法比较

为了能够体现出本文方法的优势,本文将与其他的锐化方法作比较,其中包括SFIM[18],Brovey[19],IHS[20],GS[21],GSA[22],PNN[12],Pan-Net[8]和PSGAN[10]。表2和表3分别是在QB和WV-2数据集上的比较结果。可以很明显的看出本文的方法有非常好的效果,在QB数据集上,CC、SCC、ERGAS和Q4都得到了最高的得分。PanNet[8]在SAM上取得了最好的得分,同样证明了它的网络在光谱的融合上也是很好的。在WV-2数据集上的结果显示,本文的效果是最好的,而且空间分辨率普遍得分都比较高,因为这个数据集整体细节不是很多,所以融合效果表现良好。

表2 在QB数据集上的比较结果

表3 在WV-2数据集上的比较结果

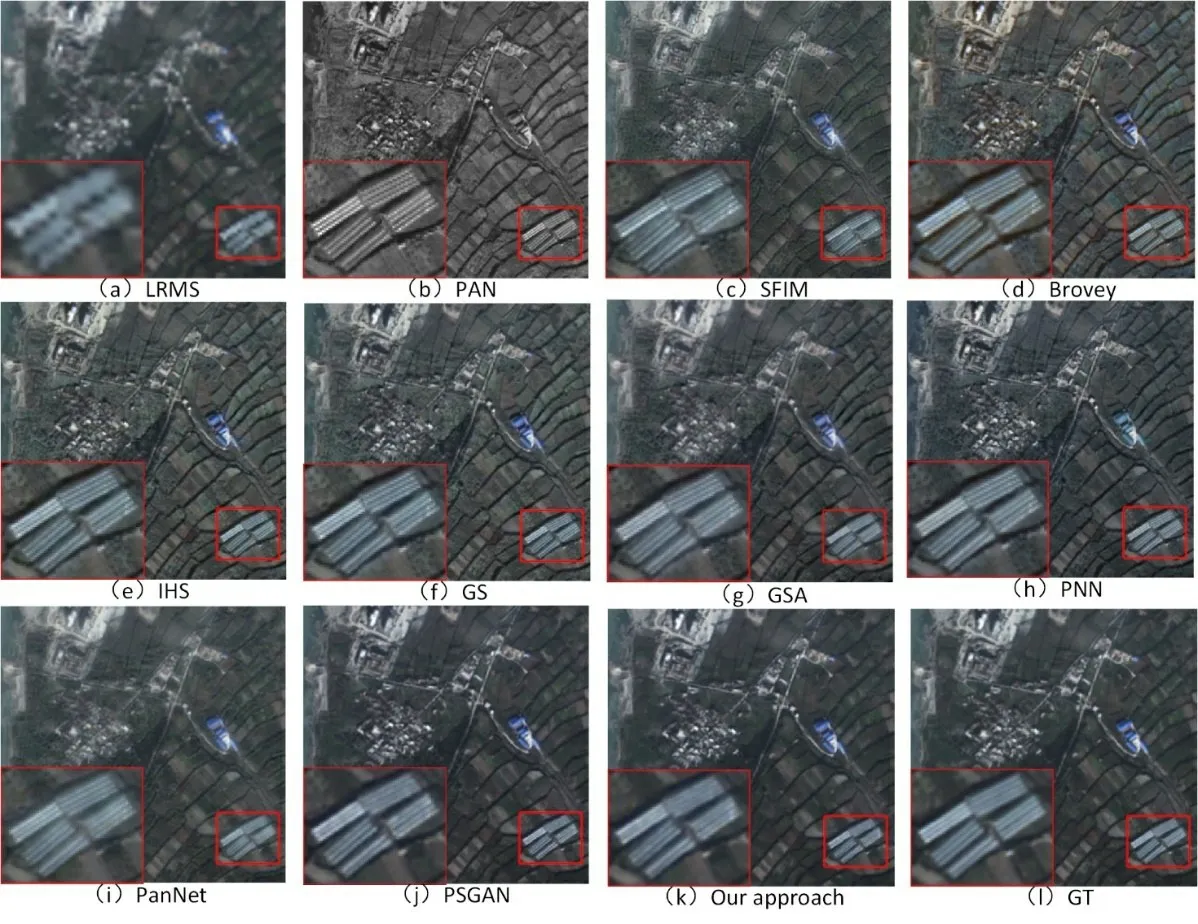

2.5 可视化结果

图5和图6分别是在QB和WV-2数据集上各种方法输出的可视化结果图,输出的都是可见的图片。其中(a)到(l)分别是低质量的多光谱图像、全色图像、SFIM方法融合的结果、Brovey方法融合的结果、IHS方法融合的结果、GS方法融合的结果、GSA方法融合的结果、PNN方法融合的结果、PanNet方法融合的结果、PSGAN方法融合的结果、本文的方法融合的结果和真实的高质量多光谱图像。

图5 在QB数据集上的可视化结果

图6 在WV-2数据集上的可视化结果

可以明显的看到所有的方法都利用了PAN图像的高频细节的信息,能够将此信息融入到结果图像中。但是在QB数据集上,除了本文方法和PSGAN方法,其他方法对于光谱信息的提取都出现了一些问题。SFIM方法的图像整体偏暗,Brovey、IHS、GS和PanNet整体上虽然接近真实的图像,但它们都没有很好的处理光谱信息,看起来尤为的粗糙。PSGAN的整体是很接近真实图像,但是从评估的数据来看依然有一些瑕疵。而本文的方法在PSGAN基础上进行了改进,在特征提取层很好的利用光谱信息平滑处理,使得与真实图像更加地接近。其主要原因就是本文利用了图像的上下文信息,很好地模拟了局部图像的细节部分。在WV-2数据集上,Brovey、IHS和GS因为没能调整好光谱信息导致整个图像都偏淡蓝色,所以光谱信息的处理对于遥感图像的融合是非常重要的。

3 结语

本文提出了一种基于GAN的遥感图像融合的方法,并在QB和WV-2数据集上进行融合实验。实验结果表明,本文的方法能在这两个数据集上得到更加接近真实图像的融合结果,评估数值结果较好。消融实验证明了残差模块层数对整个网络特征提取的影响,两层的残差模块更适合QB数据集,一层的残差模块更适合WV-2数据集。因此,要根据合适的数据集进行调整。在未来的研究中,本文会加入其他的改进处理来进一步优化网络的结构,让图像的光谱融合效果更好。