基于双线性注意力网络的农业灯诱害虫细粒度图像识别研究

姚青,姚波,吕军,唐健,冯晋,朱旭华

基于双线性注意力网络的农业灯诱害虫细粒度图像识别研究

1浙江理工大学信息学院,杭州 310018;2中国水稻研究所稻作技术研究与发展中心,杭州 311401;3浙江省托普云农科技股份有限公司,杭州 310015

【】智能虫情测报灯诱捕到的农业害虫因种类繁多、虫体姿态多样、鳞片脱落等原因造成有些害虫图像存在种间相似和种内差异的现象。为了提高农业灯诱害虫识别率,针对yolov4检测模型检测到且容易混淆的19种灯诱害虫,本文提出了基于双线性注意力网络的农业灯诱害虫细粒度图像识别模型。首先,根据灯诱害虫外观图像的相似性和检测误检的情况,将19种害虫分为6类;将所有害虫图像通过补边操作使得长宽相等,并缩放至统一尺寸224×224像素。为了提高模型的鲁棒性和泛化能力,对害虫图像进行镜像翻转、旋转180度、高斯噪声和均值滤波的数据增强,训练集、验证集和测试集样本量按照8﹕1﹕1比例划分。然后,针对6类19种农业灯诱害虫细粒度图像,建立了基于双线性注意力网络的农业灯诱害虫识别模型(bilinear-attention pest net,BAPest-net),模型包括双线性特征提取、注意力机制和分类识别3个模块;通过修改特征提取模块的下采样方式提高特征提取能力;添加注意力机制模块让整个模型更关注于局部细节的特征,将双线性结构中的上下两个注意力机制的输出进行外积运算增加细粒度特征的权重,提高识别的准确性和学习效率;模型优化器使用随机梯度下降法SGD,分类模块中使用全局平均池化,旨在对整个网络从结构上做正则化防止过拟合。最后,在同一个训练集训练VGG19、Densenet、ResNet50、BCNN和BAPest-net 5个模型,对6类相似的19种农业灯诱害虫进行识别,以精准率、Precision-Recall(PR)曲线和平均识别率作为模型的评价指标。BAPest-net对6类相似的19种农业灯诱害虫平均识别率最高,达到94.9%;BCNN次之,为90.2%;VGG19模型最低,为82.1%。BAPest-net识别的6类害虫中4类鳞翅目害虫的平均识别率均大于95%,表明该模型能较好地识别出鳞翅目害虫。测试结果中仍存在少数相似度较高的害虫误判,特别当害虫腹部朝上或侧身,种类特征不够明显的时候容易引起相似害虫的误判。对于区分度较低的相似害虫需要更多的训练样本以获取更多的特征,提高模型的识别率和泛化能力。基于双线性注意力网络的农业灯诱害虫细粒度图像识别模型可以自动识别6类相似的19种农业灯诱害虫,提高了农业灯诱害虫自动识别的准确率。

农业灯诱害虫;害虫识别;细粒度图像;双线性;注意力机制

0 引言

【研究意义】对农业害虫进行科学、快速、准确的测报是提高农作物产量和减少经济损失的前提。目前,我国农业害虫田间测报的方法主要包括人工田间调查、性诱剂、虫情测报灯等[1-3]。其中,智能虫情测报灯[4]利用灯光引诱害虫、远红外杀虫和机器视觉系统自动识别与计数害虫,具有测报数据实时、准确、历史数据可追溯等优点,已在田间获得应用。由于灯诱害虫种类繁多,虫体姿态多样,红外高温杀虫造成害虫鳞片脱离,图像中有些害虫存在种间差异小和种内差异大的现象,准确识别这些害虫具有较大的挑战性。为了提高灯诱害虫识别的准确率,需对相似灯诱害虫图像识别进行深入研究。【前人研究进展】害虫图像识别方法主要包括传统的模式识别方法和深度学习方法。传统的模式识别模型[5-8]存在鲁棒性不高,泛化能力差,无法在田间获得较好的应用与推广。近些年,随着深度学习在多个领域的图像分类任务中表现出色,许多学者开始利用深度学习研究农业害虫的识别,取得了较好的识别结果[4,9-21]。针对灯诱害虫图像,Liu等[20]提出了一种基于区域的端到端害虫检测分类模型对水稻害虫进行检测,对16类较大体型害虫识别的平均精度为75.46%。Yao等[4]为了从灯诱害虫图像中识别微小害虫,先对目标害虫区域进行分割,再利用残差神经网络对水稻上3种螟虫和2种稻飞虱进行识别,平均识别率超过85%。【本研究切入点】将相似的农业灯诱害虫识别归为细粒度图像识别。针对细粒度图像,Lin等[22]提出的双线性网络(bilinear convolutional neural network,BCNN),通过两个独立的卷积神经网络得到的特征图模拟图像的位置和外观两个变量,将图像中同一个位置上的两个特征进行外积相乘,得到特征矩阵,经最大池化下采样、向量化得到双线性向量,最后对归一化后的特征矩阵进行分类和预测;结果表明BCNN对高度定位的局部特征具有强大的激活功能,在CUB200-2011鸟类数据集细粒度图像获得了弱监督细粒度分类模型的最高分类准确率。在此基础上,BCNN的改进与变型在多种细粒度图像识别研究中取得较好的识别效果,如鸟类[23]、鱼类[24]、车型[25]、果蝇[26]等。本文在BCNN模型的基础上进行改进,研究相似农业灯诱害虫细粒度图像识别。【拟解决的关键问题】本研究对6类相似的19种农业灯诱害虫,建立基于双线性和注意力机制的农业灯诱害虫细粒度图像识别网络(bilinear- attention pest net,BAPest-net)模型,提高农业灯诱害虫识别的准确率。

1 材料与方法

1.1 灯诱害虫图像数据样本

利用智能虫情测报灯[20]采集灯诱害虫图像,如图1所示。通过yolov4[27]目标检测方法将图像中的农业害虫单个虫体检测出来,选择经常出现误判且视觉差异小的19种农业害虫作为研究对象。由于智能测报灯是通过红外高温杀死害虫,同时为了防止害虫堆积,通过抖动和传输来分散害虫,容易造成害虫鳞片脱落,且很多害虫在跌落到测报灯图像采集平台上腹部朝上,从外观上比较相似,难以辨认。根据灯诱害虫图像外观相似和模型误检的情况,将19种害虫分为6类,害虫具体信息见表1。由于害虫大小不一,将所有害虫图像通过补边操作使得长宽相等,然后缩放至统一尺寸224×224像素。

1.2 图像数据增强

为了提高模型的鲁棒性和泛化能力,对样本量少于2 000幅的害虫图像进行数据增强,增强方法包括镜像翻转、旋转180度、高斯噪声和均值滤波(图2),使得扩充后数据样本量均大于2 000幅。其中,训练集、验证集和测试集样本量按照8﹕1﹕1比例划分。

图1 智能虫情测报灯害虫图像

(a)原图;(b)镜像翻转;(c)旋转180度;(d)高斯噪声;(e)均值滤波

表1 农业灯诱害虫图像信息

1.3 农业灯诱害虫细粒度图像识别算法

1.3.1 农业灯诱害虫细粒度图像识别网络框架 农业灯诱害虫中有很多视觉上非常相似的害虫,如表1 A—F类中相同类的不同种害虫在图像上非常相似。同种害虫因姿态不同,呈现较大差异(图3)。同时,害虫种类繁多、背景复杂、虫体存在遮挡等。利用一般的深度学习模型无法获得这些害虫较高的识别率和精准率。本文将这些相似害虫识别归为细粒度图像识别。

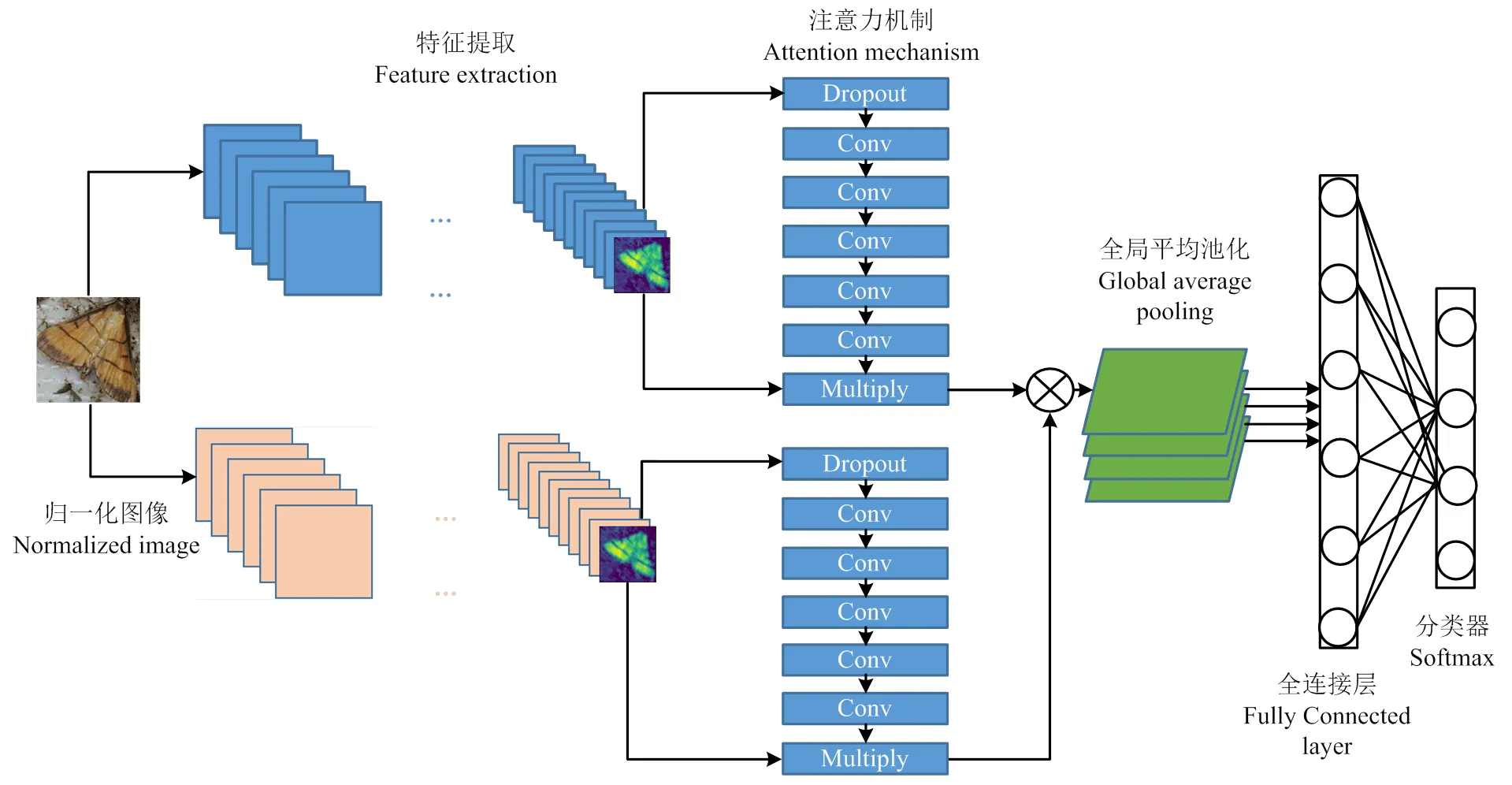

为了提高灯诱害虫细粒度图像识别精度,本文在Lin等[22]的BCNN基础上,添加注意力机制模块,建立基于双线性注意力网络的农业灯诱害虫识别模型(bilinear-attention pest net,BAPest-net),网络结构如图4所示。BAPest-net由双线性结构的特征提取层、注意力机制模块、全局平均池化和输出端的分类层组成。

1.3.2 特征提取网络 常见的特征提取网络有CaffeNet[28]、Googlenet[29]、ResNet[30]等。一般情况下,随着网络深度的增加,可提高特征的提取能力,但网络深度过深易导致梯度爆炸或者梯度消失,使神经元失活而无法提取特征[30]。ResNet网络的残差模块以跳层连接的形式将单元输入与输出加在一起后再通过激活函数来解决上述问题。本文选择ResNet50作为灯诱害虫的特征提取网络,输入部分以3×3和1×1的小卷积核为主,在每一层中,如果特征图的尺寸变化为原来的1/2,网络通过增加滤波器的数量来保持每层的信息量。但由于ResNet网络结构直接使用步长设置为2的1×1卷积进行下采样,使得输入特征图丢失3/4信息,本文将下采样位置延后,在大小为3×3的卷积核实现下采样(图5),步长为2。上下两个部分的特征提取网络均采用改进后的ResNet50网络。

(a)蝼蛄;(b)草地螟;(c)大黑鳃金龟;(d)玉米螟

图4 农业灯诱害虫细粒度图像识别网络结构图

图5 下采样延后的结构图

图6是ResNet50中下采样结构改变前后提取的稻纵卷叶螟特征图。很明显,图6-b比图6-a中包含更多的稻纵卷叶螟轮廓信息。

1.3.3 注意力机制 卷积神经网络从图像中提取了成千上万的特征,但存在一些冗余的特征。针对这个问题,Mmih等[31]提出了注意力机制,让网络更多关注于输入图像中有用信息,减少不相关的输入,通过自适应选择区域或位置的序列提取信息。本文添加的注意力机制模块有两个分支,一个由正则化方法Dropout[32]与5个级联的1×1的卷积层组成,在网络前向传播的过程中,让某个神经元以一定的概率失活,可以使得网络不会依赖某些局部的特征而使得模型的泛化能力更强;另一个是将特征图直接输入到分支终端,将两个分支在终端进行相乘处理。最后,将双线性结构中的上下两个注意力机制的输出进行外积运算,再由全局平均池化后进入到分类模块进行预测。

本文通过添加注意力机制模块,对信息量较多的区域自适应提取信息,结合双线性结构做外积运算,使网络更加注重信息较多的区域进行特征提取,以提高识别率。

1.3.4 模型的训练 利用迁移学习方法,使用预训练模型。模型训练参数设定:优化器采用随机梯下降法SGD(stochastic gradident descent),rate(学习率)设置为0.005,衰减策略设置为multistep,gamma设置为0.1,冲量为0.9,权重衰减率为0.0005,训练代数epoch为300,图像输入尺寸为224×224,损失函数采用交叉熵损失函数。

1.4 结果评价方法

为了验证本文提出的BAPest-net模型对相似灯诱害虫识别的有效性,在相同的训练集上训练VGG19、Densenet、ResNet50、BCNN和BAPest-net 5个模型,并在同一个测试集上测试。

利用害虫平均识别率和精确率-召回率(precision- recall,PR)曲线对5种识别模型进行评价,见公式1—3。

式中,精准率(precision)表示识别为某种灯诱害虫中被正确识别的比例。召回率(recall)表示某种灯诱害虫被正确识别的数量占该种害虫总量的比例;表示害虫正确识别的数量,表示错误识别为某种害虫的数量,表示为某种害虫错误识别为其他种类害虫的数量。表示灯诱害虫的种类,R表示测试集中每一种害虫的召回率。

P-R曲线是以召回率(recall)为横坐标和精准率(precision)为纵坐标绘制出来的曲线。

1.5 模型训练环境

所有模型的训练和测试均在操作系统为Ubuntu 20.04,CPU型号为Intel(R) Core(TM) i7-9800X CPU @ 3.80GHz,GPU为GeForce RTX 2070,显存大小为8G的台式电脑上完成。

2 结果

VGG19、Densenet、ResNet50、BCNN和BAPest-net 5个模型对6类相似的19种灯诱害虫的识别结果见图7—9和表2。

图7给出了5个模型在同一个测试集上测试的PR曲线。从图中可以看出,在相同召回率的情况下,BAPest-net模型的精准率高于其他4个模型,BCNN次之,VGG19效果最差。

表2给出了5种模型对19种害虫的平均识别率。5个模型平均识别率从高到低依次为:BAPest-net、BCNN、Densenet、ResNet50和VGG19。BAPest-net对19种相似灯诱害虫平均识别率达94.9%,VGG19模型仅为82.1%。

表3给出了BAPest-net对6类害虫识别的平均识别率。从表中可以看出,C—F类鳞翅目害虫识别率均超过了95.0%,B类中直翅目的2种害虫和半翅目的黄足猎蝽平均识别率为89.5%。

图8给出5种模型对每种害虫识别的精准率。从图中可以看出,VGG19、Densenet、ResNet50和BCNN对铜绿丽金龟、灰胸突鳃金龟、大黑鳃金龟、黄足猎蝽、大螟这几种害虫识别结果较差,最低精准率分别为73.3%、69.13%、15.8%、34.9%、68.1%,而BAPest-net对它们的精准率分别为97.0%、93.0%、83.0%、73.6%、100.0%。

图7 5个模型在19种害虫上的precision-recall曲线图

A1-铜绿丽金龟Anomala corpulenta;A2-灰胸突鳃金龟Hoplosternu incanus;A3-大黑鳃金龟Holotrichia oblita;B1-蝼蛄Gryllotalpa spps;B2-中华蟋蟀Gryllus chinensis;B3-黄足猎蝽Sirthenea flavipes;C1-榆黄足毒蛾Ivela ochropoda;C2-杨雪毒蛾Stilprotia salicis;D1-槐尺蛾Semiothisa cinerearia;D2-格庶尺蛾Semiothisa hebesata;E1-棉铃虫Helicoverpa armigera;E2-烟青虫Heliothis assulta;E3-劳氏粘虫Leucania loreyi;F1-二化螟Chilo suppressalis;F2-草地螟Loxostege stieticatis;F3-金黄镰翅野螟Circobotys aurealis;F4-稻纵卷叶螟Cnaphalocrocis medinalis;F5-玉米螟Pyrausta nubilalis;F6-大螟Sesamia inferens

表2 5个模型的19种灯诱害虫平均识别率

表3 BAPest-net对6类农业灯诱害虫的识别结果

利用yolov4模型对图1中的4幅灯诱害虫进行检测,存在一些害虫的误检,再经过BAPest-net模型得到灯诱害虫识别结果(图9)。在图9-a中正确识别出1只黄足猎蝽、1只中华蟋蟀、2只稻纵卷叶螟;在图9-b中正确识别出1只槐尺蛾、2个棉铃虫;在图9-c中正确识别出了1只铜绿丽金龟、1只杨雪毒蛾。前3幅图模型识别结果与人工识别结果相同。在图9-d中正确识别38只二化螟。由于该图存在虫量较多、背景复杂,部分害虫堆积严重造成遮挡现象,造成yolov4模型漏检了1只二化螟。

利用BAPest-net模型测试中,仍存在少数相似度较高的害虫误判,图10展示了3种害虫被误判成其他相似种类害虫。图10-a的铜绿丽金龟被误判为图10-b的大黑鳃金龟,这两种害虫在体型上非常相似,虽然大黑鳃金龟通体黑色,铜绿丽金龟背部呈铜绿色,但在灯诱害虫图像上铜绿色不明显,易被误判为大黑鳃金龟。图10-c的黄足猎蝽被误判为图10-d蝼蛄,虽然这两种害虫属于不同目,存在较大差异,但当他们腹部朝上时,视觉差异较小,难以区分。图10-e杨雪毒蛾被误判为图10-f榆黄足毒蛾,两种害虫在颜色与外形上极为相似,不同的地方是杨雪毒蛾足呈黑色而榆黄足毒蛾足呈黄色,当他们侧身,足的差异难以呈现在图像上,导致误判。

对于区分度较低的相似害虫需要更多的训练样本以获取更多的特征,提高模型的识别率和泛化能力。

3 讨论

农业灯诱害虫图像存在种类繁多、图像背景复杂、虫体姿态多样、鳞片脱落等问题,造成不同种害虫在视觉上差异较小,而同一种害虫可能存在较大差异,准确识别这些害虫具有很大的挑战性。传统模式识别方法存在人工设计特征、模型鲁棒性弱和泛化能力差的问题,利用深度学习方法可以提高模型的识别准确率和模型的鲁棒性。利用经典的深度学习模型VGG19、Densenet和ResNet50在灯诱害虫识别上获得了较高的精准率,但对铜绿丽金龟、灰胸突鳃金龟、大黑鳃金龟、黄足猎蝽、大螟的精准率偏低,其最低精准率分别为73.3%、69.13%、15.8%、34.9%、68.1%。本文将它们看成细粒度图像识别任务,在Lin等[22]提出的双线性网络(BCNN)网络结构基础上,建立了基于双线性注意力网络的农业灯诱害虫细粒度图像识别模型(BAPest-net),模型采用改进后的ResNet50特征提取网络,提高了图像特征提取能力,通过添加注意力机制模块,对图像中信息量较多的害虫目标区域自适应提取特征。测试结果表明,BAPest-net对6类相似的19种农业灯诱害虫平均识别率达到94.9%,对虫体遮挡、颜色较深的大黑鳃金龟的精准率提高到83.0%;对背景较复杂、虫体黑褐色部分较多的黄足猎蝽精准率达到了73.6%;对姿态差异大的草地螟精准率提高到了93.7%。结果表明基于双线性注意力机制的BAPest-net模型可以有效地识别细粒度农业灯诱害虫图像。

本文仅对6类相似的19种农业灯诱害虫进行识别。实际上,灯诱害虫种类繁多,还有更多的非目标昆虫与这19种灯诱害虫相似。随着智能测报灯在田间更广泛的应用,将采集到更多的灯诱害虫图像,可以增加相似害虫识别种类,提高目标害虫识别率和模型的鲁棒性。

4 结论

为了提高智能虫情测报灯害虫测报的精准度,针对农业灯诱害虫图像检测结果中存在较多误检且6类相似的19种害虫,本文提出了基于双线性注意力网络的农业灯诱害虫细粒度图像识别模型(BAPest-net)。BAPest-net模型采用双线性网络结构,对特征提取网络ResNet50进行改进,将下采样延后,提取更多特征信息,经归一化后输入到注意力机制模块中,最后进入到softmax分类器中分类识别。与VGG19、Densenet、ResNet50和BCNN相比,测试结果表明BAPest-net模型在6类相似的19种灯诱害虫上获得了最高的平均识别率,为94.9%,大大提高了相似灯诱害虫测报的准确性。

[1] 张心雨. 低密度下评估稻飞虱智能识别系统的有效性[D]. 南京: 南京农业大学, 2016.

ZHANG X Y. Evaluate the effectiveness of automatic identification system at the low planthoppers density. Nanjing: Nanjing Agricultural University, 2016. (in Chinese)

[2] 林培炯, 张智, 王旭龙, 刘冬雪, 胡高, 张云慧. 2019年北京市延庆区草地贪夜蛾种群动态与虫源分析. 植物保护学报, 2020, 47(4): 758-769.

LIN P J, ZHANG Z, WANG X L, LIU D X, HU G, ZHANG Y H. Population dynamic and trajectory simulation of migratory moths of fall armywormin Yangqing of Beijing in 2019. Journal of Plant Protection, 2020, 47(4): 758-769. (in Chinese)

[3] 王祥会, 焦玉霞, 王圣楠, 孙玉涛, 王宏梅, 孔德生. 祥辰智能虫情测报灯在大田害虫监测预报中的应用研究. 基层农技推广, 2020, 8(8): 43-45.

WANG X H, JIAO Y X, WANG S N, SUN Y T, WANG H M, KONG D S. Application of Xiangchen intelligent pest situation forecasting lamp in field pest monitoring and forecasting. Grassroots Agricultural Technology Extension, 2020, 8(8): 43-45. (in Chinese)

[4] YAO Q, FENG J, TANG J, XU W G, ZHU X H, YANG B J, LV J, XIE Y Z, YAO B, WU S Z, KUAI N Y, WANG L J. Development of an automatic monitoring system for rice light-trap pests based on machine vision.Journal of Integrative Agriculture, 2020, 19(10): 2500-2513.

[5] EBRAHIMI M A, KHOSHTAGHAZA M H, MINAEI S, JAMSHIDI B. Vision-based pest detection based on SVM classification method. Computers and Electronics in Agriculture, 2017, 137: 52-58.

[6] XIAO D Q, FENG J Z, LIN T Y, PANG C H, YE Y W. Classification and recognition scheme for vegetable pests based on the BOF-SVM model. International Journal of Agricultural and Biological Engineering, 2018, 11(3): 190-196.

[7] DENG L M, WANG Y J, HAN Z Z, YU R S. Research on insect pest image detection and recognition based on bio-inspired methods. Biosystems Engineering, 2018, 169: 139-148.

[8] ZHAO J, CHENG X P. Field pest identification by an improved Gabor texture segmentation scheme. New Zealand Journal of Agricultural Research, 2007, 50(5): 719-723.

[9] 佘颢, 吴伶, 单鲁泉. 基于SSD网络模型改进的水稻害虫识别方法. 郑州大学学报(理学版), 2020, 52(3): 49-54.

SHE H, WU L, SHAN L Q. Improved rice pest recognition based on SSD network model. Journal of Zhengzhou University (Natural Science Edition), 2020, 52(3): 49-54. (in Chinese)

[10] 钱蓉, 孔娟娟, 朱静波, 张萌, 董伟. 基于VGG-16卷积神经网络的水稻害虫智能识别研究. 安徽农业科学, 2020, 48(5): 235-238.

QIAN R, KONG J J, ZHU J B, ZHANG M, DONG W. Research on intelligent identification of rice pests based on VGG-16 convolutional neural network.Journal of Anhui Agricultural Sciences, 2020, 48(5): 235-238. (in Chinese)

[11] 梁万杰, 曹宏鑫. 基于卷积神经网络的水稻虫害识别. 江苏农业科学, 2017, 45(20): 241-243, 253.

LIANG W J, CAO H X. Rice pest identification based on convolutional neural network. Jiangsu Agricultural Sciences, 2017, 45(20): 241-243, 253. (in Chinese)

[12] ALFARISY A A, CHEN Q, Guo M. Deep learning based classificationforpaddy pests & diseases recognition. Proceedings of 2018 International Conference on Mathematics and Artificial Intelligence.Chengdu, 2018: 21-25.

[13] 邵泽中, 姚青, 唐健, 李罕琼, 杨保军, 吕军, 陈轶. 面向移动终端的农业害虫图像智能识别系统的研究与开发. 中国农业科学, 2020, 53(16): 3257-3268.

SHAO Z Z, YAO Q, TANG J, LI H Q, YANG B J, LÜ J, CHEN Y. Research and development of the intelligent identification system of agricultural pests for mobile terminals. Scientia Agricultura Sinica, 2020, 53(16): 3257-3268. (in Chinese)

[14] 姚青, 吴叔珍, 蒯乃阳, 杨保军, 唐健, 冯晋, 朱旭华, 朱先敏. 基于改进CornerNet的水稻灯诱飞虱自动检测方法构建与验证. 农业工程学报, 2021, 37(7): 183-189.

YAO Q, WU S Z, KUAI N Y, YANG B J, TANG J, FENG J, ZHU X H, ZHUX M. Construction and verification of automatic detection method for rice planthoppers on light-trap insect images based on improved ConerNet. Transactions of the Chinese Society of Agricultural Engineering, 2021, 37(7): 183-189.

[15] CHENG X, ZHANG Y H, CHEN Y Q, WU Y Z, YUE Y. Pest identification via deep residual learning in complex background. Computers and Electronics in Agriculture, 2017, 141: 351-356.

[16] SUN Y, LIU X X, YUAN M S, REN L L, WANG J X, CHEN Z B. Automatic in-trap pest detection using deep learning for pheromone- basedmonitoring. Biosystems Engineering, 2018, 176: 140-150.

[17] SHEN Y F, ZHOU H L, LI J T, JIAN F J, JAYAS D S. Detection of stored-grain insects using deep learning. Computers and Electronics in Agriculture, 2018, 145: 319-325.

[18] NAQVI S D Y, HAILE A, RAO S, TEWElDEMEDHIN B, SHARMA V, NYENDE A B. Evaluation of husbandry, insect pests, diseases and management practices of vegetables cultivated in Zoba Anseba, Eritrea. Journal of Eco-friendly Agriculture, 2017, 12(1): 47-50.

[19] FERENTINOS K P. Deep learning models for plant disease detection and diagnosis. Computers and Electronics in Agriculture, 2018, 145: 311-318.

[20] LIU L, WANG R, XIE C, YANG P, WANG F, SUDIRMAN S, LIU W. PestNet: An end-to-end deep learning approach for large-scale multi-class pest detection and classification.IEEE Access, 2019, 7: 45301-45312.

[21] 孔建磊, 金学波, 陶治, 王小艺, 林森. 基于多流高斯概率融合网络的病虫害细粒度识别. 农业工程学报, 2020, 36(13): 148-157.

KONG J L, JIN X B, TAO Z, WANG X Y, LIN S. Fine-grained recognition of pests and diseases based on multi-stream Gaussian probability fusion network. Transactions of the Chinese Society of Agricultural Engineering, 2020, 36(13): 148-157. (in Chinese)

[22] LIN T Y, ROYCHOWDHURY A, MAJI S. Bilinear cnn models for fine-grained visual recognition. Proceedings of the IEEE International Conference on Computer Vision.CentroParque Convention Center in Santiago, Chile, 2015: 1449-1457.

[23] 蓝洁, 周欣, 何小海, 滕奇志, 卿粼波. 基于跨层精简双线性网络的细粒度鸟类识别. 科学技术与工程, 2019, 19(36): 240-246.

LAN J, ZHOU X, HE X H, TENG Q Z, QING L B. Fine-grained bird recognition based on cross-layer compact bilinear network. Science Technology and Engineering, 2019, 19(36): 240-246. (in Chinese)

[24] 冀中, 赵可心, 张锁平, 李明兵. 基于空间变换双线性网络的细粒度鱼类图像分类. 天津大学学报: 自然科学与工程技术版, 2019, 52(5): 475-482.

JI Z, ZHAO K X, ZHANG S P, LI M B. Fine-grained fish image classification based on a bilinear network with spatial transformation. Journal of Tianjin University: Natural Science and Engineering Technology Edition, 2019, 52(5): 475-482. (in Chinese)

[25] 刘虎, 周野, 袁家斌. 基于多尺度双线性卷积神经网络的多角度下车型精细识别. 计算机应用, 2019, 39(8): 2402-2407.

LIU H, ZHOU Y, YUAN J B. Fine-grained vehicle recognition under multiple angles based on multi-scale bilinear convolutional neural network. Journal of Computer Applications, 2019, 39(8): 2402-2407. (in Chinese)

[26] KRIZHEVSKY A, SUTSKEVER I, HINTON G E. Imagenet classification with deep convolutional neural networks. Advances in Neural Information Processing Systems, 2012, 25: 1097-1105.

[27] ZHU Q, ZHENG H F, WANG Y B, CAO Y G, GUO S X. Study on the evaluation method of sound phase cloud maps based on an improved YOLOv4 algorithm. Sensors, 2020, 20(15): 4313-4330.

[28] HOU J, SU H Y, YAN B, ZAHNG H, SUN Z, CAI X. Classification of tongue color based on CNN.IEEE 2nd International Conference on Big Data Analysis. Beijing, 2017: 725-729 .

[29] SZEGEDY C, LIU W, JIA Y, SERMANET P, REED S, ANGUELOV D, ERHAN D, VANHOUCKE V, RABINOVICH A. Going deeper with convolutions. Proceeding of the IEEE Conference on Computer Vision and Pattern Recognition. Hynes Convention Center, Boston, 2015: 1-9.

[30] HE K M, ZHANG X, REN S Q, SUN J. Deep residual learning for image recognition. Proceeding of the IEEE Conference on Computer Vision and Pattern RecognitionLas Vegas, 2016: 770-778.

[31] MMIH V, HEESS N, GRAVES A. Recurrent models of visual attention. Advances in Neural Information Processing Systems. Palais des Congres de Montreal, Montreal Canada, 2014: 2204-2212.

[32] SRIVASTAVA N, HINTON G, KRIZHEVSKY A, SUTSKEVER I, SALAKHUTDINOV R. Dropout: a simple way to prevent neural networks from overfitting. The Journal of Machine Learning Research, 2014, 15(1): 1929-1958.

Research on Fine-Grained Image Recognition of Agricultural Light- Trap Pests Based on Bilinear Attention Network

1School of Information Science and Technology, Zhejiang Sci-Tech University, Hangzhou 310018;2Rice Technology Research and Development Center, China National Rice Research Institute, Hangzhou 311401;3Zhejiang Top Cloud-Agri Technology Co., Ltd., Hangzhou 310015

【】Some agricultural pests trapped by the intelligent light traps show the intraspecies difference and interspecies similarity due to a variety of pest species, different pest poses and scale missing. To improve the identification rate of agricultural light-trap pests, a fine-grained image identification model of agricultural light-trap pests based on bilinear attention network (BAPest-net) was proposed to identify 19 pest species which were easily misjudged by yolov4 model.【】Firstly, according to the appearance similarity and false detection results, 19 light-trap pest species were divided into 6 similar classes. All the pest images were processed to be equal in length and width through the edge-filling operation. Then, they were scaled to a uniform size of 224×224 pixels. In order to improve the robustness and generalization ability of model, the pest images were enhanced by mirror and flipping, rotation by 180 degrees, Gaussian noise, and mean filtering. The proportions of training set, validation set, and test set in samples are 80%, 10% and 10% respectively. An agricultural light-trap pest identification model based on bilinear attention network (bilinear-attention pest net, BAPest-net) was developed to identify 19 pest species belong to 6 similar pest classes. The BAPest-net model consisted of three modules, which were a feature extraction module, an attention mechanism module and an identification module. The down-sampling step in the feature extraction module was post-handled to extract more features. The attention mechanism model could make the model focus on the local features, which could increase the identification rate and learning efficiency. The model optimizer used the stochastic gradient descent method, and the global average pooling was used in the classification module to avoid overfitting from the structure of the entire network. Finally, the five models, including VGG19, Densenet, ResNet50, bilinear model and BAPest-net, were training on the same training set and were used to test 19 light-trap pests in the 6 similar pest classes. Precision, Precision-Recall curve and average identification rate were used to evaluate the identification effects of different models on similar light-trap pests.【】 In five models, the BAPest-net model had the highest average identification rate of 94.9% on 19 light-trap pests in 6 similar pest classes. The bilinear model gained the second high identification rate of 90.2% and the VGG19 model had only the lowest identification rate of 82.1%. The average identification rates ofpests in four pest categories were greater than 95.0%. 【】The fine-grained image identification model of agricultural light-trap pests based on bilinear attention network could automatically identify 19 agricultural light-trap pests in 6 similar pest classes and improve the automatic identification accuracy of agricultural light-trap pests.

agricultural light-trap pest; pest identification; fine-grained image; bilinear; attention mechanism

10.3864/j.issn.0578-1752.2021.21.007

2020-12-21;

2021-03-03

国家“863”计划(2013AA102402)、浙江省公益性项目(LGN18C140007)、浙江省自然科学基金(LY20C140008)

姚青,E-mail:q-yao@126.com。通信作者唐健,E-mail:tangjian@caas.cn

(责任编辑 杨鑫浩)