适应性增强胶囊网络的古壁画朝代识别算法

曹建芳,闫敏敏,田晓东,贾一鸣,靳梦燕

适应性增强胶囊网络的古壁画朝代识别算法

曹建芳1,2,闫敏敏1,田晓东1,贾一鸣1,靳梦燕1

(1. 太原科技大学计算机科学与技术学院,山西 太原 030024;2.忻州师范学院计算机系,山西 忻州 034000)

针对壁画图像自身存在多义性、不同朝代的壁画绘画风格存在差异性和传统的人工直接参考壁画文本或历史文献识别壁画朝代存在费时、费力等问题,提出了适应性增强胶囊网络(AEC)的古壁画朝代识别算法,对莫高窟壁画自动进行朝代识别。在原生胶囊网络基础上,首先引入预先卷积结构对壁画图像进行高层特征提取;其次增加均层激活增强模型的拟合性能;最后对胶囊网络进行适应性增强,在提高梯度平滑度的基础上利用自适应学习率进行优化提高模型的分类精度。实验结果表明在所构造的DH1926壁画数据集上,AEC模型准确率为84.44%、平均精确度(MAP)为82.36%、平均召回率(MAR)为83.75%、综合评价指标为83.96%。与改进的卷积神经网络(CNN)和原生胶囊网络等其他网络结构相比,各项评价指标均有3%以上的提升,有较强的拟合性能,能够多层次提取壁画的丰富特征,表达图像更细节的语义信息,在莫高窟壁画朝代识别中具有更高的准确度和更好的鲁棒性,有一定的应用价值与研究意义。

预先卷积;均层激活;适应性增强;胶囊网络;壁画朝代分类

壁画由人工使用颜料直接绘制于墙壁,因其文化价值成为了人类最珍贵的文化遗产。莫高窟中有大量朝代特征鲜明的壁画石窟,在时间轴上发展和延续了多个朝代,各个朝代的壁画在人物形象、色彩和绘画特点等方面均具有时代特色。如何对这些丰富的壁画进行深入地研究,最关键的步骤就是识别壁画图像所属朝代。

从传统的中国国画分类[1-3]到后来的具有其独有特点的壁画图像,数字化技术已被大量应用于传统艺术作品的研究。现有对壁画根进行自动分类的方法大多是基于传统的计算机视觉的方法。为了更好地对壁画图像进行检索和分类,王琦和鲁东明[4]为了解决内部类不同和噪音的问题,对古代壁画构图进行分类和特点探究,提出了一种基于壁画的内容相关性模型用于检索壁画图像的语义信息和整合古代壁画的构图和语义;唐大伟等[5]采用多实例分组的分类方法,通过对样本空间的划分和各子空间的训练,对壁画的风格进行有效分类;唐大伟等[6]通过对壁画本身的特点和轮廓特征进行研究,整合壁画轮廓整体间的结构关系,提出一种相似性度量方法,该方法与其他未整合壁画整体结构的约束方法相比,有更高的分类精度。上述方法均属于传统的壁画分类方法,虽取得了一定的分类效果,但是由于壁画图像自身所存在的图像主观性和多元性的特点,该类方法只能提取壁画的低级特征,对于壁画的纹理和颜色等高级特征提取不充分。

近年来,深度学习在壁画朝代分类领域有了一些探索[7-8]。文献[7]选定了同一飞天主题下的660幅壁画图像,与本文的多种主题相比较,存在一定的分类局限性。文献[7]与[8]的方法均使用卷积神经网络(convolutional neural network,CNN)对壁画图像进行分类,在针对壁画图像中某些特定实体(人物、建筑等)的各种特征时,CNN并不能很好地提取色调、纹理等其他类别特征且需要大量的训练数据。

相对于CNN存在的不足,胶囊网络(CapsNet)可以很好地根据在壁画图像中提取到的特征信息进行特征检测与理解。胶囊网络是深度学习之父SABOUR等[9]提出的,其特点是能够加强对图像的理解,增强了对图像的色彩、纹路以及其他高维特征的表征力,能够将图像内容中的元素特征与元素之间的空间联系起来,进行图像内容的检测与识别,已在高光谱图像[10]、细粒度图像[11]、Fashion-MNIST和CIFAR-10数据集[12]与医学图像的识别与分类[13]中取得了一定的成果。上述研究表明,胶囊网络可以针对壁画图像文本存在的多元性、主观单一性、多义性、纹理复杂等特点对壁画图像进行分类。胶囊网络中的胶囊包含丰富的特征信息,胶囊之间的动态路由可以动态地对图像中的语义信息进行学习,并能在整个网络的训练过程中将语义信息进行保留,并有效捕捉图像中的纹理特征、色彩梯度变化与克服光照不均匀的问题。对壁画图像的色彩、纹理以及艺术形象等特征在特征胶囊层进行拟合,最终确定壁画图像的朝代并进行分类。所以适用于壁画图像的特征提取。

由于原生胶囊网络的第一部分为单层卷积层,结构简单,不能对于色彩与纹理复杂的壁画图像进行充分的特征提取,导致分类效果不理想,因此本文提出一种适应性增强胶囊网络模型(adaptive enhancement capsule network,AEC)。基于胶囊网络的基本框架,在单一的卷积层基础之上增加2个相连的卷积层对图像进行基本特征提取;对增加的卷积层进行均层激活防止模型出现过拟合现象,并对模型进行适应性增强以提高最终的分类精度,从而在壁画数据集较少的基础上能够深度提取到壁画图像的色彩、纹理和绘画风格等细节特征,提高网络对壁画图像的朝代识别准确率与模型的鲁棒性。

1 相关理论

胶囊网络克服CNN在提取图像特征时只考虑图像像素的特点,充分考虑到图像内元素的空间关系。卷积层、主胶囊层和数字胶囊层构成其主要网络结构,是网络的主要特征提取部分,实现从图像低维特征到高维特征的匹配与映射。胶囊由神经元组成,而图像中的纹理、颜色等特征属性被包含在神经元中,每个胶囊都能通过神经元中的某个实体的部分属性预测整个实体的全局特征。将提取到的图像高维特征进行参数实例化,再由胶囊作为输出输入到下一个胶囊中。整个胶囊运算过程中,低层胶囊将提取到的部分图像特征传输给高层胶囊后进行整体识别。动态路由算法是胶囊网络的胶囊之间进行特征信息映射的关键。

在胶囊中,内部主要将输入的特征向量与矩阵进行乘法运算,再通过加权求和,实现特征向量的加权之和与向量之间非线性变换进行信息传播与交流。胶囊网络的算法如图1所示。

图1 胶囊网络算法结构图

图1中,为参数更新中的反向传播运算,为对标量进行加权求和运算。胶囊接收输入的特征向量,这些特征向量中包含来自低层胶囊中所提取到的图像的基本特征并进行了编码,可以识别到图像某一部分的特征。其中低层胶囊与高层胶囊之间的特征映射关系被编码在权重矩阵中,将特征向量与对应的权重矩阵进行相乘。

为了将之前低层胶囊中的特征向量进行更好地融合,预测向量在输入高层胶囊前,对标量进行加权求和。胶囊内向量之间的非线性变换主要是将输出矢量通过归一化操作对每个输出矢量进行长度归一化,将每个适量的长度规定在0和1之间,在不影响向量方向的同时对其大小进行压缩。归一化的数学式为

在得到最终的输出向量之后,通过胶囊间动态路由算法对权重进行更新。具体操作过程为:输出向量与预测向量进行相乘后与原始权重进行相加,即

其中,将输出向量与预测向量进行相乘是为了判断输入与输出之间的相似性。

胶囊网络与CNN相比,其特有的胶囊特性与动态路由算法使得整个网络模型都使用标量进行输入和输出,在参数更新时进行反向传播,能更好地理解图像,对图像的特征表达能力更强,且通过少量的数据就能学习到图像的高维特征,从而反映图像的状态特征。

胶囊网络对于医学图像以及手写数据集的分别和识别效果比较理想。但是由于壁画图像颜色更丰富,色彩梯度变化较为显著,纹理特征更加复杂,加上很多石窟的壁画图像在绘画内容和绘画文本上有极大的相似之处,直接使用原生胶囊网络,不能深度地提取壁画图像的丰富特征,会造成分类精度不高。因此,为了提高对敦煌不同石窟的壁画图像所属朝代的识别精度,对古代各个时期的壁画图像进行更好地检索、识别和分类,提出AEC模型。

2 适应性增强胶囊网络

2.1 整体结构

AEC的古代壁画图像朝代识别分类算法的整体模型结构如图2所示。

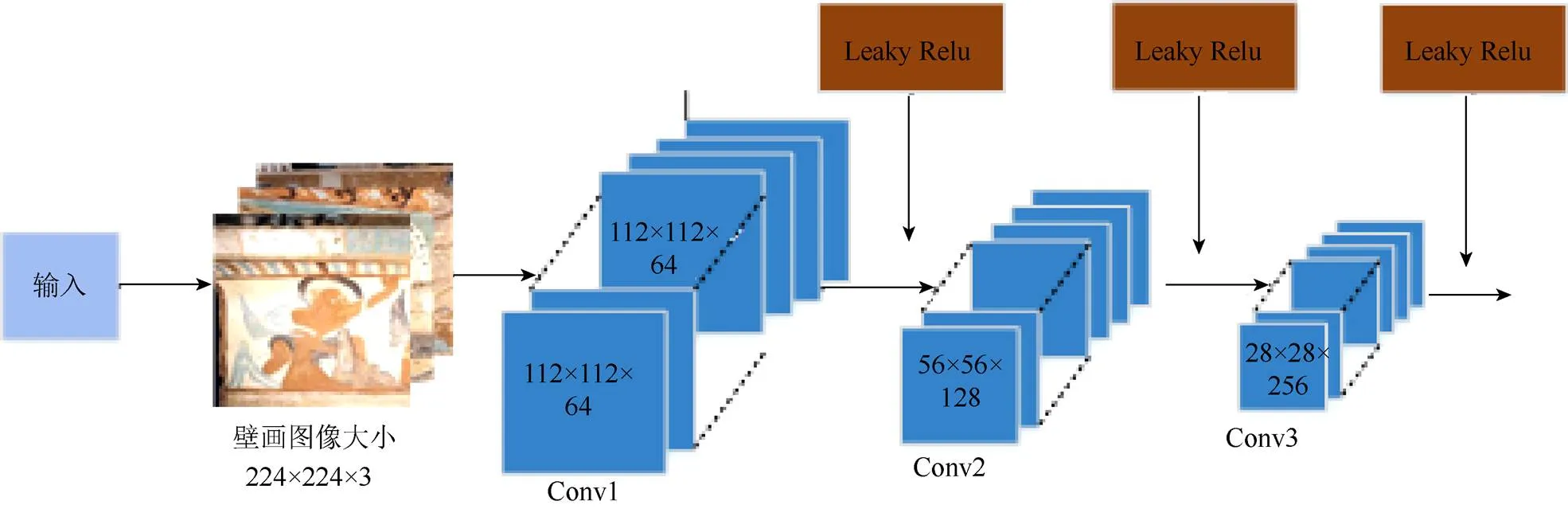

AEC首先经过3层卷积提取到输入图像的二维图像特征,然后传给特征胶囊层形成高维特征胶囊,之后再通过类别胶囊层的动态路由算法映射到最终的分类结果。

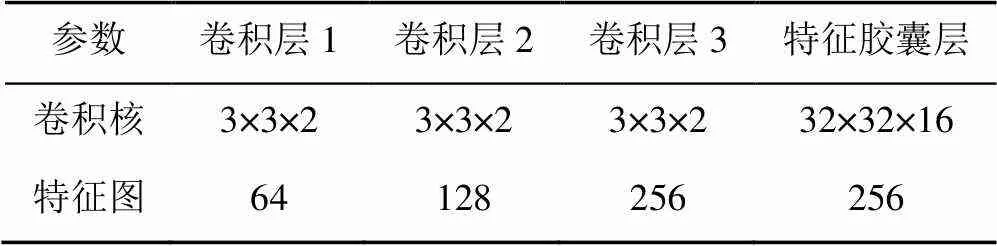

由图2可以看出,AEC主要有卷积层、特征胶囊层和类别胶囊层3部分组成。各网络层的参数设置见表1。

表1为适应性胶囊网络的各网络层参数设置详情。适应性胶囊网络的卷积层部分卷积核大小为3×3,步长为2。网络经过卷积生成64,128的特征图,再使用同样的移动提取操作输出层数为256的特征图,作为第2部分的特征胶囊层的输入。

特征胶囊层中,卷积层的大小为32×32,步长为16。特征胶囊层运算后的壁画图像底层特征信息输出为256层的特征图,按照每个胶囊特征图为32层平均分为长度8的胶囊块。

类别胶囊层中包含10个类别胶囊,最终向全连接层输出16维的特征向量,实现从特征胶囊层到类别胶囊层的映射关系。胶囊内部将输入的特征向量与权重矩阵相乘,对特征胶囊层和类别胶囊层所提取到的低层图像特征和高层图像特征之间的空间关系进行转化与编码。适应性胶囊网络中权重矩阵大小为32×6,浮点数为8×16。类别胶囊中向量的长度为置信度的高度。

图2 适应性增强胶囊网络的整体结构

表1 适应性增强胶囊网络网络层参数

2.2 改进之处

所提取到的图像特征间的关系被打包封装,并在胶囊内部进行传输,然后通过动态路由算法将其拟合,实现与分类标签之间的对应关系。故获取到壁画中丰富的特征信息和语义信息,防止出现语义鸿沟是胶囊网络在古代壁画朝代分类中使用的关键问题。

AEC可通过增加多个预先卷积层进行更深层次的特征提取,充分获取到壁画中丰富的特征信息和语义信息,然后对卷积层进行均层激活,避免在反向传播中出现梯度消失的问题,提高模型的拟合性能,并对原先胶囊网络的特征胶囊层参数进行改变,增强网络适应性,最后利用自适应优化算法对整个预卷积层的参数进行优化以提高模型的平滑度。

2.2.1 引入预先卷积层增强网络表达能力

原生胶囊网络的卷积部分仅仅使用一个卷积操作对图像的特征进行提取,对于具有复杂特征的224×224×3的古代壁画照片,一个卷积操作无法提取到可以反映目标特征的高层抽象特征,造成壁画朝代分类的效果不佳,因此需要更多的卷积层才能获取到壁画图像的色彩、绘画风格等丰富的细节特征,才能对壁画图像的语义特征进行更好地表达。因此,使用3个连续的卷积层替代原生胶囊网络的单层卷积层,实现壁画图像高层抽象特征提取。

AEC的均层激活结构部分由3个串联的卷积层组成,具体结构如图3所示。

选择大小为224×244×3的壁画图像作为AEC的输入。图2显示,壁画图像输入到3个串联的卷积层,并进行连续卷积操作。3个卷积层步长均为2、大小为3×3。先用64个卷积核进行壁画图像的底层基本特征提取,然后通过卷积层的运算对其进行卷积,作为后面特征胶囊层的特征分析。首先产生64层特征图,其大小为112×112,在卷积层之间引入Leaky Relu非线性函数激活卷积操作后的壁画图像特征图像,然后将特征传输到下一层。经过同样的卷积运算,将上一层生成的特征图转换为128层的特征图,大小为5 656。最后一层卷积层在经过2次激活后继续对特征图进行卷积操作,使用256个大小为3×3的卷积核对中间卷积层生成的128层的特征图进行移动卷积,最后生成256层的特征图并进行激活。

图3 均层激活结构

适应性增强的胶囊网络使用步长为2和3×3的3层连续步骤来执行预卷积和均匀层激活操作。通过连续卷积将224×244×3的壁画图像转化为二维图像特征,有利于胶囊层的特征分析和处理,从而更好地对提取的特征进行抽象分析,增强特征胶囊层特征胶囊对二维图像特征的表达。

2.2.2 采用卷积层均层激活提高拟合性能

为了避免预卷积部分的反向传播中梯度消失问题对壁画朝代分类结果的影响,需要使用合适的激活函数对向下传播的特征进行整理。为了使模型具有更好地拟合性能和收敛速度,需替换原始网络中的激活函数,并对增加的预先卷积网络中的每个卷积层进行激活。

适应性胶囊网络为了保留卷积层能多提取到有用的图像特征,添加了非线性激活函数对图像特征进行激活,去掉一些冗余的图像特征。Leaky Relu函数克服负值神经元沉默现象,在一定程度上加快模型收敛,防止梯度弥散。与Relu函数的差异不大,只当输入小于0的值时,Relu函数会发生趋于0的现象,而Leaky Relu激活函数会保留一些信息,且梯度不为0。Leaky Relu函数的数学表达式为

其中,Leaky Relu为激活函数的前向传播过程;leak为小数,取值0.1;为输入。

2.2.3 调整特征胶囊层参数改进网络适应性

将原始的胶囊网络直接应用于壁画图像处理,会影响最终的识别效果。考虑到输入图像尺寸与类别标签个数在改进之后的胶囊网络中需要进行一定的调整,为了使得网络的卷积核能够适用于壁画图像的特征提取,通过调整特征胶囊层和类别胶囊层中的各个参数对改进之后的网络进行了适应性增强操作。

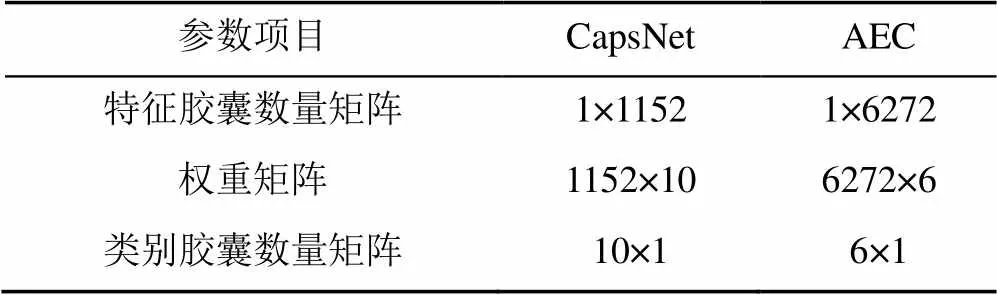

在特征胶囊层进行特征提取前,原始的胶囊网络利用一个卷积层将输入的图像通过卷积操作后生成大小为20×20的特征图,并作为特征胶囊层的输入,经过256个卷积核大小为9×9,步长为2的卷积核进行卷积操作之后,生成大小为6×6的特征图,并将其转化为1 152个胶囊。在原始胶囊网络基础上AEC,对输入特征图、卷积核大小等进行相应地调整。基于3层连续的卷积层,适应性胶囊网络将28×28的特征图作为特征胶囊层的输入,可输出50 176个单元。其中采用封装操作对特征图按照8×1的胶囊大小进行分组封装,最终封装为6 272个胶囊。参数进行适应性改进后,特征胶囊层能够表达壁画图像的丰富细节信息,参数适应性调整详情见表2。

表2 特征胶囊层参数适应性改进

在类别胶囊层中,胶囊之间与胶囊内部主要采用动态路由算法。该算法是通过路由用低层胶囊向高层胶囊进行特征向量传输。特征胶囊层参数的改进使得特征图的大小和数量发生改变,原有的类别胶囊层参数并不能直接将重建后的特征与真实特征进行相似度匹配,通过对类别胶囊层的参数进行适应性调整,网络具有更强的性能和特征表达能力。类别胶囊层中的参数改变情况见表3。

表3 类别胶囊层参数适应性改变

由表3可以看出,与胶囊网络相比,AEC分别对特征胶囊数量矩阵、权重矩阵和类别胶囊数量矩阵3个参数项目进行了改进。实验将壁画数据集分为6个类别,故将类别胶囊的数量进行了适应性调整,最终的实验结果证明上述调整在壁画图像的朝代识别中效果较佳。

2.2.4 利用自适应学习率算法提高梯度平滑度

为了适应不同的目标函数,整个网络采用自适应学习率的Adam算法。最终AEC在训练过程中梯度更加平滑,对所有参数进行优化。自适应学习率Adam算法基于适应性低阶矩,加快计算效率模型的收敛速度,对于噪声比较大的壁画图像来说,其可以降低噪声对特征提取的影响。

在整个网络训练过程中都使用自适应学习率和动量算法,学习率始终保持在固定的范围之内,参数变化比较平稳,避免出现梯度下降现象。与其他优化器相比较,该算法继承了AdaGrad算法在稀疏梯度上的优势和Rmspor算法在非稳态下的优势。模型和参数进行权重更新使得模型有更好的性能,而充分利用矩阵的一阶和二阶矩均值是更新的重要方法。

3 实验与讨论

3.1 软硬件环境

实验选用IntelCorei5-8250U1、60 GHz的处理器、NVIDIA Geforce MX150显卡以及16 GB内存。所用计算机的操作系统为Windows 10。实验将Python3.7作为网络编程语言,选择深度学习中的TensorFlow框架进行程序编写。使用Pycharm 3.5 x64编译器对语言进行编译。

3.2 数据集

3.2.1 壁 画

敦煌壁画在构图上不受时间、地点及自然环境等的限制,无论在色彩、装饰或纹理方面,与自然图像都存在本质上的差别。主要表现为:

(1) 壁画图像的纹理复杂。由于壁画图像绘制于墙壁,与普通的相机拍摄的自然图像相比较,壁画图像的纹理更加复杂;

(2) 壁画图像的色调存在一定的色彩梯度变化。壁画图像的颜料使用矿物质颜料,且色彩的面积较大,与自然图像相比,其色彩存在一定的主观意向性;

(3) 壁画自身的文本内容多元。敦煌壁画图像的绘画内容包括供养人、佛、菩萨、建筑等其他多元的艺术形象;

(4) 壁画图像自身存在的主观性和多义性。

其中不同朝代的壁画图像在色彩[14]、绘画风格、语义特征[15]等方面均有较大差异性。

3.2.2 数据集内容

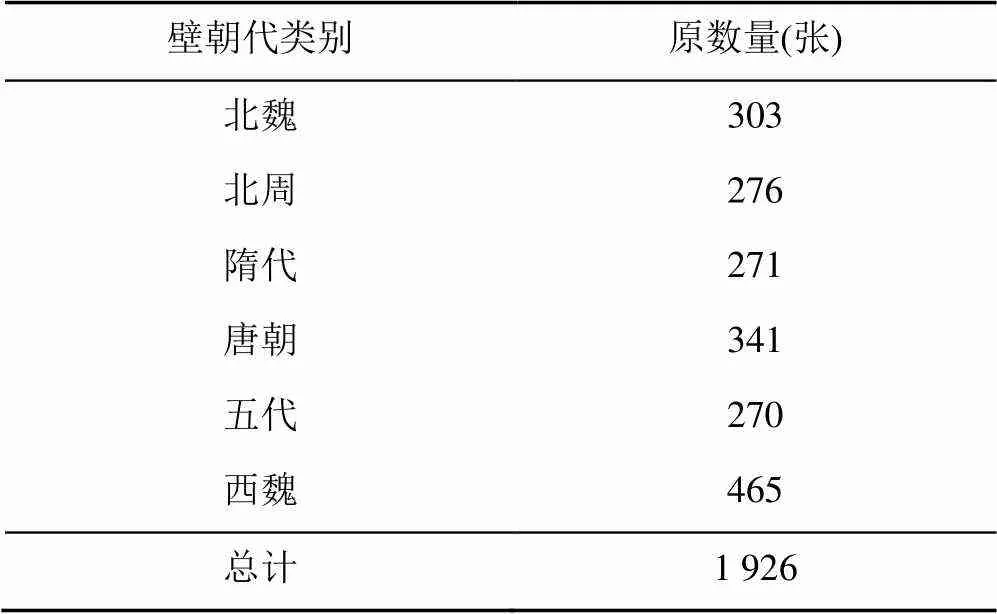

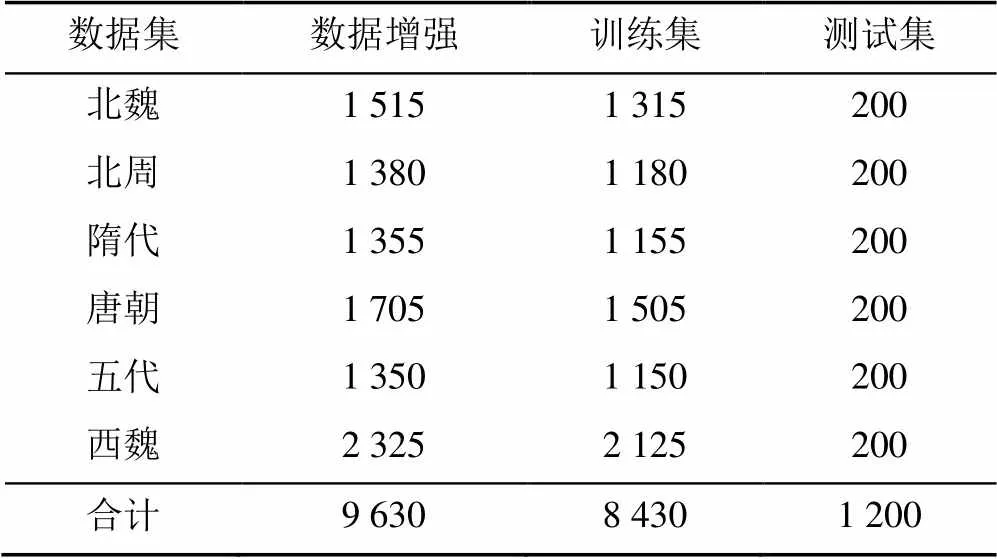

实验使用的敦煌壁画图像数据集(DH1926)均截图于《中国敦煌壁画全集》电子资源画册。根据画册中的各个壁画所标注的时代标签将所截取的所有壁画分为北魏、北周、隋代、唐朝、五代和西魏6个不同的时期,最终一共收集1 926张壁画图像数据,每个类别的图像数量分布见表4,各个时期的示例图像如图4所示。

表4 DH1926数据集的数据结构

由于壁画图像资源有限,为了防止图像资源较少导致没有训练到位或出现过拟合现象影响分类效果,本文实验通过归一化将图像修改为224×244像素大小,然后采用数据增强方式对原壁画图像进行处理,将壁画图像由1 926张拓展至9 630张。图5为数据增强处理后的部分图片。数据增强方式包括:提亮1.5倍、旋转90°加噪、旋转45°和90°加噪,其中每类选用200张壁画图像作为测试集,其他图像作为训练集。拓展后的各类别图像数量、训练集数量与测试集分布见表5。

图4 各个朝代示例图像

由表5可以看出,数据增强后的壁画图像共有9 630张。经过专家对数据集进行评审和将实验结果与原时代标签结果进行比对,验证了DH1926数据集在本文算法中的有效性。

3.3 实验验证

为了验证本文所提出的AEC有更好的识别和分类性能,分别在2个方面进行了对比实验。首先,在网络结构上,本文均使用DH1926敦煌壁画数据集,分别就不同的激活函数和优化函数进行实验;然后,分别在AEC,CapsNet,VGG16网络和LeNet-5网络上进行实验。将平均损失、准确率、平均精确率、召回率、平均召回率和综合评价指标F1作为评价指标,评估最终的实验结果与训练过程中模型的性能。

损失值指预测朝代类别标签与设定的朝代类别标签之间的距离,并计算平均损失值。

准确率是指正确识别的朝代标签数量占所有时代标签总数量的比重,代表模型的正确识别的标签的概率,即

其中,为带朝代标签的壁画数量总数;x为第个壁画图像样本;为第个壁画图像样本的预设朝代标签。

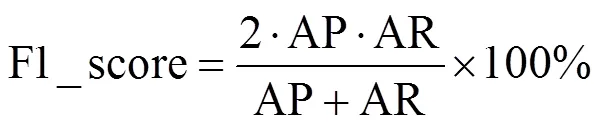

精确率(average precision, AP),指实际正样本在所召回的正样本中占的比值。召回率(average recall, AR),指被召回到类别的样本的数量与总样本数量的比值。F1值用于评价整个网络的综合性能,只有精确率与召回率均高时,F1值也相应增高,即

图5 数据增强部分图像

Fig. 5 Data enhancement part of the image

表5 数据集的内容(张)

3.3.1 不同激活函数的对比实验

激活函数可以影响整个实验过程中训练数据和模型的收敛速度,合适的激活函数可使网络表现出更好的性能。保持其他参数不变,选用Relu,Leaky Relu和Elu等3种激活函数分别进行实验,测试激活函数对损失值、准确率和其他综合评价指标的影响。实验结果对比情况如图6所示。

Loss在图6(a)中是训练中的损失值。在其他参数不变的情况下,Leaky Relu函数的Loss值在整个训练过程中较低。Elu函数Loss值最高,是线性单元函数,因为在计算时需要计算指数,导致其计算时间较长,且计算速度比其他2个函数慢。Relu函数是有信息丢失的情况,导致Loss高于Leaky Relu函数。这表明Leaky Relu函数能够克服其他2种函数的缺陷,减少信息的损失。从图6(b)中可知,Leaky Relu函数在各项指标中的值都较高,相较于其他函数,更适于在AEC中进行网络模型的参数优化。

表6中的数据说明Leaky Relu函数应用于AEC时能够获得较高的准确率,Relu函数与Elu函数的准确率相差不大。

图6 不同激活函数结果对比((a)不同激活函数的Loss结果;(b)不同激活函数评价指标对比)

表6 不同激活函数准确率对比(%)

3.3.2 不同优化器的对比实验

优化器可帮助模型进行参数更新,减少优化模型中的损失及在训练过程中的代价。本文实验选用常用的5种优化器,在激活函数为Leaky Relu的基础上,分别进行对比实验。不同优化算法对比结果如图7所示。

从图7(a)中可以看出,在训练次数相同时,5个优化函数的Loss值相对稳定,未见明显的波动。Adam函数的损失小于其他4个优化函数的损失。由于Adam函数是一种自适应学习率优化算法,用于目标函数的小批量梯度随机优化,其能保证训练中的学习率,确定在一个合适的范围,并且不会使学习在参数迭代中变短。其能更快地找到全局最优值,避免了学习速率衰减和模型振荡的现象,是因学习速率根据参数的变化方向自动调整的。

在图7(b)和(c)中,Adam函数的精度最高,且稳定在50步左右。综合评价指标值高于其他优化算法,在AEC模型的优化中性能更好。

图7 不同优化算法结果对比((a)不同优化函数的Loss变化;(b)不同优化函数的准确率Accuracy变化;(c)不同优化算法评价指标对比)

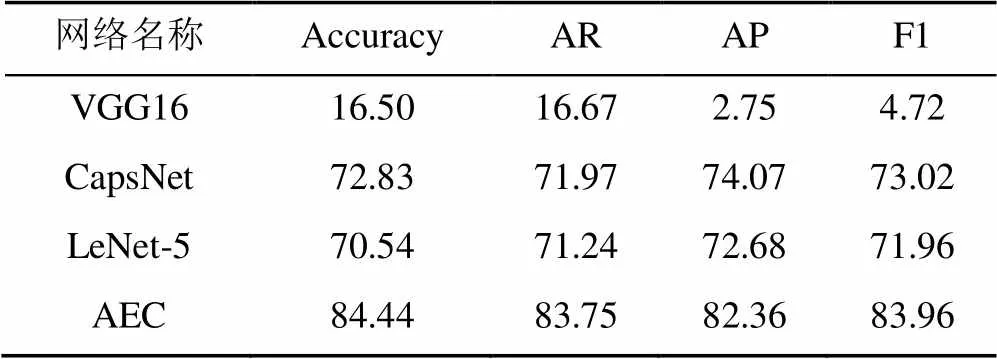

3.3.3 对整体结构的验证

为了证明适应性胶囊网络在壁画数据集上的有效性,实验将本文所构造的壁画数据集应用于VGG16模型[16],LeNet-5模型[17],CapsNet[10]与AEC等4种不同的网络结构,并训练至最优结果,对最终的识别准确率和其他综合评价指标进行对比分析(表7)。

表7 不同网络实验结果对比(%)

从表7中可以看出,AEC的准确率较VGG16,CapsNet和LeNet-5各提高了67.94%,11.61%和13.9%,主要是因为VGG16网络过拟合,CapsNet网络只有一层卷积层,对于复杂特征的壁画图像无法提取到更丰富的图像信息,而在召回率、F1值也均优于其他网络结构。本文的模型通过对原始的胶囊网络增加卷积层和激活函数操作,本文的网络模型能够对壁画图像提取到更高维的图像特征,在进行朝代识别时可以正确预测壁画图像的时代标签。

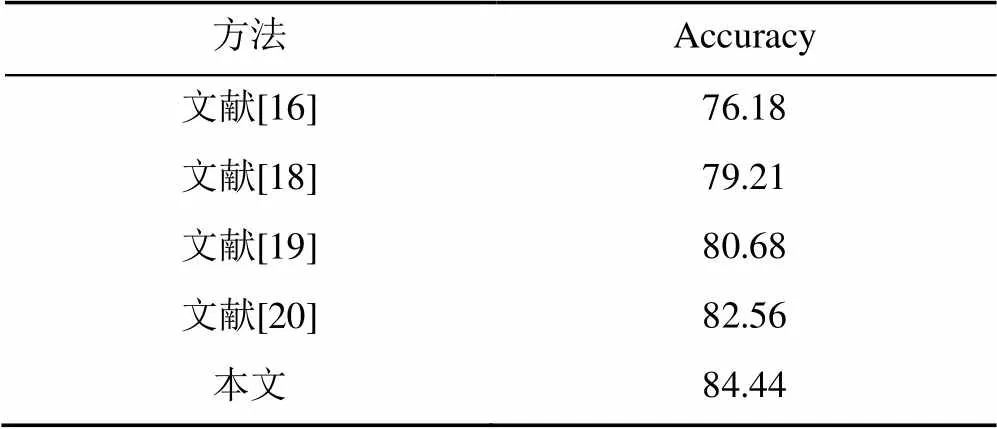

为了验证本文的AEC模型在古壁画朝代识别中的性能和有效性,将本文算法与改进的CNN模型和算法分别进行对比,其对比结果见表8。由表8可以看出,本文模型的最终识别准确率较高。

表8 不同算法的结果对比(%)

3.3.4 单类别结果分析

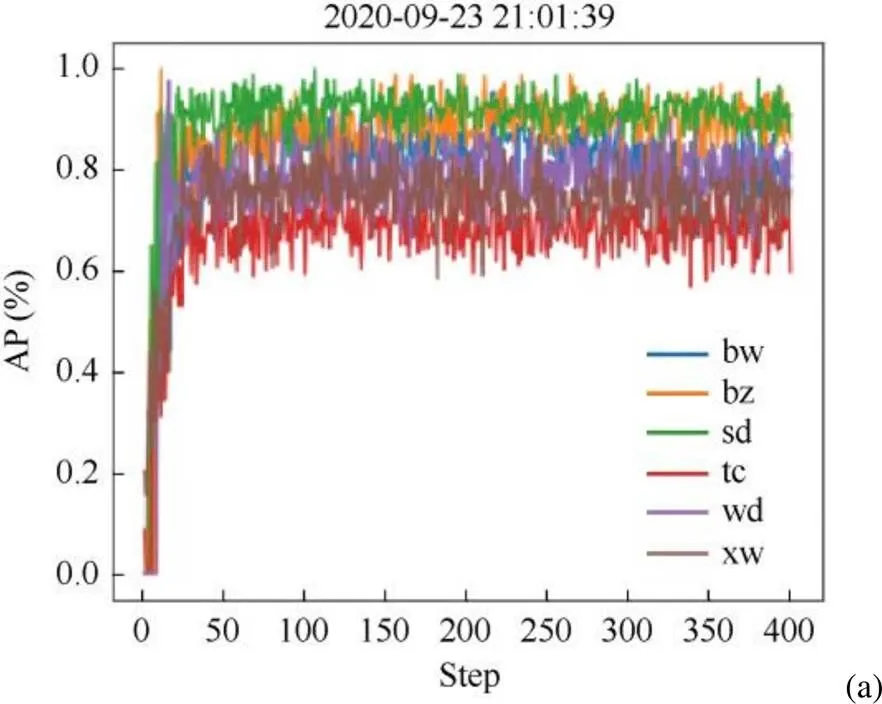

为了对本文算法进行进一步数据分析,实验将输出整个训练过程中每一类别的识别结果。实验过程中单类别各项指标对比情况如图8所示。

图8中,bw,bz,sd,tc,wd和xw分别代表北魏、北周、隋代、唐朝、五代、西魏6个朝代。从图中可以看出,在整个训练过程中,各个朝代类别的AP,AR和F1值在50次测试后准确率都处于较稳定的变化,未出现大幅度的波动现象,说明本文算法在整个实验过程中稳定性较强。

4 结束语

本文提出了一种用于莫高窟古代壁画朝代识别分类的AEC模型。模型使用胶囊网络的图像特征提取优势,针对古代壁画特征提取复杂的特点,增加多层卷积层进行预卷积处理,在对卷积层进行均层激活的基础上对原生胶囊网络的特征胶囊层参数进行适应性改进,使用自适应优化算法进行参数优化提高模型平滑度。对AEC的激活函数和优化方法进行实验验证,并就整体结构与其他改进算法进行对比,说明AEC在本文所构造的古代壁画图像数据集上的朝代识别效果比较好,具有一定的现实意义和实用价值。经过单类别结果分析后发现不同类别的测试结果波动效果不同,个别类别训练的收敛性并不好,对最终结果产生不良影响。下一步工作将进一步提高最终的分类精度且研究导致某些类别测试结果不稳定、训练效果不佳的原因及解决办法,以期提高总体模型的效果。

[1] GU LENG W J S. Painting semantic classification method based on image visual feature analysis[C]//2019 International Conference on Intelligent Transportation, Big Data & Smart City (ICITBS). New York: IEEE Press, 2019: 578-581.

[2] 周衍挺. 基于改进的卷积神经网络模型的中国绘画图像分类方法[J]. 佳木斯大学学报: 自然科学版, 2021, 39(1): 112-115.

ZHOU Y T. Reserch on Chinese painting image classification method based on improved convolutional neural network model[J]. Journal of Jiamusi University: Natural Science Edition, 2021, 39(1): 112-115 (in Chinese).

[3] LIONG S T, HUANG Y C, LI S M, et al. Automatic traditional Chinese painting classification: a benchmarking analysis[J]. Computational Intelligence, 2020, 36(3): 1183-1199.

[4] 王琦, 鲁东明. 基于构图分析的古代壁画相关度评价方法[J]. 浙江大学学报: 工学版, 2012, 46(3): 392-401.

WANG Q, LU D M. Composition analysis-based relevance ranking for ancient mural[J]. Journal of Zhejiang University: Engineering Science, 2012, 46(3): 392-401 (in Chinese).

[5] 唐大伟, 鲁东明, 许端清, 等. 壁画图像分类中的分组多实例学习方法[J]. 中国图象图形学报, 2014, 19(5): 708-715.

TANG D W, LU D M, XU D Q, et al. Clustered multiple instance learning for mural image classification[J]. Journal of Image and Graphics, 2014, 19(5): 708-715 (in Chinese).

[6] 唐大伟, 鲁东明, 杨冰, 等. 轮廓整体结构约束的壁画图像相似性度量[J]. 中国图象图形学报, 2013, 18(8): 968-975.

TANG D W, LU D M, YANG B, et al. Similarity metrics between mural images with constraints of the overall structure of contours[J]. Journal of Image and Graphics, 2013, 18(8): 968-975 (in Chinese).

[7] ZOU Q, CAO Y, LI Q Q, et al. Chronological classification of ancient paintings using appearance and shape features[J]. Pattern Recognition Letters, 2014, 49: 146-154.

[8] LI Q Q, ZOU Q, MA D, et al. Dating ancient paintings of Mogao Grottoes using deeply learnt visual codes[J]. Science China Information Sciences, 2018, 61(9): 1-14.

[9] SABOUR S, FROSST N, HINTON G E. Dynamic routing between capsules[C]//The 31st International Conference on Neural Information Processing Systems. New York: ACM Press, 2017: 3859-3869.

[10] LI H C, WANG W Y, PAN L, et al. Robust capsule network based on maximum correntropy criterion for hyperspectral image classification[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2020, 13: 738-751.

[11] 陶志勇, 李杰, 唐晓亮. 融合小波变换与胶囊网络的纹理图像分类算法[J]. 激光与光电子学进展, 2020, 57(24): 58-68.

TAO Z Y, LI J, TANG X L. Texture images classification algorithm combining wavelet transform and capsule network[J]. Laser & Optoelectronics Progress, 2020, 57(24): 58-68 (in Chinese).

[12] 李建桥, 贾晓芬, 赵佰亭. 多特征融合的胶囊网络用于图像分类[J]. 哈尔滨商业大学学报: 自然科学版, 2020, 36(6): 695-700.

LI J Q, JIA X F, ZHAO B T. Multi-feature fusion capsule network for image classification[J]. Journal of Harbin University of Commerce: Natural Sciences Edition, 2020, 36(6): 695-700 (in Chinese).

[13] ZHANG Z, YE S W, LIAO P, et al. Enhanced Capsule Network for Medical image classification[C]//The 42nd Annual International Conference of the IEEE Engineering in Medicine & Biology Society (EMBC). New York: IEEE Press, 2020: 1544-1547.

[14] 徐文思. 浅析不同朝代敦煌壁画的色彩表现特点[J]. 明日风尚, 2016(22): 197.

XU W S. A brief analysis of color expression characteristics of Dunhuang frescoes in different dynasties[J]. Fashion Tomorrow, 2016(22): 197 (in Chinese).

[15] 王晓光, 徐雷, 李纲. 敦煌壁画数字图像语义描述方法研究[J]. 中国图书馆学报, 2014, 40(1): 50-59.

WANG X G, XU L, LI G. Semantic description framework research on Dunhuang fresco digital images[J]. Journal of Library Science in China, 2014, 40(1): 50-59 (in Chinese).

[16] SIMONYAN K, ZISSERMAN A. Very deep convolutional net-works for large-scale image recognition[EB/OL]. (2015-04-10) [2021-04-16]. https://arxiv.org/pdf/1409.1556.pdf.

[17] 张荣梅, 张琦, 陈彬. 基于改进LeNet-5的车牌识别算法[J]. 科学技术与工程, 2020, 20(12): 4775-4779.

ZHANG R M, ZHANG Q, CHEN B. An improved license plate recognition algorithm based on LeNet-5 convolutional neural network[J]. Science Technology and Engineering, 2020, 20(12): 4775-4779 (in Chinese).

[18] 钟志权, 袁进, 唐晓颖. 基于卷积神经网络的左右眼识别[J]. 计算机研究与发展, 2018, 55(8): 1667-1673.

ZHONG Z Q, YUAN J, TANG X Y. Left-vs-right eye discrimination based on convolutional neural network[J]. Journal of Computer Research and Development, 2018, 55(8): 1667-1673 (in Chinese).

[19] 钱文华, 徐丹, 徐瑾, 等. 基于信息熵的风格绘画分类研究[J]. 图学学报, 2019, 40(6): 991-999.

QIAN W H, XU D, XU J, et al. Artistic paintings classification based on information entropy[J]. Journal of Graphics, 2019, 40(6): 991-999 (in Chinese).

[20] 高峰, 聂婕, 黄磊, 等. 基于表现手法的国画分类方法研究[J]. 计算机学报, 2017, 40(12): 2871-2882.

GAO F, NIE J, HUANG L, et al. Traditional Chinese painting classification based on painting techniques[J]. Chinese Journal of Computers, 2017, 40(12): 2871-2882 (in Chinese).

A dynasty classification algorithm of ancient murals based on adaptively enhanced capsule network

CAO Jian-fang1,2, YAN Min-min1, TIAN Xiao-dong1, JIA Yi-ming1, JIN Meng-yan1

(1. School of Computer Science and Technology, Taiyuan University of Science and Technology, Taiyuan Shanxi 030024, China; 2. Department of Computer Science and Technology, Xinzhou Teachers University, Xinzhou Shanxi 034000, China)

In view of the ambiguity of mural images, the differences of mural painting styles in different dynasties, and the high time-consumption and difficulty of the direct traditional manual reference to mural texts or historical documents to identify mural dynasties, an adaptive enhancement capsule network (AEC) algorithm for ancient mural dynasties identification was proposed to automatically identify the dynasties of Mogao Grottoes murals. Based on the original capsule network, the pre-convolution structure was introduced to extract the high-level features of mural images. Secondly, the fitting performance was increased for homogeneous layer activation enhancement model. Finally, the adaptability of the capsule network was enhanced. On the basis of the improved gradient smoothness, the adaptive learning rate was employed to optimize the model, thus improving the classification accuracy of the model. The experimental results show that on the constructed DH1926 mural data set, the accuracy rate of the adaptively enhanced capsule network model is 84.44%, the average accuracy (MAP) is 82.36%, the average recall rate (MAR) is 83.75%, and the comprehensive evaluation index is 83.96%. Compared with other network structures, such as improved convolutional neural network (CNN) and native capsule network, each evaluation index has been improved by more than 3%, and displayed strong fitting performance. It can extract rich features of murals at multiple levels and express more detailed semantic information of images. It is advantageous in higher accuracy and better robustness in the dynasty recognition of Mogao Grottoes murals, and is of certain application value and research significance.

pre-convolution; homogeneous layer activation; adaptive enhancement; capsule network; mural dynasty classification

TP 391

10.11996/JG.j.2095-302X.2021050744

A

2095-302X(2021)05-0744-11

2020-12-11;

2021-04-16

11 December,2020;

16 April,2021

曹建芳(1976-),女,山西忻州人,教授,博士。主要研究方向为数字图像理解、大数据。E-mail:kcxdj122@126.com

CAO Jian-fang (1976-), female, professor, Ph.D. Her main research interests cover digital image understanding, big data. E-mail:kcxdj122@126. com