VR技术在变电站仿真培训系统中的应用研究

王 磊,杨国练,陈 维,牟旭东,王瑞强

(1.国网甘肃省电力有限公司培训中心,甘肃 兰州 730070;2.国网甘肃省电力有限公司设备管理部,甘肃 兰州 730900;3.国网甘肃省电力有限公司天水供电公司,甘肃 天水 741099)

0 引言

随着计算机技术和仿真技术逐渐发展成熟,虚拟现实(virtual reality,VR)技术也带动诸多行业快速进步[1]。相关研究在各行各业也取得了巨大的成绩。其中,沉浸式仿真技术的研究较为深入且贡献较为突出[2]。其通过多种硬件设备和软件系统的结合,使得参与者完全融入逼真、交互式的虚拟场景[3]。与此同时,在培训现代变电站工作人员中,变电站沉浸式仿真培训系统起到无可替代的重要作用[4-5]。但目前国内外有关330 kV变电站沉浸式仿真培训系统的研究相对较少,面临较多的难题。鉴于此,本文在前人的经验和成果的基础上,利用多通道视频输出技术和Kinect体感的交互虚拟技术,构建一种体验感和互动性更强的沉浸式仿真培训系统。该研究结果能为后续变电站沉浸式仿真培训系统的开发提供参考。

1 变电站沉浸式仿真培训关键技术

1.1 沉浸式系统需求设计

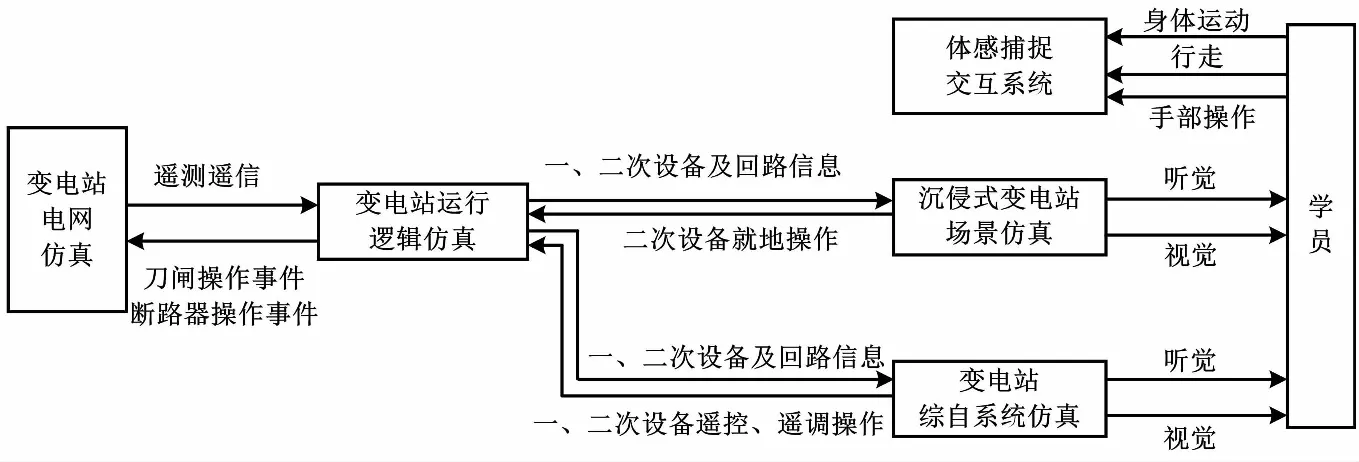

变电站沉浸式仿真培训系统中,硬件部分实现虚拟场景的立体声音效果和视觉效果,软件部分实现变电站的场景仿真,从而达到虚拟实境的效果。沉浸式仿真培训系统如图1所示。

图1 沉浸式仿真培训系统

沉浸式仿真培训系统由Kinect体感捕捉交互系统、教员管理系统、变电站综自系统仿真、变电站电网仿真、沉浸式变电站场景仿真、变电站运行逻辑仿真六大模块组成。所有模块通过仿真运行支撑平台完成交互信息、同步时间、控制协调等过程[3,6]。变电站电网仿真模块能达到电网短期、中长期过程的一体化仿真,将一次设备有功、无功等遥测量以及刀闸状态、断路器的遥信量传输给变电站运行逻辑仿真模块,同时接收来自变电站运行逻辑仿真模块的信息。沉浸式变电站场景仿真的引擎开发为Unity3D。该引擎将变电站三维图像通过多通道输出技术输出到大型3D弧幕,使用模型和场景编辑器构建变电站设备和场景模型,然后通过体感交互式设备接收实时数据,并将数据经过人体骨骼运动数据解析转变为虚拟场景中的虚拟角色行为[7-10]。

变电站运行逻辑仿真是在电网一次设备提供信息的前提下,对继电保护自动装置、直流系统、交流系统、防误系统等的逻辑行为进行模拟;同时,把二次回路和一、二次设备的仿真结果传输至场景和自动化综合仿真的2个模块,并作出相应的就地操作、遥调、遥控等指令[11-12]。变电站综自系统仿真模块的主要功能是模仿变电站监控系统的功能。Kinect体感捕捉交互系统通过Kinect体感交互技术实现精准捕获,分析所有人员的局部和全身肢体动作信息,然后将结果传输至虚拟场景并促发虚拟个体和虚拟场景之间的互动,通过手势和三维设备的精准碰撞检测来判断学员的动作,最后将动作时间提交给变电站进行逻辑仿真。教员管理系统模块的功能是控制、监视、管理培训全过程。

软件系统逻辑关系如图2所示。

图2 软件系统逻辑关系图

硬件系统包括网络交换机、工作站、Kinect传感器、大型立体弧幕+3D互动投影结构。大型立体弧幕+3D互动投影由2组共6台3D互动投影组成,功能是分别接收主图形工作站输出的不同视频信号。通过视频融合器协同处理后,投影仪将获取的三维场景图像输送至立体弧幕中。接着,学员通过3D眼镜即可沉浸在模拟的变电站场景中,感受变电站中一、二次设备的异常、正常、故障情况,思考相应的解决途径,同时也可操作、处理事故,检查、巡视虚拟设备。图形工作站的功能有以下3个方面:①分配沉浸式变电站仿真培训软件系统,从而达到培训仿真的目的;②接收和处理多通道输出的2组视频信号,从而达到模拟左右眼视频输出的效果;③通过USB数据接口连接工作站和Kinect设备,从而达到体感交互虚拟场景的目的。从工作站的功能可以视为主工作站的功能。当主工作站出现故障时,从工作站立即进入工作状态。

1.2 虚拟现实关键技术

此次研究利用多通道视频输出技术、Kinect体感交互虚拟技术和体态识别的场景漫游技术,构建一种体验感和互动性更强的沉浸式仿真培训系统。投影式沉浸式虚拟现实系统的基础是多通道视频输出技术。研究通过在计算机DirectX图像引擎和仿真应用程序两者间连接3D转换接口程序,实现多通道视频输出技术。如果仿真软件通过计算机DirectX图像引擎进行图像描绘,3D转换接口将会得到所描绘的图像数据,同时把图像调整为具有3D效果的左右两侧数据。随后通过3D转换接口程序,将左右两侧数据分别输送至两个投影机上,以此模拟人左右两眼的输出,进而得到3D立体成像效果。Kinect体感交互的虚拟人驱动技术是指精准捕获学员的局部和全身肢体运动情况,然后实时跟踪捕获到的六自由度位置信息,接着通过数据接口软件实时将跟踪信息传递给沉浸式变电站场景仿真软件,从而实现逼真的动作仿真。数据实时捕捉是利用骨骼追踪控制技术处理由Kinect传感器得到的景深数据,从而实现人体骨骼关节点的跟踪,进而实时控制虚拟人的相应骨骼节点。骨骼数据源于Microsoft Kinect SDK开发包的SkeletonStream流。研究从SkeletonStream流获取骨骼数据,每一帧数据包括骨骼对象的相应集合。其中,每个骨骼对象所包含的信息为骨骼关节的数据和位置,每个关节均有且只有一个标记号和3D向量数据。因此骨骼关节点的追踪信息可以被获取,从而保证使用者的动作和虚拟模型的运动轨迹相同。Microsoft Kinect SDK能够实现20个主要关节点的动态跟踪,但仍然不能识别更为精细的动作。

本研究实现体感交互技术的方式为识别样本和实时数据捕捉。其中,在人体动作手势识别方面,采用动态时间规整(dynamic time warping,DTW)算法。

该算法本质是模板匹配算法,其具体识别、检测步骤如下所示。首先,设置参考模板,也就是标准手势从开始到结束期间的所有3D深度数据,可以用R={R(1),R(2),...,R(M)}表示。第m帧手势模拟特征数据用R(m)表示,m=1,2,...,M。R(1)表示受试动作起点的数据,R(M)表示受试动作终点的数据。需要分析的手势动作数据用T={T(1),T(2),...,T(N)}表示。第n帧的分析手势特征数据用T(n)表示,n=1,2,...,N。T(1)表示手势起点的数据,T(N)表示手势终点的数据。通过计算两者的距离得到相似度情况。若距离越大,则相似度越低;反之,则相似度越高。为了计算相似度,需要知道相应帧序号。2帧特征矢量间的距离用d[T(n),R(m)]表示。可以看出,距离函数的值为实际距离度量。设置特征向量的获取方式为每秒30帧。通过类比分析特征数据和模板,即可以根据两者的相似度获取动作手势的参考模板,进一步促发虚拟人做出相应的手势动作。因此,该方法能够对学员的细微动作进行较为精准的识别。

动作和漫游任务相关性如表1所示。

表1 动作和漫游任务相关性

变电站培训要求控制虚拟人在一、二次设备区间的漫游操作,但动作驱动不能满足虚拟人的所有漫游操作。本文引入体态识别的场景漫游技术控制虚拟人的转向和漫游。虚拟人物可以实现实时跟踪学员的转向、行走等体态动作。该技术分析、识别人体骨骼图像帧数据并获得虚拟人物的驱动指令。假设需要作出虚拟人的行走指令,具体操作步骤如下所示。

①得到人物的骨骼数据,并对骨骼数据进行分析。

②处理骨骼数据,并得到虚拟人的动作指令。结合表1所示漫游指令和动作特征的相关性,在行走画面分析的基础上,完成行走控制任务、实现漫游控制。转向控制可以分为2种情况,分别是静止状态和动态过程中的转向。为了达到理想的控制效果、正确区分2种状态下的转向,需要控制人物的转向速度和连续性,将虚拟人物作为中心,转向速度设置为每帧5°。

2 变电站沉浸式仿真培训系统分析

2.1 虚拟仿真效果分析

研究通过分块的方式构建虚拟变电站,完成建模后再进行场景组合。多通道输出技术需结合多台投影仪共同输出完成试验展示。

多通道视频输出效果和场景漫游效果如图3所示。由图3(a)可知,左右两边图像模仿人的左右两眼,画面具有非常高的立体感,带给参与人员极高的参与感。虚拟人向前行进和向右转弯的场景漫游效果如图3(b)所示。所设计的变电站仿真培训系统能够实现一、二次设备的漫游仿真,逼真显示虚拟人物的转动和漫游。结合虚拟变电站效果图可以看出,所构建的变电站沉浸式仿真培训系统逼真且清晰。

图3 多通道视频输出效果和场景漫游效果

两种仿真培训系统优劣对比如表2所示。在体验感和沉浸感方面,沉浸式仿真培训系统都强得多。在实时性和开发性方面,原有仿真培训系统也不如沉浸式仿真培训系统。原有仿真培训系统在系统集成方面效果较好,但是它并不具有交互多样性。由表2可知,沉浸式仿真培训系统性能更优,更加适用于当前我国变电站仿真培训系统。

表2 两种仿真培训系统优劣对比

2.2 识别率效果分析

由于捕捉范围对人体动作识别率的影响极大,首先设置0.5~2.0 mm、2.0~3.5 mm、3.5~5.0 mm这3种捕捉范围内的识别率情况。人体动作识别准确率对比如图4所示。

图4 人体动作识别准确率对比

图4中,动作1~8分别为原地踏步、后退一步、左臂与肩平齐、右臂与肩平齐、左手朝胸部挥、向上方挥手、向前挥手、手握拳。捕捉范围为5.0~2.0 mm时,动作1~动作8的识别准确率为96%、94%、94%、93%、98%、92%、94%、81%。在捕捉范围为3.5~5.0 mm时,相比较于0.5~2.0 mm捕捉范围的准确率,8种动作的识别准确率均有所提高,提高幅度约为1%。在捕捉范围为2.0~3.5 mm时,8种动作的准确率均比0.5~2.0 mm捕捉范围的识别准确率更低。综上分析,Kinect体态识别技术的最佳捕捉范围为2.0~3.5 mm。

研究选取不同身高、体重、性别的试验人员,人数总计为60人,抽取200次数据结果。人体动作识别准确率统计结果如图5所示。

图5 人体动作识别准确率统计结果

图5中,动作1~动作8分别为原地踏步、后退一步、左臂与肩平齐、右臂与肩平齐、左手朝胸部挥、向上方挥手、向前挥手、手握拳。在采集到的200个样本中,动作1~动作8的样本数量分别为24、26、30、30、32、16、24、18,相应的识别准确率分别为95%、93%、93%、92%、97%、91%、93%、80%。从整体来看,左手朝胸部挥动作的识别准确率最高,而手握拳的识别准确率最低。

3 结论

针对目前变电站仿真培训系统存在体验感不足、交互性低等现状,本研究利用虚拟现实技术,提出一种新的沉浸式培训系统设计方案。该方案利用多通道视频输出技术和Kinect体感的交互虚拟技术,构建了一种体验感和互动性更强的沉浸式仿真培训系统。对比不同捕捉范围的识别准确率,确定Kinect体态识别技术的最佳捕捉范围为2.0~3.5 mm。原地踏步、后退一步、左臂与肩平齐、右臂与肩平齐、左手朝胸部挥、向上方挥手、向前挥手、手握拳的识别准确率分别为96%、94%、94%、93%、98%、92%、94%、81%。200次抽样数据中,左手朝胸部挥动作和手握拳动作的识别准确率分别是最高和最低的。

通过对原有仿真培训系统和沉浸式仿真培训性能的对比分析可知,变电站沉浸式仿真培训系统的交互多样性更强、实时性更高、体验感更强、系统集成开发功能更优。由于现有Kinect体感交互技术在识别虚拟人物转向方面还存在一些缺陷,因此识别的速度和精度还需要进一步提高。这也是未来需要突破的方向。