机器视觉系统应用中几点体会

陈煜 曹锦江 周湛 陈浩冉 戴烨 胡严斌

摘 要:运用视觉识别技术能引导机器人实现工件自动识别并进行分拣搬运。本课题研究基于索尼相机为硬件基础,以FANUC机器人为搬运分拣平台,内置视觉识别软件,搭建了基于视觉识别技术在FANUC机器人上的自动分拣系统。本文主要针对在系统搭建过程中遇到的问题进行分析,运用本实验研究结果给出解决方法,并提出参考意见。

关键词:工业机器人 机器视觉 分拣系统 标定

中图分类号:TP391.41 文献标识码:A文章编号:1674-098X(2021)05(b)-0061-05

Some Experience in the Application of Machine Vision System

CHEN Yu CAO Jinjiang* ZHOU Zhan CHEN Haoran DAI Ye HU Yanbin

(School of Automation, Nanjing Institute of Technology, Nanjing, Jiangsu province, 211167 China)

Abstract: Using visual recognition technology can guide the robot to realize automatic recognition and sorting of workpiece. Based on the hardware of Sony camera, FANUC robot as the sorting platform and built-in visual recognition software, an automatic sorting system based on visual recognition technology on FANUC robot is built. This paper mainly analyzes the problems encountered in the process of building the system, uses the experimental results to give solutions, and puts forward some suggestions.

Key Words: Industrial robot; Machine vision; Sorting system; Calibration

傳统的工业机器人能对固定位置的同一形态工件进行作业,按照程序设定的工艺流程进行搬运或加工。此方法相较于人工作业大大节省了时间和成本,但是一旦工件的位置或形态出现偏差,就会导致机器人抓取失误,甚至加工失败。在这样的背景下,机器视觉为我们提供了良好的解决方案。通过事先加装工业相机,对工件的位置进行实时监控,再配合视觉识别程序处理相机图片,得到实时的工件位置,进而对机器人的抓取或加工进行位置补正,从而达到在预定范围内的自动化作业要求。

与传统的机器分拣相比,加入了视觉识别的自动化作业能有效地降低工件的摆放要求,降低抓取的失败率,大幅提高了整个系统的自动化程度。但是加装了机器视觉模块后整个系统又面临了一些新的问题。

本文主要针对加装了视觉识别模块的分拣机器人,在搭建系统的过程中遇到的难点问题进行研究与讨论,并给出解决方法。

1 系统组成

基于视觉识别的FANUC分拣机器人主要由工业相机、FANUC机器人、气动吸盘、空气压缩机、FANUC机器人控制装置等组成。机器人的抓取动作主要通过空气压缩机提供吸合动力,由软管传递到气动吸盘,再由系统控制的电磁阀控制是否吸取工件[1]。

工业相机:本次研究选用的是索尼模拟相机(XC-56),分辨率为640像素×480像素,像素尺寸为7.4μm。相机的检测范围由相机的拍照距离,镜头焦距,成像单元CCD尺寸决定。有公式:检测范围L≈(拍照距离D-镜头焦距f)÷镜头焦距f×成像单元CCD尺寸Lc。成像单元CCD尺寸Lc=像素尺寸×分辨率。

工 业机器人:选用的是FANUC Mate200iD六轴机器人。

2 系统搭建过程中遇到的问题及其解决方法

在系统的搭建过程中,由于使用的是FANUC机器人平台,其提供了不少的视觉分析及处理程序,大大简化了调试工作,但是在此过程中也遇到了不少棘手的问题,接下来本文将一一列举这些问题并提出解决方法。

2.1 图像识别过程中阴影的干扰

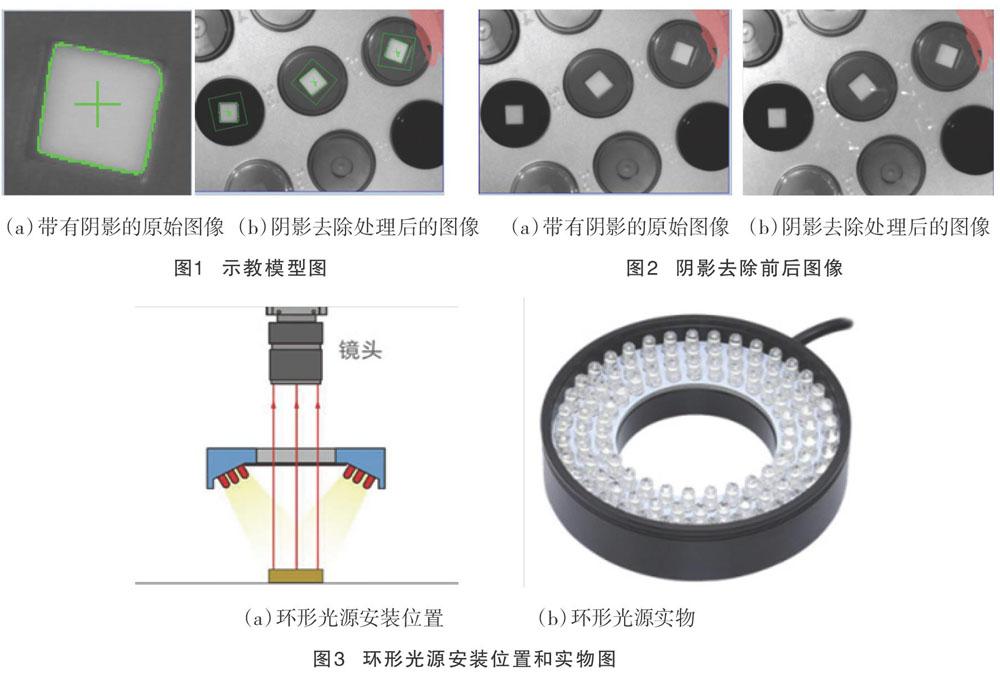

在进行图像识别的过程中,首先进行的就是模型的示教,即预先对样板工件进行拍照识别,对得到的样板照片进行处理,可通过软件自动框选目标工件轮廓或者便于识别的标志性形状,再辅助以手动框选进一步优化识别结果[2]。将此过程最终得到的工件识别轮廓存储为示教模型,以供之后对所需工件进行识别,如图1所示。在系统正常工作时,工 业相机首先对工件进行拍照,然后传递至控制器内进行分析处理,将识别出的结果与事先已示教的模型进行对比。

但是在某些情况下,由于光照没有垂直于工件会使相机拍摄得到的照片上出现工件产生的不规则阴影[3]。由于使用的是黑白相机,视觉识别时相机得到的黑白图像,会收到干扰数据,视觉识别程序会将这块阴影错误识别为工件的一部分,从而导致下一步与示教模型进行比对时出现偏差,进而将原本应当被识别为目标工件的工件错误地被识别为无效工件,致使系统的分拣出现失误。

2.1.1 针对阴影问题有两种解决方法。

方法一:在工业相机得到工件照片后先进行一次图像预处理,运用阴影去除程序去除图像中的阴影[4]。其原理为先对阴影的浓淡值进行示教并存储,在执行阴影去除时,将浓淡值低于已示教值的图像部分的像素的浓淡值变为0,即不会再被视觉识别程序识别。加入阴影去除工具前后的识别结果如图2所示。

方法二:提供更好、更稳定的光源,理想的光源应当具备结构简单、光照均匀稳定的特点。此外想要达到抑制阴影产生的目标,还应当将光源放置于工件的正上方。要想达到最理想的光照效果,应当采用环形光源围绕相机,围绕相机的环形光源如图3所示。

2.2 系统中坐标系的标定问题

在了解这个问题之前,我们应当先了解系统中所用到的各个坐标系。机器人的位置和姿态用坐标系来进行描述。常用有以下两类坐标系,第一类是用户坐标系,第二类是工具坐标系。用户坐标系是用户给定的用来定义机器人作业空间的坐标系。工具坐标系是用来定义机器人工具的位置和朝向的坐标系,工具坐标系的原点可称之为Tool Central Point(简称为TCP)。本文的研究应用FANUC的机器人,采用叫做示教重放的方式进行作业。该方式的机器人按照示教的方式再现动作。因此,在一般机器人系统上,并不将坐标系视为十分重要。但是在带视觉系统的机器人运用上,坐标系有着十分重要的意义。由于视觉识别物体得到的是用户坐标系下的坐标,因此在设定用户坐标系时必须力求准确。在物块抓取时,机器人依靠的是工具坐标系进行抓取补正,因此我们在设定工具坐标系时也需力求准确[5]。

但是在坐标系的标定过程中,初学者对于这两种坐标系的概念不能很清楚的理解,从而导致在标定中出现失误与偏差,更有甚者会把这两种坐标系混淆[6]。再加上除了这2个坐标系需要标定外,相机本身也需要进行标定,但是相机的标定是基于已经标定好的用户坐标系[7],相机标定部分将在下一部分进行详尽叙述。下文将列举几种准确且可靠的标定用户坐标系和工具坐标系的方法。坐标系的标定方法如下。

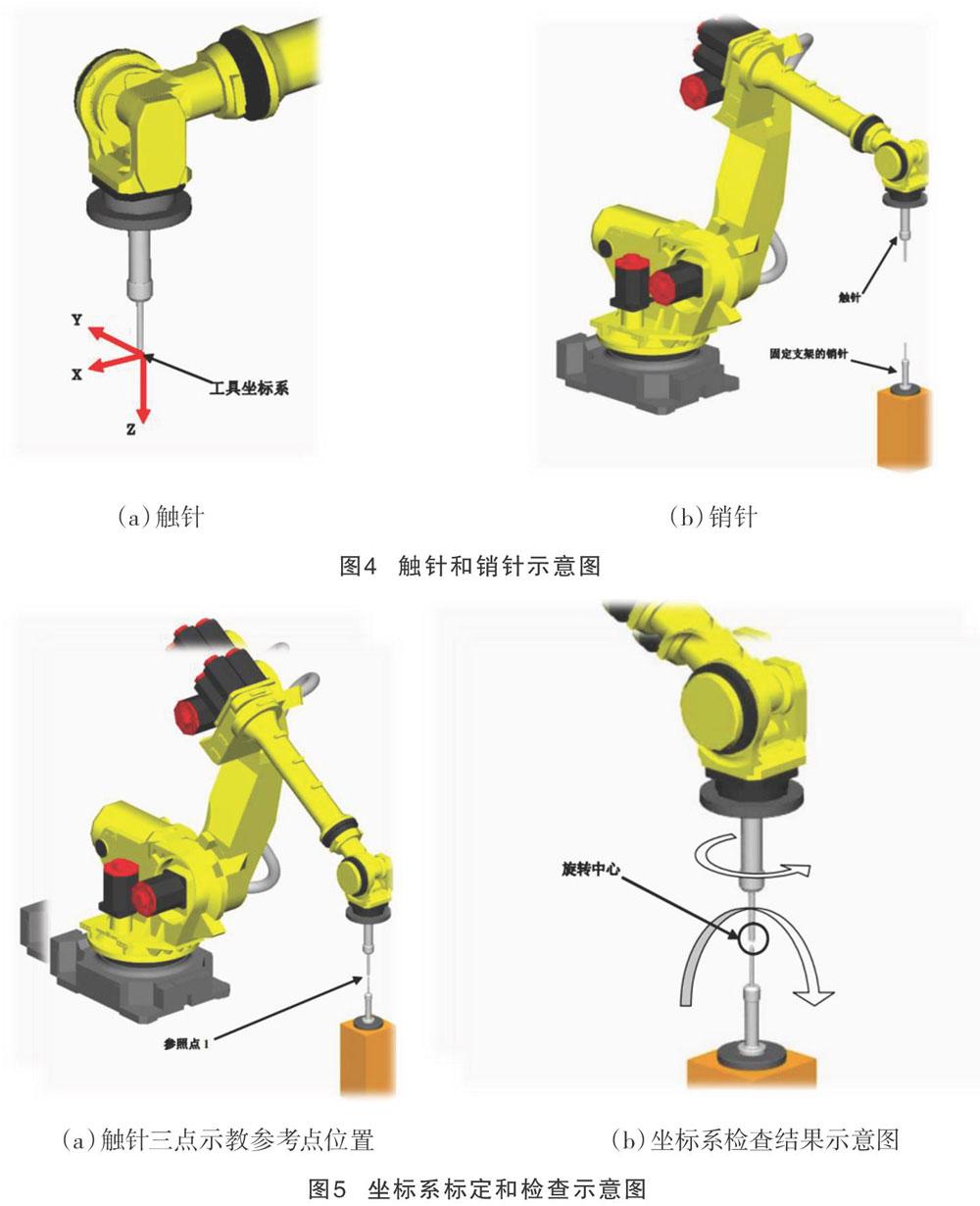

方法一:通过使用触针,进行触碰来设定用户坐标系和工具坐标系。将触针安装在机械手上,触针需要选择前端较为尖锐的且触针,要固定在机械手上,不能因为触碰而产生偏移。此外,还需要一个固定在机械手工作范围内的尖锐的销针,销针应当固定在支架上,触针和销针实物示意图4所示。

我们先介绍工具坐标系标定的方法:用安装在机械手上的触针和安装在固定位置的销针前端对合的方式设定工具坐标系的原点TCP[7]。我们使用触针的方式进行TCP设定时运用的方法叫做“三点示教法”,其内容是使用点动的方法操作机械手,使触针从3个不同的方向趋近销针的顶点,这3个方向与机械手所用的姿势应当尽可能各不相同。其次,再通过机器人内置的存储器记录下此时机械手的位置与形态。通过FANUC机器人内置的TCP设定程序即可计算出工具坐标系。最后检查工具坐标系时,先用点动的方法将触针移至销针顶端,再改变工具姿势,若TCP设定正确,则触针前端会始终指向支架的销针前端,如图5所示[8]。

运用触针进行用户坐标系的设定时,只需用点动的方式使触针对准点阵板上的固定点并记录位置即可完成用户坐标系的设定。

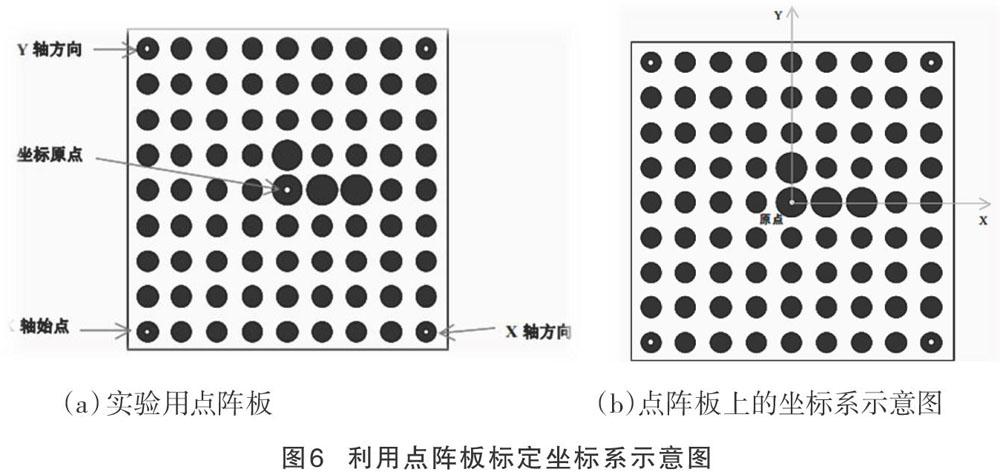

方法二:使用网格坐标系功能的坐标系设定[9]。这是一种使用相机和点阵板夹具的设置信息的一种功能。FANUC机器人能提供的一种自动标定程序。机器人会自动改变相机与点阵板的相对位置反复进行测量,最后识别并记录从机器人的基本坐标系看到的点阵板的坐标系位置如图6所示[10]。与基于触碰的方法相比其具有以下优点:可不受用户操作水平的制约,无需安装触针和销针,采用半自动方法进行设置操作简单。但是半自动的标定方法还是会受到手持相机的机器人运动灵敏度的制约,其要求进行的半自动标定方法的精準度与机器人能够运动的角度与范围成正比,只有在机器人能够在理论要求的范围与角度内运动时,半自动标定的精准度才能达到预期。所以非六轴联动机器人一般不推荐半自动标定方法。

2.3 相机标定问题

在讨论相机标定问题之前首先要了解介绍一下目前主要的相机标定方法。目前主流的相机标定方法分两种,第一种是传统相机标定方法,第二种是相机的自标定方法[11]。传统的相机标定方法是使用需要进行标定操作的相机拍摄现有的标定模板,例如棋盘格模板、网格纸模板等(上文提到的点阵板即为一种),再将所得图片与标定模板上的固定大小和位置的图案进行对比,经过算法处理后得到空间位置参数,使机器人能记录下当前状态下的相机处于何种状态,位于什么位置。而相机的自标定方法则不需要用到固定的标靶模板,其原理是以空间中的某一未知点作为参考点,以相机做特定运动的方式得到场景图像,从而完成相机的标定。相较于传统的相机标定方法,相机自标定法虽然无需用到标定模板,但是它对手持相机的机器人和位置处理算法提出了更高的要求,且标定精度与机器人运动灵敏度和精准度直接挂钩。因此,在非六轴联动的高精度机器人上,一般不推荐用相机自标定法。

本文主要介绍传统的相机标定方法,本实验主要对一板标定法进行了研究。在进行一板法标定相机时,实验人员发现其标定方法与坐标系标定类似,但是并不是创建一个新的坐标系,而是基于上所述文已经建立的用户坐标系,判断当前相机的状态与位置,进而完成相机标定的。

首先,本实验运用到的标定板即为图6(a)所示点阵板,根据相机是否固定于机器人上,点阵板的放置有两种方法,一种是相机固定于机器人时,点阵板固定于相机下的平面,另一种是相机固定时,点阵板固定于机器人上,然后进行点阵板夹具参考坐标系的设置。此时根据点阵板位置的不同又分为两种情况:点阵板固定在平面时用已经设定好的用户坐标系作为基准坐标系;点阵板固定在机器人上时用工具坐标系作为基准坐标系。本实验运用的是固定于机器人的相机,点阵板因此固定于相机下的平面上,基准坐标系选用设定好的用户坐标系。

以FANUC机器人为例,需要操作人员输入点阵板上的点间间距与相机的焦距,这里的焦距也可以让机器人自动计算,推荐使用焦距固定的相机,手动输入焦距,以较小误差,如图7所示。

最后相机进行拍照,拍照位置最好在点阵板中心线的正上方,相机光轴垂直于点阵板[12]。拍照得到的图像应当在机器人中进行处理,根据输入的点间间距与焦距自动计算出相机高度、位置偏差等的参数并记录。至此相机的一板法标定完成。

3 结语

在设计基于机器视觉的机器人自动分拣系统的过程中遇到的这些常见问题,本文主要针对图像阴影干扰、坐标系标定、相机标定等问题进行分析,运用本实验研究结果给出解决方法,并提出参考意见。

参考文献

[1] 刘亚奇.基于机器视觉的自动分拣机器人[D].开封:河南大学,2018.

[2] 卢振利,谢亚飞,周立志,等.基于机器视觉的机器人辨识及分拣盒装香烟的系统[J].高技术通讯,2016,26(6):585-592.

[3] 廖家骥,刘建群,高伟强,等.基于机器视觉的机器人分拣系统设计[J].组合机床与自动化加工技术,2019(4):25-27,31.

[4] 朱亚红.基于机器视觉的工业机器人分拣系统[J].智慧工厂 ,2018(12):73-74.

[5] 刘潇,万其,倪银堂,等.基于视觉的移动分拣机器人系统研究[J].工业控制计算机,2018,31(12):91-93.

[6] 张翔.基于工业机器人的多工件视觉识别与分拣[D].北京:北京化工大学,2018.

[7] 徐青青.基于机器视觉的工业机器人智能分拣系统设计[J].仪表技术与传感器,2019(8):92-95,100.

[8] 上海發那科机器人有限公司,FANUC机器人视觉操作说明书(B-83304CM_04)[Z].2016.10.

[9] 上海发那科机器人有限公司,FANUC机器人R-30iB-MateiRVision视觉操作说明书(B-83304CM-1_02_01))[Z].2016.10.

[10] 上海发那科机器人有限公司,FANUC机器人R-30iB-MateiRCalibration操作说明书(B-83724C M_02)[Z].2016.10.

[11] 陈恳.基于机器视觉的物料分拣工业机器人关键技术研究[D].深圳:深圳大学,2017.

[12] Hyattyonatan.TheRoleofAdaptiveVisionAiinAutonomousMachineVision[J]Photonicsviews,2021,18(2).