未来已来,几多思考

—— 2021年世界人工智能大会观察

◆本刊记者 甄敏蔚 / 文

2021年世界人工智能大会,一如往届,在炎热的夏季召开。3天的大会,会议、论坛七八十个,线上线下大咖无数,参会年轻人热潮汹涌。记者走会,汗流浃背,只能从关心处出发,展开几点观察。

关于“脑机接口”

人类与机器交互接口的每一次演变,都会带来一场颠覆性的革命。每届大会,都会接受到最新的讯息。

2019年那届,传来马斯克麾下神经科学公司的消息,称:通过微创小孔可将他们发明的超细线“缝”进人类大脑,通过专有技术芯片和信息条,可以解码“脑觉”信号。不久,马斯克就宣布,“脑机接口”研究取得突破性进展,“一只猴子已经能用大脑控制电脑”。最近这只猴子走红网上,它用脑电波控制电脑打乒乓的视屏,吸睛全球。

在2021年世界人工智能大会,记者见到了一只装在玻璃展示柜里的“猴子”。原来,这是中科院上海微系统所的陶虎团队展示的“脑机接口”——“免开颅微创植入式高通量柔性脑机接口”。这项技术厉害在:可以让那根超细线暂时“硬化”,像针灸一样植入人脑,进入之后,又会变软。所以,这是项“免开颅”的手术,创口比输液针孔径还小。

可以想见,这项高超技术如果普及的话,小朋友的自闭症、中青年的抑郁症、老年人的痴呆症,以及癫痫、瘫痪等,治疗起来难度会大大降低。

至于脑机接口技术是否已经接近马斯克向往的“人类AI化”目标呢?还是相当有距离的。毕竟,植入的AI芯片并没有运作整个大脑,而是部分脑神经。即便是击败李世石的AlphaGo芯片植入人脑的话,本质上也是不经大脑做出的决断,因为它的运作其实是绕过人脑,只是一块经过大量围棋图谱训练的芯片,在单点上击败人类而已,并且“烧脑”得厉害,要消耗大量的能源,而人类只须补充一杯牛奶而已。

关于大量训练导致的能源消耗,可以联系到谷歌AI伦理团队创始人Gebru被迫离开谷歌的大事件。据说与一篇未通过谷歌审核发表的论文有关。该论文指出,训练大型AI模型需要用到大量的计算机处理能力,因此会消耗大量电力。文中引用了一项研究发现:自2017年以来,随着向模型馈送越来越多的数据,其能耗和碳足迹也一直在呈现爆炸式增长。比如用“神经架构搜索”方法训练一种语言模型会产生626155磅(284公吨)二氧化碳,大约相当于五辆普通美国汽车使用年限内排放量的总和。这还只是对训练一次模型成本的最低估计。实际上,在研发过程中,工作人员会对模型进行多次训练和再训练。

尽管AI在接受大量训练,但目前AI也只能解决完全信息和结构化环境下的确定性问题,如语音识别、图像识别、下围棋(完全信息博弈)等,与人类大脑所表现出来的随机应变和举一反三的能力相去甚远。

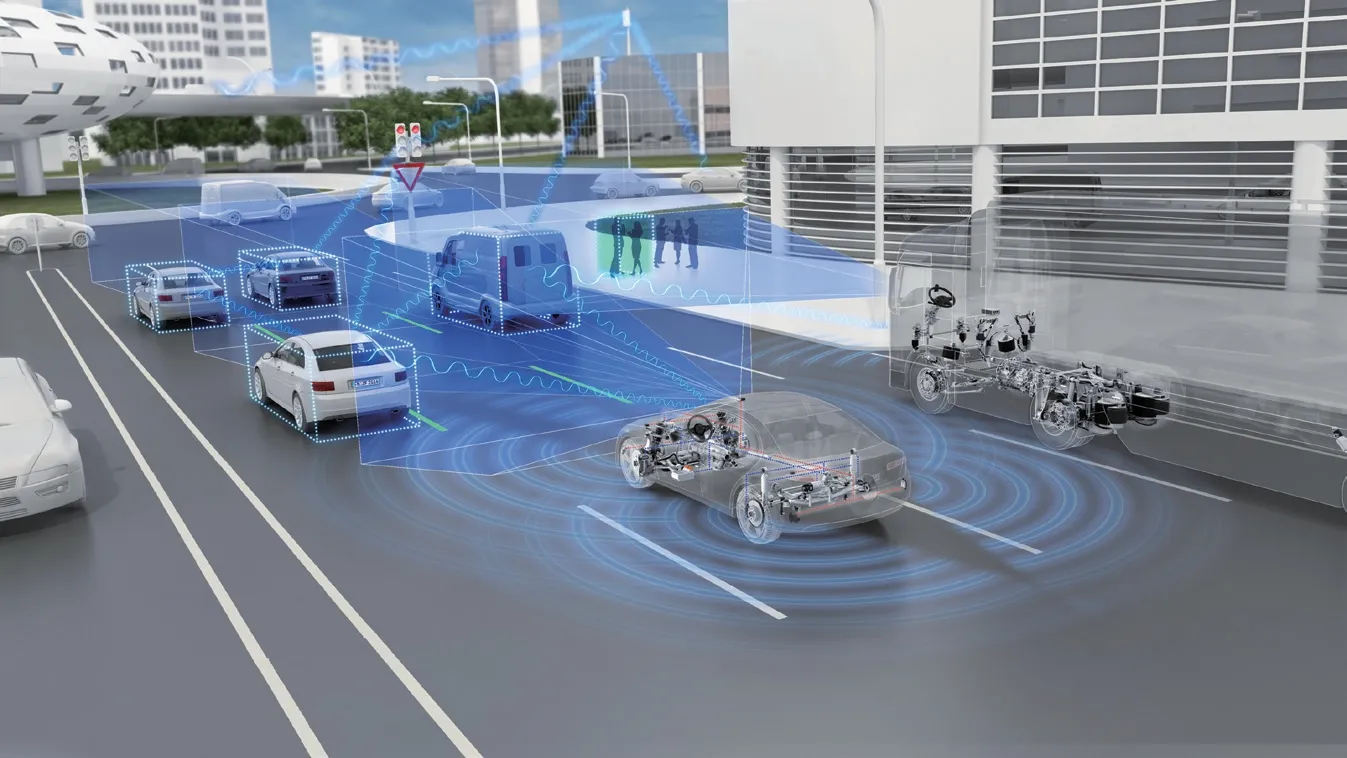

关于“自动驾驶”

这是本届大会最热的议题之一。在大会的“浦江夜话‘激荡•智能驾驶’”论坛上,争论如潮,沸沸扬扬,包括一干车企大佬,以及图灵奖得主约瑟夫•斯发基斯教授。

约瑟夫•斯发基斯教授是提出“自主系统”概念的人。他在线上发言中认为,多年来人们对自动驾驶的前景过于乐观。

他说:“构建值得信赖的自主系统不仅要有智能的主体,而且还是一个重大的系统工程。我们对于自动驾驶的愿景是自主,为了实现这一愿景,我们需要新的科技,以及工程方面的发展。我觉得还需要几十年的时间才能够实现。”

全自动驾驶分为两个阶段。第一个阶段是自动化阶段,即L1~L4阶段。一般是从简单的特定场景落地做起,去打通商业化路径。比如先从仓库工厂的自动叉车做起,再做固定路线的摆渡车、小巴,再到出租车。这些场景陆续落地后,就将进入L4级别的自动驾驶。第二个阶段,就是L5的自主化阶段。这个阶段,自动驾驶取代人类驾驶,安全通畅地行驶于所有交通场景:不管是刮风下雨,还是极端气候,或是月黑风高;无论是在狭窄的胡同,还是在酷热的沙漠,L5都能安全前进。

对此,斯发基斯教授有定义。他说:“自动化的阶段,人类司机应当负有责任;自主化阶段,机器将能够独立做出决策。”

那么,当前我们处于什么阶段?与会的智己汽车、斑马网络、华为、小鹏汽车、文远知行、出门问问等业界人士议论纷纷。有的说在L2.5,有的说在L3,也有说在L4了。

对于L5,大多数业界人士认为遥遥无期。总之,“L5像灯塔,大家奔就是了”。

其实,大洋彼岸对L5的追求,也遇到了阻力。特斯拉的自动驾驶套件更新,一而再、再而三的推迟。7月3日埃隆•马斯克终于公开承认,开发安全可靠的自动驾驶汽车比他想象的更难。然而就在三个月前,马斯克还信心满满地表示,特斯拉2021年能够实现全自动驾驶,可靠性将超越人类司机。

事实上,欧美和中国在自动驾驶方面,走的是两种路线。欧美是在“路不变、城市不变”的前提下,思考自动驾驶怎么上路。而中国更愿意去探讨:为什么一定要“路不变、城市不变”?为什么不能让高速公路跟车“对话”?为什么不能在某一个新建城市中心,把车和行人从地上到地下进行分层?这样,车不会撞到人,等于是L5级别的自动驾驶落地。

据说,从零开始建设的雄安市,将开辟自动驾驶专用智能车道,打造“车、路、云”一体化的未来智慧城市的交通模板。

当然,这有待于自动驾驶标准体系的建立,以应对一系列的技术、伦理、政策等方面的挑战。

关于“AI向善”

“如何避免大数据时代个人隐私形同虚设的问题?”“代码是否具有道德?”“人工智能时代的道德代码如何编写?”

面对人工智能引发的全球信任焦虑,如何处理好人工智能在法律、安全、就业、道德伦理方面的问题,如何让“AI向善”,如何可信与治理,也是本届大会的重要议题。

外交部前副部长、清华大学战略与安全研究中心主任傅莹在本届大会“人工智能、安全、国际合作”线上讨论会的发言,主要关注了这个话题,尤其是“人工智能赋能武器可能带来的挑战”。

我们知道,人工智能内在的技术缺陷使得攻击者难以限制打击的损害范围,容易造成过大的连带伤害,从而导致冲突升级;基于大数据训练的算法和训练数据极有可能将偏见带入真实应用系统,不排除这样的人工智能给决策者带来错误的决策;人机协同的不足将放大发生战场冲突的风险,甚至刺激国际危机的螺旋上升等。

傅莹说,当人类迈向命运共同体的未来之际,比任何时候都更需要伙伴关系与合作,她提出了“人工智能系统中纳入国际公认的有关军事活动的法律和规范”的建议。

“AI向善”,是全球共识。

2017年,全球行业领袖制定《阿西洛马人工智能原则》,为技术发展制定了“有益于人类”的自律守则;欧盟委员会也发布了人工智能道德准则;经济合作与发展组织(OECD)于2019年正式通过了首部人工智能的政府间政策指导方针,确保人工智能的系统设计符合公正、安全、公平和值得信赖的国际标准;二十国集团(G20)也出台了倡导人工智能使用和研发“尊重法律原则、人权和民主价值观”的《G20人工智能原则》;中国国家新一代人工智能治理专业委员会发布的《新一代人工智能治理原则》,提出发展负责任的人工智能。

“AI向善”,虽是全球共识,然而,做起来却难。谷歌AI伦理团队创始人Gebru被迫离职一事,就是明证。于今而言,没有建立自己AI伦理的大公司几乎找不出了,这些伦理宣言在我们看来,也都是正能量的。但是,“观其言察其行”,关键是要落实到行动上。比如,数智化时代带来工作效率提升,员工岗位大幅减少,那么,公司如何在就业与商业利益平衡上体现“向善”?再比如,越是有钱越能大量地训练AI模块,很多公司的赚钱算法就是这样来的,那么有没有公司将道德准则纳入到算法中,让算法不带“偏见”?谁能这样做,谁才是“AI向善”的行动者。

本届大会对“AI向善”贡献不少。亮点之一是发布了《可信人工智能白皮书》,首次系统提出可信人工智能全景框架,全面阐述可信人工智能的特征要素,剖析了可信人工智能与人工智能科技伦理和治理的关系,对可信人工智能的未来发展提出了建议。

关于“数字主权”

数据,是数字时代的核心资产。垄断型公司掌握的大数据、大算力、大模型,赋予其“预知”消费者动向的生杀能力,资本力量会促其“看人下菜”,实施“大数据杀熟”法来大量赚取消费者剩余。一个公司或机构,若大到掌握全民数据,这项“预知”特权就不仅能攫取财富,还能支配社会思想,进而挑战政治。因此,有人甚至预言,政治权力将让位于大数据及其掌握者。这不是危言耸听。从近期国家对有关大公司的治理,可以看出端倪。

“数字主权”也成为本届大会重要关注点之一。业界颇具代表性的有华为CIO陶景文的发言。他就强调,华为在内、外部智能化实践中,充分认识到数字主权的重要性和必要性。个人、企业、国家等不同层面,有个人隐私、企业机密、国家安全的客观诉求,华为积极支持各国的数字主权主张,做好数据主权保护。通过“建墙”和“开门”,保障数据安全有序流通,有效促进数据开放,共建共放、有序的智能世界。

本届大会诸多论坛或会议聚焦“数字主权”,如可信AI论坛、隐私计算学术交流会等。本届大会的数据要素论坛,专门就数据生产要素的重要性、数据共享开放开发与安全保护、数据权属与数据权益、公共数据赋能与社会数据交易等进行了介绍。论坛透露,国家有关部门提出要构建“五位一体”数据要素制度体系,上海市将力争年内正式出台上海市数据条例。同时,全国数据交易联盟、数据要素智能合约创新联合体也在本届大会上正式启动。