基于特征匹配的舰载对陆导弹目标识别模型

谢春思, 刘志赢, 桑 雨

(1.海军大连舰艇学院导弹与舰炮系, 辽宁 大连 116018; 2.海军大连舰艇学院学员五大队, 辽宁 大连116018;3.中国人民解放军91991部队, 浙江 舟山 316001; 4.中国人民解放军91278部队, 辽宁 大连 116041)

0 引 言

舰载对陆攻击巡航导弹具备非接触打击陆地纵深目标的能力,是当今世界军事海洋强国广泛列装的武器,可用于打击具有特殊政治意义或军事价值的目标,对导弹武器系统打击精度提出了较高要求。对陆导弹末端常采用基于图像的寻的制导,核心技术包括自动目标识别(automatic target recognition, ATR)和抗遮挡干扰。

长期以来,人们为实现导弹的自动目标识别提出了两类算法[1-7],一类是基于模板匹配[8],即采集和制作目标基准图并以模板形式储存在弹载计算机中,当导弹飞临目标上空时,将导引头实时拍摄的目标区域信息与目标模板匹配进行导弹和目标相对位置的确定;另一类是基于目标特征匹配[9-11],直接利用提取的目标结构特征实现分类和定位。二者在自动目标识别方面各有优势,前者对复杂背景的适应能力更强,后者理论上具备目标识别和跟踪一体化的能力,但对背景纯度要求较高。考虑到复杂的战场环境、弹载计算机性能受限和打击目标时可能存在多样化干扰等因素,目前国外已列装的舰载对陆巡航导弹大多采用基于前视模板匹配的目标识别技术[12]。同时,对陆导弹在作战过程中易受烟雾遮挡干扰而影响图像制导效果,如何提高系统烟雾遮挡抗干扰能力成为一个亟待解决的课题。对此,学界提出串行法和并行法两类抗干扰方案,其核心都是烟雾区域检测技术[13]。目前工程应用中大多通过模式识别法实现烟雾区域检测,对先验知识依赖程度较高。

近年来深度学习技术取得突破性进展,为对陆导弹目标识别提供了新的技术支持。深度学习检测技术利用深层次的神经网络提取目标的多尺度特征信息,与传统目标特征提取算法相比具有鲁棒性强、复杂背景适应能力强等特点,为基于目标特征的对陆导弹目标识别技术提供了新的技术途径。如通过深度学习目标检测算法框架,利用目标情报数据训练深度学习网络,实现对战时导引头获取的图像目标进行分类识别和定位[5,14-18];针对烟雾遮挡干扰,可通过深度学习语义分割算法对导弹目标区内存在的烟雾精准检测,为进一步排除烟雾干扰奠定基础[19-23]。

基于以上分析,本文提出了一种基于深度学习的对陆导弹目标识别模型,该模型包括预处理、识别、抗烟雾干扰、判别分析等4个模块,通过并行法实现目标识别和烟雾区域检测。仿真实验表明,该模型能快速准确识别复杂背景下的陆上典型固定目标,具备一定的抗烟雾干扰能力,验证了基于目标特征的深度学习目标检测技术在对陆导弹目标识别任务中的可行性和有效性。

1 问题提出

当前国外已列装的舰载对陆巡航导弹普遍使用基于前视模板匹配的图像识别技术,如首款装配ATR系统的美军AGM-84E SLAM-ER导弹[24],其末端导引头工作机制如图1所示。当导弹飞临目标区域上空,成像探头拍摄实时视频,经RS422串行总线传输到捕获模块并获取实时图;弹载计算机根据预先储存的前视模板和成像探头与弹体之间的位置关系,制作修正的基准模板;将图中提取的特征和修正基准模板实时传入匹配模块进行相关性计算,完成对导弹的飞行导航。

图1 SLAM-ER导弹ATR系统工作机制

然而,基于前视模板匹配的ATR技术存在固有缺陷。该方法提取的导引头图像中包含角点信息,通过与弹载计算机存储的目标区模板匹配实现对导弹当前时刻的定位,并对比基准面计算导弹位置偏移后导引导弹飞向空间中某一点,而不是直接定位识别和跟踪陆上目标,因此在航路规划中就存在位置误差,该方法在打击机场、跑道等目标任务中尚能满足精度要求,但对建筑物、小型岛屿等固定目标就显得不够了。

基于目标特征的ATR技术通过提取和分析图像特征信息对目标直接分类识别,标定目标在图像中的位置。建筑等小幅员目标在图像中具有“识别即定位”的特点,无需选取定位基准面,为基于目标特征的ATR技术在对陆导弹目标识别任务中的应用提供了理论依据。然而,传统方法提取的特征形态有限,难以满足导弹打击任务的精度和复杂背景适应的能力要求。近年来,基于深度卷积神经网络的特征提取与目标检测技术取得较大进展,具有鲁棒性强、复杂背景适应能力强等特点。由此提出基于深度学习特征匹配的对陆导弹目标识别模型,探讨相关技术的可行性。

2 模型设计

2.1 导弹目标识别模型总体架构

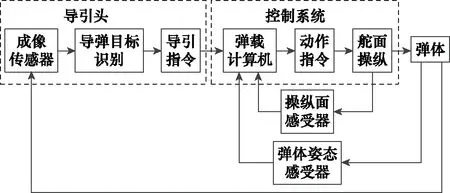

设计的对陆导弹导引控制系统结构如图2所示,飞行姿态控制主要涉及导引头、控制系统和弹体3部分。导引头获取目标图像,经导弹目标识别模型解算后生成弹体导引指令,控制导弹的飞行姿态。并设计反馈结构,使弹载计算机接收来自操纵面感受元器件和弹体姿态感受元器件的反馈信息,同时成像传感器实时捕捉目标图像,实现对弹体姿态的实时精确控制。经以上分析可知,该系统的核心为导弹目标识别模型。

图2 对陆导弹导引控制系统结构

基于深度学习的对陆导弹目标识别模型架构如图3所示,对陆巡航导弹末制导雷达导引头获取目标区域图像后,将图像输入预处理模块提高影像质量;接着分别传入识别模块和抗干扰模块,以并行模式处理后将输出结果传入判别分析模块进行综合判定,最终输出识别结果,生成导引指令对导弹姿态控制,并返回导引头搜索指令调整雷达导引头下次搜索参数。

图3 对陆导弹目标识别模型架构

对陆导弹目标识别模型主要包括预处理、识别、抗干扰和判别分析4个模块。预处理模块具备实现图像增强和降噪滤波两功能,用于改善图像清晰度,提高图像分析率,为进一步处理奠定基础;识别模块和抗干扰模块分别由YOLOv3改进算法和Deeplabv3+改进算法为核心组成,用于识别目标和排除烟雾干扰;判别分析模块首先基于目标识别和烟雾区域分割结果联合目标判定,然后分析目标位置判别中心误差,提高末端目标识别的准确度。

2.2 预处理模块原理

战场环境下影响导引头成像效果的因素主要有两类,一类是导引头的系统噪声,另一类是导弹相对目标高速运动带来的运动模糊。该模块利用改进顺序统计滤波(improved sequential statistical filtering, ISSF)算法和LR算法改善图像质量。

2.2.1 ISSF算法

导引头系统在干扰条件下产生的噪声通常为复合噪声,包括高斯白噪声、椒盐噪声、1/f噪声等。当前常用滤波算法大多对单一噪声有效,但对复合噪声收效甚微。对此提出ISSF算法,以适应任务需求,其实现过程[25]如下。

步骤 1使用5×5的像素提取窗口,计算窗口中像素灰度最大值Rmax和最小值Rmin。

步骤 2判断窗口中心点灰度值Rx,y的大小是否在Rmin和Rmax之间,输出值为

(1)

式中:

(2Rx-1,y-Rx-2,y)+(2Rx+1,y-Rx+2,y)]

(2)

步骤 3输出像素值Rxyout代替原像素值Rxy。

式(1)在计算Rxyout时进行了判断:当Rxy介于Rmin和Rmax之间时,认为该点不是噪声点并输出原值;否则认为该点是噪声点并输出Rnew。在计算Rnew时假设邻域各向梯度具有一致性,以降低将非噪声极值点误判为噪声点造成的过度平滑,最大程度上保留了图像的细节信息。

2.2.2 LR算法

运动模糊图像可通过基于贝叶斯理论的LR算法得到复原[26-27],核心原理如下:

(3)

式中:g(x,y)表示原始模糊图像;fn(x,y)表示第n次迭代后图像;h(x,y)表示退化系统。若退化系统已知,则在LR算法中经有限次迭代,即可实现图像空间域的复原,因此解决运动模糊问题的关键是对退化系统准确估计。假设图像为线性模糊,则需对运动模糊方向和尺度进行准确估计。

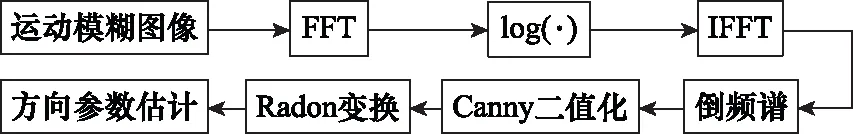

文献[24]指出运动模糊中高频成分在运动方向下降较多,而在其他方向影响较小,可利用该特性在频域内对运动模糊方向求解。倒谱法求解运动方向参数过程如图4所示,首先对退化图像进行快速傅里叶变换(fast Fourier transform, FFT),取对数后再逆向FFT(inverse FFT, IFFT),得到倒频谱后,经阈值处理并通过Canny算子对频谱二值化,最后利用Radon变换求出模糊矩阵,选取最大值后估算运动方向角度。

图4 倒谱法运动方向参数估计

联合图像频率域和空间域的信息实现运动尺度参数估计。首先将退化图像FFT操作后转移零频点至频谱中心,然后求频域矩阵各点绝对值的对数,按行或列求对数和;以图像空间域中心为起点,分别计算两侧对数和最小值出现的行数或列数,经倍数转化即可求出运动尺度估计。

对导引头图像首先利用ISSF降噪滤波处理,计算运动模糊参数估计后使用LR算法进行抑制模糊,实现增强图像成像效果的目的。

2.3 识别模块原理

目前深度学习目标检测框架有两类:检测精度较高的双步法和检测效率较好的单步法。考虑到检测效率对导弹打击精度影响更大,以综合性能较优的YOLOv3单步检测神经网络为基础,通过改进网络结构,提出更适合导弹识别任务的目标识别算法。

对陆导弹目标打击任务下达后,每枚导弹打击目标基本明确,仅需对单一目标网络训练,与常规识别任务相比,泛化能力要求不高。但随着弹目距离减小,导弹识别全过程中目标的尺度差异较大,需增强尺度变化适应能力。因此,采用特征金字塔网络(feature pyramid networks, FPN)思想,扩展多尺度检测结构,增强网络鲁棒性[28]。可以通过大量采用深度分离卷积代替普通卷积,降低网络参数量和计算量以满足弹载计算机的性能。使用k-means聚类算法式(4),距离函数指标为

(4)

式中:hmin和hmax分别为纵向最小距离和最大距离;wmin和wmax分别为横向最小距离和最大距离。预设锚框尺寸,进一步提高识别精度。

基于以上分析,通过精简特征提取网络、改进多尺度特征融合、引入深度分离卷积、锚框尺寸优化等措施,设计改进YOLOv3导弹目标识别网络如图5所示[5]。

图5 改进YOLOv3网络结构

2.4 抗干扰模块原理

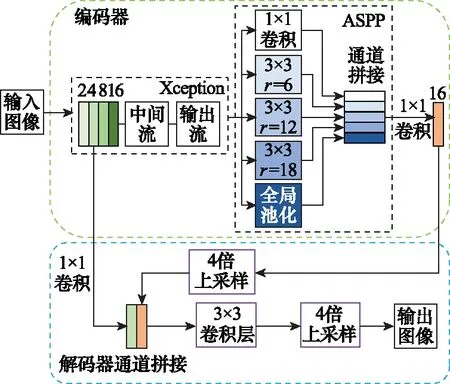

深度学习语义分割算法可实现像素级目标分类,适合烟雾等非标准形态的目标检测。抗干扰模块使用近年来综合性能优异的Deeplabv3+网络作为烟雾检测基本算法,其网络结构如图6所示。

图6 Deeplabv3+算法的网络结构

Deeplabv3+使用Xception 65网络提取目标特征,由输入流、中间流和输出流串联,生成分辨率为原始图像1/16的特征张量;将提取的特征张量传入基于空洞卷积的特征金字塔(atrous spatial pyramid pooling, ASPP)结构。该结构使用3种不同扩张率的并行空洞卷积层增大核感受野,经拼接处理后通过1×1卷积通道压缩。解码器结构中,对来自ASPP结构的特征张量通过双线性插值4倍上采样,然后与来自骨干网络的同分辨率特征图拼接,再次经3×3卷积和4倍上采样操作后输出分割结果。

由于烟雾这类非刚性目标空间形态的尺度变化较大,基础网络难以适应烟雾形变。可以从3个方面改进[29]:首先,通过异感受野融合的方式改进ASPP结构,提高信息利用率;其次,优化骨干网络中间流结构,将多尺度特征张量拼接传入Decoder模块;最后,特征融合中融入通道注意力模块(channel attention module, CAM),优化网络通道权重配置。改进后Deeplabv3+算法的网络结构如图7所示。

图7 改进Deeplabv3+算法的网络结构

2.5 判别分析模块原理

判别分析模块包括目标判定和目标位置判别中心分析两个环节,其作用是对来自识别模块和抗干扰模块的输出结果联合分析,判定识别目标是否成功,并计算目标位置判别中心的位置。基于场景阶梯式分析思想[30],将识别模块输出的预测框类别进行标记分级,模型对上级大尺度场景成功识别后,只有在大部分下级较小尺度场景预测框位于上级场景预测框内时,才会进行进一步的目标判定和目标位置判别中心分析,否则直接判定为干扰目标予以排除。

目标判定环节使用阈值法判断是否识别目标成功。图像传入目标识别模块和抗干扰模块后,YOLOv3改进算法输出一个矩形框实现目标分类和定位,Deeplabv3+改进算法输出烟雾的分割区域。判断烟雾区域是否位于矩形框内,若不在则认为目标未被烟雾遮挡,目标识别成功;反之,则通过判断框得分阈值G0与利用抗干扰式(5)的得分GX:

(5)

大小关系确定目标是否识别成功,若GX≥G0则认为识别成功,否则识别失败,需重新识别。其中,Ssmoke和Sbox分别表示矩形框中烟雾分割区域的面积和矩形框的面积;scoreX表示输出该矩形框的得分。

由于烟雾遮挡干扰,目标可能被烟雾贯穿分割成若干个子区域,YOLOv3改进算法识别时将针对子区域输出多个预测框,破坏预测框的完整性。对此提出预测框合并规则,如图8所示。计算预测框X1和X2相邻边界围成的框间区域内烟雾填充率FX1,X2,若FX1,X2小于预设阈值F0则认为两个预测框的分离不是烟雾贯穿分割造成的,不能合并预测框;否则,将两个预测框的外接矩形视为合并框,作为目标的输出。

图8 预测框的合并规则

烟雾填充率的计算如下:

(6)

式中:h和w表示框间区域的尺寸。

目标位置判别中心分析环节使用矩平衡法计算矩平衡点作为目标位置判别中心。烟雾区域与目标预测框有3种空间关系:相离、相交未贯穿和相交且贯穿。假定目标矩形区域服从均一分布特性,则相离情况下几何中心即为矩平衡点;相交未贯穿时计算矩平衡点:

(7)

相交且贯穿时,被分离矩形框中归一化面积低于设定阈值S0的分块则不参与矩计算,排除小区域引入的定位误差,然后利用式(7)计算矩平衡点。

3 模型仿真与性能测试

在Tensorflow环境下,使用Python编辑器对模型实现进行仿真,检测模型性能。

3.1 导引头成像仿真

导弹打击想定目标如图9所示,该图像为无人机通过可见光成像实拍的建筑物。在导弹目标识别模型正式测试前,运用密集匹配与重建技术构建该建筑的3D模型并训练好改进的YOLOv3识别网络,同时通过烟雾数据集训练好改进的Deeplabv3+烟雾区域分割网络。运用图像处理技术进行导引头成像仿真,如图10所示。图10(a)为原始图像,图10(b)为加入了烟雾遮挡干扰的模拟图像,图10(c)是在图10(b)的基础上加入运动方向参数为127°、尺度参数为55的运动模糊,以及由方差为5.67×10-3的白噪声和密度为5.64×10-3的椒盐噪声合成的混合噪声后生成的导引头模拟图像。导引头模拟图像样本集包括220张480×320的单通道灰度图像,可以测试导弹目标识别模型的性能。

图9 想定目标实拍图像

图10 导引头成像仿真

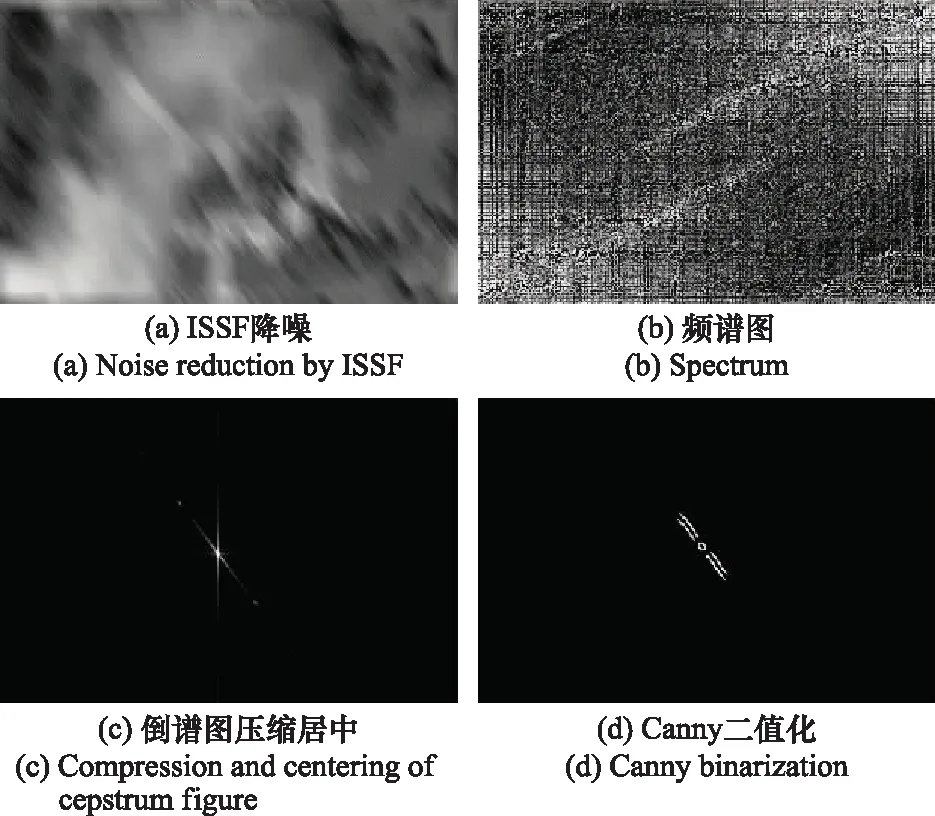

3.2 模型实现与性能测试

预处理模块依次通过ISSF算法和LR算法实现降低噪声强度和运动模糊。对于图10(c)所示的导引头模拟图像,ISSF算法处理后效果如图11(a)所示;然后FFT求得其频谱图如图11(b)所示;取对数后再进行IFFT得到倒频谱,压缩居中后其频谱图如图11(c)所示;利用Canny边缘检测算法实现倒谱图二值化后其频谱图如图11(d)所示;对二值化图做θ∈[0,180]的Radon变换后其频谱图如图11(e)所示,对函数极大值对应的横坐标加减90°,取计算后位于区间[0,180]的计算结果即为估计运动方向,图示计算结果为125°。对图10(c)取计算运动尺度大小为65,将运动方向和尺度参数传入LR算法,运动模糊复原效果如图11(f)所示,至此完成预处理。

图11 预处理过程

以每秒检测帧数(frames per second, FPS)为效率评价指标,以皮尔逊积矩相关系数(pearson product-moment correlation coefficient, PPMCC)测定预处理前后图像的空间相关性,并作为预处理效果评价指标。计算方法如下:

(8)

利用模拟图像样本集,考察预处理模块复原性能与LR算法迭代次数的关系,结果如表1所示。综合考虑导弹目标识别任务要求,将LR算法的迭代次数设置为16,此时PPMCC为0.941,FPS为47,同时具备较高的复原精度和效率。阈值法判定识别结果如图12所示。

表1 预处理模块复原性能测试

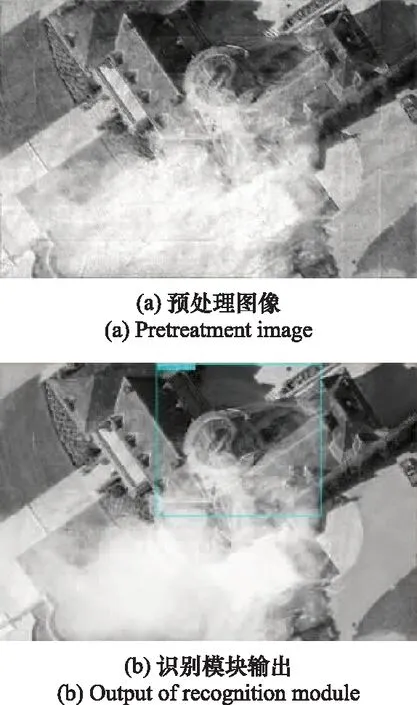

图12 烟雾区目标识别结果

图12(a)为预处理后的导引头模拟图像,图12(b)为训练好的识别模块对目标识别结果,图12(c)为训练好的抗干扰模块检测到的烟雾区域。设置判定阈值G0=0.1,目标预测框得分为0.12,经测算预测框内烟雾区域面积占比为50.11%,利用式(5)计算该图抗干扰得分为GX=0.06,小于设定的阈值,因此认为本帧图像识别失败。由本例可知,阈值法判定规则通过将抗干扰得分低的识别结果认定为识别失败,排除了较差识别结果对模型识别性能的影响,有利于提高模型识别稳定性。

预测框合并处理结果如图13所示。设置烟雾填充率阈值F0=0.5,图13(a)为某张预处理后的图像,图13(b)为识别模块识别结果,图13(c)为烟雾检测结果。经测算,图13(b)两框间烟雾填充率为FX1,X2=0.631,满足FX1,X2>F0,因此将两预测框的外接矩形作为新的目标预测框,如图13(d)所示。由本例可知,合并框具有比单一框更好的目标覆盖效果,有效排除了烟雾贯穿目标区造成的单一框目标位置判别精度差等问题,有利于提高算法识别定位精度。

图13 预测框合并规则处理结果

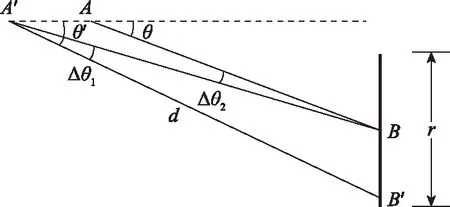

目标定位精度分析如图14所示。A为标注框中心,认为该点为目标位置基准点;B为矩平衡法计算的输出框目标位置判别中心,二者间的相对定位偏差由γ表示,由图14可知满足:

图14 定位精度分析示意图

γ=max[m,n]

(9)

γ≤1则说明导引点位于目标区域,模型能正确捕捉到目标;反之则说明丢失目标。

以目标识别准确率P、召回率R、相对定位偏差γ、γ>1比率和每秒检测帧数FPS为指标,导弹目标识别模型和基于灰度的归一化积相关(normalizated product correlation, NProd)算法经典模板匹配算法对建筑样本集的整体识别性能量化分析如表2所示。由表2可知,在存在烟雾遮挡和多种类型干扰条件的情况下,本文导弹目标识别模型P和R均高于基于NProd的模板匹配算法,具备较好的识别能力;相对定位偏差γ相近,且γ>1比率均为0,说明模型在满足判别分析模块判定准则的条件下正确标记目标区域概率为100%,具备识别即捕捉的能力和良好的定位精度。但是每秒检测帧数和模型内存与基于模板的识别算法有一定差距,说明本文模型的检测效率和工程实用性存在进一步改进的空间。

表2 导弹目标识别模型对样本集识别结果

3.3 模型导引精度分析

本文模型通过分析目标在获取图像中的位置,解算导弹当前位置与目标打击位置的偏差,生成弹体姿态控制指令,引导导弹飞向目标区,因此模型的识别精度、定位精度和检测效率都将对目标位置判别精度产生影响。不考虑导弹其他系统误差和工程制造精度误差的前提下,下面分析本文模型的位置判别精度对导引精度的影响。

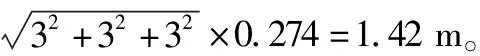

以某型海射对陆攻击导弹及相关参数为蓝本,设置仿真参数如下:导弹在距离目标6~12 km时导引头首次开机确定导弹导引方位,导弹在距离目标2~6 km时二次开机识别目标最佳命中区。导弹末端马赫数M=0.62 Ma,成像系统光学视场角为4.8°×3.2°,输出像元数480×320,每个像素对应视角为0.01°×0.01°,典型建筑目标尺寸为50 m×50 m×30 m,最佳命中区为3 m×3 m×3 m。依据前文识别结果,目标识别算法正确输出的最小识别框为21×13像素、烟雾条件下目标位置判别中心平均偏移为27.4%、检测效率为 9.73 FPS,设定模型能够识别目标最小视角为0.21°×0.13°,γ=0.274,检测周期τ=0.103 s。

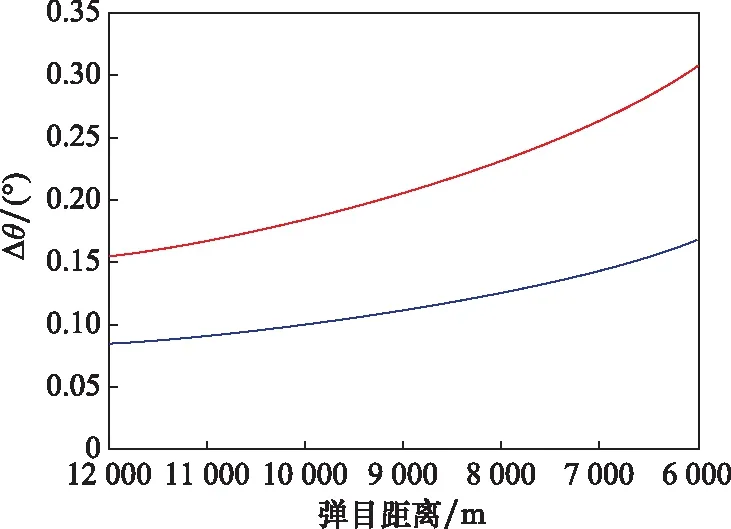

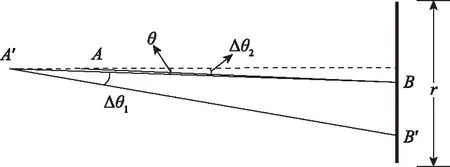

目标识别模型引起的视线角误差如图15所示。

图15 目标识别模型引起的视线角误差

假设导弹沿虚线A′A飞行,T0时刻导弹位于点A,目标最佳导引点位于点B,弹目距离为d,真实视线角大小为θ。目标识别模型检测效率并非无限大,导弹在A点时控制模型接收到的导引指令,乃是上一周期目标识别时导弹在A′点的模型输出视线角θ′解算后得到的,由于存在目标位置判别中心偏移,在A′点时模型输出的目标位置判别中心点位于B′。记目标位置判别中心偏移引起的视线角误差为Δθ1(偏移远离航路为正),检测周期引起的视线角误差为Δθ2(导弹接近目标时为正),在A点模型引起的视线角误差为

Δθ=|θ-θ′|=|Δθ1-Δθ2|

(10)

由几何关系得

(11)

(12)

设定音速为us,BB′方向上目标的尺度为r,联立式(10)~式(12)可得

(13)

图16 初次开机后导引头视线角误差

图17 导引头二次开机对最佳命中区的识别

文献[20]指出,使用提供区分服务的信道接入协议系统的某型巡航导弹对陆上目标的识别理论精度为6~10 m,实战精度为15~18 m。本文模型在仿真实验中,导引头初次开机目标识别时视线角导引误差不大于0.3°,在二次开机识别最佳命中区时空间误差不大于1.42 m,具备更好的导引精度,验证了基于深度学习的对陆导弹目标识别模型的可行性和有效性。

4 结 论

在舰载对陆攻击巡航导弹末制导自动目标识别技术中,针对传统的基于前视模板匹配算法难以直接识别和跟踪建筑等小型固定目标的问题,提出基于深度学习的对陆导弹目标识别模型。该模型对导引头图像预处理后,利用训练好的深度学习网络识别目标,并通过并行识别方案排除烟雾遮挡干扰,经判断识别成功后直接输出导引中心位置。仿真实验证明,该模型对陆上建筑目标有更好的识别精度,为对陆导弹自动目标识别提供了新的技术手段,对提高对陆导弹的作战能力具有较高的实际意义。