星地协同光学遥感影像目标识别技术验证研究

薛武 赵玲,2 王鹏

星地协同光学遥感影像目标识别技术验证研究

薛武1赵玲1,2王鹏1

(1 航天工程大学,北京 101416)(291039部队,北京 102400)

为了提高光学遥感卫星信息处理的时效性,文章提出了星地协同光学遥感影像在轨目标智能识别技术框架。将基于遥感大数据的深度学习、神经网络模型训练等数据量大、运算量大、计算复杂、要求较高的处理任务部署在地面服务器,将深度学习训练得到的模型进行压缩并上注至卫星,卫星在轨利用轻量化模型对影像进行推理计算,最后把目标识别结果下传至用户。为了对所提出的技术框架进行验证,在高性能服务器和嵌入式开发板上进行了验证试验,利用YOLO-v5算法和DIOR遥感数据集进行了测试,结果表明:在模拟星载计算环境下,处理100km2范围1m分辨率遥感影像耗时17.74s,平均精确度(Mean Average Precision,mAP)为87.2%。文章提出的星地协同智能目标识别技术框架实时性和精度上能够满足应用需求,具备一定的可行性,可以进一步开展在轨验证试验。

星地协同 目标识别 深度学习 验证试验 遥感应用

0 引言

经过多年的建设发展,中国逐步构建了比较完备的航天遥感、地理测绘、海洋监测等对地观测卫星体系,在地理国情监测、资源普查、基础测绘等领域发挥了重要的作用,取得了显著的经济和社会效益。特别在“高分”专项的持续推动下,中国遥感卫星进入了空前发展时期,多平台、多传感器、多时相的海量对地观测数据,为国民经济建设提供日益丰富的数据资源[1]。但受限于空间环境、质量、体积、功耗等因素,目前遥感卫星在轨信息处理能力较弱,主要完成数据采集和少量预处理工作。数据处理主要通过地面设备和人员进行,因此导致卫星对地观测数据处理自动化程度低,信息提取的时效性较差等问题。随着各行业对于卫星遥感信息时效性要求越来越高,传统的“卫星数据获取—地面站接收处理—数据分发—专业应用”的模式无法满足用户的时效性要求。

因此,在努力追求更高空间分辨率、光谱分辨率和时间分辨率,提高数据获取品质的同时,应提高遥感信息处理的时效性,特别是提高卫星在轨的数据处理能力。目前来看,受限于卫星的质量、体积、功耗以及信息处理硬件的发展水平,将信息处理设备直接“搬运”到星上的方式是尚不具备可行性。仅以当前光学遥感影像智能目标识别为例,以卷积神经网络为代表的深度学习算法取得了传统机器学习算法难以达到的效果,展现出巨大的应用潜力[2-3]。但深度学习需要依赖高性能的服务器进行模型的训练与验证工作,对硬件的计算和存储能力要求都很高,即使是模型推理,也十分消耗硬件资源,就目前卫星的计算能力来看,无法满足深度学习算法的需求。

各航天大国一直很重视对星上信息处理技术的研究,已有不少在遥感卫星上采用高速处理器件实现特定实时处理功能的先例。目前的星上处理任务主要集中在图像预处理、海量数据存储与格式转换、数据压缩与转发、原始数据的自动分析及目标的特征提取等功能上,力图依靠星上自主处理,最大限度地减少地面干预。

美海军“地球绘图观测者”卫星采用了美国海军研究所研制的光学实时适应信号识别系统,能够进行星上超光谱数据的实时自动数据分析、特征提取和10:1~20:1数据压缩处理,并实时地以战术下行线路将观测结果从卫星直接传送到战场[4]。美国为了实现向作战单兵提供实时遥感情报分发,发射了“战术星-3”(TacSat-3)试验卫星,能够在10min内完成从发出观测任务指令到作战人员接收信息的全过程[5]。

德国宇航局的双光谱红外探测小卫星主要用于地面火灾监视,其有效载荷包括双光谱红外过热点识别系统,其在轨处理系统实现了可见光、中波红外和热红外3个波段图像在星上的辐射校正、几何校正、纹理提取和神经网络分类等处理,实现对亚像元级热点的探测[4]。

法国研制的高分辨的光学卫星“Pleiades”采用了可重构FPGA作为模块化的星上图像数据处理器(Module Video Processor,MVP)核心,实现片上的数据采集、像元对齐、热控、电控等功能。其中的图像压缩模块采用基于小波的图像压缩算法,压缩比7:l(标准方法4.8:1),依据国际空间数据系统咨询委员会规范对输出数据进行打包[4]。

文献[5]从遥感卫星技术与信息技术深度融合的角度,阐述了未来遥感卫星运营模式和服务模式可能的变革方向。提出了未来新型智能遥感卫星的总体概念设想及一种具备开放软件平台、网络接入、可以支持第三方灵活开发并上注应用程序的智能遥感卫星,给出了一种由智能遥感卫星、云服务中心、星地网络组成的智能遥感卫星系统;文献[6]在分析未来空间信息系统发展需求以及现有空间信息系统建设所存在的弊端的基础上,从顶层设计入手,提出了以“软件星”为基础的空间信息系统发展新策略,并提出了基于“软件星”的综合一体化空间信息系统建设的初步设想;文献[7]提出了智能高光谱卫星的概念,智能高光谱卫星成像系统包括前视预判相机和主相机,前视相机用于云监测、气溶胶光学厚度以及水汽含量的反演,以及成像区域地表覆盖与背景辐射信息的初步估算,为主相机成像提供重要依据,主相机以最优化模式对地表进行光谱成像;文献[8]提出了未来空间信息网络环境下对地观测脑的概念,即基于事件感知的智能化对地观测系统,并介绍了对地观测脑的概念模型及需要解决的关键技术,举例说明了对地观测脑初级阶段的感知、认知过程。将来对地观测脑可以回答何时、何地、何目标发生了何种变化,并在规定的时间和地点把这些正确的信息推送给需要的人的手机或其他智能终端,全球用户可实时获得所需的任何数据、信息和知识。

然而,以上研究仍然主要集中在数据预处理相关的初级算法,实现基于专业模型直接生成用户可用的信息产品的高级算法仍存在较大困难。因此,未来智能遥感卫星将卫星数据的获取和应用结合在一起,将应用分析模块固化到卫星上,使得数据处理和分析与有效载荷数据获取系统连为一体,数据获取后可在星上直接处理生成信息产品,为用户提供实时服务。

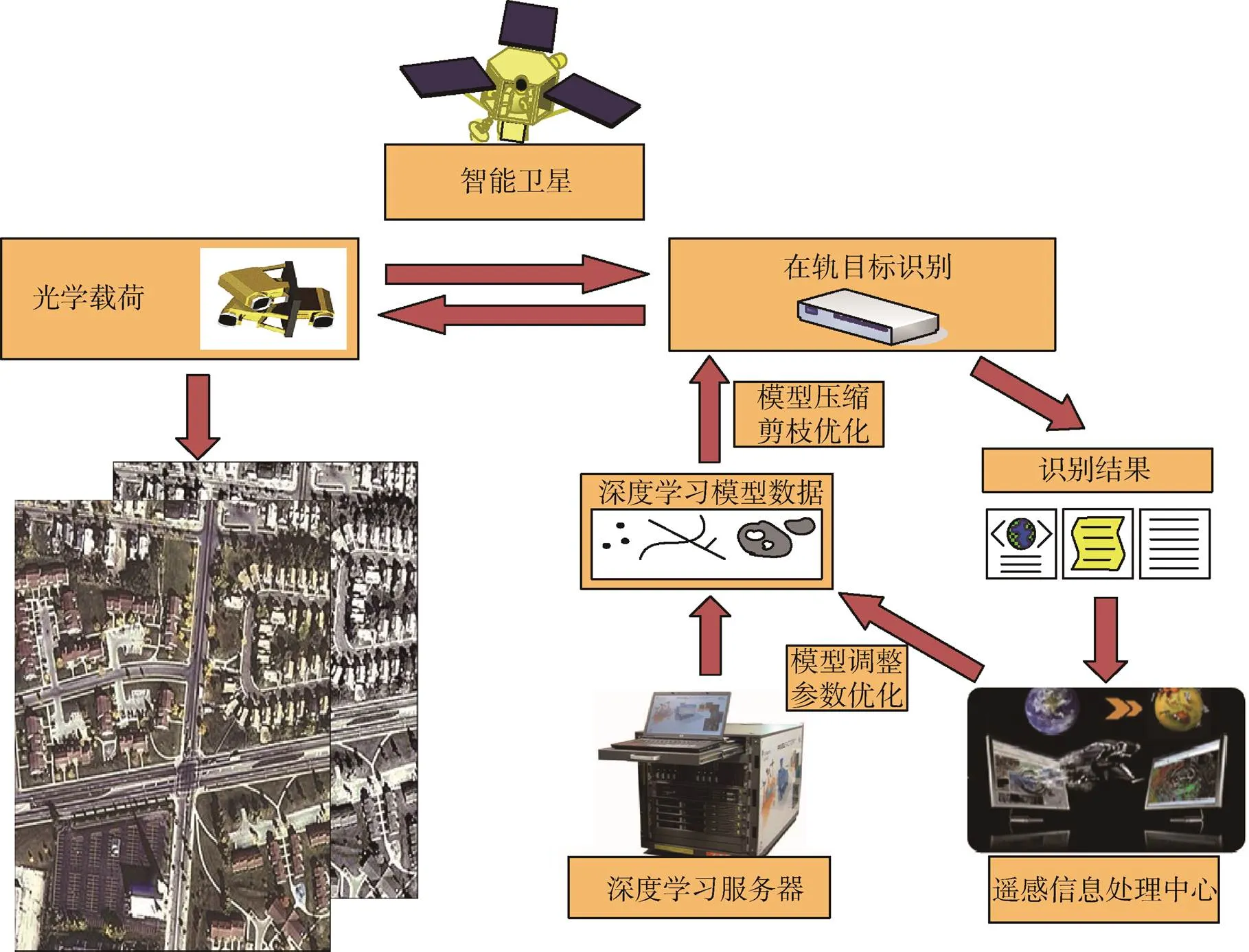

本文结合当前主流卫星计算能力和嵌入式设备算力的发展现状,提出了星地协同光学遥感影像在轨目标智能识别技术框架。所谓星地协同,就是将历史数据的深度挖掘、基于遥感大数据的深度学习、神经网络模型训练等数据量大、运算量大、计算复杂、要求较高的处理任务部署在地面系统,将深度学习训练得到的模型参数等上注至卫星,在轨通过模型推理对影像进行实时智能处理,直接将处理结果下传至用户,大幅提高卫星的智能化水平和遥感信息应用的时效性。

为阐述星地协同的遥感信息智能处理的理念并进行原理性验证,本文以高分辨率光学卫星影像在轨目标识别为例,开展了相关研究和实践工作。

1 技术框架及关键技术

1.1 技术框架

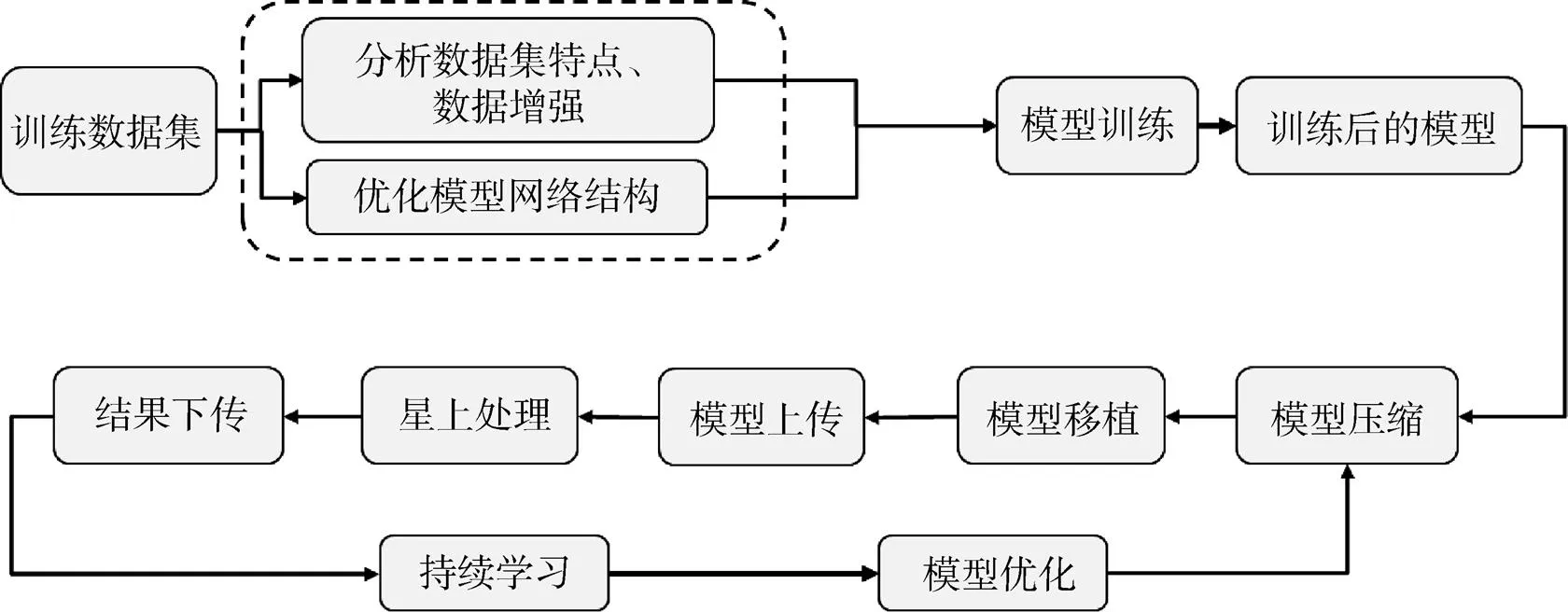

星地协同光学遥感影像在轨目标智能识别技术框架的核心思想是构建“地面模型训练—模型压缩—模型上传—星上处理—结果下传—地面检核—模型修正—更新上传”的良性循环回路,如图1所示。卫星在轨实时处理遥感影像,将信息产品传输至地面用户,提高了遥感信息应用的时效性。同时,随着深度学习模型的持续优化迭代,在轨处理结果的可靠性与精度不断提高。星地协同光学遥感影像在轨目标智能识别技术框架涉及多项关键技术,技术流程如图2所示。技术流程图展示的是星地协同处理的完整技术流程,本文重点对其中的模型训练、模型压缩和迭代优化技术进行研究。

1.2 关键技术

(1)基于深度学习的光学遥感影像目标检测识别技术

基于深层神经网络的深度学习方法在目标识别研究中取得了良好的效果,并展示出巨大的应用潜力。按照“是否生成区域建议”,可以分为“两步法”和“一步法”。

“两步法”将目标检测框架分为两个阶段。第一阶段的重点是生成一系列可能包含目标的候选区域建议。第二阶段的目标是将第一阶段获得的候选区域建议分类为目标类或背景,并进一步微调边界框的坐标。比较具有代表性的“两步法”目标识别算法有R-CNN[9]、Fast R-CNN[10]、Faster R-CNN[11]、Mask R-CNN[12-13]等;“一步法”是指直接将检测简化为一个回归问题。与基于区域建议的方法相比,基于回归的方法更简单、更有效,因为不需要生成候选区域建议和随后的特征重新采样。比较具有代表性的“一步法”目标识别方法有You Look Only Once(YOLO)[14-15]、Single Shot multibox Detector(SSD)[16]和RetinaNet[17]等。

图1 技术框架示意

图2 关键技术流程

在众多的目标检测识别算法中,YOLO算法凭借其良好的性能和效率在诸多领域取得了成功的应用,并相继推出了v1~v5多个版本。文献[16-17]开源了YOLO-v4,采用多种改进策略,在COCO数据集上几乎是当时综合性能最好的算法。Ultralytics更新了YOLO-v5(https://github.com/ultralytics/yolov5),包括4个不同的版本:YOLO-v5 s、YOLO-v5 m、YOLO-v5 l、YOLO-v5 x,其s版本体积只有YOLO-v4的十分之一,推理速度是v4版本的近3倍。

光学遥感卫星在轨目标检测识别对算法的精度和速度均有较高的要求,为验证在轨处理的可行性,本文对具有代表性的目标检测识别最新算法YOLO-v5开展试验测试。

为了使试验测试具有一定的可比性,选择在遥感公开数据集上开展试验。目前,光学遥感影像处理领域的公开数据集主要有TAS、SZTAKI-INRIA、NWPU VHR-10、VEDAI、UCAS-AOD、DOTA、DIOR等[18-19]。其中,DIOR数据集包含23 463幅遥感影像和190 288个目标实例,目标尺度变化大、影像类型丰富多样、类间相似性和类内多样性高,在众多数据集中具有明显的优势,适宜作为试验测试的基准。

(2)深层神经网络轻量化与加速技术

深度学习被认为是目前计算机图像处理领域中最先进的技术之一,虽然其功能强大,但网络中大规模的权值参数消耗了大量的计算和内存资源,如:AlexNet模型超过200Mbyte,YOLO-v4模型约250Mbyte,YOLO-v5 x模型约350Mbyte,VGG-16模型超过了500Mbyte,若将其传输至星上将相当耗费时间,且模型在星上运行还会占用相当大的计算和内存资源[20]。因此,需要研究深层神经网络轻量化与加速技术,以便于目标特征模型传输和部署到星上。网络模型轻量化的原则是在精度损失可接受的范围内尽可能压缩模型的大小,以便于在星上嵌入式系统部署和运行。

主流的深层神经网络轻量化与加速技术主要包括轻量化设计、模型剪枝、参数共享、低秩分解、知识蒸馏、权值量化和编码等技术,在边缘计算、移动端应用、在轨数据处理等领域有重要的价值[21-23]。

不同的深层神经网络轻量化与加速技术各有其优缺点,关于如何选择哪种技术尚无明确的准则,目前可供参考的经验主要有[21]:

1)对于在线计算内存存储有限的应用场景或设备,可以选择参数共享和参数剪枝方法,特别是二值量化权值和激活结构化剪枝,其他方法虽然能够有效的压缩模型中的权值参数,但无法减小计算中隐藏的内存大小,如特征图;

2)如果在应用中用到的紧性模型需要利用预训练模型,那么参数剪枝、参数共享以及低秩分解将成为首要考虑的方法,相反地若不需要借助预训练模型则可以考虑紧性滤波设计及知识蒸馏方法;

3)若需要一次性端对端训练得到压缩与加速后模型,可以利用基于紧性滤波设计的深度神经网络压缩与加速方法;

4)一般情况下,参数剪枝特别是非结构化剪枝能大大压缩模型大小且不容易丢失分类精度.对于需要稳定的模型分类的应用非结构化剪枝成为首要选择;

5)若采用的数据集较小时,可以考虑知识蒸馏方法,对于小样本的数据集学生网络能够很好地迁移教师模型的知识提高学生网络的判别性;

6)主流的几个深度神经网络压缩与加速算法相互之间是正交的,可以结合不同技术进行进一步的压缩与加速。

针对星上计算资源、功耗、内存受限的现状,瞄准任务实时性、可靠性要求高的难题,研究星上智能计算架构设计、星上智能算法设计以及基于星载嵌入式系统的运算加速技术,为星上智能实时处理提供技术支撑,提升空间系统的智能化水平和实时响应能力。

(3)星地协同模型迭代优化技术

星地协同计算一个突出的优势就是在星上计算资源有限的情况下,充分利用了地面系统的计算能力,将预先训练好的模型上注至卫星,获取影像的同时执行推理计算,得到目标检测结果。由于历史积累数据与真实数据之间存在差异,预训练模型的精度有待进一步提高。模型的优化是一个迭代的过程,需要星地协同配合实现,以光学卫星为例,其具体流程如下:地面模型迁移学习—预训练模型—模型上注—在轨推理—地面结果复核—地面模型持续训练优化—模型更新上注。

由于当前主流的深度学习目标检测算法已经有研究人员在计算机视觉开源数据库上进行了训练,并将训练结果开源。遥感领域的目标检测模型训练可以充分利用这些资源,节约较多的时间。由于遥感数据和计算机视觉数据在成像方式、尺度、目标类型、背景分布等方面有较大差异,因此直接利用计算机视觉开源数据集训练得到的模型进行推理的精度较差。利用计算机视觉中训练好的模型在遥感数据集上进行迁移学习训练,能够有效降低模型训练所需要的时间。迁移学习后可以得到目标识别的预训练模型,模型的精度取决于算法本身的精度以及采用的训练数据集与真实数据之间的相似性。

为了提高目标检测的精度,需要对迁移学习后得到的预训练模型进行迭代优化,即随着卫星在轨运行采集遥感数据的积累进行模型的持续学习,形成目标检测的闭环控制。

星地协同模型迭代优化技术主要研究星地协同智能处理闭环控制的实现方案,关键技术包括目标特征模型更新频率的自适应确定、抽样检核方案设计以及先验知识约束下的模型的迭代优化等。

2 模拟试验与分析

为了对本文提出的星地协同目标智能识别技术框架进行验证,搭建了验证环境,开展了演示验证试验,并进行了总结分析。

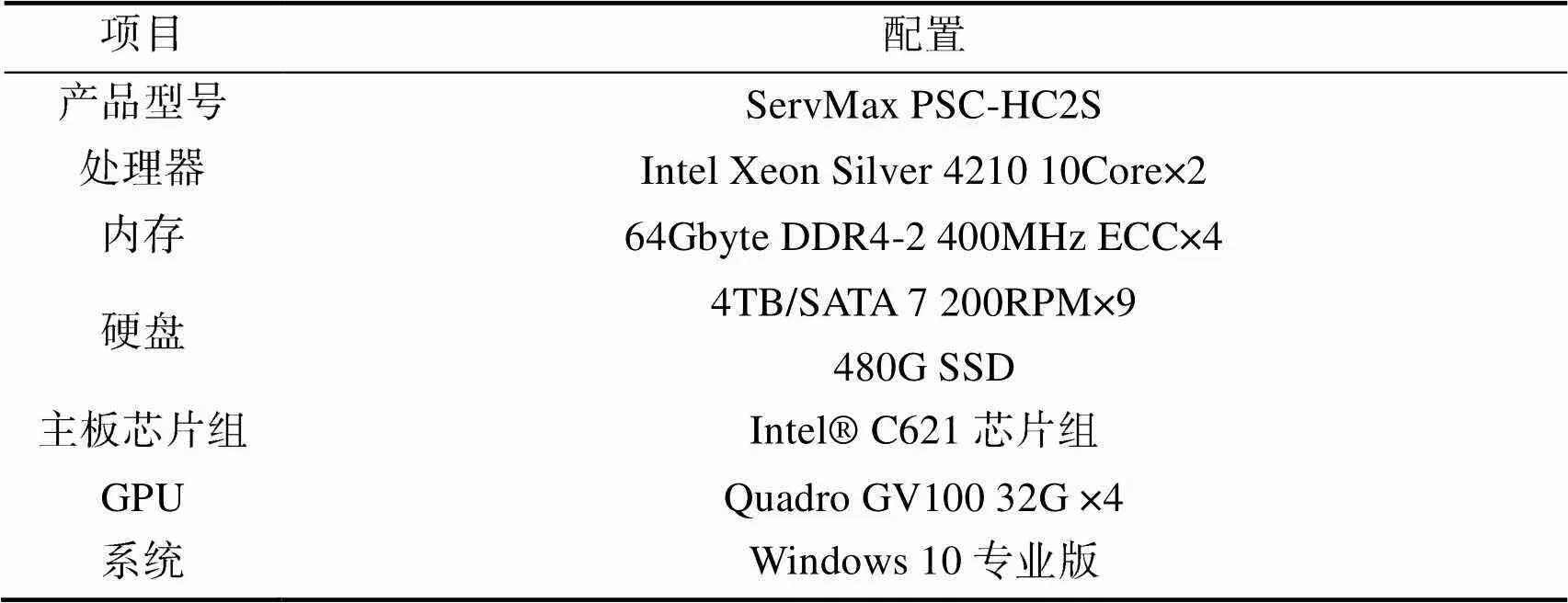

2.1 模拟验证环境搭建

由于在轨验证试验开展难度较大,本文在实验室搭建了星地协同目标智能识别的模拟环境。地面处理部分采用AMAX高性能服务器(GPU),软硬件配置如表1所示,模拟星上计算设备采用NVIDIA嵌入式开发板Jetson AGX XAVIER,软硬件配置情况如表2所示,测试数据采用DIOR数据集。

表1 AMAX高性能GPU服务器配置

Tab.1 AMAX high performance GPU server configuration

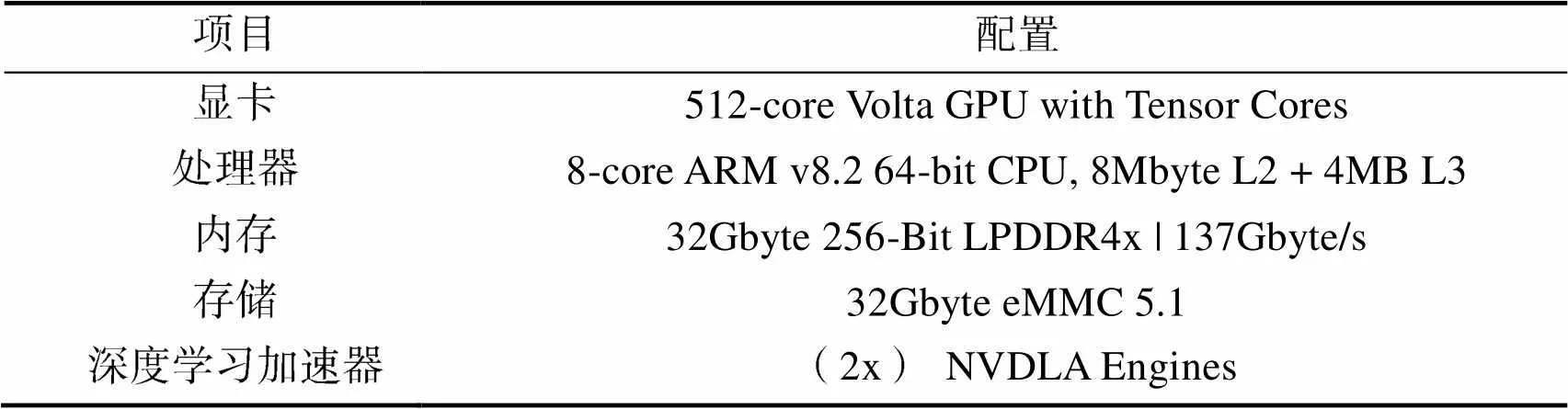

表2 Jetson AGX XAVIER配置

Tab.2 Configuration of Jetson AGX Xavier

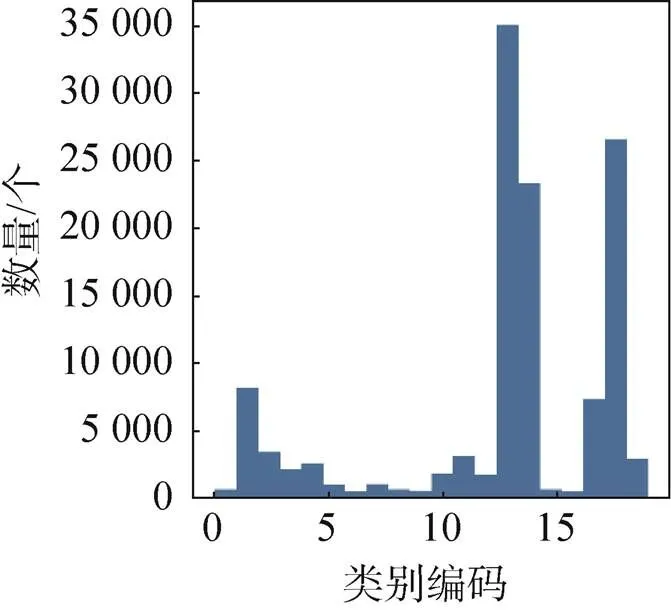

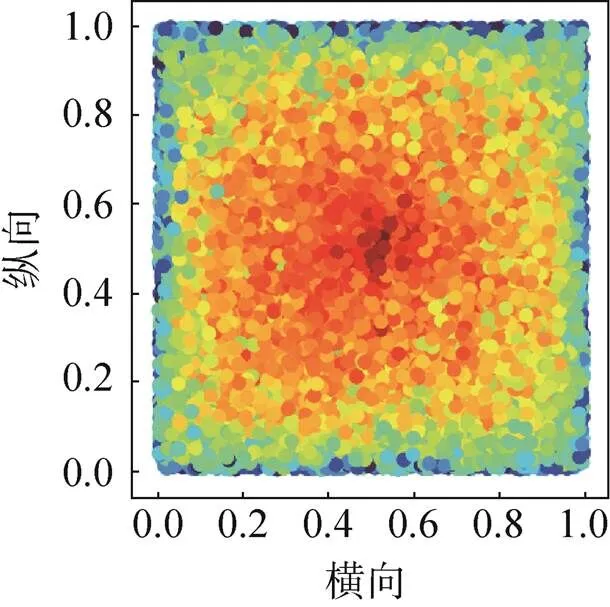

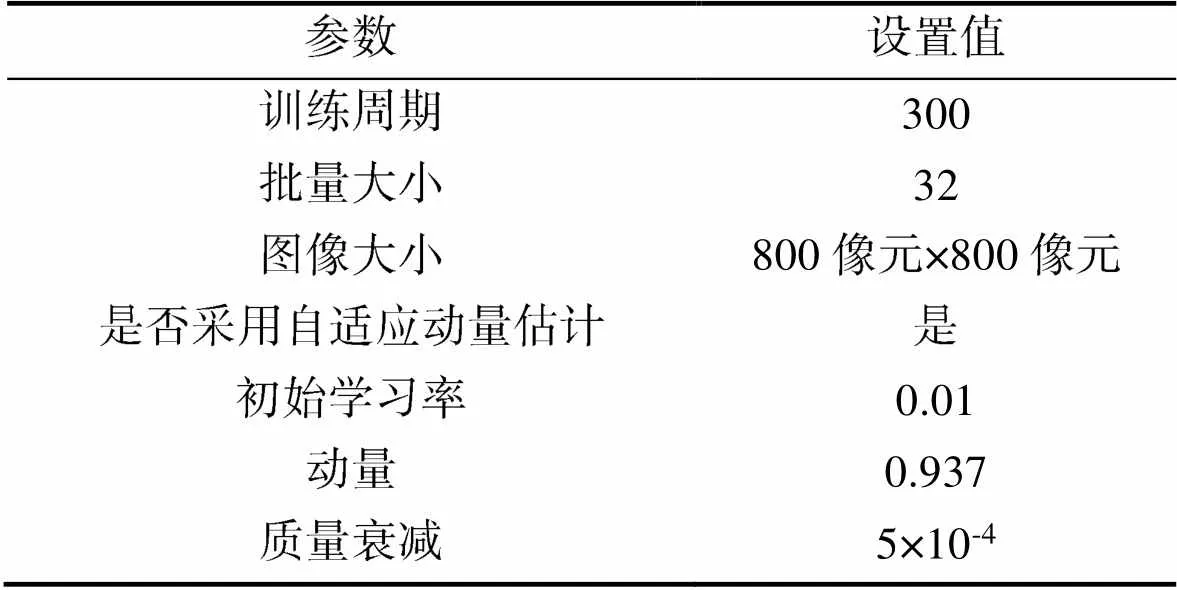

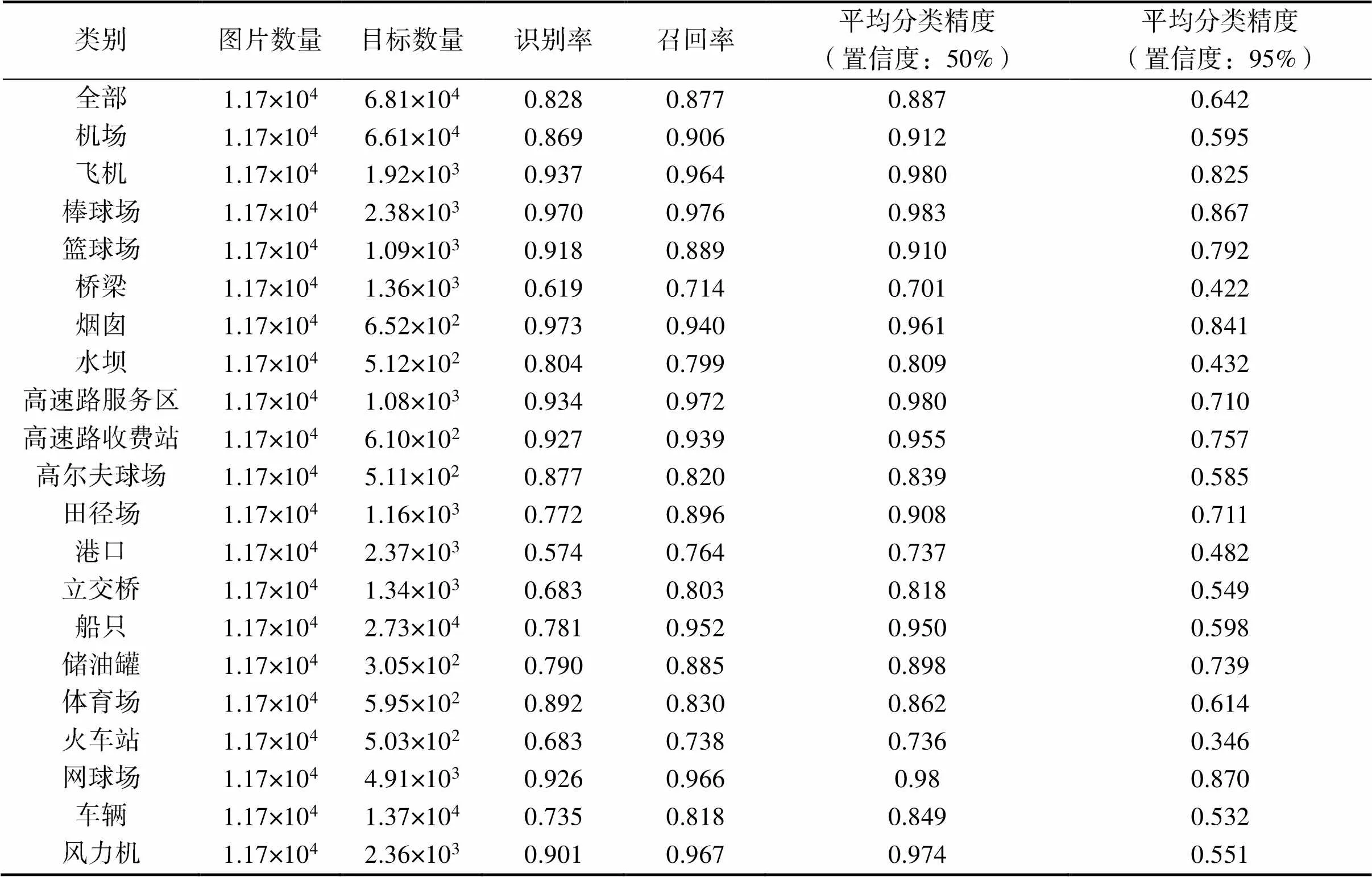

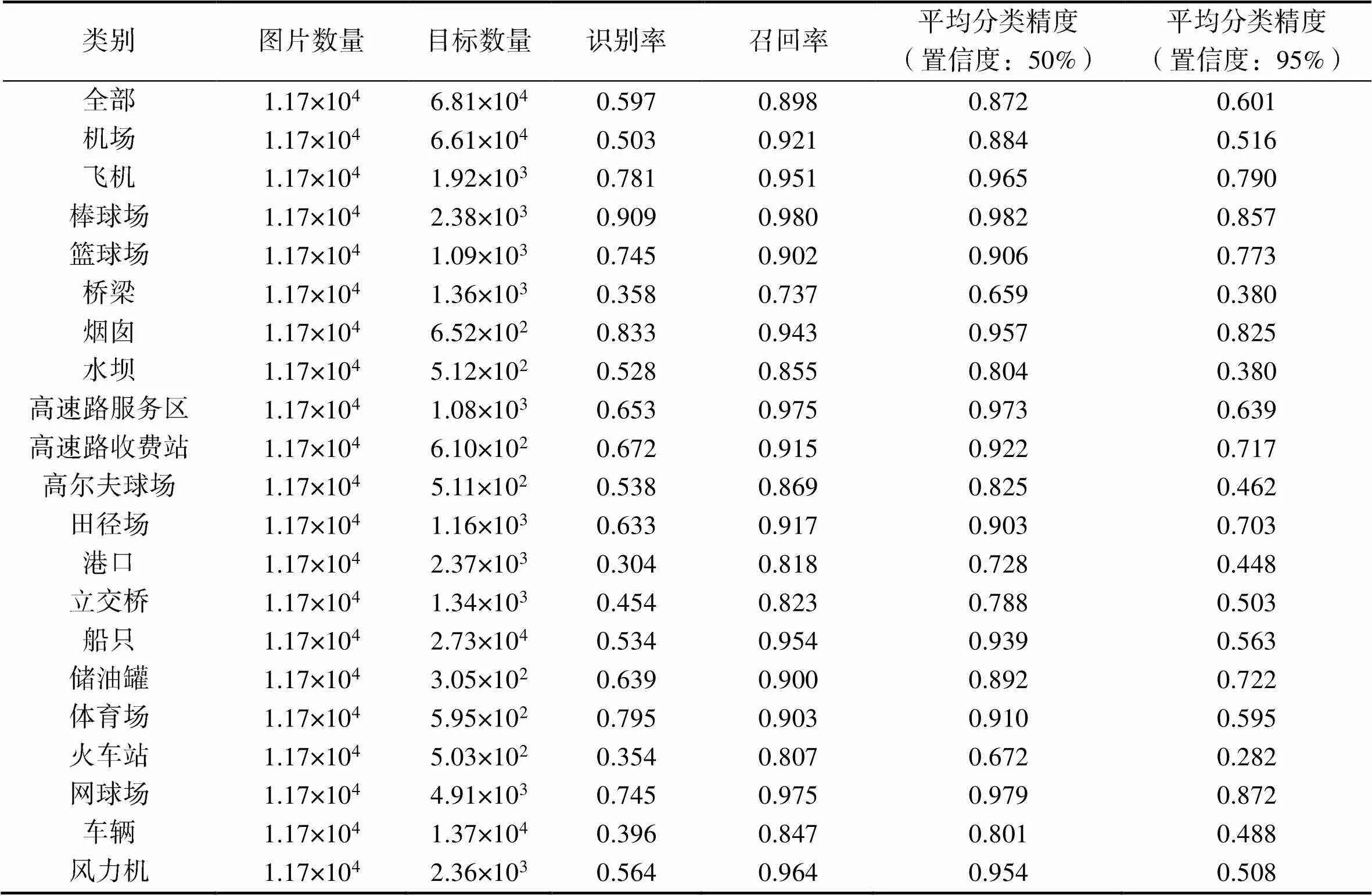

2.2 地面模型训练

在AMAX服务器上利用DIOR数据集开展YOLO-v5模型训练,DIOR数据集中不同类别的目标数量如图5所示,目标在影像上的分布情况统计如图6所示,目标大小情况统计如图7所示。YOLO-v5有多个版本,本文选择了x和s两个版本,x版本的网络模型最复杂,模型参数最多,理论上效率最慢、效果最好;s版本的网络模型结构最简单,参数最少,理论上效率最高、效果最差。通过两个版本的对比测试,可以验证YOLO算法的性能,为地面模型训练和星上推理验证提供依据。训练时利用了开源的COCO数据集预训练的模型进行迁移学习,训练过程中主要参数设置情况如表3所示,部分影像测试结果如图8所示。从随机抽取的影像中可以看出,无论是操场、网球场等大型目标,还是汽车、风车、船只等小型目标,均能够正确识别出来,说明迁移学习的有效性。训练结束后在验证数据集上,对两个版本模型的性能进行测试验证,统计其平均精确度(Mean Average Precision,mAP)、运行时间等,结果如表4、表5所示。

图5 训练数据集中不同类别目标数量

图6 目标在影像上分布位置情况统计

图7 目标大小情况统计

表3 训练过程参数设置

Tab.3 Parameter setting of training process

图8 部分影像测试结果

表4 YOLO-v5-x性能测试结果

Tab.4 YOLO-v5-x Performance test results

表5 YOLO-v5-s性能测试结果

Tab.5 YOLO-v5-s Performance test results

2.3 模拟星上模型部署与推理验证

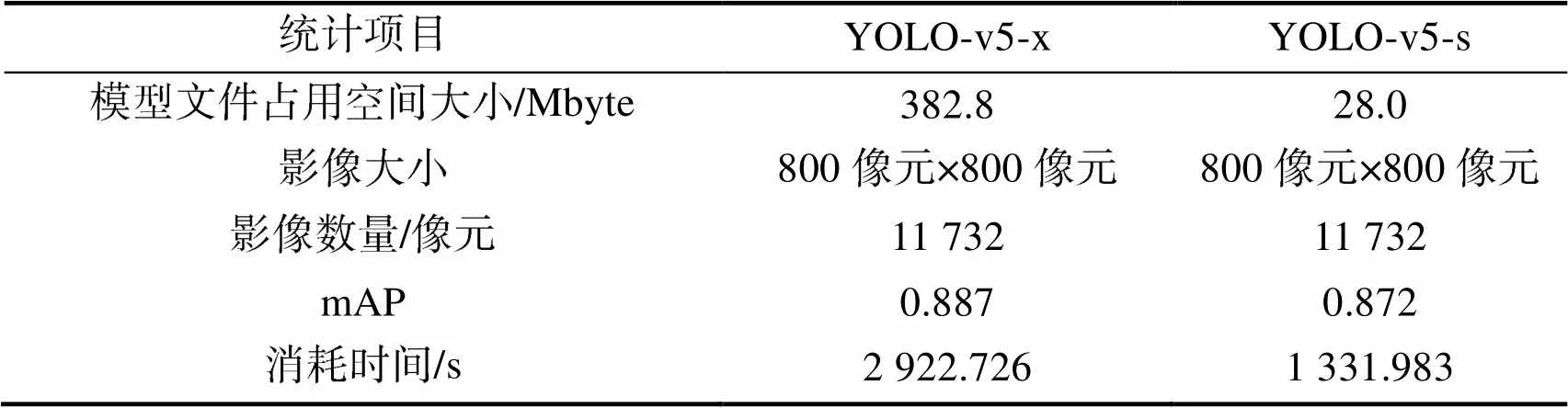

在AMAX服务器上模型训练结束后,将结果部署在嵌入式开发板Jetson AGX XAVIER中,利用DIOR数据集中的测试数据进行模型推理性能测试,并统计其mAP、耗时等指标。两个版本的统计结果如表6所示。

表6 模型推理性能测试结果

Tab.6 Model inference performance test results

2.4 模型优化与更新

在实际工程应用中,地面训练模型上注到卫星后,其精度需要通过持续学习不断迭代优化进行提升。主要方法是根据真实场景,在新获取数据积累到一定数量后,对模型进行继续训练,不断提高其精度。由于本文所采用的训练数据集与真实光学卫星影像的一致性很高,推理的精度与训练数据集比较一致,因此没有进行模型的再次更新。

对于新型传感器或新成像方式的卫星则必须进行模型的持续优化,否则受限于模型的泛化能力,基于公开数据集训练得到的模型精度较低,无法满足在轨目标识别的精度要求。

2.5 试验结果分析

1)分析2.2地面模型训练的结果可知,YOLO-v5模型具有良好的性能,在DIOR数据集上有良好的性能表现,x版本和s版本的mAP分别达到了0.887和0.872,AP值最高达0.98,满足大多数情况下的应用需求;

2)不同版本YOLO模型的精度差别不大,s版本仅比x版本下降了1.5个百分点,而模型大小不到其1/13,在嵌入式开发板上的推理速度是x版本的2.19倍,说明通过模型的轻量化设计实现了几乎不损失精度的前提下提高推理效率、节约内存资源开销的目的;

3)从表6中可以看出,运行软硬件环境的的变化并未对两个版本YOLO模型的mAP带来变化,即在嵌入式计算环境下其性能没有下降;

表7 推理效率等效计算

Tab.7 Equivalent calculation of inference efficiency

4)为了更加形象的表示模型的推理速度,便于卫星遥感领域应用分析,本文将YOLO-v5两个版本的推理效率换算到地面分辨率1m,像幅10 000像元×10 000像元的遥感影像,其地面覆盖范围10km×10km,其时间消耗情况如表7所示。

从表7可以看出,在单个Jetson AGX XAVIER开发板上采用YOLO-v5的s版本的模型处理百平方千米遥感影像消耗时间为17.74 s,mAP为87.2%,能够满足在轨快速处理的应用需求。

3 结束语

随着遥感卫星的快速发展,在轨处理、星地协同处理成为重要的发展趋势。本文提出了星地协同光学遥感影像在轨目标智能识别的技术框架,介绍了其基本原理和关键技术。基于构建的星地模拟计算环境,利用开源数据集,开展了演示验证试验。试验结果表明本文提出的星地协同智能目标识别技术框架实时性和精度上能够满足在轨处理应用需求,具备一定的可行性,可以进一步开展在轨验证试验。

[1] 李德仁, 童庆禧, 李荣兴, 等. 高分辨率对地观测的若干前沿科学问题[J]. 中国科学: 地球科学, 2012, 42(6): 805-813.

LI Deren, TONG Qingxi, LI Rongxing, et al. Current Issues in High-resolution Earth Observation Technology[J]. Scientia Sinica (Terrae), 2012, 42(6): 805-813. (in Chinese)

[2] 赵申剑. 深度学习[M]. 北京: 人民邮电出版社, 2017.

ZHAO Shenjian. Deep Learning[M]. Beijing: People's Posts and Telecommunications Press, 2017. (in Chinese)

[3] DENG J, DONG W, SOCHER R, et al. ImageNet: A Large-scale Hierarchical Image Database[C]// 2009 IEEE Conference on Computer Vision & Pattern Recognition, June 20-25, 2009, Miami, FL, USA. IEEE, 2009.

[4] 高昆, 刘迎辉, 倪国强, 等. 光学遥感图像星上实时处理技术的研究[J]. 航天返回与遥感, 2008, 29(1): 50-54.

GAO Kun, LIU Yinghui, NI Guoqiang, et al. Study on On-board Real-time Image Processing Technology of Optical Remote Sensing[J]. Spacecraft Recovers & Remote Sensing, 2008, 29(1): 50-54. (in Chinese)

[5] 杨芳, 刘思远, 赵键, 等. 新型智能遥感卫星技术展望[J]. 航天器工程, 2017, 26(5): 74-81.

YANG Fang, LIU Siyuan, ZHAO Jian, et al. Technology Prospective of Intelligent Remote Sensing Satellite[J]. Spacecraft Engineering, 2017, 26(5): 74-81. (in Chinese)

[6] 杨小牛. 基于“软件星”的综合一体化空间信息系统[J]. 中国电子科学研究院学报, 2004(4): 15-22.

YANG Xiaoniu. Integrated Spatial Information System Based on “Software Star”[J]. Journal of Chinese Academy of Electronic Sciences, 2004(4): 15-22. (in Chinese)

[7] 张兵. 智能遥感卫星系统[J]. 遥感学报, 2011, 15(3): 415-431.

ZHANG Bing. Intelligent Remote Sensing Satellite System[J]. Journal of Remote Sensing, 2011, 15(3): 415-43l. (in Chinese)

[8] 李德仁, 王密, 沈欣, 等. 从对地观测卫星到对地观测脑[J]. 武汉大学学报(信息科学版), 2017, 42(2): 143-149.

LI Deren, WANG Mi, SHEN Xin, et al. From Earth Observation Satellite to Earth Observation Brain[J]. Geomatics and Information Science of Wuhan University, 2017, 42(2): 143-149. (in Chinese)

[9] GIRSHICK, DONAHUE R, DARRELL J, et al. Rich Feature Hierarchies for Accurate Object Detection and Semantic Segmentation[C]//2014 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2014, Columbus, OH, USA. IEEE, 2014: 580-587.

[10] GIRSHICK R. Fast R-CNN[C]//2015 IEEE International Conference on Computer Vision (ICCV), December 7-13, 2015, Santiago, Chile. IEEE, 2015: 1440-1448.

[11] REN S, HE K, GIRSHICK R, et al. Faster R-CNN: Towards Real-time Object Detection with Region Proposal Networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[12] LIN T Y, DOLLÁR P, GIRSHICK R, et al. Feature Pyramid Networks for Object Detection[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. IEEE, 2017.

[13] HE K, GKIOXARI G, DollÁR P, et al. Mask R-CNN[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2020, 42(2): 386-397.

[14] REDMON J, DIVVALA S, GIRSHICK R, et al. You Only Look Once: Unified, Real-time Object Detection[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 27-30, 2016,Las Vegas, NV, USA. IEEE, 2016.

[15] BOCHKOVSKIY A, WANG C Y, LIAO H. YOLOv4: Optimal Speed and Accuracy of Object Detection[EB/OL]. [2020-10-11]. https://arxiv.org/abs/2004.10934.

[16] LIU W, ANGUELOV D, ERHAN D, et al. SSD: Single Shot Multibox Detector[EB/OL]. (2016-09-17)[2020-10-11]. https://arxiv.org/abs/1512.02325.

[17] LIN T, GOYAL P, GIRSHICK R, et al. Focal Loss for Dense Object Detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2020, 42(2): 318-327.

[18] XIA G, BAI X, DING J, et al. DOTA: A Large-scale Dataset for Object Detection in Aerial Images[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition, June 18-23, 2018, Salt Lake City, UT, USA. IEEE, 2018.

[19] LI K, WAN G, CHENG G, et al. Object Detection in Optical Remote Sensing Images: A Survey and a New Benchmark[EB/OL]. [2020-10-11]. https://arxiv.org/abs/1909.00133v2.

[20] 袁秋壮, 魏松杰, 罗娜. 基于深度学习神经网络的SAR星上目标识别系统研究[J]. 上海航天, 2017, 34(5): 46-53.

YUAN Qiuzhuang, WEI Songjie, LUO Na. Research on SAR Satellite Target Recognition System Based on Deep Learning Neural Network[J]. Aerospace Shanghai, 2017, 34(5): 46-53. (in Chinese)

[21] 纪荣嵘, 林绍辉, 晁飞, 等. 深度神经网络压缩与加速综述[J]. 计算机研究与发展, 2018, 55(9): 1871-1888.

JI Rongrong, LIN Shaohui, CHAO Fei, et al. Deep Neural Network Compression and Acceleration: A Review[J]. Journal of Computer Research and Development, 2018, 55(9): 1871-1888. (in Chinese)

[22] HAN S, MAO H, DALLY W J. Deep Compression: Compressing Deep Neural Networks with Pruning, Trained Quantization and Huffman Coding[EB/OL]. [2020-10-11]. https://arxiv.org/abs/1510.00149v3.

[23] HAN S. Efficient Methods and Hardware for Deep Learning[D]. San Francisco: Stanford University, 2017.

Satellite-earth Coordinated On-orbit Intelligent Target Recognition of Optical Remote Sensing Images

XUE Wu1ZHAO Ling1,2WANG Peng1

(1 Space Engineering University, Beijing 101416, China)(291039 Troops, Beijing 102400, China)

To improve the timeliness of optical remote sensing satellite information processing, we propose a technical framework for satellite-earth coordinated on-orbit intelligent target recognition using optical remote sensing images. Processing tasks with large amounts of data and high computation requirements, such as deep learning based on remote sensing big data and neural network model training, are deployed on the ground computing server, while the model obtained from deep learning training is compressed and transmitted to the satellite. The satellite uses a lightweight model for on-orbit inference and computation before finally transmitting the target recognition results to the user. To validate the proposed technical framework, we conducted a verification experiment on GPU server and embedded development board, and used YOLO-v5 algorithms and DIOR remote sensing data set for testing. The results show that under a simulated onboard computing environment, the processing time of 1m-resolution remote sensing images in a range of 100km2is 17.74 s, and the mAP is 87.2%. The experimental results suggest that the proposed technical framework for satellite-earth coordinated intelligent target recognition is able to meet the application requirements in both real-time performance and accuracy with certain feasibility, warranting on-orbit experiments for further verification.

satellite-earth coordination; target recognition; deep learning; verification experiment; remote sensing application

P237

A

1009-8518(2021)03-0128-10

10.3969/j.issn.1009-8518.2021.03.014

2020-11-11

薛武, 赵玲, 王鹏. 星地协同光学遥感影像目标识别技术验证研究[J]. 航天返回与遥感, 2021, 42(3): 128-137. XUE Wu, ZHAO Ling, WANG Peng. Satellite-earth Coordinated On-orbit Intelligent Target Recognition of Optical Remote Sensing Images[J]. Spacecraft Recovery & Remote Sensing, 2021, 42(3): 128-137. (in Chinese)

薛武,男,1988年生,2017年获信息工程大学测绘科学与技术专业博士学位,助理研究员。研究方向为空间感知信息智能处理。E-mail:xuewu_81@126.com。

(编辑:庞冰)