基于引导滤波和差分图像的多聚焦图像融合方法

成亚玲,柏 智,谭爱平

(1.湖南工业职业技术学院信息工程学院,长沙 410208;2.湖南城市学院机械与电气工程学院,湖南益阳 413000)

0 引言

光学成像设备的聚焦能力有限,造成一幅图像中只有部分物体可以被聚焦。多聚焦图像融合技术提取多幅局部对焦图像的互补信息以合成单幅图像。由于融合后的图像含有更多的信息,更便于视觉系统理解。目前,多聚焦图像融合技术[1-4]已被广泛应用于计算机视觉、临床理疗、军事监测等多个行业。本文针对传统的多聚焦图像空间域融合容易出现的边缘模糊问题,提出一种基于引导滤波和差分图像的多聚焦图像融合方法。

纵观近20 年,研究者提出了许多优秀的多聚焦图像融合算法,大致分为两类:变换域融合算法和空间域融合算法。前一类算法主要对图像的变换系数进行融合,随后对融合后的变换系数进行反变换以获得融合图像。在此类算法中,常用的有小波变换[5-6]、曲波变换[7-9]等。另外,文献[10-12]提出了基于非下采样Contourlet 变换(Non-Subsampled Contourlet Transform,NSCT)的多聚焦图像融合方法;文献[13-15]提出了基于稀疏表示的图像融合方法;文献[16]提出了基于卷积稀疏表示的图像融合方法;文献[17]将多聚焦图像融合任务作为二分类任务,采用卷积神经网络对源图像进行分类。总的来说,上述算法均有其优势,在一定条件下能够取得较好的融合结果,但由于此类算法依赖变换系数进行融合,变换系数的选择决定着融合图像的质量,即此类方法的融合图像存在明显的人工效应。另外,对图像的分解和变换需要较大的计算量,造成此类方法难以实现实时处理。与变换域融合不同的是,空间域融合直接将融合规则应用于图像的像素点或图像块,故算法的实时性高、复杂度低。为了避免对像素点的相同操作,研究者提出了许多不同的空间域融合算法。文献[18]采用引导滤波器测量源图像的活跃水平;类似的;文献[19]采用Laplace 滤波器测量源图像的活跃水平以得到决策图;文献[20]采用区域识别和亚像素定位对图像进行重建;文献[21]将该方法应用于视觉特征和纹理特征的融合。此类方法由于直接对像素值进行操作,其缺点是容易在融合图像的边缘产生伪影。

为了解决空间域融合的上述问题,本文提出一种基于引导滤波和差分图像的多聚焦图像融合方法。通过将现有的引导滤波和差分图像两种方法的巧妙结合,在保证算法实时性的同时,有效地解决了传统方法存在的伪影问题。本文方法的简要流程为:首先,将源图像进行不同水平的引导滤波,并对滤波后图像进行差分,获得聚焦特征图像;其次,利用聚焦特征图像梯度能量(Energy of Gradient,EOG)信息,获得初始决策图;然后,对决策图像进行优化,去除噪点;接着,为了避免融合后的图像存在边缘骤变问题,对决策图像进行引导滤波;最后,根据决策图对多聚焦图像进行融合,最终得到一幅信息丰富、整体对焦的融合图像。

1 引导滤波

引导滤波器[22]是一种高效的边缘保持滤波器,其滤波时间与滤波器尺寸相独立,滤波器权重由引导图像确定。设输入图像为P,在以中心为k的局部窗口ωk中,假设滤波器输出结果O和引导图像I为线性变换,则有:

其中:ωk是尺寸为(2r+1)×(2r+1)的矩形窗口,Ii表示i像素强度,线性系数ak和bk为ωk内的常数,通过最小化输出图像O和输入图像P可以近似估算出ak和bk。最小化操作的误差函数为:

其中:ε是自定义的参数,ak和bk通过如下的线性回归公式计算,即

其中:μk和δk分别为输入图像I在窗口ωk内的均值和方差;|ω|为窗口ωk内的像素值序号是引导图像P在窗口ωk内的均值。滤波器输出通过式(4)计算:

图1 不同等级的引导滤波Fig.1 Guided filtering at different levels

2 本文方法

本文给出一种基于引导滤波和差分图像的多聚焦图像融合方法。该方法可以分为以下3步:

步骤1 对多聚焦图像进行不同水平的引导滤波,并对滤波后图像进行图像差分,获得图像的聚焦特征图;

步骤2 对聚焦特征图进行图像强度变化和图像EOG 检测,得到初始决策图像;

步骤3 对初始决策图像进行引导滤波等优化,得到最终决策图像并融合。

下面详细描述具体的处理过程。

2.1 图像引导滤波和图像差分

如前文所述,当引导滤波器的引导图像和输入图像相同时,引导滤波器是一种高效的保边平滑滤波器;当引导图像和输入图像不同时,引导滤波器可以将引导图像中的特征注入到输入图像,从而使得滤波后的图像具有引导图像的部分特征。

首先对输入的多幅多聚焦图像进行不同水平的引导滤波。本文以两幅图像为例,若图像多于两幅,可以先融合两幅图像,然后将融合后的图像同第三幅多聚焦图像进行融合,以此类推。

给定输入图像I1和I2,通过进行引导滤波,得到第一次滤波后的图像G1和G2。该过程如式(5)所示:

其中:GF(·)表示引导滤波操作,In表示第n幅图像,表示第n幅图像第1次引导滤波后的结果,r1和ε1分别表示引导滤波器引导滤波时需要选用的两个参数,其中r1为滤波窗口半径,ε1为归一化截断值,取值范围为[0,1],其值越大,平滑效果越明显。由于在不同引导图像下的引导滤波操作可以提取多聚焦图像不同的特征,将第一次滤波后的两幅图片作为引导图像,将多聚焦图像I1和I2作为输入图像,再次进行引导滤波,该过程如式(6)所示:

其中:r2和r1含义相同,ε2和ε1含义相同。本文处理图像的窗口半径为r1=r2=2。截断值方面,根据前文所述,其值的选取将影响对图像的滤波效果:其值太小,平滑效果不明显;太大则过度滤波,引起原图像信息的丢失。为此,经过不同值的测试,本文取ε1=ε2=0.1。通过对图像进行不同的引导滤波操作,提取不同的多聚焦图像特征。因为引导图像的不同,滤波后的图像在平滑程度以及边缘保留上有不同的表现。在这个环节中,对滤波后的图像进行差分,从而得到多聚焦图像的聚焦特征图,该过程可以用式(7)表示,即:最终得到聚焦特征图。

2.2 梯度能量检测及初始决策图生成

在图像差分的基础上,采用局部聚焦检测方法,对S1和S2进行检测。具体来说,采用图像EOG 来检测聚焦特征图像所反映的聚焦情况。EOG 描述了图像梯度能量的变化情况,对EOG进行检测的过程如式(8)所示:

其中:Ii=I(i+1,j)-I(i,j)和Ij=I(i,j+1)-I(i,j)分别表示图像的水平梯度和纵向梯度,ω表示尺寸为n×n的局部窗口。

图像的初始决策图可以根据式(9)得到,即:

其中E1(i,j)和E2(i,j)分别表示第(i,j)点处图像I1(i,j)和I2(i,j)的梯度能量,经梯度能量信息检测后得到的初始决策图D1如图2(c)所示。

2.3 决策图优化及融合

初始决策图D1存在着许多的孔洞,造成空间存在不连续性,其原因在于,在某些区域聚焦和非聚焦产生了近似的效果,导致感兴趣容积(Volume-Of-Interest,VOI)和EOG 不能区分出来。对此,本节对初始决策图D1进行优化。

首先,对初始决策图D1进行形态学操作,去除狭小的缝隙和突出物,该过程如式(10)所示,即:

其中:Θ 表示腐蚀操作,⊕表示膨胀操作,B为盘状结构元,其大小为15。

随后对V2进行空间一致性检测,对小于阈值的孔洞区域进行移除,得到移除孔洞的决策图,该过程如式(11)所示,即:

其中,T为V2中孔洞区域的阈值,小于此阈值的将移除。在本文中,T设置为决策图像面积的1%,即T=0.01×H×W,其中H和W分别为决策图像的高和宽。移除孔洞后的决策图如图2(d)所示。

为了保留多聚焦图像的边缘信息,避免因决策图像在边缘的像素值变化剧烈造成的融合图像边缘模糊现象,对进行了引导滤波操作,提取源图像中的边缘细节注入到最终决策图像中。该过程表示为式(12),即:

其中,A为采用融合后的图像,其具有源图像I1和I2在边缘部分突变较大的信息,引导滤波器将A中的边缘信息提取到D2中。比起,D2充分保留了来自源图像I1和I2的边缘信息,并在边缘上有一定的平滑作用,避免了因直接采用所导致的边缘像素值突变的问题。滤波后的最终决策图D2如图2(e)所示。

最后,根据最终决策图像D2对源图像I1和I2进行融合得到融合图像F,该过程如式(13)所示:

最终,融合后的图像如图2(f)所示。

图2 源图像-决策图-融合图像获得过程Fig.2 Obtaining process of source image-decision map-fusion image

3 实验结果及分析

3.1 实验说明

为了验证本文方法的有效性,重新设计实验,对3 组经典的多聚焦图像进行融合,并与其他9 种主流的方法进行对比。这9 种方法分别是基于卷积神经网络(Convolutional Neural Network,CNN)的方法[17]、基于卷积稀疏表示(Convolutional Sparse Representation,CSR)的方法[16]、基于曲波变换(CurVelet Transform,CVT)的方法[18]、基于快速图像滤波(Fast Image Filtering,FIF)的方法[19]、基于引导滤波(Guide Filter,GF)的方法[18]、NSCT[11]、基于稀疏表示(Sparse Representation,SR)的方法[13]、基于NSCT 和SR 结合(NSCTSR)的方法[23]、基于二元树复小波变换(Double Tree Complex Wavelet Transform,DTCWT)的方法[9]。对比实验中的参数均设置为相关内容文献中的默认参数。

另外,引入客观评价指标对融合结果的评价。本文采用互信息(Mutual Information,MI)、边缘保持度(QAB/F)、功能互信息(Function Mutual Information,FMI)、视觉信息保真度(Visual Information Fidelity,VIF)作为客观评价指标。MI 反映了融合图像包含多聚焦图像的信息量;QAB/F表示融合图像包含多聚焦图像边缘的信息量;FMI 用来计算融合图像的特征互信息量;VIF 是视觉信息保真度。上述4 个指标的值越大,代表融合效果越好。

3.2 主观视觉效果

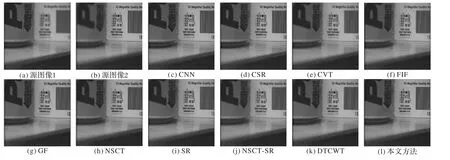

选取3组经典的多聚焦图像作为实验图像,并与其他9种多聚焦图像融合算法得到的结果进行了比较。这3 组多聚焦图像的实验图像分别如图3~5所示。

图3 Clock图像融合Fig.3 Fusion of Clock images

图3 为第一组多聚焦图像Clock 的融合结果。可以看到,CVT 和FIF 在融合图像的边缘产生了明显的光环现象,SR 和DTCWT 存在图像的失真,这是由于变换域的系数改变造成的融合图像中存在人工效应。本文方法在空间域进行活跃水平测量,得到了初始的决策图进行图像融合,有效地解决了上述问题,因此本文方法所取得的融合图像,细节丰富,边缘清晰,较好地保留了来自多聚焦图像的信息。

图4为第二组多聚焦图像Lab的融合结果。可以看出,CSR和NSCT的融合结果存在对比度降低的问题,FIF的融合结果在钟表周围有伪影现象,融合效果不明显,SR方法在“3M”标志周围相比源图像丢失了部分高频细节。相较而言,本文提出的方法则较好地将多聚焦图像的细节信息保存下来。

图4 Lab图像融合Fig.4 Fusion of Lab images

图5 为第三组多聚焦图像Pepsi 的融合结果。主观看来,CVT和DTCWT的融合结果较为模糊,在桌子和杯子之间产生了明显的伪影;GF 存在明显的对比度下降,丢失了一部分来自原始图像的细节;与之对比,本文提出的方法通过利用引导滤波器对决策图像的边缘进行处理,使得决策图像的边缘利用来自源图像中的细节信息,更好地匹配决策图像和源图像在边缘上的纹理,从而有效地解决了伪影和对比度下降的问题,取得了令人满意的融合效果。

图5 Pepsi图像融合Fig.5 Fusion of Pepsi images

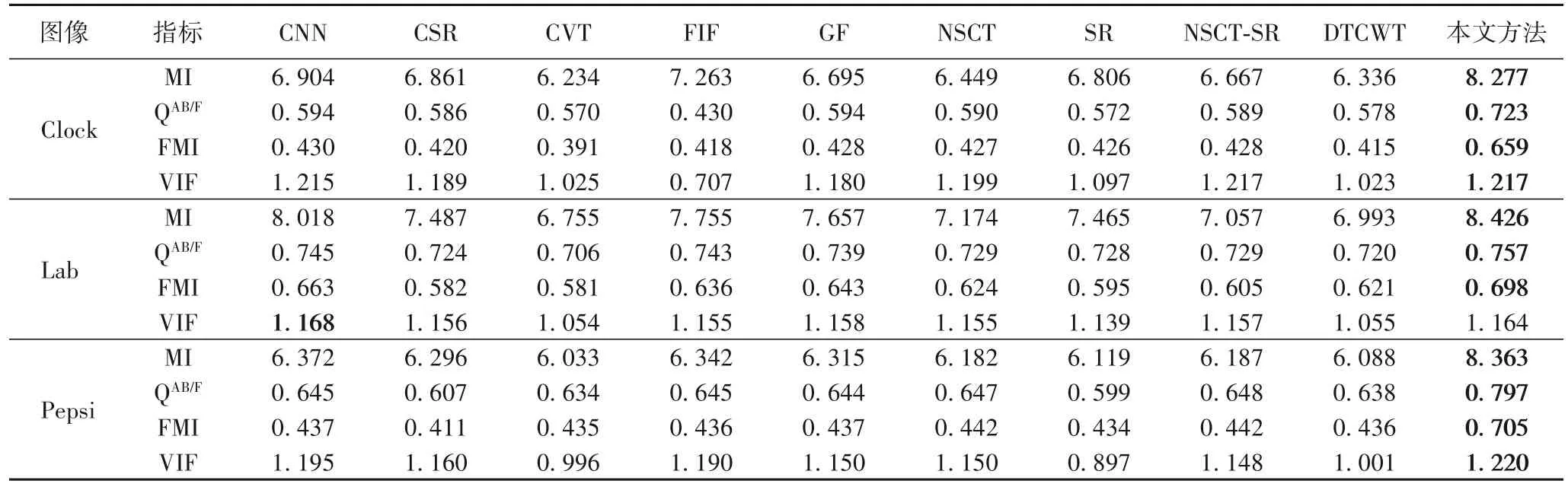

3.3 客观指标评价

为了进一步验证本文方法的有效性,下面对融合图像进行客观指标计算,结果如表1所示,其中加黑的数值表示该评价指标中的最大值,代表融合图像效果最佳。通过对比可以看到,较之其他9种算法,本文方法几乎在所有指标上均取得了令人满意的结果,尤其在互信息MI的数值上,本文方法远超过其他方法。该结果表明,通过本文方法所取得的融合图像,能够较好地保留了来自源图像中的信息,避免了存在于其他方法中的互信息损失问题。此外,其他客观指标计算结果证实了本文方法能够有效地提取来自源图像的梯度细节信息,具有更好的视觉效果。

表1 多聚焦图像融合结果评价指标结果对比Tab.1 Comparison of evaluation indicators of multi-focus image fusion results

4 结语

针对传统多聚焦图像融合算法在融合图像边缘容易出现伪影、光环的问题,本文提出了一种基于引导滤波和差分图像的多聚焦图像融合方法。通过将现有的引导滤波和差分图像方法的有机结合,在保证算法实时性的同时有效地克服了传统方法存在的伪影问题。实验环节从主观视觉体验和客观指标评价上验证了本文方法的有效性。

针对后续研究工作,将对本文方法中的源图像活跃水平测量环节进行优化,以使其能得到更好的决策图像,从而改善融合效果。