改进的无人机影像处理技术在新冠疫情复工建设中的应用

李梓豪,唐 超,郭文远

(北京城建勘测设计研究院有限责任公司,北京 100101)

在疫情特殊时期,为响应国家及防疫部门减少人员聚集的号召,无法通过现场巡视的方式了解现场情况以开展工作。复工情况紧迫,施工进度压力大。雄安高铁站总建筑面积为47.2万m2。针对如此巨大的工程场地及紧张的施工进度,如何快速掌握现场施工情况并作出施工工作部署是保障高铁站建设的前提。

无人机技术是近年兴起并具有低成本、快速响应、灵活、分辨率高等特点的新型遥感技术,主要用于大场景高分辨率需求的正射影像与三维建模[1]。但是在数据采集过程中,无人机影像数据量巨大,且影像特征点快速提取与影像拼接是其中的关键步骤,若使用传统遥感影像处理方式进行处理则耗时长,影像匹配速度慢,对于新冠疫情背景下复工复产的快速响应需求难以发挥良好作用。

为解决无人机影像在特征点快速提取与影像匹配关键步骤影像匹配耗时长的问题,国内外学者已经作了大量研究。针对尺度不变的特征变化文献[2]提出了SIFT(scale invariant feature transform)算法。该算法在匹配时与影像的旋转角度和尺度无关,且对光线变化较大、噪声点、小窗视角上有较好的容忍度,因此对工程施工场地中地物反射光线变化较大的区域有较好的提取优势。但是对可见光边缘较为光滑、特征点呈非均匀分布的条件下地物识别提取能力较弱,因此针对这些缺点,文献[3]对其进行了改进,使用无人机的pos信息建立三角网,并在相邻的两幅影像上进行SIFT算法匹配,从而在时间上有一定程度的节约。针对无人机在外业采集数据时,相邻航带之间重叠率较高,导致可能存在过度匹配的情况,文献[4]在影像匹配过程中减少了过度匹配的情况下使用SIFT算法,一定程度上解决了提取特征点效率的问题,但是未从根源上解决无人机影像特征提取数据量大、处理时间长、效率低的问题。2006年文献[5]在借鉴SIFT算法的基础上提出了SURF(speeded up robust features)算法。该算法在微分模板上进行了简化处理,在进行影像的特征点提取,使得算法的运行速度得到了一定的提高。方法提出后,文献[6]提出了一种新的无人机影像拼接方法,首先对影像的原始数据进行采样,然后在采样的基础上进行SURF特征提取。该方法同样使无人机影像数据处理的速度上得到了提升,但是仍存在影像拼接质量和精度降低的问题。在快速提取特征点的算法中,文献[7]采用ORB[8](oriented fast and rotated brief)算法对无人机影像进行拼接处理,同时采用降低迭代次数的方法提高了无人机影像的拼接速度。综上所述,SURF算法的计算速度之所以比SIFT算法快,一部分原因是SURF算法对高斯二阶滤波器进行了简化,因此SURF特征提取算法在无人机影像的处理的应用上效率高、速度快。

相比传统测绘,无人机作业效率高,作业面积大,作业成果具备高时效性,无须多人作业,且可以通过改进的SURF算法加速影像处理。一方面可以快速得到施工现场正射影像,满足了管理者对施工现场进度的掌握;另一方面可以识别出现场施工作业机械设备情况;同时也做到了不到现场的工作巡检方式,减少了聚集,从而可以在做好防护的前提下做好复工复产工作,保障雄安高铁站建设的质量与进度。因此本文针对雄安高铁站建设需要快速获取影像并估算复工复产情况的需求,提出了使用基于SURF算法与工程目标识别相融合的无人机影像拼接识别技术。

1 基于改进的SURF算法对无人机影像快速处理

1.1 Harris-laplace无人机影像特征提取

在无人机影像处理过程中,自相关函数能够较好地展现出影像中特征点的不同尺度信息[9-10]。若以任意像素N为中心,向任意方向作一定偏移都会引起灰度值明显波动,就能说明这个点是算子在寻找的角点。假设自相关矩阵为M,其特征值可以用自相关函数的一阶曲率表示。若一个像素点的两个自相关矩阵M具有较大值,则其像素点为特征点[11]。定义自相关矩阵M为

(1)

式中,L(x,y)为输入的原始影像;X为高斯平滑影像上对应的像点(x,y);Lx、Ly分别为高斯平滑影像在x、y方向上的梯度值;g(σ1)为高斯函数;σ1为积分尺度;σD为微分尺度。

其特征点相应函数如下

Coner=det(u(X,σ1,σD))-α·trace2(u(X,σ1,σD))>threshood

(2)

式中,corner为像素点的响应函数值;X为高斯平滑影像上对应的像点(x,y);det(μ(X,σ1,σD))为对矩阵μ(X,σ1,σD)进行行列式值运算;trace(μ(X,σ1,σD))为对矩阵μ(X,σ1,σD)进行迹运算;α为常数。当最终得到的响应值corner大于阈值且为影像空间中的极值,则得到特征点。

Harris-laplace特征点检测步骤可以分为3个部分:①利用和函数与原始影像进行卷积运算,在影像中每个尺度上筛选出候选点P。②对候选特征点P使用迭代法进行检验,检查运算值是否为极值点。若P是极大值则保留,若不是则舍去。③在P的邻域内求能够使corner大于阈值的特征点Q,如果存在则替换Q,不断重复以上步骤,直到Q不再有新值出现为止。

1.2 Hessian矩阵无人机影像特征提取

SURF算法中主要利用Hessian矩阵对影像中的特征点进行提取并进行变换操作,此处将任意点X=(x,y)所在位置的积分影像定义为

(3)

对于无人机影像中的任意点X=(x,y),它在σ空间尺度上的Hessian矩阵可以定义为

(4)

式中,Lxx(X,σ)、Lxy(X,σ)和Lyy(X,σ)为高斯二阶偏导数在该无人机影像上点X处的卷积。若使用Dxx、Dyy和Dxy表示模板与无人机影像卷积的最终结果,那么可以得到矩阵行列式为

Det(Happrox)=DxxDyy-(0.9Dxy)2

(5)

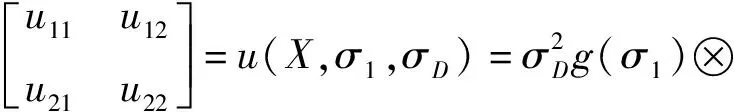

如图1所示,在简化模板中,白色区域、黑色区域、灰色区域的值分别为1、-2、0。使用滤波器σ=1.2对最小尺度空间值对图像进行滤波及特征点检测,然后在响应的无人机影像上对采样点进行非极大抑制,最终特征点就能够被确定。

图1 SURF简化计算模板

1.3 本文算法快速处理步骤

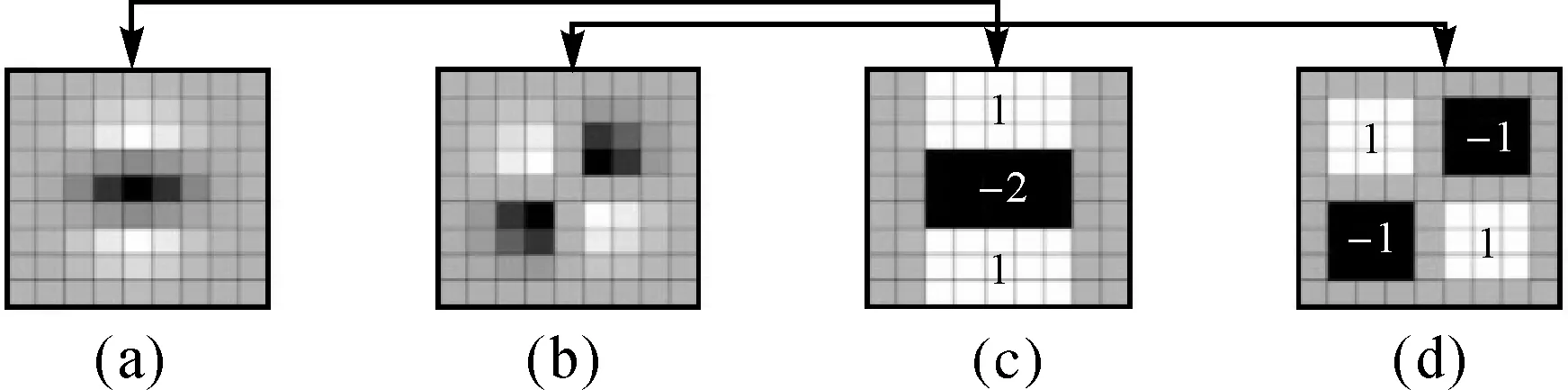

本文使用改进SURF算法意在加快无人机影像的处理速度,能够实现特殊环境下高时效性的要求,快速得到无人机正射影像。考虑到雄安高铁站主要为建筑工地,具有建筑物轮廓明显,可见光反射变化清晰等特点,如图2所示,因此使用Harris-laplace算子、Hessian矩阵同时对无人机影像中建筑工地的特征点进行提取。在特征影像处理加速环节,本文主要分为3大步骤:①结合Harris-laplace算子、Hessian矩阵各自优势在多尺度空间下对无人机高分辨率影像同时进行特征点检测;②根据采样点数建立索引表,提高计算速度;③使用SURF算法中非极大抑制的方式找到局部的极值点,并通过阈值对极值点进行筛选,提取特征点;④选取特征点邻域,将邻域内的灰度值排列顺序并进行等分处理;⑤在上一步中等分的像素点邻域内进行采样排序,得到像素点描述算子;⑥对描述算子进行累加处理,确定特征点的描述符;⑦计算特征描述符之间的欧氏距离[12],完成特征点的配对。

图2 无人机原始数据

1.4 快速正射影像处理

1.4.1 外业无人机影像采集情况

考虑到雄安建设对本次工作任务有较高的时效性要求,传统旋翼无人机受电池续航、作业速度等因素影响,外业无人机影像采集效率低,因此本次任务采用固定翼无人机对高铁站片区进行影像采集工作。其具有巡航作业时间长,机身稳定,控制半径大等特点,可以满足本次工作需求,无人机参数见表1。

表1 无人机参数

本次作业无人机共飞行4个架次,作业面积11.1 km2,总航程185.674 km,总飞行时间183 min,飞行高度200 m,飞行速度17 m/s,飞机航向、旁向重叠率高达80%,照片分辨率3 cm,拍照间距32 m。航线规划如图3所示。

图3 航线任务规划

1.4.2 内业数据情况

本次内业处理涉及文件5370个,总大小为74.7 GB,由于作业面积大,任务时间紧,因此本文使用基于Harris-laplace算子的SURF算法加速影像拼接。采用6台工作站集群方式对数据进行处理,配置为:cpu i7;内存64 GB;显卡1080 ti。内业处理耗时6.5 h。

1.4.3 影像成果情况

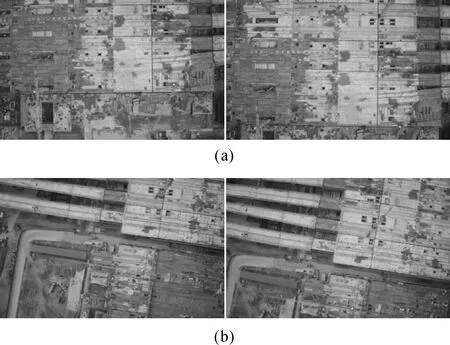

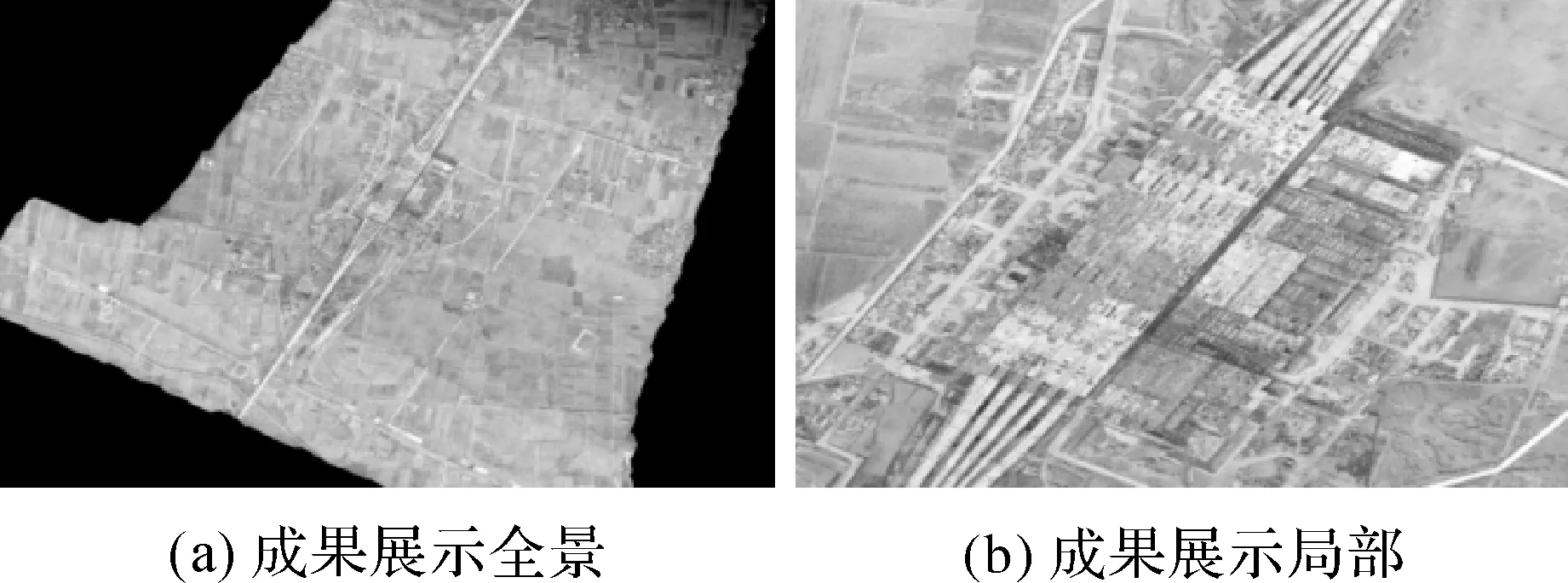

本文采用固定翼无人机在施工场地外围对雄安新区高铁站施工情况进行数据采集,避免了人员聚集与接触。通过高效的外业无人机影像采集与内业数据联动,待外业数据采集完成后通过移动端实时上传至云端工作站进行处理,降低了时间损耗。通过183 min的外业数据采集和390 min的内业数据处理,在短时间内完成了正射影像的出图,效果如图4、图5所示。

图4 测控区域三角网与灰度影像

图5 成果展示

2 现场设备识别

2.1 设备识别思路

大型铁路建设项目施工现场存在大量机械设备,通过对大型施工设备的识别可以间接推测出施工现场的复工情况,因此本次应用主要针对大型机械设备进行识别。

首先,对已经生产完成的正射影像进行兴趣区域(ROI)划分。由于整幅影像为11 km2的巨大画幅,其中存在较多的非兴趣区域(NROI),如果直接使用整幅正射影像进行目标检测,将造成巨大的时间浪费,因此对已经获取的无人机高分辨率影像进行兴趣区域划分,设定以高铁站主体100 m范围内为兴趣区域,剔除非兴趣区域。

其次输入建立目标样本库,对挖掘机、渣土运输车等重点目标建立样本,采用卷积神经网络Fast-R-CNN[13-15]进行目标学习检测。对已经识别的目标进行监督分类得到新的训练样本,然后将该训练样本再次注入样本库进行学习,提高检测能力。最终搜索完成整个ROI区域后完成对目标设备的识别。

2.2 Fast R-CNN网络识别原理概述

Fast R-CNN是结构中队整个预测矿筛选、回归和分类的重要阶段,网络结构图以及其中的关键参数如图6所示。本节将以ROI pooling、分类层和回归层、Fast R-CNN后处理模块等方面进行阐述。

图6 结构

2.2.1 兴趣区域池化(ROI-Pooling)层

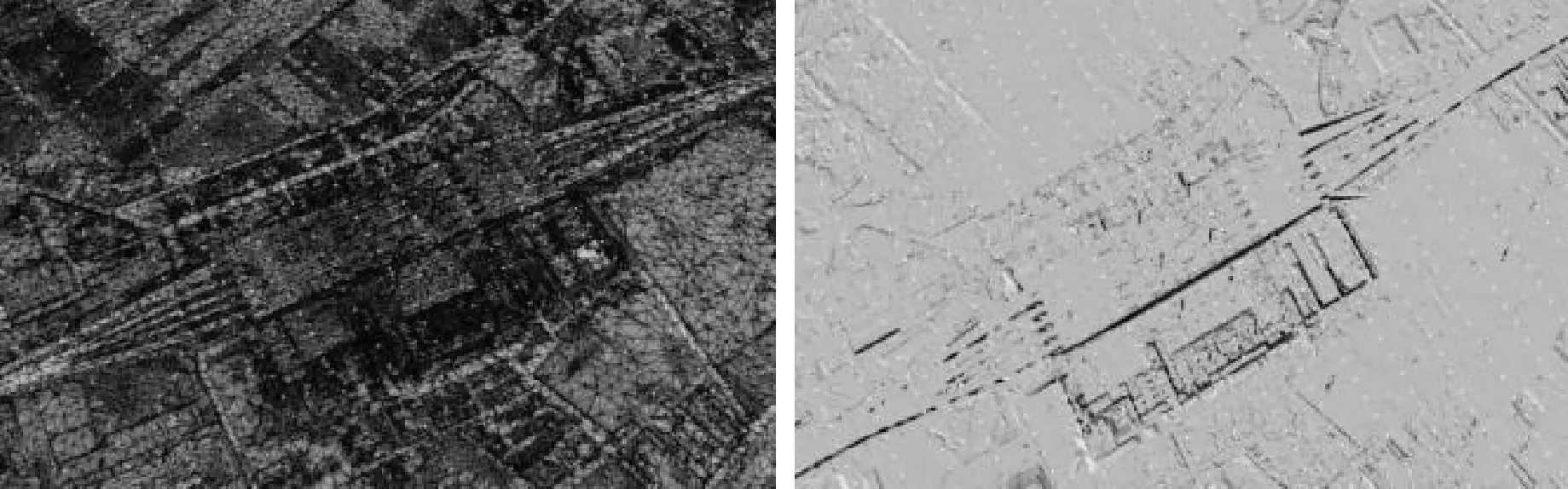

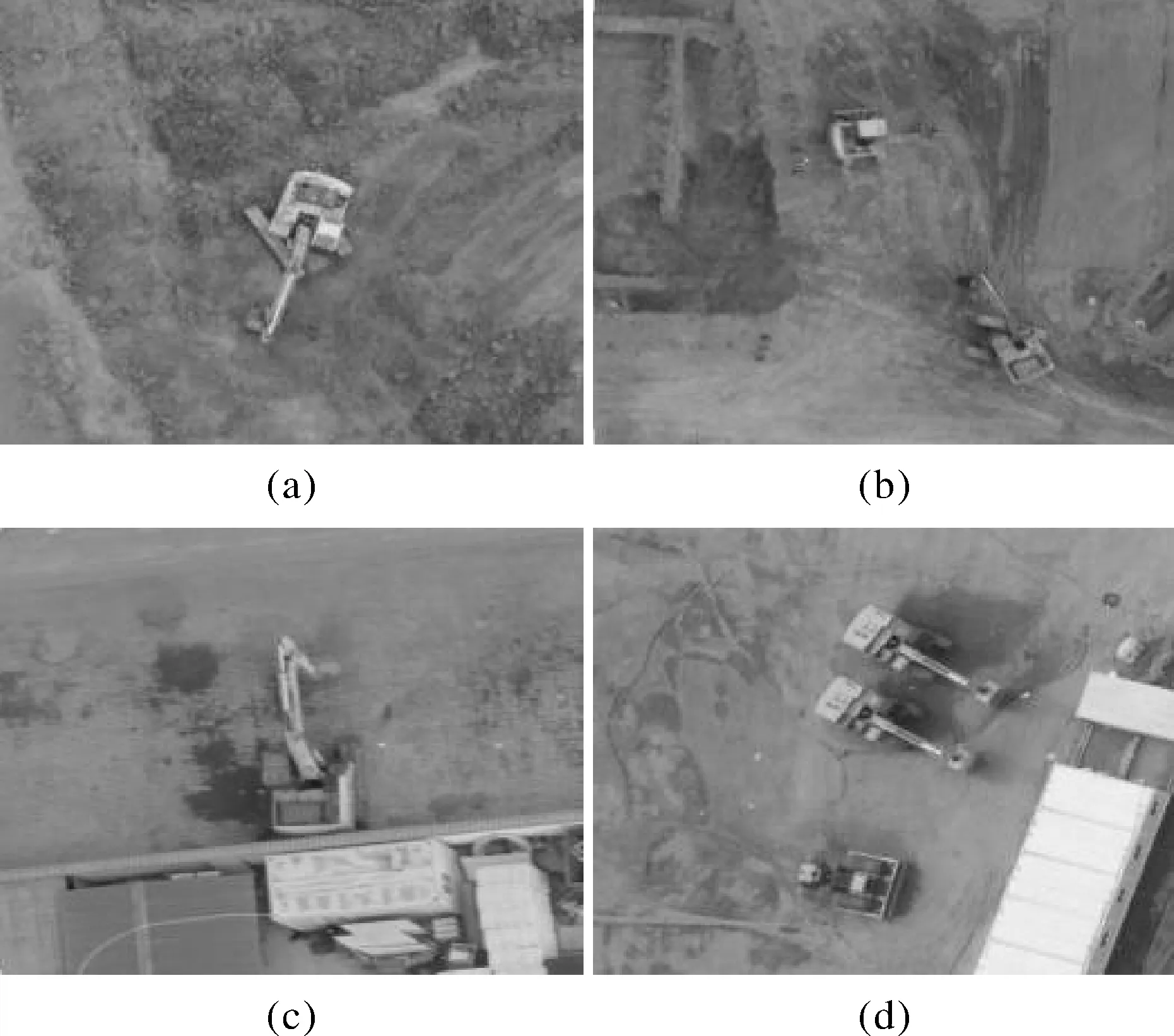

在样本选取中,本文采用512×512像素大小的影像切片,初期训练样本以监督方式从原始影像中切取,如图7所示为部分训练样本。在筛选过程中仅留存包含目标的影像并进行统一编码标注属性。本文基于轻量级标注工具进行快速标注,生成每个训练样本的信息。

图7 机械设备(挖掘机)训练样本

在Fast R-CNN中,卷积层和全连接层两部分被分开来,通过特征共享样本进行输入,进入第一阶段的预测框。在全连接层之前,ROI pooling必须把位置、尺寸不一致的预测框反映到共享特征图才能得到预测框内的特征图区域。映射的规则是无人机正射影像与特征图的尺寸比值。

ROI pooling的执行中有效减少了计算量,通过将样本池得到的特征进行聚合,使用全局平均池层而非全部连接层来融合特征图并降维,提高了计算速度与网络性能。

2.2.2 分类、回归层

分类和回归都采用全连接层,不同之处是分为水平和倾斜两个分支。对于一张输入图片,当分类分支输出维度为[512,(class_num+1)],水平预测回归系数维度为[512,4×(class_num+1)],倾斜预测回归系数维度为[512,5×(class_num+1)]时,Fast R-CNN部分结束。

2.2.3 后处理模块

通过Fast R-CNN预识别得到的结果还需要进入目标层进行最后一次筛选:①进行月结提出;②对所有预测框进行非极大抑制从而充分避免预先检测结果有大量重叠的情况。至此,整个检测过程结束,检测识别样例如图8所示。

图8 机械设备(挖掘机)识别样例

3 总 结

本文运用基于Harris-laplace算子的SURF算法与工程目标识别相融合的无人机影像拼接识别技术,在573 min内快速实现了雄安高铁站周边约11 km2面积的正射影像,并且在此基础上运用机器学习算法实现了机械设备(挖掘机)的识别。一方面满足了新冠疫情期间对人员聚集情况的需求,另一方面快速地获取了施工现场的复工情况。通过施工现场正射影像能够直观了解施工进度、施工人员进场情况,同时避免了现场巡查人员的密集接触。

由于本文算法注重实效性,强调无人机影像处理速度以及识别速度,舍弃了部分影像的拼接质量,后期的工作中需考虑保证速度的同时提升无人机影像拼接质量。将考虑运用云端处理以及5G技术加快运算以及等待时间损耗,同时考虑更具稳健性的无人机影像拼接算法。