基于扩展的Haar-Like特征和LBP特征的人脸压缩跟踪算法*

曹 洁, 唐瑞萍, 李 伟

(1.兰州理工大学 计算机与通信学院,甘肃 兰州 730050;2.甘肃省制造业信息化工程研究中心,甘肃 兰州 730050;3.兰州理工大学 电气工程与信息工程学院,甘肃 兰州 730050)

0 引 言

目标跟踪是视频分析、安全监控、人机交互和许多其他计算机视觉应用中的一个基本问题。由于人脸外观模型通常容易受到遮挡、光照变化、形变和背景干扰等因素的影响,保持实时跟踪精度的人脸目标跟踪仍然是一个具有挑战性的问题。Zhang K[1]将压缩感知理论[2]应用到目标跟踪中,提出实时压缩跟踪(compressive tracking,CT)算法,但算法对遮挡、光照变化敏感,提取特征单一,无法充分表征目标信息等。朱秋平[3]在特征提取矩阵生成中,生成 2种互补的特征提取矩阵,使得特征呈现多样化,并对不同特征进行不同更新,以此来提高跟踪的鲁棒性。曹义亲[4]通过提取并使用两类互补的纹理特征和灰度均值特征进行跟踪来提高目标特征在各种情况下的稳定性。王松林[5]在压缩跟踪算法的基础上引入了特征加权分类,但特征权值在第一帧就已经确定,无法做到实时更新以适应外观变化。虽然众多学者针对压缩跟踪算法进行了不少改进[6~10],仍然存在遮挡、光照变化等干扰条件下跟踪效果不理想的情况。

基于上述分析,提出基于扩展的Haar-Like特征和LBP特征的压缩跟踪算法,并将此算法应用于人脸这一特定目标的跟踪研究中。

1 压缩跟踪原理

压缩跟踪[5]采用了一个非常稀疏的随机测量矩阵R将高维向量X(m维)映射为低维向量V(n维),表示为v=Rx,其中,R为一个n×m维的随机测量矩阵,n≪m。

其矩阵元素定义如下

(1)

式中p为rij取某值的概率,而s取值在2~4中随机选取。

假设v中的各元素vi分布独立,利用朴素贝叶斯分类器来建模

(2)

式中p(vi|y=1)和p(vi|y=0)符合高斯分布,y∈{0,1}为二值变量,表示样本的正负,当y=0时为负样本,当y=1时为正样本,假设2个类的先验概率p(y=1)=p(y=0)。可以看出,所有特征在正负类中分布概率密度比值的对数相加构成了贝叶斯分类器,贝叶斯分类器的更新对应特征在正负类中分布的更新[11]。Diacois P和Freedman D证明:高维随机向量的随机投影几乎都服从高斯分布。

最终,选取H(v)值最大的区域作为新一帧的目标区域。在确定区域后,重新进行降维获取正、负样本,并通过下式更新系数

(3)

式中λ为学习因子且λ>0,影响更新的速度,λ越小则说明分类器更新的速度越快。

2 扩展的Haar-Like特征和LBP特征的人脸压缩跟踪

CT在某些复杂的环境中易受目标漂移的影响而失去目标,为了避免遮挡、光照变化及背景的干扰,本文扩展了原有的Haar-Like特征来适应环境的变化,提高了跟踪的性能。在计算机视觉和图像处理中,LBP是一种有效的纹理描述算子。纹理反映了图像灰度模式的空间分布,包含了图像的表面信息及其与周围环境的关系,更好地兼顾了图像的宏观信息与微观结构,具有旋转不变性和灰度不变性等显著的优点,能够更有效地获取需要的结构特点,从而得到具有较强鉴别能力的人脸图像特征。

2.1 扩展的Haar-Like特征空间

在CT[5]中将不同大小的矩形滤波器与原始图像进行卷积,并提取了不同大小的矩形图像块。图1为CT的简单的Haar-Like特征,其特征值是由积分图像来计算的。由于提取的Haar-Like特征太过简单而无法有效地处理遮挡、光照变化、物体形变和背景干扰的影响,因此,本文采用扩展的Haar-Like特征。

图1 CT中的Haar-Like特征

1)扩展的Haar-Like特征类型

Haar-Like的特征值为白色和黑色矩形区域的像素和之差。Lienhart R[12]扩展了Haar-Like特征来描述目标外观模型(见图2),主要是由45°旋转特征的有效集合扩展得到。

图2 扩展的Haar-Like特征

2) 快速特征计算

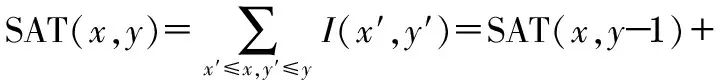

为了降低计算Haar-Like特征的计算开销和提高跟踪系统的实时性,引入了2种积分图像来快速计算特征。对于竖直的矩形,SAT(x,y)被定义为从左上角(0,0)到右下角(x,y)的像素总和

SAT(x-1,y)+I(x,y)-SAT(x-1,y-1)

(4)

对于任何45°旋转矩形的积分Rect(x,y,w,h,45°),同样可以由如图3右图所示的4个点计算得到

RSum(Rect)=RSAT(x+w,y+w)-RSAT(x,y)+

RSAT(x-h,y+h)-RSAT(x+w-h,y+w+h)

(5)

图3 45°旋转矩形块的积分

2.2 LBP特征空间

对于一幅灰度图中某个局部区域内的任意像素f(xc,yc),以gc为中心图像的灰度值,g0,…,gp-1为周围P个像素点的灰度值,则纹理T由邻域内中心像素点与周围像素点灰度值的联合分布构成

T=t(gc,g0,…,gp-1)

(6)

将邻域内P个点的灰度值减去中心像素点的值,则有

T=t(gc,g0-gc,…,gp-1-gc)

(7)

当中心像素的灰度值较大或者较小时,周围像素点与其差值的取值范围就会明显减小,从而损失一些信息。但允许损失少量的信息能使得局部纹理的描述对于灰度图像灰度范围内的平移具有不变性。t(gc)只是描述了整体图像的亮度分布情况,而其不参与描述局部纹理特征,不予考虑。同样对于均匀光照的不敏感性,有

T≈t(s(g0-gc),…,s(gp-1-gc))

(8)

其中

(9)

为每个s(gp-gc)分配一个权值2p,并计算可以得到一个唯一的LBP编码,并将此编码作为该中心像素的局部纹理特征

(10)

在传统的实时任务中,通常使用的是统计数据,即LBP统计直方图。一个输入图像的所有像素LBP代码被收集到一个直方图中,作为纹理描述符

(11)

2.3 扩展的Haar-Like特征和LBP特征的融合

将所有扩展的Haar-Like特征连接起来生成一个高维的特征向量空间xexhaar={x1,x2,…,xn},连接所有的LBP特征来生成图像X的高维特征向量空间x′LBP={x′1,x′2,…,x′n}。然后利用扩展的Haar-Like特征来进行粗跟踪,进一步应用LBP特征进行精细跟踪以搜索人脸目标最佳位置。

算法流程如下:

1)初始化相关参数并手动设定第一帧中被跟踪目标的中心位置及尺度。

2)粗采样一组图像块,采样范围为Dγ1={p|‖It(p)-It-1‖<γ1},其中,It-1是在(t-1)帧中人脸目标的跟踪位置,并提取低维特征。

3)计算积分图,45°旋转积分图和当前帧的积分直方图。

4)提取扩展的Haar-Like特征。利用扩展的Haar-Like特征计算式(3)得到最大的分类器响应值H1(v)并确定粗跟踪的跟踪位置I′t。

5)精采样一组图像块,采样范围为Dγ2={p|‖It(p)-I′t‖<γ2},并提取低维特征。

6)提取LBP特征,利用LBP特征进行精跟踪确定最佳位置It。

7)采样2组图像块,采样范围分别为Dα={p|‖l(x)-I0‖<α}和Dβ={p|β<‖l(x)-I0‖<γ,α<β<γ}。

8)通过这2组图像提取特征,并根据式(5)更新分类器系数。

3 实验结果与分析

3.1 实验设置

为了验证本文算法性能,将本文算法与CT 和STC算法对4个包含遮挡、光照变化、快速移动等干扰因素的标准测试序列进行对比。测试设备配置为2.4 GHz主频i5双核处理器,4GB内存,Windows 10操作系统,开发环境为MATLAB与C++的混合编译环境,版本为MATLAB 2014a。

数据集和参数设置:本次实验选择4个公开的标准测试序列来评估本文的算法。为了更好地评估和分析跟踪算法的性能,这些序列被分为不同的属性,如表1所示。在实验过程中,正样本采样半径α=4,采样负样本的内半径β=8,而其对应的外半径γ=20,实验设置了粗采样的搜索半径为γ1=25,精采样的搜索半径为γ2=4。分类器的学习参数被设置为γ=0.85。

表1 各视频序列的特点

评价指标:中心位置误差(center location error,CLE)、中心距离精度(distance precision,DP)是度量跟踪算法性能的重要指标。本实验采用这两项指标来评价跟踪算法的鲁棒性。其中,CLE是跟踪目标位置与实际位置的欧氏距离,单位为像素;DP为CLE 小于20的帧数占总帧数的比值。

3.2 定性结果分析

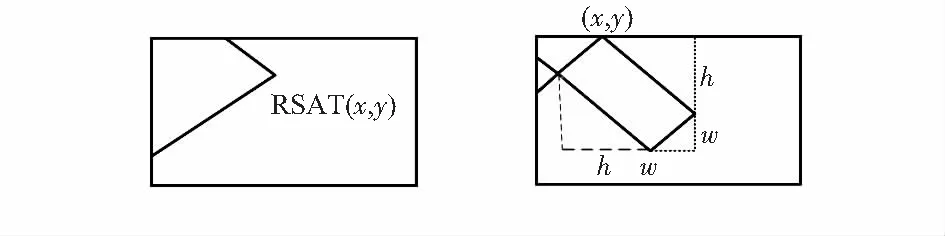

选取的4组视频序列分别用STC算法、CT算法及本文算法进行跟踪测试,跟踪效果对比图如图4所示。

图4 各视频序列跟踪结果

Faceocc1视频序列中,前170帧人脸目标出现了短时的部分遮挡,各视频序列跟踪效果差不多,170帧以后人脸目标出现较长时间遮挡,STC视频序列逐渐出现了目标漂移,由于过度的尺度调节,导致跟踪框逐渐变大,340帧以后,由于尺度变化太大,跟踪框已经完全消失在图片外。CT算法在经过多次的遮挡干扰后,也逐渐产生了目标漂移。而本文算法由于采用了由粗到精的采样策略,利用LBP特征精确描述人脸特征,使得人脸目标基本出现在跟踪框范围内,跟踪效果较为稳定。

Faceocc2视频序列中,STC算法根据人脸目标的旋转产生了尺度变化,导致跟踪框时大时小,并未能有效地跟踪到完整的人脸目标。CT算法在人脸旋转过程中出现了目标漂移。而本文算法则可以实时地跟踪并完全标注出人脸目标。

Fleetface视频序列中,前200帧视频序列3种算法跟踪效果良好,200帧以后,由于视频序列产生了快速移动、旋转,并产生了运动模糊,导致人脸目标开始出现漂移。300帧以后,由于视频序列的快速旋转,STC和CT算法均产生了明显的人脸目标漂移,500帧以后,STC算法甚至已基本丢失目标。而相较于前两种算法,本文算法相对较为稳定。

Shaking1视频序列前150帧中,3种算法跟踪效果均比较稳定,150帧以后,由于光照变化及目标的大幅度晃动,导致CT算法逐渐产生目标漂移,240帧时,STC的跟踪框产生了部分偏移,而CT算法已完全丢失目标。在整个跟踪过程中,本文算法都比较稳定地跟踪到了人脸目标。

3.3 定量结果分析

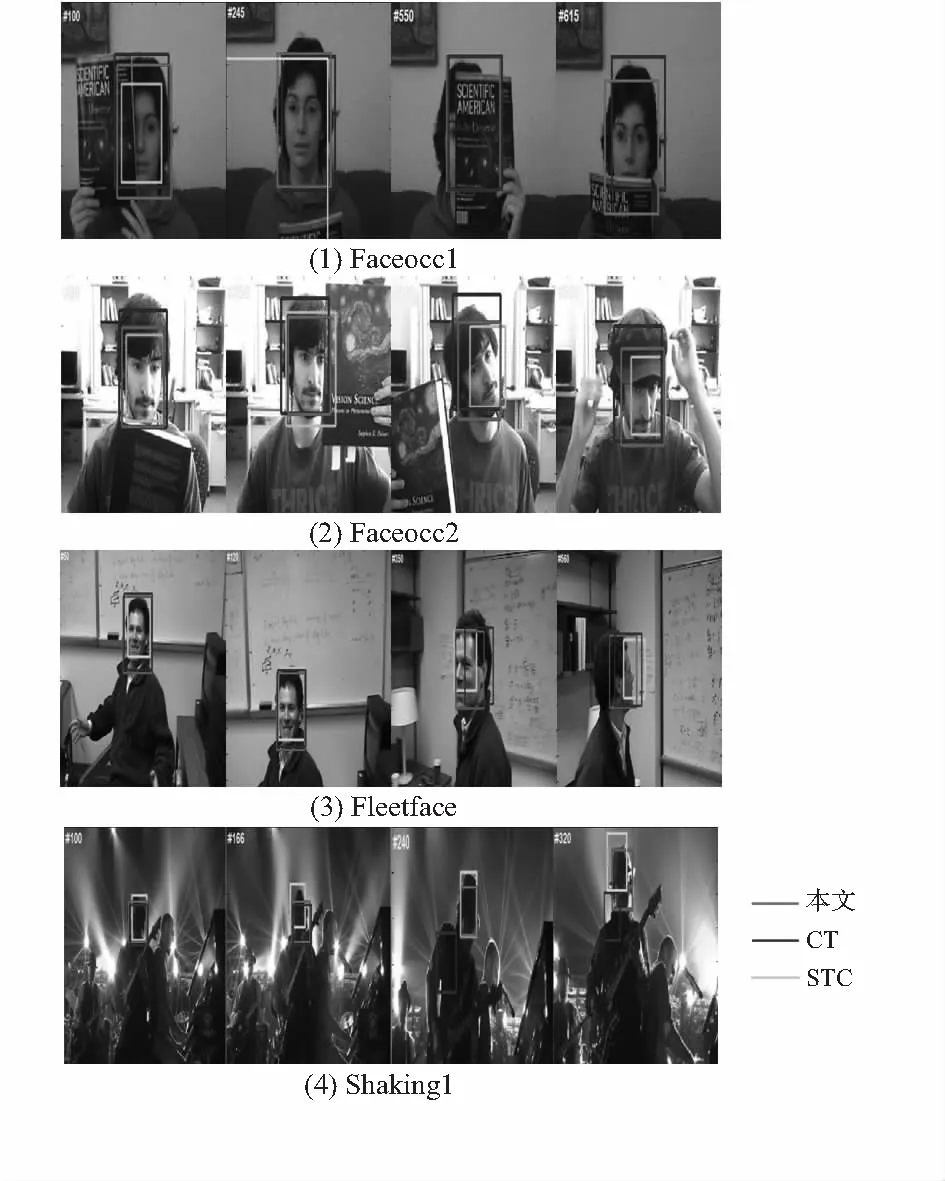

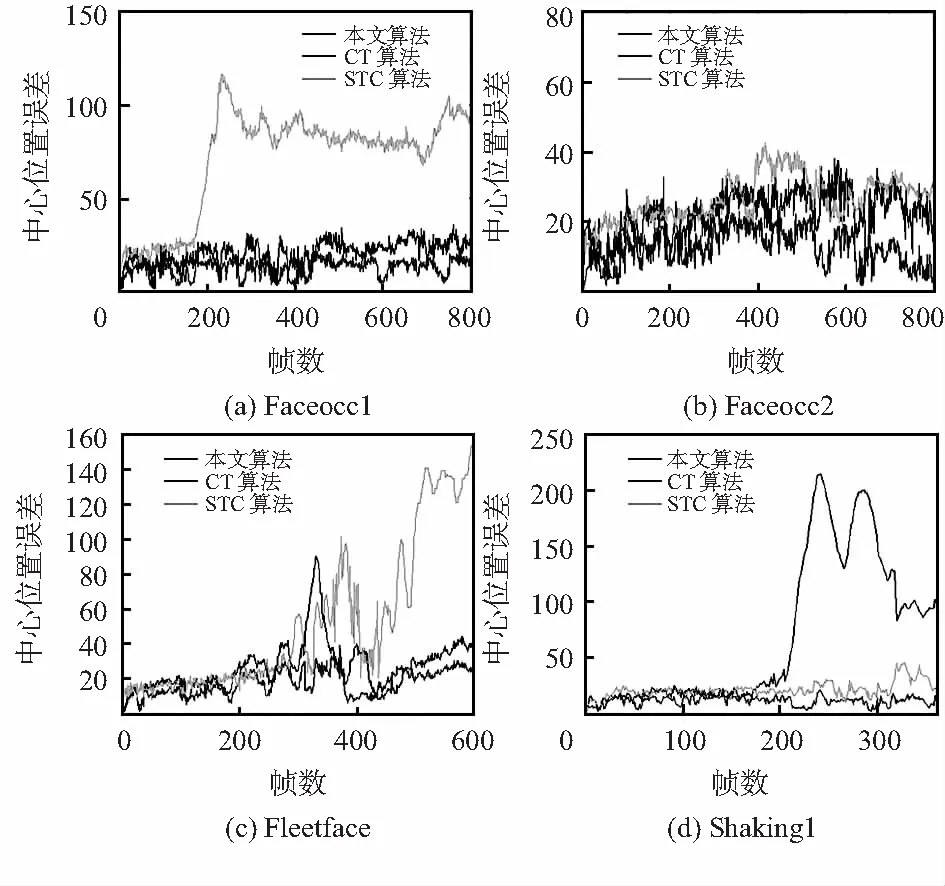

分别对STC算法、CT算法及本文算法的人脸目标跟踪结果定量计算出中心位置误差、中心距离精度这两项评价指标,并绘制出跟踪过程中的实时曲线如图5。

图5 各视频序列跟踪中心位置误差

图5为对本文所进行对比的三种算法针对不同视频序列的定量分析结果。实验数据表明,不论是从中心位置误差还是中心距离精度方面对比,本文算法的性能都更加优越。本文算法取得了最低的中心位置误差和最高的中心距离精度。综上所述,本文算法整体跟踪效果优于其他两种算法。

4 结 论

实验表明:本文算法在跟踪难点如遮挡、光照变化、旋转、形变及背景干扰等情况下跟踪性能良好,具有较强的鲁棒性。为了实现一个更加鲁棒且精确的人脸跟踪系统,仍然需要在严重遮挡和目标快速移动等干扰情况下进行进一步的研究。