基于边界脊线识别的群养猪黏连图像分割方法

韩书庆,张建华,孔繁涛,张腾飞,吴海玲,单佳佳,吴建寨

基于边界脊线识别的群养猪黏连图像分割方法

韩书庆1,张建华1,孔繁涛1,张腾飞2,吴海玲2,单佳佳3,吴建寨1※

(1. 中国农业科学院农业信息研究所/农业农村部农业大数据重点实验室,北京 100081; 2. 成都睿畜电子科技有限公司,上海 201899;3. 大连理工大学食品与环境学院,盘锦 124221)

猪体图像的前景分割和黏连猪体的分离是实现群养猪数量自动盘点和猪只个体行为智能识别的关键。为实现群养猪黏连图像的自动分割,该文采用决策树分割算法提取视频图像帧的猪体前景区域,计算各连通区域的复杂度,根据复杂度确定黏连猪体区域,利用标记符控制的分水岭分割算法处理黏连猪体图像,检测待选的边界脊线,通过检验待选边界脊线的分割效果和形状特征(包括线性度和Harris拐点数目),识别出猪体黏连分割线,实现黏连猪体的分离。结果表明,决策树分割算法(decision-tree-based segmentation model,DTSM)能够有效地去除复杂背景,前景分割效果良好。黏连猪体分离结果显示,基于边界脊线识别的黏连猪体分离准确率达到了89.4%,并较好地保留了猪体轮廓。通过计算分割后猪体连通区域的中心点,并对中心点进行德洛内剖分,初步实现了猪只的定位和栏内分布的可视化。6 min的监控视频处理结果显示,该文方法各帧图像的盘点平均误差为0.58,盘点准确率为98.33%,能够正确统计出栏内猪只数量。该研究可为实现基于监控视频的群养猪自动盘点和个体行为识别提供新的技术手段。

图像处理;畜牧业;自动盘点;决策树;分割脊线识别;群养猪

0 引 言

生猪养殖业在中国经济发展中占有重要地位。随着环境保护压力的加大,中国生猪养殖规模化和集约化程度逐年升高。规模化养殖的发展给饲养管理者带来了新的挑战。猪只数目的增多导致人工巡检工作强度加大。为减轻饲养管理压力,及时发现异常状况,提高饲养管理效率和水平,利用计算机视觉技术实现生猪采食[1-2]、饮水[3-4]、排泄[5]、攻击[6-8]、爬跨[9]、分娩[10]、哺乳[11]、活动状态[12]等行为的自动识别,以及健康福利状况的自动评估成为当前的研究热点[13-14]。其中,猪体图像的前景分割和黏连猪体图像的分离是实现生猪数量自动盘点以及个体行为准确识别的基础。

一方面,猪舍内光照条件复杂、猪体易沾染脏污、猪栏内漏缝地板背景杂乱导致监控图像对比度低,猪体图像分割难度大。这些干扰因素对图像分割算法的鲁棒性提出了更高要求。国内外学者已经开展了相关图像处理算法的研究。Zhu等[3]通过对比Otsu算法、迭代算法和最大熵阈值算法的分割效果,发现最大熵阈值方法,结合形态学开运算,较好的实现了猪体图像分割。Nasirahmadi等[15]首先利用背景减法去除图像背景,随后利用Otsu算法确定二值化分割阈值,最后对二值图像进行腐蚀和膨胀的形态学处理并消除小面积的噪声点,最后得到猪群的分割结果。Nilsson等[5]提出了基于弹性网络正则化的学习分割算法,通过颜色空间、梯度、滤波结果等10个通道的变量值分别计算出每个像素点属于感兴趣区域(region of interest,ROI)的概率,最终得到ROI的概率图像,实现对猪体图像的软分割。但是,该算法较复杂,运算量大,而且受猪的姿态和位置的影响较大。孙龙清等[16]提出了一种基于改进 Graph Cut 算法的生猪图像分割方法,该方法能够减轻背景和光照对分割结果的影响,具有较高的鲁棒性,但是该研究采用的侧面拍摄的图像,猪体相互遮挡严重,未开展黏连猪体个体的分割研究,分割后的图像难以用于个体行为识别。为解决猪舍环境光照复杂,生猪跟踪难度大的问题,段玉瑶等[17]提出了一种优化特征提取的压缩感知跟踪方法,该算法能够显著减轻背景、光照对猪目标跟踪的影响。为了实现在大田复杂光照和背景条件下水稻叶片的分割,Guo等[18]提出了一种基于决策树模型像素级的分割算法(decision-tree-based segmentation model, DTSM),该算法鲁棒性强,能够在多种天气条件下实现水稻冠层覆盖率的准确提取。目前,还未见相关研究将DTSM算法应用在猪体图像分割方面。

另一方面,由于饲养密度大,同时猪爱扎堆,猪群图像中黏连现象较常见。在图像分割提取出感兴趣区域后,需要进一步对猪体黏连图像进行识别并分离。黏连分离的方法主要包括分水岭算法[19]、椭圆拟合法[20]和分割点搜索法[21-24]。高云等[19]利用距离变换法,将二值图像变换为灰度图像,通过改进的分水岭分割算法得到分割脊线,实现黏连猪个体的分割,但是该方法的黏连分离效果依赖于形态学开运算的结果,无法处理黏连程度较高的图像。Lu等[20]利用椭圆拟合分割方法,实现了黏连仔猪的分离。在蛋鸡、害虫、稻米等农业图像处理中,也存在黏连分离的问题。Ju等[21]采用深度学习YOLO算法进行猪目标检测,生成猪个体的包围盒,黏连分割正确率达到了91.96%,但是包围盒分割线不能保留猪体完整轮廓。劳凤丹等[22]利用极限腐蚀及凹点搜寻处理算法分离黏连鸡只。黏连分离后,蛋鸡计数正确率达到了93.5%。李文勇等[23]通过对黏连图像的轮廓进行逐层剥离确定局部分割点,然后继续搜索边界轮廓得到分离点,连接分割点和分离点进行黏连害虫的分割。李冰等[24]通过提取黏连米粒背景区域图像的骨架,确定分割端点,绘制分割曲线,显著提高了黏连米粒图像的分割准确率。王小鹏等[25]提出了一种凹点检测和匹配的枸杞图像分割方法,实现了黏连枸杞的准确分割。但猪姿态多变,黏连情况多样,现有黏连分离方法难以实现黏连猪体的准确分割。

规模化养殖场景下群养猪的黏连分离面临着边界灰度梯度小、黏连情况复杂、重叠遮挡等诸多挑战,为实现群养猪黏连图像的自动分割和盘点,本文在前人研究基础上,利用决策树模型(decision-tree-based segmentation model, DTSM)算法分割猪体图像,结合标记分水岭算法提取待选黏连分割线,分析边界脊线形状特征,探索基于边界脊线识别的群养猪黏连图像自动分割,以期为生猪存栏数量的自动盘点和猪只个体行为的智能识别提供技术支撑。

1 材料与方法

1.1 图像采集

于2018年8月16日在睿畜电子科技有限公司合作养殖场录制了6 min的监控视频。视频帧速率为25帧/s,共计9 000帧图像。栏内饲养了13头育肥猪,品种为外三元。采用安装在猪栏正上方的海康威视摄像头进行整个猪栏区域的拍摄,摄像机安装高度为3 m。本文主要利用512像素×288像素的彩色图像开展生猪的图像分割和黏连分离,基于MatlabR2017a编程实现,PC处理器为Intel Core i7-4790,主频为3.6 GHz。

1.2 决策树图像分割算法

随机选定5幅图片作为训练样本,用于建立决策树分割模型。在训练样本图片中,人工标注感兴趣区域(region of interest,ROI)和背景区域,并提取RGB、HSV、***共3个颜色空间的9个色彩分量,如图1所示。利用CART算法[26]建立基于颜色特征的决策树图像分割模型,如图2所示。利用建立好的模型进行图像分割,分别判断测试图像中每个像素的颜色特征属于ROI或背景区域,从而实现图像的分割。

注:感兴趣区域用红色标注,背景区域用绿色标注。

注:R为RGB颜色空间R色彩分量;a*为L*a*b*颜色空间的a*色彩分量;b*为L*a*b*颜色空间的b*色彩分量;pig为感兴趣区域;background为背景区域。

1.3 黏连猪体分割

在猪体图像前景分割的基础上,通过复杂度公式提取黏连猪体区域,利用标记符控制的分水岭算法检测待选的黏连分割线,最后根据黏连分割线的形状特性选定分割线。

1.3.1 黏连猪体区域的识别

由于黏连猪体连通区域的边界比单只猪体的边界复杂,因此通过分别计算二值图像中各连通区域的复杂度,判断其是否属于黏连区域,并对黏连部分作进一步的分割。复杂度的定义为[27]

式中为连通区域的周长;为连通区域的面积。复杂度0=40时,可以将黏连猪体连通区域与单只猪体区域分开。2只或多只猪黏连形成连通区域的面积应大于单只猪体的面积,将连通区域面积大于单只猪体的最大面积max作为黏连区域的辅助判断依据。经测试,单只猪体最大面积为4 500。分别计算图像中各连通区域的复杂度和面积。当第个连通区域满足>0且>max时,判断该区域属于黏连猪体区域,需要进行分割。黏连猪体和单只猪体区域的复杂度数值存在显著差异,比较容易区分,如图3所示。

注:图中数值表示各连通区域的复杂度。

Note: The number shows the complexity of each connected region.

图3 黏连猪体和单只猪体区域的复杂度对比

Fig.3 Comparison of complexity between connected pigs and isolated pigs

1.3.2 黏连猪体区域待选分割线的检测

为实现黏连猪体的准确分割,本文利用标记符控制的分水岭算法定位黏连猪体区域内部的脊线作为待选分割线。标记符控制的分水岭算法是指根据先验知识寻找猪体前景和背景的标识符,标记符控制的分水岭分割能够显著改善分水岭算法的过分割现象。具体步骤如下:

1)相对于灰暗的漏缝地板,猪体区域较明亮。通过计算灰度图像的局部极大值,选定猪体内部区域作为前景标记;

2)对灰度图像进行二值化,开运算、填充空洞等预处理操作得到二值图像;

华北多特高压交直流强耦合大受端电网系统保护方案设计//罗亚洲,陈得治,李轶群,王青,张剑云,訾鹏,等//(22):11

3)对二值图像进行欧氏距离变换,对距离图像进行分水岭分割,将分水岭变换脊线作为背景标记;

4)进行前景标记和背景标记控制的分水岭分割,得到黏连区域的分水岭变换脊线;

5)将黏连区域的分水岭变换脊线图像与黏连区域的外轮廓线的补充图像进行与运算得到黏连猪体区域待选分割线,如图4所示。

由于猪舍光照条件复杂,以及猪体沾染污渍的影响,部分猪体内部有多个前景标记,导致单一猪体内部出现过分割现象,需要对待选分割线进行进一步的筛选。

1.3.3 基于形状特征的黏连猪体分割线筛选

猪只挤在一起,黏连分割线大多为光滑曲线,不会出现过多的拐点及折线。利用这一特性,通过计算分割线的拐点个数,排除折线等分割线,保留待选分割线。分别计算每条分割线的线性度和Harris角点个数。线性度的计算公式为

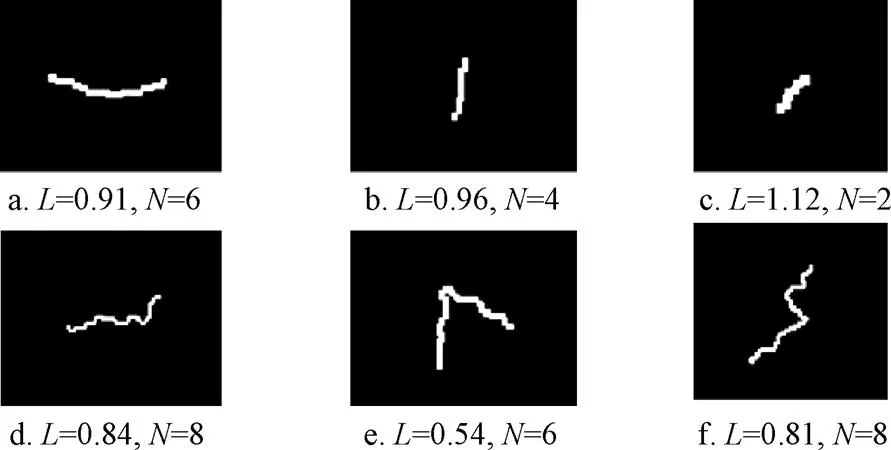

式中D为分割线端点的直线距离;K为分割曲线的实际长度。通过多次试验,选定线性度阈值L0为0.85。结合分割线的最大角点数目Nmax作为判断依据,本试验条件下Nmax为9。当分割线满足L

注:L表示线性度,N表示拐点数目。

通过以上筛选,排除线性度小于0.85或Harris角点个数大于9的分割线(图5d~5f),保留分割线(图5a~5c)。对保留的分割线图像求反,然后与待分割的黏连猪体二值图像进行与运算,实现黏连猪体连通区域的分割。若分割线筛选结果正确,则分割后连通区域的面积应该与单只猪体的面积相近。根据这一规则,对筛选出的分割线逐一检验。利用筛选出来的分割线进行猪体区域的分割,判断每一条分割线分割后,新生成2部分的面积是否均大于×max。其中,为面积系数,本试验条件下=0.6。如果是,则保留;如果否,则排除。为防止部分猪只存在弱黏连,继续对分割结果进行腐蚀。将分割结果与单只猪体区域合并。为了直观展示分割后猪的数目及其在栏内分布,利用德洛内剖分算法[13]对猪群所在区域进行三角剖分。

1.4 黏连分割效果评价

由于猪舍内部光线较暗且光照不均匀,部分猪只身上沾满污渍,同一猪体区域内灰度值变化较大,相邻猪体的界限不明显,较容易出现过分割及欠分割的情况。利用本文方法进行黏连猪体的分割,会存在正确分割、错误分割以及漏分割3种情况。本文采用准确分割率(segmentation accuracy,SR)、误分割率(segmentation error rate,SER)和漏分割率(segmentation missing rate,SMR)3个指标对黏连分割效果进行评价。各指标的计算方法如下

式中correct为正确分割的黏连线数目,missing为漏掉未识别分割的黏连线数目,manual为人工标定的黏连线数目,其中manual=correct+missing,auto为该算法自动识别分割的黏连线数目。

1.5 盘点效果评价

猪的行动较为迟缓,相邻帧图像的相似度高,在获取的9 000帧图像中存在大量冗余图像,因此在150帧中随机抽取1帧图像,共采用60帧图像测试算法的盘点效果。为了对比本文算法与文献[19]的盘点效果,分别计算2种算法的盘点平均误差(counting mean error,CME)、标准差(root mean square error,RMSE)、平均盘点耗时(average counting time,ACT)及盘点准确率(counting accuary,CA)。指标的计算方法如下所示

式中为测试的图像总帧数,i_manual为人工盘点第帧图像中猪的数量,i_auto为本文算法自动盘点得到第帧图像中猪的数量。

2 结果与分析

2.1 猪体前景分割结果

为了比较分析不同图像分割算法的分割效果,分别利用Otsu[28]、最大熵阈值[29]和DTSM算法处理前文所拍视频图像,分割效果如图6所示。由图可见,与Otsu(图6b)、最大熵阈值(图6c)分割算法相比,DTSM算法(图6d)较完整地保留了猪体前景区域,但图中PVC管颜色与猪体颜色接近,DTSM算法未能将PVC管判定为背景。PVC管会将不同猪体区域连通,影响后期黏连图像分离效果。进一步利用形态学开运算和中值滤波处理DTSM分割结果(图6e),去除PVC管等图像噪声得到最终分割结果(图6f)。

2.2 黏连猪体分离结果

为了较好地验证黏连猪体分离的效果,从9 000帧图像中人工筛选出25帧具有显著黏连特征的图像进行黏连猪体分离。利用边界脊线识别的方法筛选黏连猪体的分割线。统计25帧图像的黏连猪体分割效果,人工认定分割线为60条,本文算法自动识别分割线47条,其中正确识别黏连分割线42条,准确分割率(SR)为89.4%,误分割率(SER)为10.6%。漏掉未识别的黏连分割线为18条,漏分割率(SMR)较高,为30%。漏分割率较高是由于有3帧图像存在猪只上下堆叠在一起的现象,无法检测到边界。若排除存在猪只上下堆叠的图像,漏分割率为5.3%。

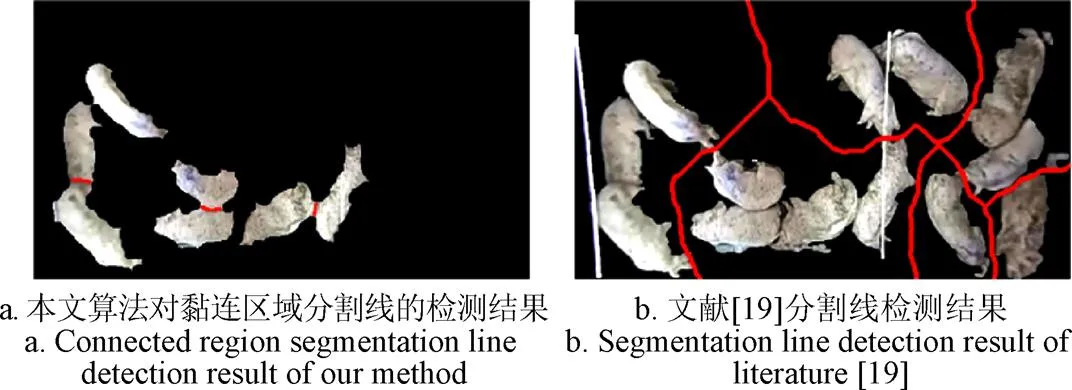

图6 不同分割算法图像分割结果的对比

在相似的研究中,高云等[19]采用圆形结构元素对二值图像进行开运算实现黏连猪体的分离,再利用距离变换选定每个连通区域的最小值区域,并将最小值区域作为“山谷”寻找分水岭分割脊线,实现黏连分割。文献[19]中,分割脊线的提取依赖于开运算的结果。利用文献[19]算法对本文所采用的图像进行开运算后,部分猪体图像仍然黏连在一起,生成的分割脊线无法将黏连的猪体分开,如图7b所示。同时,文献[19]试验用高清摄像头的图像分辨率为1 280×720,猪舍卫生条件较好,猪体与背景对比度较大,图像分割难度较小。而本文算法处理的图像分辨率较低,猪体前景与背景对比度较小,分割线检测区域是开运算后依然黏连的猪体区域,如图7a所示。文献[19]算法分割线检测结果如图7b所示,该算法提取的分割线并没有对本文关注的黏连区域进行分割。

图7 本文算法与文献[19]算法分割线检测结果的对比

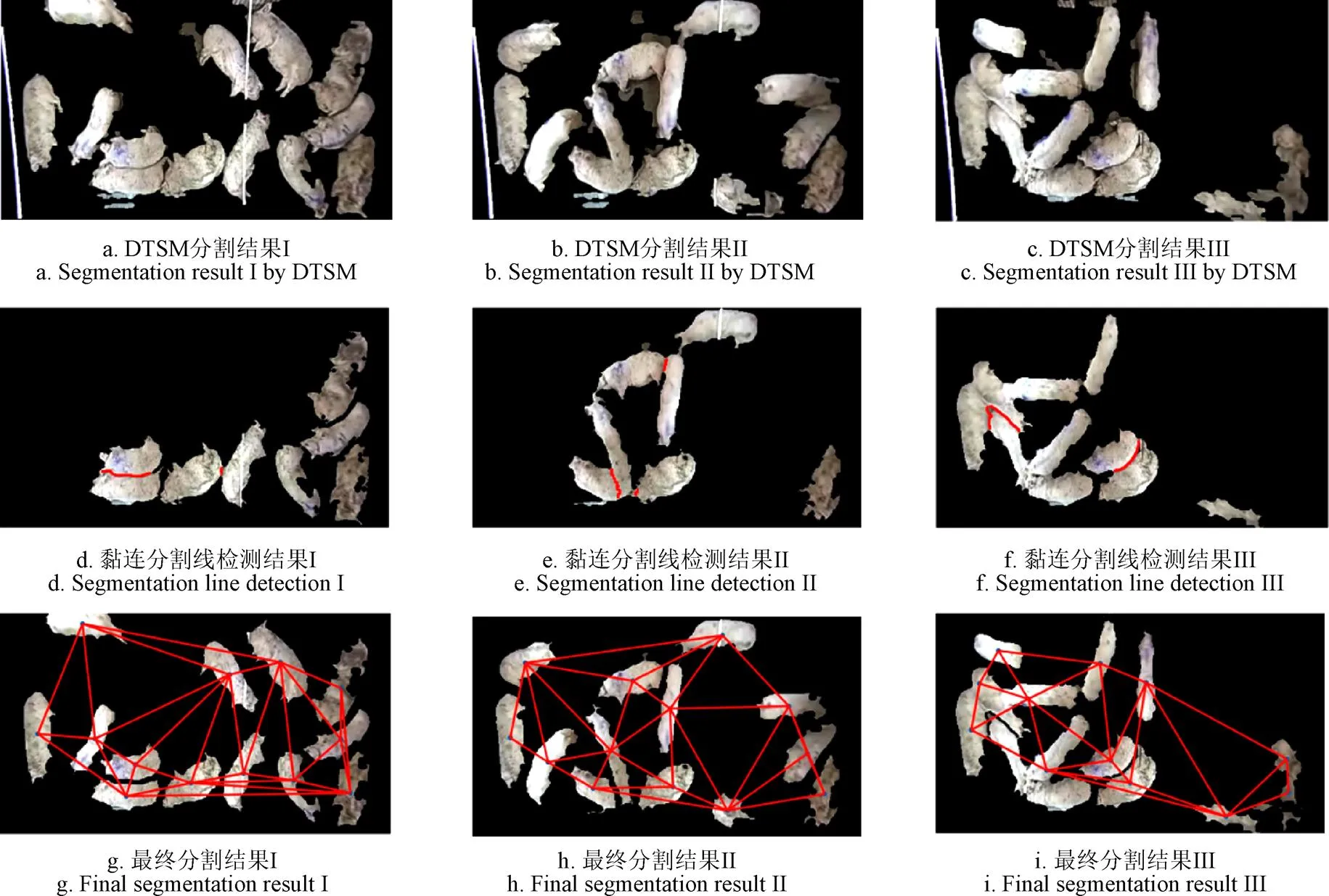

猪只黏连程度可以分为接触但不重叠(I)、轻度重叠(II)以及重度重叠(III)3种黏连等级[18]。图8a~8c为利用DTSM算法对I~III黏连等级图像的分割结果,图8d~8f为利用本文算法检测到的黏连分割线,图8g~8i为利用黏连分割线对图8a~8c的分割结果。其中,红色标记为德洛内三角剖分的结果,每个节点代表分割后单只猪的中心点。由图8g~8i可见,本文算法能够处理I、II两种情况下的黏连分割,同时实现了猪只的初步定位。通过连续处理监控图像可以记录猪在栏内的运动轨迹,辅助进行猪的饮食、休息、活动量等行为分析。但是本文算法对重度重叠(III)猪只的分割效果不好,欠分割和过分割的现象同时存在。当猪只堆叠在一起并存在遮挡的情况下,相邻猪体区域连通,边界的灰度梯度较小难以识别。本文算法可用于处理浅色猪图像,黑猪或花色猪的边界灰度梯度小,边界提取难度较大,需要通过深度相机提取深度信息,增加边界灰度梯度,提高本文算法对重度重叠猪体图像和其他颜色猪的分割能力。

注:I、II、III分别表示接触但不重叠、轻度重叠、重度重叠3种猪体黏连等级。

2.3 猪只自动盘点结果分析

本文算法、分割点搜索法[23]与文献[19]算法对60帧图像的盘点结果如表2所示。在盘点准确率方面,本文算法和分割点搜索法差别不明显,均优于文献[19]算法,本文算法盘点准确率较高,达到了98.33%,特别是在处理轻度重叠(II)图像时,盘点准确性优势较为明显,平均误差(CME)为0.58,标准差(RMSE)为0.89。在平均盘点耗时方面,文献[19]算法盘点耗时为0.089 s,处理速度最快,本文算法其次,为0.39 s,均显著优于分割点搜索算法的9.6 s。综合比较盘点准确率和平均盘点耗时,本文算法自动盘点性能最佳。

其中,分割点搜索法在处理多只猪黏连情况时,采用递归算法耗时严重。在重度重叠(III)情况下,分割点搜索法的黏连区域判定易出错,产生过分割现象,导致盘点准确率为109.34%。相比之下,本文算法通过标记符控制的分水岭算法,保留大部分的分割脊线,避免了递归调用,效率较高。但与文献[19] 相比,本文在分水岭变换后,对每一条可能的分割脊线的形状特征都进行了计算,耗时较多,每帧图像处理的平均耗时为0.39 s。由于养殖过程中猪只大部分时间在躺卧休息,活动不剧烈,对算法实时性要求不高,本算法处理速度为2.56帧/s,能够满足实际应用需求。与深度学习算法[30]相比,本文算法基于传统计算机视觉的方法,不需要部署高性能的计算设备,也不需要采集大量标注猪舍场景数据对深度学习模型进行调参训练,更易于在规模养殖场应用。

盘点准确率受边界脊线识别率的影响较大,只有将图像中每个连通区域的黏连分割线100%正确提取出来,才能实现正确盘点。本文算法对60帧图像中的30帧图像实现了正确盘点。在生猪养殖过程中,猪只数量盘点的实时性要求不高,利用本文算法处理分析多帧连续图像,统计不同盘点结果出现的频率或求取平均值,能够得到正确养殖数量。下一步研究可积累分析更多场景下的图像,对本文算法盘点效果进一步验证。

表2 不同算法的猪只盘点结果

注:CME、RMSE、ACT、CA分别表示平均误差、标准差、平均盘点耗时、盘点准确率。

Note: CME is counting mean error. RMSE is root mean square error. ACT is average counting time. CA is counting accuary.

3 结 论

本文基于决策树模型分割算法和标记符控制的分水岭分割算法,提出了基于边界脊线识别的群养猪黏连图像分割方法,实现了猪体图像的前景分割和黏连猪体的分离。主要结论如下:

1)决策树模型分割算法能够在复杂的背景条件下对猪体图像进行有效分割,本试验条件下分割效果优于Otsu、最大熵阈值等分割算法。

2)对于在实际生产环境下采集的猪舍俯拍视频图像,基于边界脊线识别黏连分离方法的准确分割率达到了89.4%,较好地保留了猪体的轮廓,实现了黏连猪体的良好分割。

3)本文方法、分割点搜索法、文献[19]算法盘点效果对比显示,本文算法平均盘点耗时0.39 s比分割点搜索法平均耗时缩短了9.21 s,盘点平均误差为0.58,比文献[19]减小了3.62,综合性能最佳。对6 min监控图像的抽样统计结果显示,该算法能够实现猪只数量的自动盘点。

由于猪群存在挤压、堆叠等现象,利用标记控制的分水岭算法进行前景提取时,存在将相邻猪体认定为同一猪体的情况,导致欠分割,漏分割率较高。针对以上情况,可通过改善猪舍光照条件,增加图像增强预处理,获取图像深度信息等方法,进一步优化本文算法,以提高盘点的准确率和缩短自动盘点时间。

[1] Yang Q, Xiao D, Lin S. Feeding behavior recognition for group-housed pigs with the Faster R-CNN[J]. Computers and Electronics in Agriculture, 2018, 155: 453-460.

[2] 李亿杨,孙龙清,孙鑫鑫. 基于多特征融合的粒子滤波生猪采食行为跟踪[J]. 农业工程学报,2017,33(增刊1):246-252.

Li Yiyang, Sun Longqing, Sun Xinxin. Automatic tracking of pig feeding behavior based on particle filter with multi-feature fusion[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(Supp.1): 246-252. (in Chinese with English abstract)

[3] Zhu W, Guo Y, Jiao P, et al. Recognition and drinking behaviour analysis of individual pigs based on machine vision[J]. Livestock Science, 2017, 205: 129-136.

[4] Bahr C, Berckmans D, Moons C, et al. The automatic monitoring of pigs water use by cameras[J]. Computers and Electronics in Agriculture, 2013, 90: 164-169.

[5] Nilsson M, Herlin A, Ardo H, et al. Development of automatic surveillance of animal behaviour and welfare using image analysis and machine learned segmentation technique[J]. Animal, 2015, 9(11): 1859-1865.

[6] Viazzi S, Ismayilova G, Oczak M, et al. Image feature extraction for classification of aggressive interactions among pigs[J]. Computers and Electronics in Agriculture, 2014, 104: 57-62.

[7] Chen C, Zhu W, Guo Y, et al. A kinetic energy model based on machine vision for recognition of aggressive behaviours among group-housed pigs[J]. Livestock Science, 2018, 218: 70-78.

[8] Lee J, Jin L, Park D, et al. Automatic recognition of aggressive behavior in pigs using a kinect depth sensor[J]. Sensors, 2016, 16(5): 631.

[9] Nasirahmadi A, Hensel O, Edwards S, et al. Automatic detection of mounting behaviours among pigs using image analysis[J]. Computers and Electronics in Agriculture, 2016, 124: 295-302.

[10] 张弛,沈明霞,刘龙申,等. 基于机器视觉的新生仔猪目标识别方法研究与实现[J]. 南京农业大学学报,2017,40(1):169-175.

Zhang Chi, Shen Mingxia, Liu Longshen, et al. Newborn piglets recognition method based on machine vision[J]. Journal of Nanjing Agricultural University, 2017, 40(1): 169-175. (in Chinese with English abstract)

[11] Liu K, Teng G, Brown-Brandl T, et al. Automatic recognition of lactating sow behaviors through depth image processing[J]. Computers and Electronics in Agriculture, 2016, 125: 56-62.

[12] 肖德琴,冯爱晶,杨秋妹,等. 基于视频追踪的猪只运动快速检测方法[J]. 农业机械学报,2016,47(10):351-357.

Xiao Deqin, Feng Aijing, Yang Qiumei, et al. Fast motion detection for pigs based on video tracking[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016, 47(10): 351-357. (in Chinese with English abstract)

[13] Matthews S G, Miller A L, Clapp J, et al. Early detection of health and welfare compromises through automated detection of behavioural changes in pigs[J]. The Veterinary Journal, 2016, 217: 43-51.

[14] Han S, Zhang J, Zhu M, et al. Review of automatic detection of pig behaviours by using image analysis[C]//In Proceedings of the International Conference on AEECE, Chengdu, China, 2017-05-26-28.

[15] Nasirahmadi A, Richter U, Hensel O, et al.Using machine vision for investigation of changes in pig group lying patterns[J]. Computers and Electronics in Agriculture, 2015, 119: 184-190.

[16] 孙龙清,李玥,邹远炳,等. 基于改进Graph Cut算法的生猪图像分割方法[J]. 农业工程学报,2017,33(16):196-202.

Sun Longqing, Li Yue, Zou Yuanbing, et al. Pig image segmentation method based on improved Graph Cut algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(16): 196-202. (in Chinese with English abstract)

[17] 段玉瑶,马丽,刘刚. 猪舍场景下的生猪目标跟踪和行为检测方法研究[J]. 农业机械学报,2015(S1):187-193.

Duan Yuyao, Ma Li, Liu Gang. Target tracking and behavior detection method in piggery scenarios[J]. Transactions of the Chinese Society for Agricultural Machinery, 2015(S1): 187-193. (in Chinese with English abstract )

[18] Guo W, Zheng B, Duan T, et al. EasyPCC: Benchmark datasets and tools for high-throughput measurement of the plant canopy coverage ratio under field conditions[J]. Sensors, 2017, 17(4): 1-13.

[19] 高云,郁厚安,雷明刚,等. 基于头尾定位的群养猪运动轨迹追踪[J]. 农业工程学报,2017,33(2):220-226.

Gao Yun, Yu Hou’an, Lei Minggang, et al. Trajectory tracking for group housed pigs based on locations of head/tail[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(2): 220-226. (in Chinese with English abstract)

[20] Lu M, Xiong Y, Li K, et al. An automatic splitting method for the adhesive piglets’ gray scale image based on the ellipse shape feature[J]. Computers and Electronics in Agriculture, 2016, 120: 53-62.

[21] Ju M, Choi Y, Seo J, et al. A kinect-based segmentation of touching-pigs for real-time monitoring[J]. Sensors, 2018, 18(6): 1746.

[22] 劳凤丹,滕光辉,李卓,等. 复杂环境中蛋鸡识别及粘连分离方法研究[J]. 农业机械学报,2013,44(4):213-216,227.

Lao Fengdan, Teng Guanghui, Li Zhuo, et al. Recognition and conglutination separation of individual hens based on machine vision in complex environment[J]. Transactions of the Chinese Society for Agricultural Machinery, 2013, 44(4): 213-216, 227. (in Chinese with English abstract)

[23] 李文勇,李明,钱建平,等. 基于形状因子和分割点定位的粘连害虫图像分割方法[J]. 农业工程学报,2015(5):175-180.

Li Wenyong, Li Ming, Qian Jianping, et al. Segmentation method for touching pest images based on shape factor and separation points location[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2015, 31(5): 175-180. (in Chinese with English abstract)

[24] 李冰,何超. 基于背景骨架特征的粘连米粒图像分割算法[J]. 计算机应用,2017,37(S2):198-202.

Li Bing, He Chao. Segmentation algorithm of touching rice kernels based on skeleton features of image background[J]. Journal of Computer Applications, 2017, 37(S2): 198-202. (in Chinese with English abstract)

[25] 王小鹏,姚丽娟,文昊天,等. 形态学多尺度重建结合凹点匹配分割枸杞图像[J]. 农业工程学报,2018,34(2):212-218.

Wang Xiaopeng, Yao Lijuan, Wen Haotian, et al. Wolfberry image segmentation based on morphological multi-scale reconstruction and concave points matching[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2018, 34(2): 212-218. (in Chinese with English abstract)

[26] Breiman L, Friedman J H, Olshen R A, et al. Classification and Regression Trees[M]. California: Chapman & Hall/CRC. 1984.

[27] 近藤直,门田充司,野口伸. 农业机器人:I.基础与理论[M]. 北京:中国农业大学出版社,2009.

[28] Otsu N. A threshold selection method from gray-level histograms[J]. Automatica, 1975, 11(4): 23-27.

[29] Chang C, Du Y, Wang J, et al. Survey and comparative analysis of entropy and relative entropy thresholding techniques[J]. IEE Proceedings: Vision, Image and Signal Processing, 2006, 153(6): 837-850.

[30] 高云,郭继亮,黎煊,等. 基于深度学习的群猪图像实例分割方法[J]. 农业机械学报,2019,50(4):179-187.

Gao Yun, Guo Jiliang, Li Xuan, et al. Instance-level segmentation method for group pig images based on deep learning[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(4): 179-187. (in Chinese with English abstract)

Group-housed pigs image segmentation method by recognizing watershed ridge lines on boundary

Han Shuqing1, Zhang Jianhua1, Kong Fantao1, Zhang Tengfei2, Wu Hailing2, Shan Jiajia3, Wu Jianzhai1※

(1,100081,; 2..,.,201899,; 3.,,124221,)

With increasing awareness and strict regulation of environmental protection, swine production management is becoming more and more intensified.The development of large-scale farming has brought new challenges to breeding managers. Manual pig counting and recognition of pigs’ abnormal behaviors are becoming difficult in larger-scale farm. Automatic counting and pig behavior recognition can save manpower and greatly improve management efficiency. Image segmentation and splitting of touching pigs is the key to realize automatic counting and behavior recognition in group-housed pigs. In this study, the methods of pig image segmentation based on decision trees and splitting of touching pigs by recognizing watershed ridge lines on the boundary were proposed. The experiments were carried out in a commercial pig breeding farm belongs to one partner of Chengdu Ruixu Electronic Technology Co. Ltd.. A Hikvision camera was set above a pen at the height of 3 m relative to the ground. Six min video of group-housed pigs was recorded on August 16th, 2018. Frame rate was 25 frame/s. Image frames extracted from the video were processed in a computer (configured with Intel Core i7-4790 CPU (central processing unit), 3.6 GHz) with Matlab R2017a. The image processing mainly included foreground pigs segmentation and splitting of touching pigs. The foreground pigs were segmented by using Decision-Tree-based Segmentation Model (DTSM). After foreground pigs segmentation, the images were used for splitting of touching pigs. Firstly, touching pigs’ connected regions were extracted by evaluating the complexity of each connected region. Secondly, the candidates of segmentation lines were detected by marker-controlled watershed segmentation. Thirdly, segmentation lines were determined by their segmentation performance and shape descriptors, including linearity and total number of Harris corners. Finally, selected segmentation lines were used to split the touching pigs and automatic counting was conducted. To evaluate the segmentation performance of DTSM, the segmentation results of DTSM were compared with the results of Otsu and Maximum entropy methods. Twenty five image frames with touching pigs were analyzed to evaluate the performance of segmentation lines recognition. To evaluate the performance of automatic counting, 60 image frames extracted from the video in a 6 s time interval were processed. The result of foreground pigs segmentation indicated that DTSM could remove the complex background effectively and achieved better segmentation performance than Otsu and Maximum entropy methods. The segmentation accuracy (SR) of watershed ridge lines recognition was 89.4%. The contours of separated touching pigs were well saved. The segmentation missing rate (SMR) was 30%, Because pig bodies were heavily overlapped by others in three image frames, this made the recognition of segmentation lines become difficult. SMR was 5.3% if the three image frames were removed from the total 25 images frames used for the recognition of segmentation lines. Location and distribution in pens of group-housed pigs can be obtained by calculating the centroid of connected area and Delaunay triangulation method. Counting mean error (CME) was 0.58, root mean square error (RMSE) was 0.89, average counting time (ACT) was 0.39 s and counting accuracy (CA) was 98.33%. The results showed that this method could be used to automatically count the total number of pigs in pens which was valuable information for breeders and managers in large-scale farming. By locating an individual pig in a pen continuously, trajectory can be plotted and its behaviors can be recognized. This study provides a new method to realize automatic counting and behavior recognition in group-housed pigs.

image processing; livestock production; automatic counting; decision trees; recognition of segmentation ridge line; group-housed pigs

韩书庆,张建华,孔繁涛,张腾飞,吴海玲,单佳佳,吴建寨. 基于边界脊线识别的群养猪黏连图像分割方法[J]. 农业工程学报,2019,35(18):161-168.doi:10.11975/j.issn.1002-6819.2019.18.020 http://www.tcsae.org

Han Shuqing, Zhang Jianhua, Kong Fantao, Zhang Tengfei, Wu Hailing, Shan Jiajia, Wu Jianzhai. Group-housed pigs image segmentation method by recognizing watershed ridge lines on boundary[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(18): 161-168. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2019.18.020 http://www.tcsae.org

2018-12-20

2019-06-11

国家重点研发计划资助(2017YFD0502006);中国农业科学院基本科研业务费专项(Y2018ZK46);中央级公益性科研院所基本科研业务费专项(JBYW-AII-2017-33)

韩书庆,助理研究员,博士,主要从事畜禽行为识别与畜牧物联网技术研究。Email:hanshuqing@caas.cn

吴建寨,副研究员,博士,主要从事地理信息系统研究。Email:wujianzhai@caas.cn

10.11975/j.issn.1002-6819.2019.18.020

TP391.4; S818.9

A

1002-6819(2019)-18-0161-08