红外与微光图像开窗配准融合处理方法

杨 钒,钱立志,刘 晓,张 强

(1.陆军军官学院 高过载弹药制导控制与信息感知实验室,安徽 合肥 230031;2.陆军军官学院 偏振光成像探测技术安徽省重点实验室,安徽 合肥 230031)

1 引 言

红外与微光融合是分别利用两种不同成像手段的探测器组成融合系统获取目标在不同波段的反射或辐射信息进行融合,由于目标在不同波段的信息反映上具有互补性及冗余性,因此通过融合可以有效增强场景理解和目标的可探测性。为使融合系统在隐藏和伪装的战争场景中的应用更加广泛,图像的实时融合尤为关键,目前解决图像实时融合的突出障碍是处理速度。对于像素级融合,图像的融合算法及待融合图像分辨率的高低直接影响融合图像质量和融合速度,图像越精细,需要处理的数据量就越多,且不同探测器分辨率的不同也为融合带来了困难,为此,我们研究红外与微光图像开窗融合处理,在减小图像融合处理数据的同时,保留重要的细节融合信息,这将大大提高实时处理速度,在一定程度上解决融合速度与质量的矛盾。

2 图像融合开窗处理

2.1 开窗融合定义

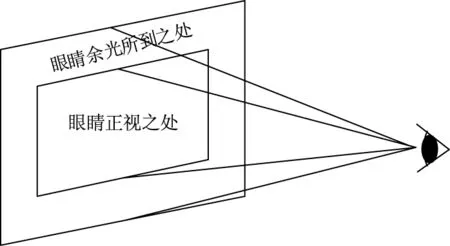

根据人眼的视觉模型可知,人眼观察目标时,在视野范围内看到的景物并不是完全清晰,其正视部分要比余光部分明了,我们感兴趣的部分大多集中在某一区域,如图1所示。可以认为观察者需要看清楚的是区域目标的细节信息,而对非目标的大面积背景区域要求则比较低,如图2所示。传统的图像融合方法耗费了较多的时间对背景融合,而目标区域融合的时间只占整体时间的一小部分。因此,在硬件速度和软件算法不能再优化的情况下,可以将图像中感兴趣的区域看作一个窗口,取另一幅图像(已与前图像配准)相同区域与之进行融合增强处理,我们称之为开窗融合,由于开窗的子窗口信息量相比较源图像要小很多,因此,通过开窗融合可以大大减少融合处理时间,提高融合算法的实时性。

图1 人眼视觉模型Fig.1 Human visual model

图2 人眼目视区域的景物Fig.2 Visual field of human eyes

2.2 图像开窗适用条件

通常在源图像光学系统相同的情况下,采集到的图像比较容易进行配准融合,但在实际应用中,一些红外与微光图像采集设备的光学系统视场相差比较大,且成像形式也不同。例如同一场景的待融合的红外与微光图像来自不同类型的传感器,因此其获取到的图像分辨率大小不一定相同。目前红外图像大多是由红外非制冷焦平面探测器来获取,由于受技术和加工工艺限制,探测器面阵规模有限,而微光探测器主要是由CCD或CMOS加装像增强器组成,通过MCP增强电子信号,图像分辨率由CCD或CMOS决定,其通常比红外图像要高,因此在获取同一场景目标时,红外图像只对应于微光图像中一部分,不能直接进行融合,为此可以采用开窗融合的方法,将低分辨率红外图像作为窗口与高分辨率微光图像中相对应的部分区域配准后再进行窗口融合。

2.3 图像窗口大小选择

图像开窗融合是以损失窗口外图像信息为代价,突出需要的目标信息,目的是保证图像的实时处理速度,因此,在保证实时性的前提下,相对于背景图像所开窗口越大越好,尽可能多的保留窗口信息。假设背景图像面积为S1,开窗的最大面积是S2,系统CPU处理速度为k,软件融合算法的总运算量为m,完成一帧图像融合的时间为t,则:t=m/k。若要图像满足实时性要求则处理速度需要25 f/s,那么开窗最大面积S2=S1/25t,即S2=kS1/25m,从S2可以看出,图像开窗的最大面积取决于CPU的处理速度k和软件融合算法的总运算量m,k越大,m越小,开窗的面积也就越大,反之面积就越小。

3 红外与微光图像开窗配准与融合

由于红外与微光图像成像机制、成像分辨率的不同且光学系统光轴不一致,获取到的红外与微光图像需要配准后方能融合。对于同一目标区域图像信息,由于小视场红外图像的像素数量大于大视场微光图像开窗区域的像素数量,这会使小视场图像相邻四个甚至更多的像素点信息仅代表大视场待融合区域对应的一个像素点,因此,在小视场图像向大视场图像匹配的过程中,通过双线性插值[1]来计算小视场红外图像中对应的大视场微光图像的像素值,双线性内插是用4个已知点的双曲抛物面来拟合1个未知点,这样将可以得到配准后大视场微光图像每个像素在待配准小视场红外图像中对应的四个点的地址和相应权值。最后,选择至少两对参考点来实现图像的配准。

在匹配过程中,由于红外图像通常获取目标辐射信息而微光图像则反映目标微弱的反射信息,图像的灰度存在较大的差异,通常采用的基于灰度信息的配准方法不适合红外与微光图像配准,因此,本文提出的开窗配准方法是利用图像的边缘特征点计算各个像素点对应的仿射变换参数,将该参数建立一套像素匹配存储表,通过直接查表的方式,调用仿射地址和对应的权值完成红外与微光图像的配准。

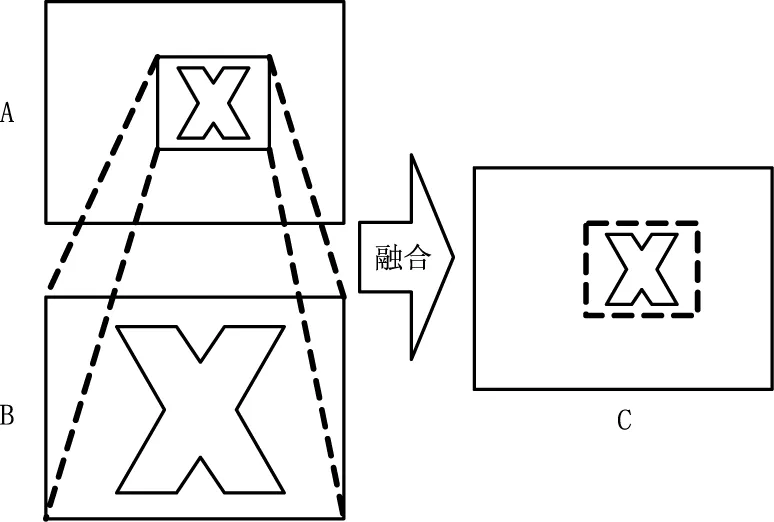

如图3所示,以大视场微光图像A为基准,对小视场红外图像B进行对正,图像B只对应于图像A中一部分,图像C是图像A和图像B的融合结果,实际上图像C中只有虚线部分才是融合图像,而其余部分只有图像A的信息。

图3 两个不同视场图像融合示意图Fig.3 Schematic diagram of image fusion in two different field of view

因此,为确定两图像间对应点的匹配关系,以大视场微光图像为基准,利用仿射变换模型对小视场红外图像进行配准计算:

X*=KRX+T

(1)

式中,X为原始红外图像;X*为红外图像经过仿射变换后的图像;K为尺度缩放因子;R为旋转角度;T为平移量,因此,红外图像上的坐标点经过平移、旋转、缩放后的坐标可用对应的仿射变换表示为:

式中,(x,y)、(x*,y*)分别是变换前后红外图像中对应点的坐标。两幅图像的坐标转换关系由平移量Δx和Δy,旋转角度θ(光轴平行为零)以及行、列缩放因子k(双线性插值的相应权值)等4个参数所决定[2]。平移量参数计算方法如下:

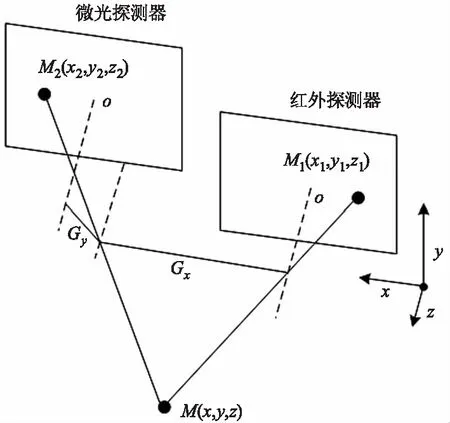

假设目标M(x,y,z)点在红外与微光探测器中所成的像点分别为M1(x1,y1,z1),M2(x2,y2,z2),如图4所示。

图4 双探测器目标成像示意图Fig.4 Schematic diagram of dual detector target imaging

经过光学微调可使两个探测器处于同一平面上且其坐标系统所对应的光轴精确平行,以红外探测器为基准,通过三角几何关系可得:

式中,f1、f2分别为两个探测器镜头的焦距;Gx、Gy为两探测器中心之间在x轴和y轴方向上的连线,则目标M(x,y,z)在两个探测器中的像点视差即为两幅图像的坐标平移量Δx和Δy,Δx=x1-x2,Δy=y1-y2。由此可见,目标在红外与微光探测器中均能找到相对应的匹配点,该匹配点具有确定的仿射变换参数。

为提高运算速度,在大视场微光图像与小视场红外图像中,采用一种利用局部差分寻找边缘的Sobel算子[3]提取两幅图像的各个边缘特征点,利用前述方法计算这些特征点对应的空间几何关系的仿射变换参数,将其制作成一套像素匹配存储表进行存储,在图像配准时,通过直接查表的方式,调用小视场红外图像对应的大视场微光图像像素值的仿射变换地址及对应的权值完成配准,然后再采用经典的拉普拉斯金字塔融合[4]方法进行融合,从而大大提高系统速度。

4 开窗融合实验与分析

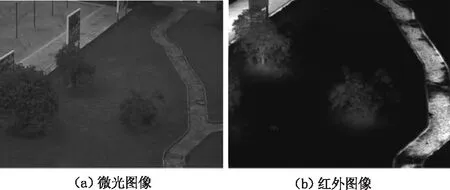

实验采用研制的平行光轴共视场光学系统,通过红外与微光双探测器双镜头同时获取目标的红外与微光图像。图像采集时的环境照度大于10-2lx,实验目标距离探测器约为10 m,实验样本为操场上隐藏在草丛中的金属板的红外与微光图像,其中,红外图像大小为640×480,微光图像大小为800×600,如图5所示。

图5 实验源图像Fig.5 Source experimental image

图5(a)为微光图像,图5(b)为红外图像,从图中可以看出,在微光图像中,景物的细节特征比较明显,敏感于目标场景的反射,但放置在草丛中金属板很难看见,具备一定的隐藏效果。而在红外图像中则能较清晰的看到金属板的辐射信息,图中道路、树丛等也具有较强的红外特征,但对整个场景的反射亮度变化不敏感,看不到路面、草丛等背景的细节信息,由此可见两者均存在不足之处。为增强场景理解,在隐藏、伪装和迷惑的背景下更快更精确地探测目标,采用本文提出的图像开窗配准融合方法对两幅图像进行处理,实验结果如图6所示。

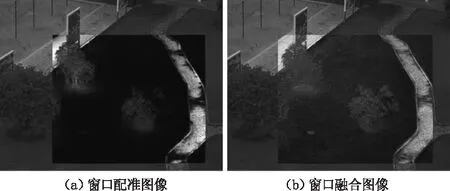

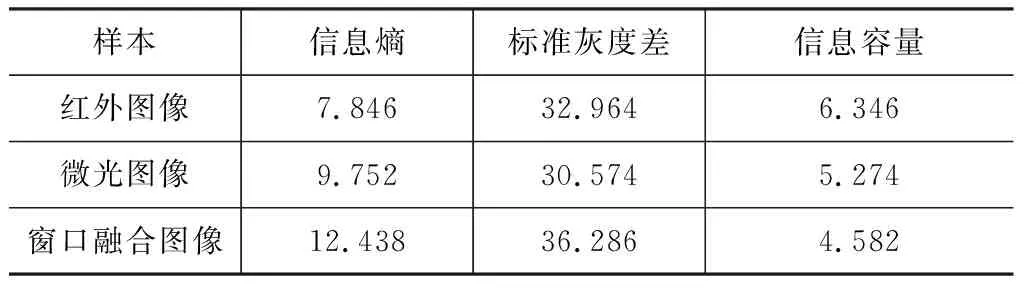

由于红外图像视场小于微光图像,因此,首先需要对图像进行配准,然后以红外图像大小为窗口进行开窗融合,图6(a)为红外图像相对于微光图像,经过平移和双线性插值缩放后的配准图像。图6(b)为经过配准后的开窗融合图像,从图中我们可以直观的看出开窗融合图像中原微光图像细节特征得到了保留,而原红外图像中我们感兴趣的金属板目标也得到了体现,窗口融合区域明显改善了人眼的识别性能,提高了图像分辨效果和人眼对场景目标的发现和识别概率。为客观评价图像融合后的效果,我们采用反映图像细节信息的信息熵[5]、标准灰度差[6]以及反映图像清晰度的二维直方图信息容量[7]的评价方法对融合前后的图像进行评价,图像的信息熵和标准灰度差越高,反映的图像细节信息越丰富。而相同的场景下,图像灰度比较集中,边缘模糊时,图像的灰度没有拉开适当的距离,信息容量较大,反之,图像较清晰时,信息容量较小,信息容量和清晰度具有反比的关系。实验结果如表1所示。

图6 配准融合结果Fig.6 Registration and fusion experiment表1 实验评价结果Tab.1 Experimental evaluation results

样本信息熵标准灰度差信息容量红外图像7.84632.9646.346微光图像9.75230.5745.274窗口融合图像12.43836.2864.582

从表1可以看到,融合后的窗口图像相对于原始微光和红外图像,信息熵和标准灰度差都得到了较大的提高,信息容量也相应减小,说明融合后的图像在图像细节和清晰度方面均有一定程度的提高,客观地说明了融合图像包含更多的信息,这也验证开窗融合的可行性。

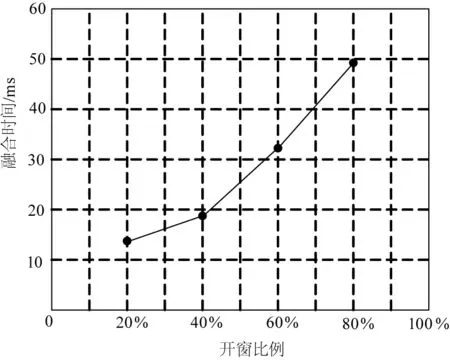

为验证开窗融合的实时性,在配准和融合算法一定的情况下,我们采用不同的开窗面积对开窗融合的时间进行了测算,结果如图7所示。

图7 开窗面积与融合时间关系曲线Fig.7 Relationship between window area and the time of fusion

由图中曲线可以看出,随着开窗面积的增加,图像的配准和融合运算量均有不同程度的增加,随之开窗融合的时间也明显增多,窗口越小,开窗融合速度就越快,基本达到实时融合效果,但如果增加融合算法的复杂度,在系统运算能力一定的情况下,只有减小窗口面积,取得算法与窗口大小关系的平衡性才能保证融合的实时性。

5 结 论

针对不同视场的红外与微光图像融合问题,提出了开窗融合技术。该技术可应用于视场大小不同的红外与微光图像,通过开窗提取图像中人眼感兴趣的区域信息进行融合来满足观察要求,图像开窗的尺寸取决于系统的硬件速度和融合算法的运算量,窗口的大小是平衡不同复杂度融合算法与实时性之间的矛盾的重要指标,这对兼顾图像融合质量和速度要求的图像融合系统具有较高的应用价值。