篮球投射过程中的角度智能视觉图像分解判断方法

何波

摘 要: 针对传统图像分解判断方法一直存在不能根据篮球投射角度变化完成投篮运动图像分解的问题,提出基于奇异值分解的篮球投射角度智能视觉图像分解判断方法。通过分析不同投篮情况下,投射角度的变化,确定篮球投射角度;并以此为基础,引入奇异值分解,对智能视觉图像分解进行判断。实验结果表明,智能视觉图像分解判断方法,提升投篮运动分解图像对比度;在最短时间内,根据篮球投射角度变化,完成投篮运动图像分解。

关键词: 篮球投射; 角度确定; 智能视觉图像; 图像分解; 奇异值分解; 图像对比度

中图分类号: TN911.73?34; TM911.73 文献标识码: A 文章编号: 1004?373X(2018)10?0175?04

Abstract: In allusion to the long?existing problem that the decomposition of basketball shooting motion images cannot be accomplished according to the variation of basketball projection angles in the traditional image decomposition and judgment method, a basketball projection angle decomposition and judgment method based on singular value decomposition is proposed for intelligent visual images. The basketball projection angles are determined by analyzing the variation of projection angles in different basketball shooting situations. On this basis, singular value decomposition is introduced to judge the intelligent visual image decomposition. The experimental results show that the intelligent visual image decomposition and judgment method can enhance the contrast degree of basketball shooting motion decomposition images, and accomplish basketball shooting motion image decomposition according to the variation of basketball projection angles within the shortest time.

Keywords: basketball projection; angle determination; intelligent visual image; image decomposition; singular value decomposition; image contrast degree

0 引 言

在籃球投射过程中,因投篮动作的不同,会导致不同投射角度的产生。传统图像分解法捕捉到的投篮图像不能在投篮角度变化的过程中,捕捉到每个角度变化瞬间的清晰图像。这也造成经过现有智能视觉分解技术处理后的图像,对比度差、分解过程耗时长等现象的出现。从投篮形式上,可将篮球投射过程中的角度,分为投空心篮时的角度和投碰篮板时的角度[1]。不同投篮形式产生的角度不同,面对不同的角度,需要采用不同的确定方法。在完成篮球投射过程中的角度确定之后,根据已确定的角度进行奇异值的分解,根据分解结果对图像的分解判断方法进行描述。至此,篮球投射过程中的角度智能视觉图像分解判断方法,得以实现。

1 篮球投射过程中的角度确定

1.1 投空心篮时角度的确定

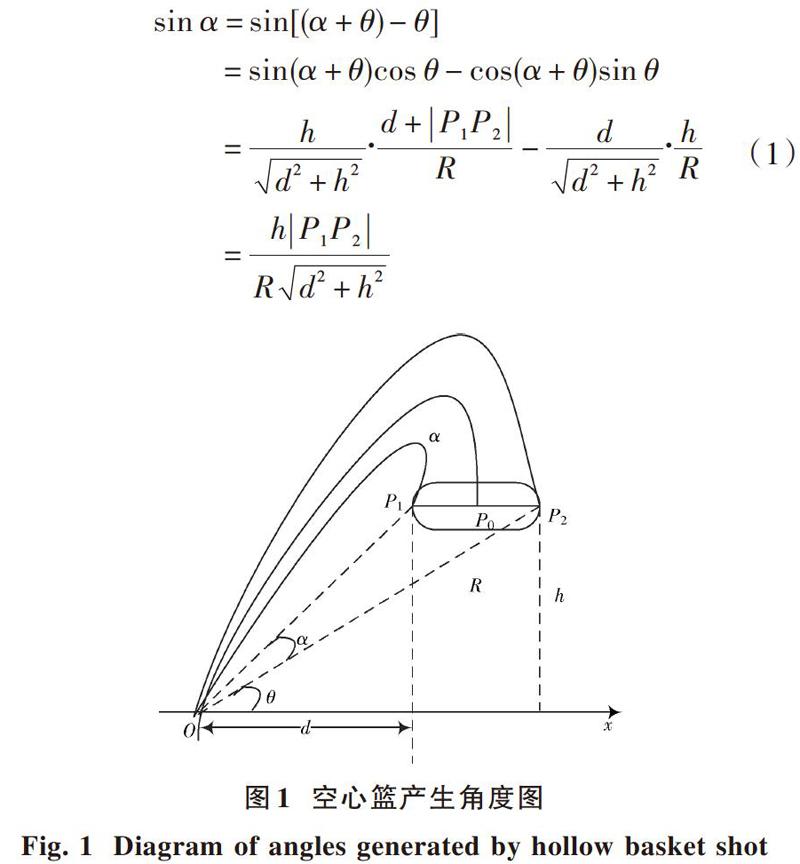

在运动员进行空心投篮时,以球出手时的圆心位置作为原点[2?3],以水平方位和竖直方位,分别作为[x]轴和[y]轴,则投空心篮时产生的角度如图1所示。

根据图1可知,投空心篮时产生的角度为[α]。设篮筐与球出手时圆心的距离为[d],篮筐据地面高度为[h],篮筐边缘[P2]与原点[O]间的距离为[R],则投空心篮时产生的角度[α]可表示为:

1.2 投碰板篮时角度的确定

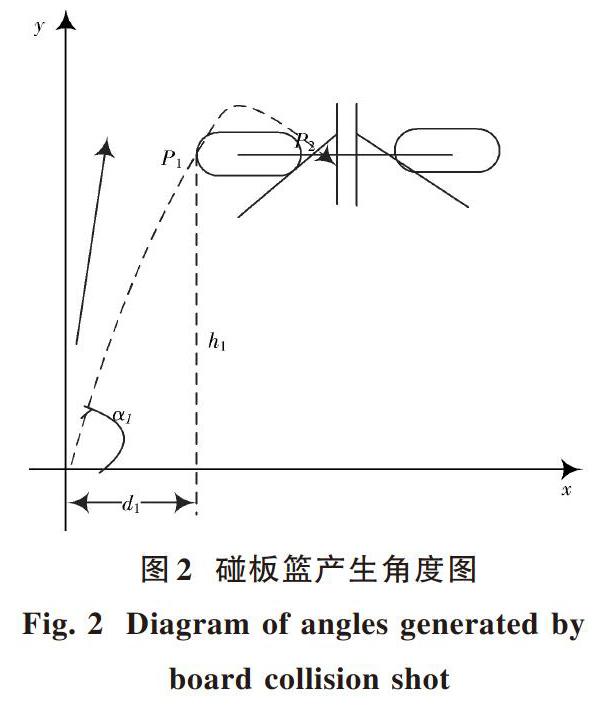

在运动员进行碰板投篮时,假设篮板背面相同位置也有篮筐,以球出手时的圆心位置作为原点[3],以水平方位和竖直方位,分别作为[x]轴和[y]轴,则碰板投篮时产生的角度如图2所示。

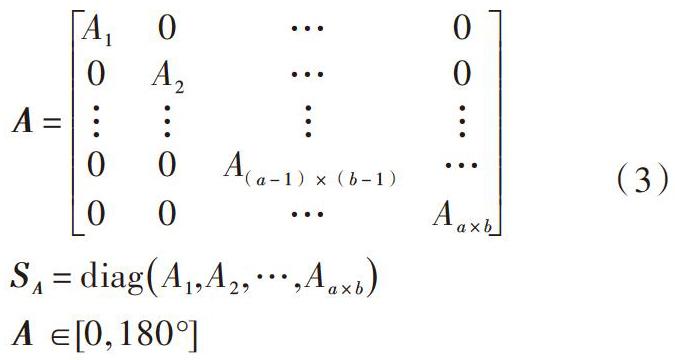

根据图2可知,投碰板篮时产生的角度[α]可表示为:

通过上述方法,首先判断篮球的投射方式,再根据不同投射方式确定角度的步骤,完成篮球投射过程中的角度确定。

2 基于篮球投射角度图像分解判断方法的构建

2.1 根据篮球投射角度完成奇异值分解

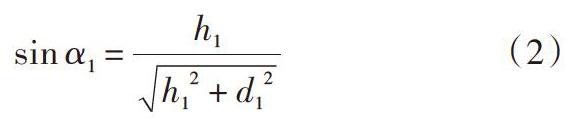

奇异值分解应用代数特征提取思想,将待分解数值进行矩阵排列,并通过特定方式,将任意矩阵分解成只含有非零奇异值的矩阵[4?5]。设篮球投射角度在0~180°之间变化,矩阵[A]为[a×b]的非负矩阵,且其中的每一项均代表一次篮球投射产生的角度。则矩阵[A]的奇异值分解过程,可表示为如下公式:

式中:[SA]代表矩阵[A]奇异值分解后结果;[diag]代表奇异值求解过程中的固定算法。篮球投射角度会随投篮形式的不同发生变化,而经过奇异值分解后的角度矩阵,具有比例不变性[6?7]。对于篮球投射角度图像分解来说,比例不变性有效解决,因图像分辨率不同引发的图像尺度变化问题。

2.2 投射角度图像分解判断方法的描述

通过对篮球投射角度的奇异值分解,可知图像的奇异值是图像本身的非视觉特性。根据已确定的篮球投射角度,完成奇异值分解,再利用智能视觉效果处理,提高图像分解的监测敏感性[8]。投射角度图像分解判断方法,整体思路并不是对投射全角进行奇异值分解,而是根据智能视觉系统估算有效投射角度,再通过视觉掩盖效应,掩盖无效投射角度。通过对掩盖后的图像和原图像进行奇异值分解,得到两幅不同的图像。再根据两幅图像中有效投射角度、无效投射角度的对比,完成篮球投射角度图像分解判断。

2.3 智能视觉图像分解判断方法的實现

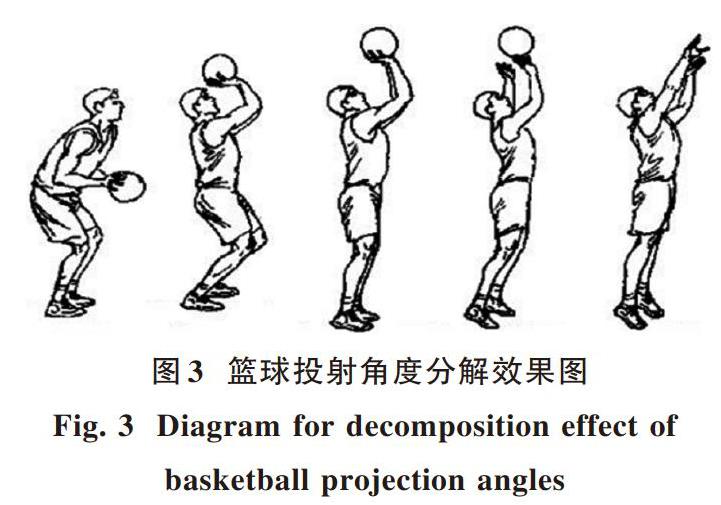

通过上述过程,可以完成对探求投射角度的奇异值分解和图像分解判断方法的描述。根据智能视觉图像分解原理,可知篮球投射角度分解图像的边缘和不分文理区域,都是组成轮廓的重要部分,既代表了图像的特征信息,也是人眼的特别关注区域[9]。为保证篮球投射过程中的角度智能视觉图像分解判断方法的顺利实现,还需按照视觉掩盖效应,对有效投射角度和无效投射角度区分,根据区分结果,掩盖无效投射角度。再对原图和完成无效投射角度掩盖后的图片,同时进行奇异值分解。再根据分解结果,进行边缘轮廓的细化处理,做到突出中心图像。通过智能视觉图像分解判断方法,处理后的篮球投射角度图像如下:

3 实验结果与分析

通过上述方法,完成篮球投射过程中的角度智能视觉图像分解判断方法的搭建。为了验证该方法的实用性价值,令一名男性篮球运动员,在空旷的场地上,模拟篮球投球运动。分别运用智能视觉图像分解判断方法和普通方法,对该名运动员在投篮时,角度的变化图像进行分解。实验开始前,首先对实验的各项参数进行设施。

3.1 实验参数设置

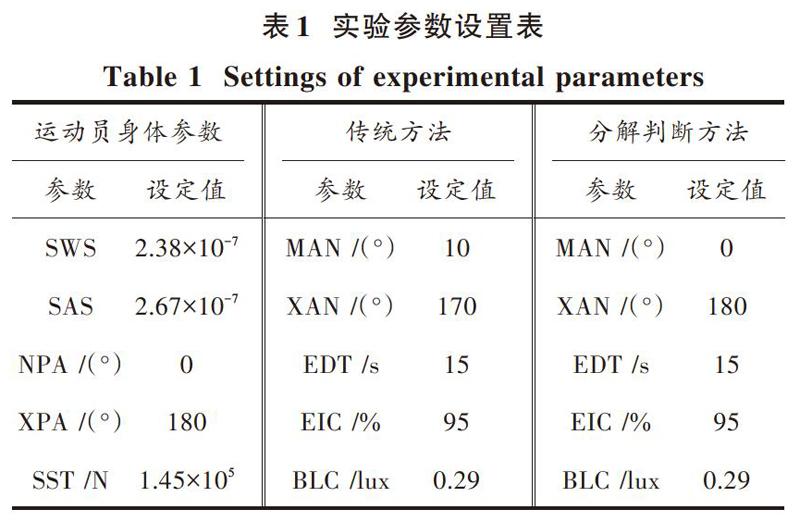

实验参数设置如表1所示。

运动员身体参数一栏,从上至下依次为手腕力量劲度系数、手臂力量劲度系数、最小投射角度、最大投射角度、投篮力度;传统方法与分解判断方法从上至下依次为最小采集角度、最大采集角度、预期分解时间、预期图像对比度、基础亮度。为保证实验的公平性,所有实验参数均遵照真实情况制定。

3.2 投篮运动分解图像对比度比较

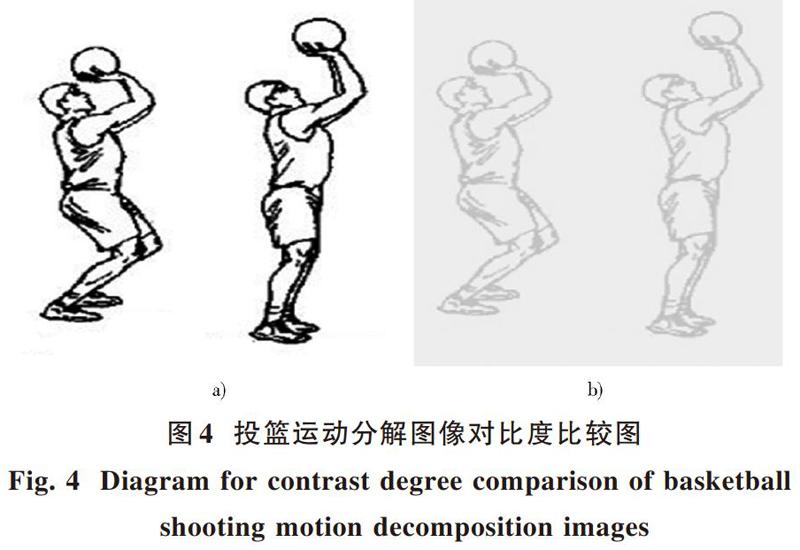

完成实验参数设定后,令该名运动员开始模拟投篮运动,分别运用智能视觉图像分解判断方法和普通方法,采集投篮过程中的角度变化情况,再根据角度变化情况进行图像分解判断。分解投篮角度图像的对比度,与图像分解判断方法的优劣成正比,分解后图像的对比度越高,代表智能视觉图像分解判断方法的分解效果越明显,反之则代表分解效果还需提升。

图4a)为运用智能视觉图像分解判断方法,分解得到的篮球投射过程中的角度变化图像;图4b)为运用普通方法,分解得到的篮球投射过程中的角度变化图像。根据左右两图对比,可发现左图的对比度明显高于右图。因此,可证明智能视觉图像分解判断方法,确实可提升投篮运动分解图像对比度

3.3 投篮运动图像分解时间对比

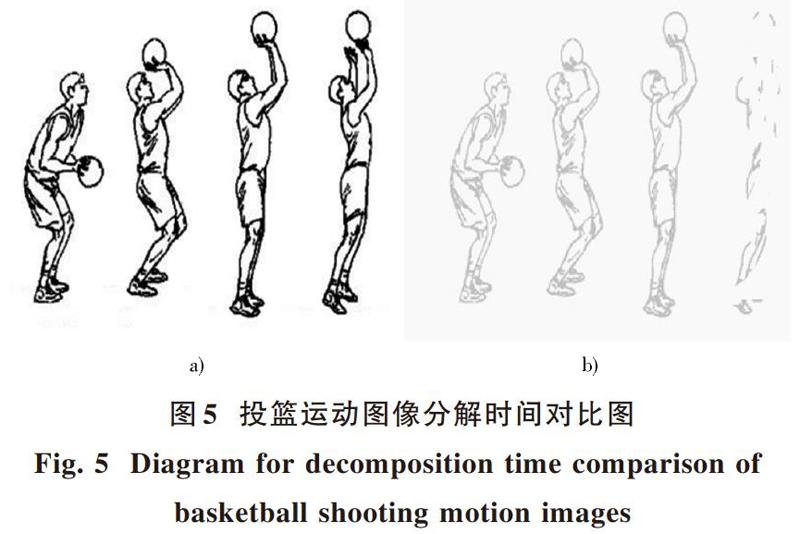

从运动员开始投篮时刻起,截取5 s时间,分别导出智能视觉图像分解判断方法和普通方法,完成的投篮角度分解图像,结果如图5所示。

图5a)为智能视觉图像分解判断方法,在5 s内完成的篮球投射角度分解图像;图5b)为普通方法,在5 s内完成的篮球投射角度分解图像。根据两图对比,可发现普通方法在相同时间内,分解得到的图像明显少于智能视觉图像分解判断方法。因此,可证明智能视觉图像分解判断方法,能在最短时间内,根据篮球投射角度变化,完成投篮运动图像分解。

4 结 语

根据上述方法,可完成篮球投射过程中,角度智能视觉图像分解判断方法的搭建。通过模拟实验的方式,证明该方法确实比普通方法,具有更高的实用价值。

参考文献

[1] 王耀南,陈铁健,贺振东,等.智能制造装备视觉检测控制方法综述[J].控制理论与应用,2015,32(3):273?286.

WANG Yaonan, CHEN Tiejian, HE Zhendong, et al. Review on the machine vision measurement and control technology for intelligent manufacturing equipment [J]. Control theory & applications, 2015, 32(3): 273?286.

[2] 杨洁,梅向辉,Hellwich OLAF.基于Matlab的图像采集系统研究:在基于视觉的智能监控系统中[J].南京邮电大学学报(自然科学版),2016,36(6):96?99.

YANG Jie, MEI Xianghui, HELLWICH O. Image acquisition system based on MATLAB [J]. Journal of Nanjing University of Posts and Telecommunications (Natural science edition), 2016, 36(6): 96?99.

[3] 毕齐林,刘志军,徐虎,等.线结构光辅助式焊缝视觉跟踪中图像分割方法研究[J].科学家,2017,5(9):95?96.

BI Qilin, LIU Zhijun, XU Hu, et al. Research on image segmentation method in visual tracking of linear?structure and light?auxiliary welding seams [J]. Scientist, 2017, 5(9): 95?96.

[4] 杨新锋,田广强,路新华,等.基于智能视觉分析无人机发动机转速测量方法[J].计算机仿真,2015,32(9):72?74.

YANG Xinfeng, TIAN Guangqiang, LU Xinhua, et al. Engine speed measurement method for unmanned aerial vehicle (UVA) based on intelligent vision analysis [J]. Computer simulation, 2015, 32(9): 72?74.

[5] 陈思,常征.基于视觉的智能车图像畸变校正算法研究[J].计算机与网络,2016,42(z1):88?89.

CHEN Si, CHANG Zheng. Research on image distortion correction methods of intelligent vehicle based on vision [J]. Computer & network, 2016, 42(S1): 88?89.

[6] 李超,吕宪伟,涂文俊,等.基于计算机视觉的实木表面智能化分选系统设计[J].北京林业大学学报,2016,38(3):102?109.

LI Chao, L? Xianwei, TU Wenjun, et al. Design of an intelligent wood surface grading system based on computer vision [J]. Journal of Beijing Forestry University, 2016, 38(3): 102?109.

[7] 陈勇,帅锋,樊强.基于自然统计特征分布的无参考图像质量评价[J].电子与信息学报,2016,38(7):1645?1653.

CHEN Yong, SHUAI Feng, FAN Qiang. A no?reference image quality assessment based on distribution characteristics of natural statistics [J]. Journal of electronics & information technology, 2016, 38(7): 1645?1653.

[8] 张飞,李景富.基于智能视觉的高空图像搜集系统的设计与实现[J].计算机测量与控制,2015,23(3):939?941.

ZHANG Fei, LI Jingfu. Aerial image collecting system design and implementation based on intelligent vision [J]. Computer measurement & control, 2015, 23(3): 939?941.

[9] 尹旭悦,范秀敏,顾岩,等.动态视觉手势识别下手工装配时序控制的智能防错方法[J].计算机集成制造系统,2017,23(7):1457?1468.

YIN Xuyue, FAN Xiumin, GU Yan, et al. Sequential dynamic gesture recognition controlled poka?yoke system for manual assembly [J]. Computer integrated manufacturing systems, 2017, 23(7): 1457?1468.