结合双深度学习特征的高光谱遥感图像分类

曾 锐,陈锻生

(华侨大学 计算机科学与技术学院,福建 厦门 361021)

1 引 言

由于高光谱卫星图像具有丰富的地物波谱信息,早期多数的遥感图像分类研究侧重于图像的光谱信息[1],但这也给分类带来了一些挑战,例如统计模型下的分类器在少量训练样本的情况下无法准确的估计出高维空间的类条件概率密度函数,往往会导致分类精度的下降,这也被称作Hughes现象[2],为了避免该现象,一般需要先对高维数据降维或是提取出更加鲁棒的特征[3-5],其中降维操作主要是指将高维特征映射到更容易判别特定地物类别的低维特征空间.然而一些传统的降维方法(PCA、LDA等)无法保留各个波段的物理特性,因此有人将波段选择作为另一种降维方法[6].随后的研究发现结合空间信息和光谱信息的特征有助于提升高光谱图像的分类精度[7,8].例如Benediktsson[9]等人基于形态学的操作,也有Li[10]等人提取gabor特征,以及Wang[11]等人将纹理信息、形态学信息、光谱信息堆叠后进行分类.合理的预处理和后处理也在一定程度上提高了高光谱图像的分类准确率.例如Kang[12]等人先使用保边去噪预处理后再分类.Li[13]等人用Sobel边缘检测算法处理图像形成一张权重图,既可以用于图像保边去噪也能优化分类后的概率表.Kang[14]等人基于邻接像素的连接强度作为一种后处理方法来优化初始分类得到的概率表.

近几年深度学习作为一种可以提取不同层次特征的工具受到了越来越多的关注,并且已经在图像处理、自然语言、语音等方面取得了重大进展,现在也被逐渐运用到高光谱图像的分类和分割.Chen[15]、Zhou[16]等人先是使用主成分分析(PCA)将光谱特征降维,取像素一定邻域形成的图像块,将其展成一维向量,然后和原始图像的光谱信息串联成新的一维向量作为输入,然后使用栈式自编码网络(SAE)或是深度置信网络(DBN)来对像素进行分类.虽然他们考虑了空间上的邻接像素(一定邻域的像素同属一类的概率很大),但是将其展成一维后破坏了它原有的空间结构.后来Chen[17]等人提出了使用卷积神经网络(CNN)来改善上述问题,它允许数据以二维或者三维的形式作为输入,实验也证明CNN对高光谱图像的分类准确率明显高于SAE和DBN.Cao[18]等人基于贝叶斯理论,将CNN分类结果当作似然概率,超像素分割方法提供先验,最后得到分类结果.Zhao[5]等人延续了上面所提的像素邻域的图像块思想,并且提出了基于局部鉴别嵌入算法(LDE)改进的降维算法BLDE,随后将降维后的光谱特征和CNN提取的特征拼接,最后使用支持向量机和逻辑回归两种分类器进行分类.

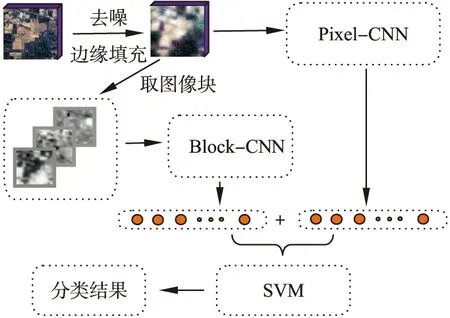

原始图像因为获取过程中受诸多因素的干扰,或多或少存在噪声,而且标注样本的获取代价昂贵,所以如何在尽可能少的训练样本前提下,合理地结合预处理提取和结合多种不同的深度学习的高光谱特征是一个值得探索的方向.因此本文先使用保边松弛算法[13]对高光谱图像每个波段对应的灰度图进行保边去噪处理,然后将像素的光谱信息(此时已经包含空间信息)作为卷积神经网络的输入用来提取一种光谱-空间特征.随后对高光谱图像的光谱维度进行降维,取像素点一定大小邻域形成的图像块(跟中心点像素同类别)作为另一个卷积神经网络的输入用来提取第二种光谱-空间特征(对于提取图像边缘的像素点的图像块,事先已对边界做了零元素填充),最后将两个特征串行拼接后使用支持向量机分类.此次本文提出的分类模型:1)使用的模型简单,参数少,所以只需要很少的训练样本;2)多特征相比单特征在分类精度上有更大的提升;3)基于改良后的保边松弛算法算法用于图像预处理,在本文分类框架下取得了很高的分类精度.

2 分类框架及其相关技术

本文提出的结合两种光谱-空间特征的分类框架TFCNN(Two spectral-spatial Features concatenation based on CNN)如图1所示.因为原始图像在获取过程受诸多因素的干扰,例如大气层、光照变化等,存在噪声,所以首先使用Li[13]提出的算法对图像进行保边去噪处理,在这里本文对该算法做了一些改良,以提高在本文提出模型下的分类精度.然后基于它的光谱维提取第一种光谱-空间特征,因为光谱高维的特点,为了避免计算复杂度,随后对图像的光谱维PCA降维(保留主要信息),取像素的一定大小邻域组成的图像块来代表中心像素,基于图像块提取第二种光谱-空间特征.最后串行拼接两种特征作为分类器的输入进行分类.

图1 TFCNN分类系统框架Fig.1 TFCNN classification system framework

市场容量的大小,是企业扩充的根本决定因素,企业首先应该考虑的方式是高效率或低成本扩张。如果企业缺乏高效率的工业基础,盲目扩张,即使产量再大,也不一定成为赢家。一旦市场价格下滑的速度高于企业成本的降低速度,企业就可能陷入被市场淘汰的僵局。

2.1 保边松弛算法

如图3(a)和图3(b)所示,分别为本文提出的两种提取光谱-空间特征的卷积神经网络框架.其中对于pixel-CNN我们把每个像素样本当成一个高度为波段数,宽度为1的二维图像[23],网络有一个卷积层(16个特征表,卷积核为10×1)、一个池化层(池化大小2×2)以及两个全连接层(神经元数分别为50、像素类别数),而Block-CNN网络有一个卷积层(16个特征表,卷积核为4×4)、一个池化层(池化大小2×2)以及两个全连接层(神经元数分别为100、像素类别数).本文实验在两个模型的卷积层和全连接层后均添加了Dropout层,以防止过拟合的发生.

(1)

其中p=[p1,…,pn]∈RK×n,pi=[pi(1),…,pi(K)],K表示的是原始图像p的波段数,n表示像素个数,u表示为优化后的图像,维度跟原图一致.λ为权衡因子,用来控制目标函数对两项的惩罚力度.∂i表示第i个像素的八邻域,εj表示的是边缘权重图ε中第i个像素的八邻域对应的边缘权重,ε如式(2)所示:

2.4 年龄对围产儿死亡发生影响 围产儿死亡的发生率,在经产妇中随年龄组的增高而增高, RR值更高。见表5。

(2)

1.1.4 心肌穿孔 心肌穿孔的发生率<1%,主要发生在右心室。心肌穿孔引起的心包填塞则是十分凶险的并发症,也是永久起搏器植入术后最严重并发症。

(3)

优化后的图像如图2(b)所示,虽然图像的边缘模糊程度更大了一点,但它基本保持了原图像的边缘形状,本文后续实验也将证实基于新的ε优化后的图像能够更大程度上的提高分类精度.接下来本文用PR*来表示基于εreplace的保边松弛算法.

在实验室资源得到合理应用的同时,更要及时的处理实验室使用过程中存在的问题。民办高校要建立健全实验室的规章制度和维护措施,很多学校为了减少经费,并没有聘请专门的实验室管理人才,而是由教师替代负责实验室的管理工作。要培养这部分教师对实验设备的管理和维护技能,使实验设备能够得到有效的维护和保养。

图2 Indian Pines的第24个波段对应的灰度图Fig.2 The 24th band′s grayscale image in Indian Pines

2.2 卷积神经网络

本文使用了两个高光谱数据集1来检验所提出的模型的分类能力.

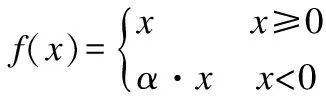

传统的深度神经网络每层的每个神经元跟下一层的所有神经元相连,神经元之间的权重各不相同,CNN则不同于一般结构:1)局部相连2)权重共享.卷积层的每个神经元的值是由输入的局部神经元的加权和加偏置项得来的,其中权值w是共享的,然后通过一个非线性激活函数后的值作为下一层的输入,因为现实的数据大多数都是非线性的,因此神经网络利用非线性映射去逼近数据的真实分布,人们经常使用的激活函数包括sigmoid、Relu、maxout等[20,21],其中Relu因收敛快、计算梯度简单而被广泛使用,而本文则使用的是由He[22]等人提出的激活函数PRelu(α为可学习的向量,确保小于0的部分梯度不为0),函数公式如下:

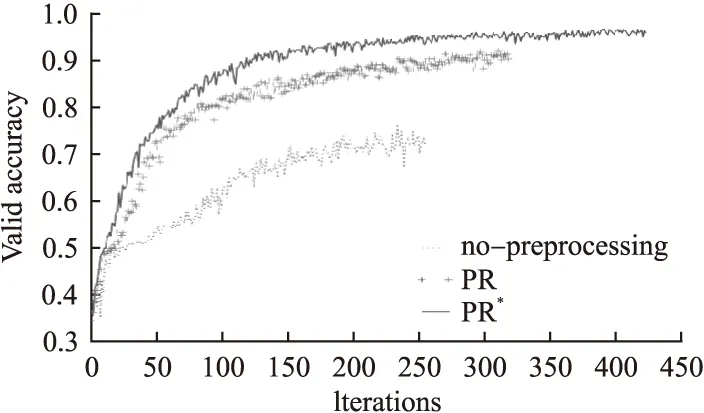

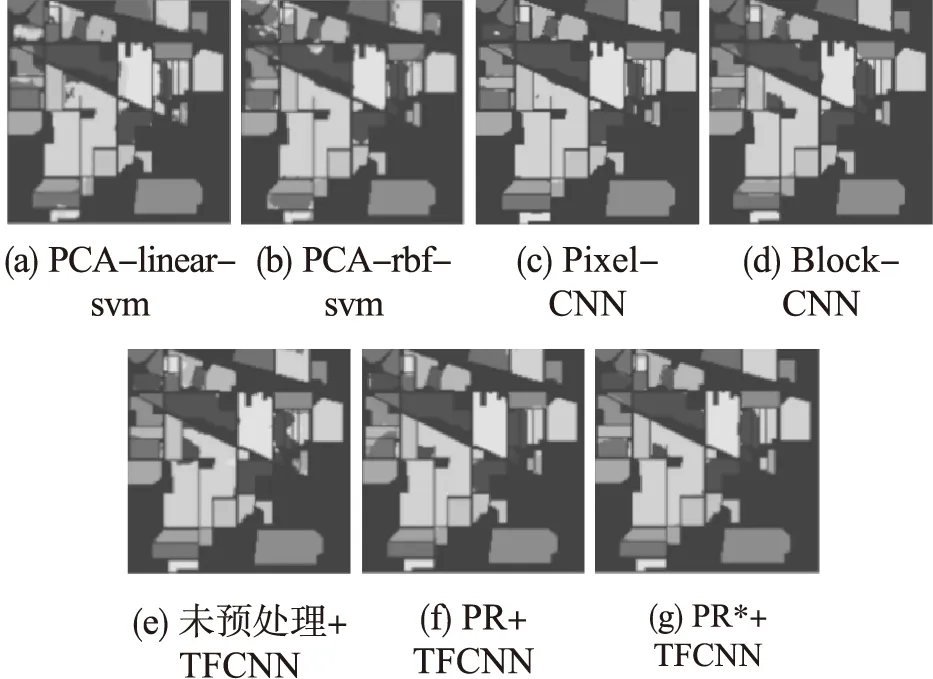

如图5所示,基于PR*相比PR优化后的图像在Pixel-CNN模型上的分类结果具有显著的提升(设置了迭代30次以内损失不再下降则停止迭代).因为原始PR算法优化图片后边缘呈锯齿状,使得边界两边出现交叉重叠,容易在分类时错分边界附近的像素点,所以如图6(b)所示,使用Pixel-CNN模型进行分类时大多数分类错误均发生在边界,而PR*优化后的图像如图6(c)所示,边缘分类结果显得更加规整.

(4)

Li[13]等人提出的保边松弛(PR)算法对高光谱图像进行平滑去噪的时候同时考虑了一定邻域的关系,因此也起到了保留边缘的作用,优化公式如下所示:

图3 卷积神经网络模型.Fig.3 CNN models(a)Pixel-CNN.(b)Block-CNN

目前已有人将CNN运用到高光谱图像分类任务当中[23],但该作者直接根据图像的光谱信息进行分类而并未考虑空间信息,而且原始图像的每个波段或多或少存在噪声,因此分类效果并不是很理想.本文用Pixel-CNN提取特征前先对图像进行了保边去噪处理,此时的光谱维既包含光谱信息也包含了空间信息,但因为对图像去噪预处理的时候只考虑八个邻接像素,包含的的空间信息有限,所以本文接着探索像素的另一种光谱-空间特征,首先对去噪后的图像的光谱维使用PCA降维(保留主要信息的同时减少计算量),取样本像素的一定大小邻域形成的图像块作为该像素的另一种表示[15-17],因为视觉上我们单单判断一个像素点的类别是很困难的,但是取以它为中心一定邻域大小形成的图像块再来判断,那么可以根据其他一些空间结构作为辅助信息,如形状、颜色等,判断出它在图像所属类别.所以基于这个思想,本文提出了第二个CNN模型(Block-CNN).最后将提取出来的两种特征串行拼接后使用svm进行分类.

其中Xl表示高光谱图像第l个波段对应的灰度图.但本文发现根据作者提出的ε优化后的图像如图2(a)所示,去噪的同时没有很好的保护边缘,边缘出现许多锯齿,影响了逐像素分类精度,因此本文重新定义ε如下式所示:

3 实 验

3.1 数据集描述

卷积神经网络[19]是一种特殊的前馈神经网络,它是由卷积层、池化层、全连接层组成,其中卷积层模仿人类视觉皮层神经元的性质,不用感知图像所有区域,只需感知局部,通常使用例如3×3的卷积核对图像进行卷积操作,旨在利用可学习的滤波器来提取输入的局部特征,这不仅符合现实而且还能减少不必要的计算.池化层采样类型有最大池化、平均池化、总和池化等,例如最大池化常使用2×2的窗口在图像上滑动,并提取窗口内值最大的元素,它一般位于卷积层之后,它的作用主要是降低输入的空间分辨率,而不丢失主要信息(实现了图像的平移、旋转不变性),也节省了计算开销.全连接层接在网络的最后,通常理解为将前面卷积和池化层提取出来的局部特征图进行线性组合而形成全局特征,最后结合softmax进行分类,然后根据分类损失进行反向传播来更新参数,如此反复直到损失不再下降.

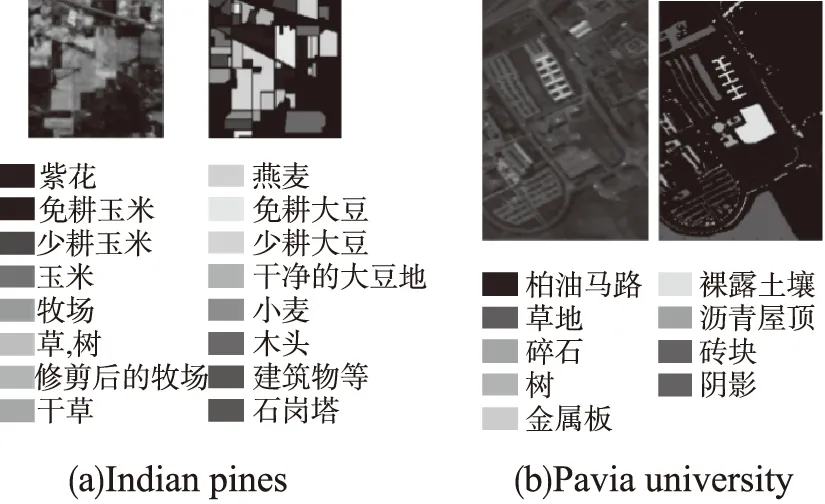

第一个数据集为Indian pines是使用机载可见光/红外成像光谱仪(AVIRIS)在美国印第安西北部采集得到的.图像具有145×145像素以及224个光谱波段,波长范围0.4~2.5μm,去除了覆盖区域水吸收的影响的24个波段,最后实验所使用的实际图像大小为145×145×200,它包含了16个地物类别.

第二个数据集Pavia University是使用反射式成像光谱仪(ROSIS)在意大利西北部的帕维亚采集而来,图像具有610×610像素以及103个光谱波段,去除图像的一些无用像素,最后实验使用的实际图像大小为610×340×103,它包含了9个地物类别.

图4 高光谱图像的伪彩色图像以及地面实况Fig.4 False color images and ground-truth maps for data sets

针对数据集样本划分,为了检验模型只根据少量样本训练出的分类能力,本文只用已标注的Indian Pines的5%,Pavia University的2%的样本进行训练,剩余作测试.

(2)薄壁空心高墩结构无论是悬臂状态还是墩顶受支撑约束状态,在日照作用下都会产生较大的温差应力,而且墩顶都会产生位移变形,尤其是悬臂状态下,墩顶位移达到1.253 4 cm,必须引起足够的重视。

3.2 本系统框架的实验结果分析

1数据集下载与类别样本数详情:http://www.ehu.eus/ccwintco/index.php?title=Hyperspectral_Remote_Sensing_Scenes

图5 使用Pixel-CNN单模型对Indian Pines数据集分类的迭代过程Fig.5 Iterative process about Pixel-CNN model being used for classifying the dataset of Indian Pines

图6 使用Pixel-CNN单模型对Indian Pines数据集分类的结果.Fig.6 Pixel-CNN model is used for classifying the dataset of Indian Pines

经Design-Expert 8.0.6软件分析优化,可得到羊肚菌SDF最佳提取工艺参数为料液比1∶20.12 (g/mL)、 碱液浓度0.75%、提取温度62.79 ℃、提取时间60 min。在此最佳工艺提取条件下,SDF理论得率为 34.62%。考虑到试验可操作性,将制备的最优条件定为料液比1∶20(g/mL)、提取液浓度0.75%、提取温度63 ℃、提取时间 60 min。在此制备条件下进行3组平行验证试验,得到羊肚菌SDF的平均值为33.06%,与模型得出的羊肚菌SDF理论值比较接近,说明数学模型对优化羊肚菌SDF的提取工艺是可行的。

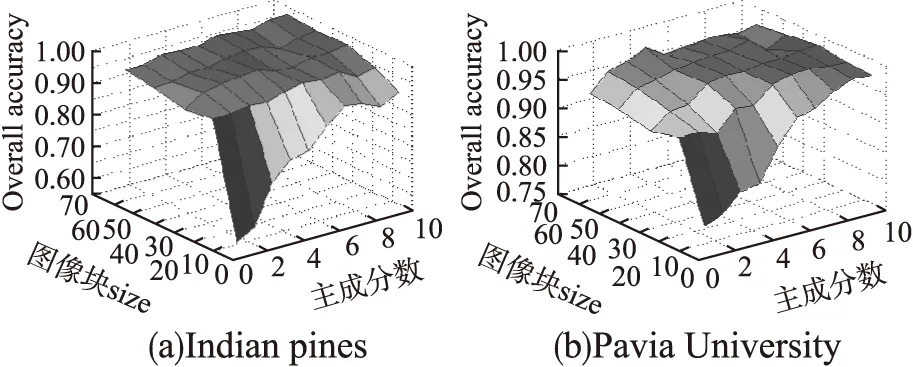

图7 不同图像大小和主成分数对Block-CNN单模型分类精度的影响Fig.7 Classification accuracy is influenced by different size of image block and principal component

影响Block-CNN模型分类准确率有两大主要参数:块大小和主成分个数.如图7所示,本文探索了不同的图像块的大小以及主成分个数对该模型分类精度的影响.最终实验对于Indian Pines数据集取的块大小为63×63,主成分数为9;Pavia University数据集取的块大小为33×33,主成分数为10.

以下实验如未特别说明的话均是基于PR*预处理后得出的结果.

图8 Indian Pines分类结果图Fig.8 Classification result of Indian Pines

图8和图9显示了不同的特征提取方法结合分类器对两个数据集的分类结果对比.其中PCA-linear-svm和PCA-rbf-svm也采用了特征拼接的方法,先用PCA对两种光谱-空间特征降维后再串联,最后分别使用线性SVM和基于高斯核的SVM进行分类(实验中支持向量机涉及的参数包括惩罚系数C和核系数g,由于Indian Pines有部分类别训练样本数少,无法实现K倍交叉验证,所以最终的参数设定是人为的尝试了一些数值后确定的,而Pavia University实验使用的参数则由10倍交叉验证得到).实验数据显示无论是本文提出的单模型Pixel-CNN或是Block-CNN均要优于传统的svm分类方法,而多特征结合后的分类效果又在单模型的基础上提升了不少.本文还同时对比了对原始图像预处理的三种不同情况(未预处理、PR预处理、PR*预处理)下的分类结果,本文提出的PR*+TFCNN分类效果要优于前两种.

5月,中国水务公司积极推动旗下上市公司钱江水利开展了非公开发行募投项目。钱江水利自2000年首发上市后,主要通过银行贷款、发行债券等债务工具筹集发展所需资金。正处于发展关键阶段的钱江水利,资本支出规模较大,依靠自有资金积累及银行贷款难以完全满足项目资金需求。而通过非公开发行,可以拓宽融资渠道,募集资金满足项目建设需要,为公司实现跨越发展提供有力保障。募投项目投产后,公司的供水规模将显著扩大,核心竞争力将迅速提升。

图9 Pavia University分类结果图Fig.9 Classification result of Pavia University

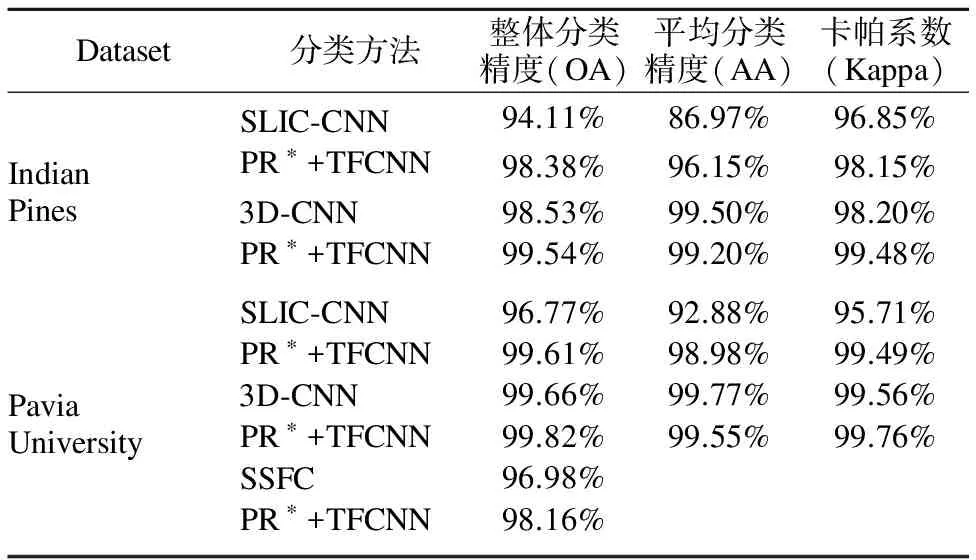

3.3 与其他分类方法对比

为了与目前深度学习在高光谱分类领域已经取得较高分类精度的算法进行对比,本文使用了与作者相关论文同数量的训练/测试样本进行实验,其中与本文做对比的算法的分类结果也均由其相关论文提供,如表1所示.

由Cao[18]等人提出的SLIC-CNN将深度学习与超像素分割相结合,使用CNN对光谱维分类得到初始概率表作为似然概率,随后的简单线性迭代聚类(SLIC)提供局部先验概率,空间邻接像素的聚类使得先验具有了空间信息,最后由贝叶斯公式得到每个像素点的最大后验概率作为最终的分类结果,然而由于超像素尺寸的原因,无法做到很好的边缘保持,这会影响到先验的大小,而且只根据光谱特征得出的初始分类精度太低,使得影响了接下来优化效果,所以可以从表5中看出等数量的训练样本的前提下,本文提出的分类方法在OA、AA、Kappa上的精度均高于SLIC-CNN许多;Chen[17]等人提出的3D-CNN保留了图像光谱高维特征,使用三维卷积提取图像块的光谱-空间特征,并且用已有的训练样本通过线性组合来创造虚拟样本,加上原有的样本一起用于训练,这在一定程度上提升了分类精度,但也只是考虑单一的光谱-空间特征,并且网络结构更加复杂增加了计算开销.而本文在模型更加简单以及未添加任何辅助训练样本的前提下在Indian Pines数据集的OA、Kappa分类精度上相比3D-CNN高出一个百分点左右, 在Pavia University的数据集上OA、Kappa也高出0.2个百分点左右;Zhao[5]等人提出的光谱-空间特征分类(SSFC)方法中并未过多的探索不同图像块大小以及成分数对结果的影响,而且由于图像噪声的存在,光谱降维后的特征分辨能力不足,所以最终实验结果看到,本文在Pavia University数据体整体分类精度上高出1个百分点左右.

我这次来山里,是想劝父亲跟我回去。两年前,我因车祸,右胳膊落下残疾,这对以绘画为生的我来说,简直是致命的打击。幸好,在最痛苦的时候,是父亲一直鼓励着我,安慰着我,我才渐渐走出伤痛,生活又恢复平静。

表1 不同分类方法的分类精度对比

Table 1 Datasets are classified in different methods

Dataset分类方法整体分类精度(OA)平均分类精度(AA)卡帕系数(Kappa)IndianPinesSLIC⁃CNNPR∗+TFCNN94.11%86.97%96.85%98.38%96.15%98.15%3D⁃CNNPR∗+TFCNN98.53%99.50%98.20%99.54%99.20%99.48%PaviaUniversitySLIC⁃CNNPR∗+TFCNN3D⁃CNNPR∗+TFCNNSSFCPR∗+TFCNN96.77%99.61%99.66%99.82%96.98%98.16%92.88%98.98%99.77%99.55%95.71%99.49%99.56%99.76%

4 小 结

针对高光谱图像的分类,本文提出了PR*+TFCNN分类方法.因为遥感数据的获取过程受诸多因素的干扰如天气、光照等影响,或多或少的存在噪声,所以预先对图像去噪处理防止影响分类结果.随后本文探索了两种不同程度上的光谱-空间特征,其中Pixel-CNN主要提取光谱信息(以光谱维作为输入),因为之前去噪考虑了像素的八邻域,所以包含了局部的空间信息;Block-CNN以图像块作为输入,主要提取空间信息,根据像素点周边更大的局部空间结构来分辨像素点所属类别,例如房屋呈现一排一排的结构、公路呈现线条状;然后将这两种不同的空间波谱特征拼接,弥补两种CNN特征都存在的部分目标辨识缺陷,提高了组合特征的鲁棒性,最后使用支持向量机对拼接后的特征进行分类.本文提出的特征提取和融合思想因为模型相对简单,参数少,避免过拟合,使之能够在少量训练样本的条件下也能取得较好的分类准确率.

[1] Melgani F,Bruzzone L.Classification of hyperspectral remote sensing images with support vector machines[J].IEEE Transactions on Geoscience and Remote Sensing,2004,42(8):1778-1790.

[2] Hughes G.On the mean accuracy of statistical pattern recognizers[J].IEEE Transactions on Information Theory,1968,14(1):55-63.

[3] Bandos T V,Bruzzone L,Camps-Valls G.Classification of hyperspectral images with regularized linear discriminant analysis[J].IEEE Transactions on Geoscience and Remote Sensing,2009,47(3):862-873.

[4] Villa A,Benediktsson J A,Chanussot J,et al.Hyperspectral image classification with independent component discriminant analysis[J].IEEE Transactions on Geoscience and Remote Sensing,2011,49(12):4865-4876.

[5] Zhao W,Du S.Spectral-spatial feature extraction for hyperspectral image classification:a dimension reduction and deep learning approach[J].IEEE Transactions on Geoscience and Remote Sensing,2016,54(8):4544-4554.

[6] Mausel P W,Kramber W J,Lee J K.Optimum band selection for supervised classification of multispectral data[J].Photogrammetric Engineering and Remote Sensing,1990,56(1):55-60.

[7] Du Pei-jun,Xia Jun-shi,Xue Chao-hui,et al.Review of hyperspectral remote sensing image classification[J].Journal of Remote Sensing,2016,20(2):236-256.

[8] Fauvel M,Tarabalka Y,Benediktsson J A,et al.Advances in spectral-spatial classification of hyperspectral images[J].Proceedings of the IEEE,2013,101(3):652-675.

[9] Benediktsson J A,Palmason J A,Sveinsson J R.Classification of hyperspectral data from urban areas based on extended morphological profiles[J].IEEE Transactions on Geoscience and Remote Sensing,2005,43(3):480-491.

[10] Li W,Du Q.Gabor-filtering-based nearest regularized subspace for hyperspectral image classification[J].IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing,2014,7(4):1012-1022.

[11] Wang Zeng-mao,Du Bo,Zhang Liang-pei,et al.Based on texture feature and extend morphological profile fusion for hyperspectral image classification[J].Acta Photonica Sinica,2014,43(8):116-123.

[12] Kang X,Li S,Benediktsson J A.Spectral-spatial hyperspectral image classification with edge-preserving filtering[J].IEEE Transactions on Geoscience and Remote Sensing,2014,52(5):2666-2677.

[13] Li J,Khodadadzadeh M,Plaza A,et al.A discontinuity preserving relaxation scheme for spectral-spatial hyperspectral image classification[J].IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing,2016,9(2):625-639.

[14] Kang X,Li S,Fang L,et al.Extended random walker-based classification of hyperspectral images[J].IEEE Transactions on Geoscience and Remote Sensing,2015,53(1):144-153.

[15] Chen Y,Lin Z,Zhao X,et al.Deep learning-based classification of hyperspectral data[J].IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing,2014,7(6):2094-2107.

[16] Lin Z,Chen Y,Zhao X,et al.Spectral-spatial classification of hyperspectral image using autoencoders[C].Proceedings of 9th International Conference on Communications and Signal Processing(ICICS),2013:1-5.

[17] Chen Y,Jiang H,Li C,et al.Deep feature extraction and classification of hyperspectral images based on convolutional neural networks[J].IEEE Transactions on Geoscience and Remote Sensing,2016,54(10):6232-6251.

[18] Cao J,Chen Z,Wang B.Deep Convolutional networks with superpixel segmentation for hyperspectral image classification[C].Proceedings of Geoscience and Remote Sensing Symposium(IGARSS),2016:3310-3313.

[19] LeCun Y,Bottou L,Bengio Y,et al.Gradient-based learning applied to document recognition[J].Proceedings of the IEEE,1998,86(11):2278-2324.

[20] Goodfellow I J,Warde-Farley D,Mirza M,et al.Maxout networks[J].Computer Science,2013,28(3):1319-1327.

[21] Krizhevsky A,Sutskever I,Hinton G E.Imagenet classification with deep convolutional neural networks[C].Advances in Neural Information Processing Systems,2012:1097-1105.

[22] He K,Zhang X,Ren S,et al.Delving deep into rectifiers:Surpassing human-level performance on imagenet classification[C].Proceedings of the IEEE International Conference on Computer Vision,2015:1026-1034.

[23] Hu W,Huang Y,Wei L,et al.Deep convolutional neural networks for hyperspectral image classification[J].Journal of Sensors,2015,2015(2):1-12.

附中文参考文献:

[7] 杜培军,夏俊士,薛朝辉,等.高光谱遥感影像分类研究进展[J].遥感学报,2016,20(2):236-256.

[11] 王增茂,杜 博,张良培,等.基于纹理特征和形态学特征融合的高光谱影像分类法[J].光子学报,2014,43(8):116-123.