夜间城市交通监控中各类车辆轨迹的完整提取

汤春明,肖文娜,董燕成,林祥清

天津工业大学电子与信息工程学院,天津300387

夜间城市交通监控中各类车辆轨迹的完整提取

汤春明,肖文娜,董燕成,林祥清

天津工业大学电子与信息工程学院,天津300387

CNKI网络出版:2017-04-19,http://kns.cnki.net/kcms/detail/11.2127.TP.20170419.1017.002.html

1 引言

城市交通监控系统对人身及道路安全日趋重要[1],越来越多的研究者致力于夜间车辆轨迹的完整提取,完成两个相邻交通监控点的车辆信息的准确传递,实现车辆监控数据(如车牌、轨迹)联网,以期为预判车辆行为和追究肇事者责任提供有力证据。夜间车辆最显著稳定的特征是车灯,要对提取出来的车灯光斑进行配对以达到识别车辆的目的。目前车灯配对主要存在三种方法:(1)几何对称法;(2)最小特征匹配代价法;(3)最大权重独立集法。其中(1)法最普通,它根据面积、圆形度、质心间距、质心连线斜率、位置和形状等几何特征进行车灯配对,如文献[2-7]。方法(2)中,如汤春明等人[8]利用最小特征匹配代价函数实现车灯配对,同时引入反馈修正机制对轨迹进行修正。(1)和(2)因未考虑监控场景中各类车辆类型,使得在车辆密集、有遮挡的情况下容易造成不止一个配对或没有相应的配对,从而导致车辆轨迹提取结果不完整,特别是在跟踪起始处,故该类算法的普适性和鲁棒性不高。方法(3)中以Zou等人[9]提出最大权重独立集的配对方法为代表,把所有前灯的两两组合情况都列出来之后,再用顶点堆积法,在帧内用两个约束条件,在帧间用速度相似性,实现合理配对,在后处理中又加入四灯一组的分析情况。该方法由于先入为主地考虑双灯车的情况而对其他情况未作考虑,致使该方法在提取特殊车辆轨迹时不够灵活。

车灯配对成功后,通过跟踪车灯实现提取车辆轨迹的目的。目前存在的车灯跟踪方法有:(1)利用卡尔曼滤波器[10-11]或者基于车灯位置、面积及形状等特征的最近邻匹配来实现车灯跟踪;(2)利用车灯面积重叠法[3]完成帧间数据关联;(3)在(1)和(2)的基础上增加空间上下文信息[9]约束车灯匹配,提高数据关联的准确性。实际上,车辆由远及近驶入摄像机监控范围,透视影响及环境光强度的不断变化,使车灯尺寸及外观变化无规律,再加上目标间相互遮挡,造成车灯很难被配对和跟踪,从而导致车辆轨迹混乱或断开。因此目前研究算法都忽略远景区域,通过划定ROI区域缩小跟踪长度。然而远景处车辆信息对于交通监控数据的联网至关重要,它是把所有监控点数据连接起来的前提。

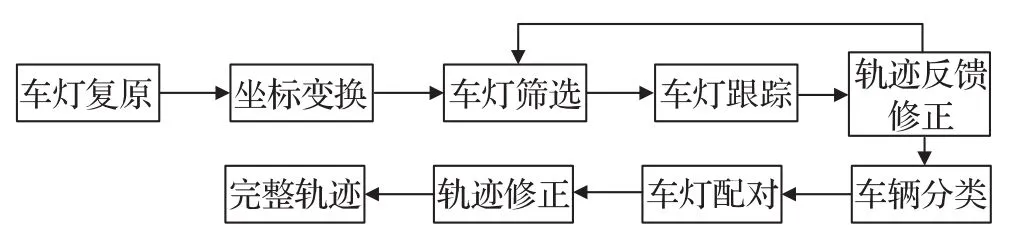

针对以上问题,本文提出一种结合车辆类型与轨迹反馈修正的跟踪系统,以实现相邻两个监控点间的车辆轨迹的完整提取,包括车灯提取、车灯筛选、轨迹反馈修正、车灯配对及车辆跟踪5个模块,如图1所示。提取车灯后用面积重叠法完成车灯匹配,再用稳定性判断筛选车灯,获得车灯初始轨迹后加入轨迹反馈修正误匹配;接着按照车型配对车灯;最后对车辆跟踪再次应用轨迹修正。

图1 系统框图

2 车灯提取

2.1 车灯复原

首先用先前提出的大气反射-散射模型[12]复原车灯光斑。该模型在有效抑制交通场景中各种环境光的同时,能准确检测远、中和近景处车灯,这是完整提取车辆轨迹的基础。

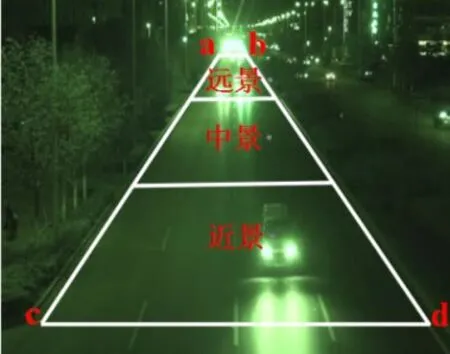

2.2 坐标变换

通过建立图像坐标系与路面坐标系之间的变换关系,能够计算出车灯在实际路面坐标系中的位置,进而可以计算出车辆的真实宽度、位移和速度等稳定特征,以便减小透视及光干扰对车灯配对的影响。常用的单视图测量方法是通过图像平面Γ1与空间场景平面Γ2之间的单应性矩阵[13]实现对目标的真实几何量的测量,其中单应性矩阵H:3×3。Γ2中任一点Mi(Xi,Yi,1),和其在Γ1中对应的点mi(xi,yi,1),满足式(1)、(2):

消去λ得到关于hij的两个线性方程,如式(3):

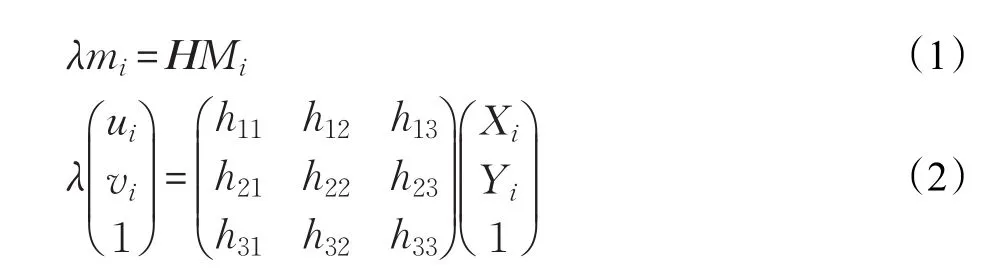

在采集视频过程中,为了避免摄像机的抖动带来误差,将摄像机固定架设于天桥上并保证拍摄角度与水平方向呈30°。如图2所示,以世界坐标系中的路面Γ2为参考平面,取图像平面Γ1中机动车道的两条边界线上的a、b、c、d共4个端点的坐标以及Γ2中相应的4个点坐标作为基准点,其中线段ab是上一个红绿灯处的禁行线,线段cd是当前红绿灯的禁行线,这4条线段所围区域内的所有驶过车辆是要跟踪的目标。把4对点坐标代入式(3)可求出H,通过H可求出图像中任一像素点对应的路面坐标。

图2 视频场景

2.3 车灯筛选

车灯复原结果还需要进一步筛选,以删除噪声。透视使车灯及噪声由远及近逐渐增大,通过分析图像中目标的几何特征、颜色及亮度[14],如图2所示,将视频场景分远、中、近3部分区域进行筛选。

针对各部分存在的典型噪声,采用对应的车灯筛选方法,具体过程如下:

(1)远景:先用面积法删除大、小噪声,再用改进的分水岭算法[15]分割粘连前灯对。

(2)中景:先用面积法删除小噪声,再用改进的分水岭算法[15]分割粘连的车灯与车身反射区,最后用长宽比删除狭长地面反射区。

(3)近景:先用面积法删除小噪声,再用RGB变异度[16]法删除近似车灯的地面反射区。

每帧车灯光斑的面积、长宽比及RGB变异度[16]特征的最佳筛选阈值是用迭代法求出。通过分区域筛选,全部车灯被保留,但仍有少量存在了一段时长的高亮噪声,需利用帧间信息进一步删除。

3 车灯跟踪与配对

3.1 车灯跟踪

由运动目标的空间连续性可知,相邻两帧目标特征最为相似。视频的帧间隔为0.04 s,在相邻两帧中同一车灯光斑会有部分重叠,以此特性关联前后帧每个车灯的ID号,得到车灯的初始轨迹。由于光斑匹配过程中存在粘连、遮挡等干扰,导致出现目标轨迹混乱或断开的情况,需要利用平均速度修正误匹配(为了减小数据误差,把稳定跟踪连续5帧的车灯速度均值作为它在某一帧的瞬时速度,把整个跟踪过程的车灯速度均值作为它的平均速度)。轨迹反馈修正具体流程如图3所示。

图3 轨迹反馈修正流程

(1)验证数据关联正确性

利用双向位置验证[4]来保证前后帧对应车灯数据关联正确。如对第m帧中某ID车灯依次向前、向后找t(t≤10)帧,利用式(4)计算车辆瞬时速度。拍摄城市交通场景的道路限速为80 km/h,当V=80 km/h,t=10帧,由式(4)推出相邻10帧的车灯质心距离d=即若质心间距满足≤10 m,即城市内以最大时速80 km/h行驶,在相邻10帧内,行驶距离不会超过10 m。以此条件判断是否成功匹配。

(2)拟合不完整轨迹

当车速很快或有长时间遮挡时,如果仅用面积重叠法易造成数据关联失败,导致目标轨迹不完整,最终丢失目标。因此在面积重叠法基础上,再利用轨迹空间位置和运动相似度来拟合缺失的轨迹。

如图4所示,ab、cd分别是利用面积重叠法得到的两条轨迹。如果坐标(xb,yb)、(xc,yc)满足横、纵坐标之差都小于5个像素距离,则ab、cd应该是同一目标的两段轨迹,把两个ID号改成一个;然后统计轨迹中连续为零的帧数,若小于10帧则认为是由漏匹配造成,再根据平均速度的相似性完成不连续轨迹的拟合,如图4中虚线段bc。

图4 拟合不完整轨迹

(3)判断非车灯轨迹

车灯稳定光斑在跟踪过程中具有运动连续性和形态稳定性,路面和车身反射区域视为非稳定光斑,它们容易引起车灯错误配对。根据稳定性判断筛选车灯,即先计算每条轨迹li持续的时间T(li),若未达到设定阈值即不满足式(5),则认为是非车灯轨迹,则不进行配对处理。

3.2 融合时空特征配对车灯

车灯提取之后,基于时空特征相似度实现车灯配对。交通场景中存在的各类车辆是导致车灯错误配对和轨迹混乱的主要原因。

为了提取长轨迹,根据网上公布的各类车型的车宽把车辆分为普通车、小车、中车及大车4种类型,其中普通车是指常见的轿车类型;按照车灯数目分为独灯车、双灯车及多灯车,然后跟据车辆类别分别进行处理。首先选取车灯对的连线斜率θ、质心欧式距离d、速度差Δv以及车宽w作为配对特征,完成普通车的车灯配对;若剩余的未配对车灯满足轨迹长度大于远、中和近景区域路面长度的2/3,则按照车宽及车灯数目进行特殊车辆的分类处理。然后对提取的车辆轨迹再次应用轨迹修正法。处理流程如图5所示。

图5 车辆定位跟踪流程

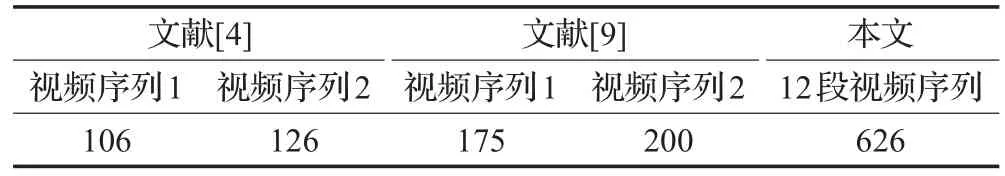

表1 车灯跟踪结果对比

分类处理交通场景中的各类车辆使得车灯在整个场景中能够正确配对,避免了在车辆密集、有遮挡的情况下容易造成不止一个配对或没有相应的配对的情况,保证完整提取车辆的长轨迹。同时,保留了独灯车的运动轨迹并保证了一车一轨迹。

4 测试结果

共测试了12段视频,分别有3 000、1 240、1 325、1 479、415、716、840、454、512、856、933、617帧。视频中包含了城市交通中常见的各类车型,在轻薄雾霾天气下,用索尼HDR-550d摄像机在夜模式下拍摄,帧率为25 f/s。

4.1 跟踪结果统计

表1是本文的跟踪方法与文献[3,9]的准确率对比。本文方法的车灯匹配率最高为98.01%,比文献[3]高出11.33%,比文献[9]的最高匹配率94.8%高出3.21%。特别如图6在车辆变道情况下,该方法表现出健壮的数据关联性。图中红线用于标注远景处红绿灯路口,数字表示车灯ID,用不同颜色表示不同车灯的轨迹。

图6 变道车辆的跟踪

4.2 车辆长轨迹提取结果

按照车宽,处理了含普通车、小轿车、货车及公交车的视频序列;按照车灯数目,处理了含摩托车、双前灯中一灯出现故障车、双前灯功率不同车、四前灯车的视频序列。图7是视频中跟踪车辆400帧的结果,左图中数字表示车灯ID,右图中如V(2)=51 km/h表示ID为2的车辆时速为51 km。

图7 车辆跟踪结果

表2 普通车辆跟踪帧数对比

图8 车辆跟踪结果对比

4.2.1 普通车长轨迹提取结果

对于普通车辆,如图8(a)、(b)是文献[4]中最后提取出的轨迹,红框标注的远景区域内存在严重的多车灯误配情况,图8(c)、(d)是文献[9]中最后提取出的轨迹。表2是针对图8中车辆跟踪帧数的对比。文献[4,9]的跟踪帧数最多为126帧、200帧;本文的方法跟踪帧数最多可达到626帧。由于现存算法中文献[9]的夜间车辆跟踪准确率最高,所以仅与它进行了对比:本文的方法在12段视频中的平均准确率为97.3%,比文献[9]的车辆平均跟踪准确率87.3%高出了10%。由对比结果可知,相比现存方法,车辆分类处理使本文的算法表现出更良好的跟踪性能。

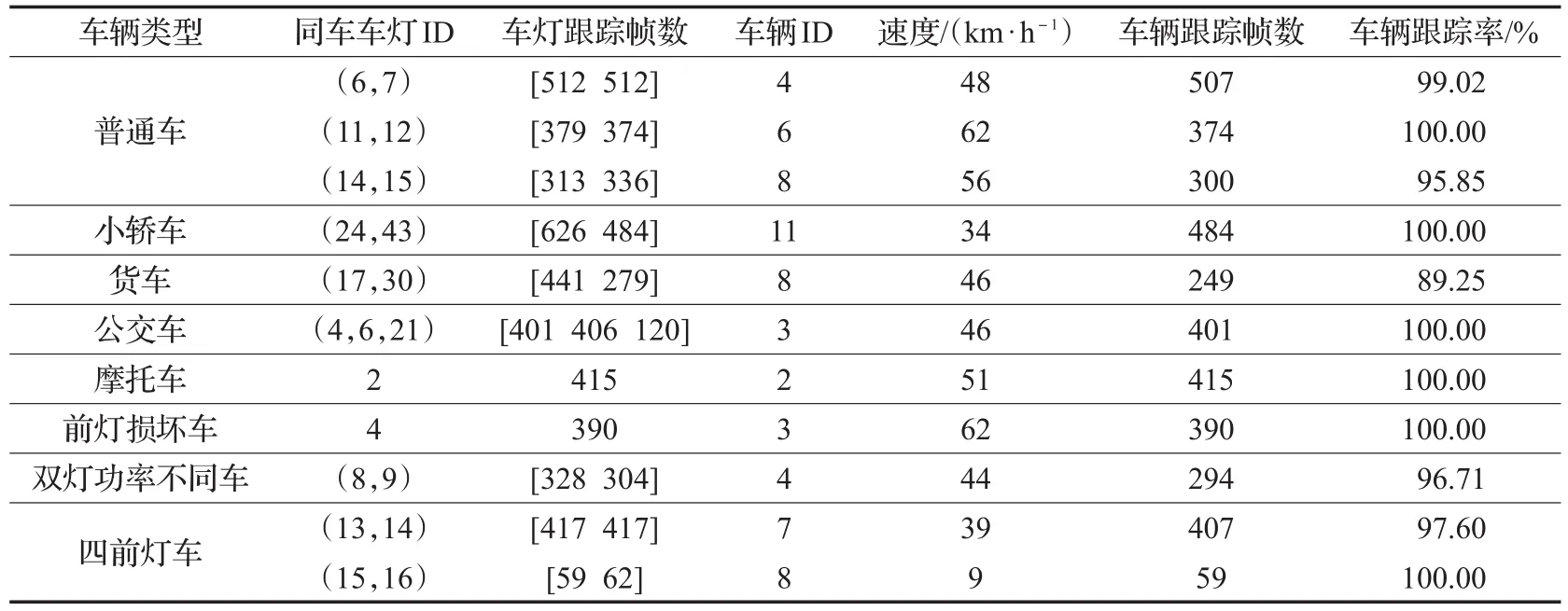

4.2.2 特殊车辆长轨迹提取结果

完成对普通车辆的处理后,按照类别要提取特殊车辆的长轨迹,表3是对特殊车辆跟踪的数据统计结果。其中,小轿车两灯跟踪帧数相差142帧,货车跟踪率仅为89.25%的主要原因是:红绿灯路口长时间停车导致大量车灯光斑与噪声相互粘连,从中极难分割出单个车灯光斑。

表3 特殊车辆跟踪数据统计

5 结束语

根据大气反射-散射模型复原车灯光斑,在远、中、近景三部分采用不同的方法筛选车灯,然后用面积重叠法完成数据关联,获得车灯初始轨迹,再加入轨迹反馈修正误匹配,按车型配对车灯;最后对车辆跟踪结果再次应用轨迹修正。验证结果表明,该法能够实现对夜间城市交通监控中各类车辆完整轨迹的准确提取。本文车灯错误匹配率比文献[3]降低11.33%,比文献[9]降低3.21%,车辆跟踪准确率比文献[9]高出10%。

[1] Kuang Huilin,Chen Long,Gu Feng,et al.Combining region-of-interest extraction and image enhancement for nighttime vehicle detection[J].Intelligent Systems IEEE,2016,31(3).

[2] Hajimolahoseini H,Amirfattahi R,Soltanian-Zadeh H.Robust vehicle tracking algorithm for nighttime videos captured by fixed cameras in highly reflective environments[J].Iet Computer Vision,2014,8(6):535-544.

[3] Chen Yenlin,Wu Bingfei,Huang Haoyu,et al.A real-time vision system for nighttime vehicle detection and traffic surveillance[J].IEEE Transactions on Industrial Electronics,2011,58(5):2030-2044.

[4] Zhang Wei,Wang Guanghui,You Xinge,et al.Tracking and pairing vehicle headlight in night scenes[J].IEEE Transactions on Intelligent Transportation Systems,2012,13(1):140-153.

[5] Tang Chunming,Hussain A.Robust vehicle surveillance in night traffic videos using an azimuthally blur technique[J].IEEE Transactions on Vehicular Technology,2015,64(10):4432-4440.

[6] Cheng H Y,Hsu S H.Intelligent highway traffic surveillance with self-diagnosis abilities[J].IEEE Transactions on Intelligent Transportation Systems,2011,12(4):1462-1472.

[7] Salvi G.An automated nighttime vehicle counting and detection system for traffic surveillance[C]//International Conference on Computational Science and Computational Intelligence,Las Vegas,NV,2014:131-136.

[8] 汤春明,聂美玲,丁腾飞,等.基于最小特征匹配代价的夜间车辆检测和追踪[J].计算机应用与软件,2015,32(4):292-296.

[9] Zou Qi,Ling Haibin,Luo Siwei,et al.Robust nighttime vehicle detection by tracking and grouping headlights[J].IEEE Transactions on Intelligent Transportation Systems,2015,16(5):2838-2849.

[10] O’malley R,Jones E,Glavin M.Rear-lamp vehicle detection and tracking in low-exposure color video for night conditions[J].IEEE Transactions on Intelligent Transportation Systems,2010,11(2):453-462.

[11] Tian B,Li Y,Li B,et al.Rear-view vehicle detection and tracking by combining multiple parts for complex urbansurveillance[J].IEEETransactionsonIntelligent Transportation Systems,2014,15(2):597-606.

[12] 汤春明,曹志升,林祥清,等.基于大气反射-散射模型的复原图像中交通视频车灯检测[J].自动化学报,2016,42(4):605-616.

[13] Hartley R,Zisserman A.Multiple view geometry in computer vision[M].2nd ed.UK:Cambridge University Press,2004:32-36.

[14] Zhu Qingsong,Mai Jiaming,Shao Ling.A fast single image haze removal algorithm using color attenuation prior[J].IEEE Transactions on Image Processing,2015,11(24):3522-3532.

[15] 胡珂立,谷宇章,王营冠,等.基于分水岭分割和尺度不变特征点的多目标全自主跟踪算法[J].电子与信息学报,2012,34(8):1827-1832.

[16] 马永明,李鹏飞,王彬.一种新的夜间交通流量检测方法[J].西北师范大学学报:自然科学版,2015,51(3):43-49.

TANG Chunming,XIAO Wenna,DONG Yancheng,et al.Complete extraction of trajectories of different vehicles in nighttime city traffic surveillance.Computer Engineering andApplications,2018,54(6):205-209.

TANG Chunming,XIAO Wenna,DONG Yancheng,LIN Xiangqing

School of Electronical and Information Engineering,Tianjin Polytechnic University,Tianjin 300387,China

The presented tracking system combines the vehicle’s type and trajectory feedback correction in order to obtain the complete trajectory in nighttime traffic surveillance.After filtering the restored headlight blobs in the distant,middle and close regions separately,the initial trajectories of headlights are obtained by area overlapping and trajectory feedback is then used for correction mismatching.Vehicles are classified according to the actual vehicle’s width which is calculated by homography matrix.Based on the temporal and spatial similarity,headlights are paired.The obtained trajectories of vehicles are finally corrected and optimized.The complete extraction of vehicles’trajectories between the two adjacent monitoring points are achieved.Compared with the other similar algorithms,the number of frames that vehicles are tracked is increased by 500 frames,headlight matching rate is increased by 11.33%and vehicle tracking rate is increased by 10%.

complete trajectory extraction;vehicles classification;feedback correction

针对夜间城市交通视频中各类车辆轨迹的完整提取,提出结合车辆类型与轨迹反馈修正的跟踪系统。在视频远中近区域筛选复原车灯光斑后,用面积重叠法获得车灯初始轨迹,再应用反馈纠正误匹配;通过单应性矩阵推算实际车宽,并依此给车辆分类后,按照时空相似度完成车灯配对;最后修正、优化车辆跟踪结果,实现相邻两个监控点间车辆轨迹的完整提取。与同类算法相比,车辆跟踪帧数增加了500帧,车灯匹配率提高了11.33%,车辆跟踪率提高了10%。

轨迹完整提取;车辆分类;反馈修正

2016-09-27

2017-01-20

1002-8331(2018)06-0205-05

A

TP391.41

10.3778/j.issn.1002-8331.1609-0384

天津市第三批千人计划项目(No.62014511);天津工业大学引进教师科研启动项目(No.030367)。

汤春明(1971—),女,博士,教授,研究领域为图像处理与模式识别,视频中目标识别与追踪;肖文娜(1990—),女,硕士研究生,研究领域为图像处理与模式识别,视频中目标识别与追踪,E-mail:937884976@qq.com;董燕成(1992—),男,硕士研究生,研究领域为图像处理,目标识别与追踪;林祥清(1990—),男,硕士研究生,研究领域为目标识别与追踪。

◎工程与应用◎