基于迟滞ELM模型的短期风速预测

余 敖,陈 亮,彭敬涛

(东华大学 信息科学与技术学院,上海 201620)

基于迟滞ELM模型的短期风速预测

余 敖,陈 亮,彭敬涛

(东华大学 信息科学与技术学院,上海 201620)

为了应对能源危机,许多国家开始大力发展最有发展前景之一的风能,而风速预测是进行风电场出力预测的前提条件。目前常用的风速预测方法没有得到很高的预测精度以及预测时间。为了改善风速时间序列的预测精度和预测时间,提出了一种基于迟滞极速学习机(Extreme Learning Machine)模型的风速预测方法。ELM算法是一种新型神经网络,计算效率高,性能优越,能避免局部最小化。通过改变神经元激励函数的方式将迟滞特性引入神经网络中,以增强历史输入对当前响应的影响,从而提高有用信息的利用率,提高风速时间序列的预测性能。仿真结果表明,与ELM模型等方法相比,迟滞ELM模型能够有效减小风速时间序列的预测误差,提高了预测精度以及减少了预测时间。

极速学习机;迟滞;风速预测;机器学习

1 概 述

随着世界经济的快速发展和人口的快速增长,世界各国对能源的需求量也日益增大,而传统的不可再生能源将逐渐枯竭,这可能导致全球能源危机。为了应对能源危机,世界各国对风能源产生了浓厚的兴趣。风能是一种清洁的可再生能源,风能利用的主要形式是风力发电,也是目前可再生能源中技术最成熟、最具规模化开发条件和商业化发展前景的发电方式之一[1]。

风速的随机性很强,而这种随机性给电力系统带来很大的冲击,对电能质量、系统稳定性、电力调度等有较大的影响。对风力发电的出力进行预测可以在很大程度上降低风力发电的缺点对电网带来的不利影响,而风速预测是进行风电场出力预测的前提条件[2]。

风速时间序列的预测研究在风电并网、气象监测等许多领域具有广泛的应用前景,是当前研究的热点问题之一[3]。目前,常用的风速时间序列预测分析方法有神经网络法、持续法、时间序列法、模糊逻辑法、卡尔曼滤波法、混沌时间序列预测分析法等[4-8]。这些预测方法运用不同的理论对风速序列展开预测研究,从不同的角度对风速序列的预测性能起到改善作用,同时也证实了风速序列预测的可行性。在这些方法中,由于本身的自适应学习能力和灵活性,神经网络已经越来越多地应用于风速预测[9]。神经网络方法在黑箱系统建模方面拥有很大的优势,因此在时间序列预测分析中具有良好的预测性能。

极速学习机(Extreme Learning Machine,ELM)是一种新型的单隐层前馈神经网络,ELM算法提供了一个结合支持向量机(SVM)、径向基函数(RBF)以及标准的前馈神经网络优势的统一学习平台。在计算方面,ELM算法克服了昂贵的学习代价,比如反向传播[10]。因为这些优势,ELM算法或者基于ELM的改进算法广泛应用于时间序列预测方面。Ronay A K等[11]利用ELM算法和最近邻算法进行短期风速预测。王智慧[12]利用移动加权ELM算法进行股票预测以及带有遗忘机制的在线序列ELM算法进行股票预测。李彬等[13]利用ELM算法进行混沌时间序列预测等。和传统的学习算法相比,ELM算法不需要同时训练隐含层的参数以及输出权值,只是随机给定隐含层参数,因此节省了大量的计算时间。由于ELM的快速学习和不严格遵守优化原则,使得ELM的随机分配更像生物神经网络的学习机制。同时,ELM算法的训练过程是一个能够直接得到输出矩阵的广义逆的线性的最小二乘法计算过程。

正是因为以上不同点,使得ELM算法的计算复杂度远低于传统算法。

但是,随机给定隐含层的参数,或多或少降低ELM算法的学习性能。除此之外,对隐含层节点的数量,并没有准确估计的方法,这是值得研究的一个点。在实际应用中,可以由交叉验证,但由于技术花费代价大,导致不能在线使用。

ELM神经网络的记忆能力和泛化性能主要取决于网络的连接权值,ELM神经网络根据当前输入得到未来的输出,而对于训练数据中所蕴含的历史变化趋势等信息利用不够充分,而在生物神经网络中普遍存在迟滞特性,这些迟滞特性可以提高神经元对历史变化信息的利用率[14],从而改善ELM神经网络的性能。

使用迟滞激励函数的神经元的输出不仅取决于它的输入,还取决于输入的导数信息。最重要的是它为神经元提供记忆的信息。除此之外,当输入卡住在传统的Sigmoid激励函数的饱和区域,迟滞函数可以在两个迟滞Sigmoid激励函数之间进行自由切换,从而避免神经元陷入局部最小值以及使得整个神经网络获得更快的学习速度。

因此,提出了一种基于迟滞ELM模型的算法来预测短期风速序列。利用迟滞ELM神经网络进行短期风速预测,不仅可以使用当前数据信息,而且还可以使用历史数据信息,因此大大地提高了风速预测的性能。

2 ELM算法

ELM算法是新加坡南阳理工大学的Huang教授等在2004年提出的一种神经网络模型[10,15]。前馈神经网络通常用于解决回归问题和分类问题[16]。接下来,从回归的角度来介绍其数学模型。

(1)

其中,ωi=[ωi1,ωi2,…,ωin]T为第i个隐含层节点的输入权值;αi∈R为第i个隐含层节点的阈值;βi∈Rm为第i个隐含层节点的输出权值;ωi·xj为ωi和xj的内积;激励函数g(x)通常选取Sigmoid函数。

式(1)的简洁表达式如下:

Hβ=Y

(2)

其中

其中,H为隐含层输出矩阵。

选取均方值误差E(W)作为评价标准。在SLFN模型中,问题是找到最优参数ω,α,β使得目标函数E(W)最小。具体的数学表达式如下所示:

(3)

(4)

其中,εj=[εj1,εj2,…,εjm]为第j个误差。

Huang[17]已经证明:如果(ω,α)是随机选定,那么隐含层输出矩阵H也会确定。然后,式(3)的问题是一个标准的最小二乘法问题,其解决方案如下:

β*=H+Y

(5)

其中,H+是H的Moore-Penrose广义逆。

Huang[17]把这种算法称为ELM。

ELM算法表现出一些不同于传统学习模式(比如误差反向传播算法)的地方:

(1)传统的训练过程是一个复杂的非线性优化问题,然而ELM算法的训练过程是一个能够直接得到输出矩阵的广义逆的线性的最小二乘法计算过程。

(2)不像传统的学习算法需要同时训练隐含层的参数(ω,α)以及输出权值β,ELM算法只是随机给定隐含层参数,因此节省了大量的计算时间。

这种随机分配也更像生物神经网络的学习机制。正是这些不同点使得ELM算法的计算复杂度远低于传统算法。

由于ELM的快速学习和不严格遵守优化原则,使得ELM的随机分配更像生物神经网络的学习机制。但是,在这样重要复杂的推导中,特别是随机给定隐含层的参数,或多或少降低了ELM算法的学习性能。除此之外,对隐含层节点的数量,也没有准确估计的方法,只是手动尝试。在实际应用程序中,可以由交叉验证,但技术花费代价大,不能在线使用。

3 迟滞ELM模型

3.1 迟滞函数

迟滞在自然界中是随处可见的一种非线性现象。滞后的定义是一个滞后效应由于力量作用于自身的变化。许多工程系统具有迟滞现象,例如机械结构和铁磁材料。滞后型非线性的识别也已经研究了很多年[18]。迟滞特性分为离散迟滞和连续迟滞。对于离散迟滞神经元模型来说:

(1)如果一个神经元的输入低于某个阈值(低于跳变点),神经元的输出是零。

(2)如果一个神经元的输入超过一个阈值(高于跳变点),就会使得神经元的输出为一个定值。

(3)如果一个神经元的输入在这两个阈值之间,神经元的输出等于它的前一个值。

图1(a)展示了离散迟滞。因为输出只有两种状态,也叫二进制离散迟滞。离散迟滞应用在Hopfield神经网络中比较多,可以求解组合优化的问题(如N皇后问题[19]、旅行商问题[20]以及交叉开关分组交换问题[21]等等),同时离散迟滞也会引起系统的同步[22]。目前已有研究,并且已应用于图像着色的问题[23]。

对于连续迟滞神经元模型来说:

(1)如果一个神经元的输入低于某个阈值(低于跳变点),神经元的输出是零。

(2)如果一个神经元的输入超过一个阈值(高于跳变点),就会使得神经元的输出为一个定值。

(3)如果一个神经元的输入在这两个阈值之间,神经元的输出通过激励函数的计算公式得到。

图1(b)展示了连续迟滞。连续迟滞和离散迟滞相比,就是第三种情况不太一样。连续迟滞用在Hopfield神经网络上也很广泛。Bharitkar等[24]在2000年提出了连续迟滞Hopfield神经网络。该神经网络的激励函数由两个加了迟滞参数的Sigmoid函数组成(见图1(b))。与普通的Sigmoid激励函数相比,神经元的输出不仅依赖于输入,而且也依赖于其输入的导数。最重要的是它为神经元提供记忆的信息。除此之外,在神经网络的训练中,迟滞特性还可以抑制故障饱和现象。连续迟滞Hopfield神经网络也已经应用于解决N皇后问题[24-25]、时分多址广播调度问题[26]、风速预测问题[27]、控制与优化问题[28]等等。

图1 迟滞函数

从上述内容可以看到,迟滞主要是从Hopfield神经网络以及典型的动力系统中引入的。

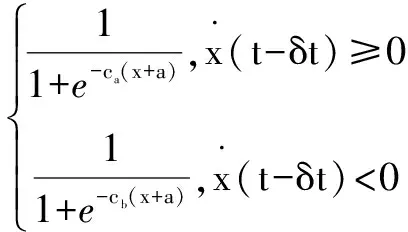

由于短期风速预测适合连续的迟滞函数,所以只介绍连续的迟滞函数。迟滞神经元的激励函数数学描述如下所示:

(6)

(7)

其中,x(t)为神经元的输入。

激励函数由两个加了迟滞参数的Sigmoid函数组成,a和b是最主要的参数,ca和cb都是正斜率参数。当a=b=0和ca=cb=1时,该迟滞Sigmoid激励函数就变成了普通的Sigmoid激励函数。由图1(b)可以看到,这种神经元的输出不仅取决于它的输入,还取决于输入的导数信息。最重要的是它为神经元提供记忆的信息。除此之外,当输入卡住在传统的Sigmoid激励函数的饱和区域时,迟滞函数可以从两个迟滞Sigmoid激励函数之间切换,从而避免神经元陷入局部最小值以及使得整个神经网络获得更快的学习速度。此外,要注意到迟滞神经元的激励函数有四个迟滞参数,即a,b,ca,cb。所以与普通的神经元相比,迟滞神经元提供了更大的灵活性。

3.2 迟滞ELM神经网络模型

提出了一种改进的迟滞ELM神经网络模型,通过采用迟滞激励函数来提高泛化能力和联想记忆功能,在某种程度上考虑到准确率和效率,随机给定隐含层节点的参数。

xaj=[xaj1,xaj2,…,xajn]T,xbj=[xbj1,xbj2,…,xbjn]T

yaj=[yaj1,yaj2,…,yajn]T,ybj=[ybj1,ybj2,…,ybjn]T

具体处理方法参考3.4节。

首先,随机给定迟滞参数a,b,ca,cb。对于xaj=[xaj1,xaj2,…,xajn]T,yaj=[yaj1,yaj2,…,yajn]T来说,一个具有N个隐含层节点的单隐层前馈神经网络模型(SLFN)的具体描述如下:

(8)

其中,ωi=[ωi1,ωi2,…,ωin]T为第i个隐含层节点的输入连接权值;αi∈R为第i个隐含层节点的阈值;βi∈Rm为第i个隐含层节点的输出权值;ωi·xaj为ωi和xaj的内积;激励函数g(x)选取带有迟滞特性的Sigmoid函数。

式(4)简化为:

Hαβα=Yα

(9)

其中

H=

其中,Hα为隐含层输出矩阵。

(10)

(11)

其中,εj=[εj1,εj2,…,εjm]为第j个误差。

然后,式(9)的问题是一个标准的最小二乘法问题,其解决方案如下所示:

β*=H+Y

(12)

其中,H+是H的Moore-Penrose广义逆。

根据该公式可以得到βα,同理得到βb。

最后,将βα和βb相加得到β。

β=βα+βb

(13)

3.3 迟滞参数调整

迟滞神经元的激活函数有四个相关联的迟滞参数,即a,b,ca,cb,这些参数为神经网络提供了一个高度的灵活性。使用梯度下降法来优化迟滞参数。对于第i个样本来说,当第i个隐含层神经元处在上升分支的激励响应时,迟滞参数的人工智能训练如下:

(14)

(15)

其中,t为第i次迭代;η为学习速率;E(W)和ε(j)同式(10)和式(11)。

对于第i个隐含层节点神经元有:

neti=ωi·xj+αi

(16)

同样地,当第i个隐含层神经元处在下降分支的激励响应时,迟滞参数的人工智能训练如下:

(17)

(18)

(19)

(20)

迟滞网络参数的优化训练提高了神经网络适应历史输入信息的能力,使网络可以充分利用训练样本中包含的有用信息,并能有效地改善泛化能力和联想记忆能力。此外,有别于传统的Sigmoid激励函数,在输入饱和区域卡住,迟滞函数可以从两个迟滞Sigmoid激励函数之间切换,从而避免神经元陷入局部最小值以及使得整个神经网络获得更快的学习速度。

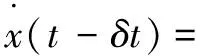

3.4 迟滞ELM算法的实现

与传统ELM神经网络相比,迟滞ELM网络的每个神经元的激励函数都具有迟滞参数。为了使网络具有良好的泛化性能,迟滞神经网络在训练过程中除了要进行权值的训练,还要对迟滞参数进行训练,这增加了神经网络训练的复杂性。

为此,提出一种网络参数的混合训练方法,即先采用最小二乘法训练ELM神经网络的连接权值,后采用梯度下降法获取最优的迟滞参数。整体思路:先确定输出权值,再确定迟滞参数,再训练好的参数进行短期风速预测。

令xaj1=xj1,xbj1=0,yaj1=yj1,ybj1=0,然后再将xj2与xj1进行对比,如果xj2大于或者等于xj1,那么令xaj2=xj2,xbj2=0,yaj2=yj2,ybj2=0。否则令xaj2=0,xbj2=xj2,yaj2=0,ybj2=yj2,一直循环到最后一个xjn,如果xjn大于或者等于xj(n-1),那么令xajn=xjn,xbjn=0,yajn=yj2,ybjn=0,否则令xajn=0,xbjn=xjn,yajn=0,ybjn=yjn。

整个迟滞ELM算法的具体实施步骤如图2所示。

图2 实施步骤

4 短期风速预测应用

风速时间序列具有很强的波动性和随机性,传统的神经网络由于神经元响应机制单一,很难适应风速的剧烈波动,因此预测结果并不理想。采用上述迟滞ELM神经网络开展风速时间序列预测分析,与ELM模型的预测结果进行对比。

采取加拿大的ACADIA VALLEY地区的每小时的平均风速数据,时间跨度是从2015年1到7月的风速数据,利用1至6月的数据来预测7月风速数据,总共650组样本数据。所有实验都是在同一台标准PC上,该PC使用的是2.60-GHz Intel Pentium(R) Dual-Core CPU 和2 G的运行内存,MATLAB版本是R2013a。迟滞ELM网络采用3层结构,输入层神经元数量m=6,隐含层神经元数量分别为5,10,20,50,100(在经过预测结果对比之后采用10个神经元),输出层神经元数量为1。在实验过程中,分别从隐含层节点数和训练样本数进行实验,评价标准是均方误差、最大误差、平均误差、训练时间、测试时间,其中均方误差最重要。

实验结果如下:

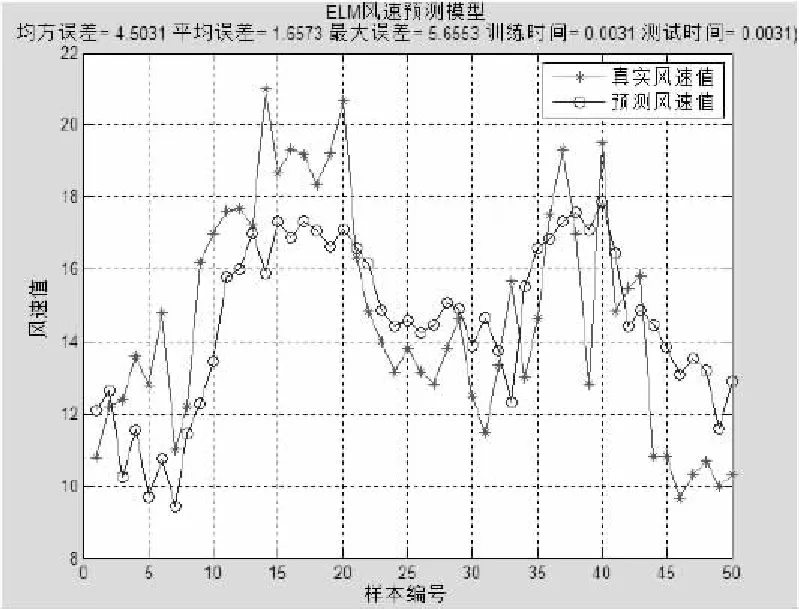

(1)用第1组至第600组数据作为训练样本,第601组至第650组作为测试样本,求取50次的平均值作为计算结果,根据手动实验对比,发现隐含层节数点为10时,实验结果较好。隐含层节点数为10时的实验结果如图3和图4所示。

图3 ELM

图4 迟滞ELM

通过对表1中的数据进行对比分析,可以得到:对于迟滞ELM算法来说,均方误差、平均误差和最大误差均要比ELM算法好。它的训练时间和测试时间要比ELM算法稍微长点,是因为在训练阶段引入梯度下降法来优化迟滞函数的参数和在测试阶段随机给定隐含层神经元连接参数。无论如何,迟滞ELM所耗费的时间是可以承受的,均方误差和泛化能力却得到显著提高。

表1 不同算法的性能比较

(2)用第1组至第300组数据作为训练样本,第601组至第650组作为测试样本,求取50次的平均值作为计算结果作为比较的第一组;用第300组至第600组数据作为训练样本,第601组至第650组作为测试样本,求取5次的平均值作为计算结果作为比较的第二组;两组对比实验结果如表2所示。

表2 不同算法以及不同样本数据的比较

通过对表2中的数据进行对比分析,可以得到:不同的训练样本对预测结果是有影响的,但是,对于同一样本来说,迟滞ELM的预测均方误差还是要小于ELM。

5 结束语

为了应对由于世界经济的高速发展带来的能源危机,世界各国大力发展清洁的可再生的风能。风能的发展与风电场的出力息息相关,风速预测又是进行风电场出力预测的前提条件。目前常用的风速预测方法预测精度不高、预测时间较短。为了改善风速时间序列的预测精度和预测时间,提出了一种基于迟滞ELM模型的风速预测方法,并且进行了对比实验。实验结果表明,与利用ELM模型进行短期风速预测的结果相比,利用迟滞ELM模型进行短期风速预测的预测精度更高,预测时间更短。因此,迟滞ELM模型能够有效减小风速时间序列的预测误差,提高预测精度以及减少预测时间,从效率上来说学习系统具有更好的误差和泛化能力。

[1] 邵 璠.风电场短期风速预测研究[D].乌鲁木齐:新疆大学,2008.

[2] 韩 爽,杨勇平,刘永前.三种方法在风速预测中的应用研究[J].华北电力大学学报,2008,35(3):57-61.

[3] 陈丹丹,李永光,张 莹,等.风电场风速预测的研究方法[J].上海电力学院学报,2011,27(3):247-251.

[4] 蒋金良,林广明.基于ARIMA模型的自动站风速预测[J].控制理论与应用,2008,25(2):374-376.

[5] 黄小华,李德源,吕文阁,等.基于人工神经网络模型的风速预测[J].太阳能学报,2011,32(2):193-197.

[6] 吕 涛,唐 巍,所 丽.基于混沌相空间重构理论的风电场短期风速预测[J].电力系统保护与控制,2010,38(21):113-117.

[7] 谷兴凯,范高锋,王晓蓉,等.风电功率预测技术综述[J].电网技术,2007,31(S2):335-338.

[8] 黄文杰,傅 砾,肖 盛.采用改进模糊层次分析法的风速预测模型[J].电网技术,2010,34(7):164-168.

[9] Wang X,Guo P,Huang X.A review of wind power forecasting models[J].Energy Procedia,2011,12(39):770-778.

[10] Huang G B,Zhou H,Ding X,et al.Extreme learning machine for regression and multiclass classification[J].IEEE Transactions on Systems Man & Cybernetics Part B Cybernetics A Publication of the IEEE Systems Man & Cybernetics Society,2012,42(2):513-529.

[11] Ronay A K,Fink O.Two machine learning approaches for short-term wind speed time-series prediction[J].IEEE Transactions on Neural Networks & Learning Systems,2015,27(8):1734-1747.

[12] 王智慧.BP神经网络和ELM算法研究[D].杭州:中国计量学院,2012.

[13] 李 彬,李贻斌.基于ELM学习算法的混沌时间序列预测[J].天津大学学报,2011,44(8):701-704.

[14] Wang X,Qiao Q,Wang Z.Solving optimization problems based on neural network with hysteretic activation function[C]//International symposium on advances in neural networks.[s.l.]:[s.n.],2005:745-749.

[15] Huang Guangbin.Extreme learning machine:a new learning scheme of feedforward neural networks[C]//IEEE international joint conference on neural networks.[s.l.]:IEEE,2004:985-990.

[16] Luzanin O,Plancak M.Hand gesture recognition using low-budget data glove and cluster-trained probabilistic neural network[J].Assembly Automation,2014,34(1):94-105.

[17] Huang G B,Zhu Q Y,Siew C K.Extreme learning machine:theory and applications[J].Neurocomputing,2006,70(1):489-501.

[18] Xie S L,Zhang Y H,Chen C H,et al.Identification of nonlinear hysteretic systems by artificial neural network[J].Mechanical Systems and Signal Processing,2013,34(1-2):76-87.

[19] Nakaguchi T,Jin No K,Tanaka M.Hysteresis neural networks for N-queens problems[J].IEICE Transactions on Fundamentals of Electronics Communications & Computerences,1999,82(9):1851-1859.

[20] Nakaguchi T,Jin’No K,Tanaka M.Hysteresis neural networks for solving traveling salesperson problems[C]//IEEE interna-tional symposium on circuits and systems.[s.l.]:IEEE,2000:153-156.

[21] Xia G P,Tang Z,Li Y,et al.A binary Hopfield neural network with hysteresis for large crossbar packet-switches[J].Neurocomputing,2005,67(1):417-425.

[22] Chen L,Lian D H,Wang T.Synchronization stability of a distributed hysteresis controlled system[C]//Industrial electronics and applications.[s.l.]:[s.n.],2012:1616-1620.

[23] Jin N K.Dynamical hysteresis neural networks for graph coloring problem[C]//Applications of nonlinear dynamics.[s.l.]:[s.n.],2009:331-340.

[24] Bharitkar S,Mendel J M.The hysteretic Hopfield neural network[J].IEEE Transactions on Neural Networks,2000,11(4):879-887.

[25] Thangavel P,Gladis D.Hysteretic Hopfield network with dynamic tunneling for crossbar switch and N-queens problem[J].Neurocomputing,2007,70:2544-2551.

[26] Sun M,Xu Y Q,Dai X F,et al.Noise-tuning-based hysteretic noisy chaotic neural network for broadcast scheduling problem in wireless multihop networks[J].IEEE Transactions on Neural Networks and Learning Systems,2012,23(12):1905-1918.

[27] Wang Hongfei,Xiu Chunbo.Hysteretic neural network and its application in the prediction of the wind speed series[C]//26th Chinese control and decision conference.[s.l.]:[s.n.],2014:985-990.

[28] 修春波,刘 畅,郭富慧,等.迟滞混沌神经元/网络的控制策略及应用研究[J].物理学报,2014,64(6):060504.

Short-term Wind Speed Forecasting by Using Hysteretic ELM Model

YU Ao,CHEN Liang,PENG Jing-tao

(College of Information Science and Technology,Donghua University,Shanghai 201620,China)

The wind,as one of the most promising energy,has been developed by many countries in response to the energy crisis,and the wind speed prediction is the premise of wind farm output prediction.Many wind speed prediction methods are adopted to get high prediction accuracy and prediction of time presently.In order to improve the prediction accuracy and time of wind speed time series,a wind speed prediction method based on hysteresis ELM algorithm has been proposed.ELM algorithm is a new type of neural network,and it has high computational efficiency and superior performance,which can avoid local minimum.Hysteresis characteristics have been introduced in neural network via changing neuronal excitation function to enhance influence of the response history to the current input and thus to improve the utilization rate of useful information and to promote the wind speed time series prediction performance.The simulation results show that compared with the ELM model,the hysteresis ELM model can reduce prediction error of wind speed time series effectively for improvement of prediction accuracy and decreasing of prediction time.

ELM;hysteresis;wind speed prediction;machine learning

2016-06-21

2016-09-22 网络出版时间:2017-03-13

上海市自然科学基金资助项目(14ZR1400700)

余 敖(1990-),男,硕士研究生,研究方向为机器学习、图像处理;陈 亮,副教授,研究方向为机器学习、图像处理。

http://kns.cnki.net/kcms/detail/61.1450.TP.20170313.1547.104.html

TP391

A

1673-629X(2017)06-0130-06

10.3969/j.issn.1673-629X.2017.06.027