基于目标增强的红外与可见光图像融合技术研究

黄 慧,张宝辉,席 峰,吴旭东

基于目标增强的红外与可见光图像融合技术研究

黄 慧1,张宝辉2,席 峰1,吴旭东2

(1. 南京理工大学电子工程与光电技术学院,江苏 南京 210094;2. 北方夜视科技集团有限公司南京研发中心,江苏 南京 211106)

针对红外和可见光图像融合算法中存在背景模糊和目标不清晰等问题,提出一种基于目标增强的红外与可见光图像融合算法。首先,利用均值滤波的方法获得透射率的粗估计,通过图像统计信息实现粗透射率的细化,依据大气散射模型实现红外图像的目标增强;然后,对目标增强的红外图像和可见光图像采用改进的Prewitt算子进行边缘检测,并将检测结果二值化,对边缘部分采用基于二值信息的融合规则,对非边缘部分采用比值加权分析的融合规则。实验结果表明,采用基于目标增强的图像融合算法不仅能凸显红外图像的目标信息,还能尽可能多的保留可见光图像丰富的细节信息,具有更好的视觉效果和更高的客观质量评价指标。

图像融合;目标增强;大气散射模型;Prewitt算子

0 引言

多源图像融合是机器视觉领域的研究热点,通过对多源图像的特征分析,按照不同融合规则进行融合,可以得到一幅包含更全面信息的融合图像[1-2]。红外和可见光图像的融合是多源图像融合中最为常见的一种,红外图像是对某一场景中温度分布的描述,温度越高对应位置的灰度值越高,即使在能见度很低的条件下也能获得确切的目标位置及信息,可见光图像对光照强度有很强的依赖性,但是其具有纹理细节清晰、对比度高的特点,因此将二者进行融合是获得更准确信息的必要手段[3-4]。

红外和可见光图像的融合算法具有多样性,文献[5]提出了基于视觉显著图的融合算法,在显著图提取的过程中,需要参照图像的物理特征,具有一定的局限性;文献[6]中的基于HIS变换的融合算法,在光照强度很弱或目标不清晰的情况下,融合图像可能出现背景失真或丢失目标信息的现象;文献[7]对感兴趣区域进行检测并结合NSCT进行图像融合,由于红外图像的分辨率较低,融合图像的背景细节信息被减弱;文献[8]利用灰色关联理论提取出目标,采用替代法将图像进行融合,检测出的目标灰度值达到最大,容易出现图像失真、画面不协调等情况,而且仅能检测出单一的红外目标,有很大的局限性[5-8]。

为改善上述融合图像质量,本文首先将纹理信息少、对比度低的红外图像进行基于大气散射模型的目标增强,即弱化背景噪声,提高目标的辨识度;然后对目标增强的红外和可见光图像采用改进的Prewitt算子进行边缘检测,并将检测结果二值化,为了保留源图像的轮廓、边缘等细节信息,对边缘部分采用基于二值信息的融合规则,为了尽可能多地保留可见光图像的背景细节信息和红外图像的目标信息,对非边缘部分采用比值加权分析的融合规则,最终得到融合后的图像。实验结果表明,本文提出的融合算法优于其它算法,目标亮度有所提高,背景细节特征突出,视觉效果显著。

1 红外图像目标增强

红外成像技术,是用热像仪将某一场景内物体的温度分布转变为人类可见图像的成像技术,也称为热成像技术。图1为红外成像系统示意图。

目标在大气中传输时,存在明显的衰减过程。大气对红外辐射的衰减能力与消光系数有关,可表示为:

红外热辐射在大气中传输的总衰减公式为:

()=exp[-()] (2)

式中:为波长;为红外辐射的等效路程;为大气消光系数。

1975年,McCartney针对可见光图像的降质问题提出了著名的大气散射模型:

()=()×()+[1-()],()=exp[-()] (3)

式中:()为待去雾图像;()为去雾后图像;()为大气透射率;表示大气光强度;为大气衰减系数;为图像空间坐标;()为场景到摄像位置的距离;[1-()]表示环境光。

对比(2)式和(3)式,红外传感器在成像过程中受大气中水分子等的影响而使图像变得视觉模糊,这与可见光传感器在成像过程中受大气散射等影响导致图片变得灰白不清晰的情况有相似之处,因此可将背景模糊、信噪比低的红外图像看作雾化的可见光图像,对红外图像进行基于大气散射模型的目标增强。

式(3)中用()表示环境光项,即有:

()=[1-()] (4)

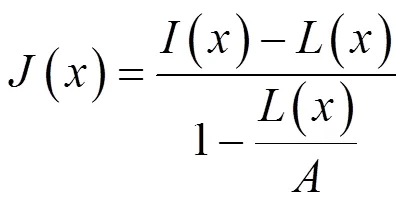

可得出透射率():

那么红外目标增强图像():

针对大气光的估计,He等[10]提出了基于暗通道理论的环境光值的取值方法,但是红外图像不存在暗通道,那么可以统计源图像灰度级前1%的点,将这些像素点取平均值作为的值。

由式(3)可知:

()≥[1-()] (7)

则透射率()与观测图像()关系:

对()进行×均值滤波得到aver()为:

aver()=avg×[()] (9)

透射率估计可表示为:

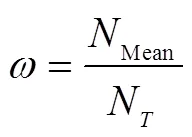

式中:为景深调整量,Î[0,1]。本文提出一种自适应确定的方法:分别统计灰度级小于强度正常阈值的像素点个数N和灰度级小于图像灰度均值的像素点数Mean,由N和Mean比值来估计的值,设置为:

经研究发现,式(11)中的阈值可由如下公式获得:

=Mean+×max(12)

式中:Mean为红外图像所有像素点的均值;max为红外图像所有像素点中最大值;根据实际情况取值,本文研究算法中取0.015。

透射率较大时,会导致图像整体太暗,为确保红外图像纹理清晰可见,需要对的下限进行设置,研究发现,下限设置为0.35效果最好,即:

联立式(10)、(13)可知透射率为:

则环境光可表示为:

联立式(6)、(9)、(15)即可求出红外图像的目标增强后的图像()。

2 图像融合

可见光图像具有背景细节突出、视觉效果好等优点,进行图像融合时对融合图像的背景信息贡献很大,然而在光照强度很弱或目标不清晰的情况下,传统融合方法得到的融合图像可能出现背景失真或丢失目标信息的现象,而红外图像是对温度分布的描述,可以确切地显示目标的位置和信息。为了使融合图像既能凸显目标特征又能拥有丰富的背景信息,本文设计了基于目标增强和边缘检测算子的融合方法。

图1 红外成像系统示意图

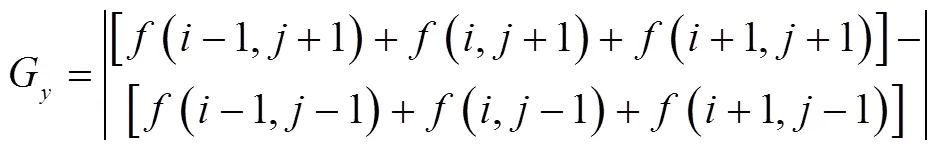

对目标增强的红外图像和可见光图像分别进行梯度运算[11],选取3×3的区域像素,采用Prewitt算子计算两幅图像中各点的梯度值。对于某一像素点(,),(,)为图像中像素点的坐标。Prewitt算子的水平方向灰度新值G和垂直方向灰度新值G为:

选用(,)=max{G,G}作为图像的梯度幅值。选择适当的阈值(为常数,本文中取值为0.06),若(,)≥,则(,)为边缘点,此时边缘图像中(,)设置为逻辑1,否则,(,)不是边缘点,边缘图像中(,)设置为逻辑0。水平和垂直方向模板如图2所示。

图2 Prewitt 算子

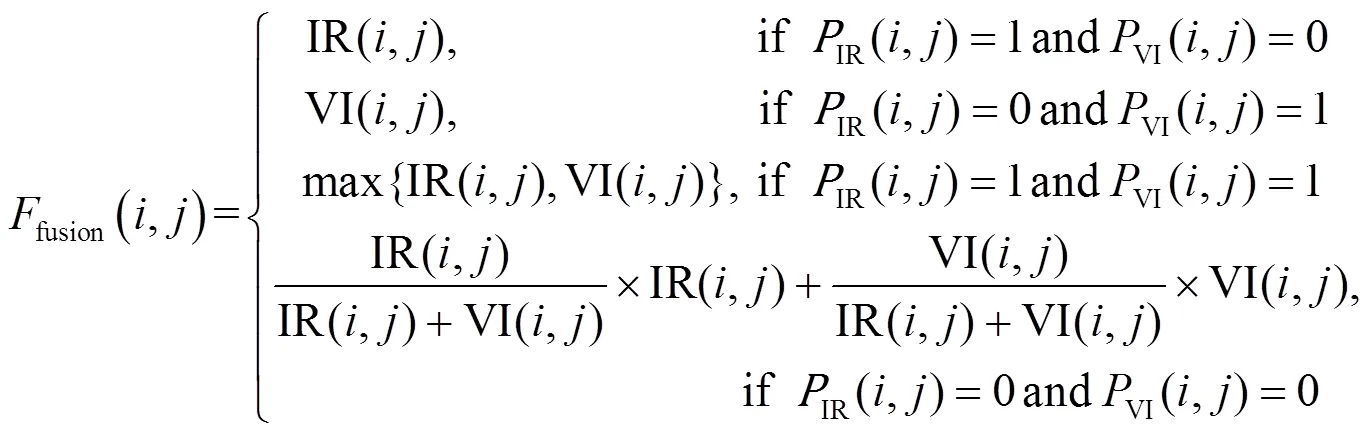

假设红外图像和可见光图像各点的灰度值分别为IR(,)和VI(,),运用Prewitt算子计算得到各点的梯度值分别为IR(,)和VI(,),当(,)=1时,则认为此处灰度值存在突变,含有较高的信息量,当(,)=0,表示此处不是图像的边缘、边界或亮度的突变部分。基于此,本文设计的融合思想为:若IR(,)=0、VI(,)=1,说明可见光在此处有较高的信息量,保留可见光图像在相应位置的灰度值;若IR(,)=1、VI(,)=0,保留红外图像在相应位置的灰度值;若IR(,)=1、VI(,)=1,选择两幅图像在相应位置的较大灰度值;若IR(,)=0、VI(,)=0,为了确保图像的不失真以及获取更多的信息量,运用加权的方法进行融合。

综上所述,红外和可见光图像融合规则可表示为:

式中:fusion(,)表示融合图像fusion在点(,)处的灰度值。

3 实验结果分析与评价

本文选取了两组不同场景的图像对本文融合算法进行验证(图3、图4)。为了说明本文算法相比于传统算法的优越性,选取了加权平均算法(Average method)、拉普拉斯金字塔算法(Laplacian Pyramid)、低通比率金字塔算法(Ratio Pyramid)、Harr小波变换算法(DWT with Harr)、形态学金字塔算法(Morphology Pyramid)与本文算法进行对比分析。

对比分析图3、图4中的融合结果,加权平均、拉普拉斯金字塔、Harr小波变换3种方法得到的融合图像纹理信息减少、目标亮度明显下降;运用低通比率金字塔融合后的图像出现了失真,目标模糊不清,树木丛等出现了很多亮点,干扰人类视线;形态学金字塔的融合方法使得图像的背景信息出现了伪迹,目标也出现了很强的伪影,不利于人眼观察;本文算法得到的融合图像中的目标突出,而且背景细节信息与源图像相关性大,视觉效果显著。

为了体现本文算法的适用性,选取其他两组不同场景的图像进行融合,如图5所示,由融合图像可以看出,本文算法融合效果好,适用性强。

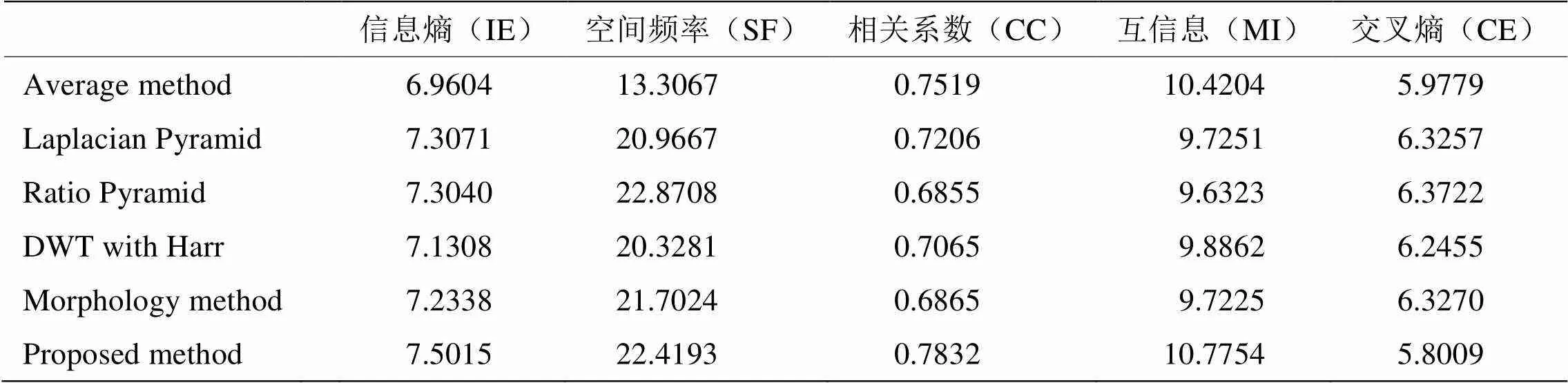

为了客观评价融合图像的性能,本文采用了信息熵(information entropy,IE)、空间频率(spatial frequency,SF)、相关系数(correlation coefficient,CC)、互信息(mutual information,MI)、交叉熵(cross entropy,CE)来评价图像融合质量。对图3、图4的融合评价结果如表1、表2所示。

图3 第一组图像不同算法融合结果对比

图4 第二组图像不同算法融合结果对比

图5 本文算法运用于其他场景的融合结果

表1 图3中各融合算法的客观评价结果

表2 图4中各融合算法的客观评价结果

从表1、表2数据来看,本文算法在信息熵、空间频率、相关系数、互信息量的数值整体上大于其他算法,说明采用本文算法得到的融合图像具有质量好、画质清晰、与源图像相关性大等优点,而交叉熵的指标相比于传统融合方法较低,说明融合图像与源图像之间的差别小、相似度高。整体而言,本文算法对于红外和可见光图像的融合是相当有效的,融合图像既能凸显目标特征又能拥有丰富的背景信息。

4 结论

本文首先对红外图像进行目标增强,然后采用改进的Prewitt算子对目标增强的红外和可见光图像进行边缘检测,并将检测结果二值化,对边缘部分采用基于二值信息的融合规则,对非边缘部分采用比值加权分析的融合规则,最终得到融合后的图像。根据实验对比分析,采用本文方法对不同场景的红外和可见光图像进行融合,得到的融合图像中目标信息主要来源于红外图像,相比于其他算法,目标亮度有所提高,视觉效果显著;融合图像的背景信息大部分来自于可见光图像,边缘、轮廓及像素的亮度突变部分信息得到保留,对比度高,细节特征突出。客观评价指标也表明,该算法整体上优于其他算法,稳定性好,具有一定的应用价值。

[1] 陈天明, 王俊琦, 张星祥, 等. 基于特征提取的红外与可见光图像融合[J]. 激光与红外, 2016, 46(3): 357-362.

CHEN Tianming, WANG Junji, ZHANG Xingxiang, et al. Fusion of infrared and visible image based on feature extraction[J]., 2016, 46(3): 357-362.

[2] LUO X, ZHANG J, DAI Q. A regional image fusion based on similarity characteristics[J]., 2012, 92(5): 1268-1280.

[3] 华玮平, 赵巨峰, 李梦, 等. 基于视觉显著性的红外与可见光图像融合[J]. 光学仪器, 2016, 38(4): 303-307.

HUA Weiping, ZHAO Jufeng, LI Meng, et al. Dual-band image fusion for infrared and visible image based on image saliency[J]., 2016, 38(4): 303-307.

[4] 林玉池, 周欣, 宋乐, 等. 基于NSCT变换的红外与可见光图像融合技术研究[J]. 传感器与微系统, 2008, 27(12): 45-47.

LIN Yuchi, ZHOU Xin, SONG Le, et al. Infrared and visible image fusion technology based on non-subsampled contourlet transform[J]., 2008, 27(12): 45-47.

[5] 王晓文, 赵宗贵, 庞秀梅, 等. 基于视觉显著图的图像融合方法[J]. 吉林大学学报: 工学版, 2014, 44(4): 1203-1208.

WANG Xiaowen, ZHAO Zonggui, PANG Xiumei, et al. Image fusion method based on visible saliency maps[J].:, 2014, 44(4): 1203-1208.

[6] TU Te Ming, SU Shun Chi, Shyu Hsuen Chyun, et al. A new look at HIS-like image fusion method[J]., 2001, 2(3): 177-186.

[7] LIU H X, ZHU T H, ZHAO J J. Infrared and visible image fusion based on region of interest detection and non-subsampled contourlet transform[J].:, 2013, 18(5): 526-534.

[8] 王春华, 马国超, 马苗, 等. 基于目标提取的红外与可见光图像融合方法[J]. 计算机工程, 2010, 36(2): 197-200.

WANG Chunhua, MA Guochao, MA Miao, et al. Fusion algorithm for infrared and visible light image based on objective extraction[J]., 2010, 36(2): 197-200.

[9] 周国辉, 刘湘伟, 徐记伟. 一种计算红外辐射大气透过率的数学模型[J]. 红外技术, 2008, 30(6): 331-334.

ZHOU Guohui, LIU Xiangwei, XU Jiwei. A math model of calculate the atmospheric transmittance of infrared radiation[J]., 2008, 30(6): 331-334.

[10] HE K, SUN J, TANG X. Single image haze removal using dark channel prior[C]// 2013, 2009: 1956-1963.

[11] 陈伟斌, 牛犇, 顾宏斌. 基于加权的可见光与红外图像融合算法[J]. 航空计算技术, 2016, 46(5): 73-76.

CHEN Weibin, NIU Ben, GU Hongbin. Fusion algorithm of infrared and visible images based on weighting[J]., 2016, 46(5): 73-76.

Image Fusion Technique Based on Target-Enhancement

HUANG Hui1,ZHANG Baohui2,XI Feng1,WU Xudong2

(1.,,210094,; 2.,-.,,211106,)

To resolve the issue of blurred backgrounds and fuzzy targets in using the infrared and visible image fusion algorithm, this paper proposes a new method for image fusion based on target-enhancement. First, average filtering is used to obtain rough estimation of the transmission rate, which is refined by calculating the images’ statistical information. Further, a final target-enhanced infrared image is obtained using the atmospheric scattering model. Then, the edge of the target-enhanced infrared image and the visible image is detected and binarized using the improved Prewitt operator. The fusion rule based on binary information is used for the edge part, and the fusion rule based on the ratio weighting analysis is used for the non-edge part. Experimental results show that the image fusion algorithm based on target-enhancement not only highlights the target information of an infrared image, but also retains the detailed information of the visible image as much as possible. Additionally, the fused image has better visual effects and higher objective quality evaluation indexes.

image fusion,target enhancement,atmospheric scattering model,prewitt operator

TP391

A

1001-8891(2017)10-0908-06

2017-06-30;

2017-08-07.

黄慧(1991-),江苏连云港人,女,硕士,主要从事图像处理方面的研究。E-mail:hh_shine11@163.com。