一种基于旋转不变特征的在线目标跟踪方法

李长隆, 杨海滨, 刘佳

一种基于旋转不变特征的在线目标跟踪方法

李长隆1, 杨海滨2, 刘佳2

(1.武警部队参谋部机要局,北京100000;2.武警工程大学电子技术系,陕西西安710086)

提出了一种新的基于局部二进制模式(LBP)特征的旋转不变特征,该特征与2bitBP特征相比,具有一定的旋转不变性。改进了跟踪-学习-检测(TLD)框架中的目标检测模块,提出了一个新的跟踪-学习-检测-验证(TLDV)框架,并将其应用到在线目标跟踪领域。该框架首先提取运动目标的SIFT特征点,然后利用SIFT点的对应关系计算目标的旋转的放射变换,从而进一步确定目标旋转角度,进行跟踪框的旋转更新,实现了旋转不变的目标跟踪算法,在一些视频的测试结果验证了算法的有效性。

跟踪-学习-检测;放射变换;目标跟踪

0 引言

智能视频安防监控系统大多以检测跟踪为基础,在捕捉运动目标信息的基础上,进行分析和理解。本文基于检测跟踪的方法,构建目标描述特征,以及半监督的在线学习跟踪算法,设计了一个基于旋转不变特征的跟踪方法。目标特征可以分为局部特征和全局特征。局部特征就是从图像的局部结构出发,用局部信息来构造出具有光照、几何变换不变性的描述子。典型的局部特征包括尺度不变特征转换(Scale-invariant feature transform SIFT)[1]、局部二进制模式(Local Binary Pattern LBP)[2]。全局特征是指反应图像全局的和整体的特征描述,一般而言全局特征与特定的应用相关。通常,结合全局特征与局部特征的方法,能够有效的改进对于目标的描述。Kalal[3]等人提出的一种新的基于正负条件约束的半监督在线学习框架,利用到了一些结构约束来训练一个二类分类器,并将这个分类器应用到视频跟踪领域取得了较好的结果。Grabner等人[4]在特征选择器更新过程中,引入半监督机制,并在特征选择过程中,利用一个初始的优先特征与在线分类器共同得到最优特征,同时通过SemiBoost训练一个分类器。已标记的数据被作为初始值,而在跟踪过程中获取的数据则被当作是未标记的样本。

本文在LBP特征的技术上,提出了一种新的旋转不变特征,同时利用TLD跟踪框架,设计了一个旋转不变的跟踪方法,并在一些视频集上进行了测试,验证了算法的有效性。

1 LBP特征及TLD跟踪框架

1.1LBP特征

LBP特征是一种表述灰度图某像素与周围像素点大小关系的二进制描述算法,最初应用于图像的纹理描述,近来人们提出了多种扩展的LBP,它计算简单,并且具有部分的尺度、旋转不变性等优点。在文献[3]中提出了一种新的特征2bit Binary Patterns(2bitBP)用于训练在线分类器2bitBP度量了在一个特定区域内的梯度的方向,将这个方向进行量化,并且输出4种可能的编码形式。如图1所示。

图1 局部2比特二进制模式

这个特征将对象框中的局部梯度进行编码[3]。2bitBP特征实际上是受到了局部二进制模式(Local Binary Patterns LBP)[2]的启发,但是与标准的LBP不同,LBP对3∗3像素的区域进行编码并将一个特定的区域表示成这些编码的分布,而2bitBP将这些区域表示成简单的编码。

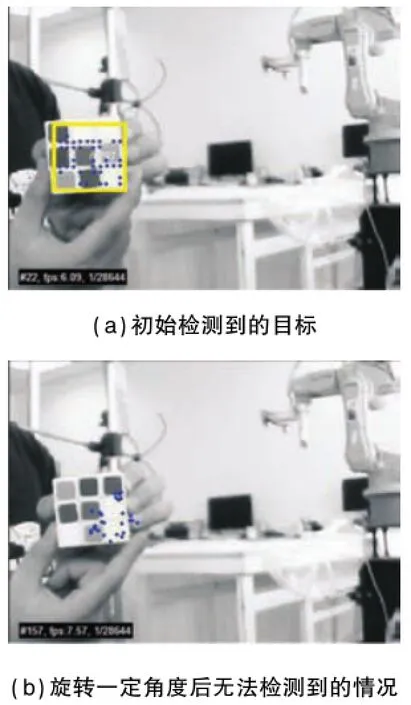

无论是LBP特征还是2bitBP特征,都不具有旋转不变性,同时LBP特征这样的局部特征也不具有全局的空间信息描述能力。在这种情况下,当跟踪目标被遮挡或是移出视场一段时间后,若目标物体再一次以不同的角度在此进入视野中时,由于训练特征不具有旋转不变性,检测器便无法检测出物体所在的位置,这样基于检测的跟踪就可能实效,如图2所示。

图2 检测实验

1.2TLD框架

在现有的在线学习跟踪的框架中,基于训练-学习-检测的框架(Training Learning Detection,TLD)是其中比较成功的,该框架在文献[3]中提出,作者给出了TLD框架中的PN学习(Positive and Negative Learning即PN learning)框架,PN学习的过程实际上就是从预先标记好的数据集(Xl,Yl)中,学习一个分类器f: X→Y,并且利用未标记的数据Xu来提高分类器的性能。

文献[3]将该学习框架应用于视频目标跟踪中,给出了TLD的跟踪框架,在跟踪中,作者使用了随机森林分类器Fern作为检测器,利用光流作为跟踪器,其跟踪流程如图3所示。

图3 基于TLD的跟踪框架

从图3中可以看出,该跟踪框架结合了跟踪器和检测器,通过跟踪器以及检测器的结合来实现检测器的更新。

2 旋转不变特征

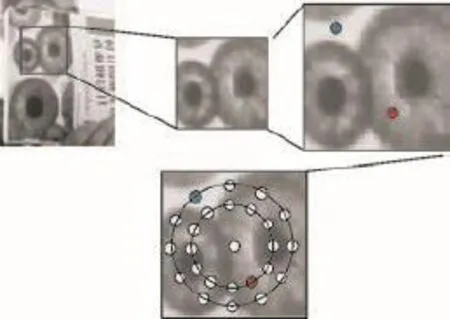

由于LBP和2bitBP特征不具有旋转不变性,在本文中,提出了一种新的旋转不变特征,该特征具有一定的旋转不变性,提取过程如图4所示。

图4 旋转不变特征的提取过程

为了实现快速的特征提取,我们采用二进制特征作为随机森林Fern分类器的特征。该特征提取过程如下:

首先,在图像块中随机的选取两个点,如红色Pr和蓝色点Pb所示,该特征初始化时是随机选取的,在训练过程中特征点的位置保持不变;

其次,以图像块的中心点为中心,以两个点到中心点的距离为半径,分别提取LBP特征即LBPr和LBPb;

最后,这两个LBP特征的关系给出最终的二进制特征即,若LBPr>LBPb,f=1,否则f=0。

需要强调的是,本文中的旋转不变特征相对于文献[3]中的2bitBP特征以及LBP特征而言,具有以下特点:

(1)旋转不变性:本文的二进制特征具有一定的旋转不变性,可以用于提高目标旋转一定角度下的检测率。

(2)计算方法简单,空间复杂度低。相比2bitBP特征每一个节点输出2位信息而言,本特征仅仅给出1bit信息,当随机森林的数目增加,或Fern中节点的数量增加的时候,2bitBP特征比本特征占用的空间要多。例如若Fern的个数为K,每个fern的深度为d的话,一个2bitBP特征输出具有4个可能值,若采用M个特征的话,每一个fern的叶子节点的数目为4d。而本文的特征输入为二值,因此fern叶子节点输出的数目为2d。

3 改进的在线学习的跟踪框架

3.1基本框架

在原始的TLD的在线跟踪框架中,利用跟踪器与检测器的相互结合进行跟踪,在本文中,改进的TLD框架利用了旋转不变特征,同时包含了一个验证器用于给出目标的仿射变换信息。与原始的TLD框架不同,本文中的跟踪框架包含训练、学习、检测与验证即Training、learning、Detection and Validator.即TLDV跟踪框架,如图5所示。

图5 改进的TLDV跟踪框架

在本文中,以实时性较好的光流[5]作为跟踪器,利用随机森林Fern[6]作为检测器,同时利用PN学习的框架更新检测器,整个半监督的跟踪框架的基本流程如下:

(1)首先进行检测器和跟踪器的初始化。

(2)其次在初始帧,针对所选的目标,提取旋转不变特征用于初始化随机森林Fern的学习,同时初始化光流跟踪器,并对当前目标提取特征点生成初始模板。

(3)在后续的视频帧中,利用跟踪器和检测器的结果,结合PN学习的框架实现目标的跟踪,即利用半监督的结构信息实现检测器的更新,具体做法如下:对视频的每一帧,检测器和跟踪器寻找目标的位置,由跟踪器给出的距离轨迹较近的图像块被作为正样本,而由检测器得到的距离轨迹较远的图像块被作为负样本。如果离跟踪结果很远处有一个很强的检测结果,跟踪器重新进行初始化并且收集的样本被丢弃掉。

(4)由于跟踪器可能漂移出目标,因此当跟踪器正确跟踪到物体的时候,需要进行下一帧位置的估计。跟踪器的信任度通过跟踪到的图像块与第一帧选择的图像块之间的互相关性来进行度量。当跟踪轨迹的最后一帧拥有大于80%的相关度的时候,这个连续的轨迹被认为是正确的。当这个轨迹被认为是有效时,那么它将会触发P-N约束条件,从而开始利用数据的结构信息,进行检测器的更新。

(5)根据跟踪器和检测器的输出个结果,得到当前目标坐在的位置,然后利用姿态估计器,提取目标所在区域的SIFT特征,通过与模板的匹配,给出跟踪框旋转的角度信息。

3.2姿态验证估计器

在本文的TLDV框架中,除了旋转不变特征以外,另一个重要的改进是引入了姿态验证估计器,给出变换后的跟踪框的位置以及角度。一般而言,都假设目标的旋转或是变换是一个仿射变换,本文利用SIFT描述子的匹配关系,在跟踪过程中,通过跟踪框中当前帧与初始帧的特征点的匹配估计出仿射变换矩阵。实际上针对跟踪目标的仿射变换,已经研究者做了一些工作,例如Ross等人[7]提出采用增量学习的方法来学习一个低维的子空间表示来自适应的描述目标的外观,从而给出目标位置和姿势的一个估计。Kwon等人[8]利用在仿射群上的粒子滤波框架来得到目标的仿射变换估计。但是基于粒子滤波框架的仿射变换估计的计算量很大,无法达到实时,特别是当粒子数目设定的过多时,运行速度非常慢,不具有实用性。而本文的估计器简单、稳定、对图像预处理要求低,同时同处理较大角度的旋转。具体的计算的流程如图6所示。

图6 验证估计器的具体流程

这整个验证估计的流程可以具体的描述为:

初始帧:计算模板图像的SIFT特征点,记为X’。

当前帧:根据检测器和跟踪器的输出到当前目标的位置,同时提取该目标的SIFT特征点,记为X.,利用SIFT匹配算法,进行特征点匹配,选取n(n≥3)个匹配点对,这些匹配上的点对分别表示为Y’和Y.根据仿射变换的定义,求解仿射变换矩阵参数,即根据下式计算:

其中,HA是仿射变换矩阵,A是2×2的非奇异矩阵,t是二维平移矢量,平面仿射变换具有6个自由度,对应于6个矩阵元素,可以由3组点对应得到。

给定当前目标边框的四个顶点位置,根据仿射矩阵得到一个新的位置,这个新的位置即是当前目标框的输出位置。

由于本文利用了检测器、跟踪器以及估计器,使得跟踪过程可以有效处理目标丢失后再出现的情况,对于这种情况而言,重要的是如何进行目标再出现的初始化跟踪,在原始的TLD框架中,仅仅利用检测器进行初始化,在TLDV的框架中,具体方法如下:当目标丢失后,在每一帧,利用检测器进行目标检测。当检测到目标时,计算检测到的跟踪框中的目标与模板的相似度,若大于一定的阈值,则提取该检测框中的特征点,利用估计器得到修正后的检测框。在修正后的检测框上选择适当比例大小的初始框,重新初始化光流跟踪器。然后就按照TLDV的框架进行跟踪和检测的在线更新。

可以看出,与TLD仅仅利用监测器进行跟踪器的再次初始化相比,本文的方法利用了估计器来得到初始图像的旋转角度。

4 实验及分析

为验证LBP旋转不变特征的有效性,当图像块旋转一定的角度时,有这两个点形成的两个LBP特征的大小关系保持不变,因此,该特征具有一定的旋转不变性。图7是利用这个旋转不变特征后,得到的结果,可以看出,旋转不变特征具有一定有效性,使得不同角度下的目标都能被有效的检测出。

图7 利用旋转不变特征进行基于检测的跟踪

本文利用SIFT描述子的匹配关系,在跟踪过程中,通过跟踪框中当前帧与初始帧的特征点的匹配估计出仿射变换矩阵,基本的过程如下:

1)在初始帧,将目标保存为模板图像,并提取SIFT特征点。

2)在下一帧以及当前帧进行跟踪时,若跟踪成功,则提取跟踪框中的图像的SIFT点,将当前帧中跟踪目标的SIFT特征点与模板图像的SIFT特征点进行配准。

3)通过大量的匹配上的点,建立仿射变换方程,从而得到仿射变换中图像旋转角度信息,通过对当前帧图像中的跟踪框进行仿射变换从而得到更加准确的姿态信息。

如图8所示,通过上面的方法,可以有效的估计出当前跟踪目标的旋转角度信息。其中黄色的跟踪框为TLD跟踪结果,红色的跟踪框为根据匹配点得到旋转角度后跟踪框。

图8 根据SIFT匹配点得到的跟踪框结果

5 结语

本文提出了一个新的跟踪框架跟踪-学习-检测验证(TLDV)框架,该框架在TLD的基础上上,为了克服目标旋转引起的目标丢失,首先为检测模块引入了一个旋转不变的LBP特征,该特征的提取依据圆周满足旋转不变的特性,实现目标旋转的不变特性,同时增加了一个验证模块,该模块首先提取目标的SIFT特征点,然后将模板图像与当前帧的SIFT特征点进行匹配,从而估计出当前帧旋转的角度,实现了一个旋转不变的在线目标跟踪方法。文中提出的方法仅适用于刚性物体旋转不变的跟踪,对于非刚性物体的跟踪效果较差,这将是下一步研究的重要内容。

[1] Lowe D G.Distinctive Image Features from Scale-Invariant Keypoints,International Journal of Computer Vision[J]. 2004,60(2):91-110.

[2] Ojala T and Pietikainen M.Multiresolution Gray-Scale and Rotation Invariant Texture Classification with Local Binary Patterns,IEEE Trans on Pattern Analysis and Machine Intelligence[J].2002,24(7):971-987.

[3] Kalal Z,Matas J,and Mikolajczyk K.P-N Learning:Bootstrapping Binary Classifiers by Structural Constraints[C]. Conference on CVPR,2010,238(6):49-56.

[4] Grabner H,Leistner C,and Bischof H.Semi-supervised Online Boosting for Robust Tracking[C].In Proceedings European Conference on Computer Vision(ECCV),2008,5302: 234-247.

[5] Lucas B and Kanade T.An iterative image registration technique with an application to stereo vision[J].IJCAI,1981 (81):674-679.

[6] Zuysal M,Calonder M,Lepetit V.Fast Keypoint Recognition Using Random Ferns[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2009,24(7): 971-987.

[7] Ross D,Lim,Lin Jand Yang M H.Incremental learning for robust visual tracking[J].International Journal of Computer Vision,2008,77(1-3):125-141.

[8] Kwon J,Park F.Visual tracking via particle filtering on the affine group[C].Proceedins of IEEE International Conference on InformationandAutomation,2008,29(2-3): 997-1002.

A New Online Object Tracking Algorithm based on Rotation-Invariant Feature

LI Chang-long1,YANG Hai-bin2,LIU Jia2

(1.Joint Staff of PAP,Beijing 100000,China;2.Dept.of Electronic Technology,Engneering University of PAP,Xi’an Shaanxi 710086,China)

A novel rotation-invariant feature based on LBP for video object tracking,and similar to 2Bit BP feature is described,and based on the improved object detection model in TLD framework,a novel tracking framework called tracking-learning-detectionvalidator(TLDV)for onlie object tracking is proposed.By taking advantage of the SIFT feature of moving object,affine transform of the rotation is calculated and acquired.Experiments on some test videos indicate that the proposed algorithm is feasible and effective.

TLD;affine-transform;object tracking

TN91

A

1009-8054(2016)08-0082-05

∗2016-03-20

国家自然科学基金(No.61403417)

李长隆(1982—),男,硕士研究生,工程师,主要研究方向为图像、视频处理;

杨海滨(1982—),男,硕士,讲师,主要研究方向为模式视频分析。

刘佳(1982—),男,博士,讲师,主要研究方向为机器学习,目标跟踪。■