基于色度饱和度-角度梯度直方图特征的尺度自适应核相关滤波跟踪

王春平,王 暐,刘江义,付 强,徐 艳

(军械工程学院 2系,河北 石家庄 050003)

基于色度饱和度-角度梯度直方图特征的尺度自适应核相关滤波跟踪

王春平,王暐*,刘江义,付强,徐艳

(军械工程学院 2系,河北 石家庄 050003)

针对核相关跟踪算法(KCF)对特征敏感及无法跟踪尺度的问题,本文从特征提取和尺度自适应两个方面对核相关滤波跟踪算法进行了研究。提出了一种基于色度饱和度-角度梯度直方图特征的自适应核相关跟踪算法来改善KCF算法的跟踪性能。首先,研究了HSI颜色空间的特点, 基于颜色和梯度是互补的图像特征,提出了一种融合了梯度和颜色的HHS-OG特征来有效提高原始KCF算法对目标和背景的判别力。其次,针对KCF无法处理目标尺度变化的问题,在跟踪的检测阶段采用一组固定的尺度因子进行图像块采样,根据得到的滤波响应图估计目标的最优位置和尺度。将所提算法在大量视频序列上进行了跟踪实验,结果显示其平均跟踪速度为37.5 frame/s,跟踪精度和成功率分别提升了5.4%和10.1%。实验表明HHS-OG特征具有良好的目标-背景判别能力,能够实现鲁棒跟踪,而尺度自适应策略能较大程度地提高跟踪精度。

视觉跟踪;核相关滤波跟踪;特征融合;特征提取;尺度自适应跟踪

1 引 言

视觉跟踪是计算机视觉的一个基础性研究方向,在人机交互、监控、增强现实、机器感知等场景中有着广泛的应用[1]。视觉跟踪的任务是在给定目标初始状态的情况下,对目标在后续帧中的状态进行实时估计,跟踪中面临的主要挑战包括光照变化、目标尺度变化、背景干扰、遮挡等。为了对现有跟踪算法进行公平有效的评价,WU Y等[1]在计算机视觉顶级会议CVPR(Conference on Computer Vision and Pattern Recognition)上提出了一个大规模的跟踪测评集,该测评集的提出有效促进了跟踪算法的研究。由于基于相关滤波(Correlation Filter, CF)的跟踪算法在该测评集上的表现优异[2],它已成为近两年视觉跟踪的研究热点。

相关滤波在计算机视觉领域最初被用于目标检测和识别[3],学者们利用相关滤波器能够在目标处产生响应峰值的现象,实现对目标的精确定位。但相关滤波的滤波器在训练过程中耗时严重,故其一直无法应用于实时视觉跟踪。为此,BOLME D S等[4]设计了一种MOSSE(Minimum Output Sum of Squared Error)相关滤波器,其可以自适应更新,首次实现了基于相关滤波的高速跟踪。以MOSSE为基础,Henriques等[2,5]在岭回归框架下学习滤波器,利用循环矩阵、快速傅里叶变换(FFT)对跟踪加速,并将核技巧(kernel trick)融入学习框架以提升滤波器的判别能力,最终提出一种核相关滤波跟踪(Kernelized Correlation Filters tracking,KCF)方法。KCF是目前大多数基于相关滤波跟踪算法的基础框架。MARTIN D等[6]指出KCF在采用FFT加速的过程中对训练样本进行了周期性假设,导致了所谓的边界效应[5],他们提出了一种空间规则化的相关滤波算法,以降低边界效应的影响。但该算法增大了采样区域,且优化时间复杂度较高,所以较KCF更为耗时,同时,由于采样区域加大,该算法更容易导致漂移。TANG M等[7]对KCF进行了多核化和尺度自适应的扩展,得到了性能更优的跟踪算法,但同样存在算法复杂度过高的问题。文献[4, 8, 9]从特征表达的角度改进KCF,分别采用角度梯度直方图[10]特征(Histogram of Oriented Gradient, HOG)、颜色特征、分层深度特征等代替简单的灰度特征[5],均大幅提升了KCF的跟踪性能。其中,HOG和颜色特征实时性较好。

鉴于颜色和梯度信息均有利于跟踪[4, 8 ]且能够快速提取,本文提出了一种融合梯度和颜色的色度饱和度-角度梯度直方图特征(Histogram of Hue Saturation and Oriented Gradient, HHS-OG),来提升KCF的跟踪性能。同时,为了应对目标的尺度变化,本文采用一种尺度自适应策略,并根据该策略的特点实现了并行计算,在不增加算法耗时的前提下,提升了算法的跟踪精度。最后,通过大量的对比实验验证了所提HHS-OG特征和尺度自适应策略的有效性。

2 基于核相关滤波的跟踪

在对每一帧的跟踪中,KCF包括两个步骤:检测目标和训练(更新)滤波器。

2.1训练滤波器

在视频序列的第一帧中指定目标,然后从该帧中取大小为M×N的图像块作为训练样本,该图像块以给定的目标为中心,包含目标区域和目标周围的背景区域,记为x0,称为基本样本。将x0在行、列方向上进行循环位移,可得到MN-1个虚拟样本,如图1所示。记每个样本为xi,i=0,1,…,MN-1,并对其进行标记,标记值记为yi,文献[2]中标记值yi为二维高斯函数,基本样本x0对应最大值,如图2所示。

图1 基本样本(最中心处)及其虚拟样本示例

图2二维高斯函数标记图,每个像素对应图1中的一个样本

Fig.2Label map of 2-D Gaussian function, in which each pixel corresponding to one sample in Figure 1

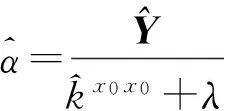

Henriques等[2,5]采用岭回归方法[11-13]训练滤波器ω,对于大小为M×N的任意图像块z,滤波结果为f(z)=ωT·z。对于给定的训练集{(xi,yi)},文献[11]给出了ω的解析解:

ω=(XTX+λI)-1XTY,

(1)

其中:X为训练样本xi的集合矩阵,Y为所有标签组成的集合,I为单位矩阵,λ为规则化系数,上标T表示矩阵转置。

为了进一步提高岭回归算法的性能,引入核技巧[11]。设映射函数φ(·)将样本xi映射到某高维非线性特征空间,则滤波器ω为高维空间中样本的线性组合[14]:

(2)

其中αi为组合系数,其集合为α。则滤波结果为:

(3)

其中:κ(·)称为核函数,表示两个样本在高维特征空间的内积,κ(z,xi)=φ(z)⊙φ(xi),⊙为内积操作,返回两侧样本对应维相乘后的和值。KCF通常使用的是高斯核。核技巧将对滤波器ω的求解转换为对系数α的求解,α的解析解为[11],

α=(K+λI)-1Y,

(4)

其中K为MN×MN的核矩阵,保存了训练样本间的核函数值,即Kij=κ(xi,xj)。

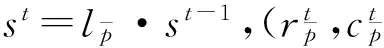

文献[2]证明,对于多项式核、径向基函数核(包括高斯核)等核函数,可在傅里叶域内快速求得α:

(5)

式中:变量的上标“^”表示变量在傅里叶域的对应值。kx0x0为核矩阵K的第一行,保存x0与x0的所有循环转移样本的核函数值,大小为MN。

式(4)中的主要运算为矩阵求逆和矩阵乘,最大的矩阵为K(MN×MN),计算复杂度为O((MN)3)。而式(5)中的快速算法,主要运算为矩阵乘,矩阵的维度均为MN,计算复杂度仅为O(MN)。由于FFT复杂度为(O(MNlog(MN))),采用式(5)求系数α的运算复杂度也只有O(MNlog(MN)),小于式(4)的求解方法,保证了KCF的高速性能。

2.2检测阶段

当新的一帧图像到来时,提取以上帧目标位置为中心的图像块z,从式(3)出发,可推出[2]:

(6)

得到的f(z)为与z大小相同的滤波响应图,响应图中每个点的值表示以该点为中心的循环转移样本为目标的概率。*表示共轭。滤波响应图的最大值点即为当前帧中的目标位置。

式(6)表明,求滤波响应图只需保存之前帧训练的系数α和基本样本x0,称(α,x0)为滤波器模型。

根据检测到的目标位置,在当前帧获取新的滤波器模型,然后采用线性插值对之前的滤波器模型进行更新,进行下一帧的跟踪。具体细节请参考文献[2,5]。

3 本文算法

本节首先将颜色与梯度特征融合,借鉴HOG特征的设计方法,提出了一种新的色度饱和度-角度梯度直方图特征(HHS-OG),并将其应用于KCF跟踪。然后,在检测阶段采用了一种尺度自适应策略。所提算法称为采用HHS-OG特征的尺度自适应核相关跟踪算法(Scale adaptive Kernelized Correlation Filter tracking using HHS-OG feature, KCF-HS),流程如图3所示,KCF-HS的后缀H表示直方图特征(Histogram),S表示尺度自适应(Scale adaptive)。

图3 所提KCF-HS算法的流程图

3.1HOG特征

HOG特征最早由DALAL N等[15]提出,在目标检测,特别是人体检测中,取得了成功应用。与文献[2]相同,本文采用PEDRO Felzenszwalb等在文献[10]中提出的改进的HOG版本进行跟踪,该HOG提取和统计每个cell(一小块图像区域,如4 pixel×4 pixel 大小)的梯度信息作为图像特征,每个cell的特征为31维,包括方向不敏感特征(9维)、方向敏感特征(18维)和纹理特征(4维),其主要提取步骤如图4所示。

图4 文献[10]中HOG特征的主要提取步骤

3.2HHS-OG特征

在原始图像上进行差分操作(求梯度),将差分操作的次数称为阶次,则颜色和梯度分别为图像的0阶和1阶特征,它们从不同的层面对图像进行特征提取,具有互补性。事实上,颜色和梯度对应视觉系统中不同层面的神经元,它们从不同层面对图像进行抽象和表达,颜色对目标形状、尺度等具有较好的不变性,而梯度对光照等具有较好的不变性[16]。单独采用颜色和HOG的KCF算法的性能均优于采用灰度特征的KCF算法性能,融合颜色和HOG将有助于进一步提高KCF的跟踪性能。

常用的RGB颜色空间将颜色和亮度信息相混杂,导致颜色的判别能力降低。而HSI空间包含色度(Hue)、饱和度(Saturation)和亮度(Intensity)信息,是一种更符合人类视觉特点的颜色表达[16],文献[8]通过实验验证了HSI在跟踪方面的性能优于RGB。因此,本文将HSI和HOG相融合,用于KCF跟踪框架。

图5HSI颜色空间原理及H、S通道与梯度关系示意。右侧为HOG特征提取时对梯度的处理方式,可见H、S和梯度角度、幅值在结构上一致

Fig.5Schematic of HSI color space and correspondence between H, S and gradient

图5为HSI颜色空间的原理图,亮度信息已用于提取HOG特征时的梯度计算,为了避免冗余,仅对HS通道的信息进行分析和提取。H和S通道构成了一个极坐标系,色度代表角度,饱和度代表半径。在形式上,色度和饱和度与HOG特征提取时用到的梯度角度、梯度幅度相一致。将图像的色度、饱和度分别看作HOG提取中的梯度角度和幅度,然后进行图4中的‘统计直方图,根据cell聚合’和‘归一化、截断及降维’操作,便得到了31维的色度-饱和度直方图(HHS)。

在概念上,颜色和梯度分别是图像的0阶和1阶特征,且HHS和HOG具有相同的表达形式。因此,本文将HHS和HOG在每个cell上进行连接,提出了HHS-OG特征,同时提取颜色和图像信息。进一步的实验测评发现,移除HHS的18维方向敏感特征能够同时提升跟踪算法的速度和判别力,因此本文采用了13维的HHS特征(9维方向不敏感特征与4维纹理特征)。最后,将13维的HHS特征与31维的HOG特征在对应cell上进行串接,最终形成44维的HHS-OG特征。

3.3尺度自适应

视觉跟踪中目标的尺度会发生变化,而原始KCF采用固定维度的滤波器,因而导致其输出的跟踪结果尺度固定不变。为了解决这一问题,在跟踪的检测阶段,本文采用如下的尺度自适应跟踪策略。

(7)

3.4算法步骤

结合上述HHS-OG特征和尺度自适应策略,所提KCF-HS算法(算法1)的基本步骤如下。

初始化:第一帧中目标状态(r1,c1),M,N及s1=1 fort=1 toT(T为序列的总帧数)

检测

ift>1 then

forp=1 toP

end

步骤3求当前帧的目标状态(rt,ct,st)(式(7))

end

训练/更新

步骤4根据检测结果(rt,ct,st),采样基本样本,并采用HHS-OG特征表达

步骤5训练当前帧滤波器模型(式(5)),并对总滤波器模型进行更新

end

end

4 实 验

为评估所提算法的性能,本文在CVPR2013跟踪测评集[1]上进行了两组对比实验。第一,将所提KCF-HS算法与目前最优秀的其它几种算法进行对比;第二,将KCF-HS与其它几种不同版本的算法进行对比,以验证HHS-OG特征和尺度自适应策略的有效性。

实验中,HHS-OG特征的cell大小为4×4,色度和梯度方向的直方图量化数为9,尺度因子个数P=5,S={0.98,0.99,1,1.01,1.02}。其余参数设置均与文献[2]相同。从算法1中可以看出,多个尺度检测之间是相互独立的,可以采用并行的方式实现,使得尺度自适应策略与原始的固定尺度跟踪方法的耗时基本相同。本文的实验平台为配置2.6 GHz i5处理器(6个处理器核)、4 GB 内存的普通电脑,仿真环境为Matlab 2011b,所提算法的跟踪速度达到了37.5 frame/s。

4.1CVPR2013测评集及测评准则

CVPR2013视觉跟踪测评集[1]包含50个完整标注的视频序列,涵盖了视觉跟踪面临的主要挑战性场景,即光照变化、尺度变化、遮挡、变形、运动模糊、快速运动、平面内旋转、平面外旋转、目标超出视场、背景干扰和低分辨率。近年来多数跟踪算法都以该测评集为基准进行实验和测评。

CVPR2013测评集从跟踪的精度和重叠率出发,提出了两个测评准则:精度曲线和成功率曲线。某一图像帧中,将跟踪算法的跟踪框与标注的真实目标框的中心距离称为精度,将两个框的重叠面积与总面积之比称为重叠率。精度曲线的横轴为给定的精度阈值,纵轴为跟踪精度大于给定阈值的图像帧占所有图像帧的比例。通常取精度曲线上对应阈值为20像素的值为典型值Pre-20。成功率曲线的横轴为给定的重叠率阈值,当跟踪的重叠率大于给定阈值时认为该帧跟踪成功。成功率曲线的纵轴为跟踪成功的帧占所有图像帧的比例,取阈值为50%时的值为典型值Suc-50。本文采用上述准则进行测评。

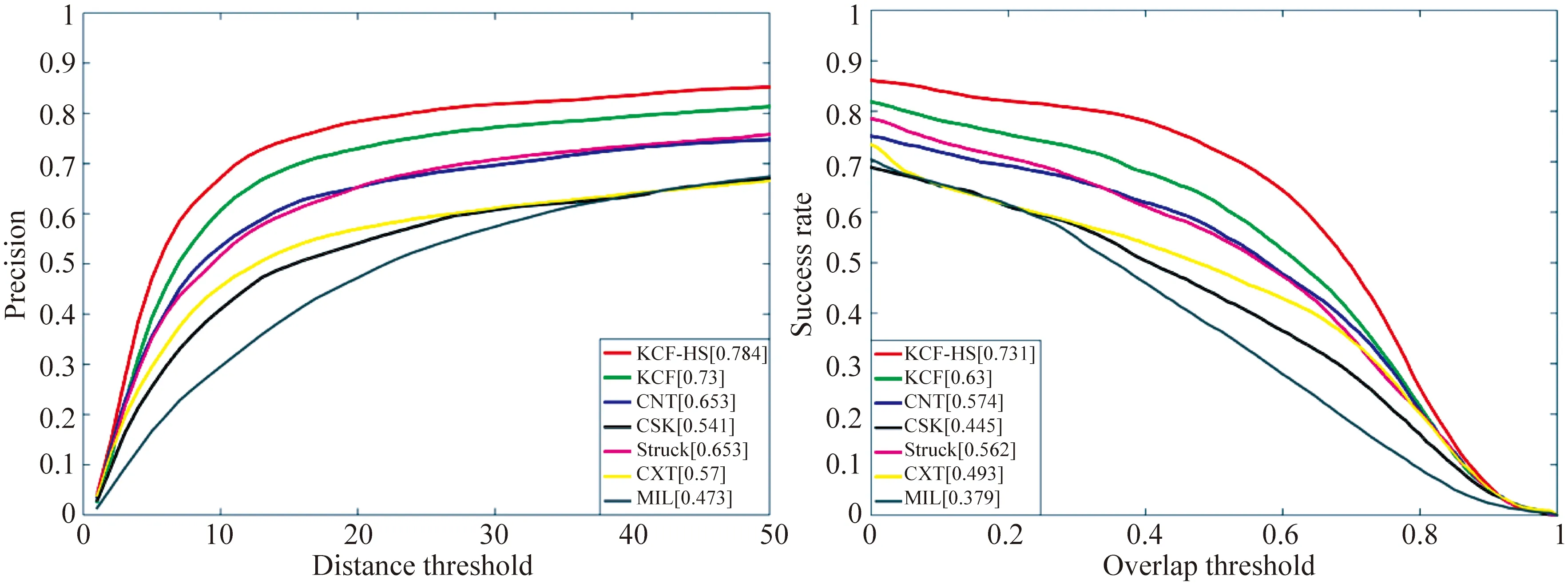

4.2总体性能测评

首先在CVPR2013测评集上对本文算法总体性能进行了对比测评,对比算法包括几种采用不同特征的KCF算法:原始KCF(HOG特征)[2]、CSK(灰度特征)[5]、CNT(颜色名特征)[8],以及在该测评集上表现优异的几种算法:Struck[17]、CXT[18]、MIL[19]。测评结果见图6(彩图见期刊电子版)。相比于Struck算法,所提KCF-HS的性能更优,Pre-20和Suc-50分别提高了13.1%(0.784 vs 0.653)和16.9%(0.731 vs 0.562)。KCF-HS在精度和重叠率上的性能较其他基于相关滤波的跟踪算法具有较大的优势,这也验证了HHS-OG特征和尺度自适应策略的有效性。

图6 所提KCF-HS算法与其它6种对比算法在CVPR2013测评集上的性能对比,左侧为精度曲线、右侧为成功率曲线

4.3算法具体分析

为进一步验证HHS-OG特征和尺度自适应策略的有效性,本文实现了KCF-HS的2个切割版本:仅采用HHS-OG特征的版本,记为KCF-H;仅采用尺度自适应策略的版本,记为KCF-S。仅采用HHS为特征的版本性能较差,所以未在对比分析中采用。

4.3.1定量分析

图7(彩图见期刊电子版)给出了KCF-HS、KCF-H、KCF-S、KCF的性能对比结果。从图中可以看出,单独采用所提HHS-OG特征(KCF-H)使原始KCF算法的Pre-20、Suc-50值分别提高了2.5%、2.6%,单独采用尺度变化策略(KCF-S)使原始KCF算法的Pre-20、Suc-50值分别提高了2.4%、7.1%。而两者同时采用可使KFC-HS的性能提升高达5.4%、10.1%。

特别是,在精度曲线和成功率曲线的高精度区域,即距离阈值较小或重叠率阈值较大处,尺度自适应算法(KFC-HS和KCF-S)的性能更优,说明同时跟踪目标中心和尺度的策略有效提高了跟踪精度。而在对精度要求较低的区域,KCF-H的性能与KCF-S相当,表明即使在尺度跟踪不精确的情况下,更具判别力的特征(所提HHS-OG)也能够有效提升跟踪性能。

4.3.2定性分析

图8(彩图见期刊电子版)为4种算法对测评集中几个典型序列的跟踪结果。

在序列Jogging2中,由于真实目标(白色衣服跑步者)和干扰目标(棕色衣服跑步者)具有相似的HOG特征,KCF-S和KCF在第63帧目标被遮挡后开始跟踪错误目标,而采用了HHS-OG特征的KCF-HS和KCF-H由于提取了更具判别力的颜色信息,故可实现持续稳定的跟踪。在序列Bolt中,KCF-HS和KCF-H在有背景干扰的条件下(第6帧中其他运动员和第240帧中黄色台子)实现了准确跟踪,这是因为HHS-OG同时提取颜色和梯度信息,能有效提高算法的判别能力。在Lemming序列第374帧,目标变小且被遮挡,此时只有KCF-HS完全捕获了目标的表观变化,完成了跟踪,其它3种算法均丢失目标。

Car4和Dog1序列(非彩色序列)中,目标车辆和玩具的尺度反复变化,KCF-HS和KCF-S均能实现尺度自适应跟踪,而其它两种算法由于无法准确估计目标尺度使得对目标中心的定位精度降低(Car4第599帧和Dog1第791帧)。CarScale序列中目标尺度快速增大,KCF-HS和KCF-S依然实现了稳定的位置和尺度跟踪,验证了所提尺度自适应策略的有效性。

图8 KCF-HS、KCF-H、KCF-S、KCF等4种算法在若干典型视频序列上的跟踪结果

5 结 论

本文从特征提取和尺度自适应两个方面对核相关滤波跟踪算法进行了研究,提出了一种采用HHS-OG特征的尺度自适应KCF跟踪算法。首先,研究了特征提取对KCF跟踪性能的影响,指出颜色和梯度是互补的图像特征,并提出了一种形式类似于HOG的融合特征——色度饱和度-角度梯度直方图(HHS-OG)。同时,针对KCF无法处理目标尺度变化的问题,提出了一种可并行实现的尺度自适应策略。所提算法在CVPR2013跟踪测评集上进行了实验测评,跟踪结果在成功率典型值上的提升达10.1%,表明HHS-OG特征具有良好的目标-背景判别能力,能够实现更鲁棒的跟踪,而尺度自适应策略能在较大程度上提高跟踪精度。

[1]WU Y, LIM J, YANG M H. Online object tracking: a benchmark [C].IEEEConferenceonComputerVisionandPatternRecognition,Portland,USA, 2013: 1354-1362.

[2]JOAO H, RUI C, PEDRO M,etal..High-speed tracking with kernelized correlation filters [J].IEEETransactionsonPatternAnalysisandMachineIntelligence, 2015, 32(9): 1627-1645.

[3]BOMLE D S, LUI Y M, DRAPER B A,etal.. Simple real-time human detection using a single correlation filter [C].IEEEInternationalWorkshoponPerformanceEvaluationofTracking&Surveillance,Snowbird,UT, 2009: 1-8.

[4]BOMLE D S, BEVERIDGE J R, DRAPER B A,etal..Visual object tracking using adaptive correlation filters [C].IEEEConferenceonComputerVisionandPatternRecognition,SanFrancisco,USA, 2010: 2544-2550.

[5]JOAO H, RUI C, PEDRO M,etal..Exploiting the circulant structure of tracking-by-detection with kernels [C].EuropeanConferenceonComputerVision,Florence,Italy, 2012: 702-715.

[6]MARTIN D, GUSTAV H, FAHAD S K,etal..Learning spatially regularized correlation filters for visual tracking [C].InternationalConferenceonComputerVision,Santiago,Chile, 2015: 4310-4318.

[7]TANGM, FENG J. Multi-kernel correlation filter for visual tracking [C].InternationalConferenceonComputerVision,Santiago,Chile, 2015: 3038-3046.

[8]MARTIN D, FAHAD S K, MICHAEL F,etal..Adaptive color attributes for real-time visual tracking [C].IEEEConferenceonComputerVisionandPatternRecognition,Columbus,USA, 2014: 1090-1097.

[9]MA C,HUANG J B, YANG X K,etal..Hierarchical convolutional features for visual tracking [C].InternationalConferenceonComputerVision,Santiago,Chile, 2015: 3038-3046.

[10]PEDRO F, ROSS G, DAVID M,etal..Object detection with discriminatively trained part based models [J].IEEETransactiononPatternAnalysisandMachineIntelligence, 2010, 32(9): 1627-1645.

[11]ZHANG B, EBEID S M, PREVOSTR,etal..Fast solver for some computational imaging problems: a regularized weighted least-squares approach [J].DigitalSignalProcessing, 2014, 27: 107-118.

[12]张雷,王延杰,孙宏海,等. 采用核相关滤波器的自适应尺度目标跟踪[J]. 光学 精密工程, 2016, 24(2): 448-459.

ZHANG L, WANG Y J, SUN H H,etal..Adaptive scale object tracking with kernelized correlation filters [J].Opt.PrecisionEng., 2016, 24(2): 448-459. (in Chinese)

[13]宋策,张葆,尹传历. 适于机载环境对地目标跟踪的粒子滤波设计[J]. 光学精密工程, 2014, 22(4): 1037-1047.

SONG C, ZHAGN B, YIN CH L. Particle filter design for tracking ground targets in airborne environment [J].Opt.PrecisionEng., 2014, 22(4): 1037-1047. (in Chinese)

[14]BERNHARD S,ALEXANDER S.LearningwithKernels:SupportVectorMachines,Regularization,Optimization,andBeyond[M]. Massachusetts, the MIT Press, 2002: 184-209.

[15]DALAL N, BILL T. Histograms of oriented gradients for human detection [C].IEEEConferenceonComputerVisionandPatternRecognition,SanDiego,USA, 2005: 886-893.

[16]JIANG Y S, MA J W. Combination features and models for human detection [C].IEEEConferenceonComputerVisionandPatternRecognition,Boston,USA, 2015: 240-248.

[17]SAM H, AMIR S,PHILIP H. Struck: Structured output tracking with kernels [C].InternationalConferenceonComputerVision,Barcelona,Spain, 2011: 263-270.

[18]THANG B, NAM V, GERARD G M. Context tracker: exploring supporters and distracters in unconstrained environments [C].IEEEConferenceonComputerVisionandPatternRecognition,ColoradoSprings,USA, 2011: 1177-1184.

[19]BORIS B, YANG M H, SERGE J B.Visual tracking with online multiple instance learning [C].IEEEConferenceonComputerVisionandPatternRecognition,Miami,USA, 2009: 983-990.

王春平(1965-),男,陕西汉中人,教授,博士生导师,主要从事图像处理、火力控制理论与应用方面的研究。E-mail:wchp17@139.com

王暐(1989-),男,甘肃靖远人,博士研究生,2010年于北京航空航天大学获得学士学位,主要从事计算机视觉、嵌入式系统设计方面的研究。E-mail:wang_wei.buaa@163.com

(版权所有未经许可不得转载)

Scale adaptive kernelized correlation filter tracking based on HHS-OG feature

WANG Chun-ping, WANG Wei*, LIU Jiang-yi, FU Qiang, XU Yan

(The2ndDepartment,OrdnanceEngineeringCollege,Shijiazhuang050003,China)*Correspondingauthor,E-mail:wang_wei.buaa@163.com

Since Kernelized Correlation Filters (KCF)tracking algorithm is sensitive to feature selecting and unable to estimate object scale, this paper researches the KCF tracking algorithm based on feature extraction and scale adapting. A scale adaptive KCF tracker by using HHS-OG (Histogram of Hue Saturation and Oriented Gradient, HHS-OG) feature was proposed to improve the tracking performance of the KCF tracker. Firstly, the HSI color space was studied. By taking the complementary of color and gradient in an image, a novel HHS-OG feature focused color and gradient features was proposed to improve the discrimination ability of the KCF algorithm to backgrounds and targets. As the KCF algorithm is unable to process the changed scale, a set of scale factors were used to sample image patches in the detection stage of tracking and the generated corresponding filter response maps were used to estimate the optimal target position and scale. The proposed tracker was tested on a large tracking benchmarks with 50 video sequences. Experimental results show that the tracker runs at a high speed of 37.5 frame per second and has a significantly improvement of 5.4% in representative precision score and 10.1% representative success score. The HHS-OG feature has good discrimination ability for backgrounds and targets and has robustness for target tracking. The scale adaptive strategy is effective for improving tracking performance.

vision tracking; kernel correlation filter tracking; feature fusion; feature extraction; scale adaptive tracking

2016-05-13;

2016-07-12.

国家自然科学基金资助项目(No.61141009)

1004-924X(2016)09-2293-09

TP391

A

10.3788/OPE.20162409.2293