深度学习及其在医学图像分析中的应用研究

王媛媛,周 涛,吴翠颖

(宁夏医科大学 a.公共卫生与管理学院; b.理学院,宁夏 银川 750004)

深度学习及其在医学图像分析中的应用研究

王媛媛a,周涛b,吴翠颖a

(宁夏医科大学 a.公共卫生与管理学院; b.理学院,宁夏 银川 750004)

深度学习被引入机器学习领域与大数据的完美结合加快了人工智能实现的步伐,近年来备受学术界和工业界的广泛关注。从深度学习的3种经典模型出发,主要做了5方面的工作:第一,针对深度信念网络,从网络结构(隐含层数、RBM结构、DBN级联),学习算法(基本算法、优化算法与其他方法结合),硬件系统(GPU,FPGA)三个方面进行总结;第二,针对卷积神经网络,从网络结构(输入层、隐含层、CNN个数),学习算法,硬件系统三个方面进行归纳;第三,针对堆栈自编码器,以时间为轴对其发展进行梳理,阐述相应自编码器的方法改进;第四,从医学图像分割、医学图像识别和计算机辅助诊断3个方面详细探讨深度学习在医学图像分析领域中的应用;最后从大数据浪潮、模型构建、特征学习、应用拓展4个方面对深度学习的发展进行展望。

深度学习;深度信念网络;卷积神经网络;堆栈自编码器;医学图像

深度学习是机器学习领域中一系列试图使用多重非线性变换对数据进行多层抽象的算法,不仅学习输入和输出之间的非线性映射,还学习输入数据向量的隐藏结构[1],以用来对新的样本进行智能识别或预测。20世纪80年代末期,用于人工神经网络的反向传播算法的发明掀起了基于统计模型的机器学习热潮,20世纪90年代,浅层学习掀起机器学习的第一次浪潮,这些浅层结构虽然相比于过去基于人工规则的系统展现了很大的优越性,但对于处理复杂的问题,表现出特征学习能力不足、维数灾难、易陷入局部最优等缺点。针对上述问题,2006年,Hinton在《Science》上首次提出“深度学习”并掀起了机器学习的第二次浪潮,多隐层的网络具有优异的特征学习能力,学习得到的特征对数据有更本质的刻画。2012年《纽约时报》披露了Google Brain项目,该项目用16 000个CPU Core的并行计算平台训练“深度神经网络”,在语音识别和图像识别中得到成功应用;2013年机器学习国际会议就音频、语音和视觉信息处理的学习结构、表示和最优化等方面进行讨论[2];4月,《MIT Technology Review》杂志将深度学习列为2013年十大突破性技术之首;2013年百度成立了深度学习研究院,并实施“百度大脑”计划;2015年,中科曙光推出深度学习一体机,并联合中科院计算技术研究所和NVIDIA公司成立深度学习实验室;深度学习在神经影像学[3]方面的突破对于医学领域的发展至关重要。

鉴于深度学习优异的特征学习能力和实际应用价值,本文主要总结了深度学习的三种模型:深度信念网络(Deep Belief Network,DBN)、卷积神经网络(Convolutional Neural Network,CNN)、堆栈自编码器(Stacked Autoencoder,SAE)。针对DBN,CNN主要从网络结构、学习算法和硬件系统三方面综述研究进展,针对SAE以时间为轴梳理发展过程;然后对深度学习在医学图像分析领域中的应用进行详细总结,最后从大数据浪潮、模型构建、特征学习、应用拓展四个方面对深度学习未来的发展进行展望。

1 深度信念网络(DBN)

1.1基本原理

DBN是无监督学习下的深度结构概率生成模型,由多层神经元构成,显性神经元用于接受输入,隐性神经元用于提取特征,每一层从前一层的隐含单元捕获高阶数据的相关性。DBN的基本组成块是受限玻尔兹曼机(RBM),层间单元是全连接关系,层内单元之间没有连接关系。

RBM在给定模型参数θ条件下,可以使用能量函数来表示RBM中的可视单元v和隐层单元h的联合分布

P(v,h;θ)=exp(-E(v,h;θ))/z(θ)

(1)

(2)

式中:P(v,h;θ)为玻尔兹曼分布函数;z(θ)是一个归一化因子;θ={ωij,bi,aj}。对于一个伯努利(可视)-伯努利(隐藏)RBM,其能量函数可定义为

(3)

条件概率可以表示为

(4)

(5)

其中:ωij为可视单元和隐单元的连接权值;bi和aj分别是对应偏置量,i和j为可视单元和隐层单元的数目;激励函数一般是sigmoid函数。

1.2DBN改进

DBN作为一种无监督特征学习复杂层次概率模型的方法,目前主要集中在网络结构、学习算法、硬件系统3个方面的改进研究,如图1所示。

图1 深度信念网络的改进

1.2.1网络结构

深度信念网络是由RBM堆叠而成,那么RBM的堆叠个数和结构的改变会构建不同的DBN,并且多个DBN级联也会影响其性能。

1) 在DBN隐含层数的确定方面,目前主要依赖于先验知识,其缺点是主观性大,时间复杂度高。李晋徽提出瓶颈深度信念网络[4],设定一个奇数层的多层神经网络且最中间的神经元个数最少的一层作为瓶颈层,然后去除瓶颈层之后的网络,原来的瓶颈层作为输出层;潘光源[5]证明了RBM重构误差与网络能量的正相关定理,根据隐含层和误差的关系,提出一种基于重构误差的网络深度判断方法。

2)在DBN模型结构方面的研究主要是基于RBM结构的改进。期望能量受限波尔兹曼机[6]是将RBM函数逼近的学习性能通过负预期能量代替负自由能量计算输出;数值属性的DBN是在sigmoid单元中增加噪声将输入缩放到[0,1]区间,避免一般的输入二值向量造成的信息丢失使分类效果降低的现象;卷积深度信念网络是引入局部感受野和卷积操作,具有平移不变性并支持高效的自下而上和自上而下的概率推理;因素四通道条件限制玻尔兹曼机[7]即一个新标签层和来自不同层的神经元结合建立四通道,实现回归和分类。

3)在DBN级联方面,深度信念网络和级联去噪自编码器结合,即前两层用去噪自编码实现,中间两层用受限玻尔兹曼机来实现,最后用逻辑斯特层作为分类层;Ping Liu提出由一组DBN构成的BDBN(Boosted DBN)[8]框架使得特征学习、特征选择和分类器重建统一成一个循环的过程,特征被联合微调同时被选择形成一个强大的分类器。

1.2.2学习算法

DBN的学习过程包括无监督预训练和有监督微调,学习算法是实现特定目标任务的基础,本文从DBN基本学习算法、优化算法和与其他算法的结合三方面进行阐述:

1)在基本学习算法方面,2006年,Hinton教授提出高效的RBM近似学习算法(CD)[9],即将原始RBM的学习算法中的概率分布差异度量用一个近似的概率分布差异度量取代;2008年Tijmen Tieleman[10]提出了PCD学习算法,既保持了CD的学习效率又具备更强的模式生成能力,随后提出的快速持续对比散度算法,加快了运行速度;2009年开始出现了一系列基于回火的马尔科夫链蒙特卡罗采样算法的RBM学习算法,为学习率和无监督训练提供了高可靠性和强鲁棒性;赵彩光[11]结合指数平均数指标算法和并行回火的思想改进CD训练算法;Noel Lopes[12]提出了一种自适应步长技术以提高对比发散算法的收敛性。

2)对于优化算法,其目的在于提高DBN的整体性能。L1和L2两个不同正则项的选择性应用[13]可确保表示的稀疏性和泛化能力;经粒子群优化的DBNs模型可获得更好的函数逼近效果;加入共轭梯度算法可加速训练;基于连续判别训练准则优化DBN权值、状态变换参数及语言模型分数,使得DBN性能优于基于框架准则的DBN;稀疏响应DBN[14]即数据的分布和由DBN的构建块中定义的平衡分布之间的Kullback-Leibler散度(相对熵)被视为失真函数,并且稀疏响应正则化诱导L1范数代码被用来实现一个小代码率进行多层次的抽象特征提取。

3) DBN与其他方法的结合表现在结合预处理方法、特征提取方法和分类器。对图像进行归一化处理输入模型中;对图像提取特征如LBP或进行Gabor小波变换并编码作为输入,从而学习数据更本质的特征;输出层与其他分类器结合达到良好的识别效果。有判别力的限制玻尔兹曼机与线性变换结合[15]用于不变模式的识别,特征提取和模式分类同时实现;极限学习机(ELM)[16]运用到 DBN 模型的训练中,既保证学习准确性又提高学习速度。

1.2.3硬件系统

深度学习模型结构的复杂化必须以计算机硬件为基础。高度可扩展的图形处理单元(GPU)[12]并行执行CD-K算法,加快了训练速度;面向计算机集群的分布式内存计算方法[17]提升深度学习技术并行化学习效率;以多个副本异步并行计算的方式进行深度信念网络模型训练,明显提高深度神经网络的训练效率,并具备良好的可扩展性。

2 卷积神经网络(CNN)

2.1基本原理

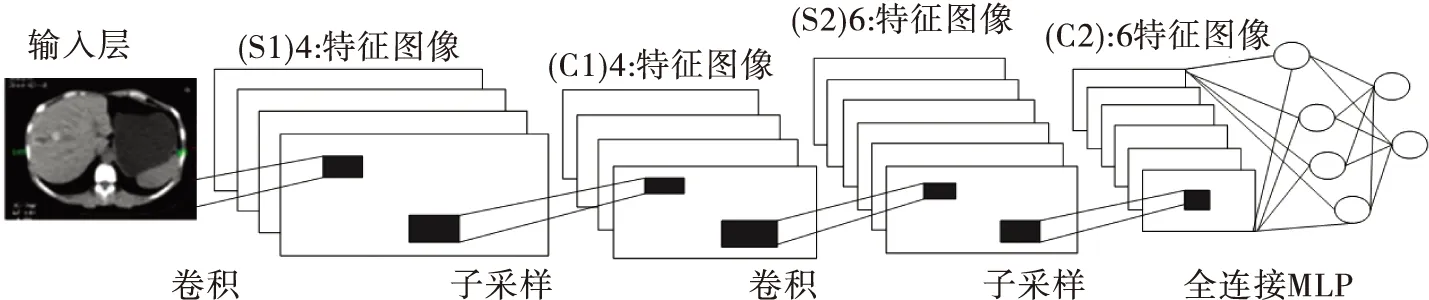

CNN是一种有监督学习的深度学习模型(如图2所示),包含卷积层和子采样层两种特殊的结构层,通过结合局部感受野、权值共享、时间或空间亚采样来实现对输入数据的位移变化、尺度变化、形变变化的不变性。

图2 卷积神经网络的整体结构

卷积神经网络的隐藏层是特征提取的核心,在卷积层,每个神经元的输入与前一层的局部感受野相连,并提取该局部的特征。卷积层的形式

(6)

其中:I代表层数;Mj代表输入层的感受野;b代表偏置。在下采样层,输入的特征图经过池化后其个数不变,输出特征图大小为原图一半,下采样层的形式

(7)

其中:p(·)为下采样函数;β为权重系数;b为偏置系数。

2.2CNN改进

卷积神经网络在二维图像识别中展现了良好的容错能力、并行处理能力和自学习能力,但其训练时间过长,训练速度过慢,本文从网络结构、学习算法和硬件系统3个方面对CNN的改进进行总结(如图3所示)。

图3 卷积神经网络的改进

2.2.1网络结构

多输入卷积神经网络结构[18]将原数据样本梯度信息(水平梯度、垂直梯度、两个对角梯度)同时输入卷积神经网络,能更充分利用原始数据中隐含的特征表达;渐进式网络扩展结构通过不断调整训练集来改变网络结构,尤其加强训练分类错误的数据集,从而提高分类精度;自适应级联卷积深层神经网络[19]用高斯分布来表示预测位置和真实位置的距离达到人脸校准,降低了复杂性、增加了稳健性;三维卷积神经网络模型[20]通过在空间和时序上运用三维卷积提取特征,基于输入帧生成多个特征图通道,将所有通道的信息结合获得最后的特征表示;多重卷积神经网络是由多个高识别率的小卷积神经网络组成,易于调节参数,可扩展性强。

2.2.2学习算法

对于优化算法,在CNN的全连接层引入Dropout或DropConnect防止过拟合现象;采用纠正线性单元(Relu)[21]函数代替常用的sigmoid、使用随机对角算法优化训练提高网络收敛速度;基于Fisher准则[22]的深度学习算法在保持样本类内距离小、类间距离大的同时也考虑误差的最小化,使权值能更加快速地逼近有利于分类的最优值,降低了时间复杂度并达到较好的识别效果。CNN在分类识别过程中与视觉注意模型、多尺度滑动窗口有效结合先对物体定位;与SVM[23]、随机森林、径向基网络、Softmax分类器结合,挖掘本质信息再直接智能识别;在CNN中引入了递归神经网络,先通过一级卷积神经网络学习原始图像的组合特征,再通过一级卷积和一级递归神经网络分层提取特征,最后对特征向量进行分类。

2.2.3硬件系统

深度学习性能的提升,需要高计算密度的硬件设备支持。CPU由于其自身特点无法充分地挖掘 CNN内部的并行性;GPU可通过其巨型并行结构以相对低的代价实现高计算量;FPGA即现场可编程门阵列作为一种计算密集型加速部件,通过将算法映射到FPGA上的并行硬件进行加速;将一个深层CNN转换成一个脉冲神经网络(SNN)映射CNN到一个基于Spike的硬件架构[24]比基于FPGA硬件的CNN实施达到两个数量级以上的高效率。

3 堆栈自编码器(SAE)

本文将堆栈自编码器映射在一个二维空间中,纵轴以时间为序探索发展历程,横轴以方法改进作为指针综述相应编码器的进展,具体如图4所示。纵观时间轴的进程:以1986年Rumelhart提出的自动编码器作为起点,2006年Hinton提出堆栈自编码器则是转折点,随后提出稀疏自编码器、降噪自编码器、收缩自编码器、卷积自编码器、拉普拉斯自编码器,每一种编码器又以横轴为向进行改进。

图4 自编码器的改进

2006年Hinton提出堆栈自编码器,它是一种从无类标数据中分层提取输入数据高维复杂的特征,得到原始数据的分布式特征表示并利用无监督逐层贪心预训练和系统性参数优化的多层非线性网络,根据不同任务的需要来调整参数,稳定性、可控性强,具有大规模并行、分布式处理、自组织和自学习的特点。

2007年,Benjio提出稀疏自动编码器,即在自编码的基础上增加稀疏性约束条件,提高表示学习算法的鲁棒性,增强数据的线性可分性,使得信息表述的全面性和准确率得到提高。稀疏自编码器引入卷积神经网络和池操作[25],降低计算成本,减少训练复杂性;在SAE进行无监督特征预训练时引入散射小波变换[26]作为初始信号表示,计算出多阶调制频谱系数,经过预训练、有监督微调进行识别。

2008年,Vincent提出降噪自动编码器,在训练数据中添加腐坏向量,通过最小化降噪重构误差,从含随机噪声的数据中重构真实的原始输入。将加权重建损失函数引入到去噪自动编码器中,构造一种加权去噪自动编码器(WDA)[27]和噪声分类的语音增强的方法;多层降噪自编码器与欠采样局部更新的元代价算法结合[28],有效利用无标签样本、抗噪声的特性,使组合模型具有代价敏感、降低不均衡性。

2010年,Salah提出收缩自动编码器,对升维和降维的过程加以限制,其代价函数为

(8)

其中:λ是反映矩阵正规化程度的活跃参数。收缩自编码模型试图利用隐单元构建一些复杂非线性流形模型,由于原理复杂,构建和训练模型难度较大,近年来对其研究较少。

2011年,Masci J提出卷积自动编码器,学习图像局部特征,通过权重实现共享,并添加卷积和池化操作,保留数据的空间位置信息。在堆叠卷积自动编码器中引入自引导学习[29]并结合强大的时间缓慢约束从大量序列图像块中学习恒定表示以提高学习表示能力;堆叠的局部卷积自编码器[30]利用贪婪逐层策略训练堆叠的局部卷积自编码器,梯度下降法用于训练各个层,输入数据的表示视为对象特征,从而提高了3D对象检索性能。

2012年,Taylor深入探讨了SAE与无监督特征学习之间的联系,阐述如何利用自动编码器来构建不同类型深度结构。2013年Telmo研究了用不同代价函数训练SAE的性能,为代价函数优化策略的发展指明方向。2015年,Kui Jia提出一种新的无监督流形学习方法—拉普拉斯自动编码器(LAE)[31],从正则函数的学习框架出发,使学到的编码功能在数据点的局部有防腐性能,具有更好的泛化能力,当训练样本稀缺时,LAE优于其他自编码器。

4 深度学习在医学图像分析中应用

基于深度学习模型结构和学习算法的不断优化,深度学习医学图像分析方面应用广泛,本文主要从医学图像分割、识别、计算机辅助诊断三方面进行总结,以期为临床医护人员提供参考和帮助,也为辅助医疗和智慧医疗提供便利。

4.1医学图像分割

在医学图像分割方面,将深度学习算法与其他算法结合使用,CNN和连通分量算法结合用于扫描电镜图像分割,与随机森林结合用于神经细胞图像分割,基于超像素和卷积神经网络的方法用于宫颈癌细胞的分割;基于导数和深度学习架构的检索方法对心脏超声图像的左心室分割进行研究。深度卷积神经网络用于多模态同强度的婴儿脑部图像的分割[32],三维CNNs对多模态图像特征提取后对MRI脑肿瘤、膝关节软骨进行分割都取得了进步,作用于MR图像的前列腺分割对于诊断前列腺癌和前列腺癌的放射治疗意义重大。

4.2医学图像识别

在医学图像分类识别中,将深度信念网络用于脑电图数据表现的积极和消极的情感分类;利用深度学习对基于超声造影的良性和恶性肝脏局灶性病变进行分类[33],展现了准确性、敏感性和特异性上的优越性;基于子集[34]的深度学习用于RGB-D对象识别,原始RGB-D图像划分为若干子集,从中学习更高级别的特征被级联为最终特征进行分类,其精度显著提高。限制玻尔兹曼机[35]的概率模型用于神经影像学的检查以此来识别固有网络,适用于分层和多模态的扩展数据,为今后的神经影像学研究提供了前景;卷积深度信念网络考虑到频域空间变换数量的最小化[36],开辟了深度学习在三维图像分析领域新的方向。

4.3计算机辅助诊断

在计算机辅助诊断方面,利用深度学习算法对前列腺病理图像组织来源进行判断、根据X光片和胸片的集群微钙化表现检测乳腺癌、利用卷积神经网络对小细胞型肺癌辅助检测都取得了较高的检测率。利用深度玻尔兹曼机从PET/MRI多模态融合图像中挖掘高层次潜在特征,对AD和MCI的诊断准确率可高达95.35%,85.67%[37];CNN用于胸片中胸管的检测,得到了99.99%的准确度和特异性,开启了深度学习用于人造物体检测的先例[38];将降噪自编码器用于从不完整的脑电图EEG进行特征学习,使用Lomb-Scargle周期图对不完整EEG频谱能量进行评估[39];中科院金林鹏[40]提出导联卷积神经网络,并利用“平移起始点”和“加噪”增加训练样本数,构造了心电图分类模型,并取得83.66%的准确率。

5 深度学习研究展望

1)大数据潮流。随着大数据时代的来临和存储技术的发展,如何从海量数据中挖掘信息至关重要,所以充分利用大量的无标记数据、无监督地进行特征学习赋予了深度学习无限的发展潜力,“大数据+深度模型”将成为未来的研究方向。

2)模型构建。深度学习模型是具有多层隐含层的人工神经网络,但并不是隐含层越多越好,网络层数的确定和激活函数的选择值得探讨,并且随着模型复杂度的不断增加,如何衡量训练复杂度和任务复杂度的关系、如何权衡模型规模与训练速度、训练精度之间的关系都是深度学习研究的方向。

3)特征学习。深度学习的“深度模型”是手段,“特征学习”则是目的,有效的训练算法和连续的优化策略、网络结构参数设定和优化对于特征选择极其重要,算法自身和硬件系统的改进、与其他方法的融合、结合复杂推理表示学习系统、操作大量向量的新范式来代替基于规则的字符表达式操作等,都是特征学习能力提升的表现。

4)应用拓展。深度学习的广泛应用将催生出多个领域的变革和跨越式发展,作为新一代信息科学的主流方法,在图像识别、语音识别、计算机视觉等方面取得进步的同时更应拓宽应用范围,对于智能设备、无人驾驶汽车、机器人等领域具有非常广阔的应用前景,尤其对于医学图像的分析和计算机辅助诊断具有直接的现实意义。

6 总结

深度学习已引起了各领域研究人员的广泛关注,本文从深度学习的基本理论和医学领域的应用出发,详细阐述了深度信念网络、卷积神经网络在网络结构、学习算法和硬件系统3方面的研究进展和堆栈自编码器随时间发展的不断改进,并从医学图像的分割、识别和计算机辅助诊断3方面总结了深度学习在医学图像分析领域中的广泛应用,最后从大数据浪潮、深度模型构建、特征学习能力提升、应用拓展4个方面对深度学习未来的发展进行展望。总之,借助大数据的潮流,结合深度学习自身潜力,争取在医学领域取得更大的进步并早日实现人工智能的初衷。

[1]AREL I,ROSE D C, KARNOWSKI T P. Deep machine learning-A new frontier in artificial intelligence research[J].Computational intelligence magazine,2010,5(4):13-18.

[2]MARKOFF J. Scientists see promise in deep-learning programs[N].The New York Times,2012-11-23.

[3]PLIS S M ,HJELM D R,SALAKHUTDINOV R,et al. Deep learning for neuroimaging: a validation study[J].Frontiers in neuroscience,2014(8):229.

[4]李晋徽,杨俊安,王一.一种新的基于瓶颈深度信念网络的特征提取方法及其在语种识别中的应用[J].计算机科学,2014,41(3):263-266.

[5]潘广源,柴伟,乔俊飞. DBN网络的深度确定方法[J].控制与决策,2015,30(2):256-260.

[6]ELFWING S,UCHIBE E,DOYA K.Expected energy-based restricted Boltzmann machine for classification[J]. Neural networks,2015(64):29-38.

[7]MOCANU D C,AMMAR H B.Factored four way conditional restricted Boltzmann machines for activity recognition[J].Pattern recognition letters,2015(66):100-108.

[8]LIU P,HAN S Z,MENG Z B,et al. Facial expression recognition via a boosted deep belief network[C]//Proc. the 2014 IEEE Conference on Computer Vision and Pattern Recognition.[S.l.]:IEEE,2014:1805-1812.

[9]HINTON G. Training products of experts by minimizing contrastive divergence[J].Neural computation,2006,14(8):1771-1800.

[10]TIELEMAN T.Training restricted Boltzmann machines using approximations to the likelihood gradient[C]//Proc. the 25th International Conference on Machine learning. [S.l.]:IEEE,2008:1064-1071.

[11]赵彩光,张树群,雷兆宜. 基于改进对比散度的GRBM语音识别[J].计算机工程,2015,41(5):213-218.

[12]LOPES N,RIBEIRO B.Towards adaptive learning with improved convergence of deep belief networks on graphics processing units[J].Pattern recognition,2014,47(1):114-127.

[13]MANSANET J,ALBIOL A,PAREDES R,et al. Mask selective regularization for restricted Boltzmann machines[J]. Neurocomputing,2015,165:375-383.

[14]JI N N,ZHANG J S,ZHANG C X. A sparse-response deep belief network based on rate distortion theory[J]. Pattern recognition,2014,47(9):3179-3191.

[15]JI N N,ZHANG J S,ZHANG C X,et al. Discriminative restricted Boltzmann machine for invariant pattern recognition with linear transformations[J].Pattern recognition letters,2014,45(1):172-180.

[16]YU W C,ZHUANG F Z,HE Q, et al. Learning deep representations via extreme learning machines[J]. Neurocomputing,2015,149:308-315.

[17]李抵非,田地,胡雄伟. 基于分布式内存计算的深度学习方法[J].吉林大学学报(工学版),2015,45(3):921-925.

[18]费建超,芮挺,周遊,等.基于梯度的多输入卷积神经网络[J].光电工程,2015,42(3):33-38.

[19]DONG Y,WU Y. Adaptive cascade deep convolutional neural networks for face alignment [J]. Computer standards & interfaces,2015(42):105-112.

[20]JI S,XU W,YANG M,et al. 3D convolutional neural networks for human action recognition[J]. Pattern analysis and machine intelligence,2013,35(1):221-231.

[21]SAINATH T N ,KINGSBURY B. Deep convolutional neural networks for large-scale speech tasks[J]. Neural networks,2015(64):39-48.

[22]孙艳丰,齐光磊,胡永利,等.基于改进Fisher准则的深度卷积神经网络识别算法[J].北京工业大学学报,2015,41(6):835-841.

[23]NIU X X,SUEN C Y. A novel hybrid CNN-SVM classifier for recognizing handwritten digits[J].Pattern recognition,2012,45(4):1318-1325.

[24]CAO Y Q,CHEN Y,KHOSLA D.Spiking deep convolutional neural networks for energy-efficient object recognition[J].International journal of computer vision,2015,113(1):54-66.

[25]SU S Z,LIU Z H,XU S P,et al. Sparse auto-encoder based feature learning for human body detection in depth image[J].Signal processing,2015(112):43-52.

[26]LI S Z,YU B,WU W,et al.Feature learning based on SAE-PCA network for human gesture recognition in RGBD images[J]. Neurocomputing,2015(151):565-573.

[27]XIA B Y,BAO C C.Wiener filtering based speech enhancement with weighted denoising auto-encoder and noise classification[J].Speech communication,2014,60(2):13-29.

[28]胡帅,袁志勇,肖玲,等. 基于改进的多层降噪自编码算法临床分类诊断研究[J].计算机应用研究,2015,5(32):1417-1420.

[29]KUEN J,LIM K M,LEE C P. Self-taught learning of a deep invariant representation for visual tracking via temporal slowness principle[J].Pattern recognition,2015,48(10):2964-2982.

[30]LENG B,GUO S,ZHANG X Y,et al. 3D object retrieval with stacked local convolutional autoencoder[J]. Signal processing,2015(112):119-128.

[31]JIA K,SUN L,GAO S H,et al. Laplacian auto-encoders: an explicit learning of nonlinear data manifold[J]. Neurocomputing,2015(160):250-260.

[32]ZHANG W L,LI R J,DENG H T,et al. Deep convolutional neural networks for multi-modality isointense infant brain image segmentation[J]. NeuroImage,2015(108):214-224.

[33]WU K Z,CHEN X,DING M Y. Deep learning based classification of focal liver lesions with contrast-enhanced ultrasound[J].Optik-international journal for light and electron optics,2014,125(15):4057-4063.

[34]BAI J,WU Y,ZHANG J M,et al. Subset based deep learning for RGB-D object recognition[J]. Neurocomputing,2015(165):280-292.

[35]HJELM R D,CALHOUN V D,SALAKHUTDINOV R,et al. Restricted Boltzmann machines for neuroimaging:an application in identifying intrinsic networks[J]. NeuroImage,2014,96(8):245-260.

[36]BROSCH T,TAM R. Efficient training of convolutional deep belief networks in the frequency domain for application to high-resolution 2d and 3d images[J].Neural computation,2015,27(1):211-227.

[37]SUK H-I,LEE S-W,SHEN D G. Hierarchical feature representation and multimodal fusion with deep learning for AD/MCI diagnosis[J]. NeuroImage,2014(101):569-582.

[38]MERCAN C A,CELEBI M S. An approach for chest tube detection in chest radiographs[J]. Image processing,2014,8(2):122-129.

[39]LIA J H, STRUZIKA Z,ZHANGB L,et al. Feature learning from incomplete EEG with denoising autoencoder[J]. Neurocomputing,2015(165):23-31.

[40]金林鹏,董军. 面向临床心电图分析的深层学习算法[J].中国科学:信息科学,2015,45(3):398-416.

责任编辑:闫雯雯

Research on deep learning and application on medical image

WANG Yuanyuana, ZHOU Taob, WU Cuiyinga

(a.SchoolofPublicHealthandManagement;b.SchoolofScience,NingxiaMedicalUniversity,Yinchuan750004,China)

Deep learning is introduced to the machine learning field and made it more close to artificial intelligence with the big data,in recent years it receives extensive attention from academia to the industry.In this paper, five aspects of work about deep learning are done. Firstly,it describes three parts including model structure(hidden layer,the structure of RBM,the number of DBN),learning algorithms(basic algorithms,optimization algorithm, methods combination)and hardware(GPU,FPGA) about deep belief network. Secondly, it also reviewes model structure(input layer,hidden layer,output layer),learning algorithms and hardware about convolutional neural network.Thirdly, it introduces the development of stacked autoencoder according to the timeline.Fourthly, application of deep learning focused on medical image analysis is discussed,including medical image segmentation,recognition and computer aided diagnosis.Finally,the development orientation is forecasted concentrated on big data,model building,feature extraction and application extension.

deep learning;deep belief network;convolutional neural network;stacked autoencoder;medical image

TN911.73

ADOI: 10.16280/j.videoe.2016.10.024

国家自然科学基金项目(81160183;61561040);宁夏自然科学基金项目(NZ12179;NZ14085);宁夏高等学校科研项目(NGY2013062)

2015-11-26

文献引用格式:王媛媛,周涛,吴翠颖. 深度学习及其在医学图像分析中的应用研究[J].电视技术,2016,40(10):118-126.

WANG Y Y,ZHOU T,WU C Y. Research on deep learning and application on medical image [J]. Video engineering,2016,40(10):118-126.