运动目标的自动选取与跟踪

罗 菁,牛 莹,修春波,魏世安

(天津工业大学电气工程与自动化学院,天津 300387)

运动目标的自动选取与跟踪

罗菁,牛莹,修春波,魏世安

(天津工业大学电气工程与自动化学院,天津300387)

为了提高连续自适应均值漂移跟踪方法在复杂背景中的跟踪性能,提出一种基于显著性色度特征的运动目标自动选取及跟踪方法.利用高斯混合模型确定出目标模板,根据目标模板与其背景区色度直方图的对比确定出目标的显著性色度等级,将目标模板中具有显著性色度等级的区域确定为跟踪目标.根据跟踪目标的色度直方图模型利用反向投影建立跟踪图像的概率分布图,采用自适应均值漂移方法实现目标跟踪.仿真结果表明:该方法能够有效提取目标的显著性色度等级,从而确定出易于区分背景的跟踪目标,可有效抑制背景对目标跟踪的影响,改善复杂背景情况下目标跟踪的性能,单帧平均跟踪时间小于15 ms,满足跟踪系统实时性的要求.

运动目标;自动选取;目标跟踪;显著性;复杂背景;直方图

运动目标的检测与跟踪是机器视觉研究的重要方向之一,在军事、工业、安防等各领域有着广泛的应用前景[1-3].现有的目标跟踪方法大多根据目标图像在时间和空间上的位置信息实现目标的定位跟踪.一般来说,跟踪系统对跟踪方法的实时性有着严格的要求,也就是要求跟踪方法同时具有运算速度快和识别准确性高的特点,这对跟踪算法的设计提出了较高的性能要求[4-6].MeanShift算法由于具有无需参数以及模式匹配快速的特性得到了研究者的关注,并获得了良好的应用效果.但当目标在跟踪过程中出现明显的尺寸变化时,该方法容易造成跟踪失败[7-8].而Camshift方法能够自适应调整目标尺寸,满足目标尺寸变化的跟踪要求[9].但这2类方法都适用于目标与背景对比明显的情况.当背景复杂、目标与背景对比度较低时,这2类方法的跟踪性能很不稳定[10-12].而在实际的目标跟踪过程中,初始目标的选取一般人为设定,不一定能够满足目标与背景对比度的要求[13].由于目标颜色与背景颜色的可分性直接影响着CamShift方法的跟踪效果,当搜索窗口中包含背景颜色信息时,传统方法会将属于背景的像素误判为目标像素,从而产生跟踪误差,并且随着误差的积累,最终导致跟踪失败[14-16].因此,建立易于区分的目标模型是降低背景干扰,提高目标跟踪性能的有效手段.

本文提出一种基于显著性色度特征的目标自动选取跟踪方法,利用高斯混合模型确定出目标模板,通过目标直方图与背景直方图的对比进行目标显著区域的自动定位,从而确定出具有显著性色度特征的跟踪目标,抑制背景干扰,提高目标跟踪的可靠性.

1 目标的自动选取与跟踪

利用高斯混合模型建立场景图象的背景模型,从而确定出运动目标区域,即目标模板.高斯混合模型基于背景样本的统计学特性来确定图像的背景区域,实现运动目标区域的检测.

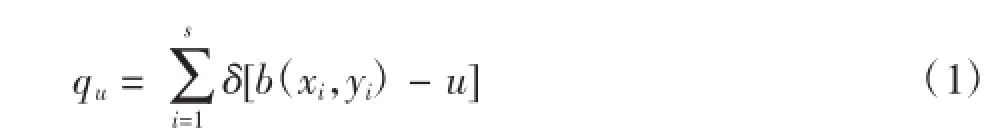

对检测出的目标模板在HSV颜色空间中对H(色度)分量建立直方图模型.设色度特征等级划分为m级,目标的各像素位置坐标为{(xi,yi)},i=1,2,…,s.像素(xi,yi)的色度特征值为b(xi,yi),运动目标区的色度特征直方图模型q={qu},u=1,2,…,m:

式中:δ()为Kronecker函数.以提取出的运动目标区域为中心,向四周扩展一定的区域,成为背景对比区.将背景对比区内的像素色度同样划分为m个等级,设背景对比区中像素的坐标位置为{(xi,yi)},i=1,2,…,t.像素(xi,yi)的色度特征值为b′(xi,yi),由此可建立背景对比区的色度直方图模型p={pu},u=1,2,…,m:

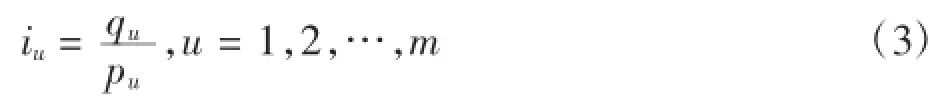

对上述2个区域内所建立的色度直方图的不同色度等级进行对比:

将对比度最大的色度等级确定为显著性色度等级.即如果iv>iθ,则色度等级v即为显著性色度等级,其中iθ为显著性阈值.

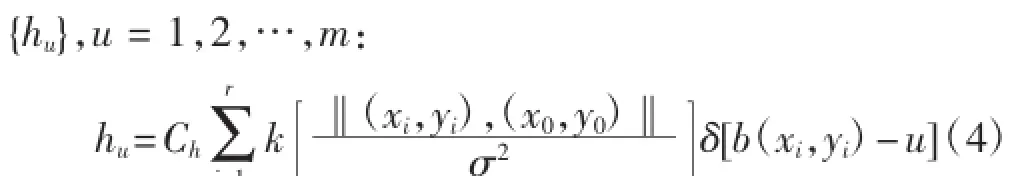

将具有显著性色度等级的像素构成的区域确定为跟踪目标,重建跟踪目标的色度特征直方图模型h=

式中:k()为高斯核函数;Ch为归一化系数;σ为核函数带宽.

i=1

式(4)采用显著性像素建立直方图模型,由于目标的边缘已发生遮挡、形变等变化,而中心区域像素相对稳定,核函数突出了中心区域像素的作用,可有效提高模型对噪声的抗干扰能力.根据重建出的跟踪目标直方图模型进行反向投影,实现选定目标的运动跟踪.

算法具体描述如下:

Step1.利用高斯混合模型实现运动目标区域的检测,确定出目标模板.

Step2.利用式(1)建立目标模板的色度直方图模型.

Step3.将运动目标区域向四周扩展0.1倍边长,成为背景对比区,利用式(2)建立其色度直方图模型.

Step4.利用式(3)确定显著性色度等级.

Step5.利用式(4)重建跟踪目标的色度特征直方图模型.

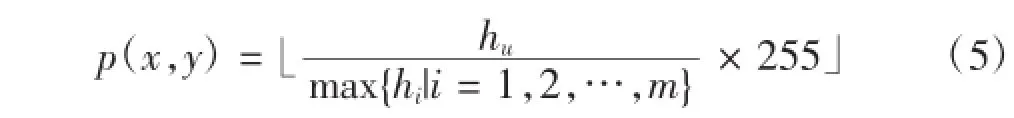

Step6.根据跟踪目标的色度直方图模型进行反向投影,建立起跟踪图像的反向投影概率分布图.设点(x,y)为跟踪图像中色度特征值为u的像素点位置坐标,该点的反向投影概率分布图的灰度值p(x,y)为:

Step7.根据反向投影概率分布图的灰度值,计算搜索床的质心位置,并自适应调整搜索窗长,将搜索窗的中心移至质心位置,重复操作直至完成均值漂移过程.

Step8.根据搜索窗的二阶矩自适应调整跟踪目标区的方向和大小,然后返回Step6对下一帧图像进行目标定位与跟踪.

本文在检测出的运动目标区中进行目标与背景的色度显著性对比分析,确定出易于区分背景的色度等级,并将具有该色度等级的运动目标区域确定为跟踪目标,实现了跟踪目标的自动选取.由于被跟踪目标色度等级与背景差异较大,可有效抑制背景区对目标识别与定位的干扰,有利于提高目标跟踪的稳定性.

2 实验结果与分析

2.1标准测试视频目标跟踪

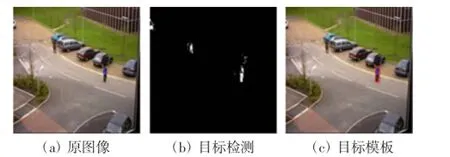

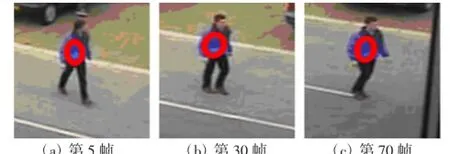

采用PETS2000标准测试库中的test.mov视频中的运动目标进行跟踪对比实验,如图1(a)所示,序列图像中的2个人都是运动目标,采用高斯混合模型得到的运动目标检测结果如图1(b)所示,2个运动目标都能够检测出来.本实验选择面积较大的运动目标进行跟踪,即对右侧的人进行跟踪,目标模板如图1(c)所示.

图1 高斯混合模型实现目标模板检测Fig.1 Target template detection based on Gaussian mixture mode

分别选用传统Camshift跟踪方法、基于多特征融合的Camshift跟踪方法[17]和本文方法分别进行对比跟踪实验.其中,基于多特征融合的Camshift跟踪方法将颜色、边缘和纹理等多种特征进行了自适应融合.

2.1.1传统Camshift跟踪方法

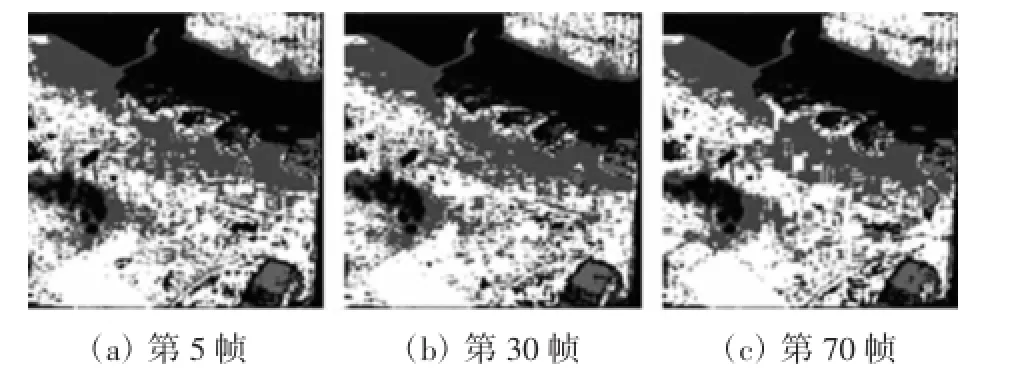

采用传统Camshift跟踪方法所得跟踪结果如图2所示,对应的反向投影概率分布图如图3所示.

图2 传统CamShift跟踪效果Fig.2 Tracking results obtained by basic Camshift method

图3 传统CamShift跟踪方法的反向投影概率分布图Fig.3 Projection images of basic Camshift method

由图2和图3跟踪结果可见,由于所选择的目标模板中包含了部分背景信息,且模板中大量像素的色度与背景区的色度相同,因此在反向投影概率分布图中,目标完全淹没在背景中,在跟踪过程中很快造成目标的丢失.

2.1.2基于多特征融合的Camshift跟踪方法

采用多特征融合的Camshift跟踪方法所得跟踪结果及对应的反向投影概率分布图如图4和图5所示.

由图4和图5可知,跟踪过程中该方法将颜色、边缘和纹理等多个特征进行融合,能够在一定程度上提高模型的精度,有利于改善跟踪性能,但随着跟踪过程的持续进行,由于背景的复杂性,对目标的识别与定位产生误差,误差逐渐累积,最终导致跟踪的失败.

图4 多特征融合CamShift跟踪效果Fig.4 Tracking results obtained by multi-feature fusion Camshift method

图5 多特征融合CamShift跟踪方法的反向投影概率分布图Fig.5 Projection images of multi-feature fusion Camshift method

2.1.3本文方法

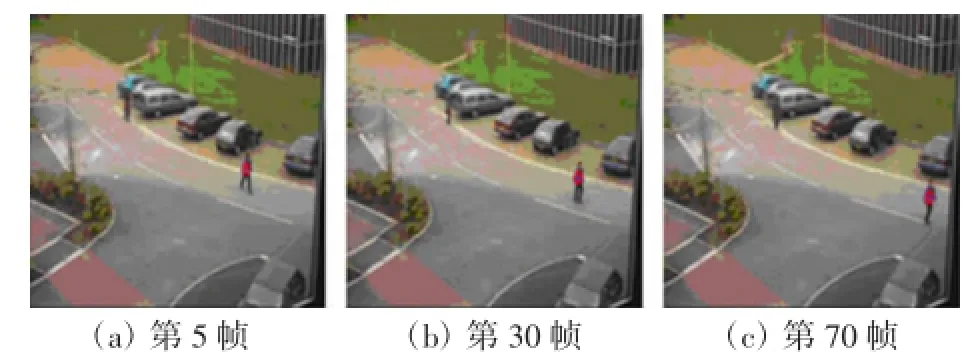

采用本文方法实现跟踪的结果图、反向投影概率分布图及局部放大图如图6、图7和图8所示.

图6 本文跟踪效果Fig.6 Tracking results obtained by our method

图7 本文跟踪方法的反向投影概率分布图Fig.7 Projection images of our method

图8 本文跟踪方法的局部放大图Fig.8 Partial enlarged images of our method

由图6—图8跟踪结果可见,尽管采用高斯混合模型将整个人体都确定为运动目标区,但由于人体下半部与背景的色度相似,因此仅将具有显著性的上半身作为跟踪目标,由反向投影概率分布图可见,跟踪目标的色度与背景的色度具有显著差异,大部分背景区都被有效抑制,即背景区不会对跟踪目标产生干扰,整个跟踪过程都能够对目标实现有效的定位与跟踪.

2.2实际跟踪实验

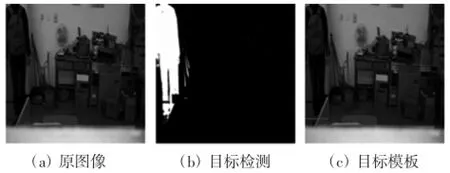

对实验室中实际拍摄的视频图像进行同样的对比跟踪实验,图9为采用高斯混合模型检测出的运动目标区域及目标模板.

图9 高斯混合模型实现目标模板检测Fig.9 Target template detection based on Gaussian mixture mode

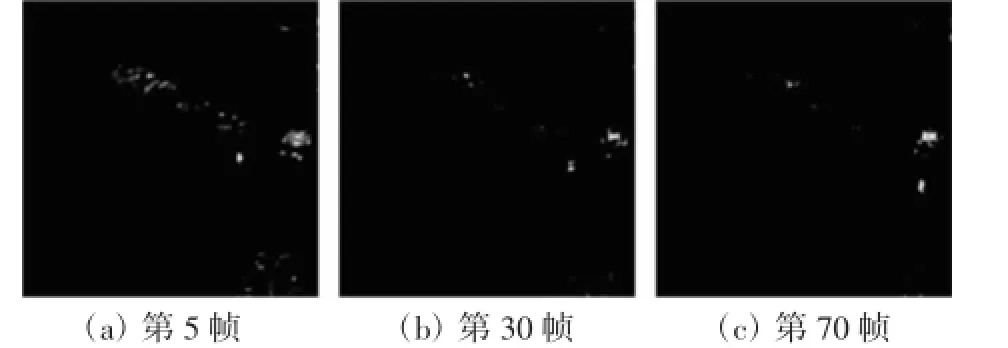

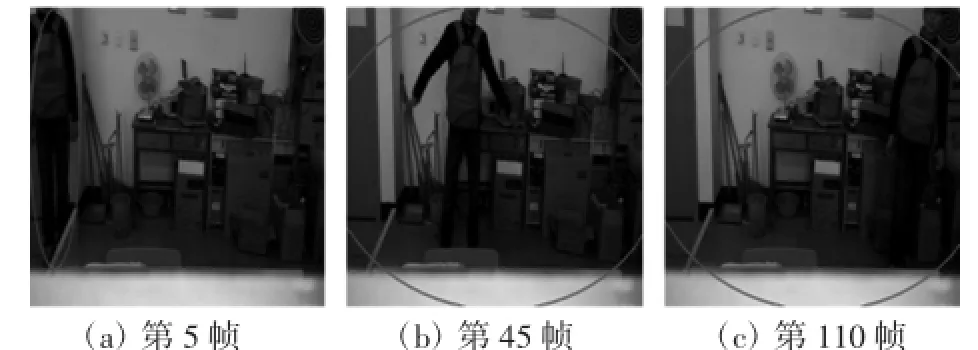

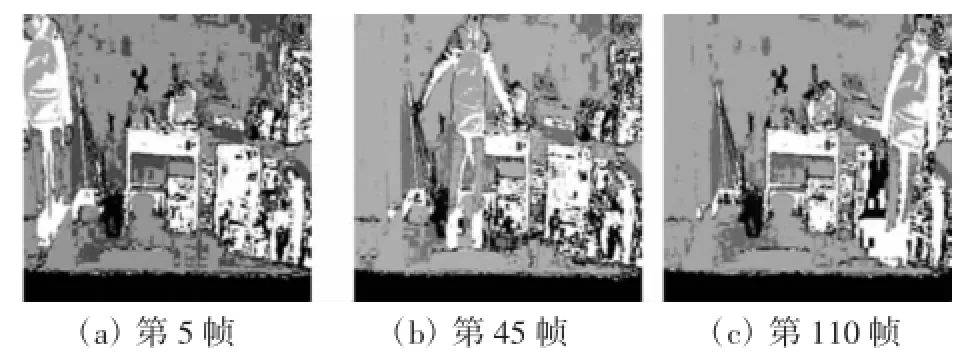

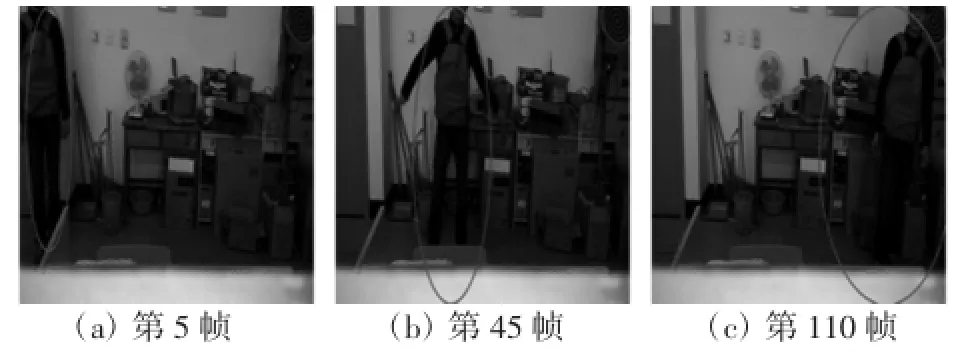

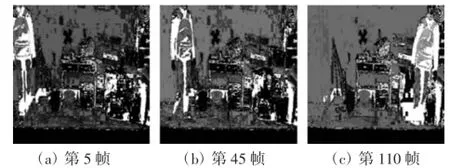

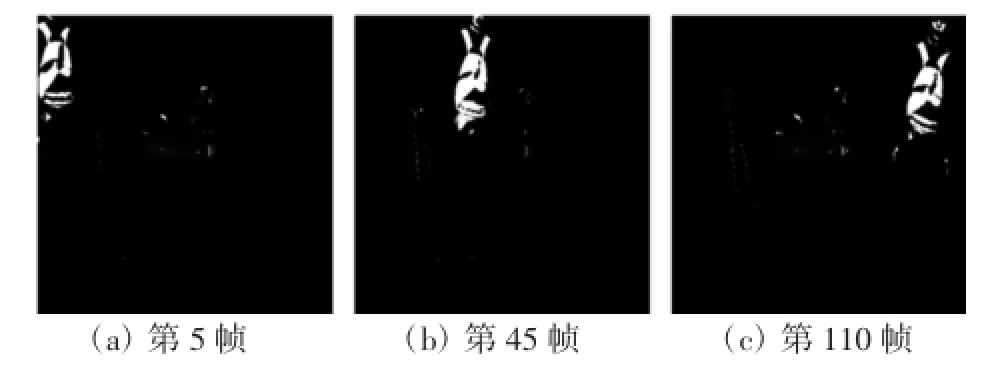

图10—图15分别为采用传统CamShift跟踪方法、多特征融合的CamShift跟踪方法以及本文方法所获得的跟踪结果及对应的反向投影概率分布图.

图10 传统CamShift跟踪效果Fig.10 Tracking results obtained by basic Camshift method

图11 传统CamShift跟踪方法的反向投影概率分布图Fig.11 Projection images of basic Camshift method

图12 多特征融合CamShift跟踪效果Fig.12 Tracking results obtained by multi-feature fusion Camshift method

图13 多特征融合CamShift跟踪方法的反向投影概率分布图Fig.13 Projection images of multi-feature fusion Camshift method

图14 本文跟踪效果Fig.14 Tracking results obtained by our method

图15 本文跟踪方法的反向投影概率分布图Fig.15 Projection images of our method

由图10—图15可见,各种方法所得跟踪结果与标准测试视频中目标跟踪结果一致.由于目标模板中存在与背景色度相似的区域,因此,传统CamShift跟踪方法无法抑制背景对目标识别的干扰,在跟踪初期就造成跟踪失败.而多特征融合的CamShift方法利用所融合的多种辅助特征虽然能够提高目标建模的准确性,但复杂的背景仍然会对目标的定位产生影响,并且定位偏差不断累积变大,最终导致跟踪失败.本文跟踪方法仅选择了目标模板中与背景易于区分的一部分区域作为跟踪目标,能够有效抑制背景对目标定位的干扰,在反向投影概率分布图中表现为大部分背景区域为黑色,即灰度值低,高灰度值的白色区域主要集中在目标区,因此很容易实现目标的准确定位与跟踪.

2.3运算时间对比

上述目标跟踪实验的运算时间对比如表1所示.

表1 单帧平均跟踪运算时间Tab.1 Average tracking time of single frame ms

由表1可见,由于多特征融合方法需要处理所融合的辅助特征,因此计算量较大,运算时间较长.而本文方法由于只利用显著性色度等级进行目标跟踪,而且跟踪结果准确,目标模板尺寸较小,因此针对同样的运动目标,本文方法具有更快的跟踪速度,单帧平均跟踪时间小于15 ms.另外,上述3种方法的单帧平均跟踪运算时间均小于40 ms,都可以满足电视跟踪系统实时性的要求.

3 结语

本文结合高斯混合模型实现了一种跟踪目标的自动选取及跟踪方法,根据目标模板的色度直方图和背景色度直方图的对比,确定模板图像的显著性色度等级,将模板中具有显著性色度等级的区域确定为跟踪目标.利用跟踪目标的直方图模型进行反向投影,能够有效抑制背景信息对目标识别的干扰.仿真实验结果表明,该方法能够有效克服传统CamShift跟踪方法在复杂背景中容易受到背景干扰而造成目标丢失的缺点,目标定位的准确性和稳定性都能够得到明显提升,单帧平均跟踪时间小于15 ms,满足跟踪系统实时性的要求.

[1]黄园刚,桑楠,郝宗波,等.改进CamShift算法的眼动跟踪方法[J].计算机应用研究,2014,31(4):1220-1224. HUANG Y G,SANG N,HAO Z B,et al.Eye tracking method on improved CamShift algorithm[J].Application Research of Computers,2014,31(4):1220-1224(in Chinese).

[2]卢少磊,李强,马天义,等.多阶微分环形模板匹配跟踪方法[J].天津工业大学学报,2012,31(2):65-68. LU S L,LI Q,MA T Y,et al.Circle template matching and tracking algorithm based on multi-order differential information[J].Journal of Tianjin Polytechnic University,2012,31 (2):65-68(in Chinese).

[3]谭琦,肖志涛,耿磊,等.基于多特征的前方车辆实时检测方法[J].天津工业大学学报,2013,32(3):72-77. TAN Q,XIAO Z T,GENG L,et al.Preceding vehicles detecting method based on multiple features[J].Journal of Tianjin Polytechnic University,2013,32(3):72-77(in Chinese).

[4]MALIK M,TARDI T.Gravity optimised particle filter for hand tracking[J].Pattern Recognition,2014,47(1):194-207.

[5] DU C H,ZHU H,LUO L M,et al.Face detection in video based on AdaBoost algorithm and skin model[J].The Journal of China Universities of Posts and Telecommunications,2013,20(S1):6-9.

[6]GUANG D U,ZHANG P.Human-manipulator interface using hybrid sensors with Kalman filters and adaptive multi-space transformation[J].Measurement,2014,55:413-422.

[7] MAZINAN A H,AMIRLATIFI A.Applying mean shift,motion information and Kalman filtering approaches to object tracking[J].ISA Transactions,2012,51(3):485-497.

[8] WANG F L,YU S Y,YANG J.Robust and efficient fragments-based tracking using mean shift[J].AEU International JournalofElectronicsandCommunications,2010,64(7):614-623.

[9]BATTIATO S,FARINELLA G M,FURNARI A,et al.An integrated system for vehicle tracking and classification[J].Expert Systems with Applications,2015,42(21):7263-7275.

[10]李超,刘铁根,刘宏利,等.基于Haar检测和改进的Camshift的人脸跟踪[J].光电子·激光,2011,22(12):1852-1856. LI C,LIU T G,LIU H L,et al.Face detecting based on Harr detection and improved Camshift algorithm[J].Journal of Optoelectronics·Laser,2011,22(12):1852-1856(in Chinese).

[11]YIN M H,ZHANG J,SUN H G,et al.Multi-cue-based CamShift guided particle filter tracking[J].Expert Systems with Applications,2011,38(5):6313-6318.

[12]WANG Z W,YANG X K,XU Y,et al.CamShift guided particle filter for visual tracking[J].Pattern Recognition Letters,2009,30(4):407-413.

[13]BELAROUSSI R,MILGRAM M.A comparative study on face detection and tracking algorithms[J].Expert Systems with Applications,2012,39(8):7158-7164.

[14]马正华,顾苏杭,戎海龙.基于SIFT特征匹配的CamShift运动目标跟踪算法[J].计算机科学,2014,41(6):291-294. MA Z H,GU S H,RONG H L.CamShift moving object tracking algorithm based on SIFT feature points matching[J].Computer Science,2014,41(6):291-294(in Chinese).

[15]冀治航,陈家新,黎蔚,等.基于空间直方图的CamShift目标跟踪算法[J].微电子学与计算机,2009,26(7):194-197. JI Z H,CHEN J X,LI W,et al.Object tracking using CamShift algorithm based on spatiogram[J].Microelectronics& Computer,2009,26(7):194-197(in Chinese).

[16]闫钧华,陈少华,艾淑芳,等.基于Kalman预测器的改进的CAMShift目标跟踪[J].中国惯性技术学报,2014,22(4):536-542. YAN J H,CHEN S H,AI S F,et al.Target tracking with improved CamShift based on Kalman predictor[J].Journal of Chinese Inertial Technology,2014,22(4):536-542(in Chinese).

[17]林建华,刘党辉,邵显奎.多特征融合的Camshift算法及其进一步改进[J].计算机应用,2012,32(10):2814-2816. LIN J H,LIU D H,SHAO X K.Multi-feature fusion Camshift algorithm and its further improvement[J].Journal of Computer Applications,2012,32(10):2814-2816(in Chinese).

Automatic selection and tracking method of motion target

LUO Jing,NIU Ying,XIU Chun-bo,WEI Shi-an

(School of Electrical Engineering and Automation,Tianjin Polytechnic University,Tianjin 300387,China)

In order to improve the tracking performance of the continuously adaptive Mean Shift tracking algorithm in the complex background,an automatic selection and tracking method of the motion target is proposed based on the saliency hue level.Gaussian mixture model is used to determine the target template,and the saliency hue level can be determined by comparing the hue histograms of the target template and the background.The area composed of pixels with the saliency hue level is selected as the tracking target.The probability distribution image of the tracking image can be got according to the hue histogram of the tracking target by the back projection.The continuously adaptive MeanShift tracking algorithm is used to perform the target tracking. Simulation results show that the method can extract the saliency hue level of target,and it is easy to distinguish the target from the background and restrain the information from the background to disturb the target tracking. Thus,the tracking performance can be improved under the complex background.The average tracking time of single frame is less than 15 ms,so the method can meet the real-time requirement of the tracking system.

motion target;automatic selection;target tracking;saliency;complex background;histogram

TP391.4

A

1671-024X(2016)04-0070-05

10.3969/j.issn.1671-024x.2016.04.012