红外图像与可见光图像融合算法研究

蔡铠利,石振刚

(沈阳理工大学 信息科学与工程学院,沈阳 110159)

红外图像与可见光图像融合算法研究

蔡铠利,石振刚

(沈阳理工大学 信息科学与工程学院,沈阳 110159)

红外图像和可见光图像反映不同拍摄仪器下目标景物的不同特征。首先,通过小波分解得到高频分量系数和低频分量系数,高频系数和低频系数分别处理,高频系数采用邻域区域相关性方差的规则,低频系数采用梯度求和加权的规则。然后进行逆变换得到融合图像。最后利用信息熵、平均梯度、互信息方法对图像的融合效果进行综合评价。得到实验结果,融合图像包含更多的信息量,更有助于人眼的判断与观察。

图像融合;邻域区域相关性方差;梯度和加权;互信息

在国外,针对图像融合提出了贝叶斯优化法、双模态神经网络法、脉冲耦合神经网络法,研究算法可以保持更多的现场数据,提供比其它融合层次细节丰富、目标空间位置精确、更利于观察的和更加可靠的图像信息[1]。在国内,研究院所在彩色夜视融合、多光谱图像融合理论及系统设计方面进行了较全面的研究,提出了基于多层次的传感器融合、多尺度的图像融合等算法。整体而言,国内在理论研究方面日趋完善[2],目前也己有不少研究机构与高校从事这一领域的研究与探索。但这些算法普遍的缺点是适应范围较窄,只对一定类型的图像融合效果较好,对微光图像和红外光图像的融合效果较差,本文针对性地提出了改进的小波融合算法。

不同传感器拍摄同一目标具有很大区别,红外图像亮度变化不敏感、对比度低,含有的噪声较多,但可以显示人肉眼无法看到的目标。可见光图像清晰度高、对比度高、亮度变化敏感,但是在光照较弱的时候,往往不能准确反映目标位置,受光照条件和环境条件的约束。现在社会中,红外图像和可见光图像的使用比较广泛,图像融合的目的正是结合两种图像的共同优点,将各图像数据中所含的信息优势或互补性有机地结合起来,产生出信息丰富的图像,这种新数据能够比较全面地描述被研究对象,同单一的源信息相比,能够抑制一些不确定性的误差或环境解释中存在的多义性,能够最大限度地利用各种信息源提供的数据。因此广泛应用于军事和民用领域。

1 常用的图像融合方法

目前常用的图像融合方法有基于空域的方法:图像像素灰度极值的融合方法,图像像素灰度值加权融合法,TOET图像融合方法。基于变换域的方法:多分辨率金字塔融合方法,傅立叶变换的图像融合方法,小波变换的图像融合方法。

(1)图像像素灰度极值的融合方法是只用于对两幅待配准的图像取对应像素点灰度值较大或较小者,计算简单,只适用于对融合效果要求不高的时候。

(2)图像像素灰度值加权融合法是将两幅输入图像各自乘上一个权系数,融合而成新的图像。该算法实现简单,困难在于如何选择权重系数,才能达到最佳的融合效果。

(3)TOET图像融合方法是首先求出两幅输入图像的共同部分,两幅原图像中都扣除共同成分得到两幅图像的特征成分[3]。然后,第一幅图像扣除第二幅图像的特征成分,第二幅图像扣除第一幅图像的特征成分。最后确定两幅图像的不同成分,按不同的权重计算融合图像的灰度值。

(4)基于多分辨率金字塔融合法是原图像不断地被滤波,形成塔形结构。在金字塔的每一层都用一种算法对这一层的数据进行融合,从而得到一个合成的塔形结构,然后对合成的塔形结构进行重构,最后得到合成的图像。合成的图像包含了原图像的所有重要信息。但这种方法产生的数据有冗余,而且不同级的数据相关。

(5)基于傅立叶变换的图像融合方法是通过在时空域和频率域来回切换图像,对图像的信息特征进行提取和分析,简化了计算工作量。

(6)基于小波变换的图像融合是把图像分解成不同频率特性的子图像,针对分解得到的系数采用不同融合策略[4],其优势在于将图像分解为不同的频率域,在不同的频率域运用不同的策略,得到合成图像不同频率域的显著特性。最后再进行小波逆变换。

2 改进的图像融合算法

由于红外成像仪器本身存在缺陷和环境的影响,造成图像成像效果不是很理想,噪声大,视觉效果不好,这些都会影响融合的效果。所以在图像融合之前先进行图像的去噪、增强等处理,改善红外图像的视觉效果[5]。采用分段函数对红外图像进行增强,提高图像的动态范围,增加图像的对比度,使图像更加清晰明显,以便于进行最后的融合。

在图像融合的过程中融合规则往往比较重要,基于像素的融合方法不能反映一定区域内像素之间的关系,而人眼对像素的感知也是区域性的,基于像素的方法往往具有片面性[6]。通过改进的小波算法把红外图像和可见光图像进行分解,分别得到图像的低频系数部分和高频系数部分,低频部分采用梯度求和加权的融合规则,高频部分采用区域相关性方差的融合规则,最后再对低频部分和高频部分进行小波重构[7]得到最后的融合图像。改进的算法融合流程如图1所示。

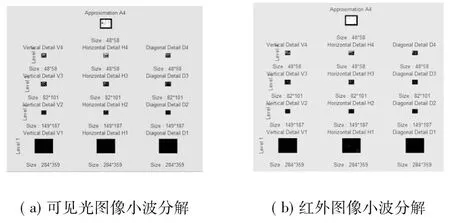

经过小波的4层分解得到分层图,图2a为可见光图像小波分解图示,图2b为红外图像小波分解图示,经过逐层分解,得到原图像的不同频段。

图1 图像融合流程图

图2 小波分层分解

2.1小波分解的高频与低频部分

红外图像和可见光图像分别经过4层小波分解得到高频部分和低频部分,图3a是红外图像小波分解,图3b是可见光图像小波分解。由图3可知红外图像低频能量集中,最后一层能量较高,可见光图像高频细节丰富[8],根据小波分解得到CL的低频分量和垂直分量CV、对角分量CD、水平分量CH的高频部分。

图3 小波分解结果

2.2低频融合策略

图像的低频信息部分,大多数反应图像的主要结构,占据图像的大部分能量[9],传统的像素平均加权降低了融合图像的对比度,失去了一部分有用的信息,仅仅依靠单独像素点作为信息的度量是不够的。由于红外图像和可见光图像物理特性不同,通过对一个低频系数一定区域内的梯度求和得到这个低频系数对应的值,可以反映图像中微小细节的变化,反映图像的清晰度变化。梯度求和公式如下:

[X(i,j+1)-X(i,j)]2}

(1)

分别求出可见光图像和红外光图像梯度求和对应的值RV(i,j),RR(i,j),然后对红外低频系数和可见光高频系数进行求权值。公式如下:

W(i,j)=RV(i,j)/RR(i,j)

(2)

式中:RV,RR分别代表梯度求和对应的值;W(i,j)是两者相除得到的值,W(i,j)可以反映两幅图像一定区域内梯度的大小;w代表权重;T是阈值,取值0.5。

最后进行加权求和即可得到图像低频融合部分,加权公式如下:

F(i,j)=w×XV(i,j)+(1-w)×XR(i,j)

(3)

通过低频的方法处理使融合图像更加清晰。图像的微小细节部分得到了明显的改善,综合了原图像共同的优点,如图4所示。

图4 融合后图像与原图像对比

2.3高频融合策略

高频部分反映了图像的细节部分特征,包括图像的纹理轮廓信息,一般可见光图像高频部分包含的细节较多。传统绝对值取大的方法是最简单、直接的融合规则,但是分解系数的能量会随原图像的平移旋转等规则变化发生剧烈的不规则的变化,导致融合后的图像缺乏一致性[10],传递和放大了原图像的死点和噪声点,忽略了相邻像素的关系,不能完全提取图像的细节信息,通过进行基于方差显著性的匹配方法,可以最大限度地融合两幅图像的细节部分。降低融合图像的模糊度。假定图像分解后的高频系数为G(X),可以求出区域方差公式如下:

(4)

然后,要求出红外高频区域系数和可见光高频区域系数的匹配度,区域匹配度是进行高频融合的依据[11],区域方差匹配度公式如下:

(5)

通过匹配度Q(p)与选取的阈值比较设计融合策略,Q(p)的取值在0~1之间,取值越大,说明系数相关性越高。然后进行加权融合,公式如下:

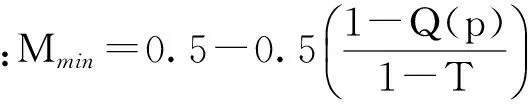

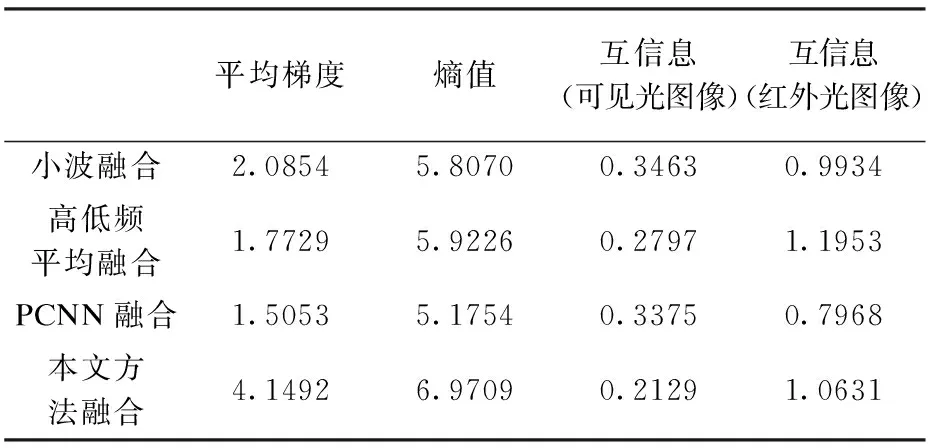

当Q(p) (6) (7) 通过高频方法进行图像的处理,使图像的轮廓信息变得更加丰富。通过计算平均梯度,本文融合图像的梯度为4.1492,明显大于其他方法融合图像的平局梯度,说明使用本文方法后融合图像的信息更加丰富。 3.1红外光图像与可见光图像融合直方图分析 对红外图像和可见光图像的像素进行统计,发现可见光图像像素大多处于0~50之间,像素集中,说明图像整体昏暗,不利于人眼的区分。红外图像像素分布分散,说明图像明暗相对均匀,有利于人眼观察。通过算法的融合,得到最终的图像。可知,融合后的图像像素分布的更加均匀,而且图像直方分布比较平滑,说明融合的图像更加利于人眼的观察分辨,融合得到的图像效果更好。图像的直方图如图5所示。 图5 直方图 3.2算法仿真 为验证算法的融合效果,选取一对红外光图像和可见光图像进行融合实验,并给出最终融合性能评价,本文仿真软件是由Matlab实现,Matlab操作界面如图6所示。 图6 Matlab操作界面 两幅图像都选取大小为629×494的图像,背景目标相同,红外仪器与可见光仪器拍摄位置相同,其中图7a是可见光图像,景物昏暗,只有少量的灯光较为明显,在灯光的照射下字体清晰可见,但路人与房屋等无法准确分辨。图7b是红外光图像,图像明亮,路人房屋的位置容易分辨,但模糊不清,分辨率较低,细节部分显示不出。算法的目的是得到一幅即可以看到灯光下字体[12],又能分辨路人的融合图像。为验证融合算法的有效性,与传统的小波融合算法进行试验对比。由于图像的分解层数增加,提取的细节信息也相应增加,但各子频带的相互干扰也增加[13],反而影响图像的融合质量,本文的小波分解尺度设定为4。图8a为传统小波融合的结果。图8b为使用高低频平均法的小波融合的结果。图8c为PCNN融合的结果。图8d为本文提出的融合方法的结果。 图7原图像 图8 实验结果 可以看到,图8d融合图像明显对比度较强,与图8a比较含有更多的细节。比单独使用传统方法的图8b含有的信息更丰富,图像更明亮。PCNN方法针对不同的图像会有不同的效果,在对比度较低的图像下,明显不如本文提出的方法,图8c图像融合效果较差。 评价方法采用平均梯度、信息熵、互信息作为评价标准[14]。 (1)平均梯度:反映了图像中微小细节的反差和图像的纹理变化以及图像的清晰度。值越大表明图像的变化越明显。 (2)信息熵:表示图像信息量的度量,是图像评价的基础指标,值越大表明图像的信息量越多,图像对比度越大,像素信息排列越混乱。 (3)互信息:用于反映两幅图像相似度的度量,融合图像与理想图像相似度越大表明图像的融合质量越好,现实中理想图像很难得到,所以通过求,融合图像与可见光图像和融合图像与红外光图像的互信息来进行评价。 表1表示客观评价的结果,通过表1可以看出,本文提出的方法在平均梯度、值熵、互信息值与主观的评判结果是一致的[15],通过本方法图像对比度增强,图像信息量增多,和原图像有更多的相似性,相比较其他方法,在各方面都表现出一些优势。进一步说明了本文提出方法的优越性。但是可以发现,融合图像在与可见光进行互信息时值较小,通过研究分析,主要原因在于可见光图像较暗,含有的有用信息较少,通过算法的筛选导致融合图像含有可见光的信息量减少,但并不影响主要信息的融合。反而有利于红外光信息的保存与融合,有利于图像的最终形成。 表1 融合效果综合评价结果 针对红外和可见光图像的成像特点,在低频部分采用基于融合图像自身物理特性的区域梯度求和的方法,高频部分考虑到高频分量的变化,引入基于区域方差的相关系数匹配度方法[16]。通过改进的小波图像融合方法,结合低频梯度,高频方差能量的融合方法。降低了融合图像的模糊程度,丰富了图像的信息,更好地保留了图像的边缘和纹理细节。实验结果表明,本文方法具有更好的鲁棒性,并且能得到更好的视觉效果,结合了红外图像与可见光图像共同的优点,主客观综合评价本方法具有一定的优势。 [1]邓承志,饶伟.基于Shearlet变换的红外与可见光图像自适应融合[J].激光与红外,2013,43(4):399-403. [2]徐亮,吴海涛,孔银昌.自适应阈值Canny边缘检测算法研究[J].软件导刊,2013,12(8):62-63. [3]Goferman S,Zelnik-Manor L,Tal A.Context-aware saliency detection [J].IEEE Transactions on Pattern Analysis and M-chine Intelligence,2012,34(10):1915-1926. [4]邢素霞,肖洪兵,陈天华,等.基于目标提取与NSCT的图像融合技术研究[J].光电子·激光,2013,24(3):583-588. [5]彭海.红外与可见光图像融合方法研究[D].杭州;浙江大学,2012:31-41. [6]王晓文,赵宗贵,汤磊.一种新的红外与可见图像融合评价方法[J].系统工程与电子技术, 2012,34(5):871-875. [7]YE Yinfang,NIE Jianying.Principal Component Fusion of IR/PMMW Image Based on Multiresolution Analysis[J].El-ectronics Optics&Control,2013,20(9):6-9. [8]叶银芳,聂建英.基于多分辨分析的红外/被动毫米波图像主成分融合[J].电光与控制,2013,20(9):6-9. [9]WEN Liming,PENG Li.Remote sensing image fusion method based on wavelet packet transform with Sobel operator[J].Computer Engineering and Application,2013,49(3):207-209. [10]ZHANG Defeng.MATLAB:Wavelet Analysis (2th edition)[M].China Machine PRESS,2012:70. [11]LI S T,KANG X D,HU J W.Image fusion with guided fitering[J].IEEE Transcations on Image Procession,2013,22(7):2864-2865. [12]LUO X Y,ZHANG J,DAI Q H.Saliency-based geometry measurement for image fusion performance[J].Instrumentaion and Measurement,IEEE Transactions,2012,61(4):1130-1132. [13]M.Hossny,Jack K Holmes,Srini Raghavan.Information measure for performance of image fusion[J].Electronics Letters,2008,44(18):1066-1067. [14]WEI H,JING Z I.Evaluation of focus measures in multi-focus image fusion [J].Patern Recognition Letters,2007,28(4):493-500. [15]邹北骥,胡艺龄,辛国江.基于小波分解和PCNN的图像融合方法[J].计算机工程与科学,2011,33(2):102-107. [16]NIE Jianying,LI Xingguo,LOU Guowei.Analysis of Wavelet Packet and Radiation Characteristics for Armored Targets with PMMW[J].Electronics Optics & Control,2011,18(3):72-75. (责任编辑:马金发) Research on Image Fusion Algorithm of Infrared and Visible Image CAI Kaili,SHI Zhengang (Shenyang Ligong University,Shenyang 110159,China) Infrared image and visible image reflect on different shooting instrument,different characteristics of target scene.Firstly,with wavelet decomposition high frequency coefficient and low-frequency coefficients,high frequency and low frequency are obtained respectively.The high frequency coefficients are dealt with by using the rule of neighborhood regional correlation variance,the low frequency coefficients are dealt with by adopting the rule of gradient weighted sum.Then,the fusion image is gotten by inverse transform.Finally,image fusion effect is comprehensively evaluated by information entropy,average gradient and mutual information.Experimental results show that the fusion image contains more information,which is more advantageous to human eye judgment and observation. image fusion;neighborhood regional correlation variance;gradient weighted sum;mutual information 2015-05-25 国家自然科学基金资助项目(60602040) 蔡铠利(1992—),男,硕士研究生;通讯作者:石振刚(1971—),男,副教授,博士,研究方向:图像处理与分析技术。 TP751.2 A

3 实验结果分析

4 结束语