基于HSI亮度分量和RGB空间的图像去雾算法

李慧慧 秦品乐 梁军

摘要:图像去雾技术处理的目的是消除雾霾对视频监控图像的影响,提高雾霾图像的视觉效果。目前,一般去雾图像只是比较去雾后和去雾前的图像,处理结果通常失真严重或过饱和,不能在保证细节清晰的同时保证颜色信息完整。针对上述问题,提出了一种基于大气散射模型和光学原理,建立具有散射特性的HIS亮度转换模型,并与RGB空间结合计算的图像复原方法。该方法通过分析晴天图像和雾霾图像的对比关系,结合HSI空间人眼视觉最敏感的亮度分量计算出图像场景的相对深度关系,利用大气散射模型以及景深比,对雾霾视频图像进行清晰复原和结果的测评。实验结果证明,与只从RGB空间计算的去雾霾方法对比,所提方法去雾效果更清晰,彩色失真和过饱和程度更小。

关键词:视频监控;去雾;大气散射模型;图像复原;景深

中图分类号:TP752.2 文献标志码:A

Abstract:The purpose of image defogging is to remove the fog effect from image of surveillance video to improve the fog haze image visual effect. Presently, there is only a comparison between images before and after defogging, and the results are often distorted seriously and oversatuarted. Thereby, it is hard to ensure the clear details and the integrity of color information simultaneously. For tackling above problems, a new optimized method for images recovering was proposed with combination of HIS luminance component and RGB space, which was based on atmosphere scattering model and optical principals. In this method the relative depth relationship of image scene was analyzed by comparing images in fine and haze days with help of the most eyesensitive HSI luminance component. Finally, by utilizing atmosphere scattering model and the comparison of depth of field, the recovering and result evaluation were conducted on the video obtained in haze. The experimental results show that, compared with the defogging methods calculated in RGB space, the proposed method has more clear defogging results and smaller degree of color distortion and oversaturation.

Key words:video surveillance; defogging; atmosphere scattering model; image recovering; depth of field

0 引言

雾霾天气下,道路监控摄像机的监控距离、图像清晰度下降,导致监测到的车辆、人物等主体的关键细节信息丢失,降低了视频监控系统的实用性, 因此雾天降质图像或视频的清晰化处理成为了计算机视觉和图像处理领域的一大研究热点。目前,较常用的有光学透雾和电子透雾两种透雾技术。光学透雾是基于光波波长和雾霾浓度的特征,利用可穿透雾霾的近红外波段光线进行成像,成像效果比较明显,较好地运用在了海事、海洋的相关科研活动中[1]。然而光学透雾只能得到黑白监控画面,镜头延伸有一定的限制,并且需要的镜头成本很昂贵。电子透雾技术主要分为两类:一类是非模型的图像增强方法,通过增强图像的对比度,满足主观视觉的要求来达到清晰化的目的;另一类是基于物理模型的图像复原方法,考察图像退化原因,将退化过程进行建模,采用逆向处理,最终完成图像的复原。将光学透雾和电子透雾结合起来称为光电透雾,可以均衡两者的优势,达到更好的去雾效果。非模型方法只能相对地提高图像质量,造成图像部分信息的丢失。

基于物理模型,利用单幅图像进行去雾,取得了一定效果,但是单幅图像只能对原雾天图像和去雾后的图像进行对比,往往忽略了颜色信息的丢失和过饱和情况,造成对监控主体特征的错误判断。He等[2]提出了暗通道优先,利用暗通道优先取得了很好的去雾效果,并且得到了深度图像;但在实际使用过程中暗通道优先方法有一定的局限性,不能很好处理图像中灰白色区域,且大量的计算使整个处理过程耗时太长,难以应用和推广。基于物理模型,利用多幅图像对比进行去雾是目前研究的热点,但也有其局限性。如偏振方法去雾[3-7],需要不同拍摄角度或不同拍摄时间,取得了一定的效果,但这些方法对数据输入要求较高,普通拍摄难以获取合适的图像。Narasimhan等[8]从RGB色彩空间出发,利用多幅雾天图像计算出场景的三维结构,从而对场景图像去雾。该方法近似大气散射系统和波长无关,对与雾气颜色接近的图像部分恢复效果不理想,且无法用于动态监控视频场景。陈功等[9]作了相应的改进,但只是从RGB色彩空间进行计算,RGB关联较大,虽然分别对红(R)、绿(G)、蓝(B)分量作不同处理,但在计算场景深度时,以R通道为轴,会造成较大的色彩失真和饱和度。本文在此基础上,针对去雾清晰度、色彩失真度及过饱和的问题,提出了基于大气物理模型的新的计算方法,根据大气雾霾粒子散射特性及人眼对红光、绿光和蓝光的不同敏感度设计出新的亮度转换模型,并结合RGB色彩空间计算出场景深度与景深比,对图像进行去雾处理,实验证明,本文方法得到了更好的去雾效果。

1 大气散射计算模型

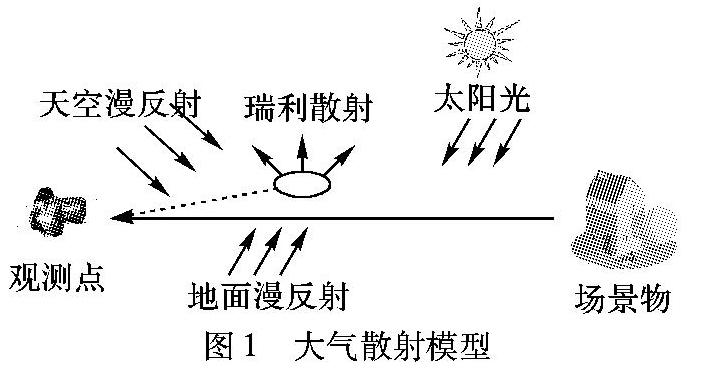

大气散射模型是雾天视频场景图像降质的物理原理,文献[10-11]中对大气散射模型进行了详细的推导。在光的传播过程中,撞上悬浮在空中的雾霾粒子,部分光就会被这些粒子散射掉,导致光束被削弱。大多数雾霾天气主要是由一种较大的气溶胶颗粒造成,其尺寸小于光波波长λ的1/10,此时发生的是瑞利散射,且不同波长的光波的散射程度是不同的。由于多次散射,远处的光亮度大大降低,最终短波光被散射殆尽,无法到达成像设备,得到不清晰的雾霾视频图像。环境光照则是随着光程增加逐渐增强,所以景深较大的场景点亮度较大,色彩和纹理特征也较模糊。由此,在雾天情况下,散射模型过程主要由衰减过程和环境光照组成。如图1所示,描述了散射模型的过程。

2 基于散射特性亮度模型的改进算法

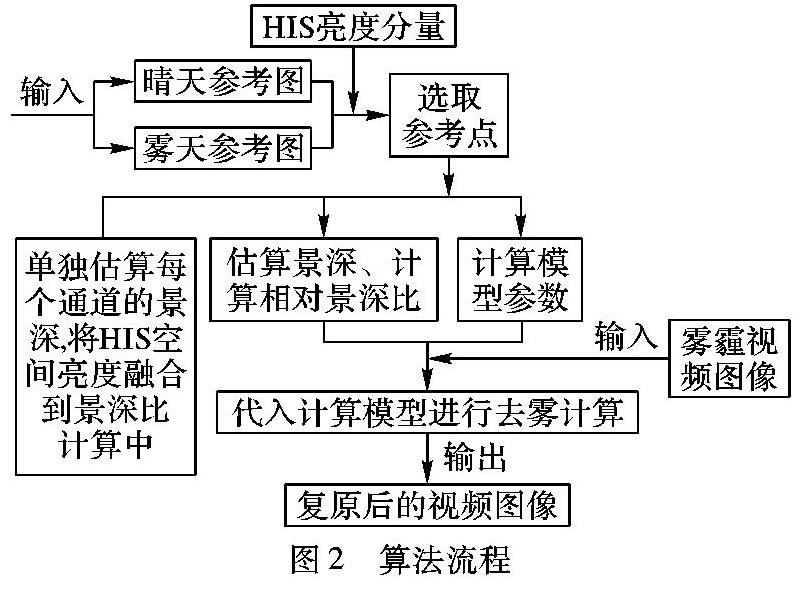

2.1 算法流程

本文利用一张晴天参考图像和雾天参考图像,通过参考点选取方法得到的两个参考点,计算出部分模型参数,然后借助这些参数,将基于散射特性的HSI(HueSaturationIntensity)空间亮度转换模型和RGB色彩空间近似的红、绿、蓝光波结合起来,计算出各个场景点相对于参考点的相对景深比关系,并利用计算得到的相对景深比计算出所有模型参数和场景各点的深度,晴天参考图像对去雾结果图像的饱和度和颜色信息适当地进行了还原,最后实现了对雾天视频图像的去雾处理。算法流程如图2所示。

2.3 参考点选取

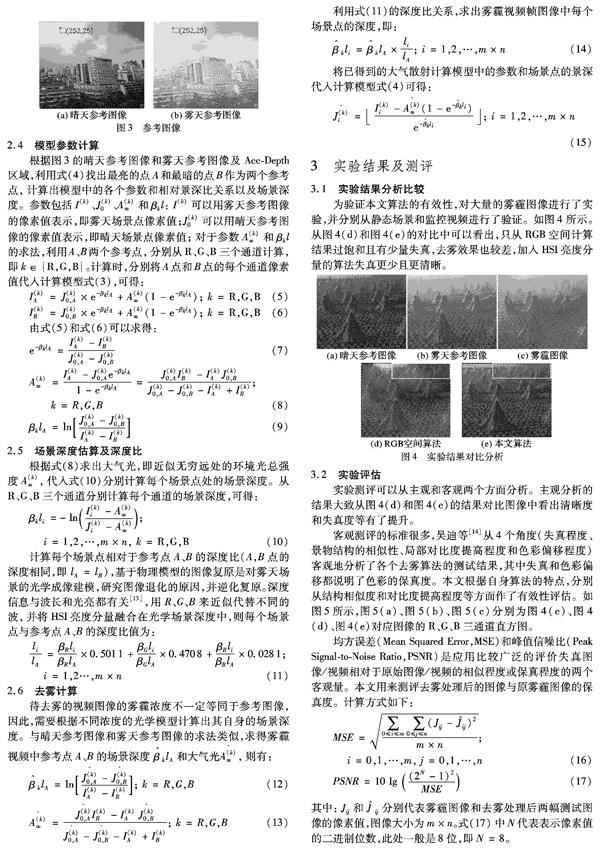

利用一张晴天参考图像和雾天参考图像,选取两个参考点,用于之后的参数计算,对光学成像过程建模。雾霾天气下场景物的可见度与场景深度有关,并且可见度较深度是呈指数下降的。陈功等[9]曾提到一种选取参考点的方法,即先利用先验知识找几个深度相同的场景点或一个景深相同的场景小区域,然后取这些场景点中颜色差异较大的两个点。本文利用先验知识找到景深相同的一个小矩形区域,区域大小选择要适中,根据实际的图像特征决定,找到最精确景深(AccurateDepth,AccDepth)区域。然后利用亮度转换式(4)找出场景点中亮度差异最大的两个点。

3 实验结果及测评

3.1 实验结果分析比较

为验证本文算法的有效性,对大量的雾霾图像进行了实验,并分别从静态场景和监控视频进行了验证。如图4所示。从图4(d)和图4(e)的对比中可以看出,只从RGB空间计算结果过饱和且有少量失真,去雾效果也较差,加入HSI亮度分量的算法失真更少且更清晰。

3.2 实验评估

实验测评可以从主观和客观两个方面分析。主观分析的结果大致从图4(d)和图4(e)的结果对比图像中看出清晰度和失真度等有了提升。

客观测评的标准很多,吴迪等[14]从4个角度(失真程度、景物结构的相似性、局部对比度提高程度和色彩偏移程度)客观地分析了各个去雾算法的测试结果,其中失真和色彩偏移都说明了色彩的保真度。本文根据自身算法的特点,分别从结构相似度和对比度提高程度等方面作了有效性评估。如图5所示,图5(a)、图5(b)、图5(c)分别为图4(c)、图4(d)、图4(e)对应图像的R、G、B三通道直方图。

均方误差(Mean Squared Error,MSE)和峰值信噪比(Peak SignaltoNoise Ratio,PSNR)是应用比较广泛的评价失真图像/视频相对于原始图像/视频的相似程度或保真程度的两个客观量。本文用来测评去雾处理后的图像与原雾霾图像的保真度。计算方式如下:

对比去雾后的图像与雾天图像的差异,对图5的直方图进行分析,计算出实验数据,如表1所示。MSE的数值越小,PSNR的值越大,经过去雾处理后的失真程度就越小。直方图相关系数越大,表明两幅图像的相似度越高,将只从RGB空间计算的算法和本文算法处理后的结果分别与晴天参考图像进行直方图相关系数计算,从表1可知,本文算法的系数值更高,即结构相似度更高。从对比度比较可得,本文去雾算法结果图像的对比度更好,细节更突出,去雾效果图像更清晰。图6为以城市建筑图为例进行的实验结果对比分析图,晴天参考图像和雾天参考图像见图3,表2为对应的数据分析比较。同图4对比结果一致,可以看出本文算法去雾效果更优。

3.3 监控视频应用

监控视频是一个动态的场景,即场景中同时存在静止的背景和运动的前景。 要使本文去雾算法针对于监控视频雾霾图像,必须估算出其前景深度。本文用参考背景图像的场景深度来近似等价于同一位置上前景的深度。由于参考图像中的前景会影响去雾效果,为了减少这种影响,首先分别对雾天和晴天的视频进行背景提取,将得到的晴天和雾天的背景分别作为晴天参考图像和雾天参考图像。实验证明,本文算法对于视频图像同样有较明显的去雾效果,如图7所示。

4 结语

本文通过雾霾图像对比,对现有RGB空间去雾算法进行分析,用基于散射特性的HSI空间亮度转换模型和RGB空间结合计算各个模型参数,减少失真和过饱和,并得到更有效的去雾方法。目前,计算机视觉已经广泛地应用在交通和安全监控系统中,图像和监控视频的去雾也已经成了计算机视觉重要的研究方向之一。现有的去雾霾方法并不能适用于所有的场景,需要动手调整参数以提升算法的适用能力。然而,交通、安全监控等系统都需要一种能够自动调参的自适应能力,这也是未来需要研究的重要内容之一。

参考文献:

[1]鲍永欣. 海事调查取证系统的研究[D]. 大连:大连海事大学,2014:52-58.(BAO Y X. Research on forensics system for maritime investigation[D]. Dalian: Dalian Maritime University, 2014:52-58.)

[2]HE K, SUN J, TANG X. Single image haze removal using dark channel prior[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2011, 33(12): 2341-2353.

[3]SCHECHNER Y Y, NARASIMHAN S G, NAYAR S K. Instant dehazing of images using polarization[C]// Proceedings of the 2001 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2001, 1: 325-332.

[4]SCHECHNER Y Y, NARASIMHAN S G, NAYAR S K. Polarizationbased vision through haze[J]. Applied Optics, 2003, 42(3):511-525.

[5]NAMER E, SCHECHNER Y Y. Advanced visibility improvement based on polarization filtered images[C]// Proceedings of the 2005 International Society for Optics and Photonics. Bellingham, WA: SPIE, 2005, 5888: 36-45.

[6]SHWARTZ S, NAMER E, SCHECHNER Y Y. Blind haze separation[C]// Proceedings of the 2006 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2006, 2: 1984-1991.

[7]SCHECHNER Y Y, AVERBUCH Y. Regularized image recovery in scattering media[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2007, 29(9): 1655-1660.

[8]NARASIMHAN S G, NAYAR S K. Vision and the atmosphere[J]. International Journal of Computer Vision, 2002, 48(3):233-254.

[9]陈功,王唐,周荷琴.基于物理模型的雾天图像复原新方法[J]. 中国图象图形学报,2008,13(5):888-893.(CHEN G,WANG T,ZHOU H Q. A novel physicsbased method for restoration of foggy day images[J]. Journal of Image and Graphics,2008, 13(5):888-893.)

[10]NAYAR S K, NARASIMHAN S G. Vision in bad weather[C]// Proceedings of the 7th IEEE International Conference on Computer Vision. Piscataway, NJ: IEEE, 1999, 2: 820-827.

[11]NARASIMHAN S G, NAYAR S K. Removing weather effects from monochrome images[C]// Proceedings of the 2001 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2001, 2: 186-193.

[12](美)冈萨雷斯, (美)伍兹, (美)艾丁斯. 数字图像处理[M]. 3版.阮秋琦,译.北京:电子工业出版社,2012: 20-23. (GONZALEZ R C, WOODS R E, EDDINS S L. Digital Image Processing[M]. 3rd Ed. RUAN Q Q, translated. Beijing: Publishing House of Electronics Industry, 2012: 20-23.

[13]NARASIMHAN S G, NAYAR S K. Contrast restoration of weather degraded images[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2003, 25(6): 713-724.

[14]吴迪,朱青松.图像去雾的最新研究进展[J]. 自动化学报,2015,41(2):221-239.(WU D, ZHU Q S. The latest research progress of image dehazing[J]. Acta Automatica Sinica, 2015,41(2):221-239.)