基于LBP-GLCM纹理特征提取的服装图像检索

李玥灵,吴国平,耿秀秀,杜晓骏

(中国地质大学(武汉)机电学院,湖北 武汉 430074)

在服装电子商务蓬勃发展的背景之下,传统的基于文本的图像检索技术(Text-based Image Retrieval,TBIR)[1]已经不能满足广大消费者的需求。而基于内容的图像检索技术(Content-based Image Retrieval,CBIR)[2]是通过提取图像的视觉特征(又称底层特征、物理特征),如颜色、形状、纹理、空间位置信息等,利用距离函数来度量图像的相似性达到检索图像的目的,正好可以弥补TBIR在图像检索中的不足。

实现CBIR的关键技术之一是图像特征提取。而在图像的底层特征中,纹理特征由于提取难度较大,一直是研究领域中的热点,各种方法也层出不穷,Tuceryan和Jain[3]将这些方法归为四大类:结构分析法、统计分析法、模型化方法和频域分析法。在统计分析法中灰度共生矩阵(Gray-Level Co-Occurrence Matrix,GLCM)因其原理简单易于理解且能较精确地反映纹理信息而具有很旺盛的生命力。虽然使用GLCM提取服装图像的纹理,可以达到比较良好的效果,但由于其不具有旋转不变性,而待检索的服装图像很多是人工拍照上传到数据库,图像在方向上有很大的随意性,单纯使用GLCM进行检索会影响检索的准确率。而局部二值模式(Local Bi⁃nary Pattern,LBP)算法中,恰好有一类旋转不变的算法可以与之结合。因此,本文提出一种LBP-GLCM纹理特征提取方法,即将Uniform-旋转不变LBP算法与GLCM相结合,使之具有抗旋转性,并将其应用到服装图像检索中,以期达到更高的检索效率和准确率。

1 灰度共生矩阵(GLCM)

由于纹理是图像中相邻像素或者相邻区域在灰度上表现出来的某种规律性,因此同处一种相对位置关系下灰度的某种边缘条件概率可以用来表示图像的纹理特征。1973年Haralick等[4]从概率角度研究了图像纹理灰度级的空间依赖关系,依据图像中各像素之间的相对位置关系构造了灰度共生矩阵。如图1所示,两像素间的横向差Δx和纵向差Δy由像素间距离d和方向角θ两个参数决定,Δx=dcosθ,Δy=dsinθ。

图1 像素相对分布示意图

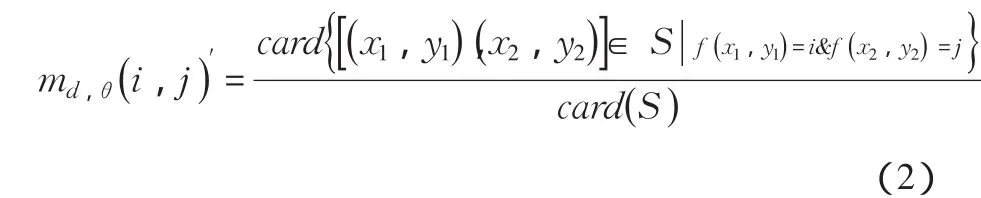

设 f(x,y)表示一幅灰度图像,S表示为具有某种特定空间和像素关系的像素对集合,灰度共生矩阵为

式中:x2=x1+Δx,y2=y1+Δy,card(S)表示集合S中的元素个数。在应用中常用式(2)对式(1)进行归一化处理

在实际使用中,为了减少运算量,往往对图像进行灰度级缩减处理,经常量化为8个灰度级别,同时为了减少θ的方向数,一般取0,π/4,π/2,3π/4这4个方向。

假设图像被量化到了8个灰度级(1~8),取d=1,θ=0,则GLCM计算过程如图2所示,左侧表示原始图像,右侧表示灰度共生矩阵 m1,0。其中GLCM矩阵中(1,1)元素是“1”,表示该点像素值为“1”,同时相邻的右边像素值也为“1”的像素点个数是1个;同理可得,(1,2)元素是“2”,依此类推。

图2 灰度共生矩阵统计过程

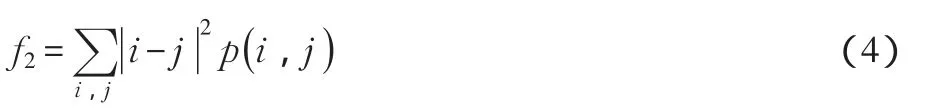

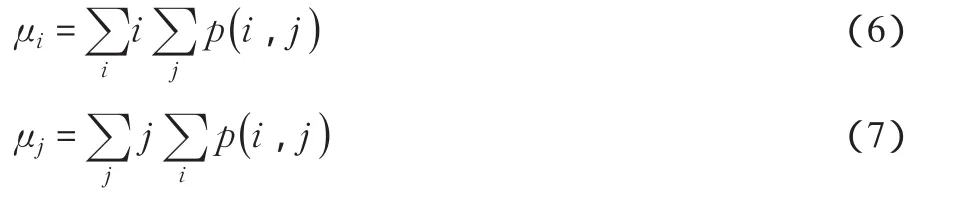

灰度共生矩阵是研究图像局部纹理模式和排列规律的基础,但是由于灰度共生矩阵依然维数过高,并且特征不够明显,因此为了更加有效地利用灰度共生矩阵所提供的灰度方向、变化幅度和间隔等图像信息,Haralick等[4]定义了 14个灰度共生矩阵特征参数用于纹理分析。本文仅讨论试验中用来描述服装图像纹理特征的4个参数[5],其他的不再赘述。

1)二阶矩(angular second moment)

2)对比度(contrast)

式中:μi,μj分别表示水平方向和竖直方向的像素均值

σi,σj分别表示水平方向和竖直方向像素的标准差

相关性在一定程度上反映了整个图像中像素与其周边像素之间的灰度关系。当矩阵元素值均匀相等时,相关值就大;相反,如果矩阵像元值相差很大则相关值小。相关性特征范围在-1~1之间,特别地,相关系数为1表示特定位置的像素之间具有相同的像素值。

4)均匀性(homogeneity)

由于这几个分量的物理意义、量纲和取值范围各不相同,因此在进行检索时需要对其进行归一化处理[6],这样有助于在进行相似性度量时使权重系数相近,减少了调整权重系数的过程。本文使用高斯归一化法,它对于严重偏离均值的数据点有较好的处理效果。

高斯归一化的过程如下,例如有一组数据x={x1,x2,…,xn}其均值 μ,方差为σ2。对x进行高斯归一化,即每一个元素都减去均值,再除以方差,如式(11),得到归一化数据y={y1,y2,…,yn}。

灰度共生矩阵能够很好地描述图像的纹理特征,但是由于灰度共生矩阵不具有旋转不变性,所以从中提取的统计量也仅仅反映该方向上的特征,虽然可以计算几个方向上的统计量然后做平均,但也无法很好地表达图像纹理的特征。为了解决这一问题,本文在图像计算灰度共生矩阵之前,先对图像做LBP处理。

2 局部二值模式(LBP)

LBP是一种有效的纹理特征提取算法,由Ojala等[7]在1996年提出,主要用于解决多分辨率和旋转情况下图像的纹理分类问题。从某种意义上说,该方法将局部纹理信息与全局纹理信息同时融合到一起。

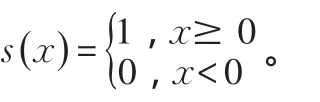

2.1 原始LBP算法

原始的LBP算法是作用在一个3×3的矩形像素区域中,以中心像素的灰度值为阈值,将周围8个像素的灰度值依次与其进行比较,如果周围像素的灰度值大于中心像素,则该位置赋值为“1”,否则赋值为“0”,把阈值化后的值顺次记录下来,得到一串二进制数字,转换为十进制就得到该中心位置的LBP值,其范围为[0,255]。计算公式如下,其计算过程如图3所示。

图3 原始LBP算法示意图

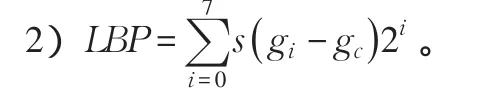

2.2 多尺度LBP算法

为满足不同尺度的纹理提取,Ojala T等[8]对原始的LBP算法进行了改造,提出了多尺度LBP算法。使用圆形邻域(P,R)(P表示圆形邻域中所取的像素个数,R表示邻域半径)以及插值法,该算子可扩展到任意半径和任意邻域像素个数,其他尺度的纹理结构如图4所示。

图4 几种不同P,R值对应的圆形邻域示意图

对于这种圆形邻域的LBP算法,其计算方法与原始方法相似,记作LBPP,R。计算公式如下

此算法生成的模式有256种,计算量太大,极大地影响了检索效率,不适用于服装图像检索。

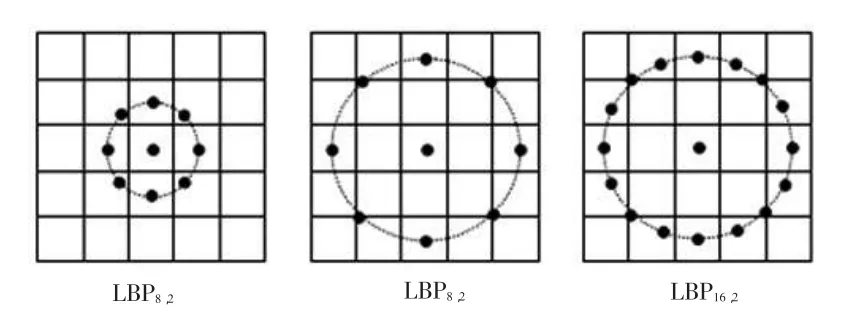

2.3 旋转不变LBP算法

多尺度的LBP算法所得到的LBP值与二进制序列的起始位置和选取方向密切相关。如果图像发生旋转,对应的二进制序列就会发生变化,最终的LBP值也将不同。因此,为了得到不变的编码模式,Ojala等[8]又提出了旋转不变LBP算法,即不断旋转圆形邻域得到一系列初始定义的LBP值,取其最小值作为该邻域的LBP值,用公式表示如下

式中:ROR(x,i)表示对二进制序列x循环移动i位且i<p。对于P=8,将有36种唯一的旋转不变二值模式。但是此时的编码模式仍然较多,应用到服装纹理特征提取时,计算量较大,影响检索速度。

2.4 Uniform模式

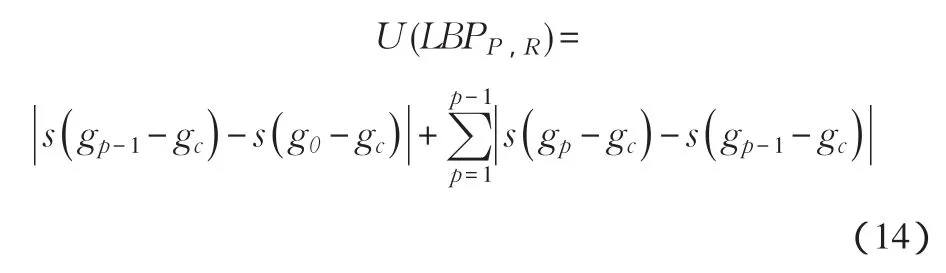

如图3所示,在记录阈值化后的二进制序列时,如果选取的起始点和方向不同,二进制序列将有2P种,对应的LBPP,R会产生2P种模式。但是在实际研究中发现,各种模式所出现的频率是不同的,统计结果表明,少数的模式出现的数量占所有模式的90%以上,Ojala等[8]将这些出现频率特别高的模式定义为Uniform模式。将二进制序列看作一个圆环,如果“0→1”和“1→0”的变化不超过2次,则该序列称为Uniform模式。例如,“00000000”(0次转变)、“00011100”(2次转变)是Uniform模式,而“10010011”(4次转变)不是Uni⁃form模式。在使用LBP算法对图像进行纹理分析时,通常只关心Uniform模式,而将其他模式归为同一类称为混合模式。判断某种序列是否为Uniform模式的方法如下

这样改进后,模式的种类大大减少,特别是对于P=8的情况,模式数量由原来的256种变为58种。

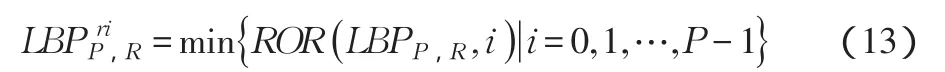

2.5 Uniform-旋转不变LBP算法

经过抗旋转的编码方式获得了若干LBP模式,但是通过前面Uniform模式的论述可知,其中某些模式在所有的模式中并不是占有大量的比重,故又有人提出Uniform-旋转不变LBP算法,使模式种类减少到P+1种,表示如下

uniform-旋转不变LBP算法,既保证了旋转不变性,又使模式数量大大减少,应用到服装图像检索可提高检索效率和准确率。

3 实验和分析

本文以移动拍照设备采集的服装图像为实验对象,运用提出的纹理特征提取方法进行实验和分析。

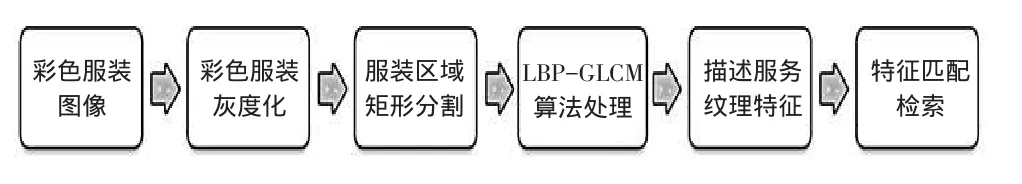

3.1 实验系统设计

实验系统首先要滤除服装图像的复杂背景,将彩色图像转换为灰度图像;接着利用图像分割技术分割出服装区域并找到其中最大矩形部分;然后将图像通过Uniform-旋转不变LBP算子处理,并获取其灰度共生矩阵;再采用能量、对比度、相关性和均匀性描述图像的纹理特征,最后通过特征匹配进行检索。整个实验系统的工作流程如图5所示。

图5 LBP-GLCM算法实验系统流程图

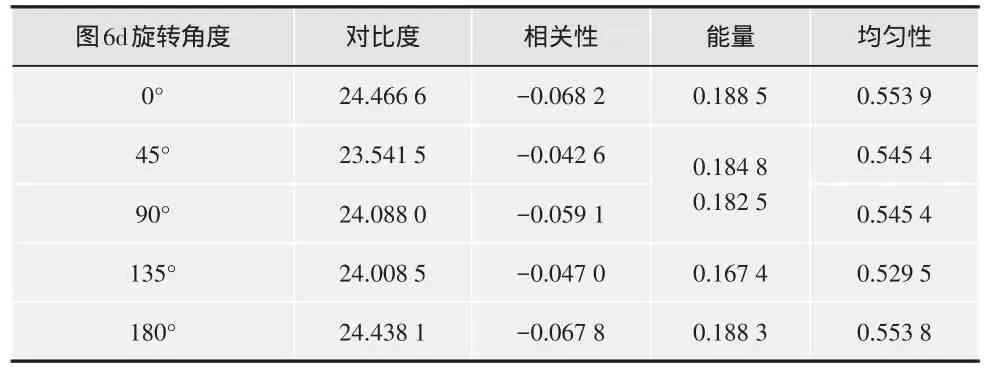

3.2LBP-GLCM纹理特征提取方法抗旋转性实验

选取图6b和图6d两幅图像做抗旋转实验。首先将两幅图像进行45°、90°、135°和180°旋转,然后按照图5所示的实验系统流程图提取各旋转后的纹理特征(省略特征匹配检索环节),得到如表1和表2所示的纹理特征表。

图6 服装纹理待检索图像

表1 不同旋转角度下图6b的纹理特征

表2 不同旋转角度下图6d的纹理特征

通过表1和表2可以看出,服装图像在不同程度的旋转情况下纹理特征变化很小,因此本文提出的纹理特征提取方法具有较好的抗旋转能力。

3.3LBP-GLCM纹理特征提取方法检索效果实验

以如图6中4幅服装图像为例,按照流程图5进行特征提取和匹配检索可得到如表3所示的服装纹理特征,以及如图7所示的检索结果。

表3 图6待检索图像的纹理特征

图7 纹理特征检索结果

由表3所示的服装纹理特征可知,图6b和图6d有较多的黑白元素,故对比度大;在图6a和图6c中有大量的条纹元素,故相关度为正值(即相邻像素间像素差别不大);由于图6b和图6d中,花纹样式复杂多变,故其拥有更大的能量;图6a和图6b相对于图6c和图6d具有更均匀的纹理。

系统采用欧氏距离作为相似性的度量,对于图6a,找出2幅与之具有相似条纹纹理特征的服装图像;图6b,找出6幅与之具有相似斑点纹理的服装图像;图6c,找出3幅与之相近的具有方格图案的服装图像;图6d,找出5幅与之相近的具有碎花纹理的服装图像。

在本实验中,T恤样本:条纹类图像30张,斑点类图像20张,纯色图像40张,花型图像10张;大衣样本:纯色图像50张,条纹类图像35张,褶皱类图像15张,分别利用GLCM和LBP-GLCM提取服装图像的纹理特征,采用欧氏距离作为相似性的度量,检索效果对比如表4所示。

表4 不同纹理特征提取方法的检索效果对比

通过上述实验可知,本文的LBP-GLCM纹理特征提取方法在一定的匹配策略下,应用在服装图像检索中可以获得更高的准确性。

4 结论

本文提出的LBP-GLCM纹理特征提取方法,既克服了灰度共生矩阵的不抗旋转性,又在一定程度上降低了计算的复杂性。在服装图像发生旋转时,相较于单纯的GLCM纹理特征提取方法,检索的准确性更高。

因此,本方法可以很好地应用在服装电子商务领域中,不仅能帮助消费者快速地检索服装,辨别服装材质,提高购物效率,而且可以帮助销售商进行客观而快捷地服装分类,减少人工标注关键字分类带来的主观影响,同时也提高了分类效率。另外,LBP-GLCM纹理特征提取方法也可应用在工业领域,比如在服装生产加工过程中,以完好的服装面料为检索标准,可以对加工后的服装进行面料的瑕疵检测等。

[1] 王莹,罗坤,姜磊,等.基于内容的图像检索技术的专利技术综述[J].电视技术,2013,37(S2):62-63.

[2] ASLANDOGAN Y A,YU C T.Techniques and systems for image and video retrieval[J].IEEE Trans.Knowledge and Data Engineer⁃ing,1999,11(1):56-63.

[3] TUCERYAN M,JAIN A K.Handbook pattern recognition and computer vision[M].Singapore:World Scientific,1993.

[4] HARALICK R M,SHANMUGAM K.Texture features for image classification[J].IEEE Trans.Sys.,Man,and Cyb.,1973,SMC-3(6):610-621.

[5] 杨帆.数字图像处理与分析[M].北京:航空航天大学出版社,2007.

[6] RALLABANDI V R,RALLABANDI V P S.Rotation-invariant texture retrieval using wavelet-based hidden Markov trees[J].Sig⁃nal Processing,2008,88(10):2593-2598.

[7] OJALA T,PIETIKAINEN M,HARWOOD D.A comparative study of texture measures with classification based on feature dis⁃tributions[J].Pattern Recognition,1996,29(1):51-59.

[8]OJALA T,PIETIKAINEN M,MAENPAA T.Multiresolution grayscale and rotation invariant texture classification with local bina⁃ry patterns[J].IEEE Trans.PAMI,2002,24(7):971-987.