基于视频的人脸和步态自适应融合身份识别

孔英会,陈佩瑶

(华北电力大学 电子与通信工程系,河北 保定 071003 )

基于视频的人脸和步态自适应融合身份识别

孔英会,陈佩瑶

(华北电力大学 电子与通信工程系,河北 保定 071003 )

多生物特征融合的主要目的是利用其互补性来提高系统的识别性能。主要针对行走视频中人脸和步态两个生物特征融合的识别方法进行研究,对多个角度视频下的人脸和步态提出了基于决策层的自适应加权融合方法,实验结果证明该方法的融合识别结果比单一生物识别方法以及最大法则、加权法则等融合算法具有更高的识别率。

视频;人脸;步态;自适应;融合

生物特征识别技术由于其可靠性高、安全性好、鲁棒性强等优势日益受到关注。典型的生物特征包括指纹、手掌纹理、人脸、虹膜、人耳、声音等[1]。目前的生物特征识别系统大多是基于单一生物特征的,然而在不同环境下单一的生物特征由于其局限性并不总能得到令人满意的识别率。因此多生物特征融合系统应运而生,利用了生物特征之间在某些条件下的互补性来提高系统的识别性能。

随着监控视频技术的发展,基于监控视频的身份识别受到广泛关注,而监控视频下可以获得的生物特征有人脸、步态、虹膜、肤色等,其中,由于人脸和步态都具有易获得性和普遍性,并且在许多方面都具有互补性,所以融合人脸和步态的多生物特征识别技术有着很大的发展和研究潜力。信息融合识别方法中融合策略的选取对识别结果有明显影响,目前关于融合人脸和步态所取得的研究成果有:Bir Bhanu等人[2]分别使用PCA和MDA从增强的侧面人脸图像(EFSI)和步态能量图(GEI)中提取特征,然后在匹配分数层上使用加法法则、乘法法则、最大法则等几种融合策略将二者融合。李轶等人[3]采用基于傅里叶描绘子和关键点特征的方法提取步态特征,采用傅里叶变换和奇异值分解提取步态图像中的侧面人脸特征取,继而在决策层上利用最大法则、加法法则和乘法法则对人脸和步态特征进行融合。这些研究都使识别效果有了提升,但相对存在局限,因为融合策略基本采用静态融合,未考虑数据变化产生的影响,而自适应融合通过对实际数据进行分析确定合理的权值分配策略,可进一步提高识别性能。耿鑫等人[4]提出了一种可以根据实时外界条件而动态调整的自适应人脸和步态融合方法,在融合过程中考虑到了可能会影响到人脸和步态关系的两个因素,即人体到摄像头的距离和成像角度,取得了好的结果;张立峰等人[5]提出基于方差估计的多传感器自适应加权融合算法,可得到压力传感器数据中方差最小的数据融合值,提高了测量数据的准确性。这些为本文的研究提供了有益的参考。

目前多数研究采用的人脸与步态融合方法并未考虑根据环境条件进行实时调整和改变融合权值,如最大法则、乘法法则、固定权值的加法法则等。本文通过在决策层上将每个生物特征的距离匹配值进行自适应分配权值以获得最优的联合匹配分数,达到最好的信息融合结果,由于该融合权值会随着不同的测试对象和角度发生变化,因此有一定的实时性和适应性。

1 总体思路和结构框架

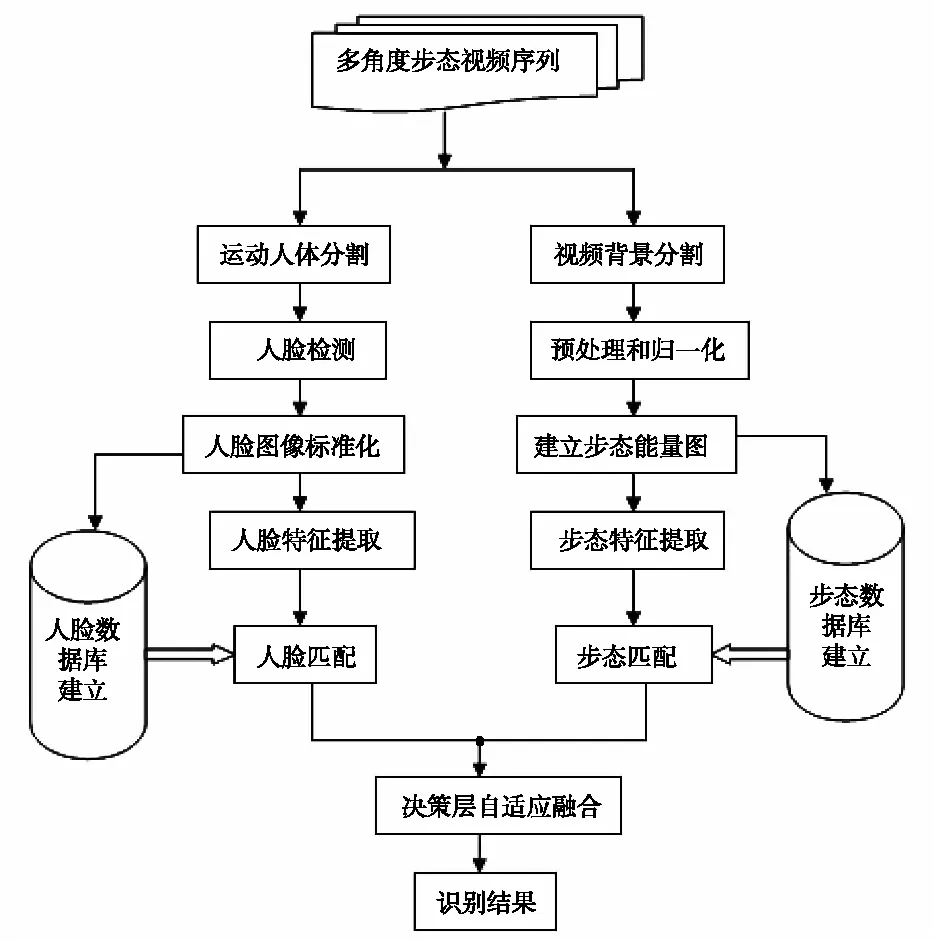

本文研究内容和主要工作可分为以下4个部分:1)步态轮廓图像的提取和步态能量图的建立;2)基于Haar特征的人脸检测;3)人脸和步态数据库的建立;4)使用非负矩阵分解NMF提取步态和人脸的特征,经匹配后在决策层进行自适应融合得到识别结果。流程图如图1所示。

图1 融合步态和人脸身份识别流程图

2 从视频帧中获取标准归一化步态和人脸图像

2.1 步态图像归一化和步态能量图的建立

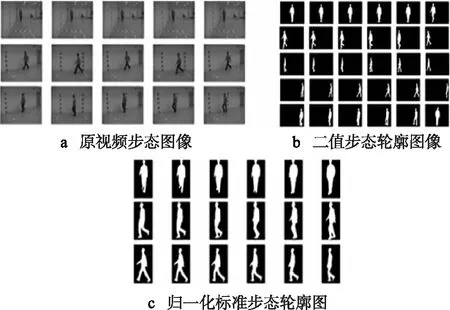

在视频监控中步态是用于远距离身份识别的一个重要生物特征。获得一个视频中人体的运动信息和步态特征,要先从拍摄行走视频序列中提取出标准的二值化步态轮廓图像。步骤为: 1)使用基于高斯模型的背景差法分割出二值步态图像; 2)使用膨胀、腐蚀等形态学运算去掉二值图像中的噪声和空洞,完成图像预处理; 3)通过将上半身剪影的质心设为中心实现图像的水平对齐,按比例调整每个轮廓图像保证所有的剪影都有着相同的高度,得到统一尺寸的标准归一化二值步态轮廓图像,如图2所示。

常规的人体行走可以视为周期性的动作,人体按照一个稳定的频率进行重复的动作。因此,将整个步态序列划分成多个周期是可行的。在一个归一化的二值侧影序列中,每一帧侧影的下半身的时间序列信号指示出了步态的频率和相位信息。假设二值化步态轮廓图Bi(x,y,t)是在一个视频序列的所有视频帧中的第i个步态周期的时刻t所提取的,则灰度级的步态能量图(GEI)[6]被定义为

(1)

图2 从视频序列中获取标准归一化二值步态图像

式中:N是在一个步态周期内的视频帧数量;t是视频序列的帧号数;x和y则是归一化的二值图像B的坐标值。图3显示了在一个步态周期内0°、54°和90°的人体样本侧影图像,最右是相应的步态能量图。它反映了侧影的主要形状和在步态周期上人体运动信息的变化,可作为步态识别的重要依据。

图3 归一化步态轮廓图像及相应步态能量图

2.2 AdaBoost人脸检测

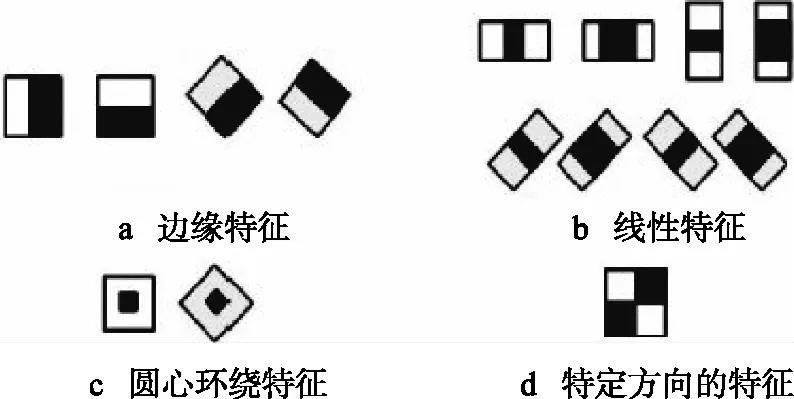

目标检测方法最初由Paul Viola提出,并由Rainer Lienhart对这一方法进行了改善。首先,利用上百幅样本图片的Haar特征进行分类器训练,得到一个级联的boosted分类器。训练样本分为正例样本和反例样本,其中正例样本是指待检测目标样本,反例样本指其他任意图片,所有的样本图片都被归一化为同样的尺寸大小。分类器训练完以后,就可以应用于输入图像中的感兴趣区域的检测。

对于每个类Haar特征,都可以生成一个分类器,其形式为

(2)

式中:x代表样本;hi(x)为第i个类Haar特征hi在样本上的取值;pi是分类方向符号;fi为由特征hi构成的分类器;θi为分类器fi的阈值。Adaboost算法的目的就是在分类器集合中寻找分类错误最小的弱分类器,即寻找参数hi,pi,θi,在反复进行多次迭代训练后,使分类错误趋近于零,最后将这些弱分类器组合成强分类器。检测到目标区域分类器输出为1,否则输出为0。为了在整幅图像中检测未知大小的目标物体,扫描程序通常需要移动调整不同比例大小的搜索窗口对图片进行几次扫描。在图像检测中,被检窗口依次通过每一级分类器,全部通过每一级分类器检测的区域即为目标区域。基础分类器是至少有两个叶结点的决策树分类器。Haar特征是基础分类器的输入,该特征可以用来描述人脸、眼睛、嘴唇、鼻子、人体、车辆等目标物体。扩展的Haar特征[7]有4种,如图4所示。

图4 扩展的Haar特征

2.3 利用Haar分类器从视频帧中获得标准化人脸图像

要从行走视频中获得标准化的人脸图像作为数据库,主要可分为3个步骤:1)利用训练好的行人全身检测Haar级联分类器对视频帧进行检测得到行人全身;2)利用训练好的人脸检测Haar级联分类器从步骤1)中所得的行人全身图像中获得正面或者侧面人脸;3)对步骤2)获得的各种尺寸的低分辨率人脸图像通过双三次插值法得到统一尺寸的较高分辨率的人脸图像,如图5所示。

图5 从视频序列中获取归一化多角度人脸图像

3 基于NMF的特征提取和决策层人脸与步态自适应融合识别

3.1 基于NMF的人脸和步态特征提取

NMF是一种新的特征提取方法,它的思想是对基矩阵引入非负约束,把一个大的非负矩阵V分解成两个非负矩阵矩阵W和H的乘积[8],即V=WH,从而提取到有意义的局部成分,克服其他子空间分解方法所出现的系数之间的正负相互抵消而使得特征削弱的现象,更好地反映局部特征,提高识别的准确率。

基于NMF的人脸和步态特征提取是:首先读入人脸和步态的训练图像数据库,得到训练图像矩阵V=[V1,V2,…,Vn],n为训练库中图像数量,列向量Vi代表一张训练图像。通过NMF变换公式V=WH得到

(3)

式中:W=[W1,W2,…,Wn]为基矩阵:H=[H1,H2,…,Hn]为系数矩阵,W的每一列Wi为一幅基图像,Hi为第i张训练图像Vi在基图像矩阵W=[W1,W2,…,Wn]上的投影后的系数,训练库中每张训练图像近似为基图像的线性组合,使用Hi代表Vi从而达到了降维和特征提取的目的,Wi则是基于NMF的基图像。

3.2 人脸和步态的决策层自适应融合方法

多特征融合技术的一个核心问题就是融合策略问题,即选择在哪个层次级别上融合的问题。根据生物特征识别的基本方法,目前多特征融合在四个层次[9]上进行,即数据层、特征层、匹配层和决策层。也有人将在较高层次融合的匹配层和决策层统称为决策层融合。

决策层融合的主要思想是分别对采集层、特征层和匹配层的处理进行评估,然后利用数据融合的方法将评估结果在匹配层进行表达,使得各层的有效性和可靠性在最后的匹配计算中得到体现,获得更加客观的识别结果。对于多生物特征的识别来说,匹配输出的结果往往是一个多维的向量,向量中的每一个成员都表示一个不同来源的匹配结果,决策层融合算法的研究目的就是在这样的一个向量空间做类内和类间的划分。本文采用的是在决策层上对两组匹配值进行自适应融合以达到最优识别效率。

对人脸和步态进行NMF特征提取之后,需要分别获得其欧氏距离匹配数组:将待测人脸或者步态图像的一维特征列向量c对基图像所形成的坐标系上进行投影S=c·W,得到投影矩阵,求出待测图像与所有n幅训练图像的欧氏距离,从而得到人脸或者步态的欧式距离匹配数组F={F1,F2,…,FN}以及G={G1,G2,…,GN}。分别得到人脸和步态距离匹配值数组之后,需要先将所得的欧氏距离数组进行归一化。本文使用线性归一化方法[10]

(4)

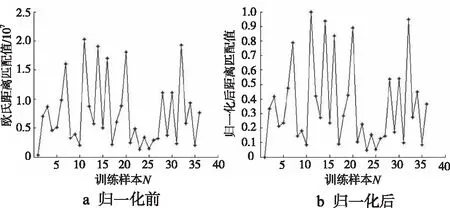

式中:soriginal定义为输出的原始匹配值;snorm为归一化之后的匹配值。由此得到归一化的匹配值数组Sf={Sf1,Sf2,…,SfN}和Sg={Sg1,Sg2,…,SgN},归一化前后的匹配值分布如图6所示,这种归一化方法可以将原始匹配数组映射到[0,1]区间中去,且不会改变数据的分布形式。

图6 不改变原来曲线的分布归一化前后的匹配值分布

在得到人脸和步态的输出匹配分数后,如何分配各个子系统所占的权重以达到最好的融合效果是整个融合系统的核心问题。而反映一个匹配分数数组曲线的主要参数就是离散度。离散程度反映了一个数组的波动大小,通常和两个参数有关,即均值μ和标准差σ,其中

(5)

(6)

式中:N为训练样本的个数。标准差的大小反映了数组的均衡性、稳定性、差异性等,标准差较大的说明各个子系统得到的匹配分数对类之间有较好的区分度。

(7)

(8)

由于本文中仅包含人脸和步态两个生物特征,n=2,可得

(9)

(10)

由于每两个人脸和步态距离匹配值数组的变化和不同,所得的匹配离散度w=μ/σ2也在发生变化,因此相对于其他方法来说,该融合方法具有很好的实时性与自适应性。

4 实验及结果分析

本实验采用中科院自动化研究所建立的CASIA步态数据库中的DatasetB提供的步态视频来提取人脸和步态的图像数据库。DatasetB是一个大规模的多角度步态视频数据库,其中共有124个人,每个人有11个视角(0°,18°,36°,…,180°),在3种行走条件下(普通条件、穿大衣、携带包裹条件)采集。实验选取了DatasetB中的前40个人在普通条件下的0°,54°,90°视角进行人脸识别和步态识别。使用之前, 对数据库中的数据进行了一个粗略的筛选, 由于光照条件和背景干扰等问题剔除了DatasetB中用于步态识别的5,28,34三个对象的视频帧和用于人脸的5,15两个对象的视频帧数据,这样保留了DatasetB中的36个对象的正面行走数据用于完成训练和测试。对于这36个对象,实验从其中每人的6个普通条件行走视频中任意选取2个视频序列,一个用于训练数据库,一个作为测试库。

本文主要利用普通行走条件下0°,54°,90°这3种角度的人脸和步态进行融合实验,分别为:0°行走视频中的人脸和0°行走视频中的步态融合,54°行走视频中的人脸和54°行走视频中的步态融合,以及双视角条件下0°行走视频中的人脸和90°行走视频中的步态融合。为了方便人脸和步态的特征融合,首先将人脸图像和步态能量图归一化成大小一致的二值化图像,人脸和步态的训练数据库和测试数据库中分别有36幅图像,如图7所示。利用NMF提取特征向量并计算出测试图像与所有训练图像降维向量的欧氏距离,并得到归一化的人脸和步态特征匹配值数组Sf={Sf1,Sf2…,SfN}和Sg={Sg1,Sg2…,SgN}。

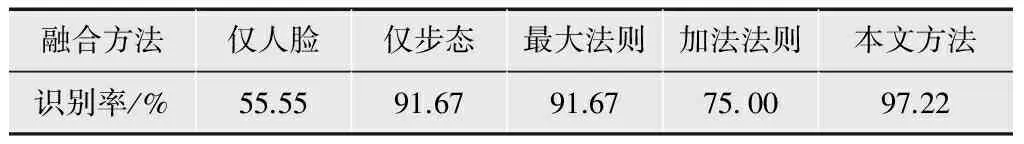

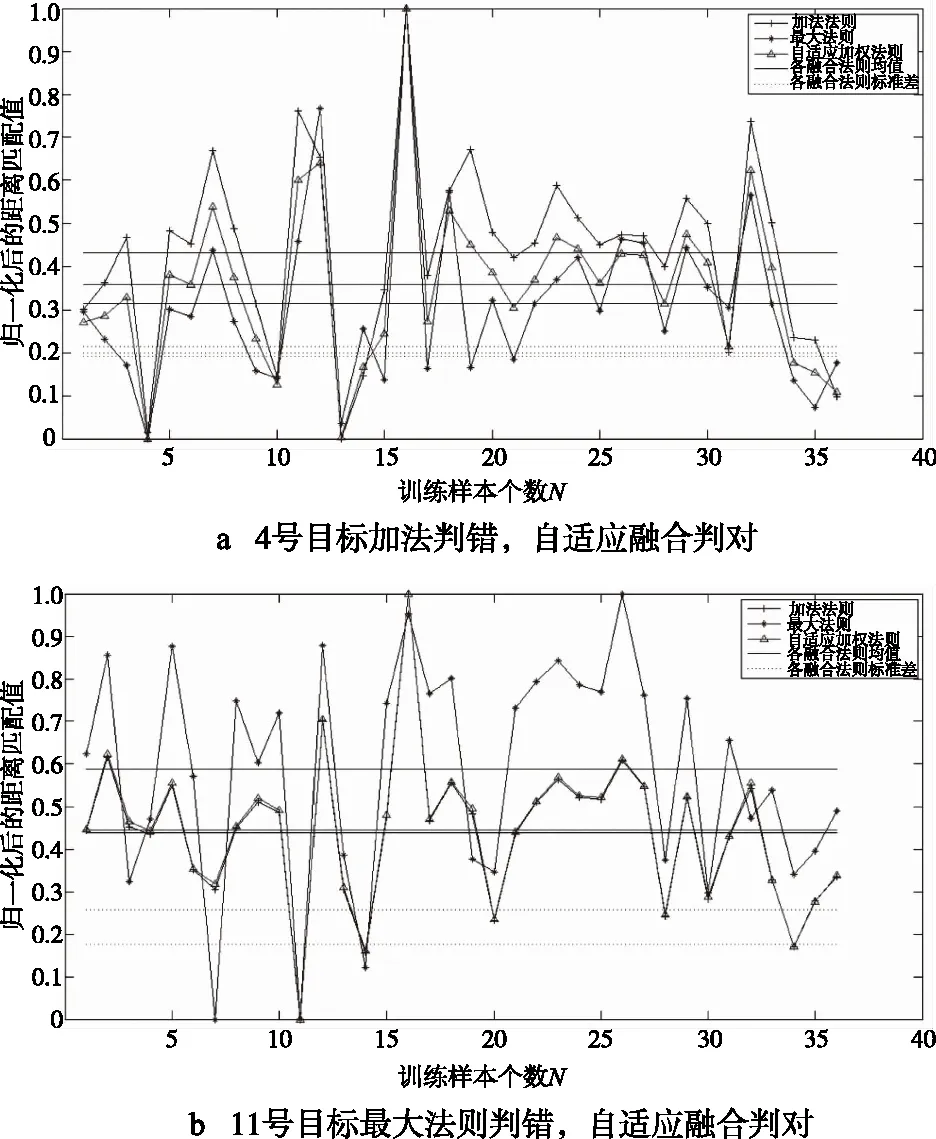

本文分别采用最大法则、加入权值的加法法则和本文所提出的自适应方法进行融合。对于加入权值的加法法则, 选择文献[3]所使用的方法,选取的权值分别为步态和人脸的识别率,表1给出了0°行走视频中人脸和步态相融合所得识别结果,表2给出了54°行走视频中人脸和步态相融合所得识别结果,表3给出了双视角下0°人脸和90°步态融合所得识别结果;图8则展示了部分自适应融合法则可以改善使用加法法则和最大法则判错的情况。

图7 部分各角度的人脸和步态训练数据库

融合方法仅人脸仅步态最大法则加法法则本文方法识别率/%69.4472.227586.1188.89

表2 54°行走视频中人脸和步态相融合所得识别率

表3 双视角下0°人脸和90°步态融合所得识别率

图8展示了双视角条件下使用各融合法则的部分判决结果,图8a显示了4号目标使用加法法则判错,自适应融合法则判对的情况;图8b显示了11号目标使用最大法则判错,自适应融合法则判对的情况。

图8 双视角条件下使用各融合法则的部分判决结果

从实验结果可以看出,无论采用何种角度组合方式和以上哪种融合方法,将人脸和步态特征融合后进行识别的识别率都不低于采用单一特征的识别率,且采用本文所提出的决策层自适应匹配融合方法通过最优权值分配和总均方误差的非线性规划过程,可以改善最大法则和加法法则的判错情况,使得识别错误率降低,具有很好的实时性和实用性。

5 结论

本文提出了一种采用视频序列中多个角度的人脸和步态进行自适应融合的身份识别方法,首先采用步态能量图对一个或多个步态周期内的人体运动信息进行描述,利用级联的Haar分类器从视频帧中检测出人脸区域,然后利用非负矩阵分解NMF提取人脸和步态特征并分别获取测试图像到训练图像库的欧式距离数组集合,在决策层利用非线性规划将每个生物特征的距离匹配值进行自适应分配权值以获得最优的联合匹配分数,达到最好的信息融合结果,由于该融合权值会随着不同的测试对象和角度发生变化,因此有一定的实时性和适应性。实验结果表明,本文提出的融合方法的识别性能要优于单一生物识别方法以及最大法则、加权法则等静态融合算法,能达到很好的信息融合效果。

[1]NIINUMA K,PARK U,JAIN A K.Soft biometric traits for continuous user authentication[J].Information Forensics and Security,2004,5(4):771-780.

[2]ZHOU XL,BHANU B.Integrating face and gait for human recognition at a distance in video[J].IEEE Trans.System Man.and Cybernetics,2007,37(5):1119-1137.

[3]李轶,明东,王璐,等.融合步态和人脸特征的远距离身份识别研究[J].仪器仪表学报,2011,32(2): 264-270.

[4]GENG Xin,WANG Liang,LI Ming, et al.Adaptive fusion of gait and face for human identification in video[J].Applications of Computer Vision,2008,7(9):1-6.

[5]李媛媛,张立峰.多传感器自适应加权融合算法及其应用研究[J].自动化与仪器仪表,2008(2):10-13 .

[6]唐春林.基于帧差能量图遗传算法的自遮挡步态识别[J].电视技术,2014,38(5):173-177.

[7]郭磊,王秋光.Adaboost人脸检测算法研究及OpenCv实现[J].哈尔滨理工大学学报,2009,14(5):123-126 .

[8]WANG Yuxiong,ZHANG Yujin.Nonnegative matrix factorization:a comprehensive review [J].IEEE Trans.Knowledge and Data Engineering,2013,25(6):1337-1351.

[9]LIU Chengjun.Learning the uncorrelated,independent, and discriminating color spaces for face recognition[J].Information Forensics and Security,2008,3(2):213-222.

[10]周斌,林喜荣.量化层多生物特征融合的最佳权值[J].清华大学学报,2008,48(2):192-195.

Adaptive Fusion of Multi-biometrics for Human Identification in Video

KONG Yinghui,CHEN Peiyao

(ElectronicsandCommunicationEngineering,NorthChinaElectricPowerUniversity,HebeiBaoding071003,China)

The purpose of multiple biometric fusion is to improve the recognition performance by utilizing their complementary.In this paper, the feature fusion recognition method of multi-view face and gait in video is studied, and a adaptive decision fusion method is proposed.The results show that the adaptive fusion features carry the most discriminating power compared to any individual biometric and other static fusion rules like MAX and SUM.

video; face; gait; adaptive; fusion

TP391.41

A

10.16280/j.videoe.2015.05.033

2014-07-12

【本文献信息】孔英会,陈佩瑶.基于视频的人脸和步态自适应融合身份识别[J].电视技术,2015,39(5).

孔英会(1965— ),女,教授,主研智能信息处理,图像处理;

陈佩瑶(1992— ),女,硕士,主研图像处理。

责任编辑:闫雯雯

——股权结构的调节效应检验