基于姿态估计的正面人脸图像合成

方三勇,周大可,曹元鹏,杨 欣

(南京航空航天大学自动化学院,南京 210006)

基于姿态估计的正面人脸图像合成

方三勇,周大可,曹元鹏,杨 欣

(南京航空航天大学自动化学院,南京 210006)

为对不同姿态下的人脸图像进行处理,提出一种基于姿态估计的正面人脸图像合成方法。利用统计建模的思想重构缺失的人脸形状和纹理。运用平均三维模型估计测试图像的姿态参数,结合压缩感知理论构建形变模型。应用稀疏形变模型理论分别重构测试人脸的三维形状和纹理,根据测试图像与重构模型生成正面人脸图像。实验结果表明,该方法能够由一幅姿态人脸图像合成出精确、自然的正脸图像,并具有较高的识别率。

正面人脸图像合成;平均三维模型;姿态估计;压缩感知;形变模型

1 概述

人脸图像处理技术作为计算机视觉和计算机图形学重要的研究方向之一,近年来成为研究的热点。但人脸图像在处理过程中普遍受到姿态、光照的限制,这给计算机理解图像带来困难。文献[1]中指出,同一个人在不同姿态、不同光照下人脸图像之间的差异,往往大于在相同姿态、相同光照下不同人的人脸图像之间的差异。为了使计算机准确地理解图像,从一张任意姿态、任意光照的人脸图像合成正常光照、正面人脸图像是解决该类问题的一个重要思路,其中以正面人脸图像合成尤为典型[2]。

正面人脸图像合成的一般思路[3]是将人脸图像中可视区域重新绘制到正面人脸区域,同时对不可见区域进行合成,再绘制到相应的正面人脸区域,其研究的方法主要包括三维的方法和二维的方法。其中三维方法的思路是通过构建三维人脸模型,对测试人脸图像进行模型参数的匹配,进而获得完整的三维人脸数据,获得正面人脸图像。最典型的方法是文献[4]提出的3DMM(3D Morphable Model),该方法只需单幅人脸图像就可以合成完备的三维人脸数据信息。3DMM方法虽然能够达到很好的实验效果,但因其匹配过程十分耗时,所以后续学者对3DMM进行改进。文献[5]采用2D+3D主动表观

模型的方法[5],可以获得较好的3D人脸形状,但是正面的纹理信息无法像3DMM那样求出。除此之外,采用二维的方法合成正面人脸图像也取得了较好的研究成果。文献[6]指出,同一人在不同视角下的人脸可以构成一个平滑的流形,且在不同视角下合成系数在视角间是保持不变的。文献[7-8]先采用CPCA-SVM技术,对测试人脸图像进行人脸姿态判定,然后根据判定的姿态信息选用对应的训练样本集进行正面人脸合成。但该方法涉及大量的特征点标定工作,且所能合成的人脸姿态也非常有限。文献[9]采用局部线性回归的方法,将人脸划分为不同的矩形区域,通过局部人脸区域的线性逼近全局的非线性,合成的图像与真实图像较为相似,但其合成的正脸图像只包含人脸中心区域。文献[10]提出通过正侧面人脸图像训练样本求解其对应的旋转矩阵,进行逆向恢复的方法求解正脸图像,但该方法只能对旋转角度在30°以内的图像进行恢复。

本文提出一种基于姿态估计的正面人脸图像合成方法。该方法通过建立平均三维人脸模型进行姿态估计,以避免3DMM方法中复杂的迭代计算;采用压缩感知理论对原型样本进行筛选,以提高形变模型的精度;将原始纹理与重建纹理相结合构建综合纹理,以保留人脸图像的细节信息。

2 基于平均三维模型的姿态估计

因为人脸图像是由三维信息投影得到的,所以采用三维模型对姿态进行估计更加准确。文献[11]提出了基于三维重建的人脸姿态估计,该方法需要正面输入人脸图像进行三维重建,利用重建的三维人脸模型对其姿态图像进行估计。笔者受该方法的启发,利用三维人脸训练样本建立平均三维人脸模型,建立二维图像与平均三维模型特征点间的对应关系,用最小二乘法对姿态角求解。利用建立特征点稠密对应的三维人脸库,得到平均三维人脸模型,将模型绕坐标轴分别旋转 α,β,γ的角度,假设旋转后的模型与测试图像姿态相同,模型上特征点由 P变为Pr:Pr(χ′,y′,z′)=R*P(χ,y,z),其中,正交旋转矩阵R为:

根据旋转公式对三维模型进行旋转,投影后建立与输入图像的对应关系,如图1所示。

图1 3D与2D图像之间特征点的匹配

通过3D到2D的投影关系,对三维坐标系进行平移以及尺度变换,将旋转后三维模型上的特征点投影到二维平面上,建立与输入图像标定点的对应关系。选取模型上明显的7个特征点,经过坐标平移和尺度变换后,记为Pi(χi,yi,zi)T,给定一张测试图像对其进行特征点标定,得到特征点坐标为Ii(χ′i,y′i)T,由于人脸图像上深度信息的缺失,通过模型到二维的投影与测试图像特征点的对应关系,得到如下超定方程:

其中,i=1,2…,7,方程写为矩阵的表达形式:A=(P1,P2,P3,P4,P5,P6,P7)T,B=(I1,I2,I3,I4,I5,I6,I7)T,采用最小二乘法进行求解,求得一组向量 δ=(R11,R12,R13;R21,R22,R23)=(ATA)-1ATB,进而求得旋转的姿态角度 α,β,γ。

3 形变模型理论

3.1 形变模型及稀疏形变模型

形变模型的方法主要包括形变模型的建立和测试图像与模型匹配2个部分。其中,涉及3维人脸数据归一化[12]处理、组合模型的建立和测试图像与模型匹配等主要步骤。规范化后包含m个顶点的三维人脸形状和纹理向量表示为:

其中,(χik,yik,zik)和(rik,gik,bik)分别是第k点的三维坐标和像素值。设包含n个3维人脸数据构成的原型样本集矩阵为:

那么给定任意一张新的三维人脸,可以通过原型样本表示为:

量的目的。设矩阵 P=(P1,P2,…,Pn′),Q=(q1,q2,…,qn′)是前n′个最大特征值对应的特征向量(主成分)构成的特征向量矩阵,式(3)和式(4)可改写为:

将人脸重建的问题转化为求解目标函数最小化的数学问题,采用牛顿迭代法进行求解的计算量很大。文献[13]中提出了稀疏形变的方法,通过选取少数的特征点进行匹配大大地简化了计算。对模型上选取的 k个特征点并进行旋转和投影变换,即:其中s—h,对ph进行SVD分解,ph=UΛVT,采用贝叶斯最大后验概率求得最优解得到:

根据求得的形状组合系数,得到合成的正面人脸形状:

采用类似的求解方法求得形变模型中纹理的组合系数β得到合成纹理:

3.2 基于压缩感知的样本筛选及形变模型

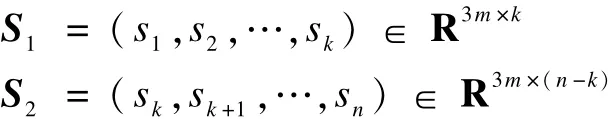

通过对原型样本进行筛选,可以构建更加精准的模型。对于足够大的原型样本数据S,将其分为与测试图像比较相似的样本子集S1和原型样本S中余下的子集S2。分别记为:

且k=n。

测试图像表达为:

其中,向量C=[c1,c2,…,ck,0,…,0]T∈Rn,可知测试图像可以由原型样本集稀疏表示。若能求得该稀疏解,就可对原型样本集进行筛选,为此,需要求解如下优化问题:

可以采用压缩感知理论求解该优化问题,根据式(8)中的选点和变换操作,式(13)的优化问题等价于:

采用正交匹配追踪算法[14]进行求解。对于求得的稀疏解C,系数越大说明测试图像与原型样本的相似性越大,反之越小。所以,按C的绝对值由大到小排列,选取前面m′个分量所对应的样本作为新的原型样本。则经过筛选之后新的原型样本集为S1=(s1,s2,…,s′m)∈R3m×m′,则任一新的人脸可表示为:

其中,P=(si-s—,si+1-s—,…,sm′-s—)∈R3m×m′。为减少计算量,参照稀疏形变模型的方法的求解思路,选取少数特征点进行匹配,由式(15)和式(8),直接得到,其中伪逆矩阵为了避免特征点过拟合造成严重的形变,对求得的解加入扰动因子为:

3.3 形状和纹理建模

对测试人脸图像进行简单的裁剪、对齐、统一坐标系等预处理作,并对测试进行眼睛、鼻子、嘴部附近特征点的标定并根据上述形变模型理论对人脸形状进行合成。为了得到相同维数的人脸像素信息,必须建立图像间像素的对应关系。本文对人脸进行三角剖分,将人脸Delaunay(德劳内)三角化,经三角剖分后,所有的人脸具有相同的拓扑结构,如图2所示。

图2 人脸的三角剖分结果

在每个三角片内人脸的像素点数目是不同的,因此,将三角面片形变到平均人脸上,就实现了整个人脸到平均人脸的对应。由三角面片T′形变到T的过程如图3所示。

图3 三角面片之间的映射关系

其中,P′1~P′3是样本人脸中一个三角面片的3个顶点,在该三角面片内的每一顶点P′都可以用该三角面片的3个顶点来进行表达,如式(17)所示:

假设样本三角面片顶点的坐标为:

则:

求得s,t后,对齐到平均人脸三角面内点为:

这样即可建立人脸图像间像素的对应关系,利用形变模型理论合成正面人脸形状和正面人脸纹理,便可合成正面人脸图像。

3.4 综合纹理生成

形变模型方法是基于统计学原理,有效保留了人脸共性特征,但不能够保留测试的某些细节特征,所以提出利用测试纹理与合成纹理相结合,生成综合纹理的方法。结合的方式如下:如果在正脸图像中可见,而在测试图像中不可见的纹理,则采用重建的纹理;如果在正脸图像和测试图像中均可见的部分,主要采用测试图像的纹理。生成的综合纹理可以通过式(20)进行求解:

gi(χ,y)=wi(χ,y)ti(χ,y)+(1-wi(χ,y))t0(χ,y)(20)其中,ti(χ,y),t0(χ,y)分别代表在点(χ,y)处合成的像素值与测试图像的像素值;wi代表合成纹理中点(χ,y)的权重;这样合成的正面人脸图像既保留了人脸共性的信息,又能使某些局部的信息得到有效的显示。将三角剖分后的测试拉伸到合成人脸形状对应的三角面上,假设测试上某一面积为Ari的三角形拉伸到对应面积为Ai的正面三角形上,计算面积Ari与Ai间比值的大小以确定wi(χ,y):

在三角形里点的综合的灰度值便可以根据上述确定的权重得到。三角形从侧面拉伸到正面时形变越大则采用合成纹理信息越多,反之采用原来的纹理信息越多。最后,将得到的综合人脸纹理映射到正面人脸形状上,得到最终的正面人脸图像。

4 实验结果及评价

4.1 实验结果

本文实验以北京工业大学BJUT-3D Face Database[15](包含500张三维人脸的形状和纹理数据,男女各250人)中部分数据作为训练样本。测试样本为该库其余样本旋转投影下的人脸及部分CAS-PEAL[16]二维姿态人脸图像。实验分为2个部分:第1部分对测试进行姿态估计;第2部分是对估计出姿态角的进行正面人脸图像合成。测试样本分为库内样本和库外样本。对三维人脸数据进行归一化处理后,得到规范化的三维人脸数据。从中筛选100张包含纹理信息的三维人脸作为训练样本,其中男女各50张,建立平均三维人脸模型。对测试图像进行预处理之后标定40个特征点,如图4所示。采用其中的内外眼角点、鼻尖点,和嘴角点与三位平均模型中对应的特征点进行姿态估计。在得到姿态角后,用这40个标定点合成正面人脸形状。为了获得对应的纹理信息,根据合成的形状再标定12个轮廓点,进行正面人脸纹理的合成。

图4 特征点标定

采用BJUT-3D Face Database中测试样本投影和CAS-PEAL库里的进行姿态估计和正面合成的联合实验,结果如图5~图8所示,图5和图8的具体数据如表1和表2所示,在表中,图像编号代表从左至右的图像顺序。

图5 3D测试样本投影图像姿态估计结果

图6 3D测试样本投影图像的正脸合成结果

图7 2D测试样本姿态估计结果

图8 CAS-PEAL测试样本的正脸合成结果

表1 3D测试样本姿态估计的真实值/估计值

表2 2D测试样本姿态估计的真实值/估计值

图5和图7是对测试样本进行姿态角估计的结果。图6和图8测试分别为采用BJUT-3D Face Database里任意一张三维人脸的投影图,以及CASPEAL人脸库里任意一张姿态图像进行合成的结果。

4.2 算法评价

为对算法进一步进行定量分析,本文将FRB[4],ROF[8],LLR[9]合成方法与本文方法进行比较。人脸识别率虽然是反映正面人脸图像合成算法性能的一个有利指标,但其受到实验设置及识别方法等因素的影响,所以,本文还综合了合成图像的视角范围及合成图像质量等指标进行综合分析。其中人脸的识别实验是在CAS-PEAL人脸库上进行,选取其中POSE子集中30个人的6种不同姿态进行正脸合成,通过提取合成人脸图像的LBP特征进行识别验证。图像质量是基于对不同合成方法所得到的正面人脸图像主观评价得到的,具体实施是将不同方法合成的正面人脸图像混合在一起后,让25个人对合成的图像按照相似性及自然性从0.1,0.2,…,1这10个分数值进行打分。对算法性能定量评价的结果如表3所示。

表3 3种正面人脸图像合成方法性能评估

5 结束语

本文提出一种高精度的正面人脸图像合成方法。该方法利用三维人脸库的信息,构建不同姿态下的二维人脸样本图像,避免了二维姿态样本不易获得且需对样本进行标点的问题;采用压缩感知理论对原型样本筛选,构建更精确的形变模型;将原始纹理与重建纹理相结合构建综合纹理,有效保留了人脸图像的细节信息。但本文方法还存在以下不足:当输入图像旋转的角度过大(超过45°)时,合成的效果将会变差;没有充分考虑光照变化对合成效果的影响。因此,解决大姿态角度的旋转和光照问题,是下一步研究工作的重点。

[1] Zhao W,Chellappa R,Rosenfeld A,et al.Face Recognition:A Literature Survey[J].ACM Computing Survey,2003,35(4):399-458.

[2] 赵 林,高新波,田春娜.正面人脸图像合成方法综述[J].中国图象图形学报,2013,18(1):1-10.

[3] Vetter T.Synthesis of Novel Views from a Simple Face Image[J].International Journal of Computer Vision,1998,28(2):103-116.

[4] Blanz V,Grother P,Philips P J,et al.Face Recognition Based on Frontal Views Generated from Non-frontal Image[C]//Proceed-ings of IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Los Alamitos,USA:IEEE Press,2005:454-461.[5] Xiao Jing,Baker S.Real-time Combined 2D+3D Active Appearance Models[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition.New York,USA:IEEE Press,2004:535-542.

[6] Huang Xinyu,Gao Jizhou,Cheung S S,et al.Manifold Estimation in View-based Feature Space for Face Synthesis Across Poses[C]//Proceedings of the 9th Asian Conference on Computer Vision.Heidelberg,Germ any:Springer-Verlag,2010:37-47.

[7] Li Yingchun.Face Pose Estimation and Synthesis by 2D Morphable Model[C]//Proceedings of International Conference on Computational Intelligence and Security. Heidelberg,Germany:Springer-Verlag,2007:1001-1008.

[8] 杜 成,苏光大,林行刚,等.多姿态人脸图像合成[J].光电子·激光,2005,15(12):1498-1501.

[9] Chai Xiujuan.Locally Linear Regression for Poseinvariant Face Recogni-tion[J].IEEE Transactions on Image Processing,2007,16(7):1716-1725.

[10] Li Xi,Takahashi T,Deguchi D,et al.Virtual View Generation Using Clustering Based Local View Transition Model[C]//Proceedings of the 11th International Conference on Computer Vision.Heidelberg,Germ any:Springer-Verlag,2013:260-271.

[11] 熊黎丽,王国胤.基于三维重建的人脸姿态估计[J].重庆邮电大学学报:自然科学版,2010,22(3):375-380.

[12] 胡阳明,周大可,鹿 乐.基于改进ASM的三维人脸自动对齐算法[J].计算机工程,2013,39(3):250-253.

[13] Blanz V.Reconstructing the Complete 3D Shape of Faces from Partial Information[J].Informations Technikund Technische Informatik,2002,44(6):295-302.

[14] Donoho D L.Fast Solution of l1-norm Minimization Problems When the Solution May Be Sparse[J].IEEE Transactions on Information Theory,2008,54(11):4789-4812.

[15] 尹宝才.BJUT-3D三维人脸数据库及其处理技术[J].计算机研究与发展,2009,46(6):1009-1018.

[16] 张晓华,山世光,曹 波,等.CAS-PEAL大规模中国人脸图像数据库及其基本评测介绍[J].计算机辅助设计与图形学学报,2005,17(1):9-17.

编辑 金胡考

Frontal Face Image Synthesis Based on Pose Estimation

FANG Sanyong,ZHOU Dake,CAO Yuanpeng,YANG Xin

(College of Automation Engineering,Nanjing University of Aeronautics and Astronautics,Nanjing 210006,China)

In order to process the face image in different poses,this paper proposes a frontal face image synthesis method based on pose estimation.The method is based on the idea of statistical modeling to reconstruct the missing face shape and texture.Firstly,3D average model is applied to estimate the pose parameters of the test face image.Compressed sensing theory is used to filter prototype samples and then a more accurate model of deformation is built up.Secondly,the test face image is separately expressed by texture vector and shape vector.The deformation model theory is used to reconstruct front texture and shape.Finally,synthesis texture is produced according to the original texture and reconstructed texture.Experimental result shows that this method can be used to synthesize natural frontal face image from non-frontal face image with effectiveness and higher recognition rate.

frontal face image synthesis;average 3D model;pose estimation;compressed sensing;deformable modelDO I:10.3969/j.issn.1000-3428.2015.10.045

方三勇,周大可,曹元鹏,等.基于姿态估计的正面人脸图像合成[J].计算机工程,2015,41(10):240-244,249.

英文引用格式:Fang Sanyong,Zhou Dake,Cao Yuanpeng,et al.Frontal Face Image Synthesis Based on Pose Estimation[J].Computer Engineering,2015,41(10):240-244,249.

1000-3428(2015)10-0240-05

A

TP18

国家自然科学基金资助项目(61172135);南京航空航天大学研究生创新基地(实验室)开放基金资助项目(kfjj20130210)。

方三勇(1989-),男,硕士研究生,主研方向:图像处理,模式识别;周大可,副教授、博士;曹元鹏,硕士研究生;杨 欣,副教授、博士。

2014-11-03

2014-11-28E-mail:fangsnyong@163.com