基于局部敏感直方图的分布场跟踪算法研究

翟亮亮, 宁纪锋

(西北农林科技大学 信息工程学院,陕西 杨凌 712100)

目标跟踪是计算机视觉领域一个重要的研究方向,在监控系统、运动分析、行为识别和人机交互等领域有着广泛的应用[1-2]。由于跟踪过程中目标的旋转、变形、遮挡及光照变化等复杂因素的影响,视觉跟踪技术一直是值得深入研究的问题。目标跟踪主要有基于主动轮廓的跟踪、基于特征匹配的跟踪及基于区域的跟踪[3]等。

目标表面模型是影响目标跟踪算法性能最重要的因素,因此得到了广泛的关注。经典的Mean Shift[4-5]采用颜色直方图对目标建模,虽然对于尺度和形状变化具有一定的鲁棒性,但丢失了目标的空间分布信息。因此,当目标与背景在颜色分布上具有较高相似性时,该方法性能下降。文献[6]将基于Haar小波的AdaBoost算法引入到人脸检测中,极大地提高了人脸检测的准确性;文献[7]提出了利用协方差矩阵描述目标的方法,并将协方差矩阵应用于目标检测和跟踪、纹理分类中,但该方法实验效果并不理想;文献[8]将Harr-llike特征引入目标表示,采用包的形式组织样本,提出多示例目标跟踪方法,取得了较好的跟踪结果;文献[9]提出利用多特征进行融合后得到的混合特征表示目标,也取得了较好的跟踪结果。但是,Haar-Like特征对边缘、线段比较敏感。最近提出的分布场目标表示方法[10]通过将目标区域划分成层,保持目标空间结构;同时,在空间域和特征域对层进行平滑,克服由于光照、旋转、视点和遮挡等变化造成表示目标表面模型的不确定性,对一些具有挑战性的视频序列取得了良好的性能。但是,分布场跟踪算法对参数和光照的变化比较敏感,限制了其应用。

文献[11]提出局部敏感直方图描述子方法,并通过统计像素及其邻域的相关性得到图像的特征描述,其对图像的光照具有不变性,将其用于目标表示,得到了较好的跟踪结果。作为目标空间结构的表示方法,局部敏感直方图与分布场模型具有类似性,两者的不同之处在于局部敏感直方图对像素点所在层赋予更大的权重,能够更好保护目标空间结构。因此,本文提出了局部敏感直方图分布场跟踪算法,利用敏感直方图来构造分布场表示目标,并将其应用于目标跟踪,取得了比原始分布场和局部敏感直方图更好的跟踪结果。

1 相关算法简介

1.1 分布场

分布场是由各个像素点的概率向量组成的概率分布,定义了在特定条件下,像素值在该位置的概率。设灰度图像I的维度为M×N,则图像的分布场为M×N×256维概率矩阵d。将像素值等分为B个区间,d可以定义为:

其中,I(i,j)为灰度图像I的第i行、第j列的像素值,灰度范围等分成b个区间,k∈{1,2,3,…,b},分布场d满足1。得到的分布场不会丢失空间信息。

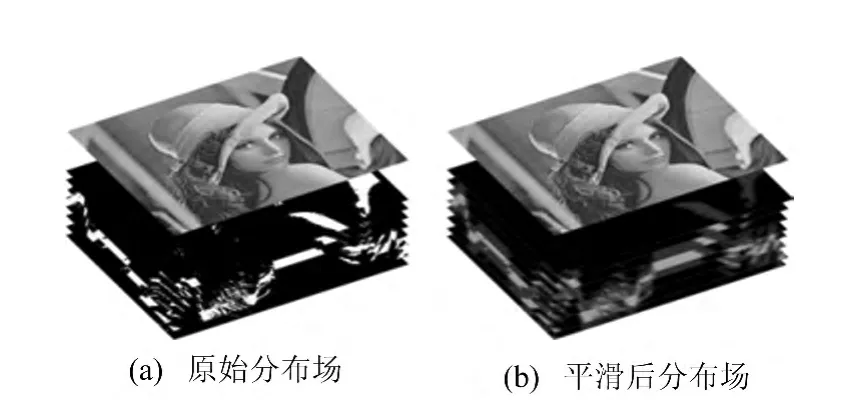

将图像“Lena”转化为分布场的结果如图1a所示,得到图像的分布场后,需要在图像空间和特征空间分别进行平滑,结果如图1b所示。

平滑的目的是在不损害原始图像亮度信息的同时引入不确定性,使其对各种复杂条件具有适应性。首先,进行空间域平滑,用二维高斯滤波器对分布场的每一层进行卷积,可以将其表示为:

其中,hσs为一个标准差为σs的二维高斯核;*为卷积运算符。可以发现卷积后的分布场ds仍满足1,所以仍可将其看成分布场。空间域平滑表示在图像x和y方向上进行平滑,平滑后引入了位置不确定性。例如,当某一层的某一点处的值不为0时,此点附近可能存在目标,再进行特征域平滑,可表示为:

其中,hσf为一个标准差为σf的一维高斯核。平滑后允许分布场模型解释亚像素运动、阴影、亮度变化等,从而得到最终的分布场。

图1 分布场举例

在分布场中,利用L1距离来衡量2个分布场之间的相似性,计算公式为:

其中,d1和d2为2个分布场。

分布场原始目标跟踪算法已经取得较好的结果,但是它的参数较多,而且对参数比较敏感。因此,本文提出了一种改进的分布场,在一定程度上解决了上述问题。

1.2 局部敏感直方图

局部敏感直方图是将一个像素及邻域的灰度值映射为一个向量。一幅图像的局部敏感直方图是一个三维矩阵,其构建过程如下:

其中,Hp(b)为在第b层上局部敏感直方图在像素点p处的值;Iq为在像素点q的像素值;将像素值区间[0,255]等分成B个区间,b为其中某一个区间。如果Iq∈b,则Q(Iq,b)=1,否则Q(Iq,b)=0。需要对Hp(b)进行归一化,满足通过(6)式,可得具有光照不变性的局部敏感直方图特征。

其中,bp为像素点p所属层;Lp为具有光照不变性的局部敏感直方图特征。Lp不仅考虑到同一层上距离不同,附近各像素点对像素点p的贡献不同;同时也考虑了在不同层上,各层离像素所在层bp远近不同,对像素点p的贡献也不同。

2 基于局部敏感直方图的分布场跟踪

2.1 基于局部敏感直方图的分布场目标表示

从分布场和局部敏感直方图的定义可以看出,两者均用于表示目标的空间结构,但它们在形式上具有一定的相似性。首先,经过图像空间和特征空间平滑后的分布场特征允许分布场模型解释亚像素运动、阴影、亮度变化等。而局部敏感直方图通过(5)式和 (6)式进行了图像空间域和特征空间域的平滑。其次,分布场特征和局部敏感直方图特征都是通过对原始图像分层,最后得到基于层的特征。基于局部敏感直方图的分布场推导过程如下。

设目标区域为M×N维灰度图像,将原始图像的每行和每列都看成一幅子图像,就可以按照(5)式进行计算得到Hp。Hp为新型分布场。

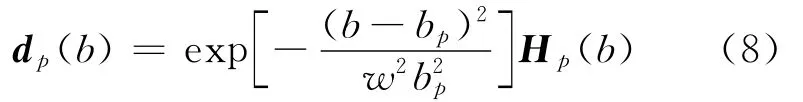

为了得到比较理想的跟踪结果,需要考虑层与层之间的关系,离目标位置所在层较近的层对跟踪结果的影响比较大,反之影响比较小,其表达式为:

其中,exp[-(b-bp)2/(w2b2p)]为以bp为中位数和标准差的高斯分布;w为分层的宽度。当bp较大时,目标位置像素值比较大,可以适当扩大周围层对跟踪结果的影响;反之,需要减少周围层对结果的影响。这都是通过目标位置的像素值控制高斯分布的标准差自动确定的,但是由于(8)式分母可能为0,所以需对 (8)式进行变动,即

由于Ip=wbp,通过 (7)式可得:

其中,dp(b)为最终得到的新型分布场。

通过(9)式,每个像素得到一个含有B个元素的向量,该向量表示以该点为中心的加权结构特征,离点p所在层较近Hp(b)有更大的权重,离点p所在层较远的Hp(b)有更小的权重。而分布场只是在空间域和特征域进行平滑。

所以,局部敏感直方图具有分布场特征保留目标空间结构的优点。此外,与分布场特征相比,局部敏感直方图不仅考虑到目标位置周围像素点对目标跟踪结果的贡献不同,同时也考虑到每一层特征对目标跟踪结果的贡献不同。所以可将局部敏感直方图看作是一种新型的分布场构造方式。本文将其应用于目标跟踪,分析其跟踪性能。

2.2 算法详述

利用(9)式得到的分布场作为外观模型,通过L1距离衡量当前帧目标位置的分布场与下一帧的潜在目标位置的相似度,如(4)式。与原始的分布场跟踪类似,本文提出的跟踪算法采用梯度下降法来进行搜索。目标模型的更新公式如下:

其中,λ为学习率。

输入:视频序列V;视频目标T(x,y,w,h),其中,(x,y)为矩形框左上角的坐标,w、h分别为目标的宽和高;控制权重的参数α;分布场层数B;搜索半径R;学习率λ。

输出:目标在视频中每一帧图像中的位置(x,y)。

具体步骤如下:

(1)求第1帧图像局部敏感直方图分布场d1。

(2)截取d1中的对应目标区域的部分dT。

(3)对于f=2:|V|,以目标T为中心,以R为搜索半径在f上截取将要进行搜索区域。

(4)对Z求局部敏感直方图分布场dZ。

(5)计算。

(6)结束。

3 实验及结果分析

本文提出的算法选择了有挑战性的10个视频序列来验证其性能,这些视频基本涵盖了目标跟踪中的有代表性的难题,如光照变化、遮挡、旋转、形变等。为了比较,本文选择了目前对上述视频序列跟踪效果良好的其他3种跟踪算法,分别为多示例跟踪算法、原始的分布场跟踪算法以及局部敏感直方图跟踪算法。

本文从跟踪成功率和跟踪结果与真实位置的距离来衡量跟踪结果,将提出的跟踪算法结果与其他3种算法作对比。对于这10个视频,多示例跟踪算法、原始的分布场跟踪算法和局部敏感直方图跟踪算法中每个视频序列各采用一组最佳参数,而本文提出的算法对于这10个视频固定地采用一组最佳参数来对比实验结果。

3.1 实验环境

本实验在Microsoft Windows XP系统下完成,实验运行环境为Matlab R2009a,计算机配置为:Inter (R)Core(TM)i3-2130.1.59GHz CPU,3.47GB RAM。

3.2 实验参数

对所有的视频,本文提出的局部敏感直方图分布场跟踪算法采用一组固定的参数进行测试,以检验该算法的鲁棒性。参数设置如下:

学习率λ=0.95,权重参数α=0.06,分层参数B=64,搜索半径为30。

对于多示例跟踪算法、分布场跟踪算法和局部敏感直方图跟踪算法,本文选择固定的最佳的一组参数进行测试,便于与提出的算法作对比。

3.3 结果分析

对于跟踪结果的成功率,采取以下判断方式:

如果(A∩B)/(A∪B)>0.5,判断跟踪成功。其中,A为跟踪结果区域;B为目标真实区域。4种跟踪方法的跟踪准确率、跟踪结果与实际目标位置间的距离误差见表1所列。表1中及下面有关图中,MIL为多示例跟踪算法;DF为分布场跟踪算法;LSH为局部敏感直方图跟踪算法;LSH-DF为本文提出的局部敏感直方图分布场跟踪算法。从表1可以看出,在10个视频序列中,本文算法有8个视频的准确率达到了最佳效果,2个达到次佳效果;由距离误差可以看出,在10个视频序列中,本文的算法有6个视频达到了最佳效果,3个达到次佳效果。表1表明,无论从参数鲁棒性还是跟踪效果上,本文算法的跟踪效果都要好于其他3种跟踪算法。

表1 不同算法的跟踪准确率、跟踪结果与实际目标位置间的距离误差

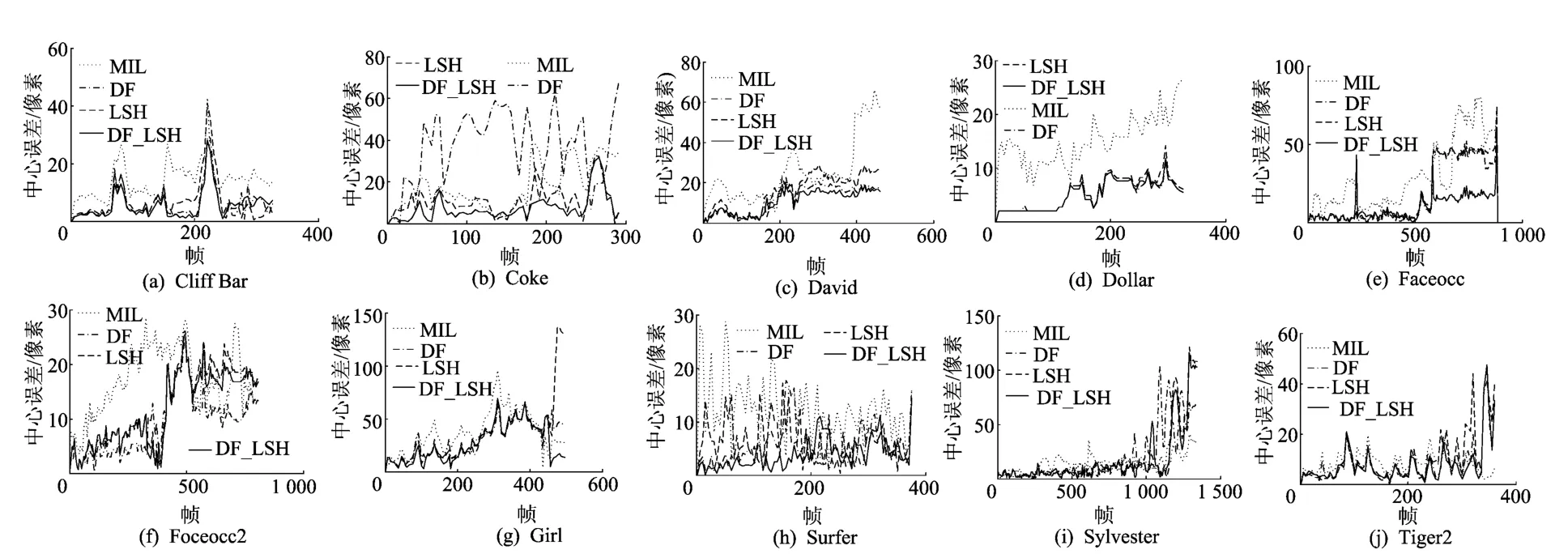

跟踪结果的中心误差如图2所示,从图2可以看出,本文提出的算法整体上优于其他3种算法。视频的部分关键帧跟踪结果如图3~图5所示。

图2 视频中心误差图

图3 视频Cliff Bar和Coke跟踪结果展示

图4 视频David、Dollar、Faceocc、Faceocc2、Girl及Surfer跟踪结果展示

Cliff Bar视频的主要挑战在于目标发生缩放和旋转。图3中的Cliff Bar在130帧发生旋转,多示例跟踪算法适应性差,导致漂移,这是由于算法对旋转比较敏感。

Coke视频的主要挑战在于快速运动中引起的目标模糊、光照变化、旋转以及部分的、完全的遮挡。图3中的Coke在55帧时光照变化明显,导致多示例跟踪算法结果和分布场跟踪算法结果产生漂移,这是因为多示例跟踪算法和分布场跟踪算法对光照不够鲁棒。

在视频David中,背景光照发生变化,目标局部发生变化,增加了跟踪难度。图4中的David在90帧时光照发生明显变化,多示例跟踪算法的结果产生漂移,这是由于多示例跟踪算法对光照不够鲁棒造成的。

在视频Dollar中,目标局部发生变化,并且视频中出现和目标非常相似的背景,增加了跟踪难度。图4中的Dollar在50帧时目标发生局部变化,多示例跟踪算法的结果产生漂移,这是由于多示例跟踪算法对遮挡不够鲁棒造成的。

Girl视频的主要挑战在于目标旋转以及部分遮挡。图4中的Girl在85帧左右,目标发生旋转,多示例跟踪算法和分布场跟踪算法结果都发生漂移,是由于多示例跟踪算法和分布场跟踪算法对遮挡不够鲁棒造成的;在500帧左右,局部敏感直方图算法完全丢失目标,是由于局部敏感直方图算法对大面积的遮挡不够鲁棒造成的。

Faceocc视频和Faceocc2视频的主要挑战在于目标的较大部分被长时间遮挡。图4中的Faceocc在85帧左右发生遮挡,多示例跟踪算法结果产生漂移,在615帧左右发生遮挡,分布场算法产生漂移,这是由于多示例跟踪算法和分布场跟踪算法对遮挡不够鲁棒造成的。Faceocc2在155帧发生遮挡,导致多示例跟踪算法结果发生漂移,是由于多示例跟踪算法对遮挡不够鲁棒造成的。

在视频Surfer中,目标发生了旋转,增加了跟踪的难度。图4中的Surfer在210帧发生旋转,导致局部敏感直方图算法、多示例跟踪算法和分布场算法结果发生漂移,这是由于局部敏感直方图等3种算法对旋转不够鲁棒造成的。

在视频Sylvester中,目标光照发生变化,并且产生旋转。图5中的Sylvester在610帧发生旋转,导致多示例跟踪算法和分布场跟踪算法结果发生漂移,这是由于多示例跟踪算法对旋转不够鲁棒造成的。

图5 视频Sylvester、Tiger2跟踪结果展示

Tiger2视频的主要挑战在于目标频繁遮挡和旋转。图5中的Tiger2在305帧被遮挡并发生旋转,导致多示例跟踪算法和局部敏感直方图算法结果发生漂移,这是由于局部敏感直方图算法和多示例跟踪算法对遮挡和旋转不够鲁棒造成的。

从以上分析可以看出,Coke、David、Sylvester视频的光照变化都比较明显,但是本文算法得到了较好的结果。对于其他的视频,本文算法也取得了比较好的结果。综上所述,本文提出的局部敏感直方图分布场跟踪算法在跟踪准确性方面和鲁棒性方面都要优于其他3种算法。

4 结束语

根据局部敏感直方图与分布场在表示目标空间结构上的相似性,本文提出采用局部敏感直方图作为分布场的一种新构建方式来表示目标,并将其应用于目标跟踪应用中。对10个具有挑战性的视频序列进行实验,结果表明,与其他跟踪算法相比,本文提出的局部敏感直方图分布场跟踪算法在一组固定参数的设置下,对目标运动过程中的光照、视点变化、尺度变化和遮挡等都具有良好的鲁棒性,得到了最优的跟踪结果。本文将进一步探讨局部敏感直方图和分布场模型间的关系,以提出更好的跟踪方法。

[1] Yilmaz A,Javed O,Shah M.Object Tracking:a survey[J].ACM Computing Surveys,2006,38(4):13.

[2] Zhang Kaihua,Song Huihui.Real-time visual trackingvia online weighted multiple instance learning[J].Pattern Recognition 2013,46(1):397-411.

[3] Ning Jifeng,Zhang Lei,Zhang D,et al.Robust mean shift tracking with corrected background-weighted histogram[J].IET Computer Vision,2012,6(1):62-69.

[4] Comaniciu D,Ramesh V,Meer P.Kernel-based object tracking[J].IEEE Trans Pattern Anal Machine Intell,2003,25(5):564-577.

[5] Ning Jifeng,Zhang Lei,Zhang D,et al.Robust mean stift tracking with corrected background-weighted histogram[J].IET Computer Vision,2012,6(1):62-69.

[6] Viola P,Jones M.Rapid object detection using a boosted cascade of simple features[C]//IEEE Conference on Computer Vision and Pattern Recognition,2001:511-518.

[7] Tuzel O,Porikli F,Meer P.Region covariance:a fast descriptor for detection and classification[C]//Computer Vision-ECCV,2006:589-600.

[8] Babenko B,Yang M,Belongie S.Robust object tracking with online multiple instance learning[J].IEEE Transaction on Pattern Analysis and Machine Intelligence,2011,33:1619-1632.

[9] 李 菊,余 烨,戴 欢,等.基于颜色和LBP多特征的mean shift的跟踪算法[J].合肥工业大学学报:自然科学版,2014,37(5):578-581.

[10] Sevilla-Lara L,Learned-Miller E.Distribution fields for tracking[C]//IEEE Conference on Computer Vision and Pattern Recognition,2012:1910-1917.

[11] He Shengfeng,Yang Qingxiong,Rynson W,et al.Visual tracking via locality sensitive histograms[C]//IEEE Conference on Computer Vision and Pattern Recognition,2013:2427-2434.

- 合肥工业大学学报(自然科学版)的其它文章

- 强降雨激励下松散岩堆路堑边坡稳定性分析

- 斜拉桥拱塔大缩尺比模型试验研究