NSCT域内基于自适应PCNN的红外与可见光图像融合方法

郝文超,贾 年

(西华大学无线电管理技术研究中心,四川 成都 610039)

图像融合是用特定的算法对多个不同模式的图像传感器在同一时刻或同一传感器在不同时刻获得的同一场景的多幅图像或图像序列加以处理,综合生成满足某种应用需要、具有更多信息的场景解释的过程。它在地球遥感、安全监控、智能交通、医学图像处理和军事侦查等领域有着广泛应用。

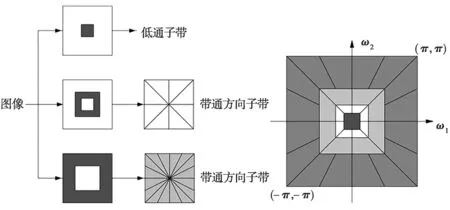

根据对信息抽象程度的不同,图像融合可分为像素级融合、特征级融合和决策级融合3个层次。像素级图像融合是高层次图像融合的基础。该层次的融合方法大致分为基于空间域的图像融合和基于变换域的图像融合2大类。基于变换域的图像融合算法是目前研究的热点,这些算法大部分是基于多尺度分解的。按采用的多尺度分解方法不同可分为传统的基于金字塔变换的图像融合算法和目前研究比较多的基于小波变换的图像融合算法,然而由一维小波张成的二维可分离小波只具有有限的方向,即水平、垂直、对角,不能很好地表达二维图像的边缘及线状特征等的线、面奇异性。Contourlet变换[1]是一种离散图像的多方向、多尺度计算框架。它不仅具有小波变换的多分辨率和时频局部性特点,还具有高度的方向性和各向异性;但由于变换过程中需要对图像进行下采样操作,因此不具备平移不变性,在图像处理中会产生伪Gibbs现象,导致图像失真。为此,A. L. Da Cunha等[2]基于Contourlet变换和非下采样的思想,提出一种具有平移不变性的Contourlet变换——非下采样Contourlet变换(nonsubsampled contourlet transform,NSCT)。

脉冲耦合神经网络[3](pulse coupled neural networks,PCNN)是R. Eckhorn等在研究猫的大脑皮层的视觉区神经元信号传导特性时,提出的展示神经元同步脉冲发放现象的神经网络模型。与BP神经网络和Kohonen神经网络不同,PCNN为单层模型神经网络,不需要学习或者训练,就可实现图像分割、模式识别和目标分类等,因此非常适用于实时图像处理环境。文献[4]借助该网络实现图像融合以提高目标的识别率,并论证了PCNN神经元的点火频率与图像灰度的关系,证实了PCNN用于图像融合的可行性。

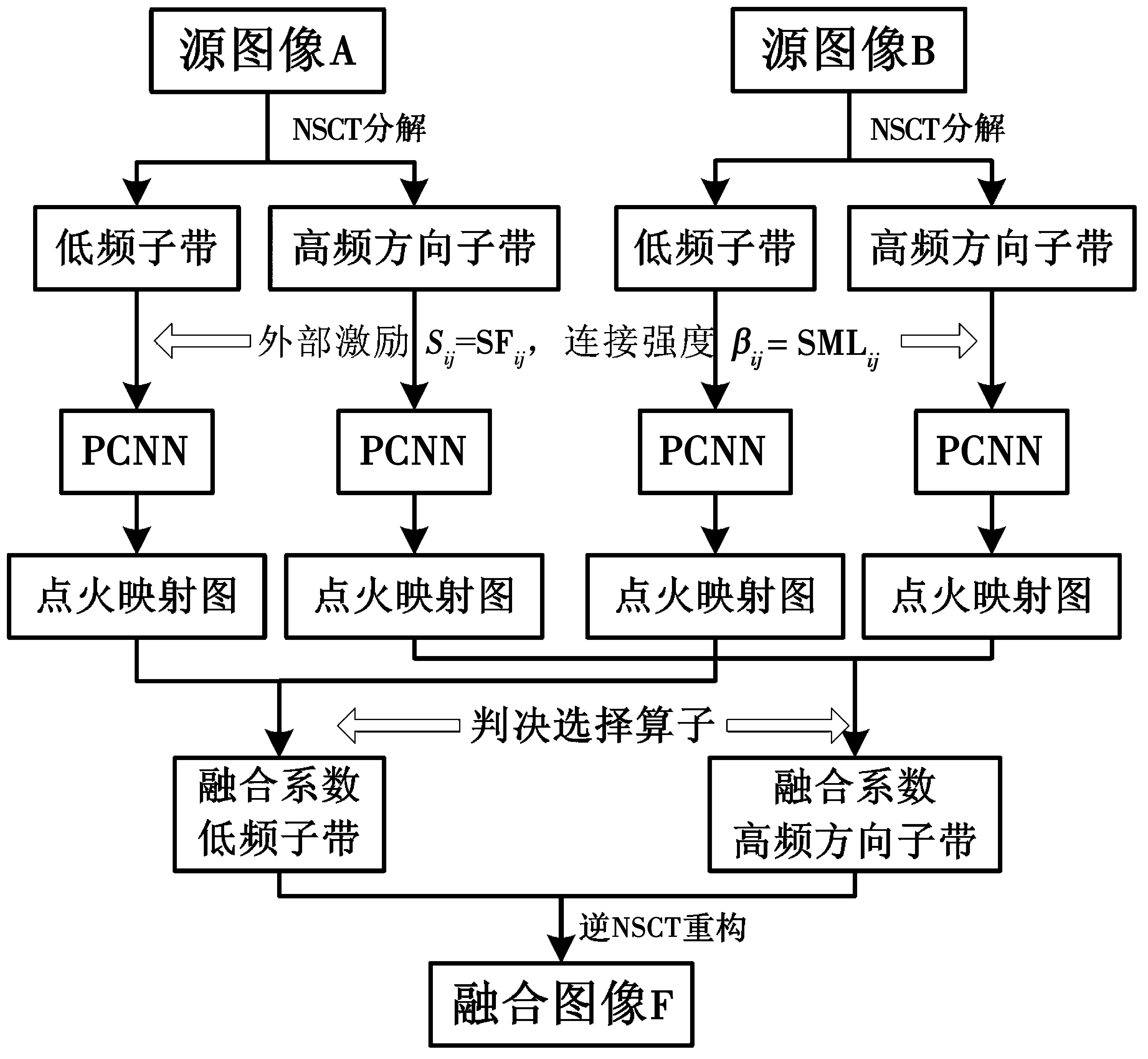

本文提出一种在图像NSCT域内基于自适应PCNN的红外与可见光图像融合方法。首先,采用NSCT将严格配准的源图像分解到不同尺度、不同方向子带范围内;然后,使用各子带系数的空间频率(spatial frequency,SF)作为PCNN神经元的自适应连接强度系数,使用各子带系数的改进的拉普拉斯能量和(sum-modified-Laplacian,SML)作为PCNN的外部激励,计算点火映射图,以此确定融合图像的各子带系数;最后,经过NSCT逆变换得到融合图像。实验结果表明,本文方法优于基于小波变换、NSCT和传统NSCT与PCNN结合的图像融合方法。

1 图像的非下采样Contourlet变换

(a)构建NSCT所采用的NSDFB结构 (b)由(a)得到的理想频域划分

2 脉冲耦合神经网络模型

PCNN是一种基于猫的视觉原理构建的简化神经网络模型。每个PCNN神经元由接收域、调制域和脉冲发生器3部分组成[5]。构成PCNN的神经元系统是一个复杂的非线性动态系统,如图2所示。

图2 PCNN神经元模型框图

PCNN的数字图像处理模型由脉冲耦合神经元构成的二维单层神经元阵列组成,网络中神经元数目与输入图像像素数目一致,神经元与像素点一一对应[6]。由于基本模型实现相对复杂,在实际应用中常使用改进型的PCNN,其数学模型为:

(1)

Tij(n)=Tij(n-1)+Yij(n)

(2)

式中:(i,j)为PCNN中神经元的标号;F为神经元的反馈输入;S为神经元强制激发的外部激励(在图像处理中通常为图像像素灰度值);L为神经元的连接输入,VL和αL分别为其放大系数和衰减时间系数;权值矩阵W为连接输入的连接矩阵;k、l表示与周围神经元连接的范围;U为神经元的内部活动项;β为连接强度系数;θ为变阈值函数输出,Vθ和αθ分别为其放大系数和衰减时间系数;Y为神经元的输出,当Uij≥θij时,神经元产生1个脉冲,称为1次点火。实际应用中,常用式(1)和(2)计算的n次迭代后神经元的点火次数Tij构成的点火映射图作为PCNN的输出。

3 NSCT域内基于自适应PCNN的图像融合算法

3.1 自适应PCNN中连接强度系数β和外部激励S的确定

在传统基于PCNN的图像融合中,神经元的连接强度系数β通常是根据具体应用环境通过多次试验的方法确定的,且所有神经元的β都为相同数值,但在人眼的视觉系统中,每个神经元有其自己的连接强度系数;因此,在PCNN中β随着图像特征变化根据输入外部激励S的不同自适应的调整是合理的。文献[7]给出了图像空间域内多种典型的清晰度评价方法,例如图像梯度能量(energy of gradient,EOG)、拉普拉斯能量(energy of Laplacian,EOL)、改进的拉普拉斯能量和(SML)和空间频率(SF),它们都是通过测量像素的变化程度来表征的。文献[8]使用图像的SML作为PCNN对应神经元的连接强度系数,进行医学图像的融合,取得了较好的融合效果。由于图像在NSCT变换域内的子带也可看作图像,并且存在幅值的变化,因此利用EOG、SML等清晰度指标来选择融合图像的NSCT变换域系数是合理的。文献[9]使用图像的SF作为PCNN的外部激励,结合NSCT,对多聚焦图像、可见光与红外图像进行融合实验,取得了较好的融合效果。

本文提出一种在图像NSCT变换域内使用SF作为神经元自适应连接强度系数、SML作为外部激励的自适应PCNN图像融合新方法。与文献[7]的清晰度定义不同,本文在NSCT域定义子带系数的清晰度,用Ii,j表示子带内位置为(i,j)的系数。(i,j)位置上对应的空间频率(SF)和改进的拉普拉斯能量和(SML)定义如下。

1)空间频率(SF)定义为

(3)

其中,(2P+1)×(2Q+1)为子带系数内滑动窗口的大小,本文选取3×3的窗口。在计算过程中,需要对子带系数矩阵进行扩充处理。

2)改进的拉普拉斯(ML)及改进的拉普拉斯能量和(SML)定义为:

MLij=|2Ii,j-Ii-step,j-Ii+step,j|+|2Ii,j-

Ii,j-step-Ii,j+step|

(4)

(5)

其中:step为像素点间的可变间距,本文总是为1;(2P+1)×(2Q+1)为子带系数内滑动窗口的大小,本文选取3×3的窗口。在计算过程中,需要对子带系数矩阵进行扩充处理。

3.2 融合过程及算法步骤描述

参与融合的源图像首先经过NSCT多分辨率多方向分解,得到低频子带和高频方向子带;然后使用各子带系数的空间频率SF作为PCNN对应神经元的自适应连接强度系数,同时利用各子带系数的SML激励每个神经元,经过PCNN点火过程获得各子带对应的点火映射图,通过判决选择算子确定融合图像各子带的系数来源;最后经过NSCT逆变换重构得到融合图像。2幅图像的融合过程如图3所示。

图3 融合算法流程示意图

假定参与融合的2幅源图像是经过严格配准的,具体融合算法步骤如下。

step1对源图像A和B进行NSCT分解,分别得到各自分解后的低频子带系数和高频方向子带系数。

step2利用式(3)计算子带系数的SF,并进行归一化,作为PCNN神经元的自适应连接强度系数,即式(1)中Sij=SFij;利用式(5)计算子带系数的SML,作为外部激励输入PCNN网络,即式(1)中β=SMLij。

step3初始化式(1)中的Lij(0)、Uij(0)、θij(0)、Yij(0)和式(2)中的Tij(0)为零矩阵,利用式(1)和式(2)计算n次迭代后PCNN中神经元的点火次数Tij(n),作为点火映射图输出。

step4经过step 2和step 3的PCNN处理后,每个子带系数得到对应的点火映射图,利用式(6)计算每个子带系数对应的决策图。在决策图DF,ij中,利用一致性检验方法[10],如果中心元素为1,而邻域内大多数元素为0,则将中心元素修改为0。使用一致性检验后的决策图,利用式(7)选取子带系数。

(6)

(7)

其中,DF,ij代表融合图像F各子带系数对应的决策图,TA,ij(n)和TB,ij(n)分别对应源图像A和B的子带系数对应的点火映射图,xF,ij、xA,ij和xB,ij分别代表融合图像F、源图像A和B的子带系数。

step5使用式(7)选出的低频子带系数和高频方向子带系数做NSCT逆变换,重构输出融合图像F。

4 仿真实验与结果分析

实验中红外与可见光图像以及各融合算法的融合结果如图4所示。源图像是一片树林。由于树叶的遮挡,目标人在可见光图像中完全不可见,但人可以产生热辐射,从而在红外图像中被完整的保留。从图4(c)—(f)可以看出,几种融合方法都很好地保留了可见光图像中的背景信息和红外图像中的目标信息;但仔细观察图4(c)—(f)中左下角与右下角部分,可以发现图4(f)中树叶区域的像素灰度和边缘轮廓与可见光图像更为接近,说明本文算法能更好地保留可见光图像中的背景信息,更符合人眼的视觉系统。

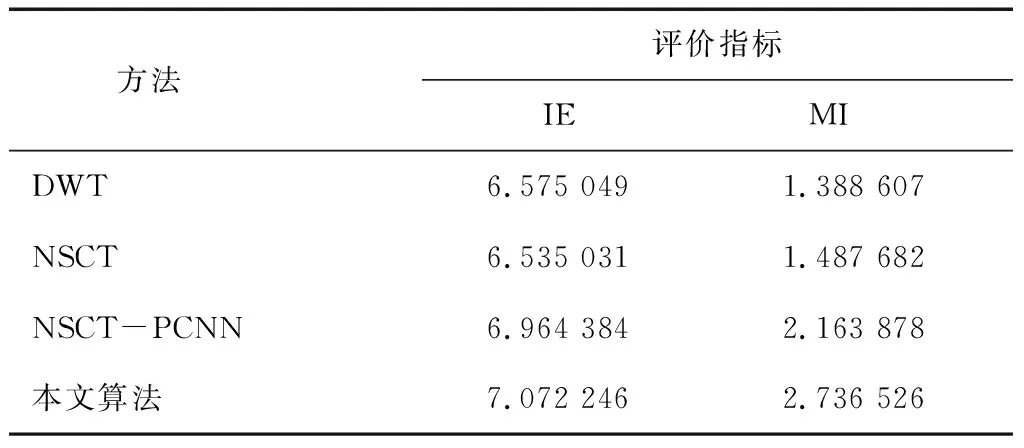

在无标准参考图像的情况下,本文选取信息熵(IE)和互信息(MI)2个常用融合定量评价指标,对上述4种融合方法进行比较。图像信息熵是图像的平均信息量,融合图像的信息熵越大,说明包含的信息越多;互信息是衡量融合图像从源图像中继承信息的多少,互信息越大,说明融合图像从源图像中继承的信息越多。从表1可以看出,使用本文算法,其融合结果的2项评价指标均为最大,说明本文算法优于其他3种方法。

(a)可见光图像

(b)红外图像

(c)DWT融合结果

(d)NSCT融合结果

(e)NSCT-PCNN融合结果

(f)本文方法融合结果

方法 评价指标IE MIDWT6.575 0491.388 607NSCT6.535 0311.487 682NSCT-PCNN6.964 3842.163 878本文算法7.072 2462.736 526

5 结论

本文根据NSCT和PCNN的特点,提出一种在图像NSCT域内基于自适应PCNN的红外与可见光图像融合新方法。该方法的最大特点是在源图像NSCT变换域上,使用各子带系数的空间频率SF作为神经元的自适应连接强度系数,使用改进的拉普拉斯能量和SML激励PCNN中的每个神经元。实验结果表明,本文方法能更好地保留可见光图像的背景信息和红外图像的目标信息,在视觉效果方面更符合人眼的视觉系统。虽然PCNN的简化模型易于并行实现,但NSCT的计算复杂度较高,融合过程耗时;因此如何提高运算速度有待于进一步研究。

[1]Do M N,Martin V. The Contourlet Transform: an Efficient Directional Multiresolution Image Representation [J]. IEEE Transactions on Image Processing,2005,14(12):2091-2106.

[2]Da Cunha A L,Zhou J,Do M N. The Nonsubsampled Contourlet Transform: Theory, Design, and Applications [J]. IEEE Transactions on Image Processing,2006,15(10):3089-3101.

[3]Eckhorn R,Reitboeck H J,Arndt M,et al. Feature Iinking Via Synchronization Among Distributed Assemblies: Simulations of Results from Cat Visual Cortex [J]. Neural Computation,1990,2(3):293-307.

[4]张军英,梁军利. 基于脉冲耦合神经网络的图像融合[J]. 计算机仿真,2004,21(4):102-104.

[5]Wang Z B,Ma Y D,Cheng F Y, et al. Review of Pulse-coupled Neural Networks [J]. Image and Vision Computing, 2010,28:5-13.

[6]房华. 脉冲耦合神经网络在图像处理中的应用研究[D]. 西安:西安石油大学,2010.

[7]Huang W,Jing Z L. Evaluation of Focus Measures in Multi-focus Image Fusion [J]. Pattern Recognition Letters,2007,28:493-500.

[8]夏加星,段先华,魏世超. 利用邻域激励的自适应PCNN 进行医学图像融合[J]. 计算机应用研究, 2011, 28(10):3929-3933.

[9]Qu X B,Yan J W,Xiao H Z,et al. Image Fusion Algorithm Based on Spatial Frequency-Motivated Pulse Coupled Neural Networks in Nonsubsampled Contourlet Transform Domain[J]. Acta Automatica Sinica,2008,34(12):1508-1514.

[10] 任国超,师黎. 基于2v-SVM和一致性检验的医学图像融合算法[J]. 计算机工程与应用,2010,46(13):199-201.

[11] Xu L,Du J P,Li Q P. Image Fusion Based on Nonsubsampled Contourlet Transform and Saliency-Motivated Pulse Coupled Neural Networks [J]. Mathematical Problems in Engineering, vol2013,Article ID 135182,10 pages,2013.

[12] 李美丽,李言俊,王红梅,等. 基于NSCT 和PCNN 的红外与可见光图像融合方法[J]. 光电工程,2010,37(6):90-95.

[13] 赵飞翔,陶忠祥. 基于NSCT的红外与可见光图像融合[J]. 电光与控制,2013,20(9):29-33.

[14] 马义德,李廉,绽琨,等. 脉冲耦合神经网络与数字图像处理[M]. 北京:科学出版社,2008:1-17.

[15] 敬忠良,肖刚,李振华. 图像融合:理论与应用[M]. 北京:高等教育出版社,2007:73-83.