情绪韵律调节情绪词识别的ERP研究*

郑志伟 黄贤军 张 钦

(1首都师范大学心理系,北京市“学习与认知”重点实验室,北京 100048)(2中国科学院心理研究所,北京 100101)

1 前言

口头语言与书面语言的一个重要区别在于口语具有韵律特征。作为一种超音段特征,韵律特征主要通过语音中的基频、音强以及时长等声学线索的动态变化来体现。从功能上讲,韵律特征可以区分为言语韵律特征和情绪韵律特征。言语韵律特征主要包括语调、重读、停顿等,而情绪韵律特征则是反映说话人情绪状态的副言语信息。不同种类的情绪韵律具有不同的声学模式(Banse&Scherer,1996;Scherer,2003),听话人能够通过语音的声学线索来判断说话人传递的情绪信息,且情绪韵律的识别具有跨文化的一致性(Scherer,Banse,&Wallbott,2001)。

在现实生活中,说话人既可以通过情绪韵律来表达自己的情绪状态,也可以通过言语中的词汇来表达。多数情况下这两个情绪通道会表达一致的情绪信息,但也有例外,比如用不同的方式说“真棒!”,表达的可能是表扬,也可能是讽刺。听话人需要联合情绪韵律和词汇两方面信息,才能准确判断说话人的情绪和意图(Paulmann&Kotz,2008)。

在情绪言语加工研究中,情绪韵律是否以及如何对情绪词的加工产生影响是研究者关注的主要问题。韵律/词汇干扰范式是考察该问题常用的实验范式。这一范式使用的言语材料包含情绪韵律和情绪词两个维度的情绪信息,情绪韵律和情绪词之间的效价具有一致或者不一致两种条件,要求被试忽略一个维度的信息,判断另一维度的效价。

在行为研究上,Kitayama和Ishii(2002)采用该范式发现,当要求被试忽略词汇信息判断韵律效价时,会受到词汇效价的影响,被试对与词汇效价一致韵律效价判断更快、更准确;当要求被试忽略韵律信息判断词汇效价时,则不存在效价一致的韵律促进效应。与上述研究结果不一致的是,同样采用词汇效价判断任务,Min和Schirmer(2011)却发现了韵律效价的促进效应,即被试对与情绪韵律效价一致的词汇做出了更快、更准确的效价判断。在其他任务中,如情绪词命名(Naming)或识别(Identification),也存在情绪韵律效价的促进效应,被试能够更快、更准确的对与情绪韵律效价匹配的情绪词做出反应(Grimshaw,1998;Nygaard&Queen,2008)。

Wurm,Vakoch,Strasser,Calin-Jageman和Ross(2001)的研究或许能够为上述研究结果之间的差异提供一些启示,他们发现,当不同的情绪韵律在实验中以分组方式呈现,即情绪韵律的种类在每个实验组内不发生变化时,能够对情绪词的识别产生影响;而情绪韵律的类型在每个实验组内以随机混合的形式呈现时,情绪韵律则不会影响词汇的识别。Wurm等人认为情绪韵律以分组形式呈现会使得其在每个实验组中的各个试次之间具有连续性,被试能够对情绪韵律形成较强的预期,情绪韵律的背景效应更强,因而更有可能对情绪词识别产生影响。该研究表明情绪韵律对词汇识别的调节作用可能与情绪韵律的呈现方式有关。

事件相关电位(ERP)技术的高时间分辨率优势便于研究者观察到情绪韵律影响情绪词识别的时间进程,基于这一技术,研究者可以更好地探讨情绪韵律何时以及如何调节情绪词的加工问题。Schirmer和Kotz(2003)采用韵律/词汇干扰范式,要求被试执行词汇效价判断任务,结果发现,与情绪韵律的效价不一致的情绪词比效价一致的情绪词诱发了走向更负的N400成分。由于N400成分是语义加工的标志,Schirmer和Kotz认为情绪韵律对词汇加工的影响主要出现在词汇的意义加工阶段。另外,在句子水平上,Schirmer,Kotz和Friederici(2002,2005)运用跨通道启动范式,考察句子的情绪韵律背景对视觉呈现的德语情绪词加工的影响,得到了与Schirmer和Kotz(2003)相似的N400效应,说明情绪韵律像句子背景一样,能够调节词汇的意义加工。而Schirmer等人(2006)以粤语为实验材料,ERP结果显示,与情绪韵律效价不一致的情绪词只诱发了更正的LPC(Late positive component),而没有出现更负的N400。Schirmer等人认为粤语中的情绪韵律并不调节情绪词语义加工,而是在决策阶段与情绪词产生相互作用。因此,从Schirmer等人的研究可以看出,情绪韵律对情绪词的作用方式可能会受到语言特征的调节。

以上ERP研究表明,个体在情绪言语材料加工过程中会使用情绪韵律线索,尽管情绪韵律产生作用的阶段可能会因语言类型的不同而存在一定的差异,但以往研究存在以下问题:(1)先前研究的实验任务大多采用效价判断任务,这种任务需要被试忽略某一维度的信息,使ERP结果可能受到了个人反应策略的影响,比如获得的N400效应不止纯粹地反映情绪韵律对情绪词意义加工的影响,也有可能反映了个体在加工任务相关信息过程时,忽略任务不相关信息(韵律)所付出的心理努力(Schirmer&Kotz,2003)。(2)跨通道启动范式有助于考察情绪韵律背景对情绪词识别的影响,但这种范式的缺陷在于无法反映自然言语中,音段信息以及依附在音段上的韵律信息随时间展开的共时性;另外,跨通道范式中的目标项目采用的是视觉词,视觉词与听觉词有很大不同,视觉刺激在呈现时会立即提供所有的信息,而听觉刺激是随时间而展开的。因此,研究结果难以完全概括到听觉词汇的加工中。(3)以往研究主要考察的是英语、德语等非声调语言中情绪韵律在情绪言语加工中的作用,对声调语言(如汉语、粤语等)研究相对较少。在非声调语言里,情绪韵律变化的不同模式主要通过基频的变化来实现。在声调语言里,基频的变化除了与语调的变化模式有关外,还与声调调值的高低升降(用于声调语言的词汇识别)有直接关系,两者重叠交错在一起,很难截然分开(林焘,王理嘉,1992)。所以对于声调语言而言,情绪言语材料的加工中,情绪韵律和词汇的识别都依赖于基频的变化。汉语中的情绪韵律是否能够调节情绪词的识别,还是与粤语研究(Schirmer et al.,2006)相似,只有在词汇识别完成之后与其产生整合,到目前为止还没有相关证据。

针对以上问题,本研究使用事件相关电位技术考察了汉语中情绪韵律影响口语情绪词识别的时间进程问题。借鉴韵律/词汇干扰范式,使用的实验材料为用高兴和悲伤两种情绪语调表达具有积极和消极意义的汉语双字词,韵律和词汇之间的效价存在一致和不一致条件。为了考察情绪韵律对情绪词识别的自然影响,本研究并没有使用效价判断任务,而是采用了词汇延迟匹配任务,即在听觉情绪语音词出现后会呈现一个视觉词,要求被试在视觉词出现后判断听觉语音词与视觉词是否为同一个词,以使被试将注意资源集中到听觉词上。另外,还操纵了情绪韵律的呈现方式,在实验一中,不同的情绪韵律分组呈现,即每一个实验组里只存在由一种情绪韵律表达的积极词和消极词;在实验二中,不同的情绪韵律混合随机呈现,即每一个实验组里包含了分别用高兴和悲伤语调表达的积极和消极词。通过以上操纵,还可以考察情绪韵律呈现方式在情绪言语知觉中的作用。

结合以往的研究,提出以下假设:情绪韵律能够实时的调节情绪词的识别,比如意义加工,在ERP结果上表现为,与情绪韵律效价不一致的情绪词要比效价一致的情绪词诱发更负的N400成分。与以往研究相比,本研究的实验任务不要求被试有意识忽略情绪韵律,因而情绪韵律产生的作用可能会更强,情绪韵律除了能调节情绪词的语义加工,还可能也会对情绪词的早期加工(如音韵编码)产生影响,表现为效价不一致的语音词与效价一致的语音词在更早期的ERP波形上存在差异。另外,如果情绪韵律能够影响口语词的识别,那么两种情绪韵律呈现方式条件下均会出现上述ERP效应;如果情绪韵律的影响依赖于建立的情绪韵律背景的强弱,我们可能只在情绪韵律以分组呈现的条件下观察到此类ERP效应。

2 方法

2.1 被试

32名高校学生参加了实验(16男16女),年龄范围为18~26岁。被试母语为汉语,普通话标准。右利手,听力、视力或者矫正视力正常,无神经系统疾病。其中16名被试(8男)参与实验一,其余被试(8男)参与实验二,被试在实验后获少量报酬。

2.2 实验材料

从汉语情感词系统(王一牛,周立明,罗跃嘉,2008)选取了120个双字词,其中积极词和消极词各60个。招募20名不参与脑电实验的被试(10名男性,10名女性)在7点量表上对每个双字词的效价(1表示非常不愉快,7表示非常愉快)和熟悉度(1表示非常不熟悉,7表示非常熟悉)进行评定。评定结果显示,积极词与消极词的效价值之间差异显著(p

<0.001),积极词的效价值(M

=6.77;SD

=0.84)要高于消极词的效价值(M

=1.44;SD

=1.03);积极词的熟悉度(M

=6.11;SD

=0.93)与消极词的熟悉度(M

=6.17;SD

=1.04)之间差异不显著(p

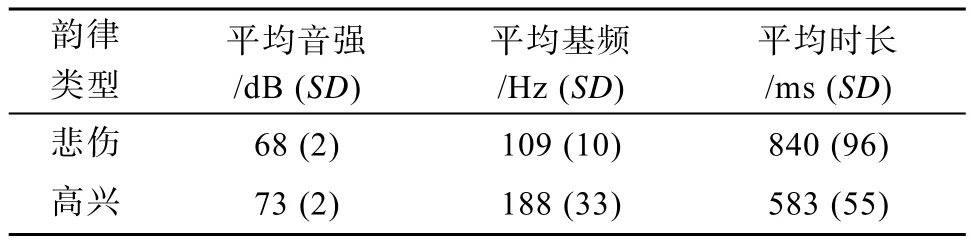

>0.05)。请一名专业的播音员分别用高兴和悲伤两种情绪语调朗读了所有双字词。为保证情绪韵律的表达符合要求,请20名被试(10名男性,10名女性)对所有的语音材料进行评定,任务是判断每个语音词的情绪韵律类型(高兴、悲伤、中性、其他)。计算每个语音词的情绪韵律的正确识别率(正确判断的人数/总人数),凡是正确识别率没有达到75%的词语进行重新录制和评定,直到符合标准(Nygaard&Queen,2008)。最终得到240个语音刺激,其中包含120个高兴韵律词(积极和消极词各半)和120悲伤韵律词(积极和消极词各半)。使用Praat软件(Boersma&Weenink,2011)对所有的语音刺激的声学线索(音强,基频,时长)进行提取和分析,结果如表1所示。以声学参数为指标进行统计分析,结果显示高兴韵律和悲伤韵律在各项声学参数上均存在显著差异(p

s<0.001)。与高兴韵律相比,悲伤韵律表现出较低的平均基频和音强,且发音速度更缓慢,这与以往研究结果一致(Banse&Scherer,1996;Scherer,2003)。

表1 情绪韵律词的声学参数分析

根据情绪韵律和情绪词的关系,实验一的语音材料共分6组:其中3组只包含高兴韵律的情绪词,有高兴–积极和高兴–消极两种条件;另外3组则只包含悲伤韵律的情绪词,有悲伤–消极和悲伤–积极两种条件。每组包含40试次,每个条件各20试次。被试需要先完成一种韵律条件(3组),再完成另一种韵律条件(3组),其先后顺序在被试间进行了平衡。实验二的语音材料也分6组,每组有40试次,分别随机呈现高兴–积极、高兴–消极、悲伤–消极和悲伤–积极四种条件,每个条件各10个试次。

视觉双字词共240个,选自《现代汉语词典》(第5版),其中一半为与语音词相同的情绪词(积极和消极各半),另一半为与语音词不同的中性词。对中性词在7点量表上进行效价和熟悉度评定(同一批被试),结果显示,中性词的效价值(M

=4.08;SD

=1.21)高于消极词,低于积极词,且差异均显著(p

s<0.001);中性词的熟悉度(M

=6.32;SD

=0.76)与积极词和消极词之间的差异均不显著(p

s>0.05)。两个实验中呈现的视觉词,与各条件的语音词均有一半相同,一半不同。

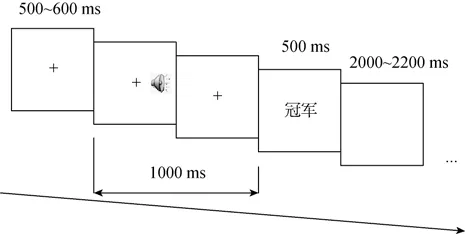

2.3 实验程序

被试坐在电屏蔽实验室里,眼睛与计算机显示器的距离约为50 cm。情绪语音词通过耳机以适合的声压级呈现给被试,视觉词的视角大小为5°×2°。实验流程如图1所示。每个Trial开始时会在计算机屏幕中央出现一个注视点,注视点呈现500 ms~600 ms后先呈现语音词,然后再呈现视觉词,语音词与视觉词之间的时间间隔(SOA,stimulus onset asynchrony)为1000 ms,视觉词呈现的时间为500 ms,屏幕空白2000~2200 ms之后开始下一个trial。被试的任务是注视屏幕中央,认真听语音刺激,在视觉词出现后,判断听到的词与视觉词是否相同,通过鼠标左右键做出反应。正式实验前,被试进行了练习。每组实验之间,被试可以休息。为消除顺序效应,在被试之间对组的呈现顺序和左右按键顺序进行了平衡。

图1 实验流程图

2.4 EEG记录与数据处理

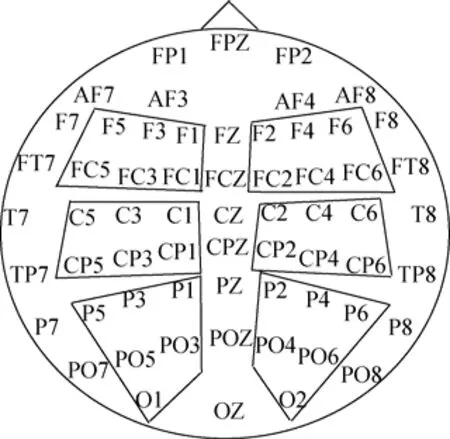

采用Neuroscan公司生产的ESI-64导脑电记录分析系统和Ag/AgCl电极帽,连续记录62个单极导联的脑电(EEG)。电极位置采用国际10~20系统。另有4个电极记录眼电:左眼眶上下2个电极记录垂直眼电,双眼外侧2个电极记录水平眼电。参考电极置于左侧乳突,接地点在FPz和Fz的中点,右耳乳突也放置一个电极,A/D采样频率为500 Hz,电极与头皮之间的阻抗小于5 kΩ。

对记录获得的EEG进行离线分析处理,滤波带通为0.01~40 Hz,基线矫正后,剔除了波幅超过±75 μV的伪迹。仅对反应正确的听觉刺激诱发的EEG进行叠加,实验一和实验二中语音词诱发ERP波形的平均叠加试次为50和52。分析时程为−100~1000 ms,用刺激呈现前100 ms的脑电为基线。

通过平均波形及前人研究,确定实验一和实验二中ERP数据分析的5个时窗为90~150 ms(N1),150~250 ms(P2),250~350 ms(N300),350~550 ms(N400),550~1000 ms(late negativity)。分别对各个时窗进行2(韵律效价:积极/消极)×2(词汇效价:积极/消极)×3(电极位置:额区/中央顶区/顶枕区)×2(半球:左/右)的重复测量方差分析。分析的电极分别为:左侧额区(F5/F3/F1/FC5/FC3/FC1),右侧额区(F6/F4/F2/FC6/FC4/FC2),左侧中央顶区(C5/C3/C1/CP5/CP3/CP1),右侧中央顶区(C6/C4/C2/CP2/CP4/CP6),左侧顶枕区(P5/P3/P1/PO5/PO3/O1)和右侧顶枕区(P6/P4/P2/PO6/PO4/O2),如图2所示。将每一时窗内,每一条件下各个头皮区域包含的所有电极的平均波幅的算术平均数作为因变量。所有分析均使用SPSS 16.0统计软件包进行,显著性水平设在0.05,统计分析结果选用Greenhouse-Geisser矫正法。

图2 电极位置

3 结果

3.1 行为结果

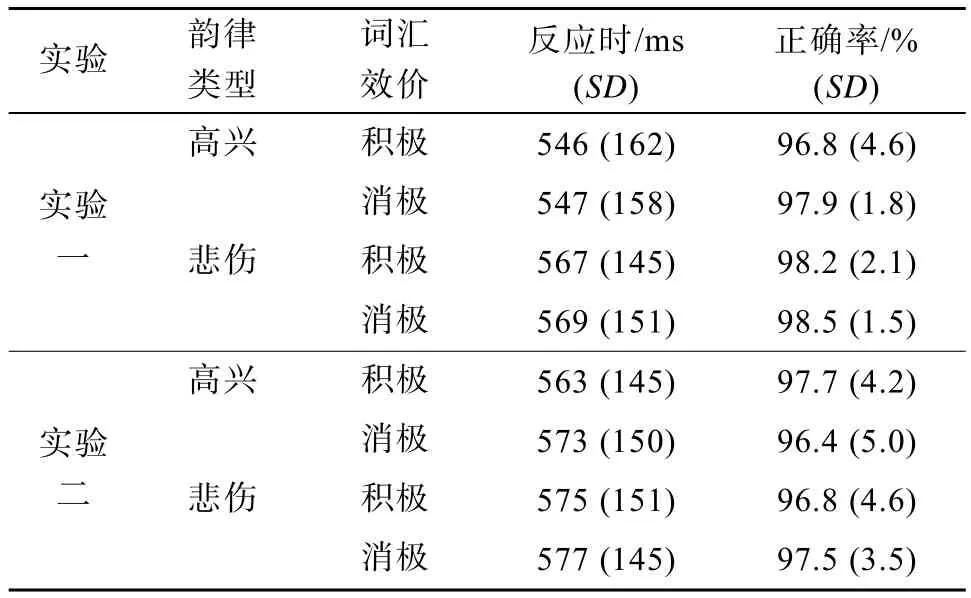

实验一和实验二中不同条件语音词的反应时和正确率如表2所示。

表2 实验一和实验二中不同条件语音词的行为结果

分别以反应时和正确率为指标,进行2(韵律效价)×2(词汇效价)重复测量方差分析。在反应时上,实验一和实验二中,韵律效价主效应、词汇效价主效应以及韵律效价和词汇效价的交互作用均不显著(p

s>0.05)。在正确率上,实验一的韵律效价主效应、词汇效价主效应以及韵律与词汇交互作用均不显著(p

s>0.05);实验二中,韵律效价主效应和词汇效价主效应均不显著(p

s>0.05),韵律与词汇效价之间的交互作用显著,F

(1,15)=9.288,p

<0.01。进一步的简单效应检验显示,在高兴韵律水平上,消极词比积极词的正确率更低,F

(1,15)=7.94,p

<0.05;在悲伤韵律水平上,积极词与消极词的正确率差异没有达到显著水平(p

>0.05)。这一结果表明,尽管被试执行的任务是延迟匹配任务,情绪韵律仍然在一定程度上对情绪词的加工产生了影响,效价不一致的情绪韵律干扰了情绪词的判断。3.2 ERP结果

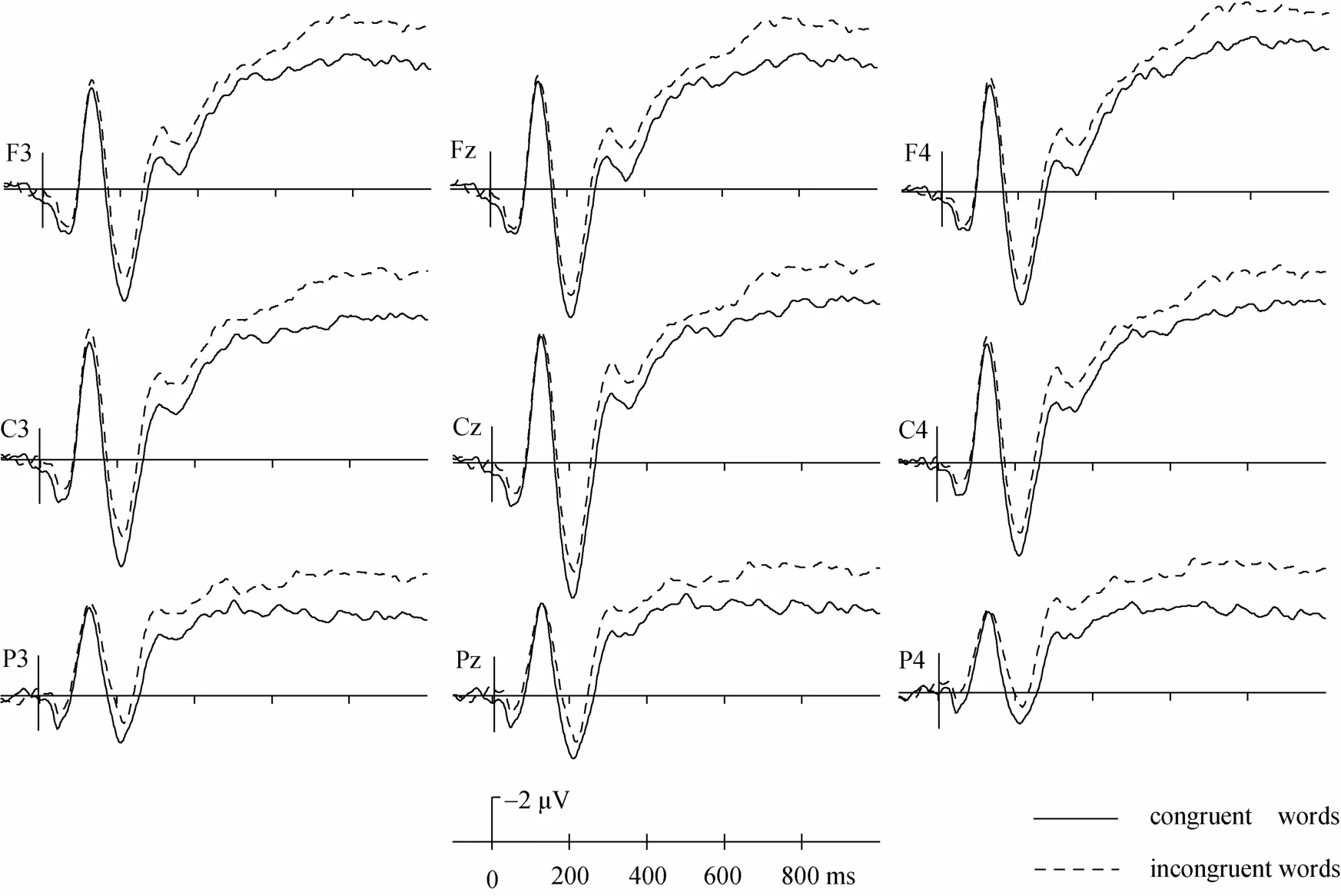

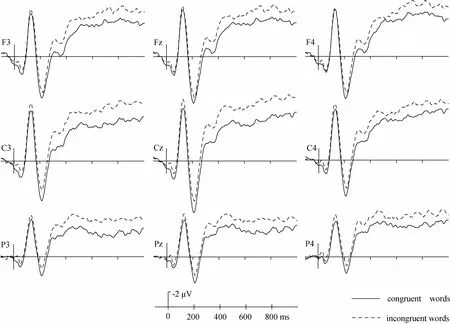

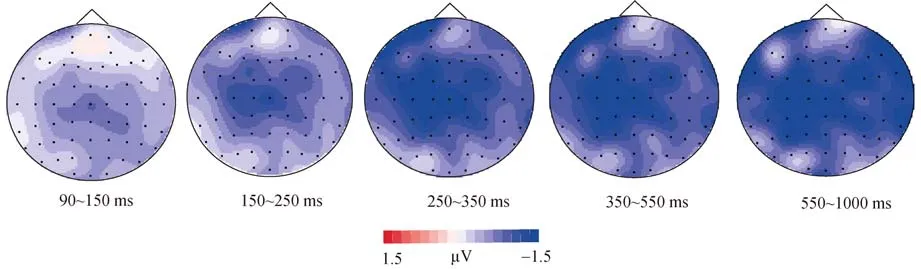

实验一和实验二中语音词诱发的ERP总平均波形图以及差异波地形图分别见图3和图4、图5和图6。差异波均由效价不一致的语音词与效价一致的语音词诱发的波形相减获得。

如图3所示,实验一中的语音词首先诱发了一个听觉的P1成分,在P1之后是整个头皮分布的峰值大约在100 ms左右的N1成分,前部N1的波幅要比后部更大。在N1之后是一个峰值在大约200 ms左右的正走向的波形,即P200,P200与N1的头皮分布相似。接下来是始于250 ms左右的分布广泛且持续时间较长的负走向的波形,一直持续到分析时段结束。通过直接观察可以发现,效价一致语音词比效价不一致语音词诱发了更正的P2成分;在负波时窗,效价不一致的语音词比与效价一致的语音词的走向更负。实验二的ERP总平均图(图5)显示了相似的趋势。下面将分别对实验一和实验二的ERP结果进行统计检验。

3.2.1 实验一ERP结果

图3 实验一中效价一致和效价不一致语音词诱发的ERP总平均波形图

图4 实验一中效价不一致和效价一致语音词的ERP差异波地形图

重复测量方差分析结果显示,在90~150 ms,韵律效价的主效应显著,F

(1,15)=5.268,p

<0.05,悲伤韵律词比高兴韵律词诱发更大波幅的N1成分。词汇效价的主效应显著,F

(1,15)=4.778,p

<0.05,消极词比积极词诱发更负的N1。韵律效价和词汇效价的交互作用不显著(p

s>0.05),且不受半球和电极位置的调节(p

s>0.05)。

图5 实验二中效价一致和效价不一致语音词诱发的ERP总平均波形图

图6 实验二中效价不一致和效价一致语音词的ERP差异波地形图

在150~250 ms,韵律效价的主效应显著,F

(1,15)=11.334,p

<0.01,与高兴韵律词相比,悲伤韵律词诱发更负的P2成分。韵律效价和词汇效价的交互作用显著,F

(1,15)=30.641,p

<0.001,进一步的简单效应检验显示,在高兴韵律水平上,积极词比消极词诱发更正走向的P2成分,F

(1,15)=9.59,p

<0.01;与之相似,在悲伤韵律水平上,消极词比积极词诱发更正的P2成分,F

(1,15)=31.15,p

<0.001。这一交互作用不受电极位置和半球的调节(p

s>0.05)。在250~350 ms,韵律效价的主效应显著,F

(1,15)=21.532,p

<0.001,悲伤韵律词比高兴韵律诱发更负走向的N300。韵律效价和词汇效价之间的交互作用显著,F

(1,15)=53.637,p

<0.001,简单效应检验结果显示,在高兴韵律水平上,消极词比积极词诱发了更负走向的N300成分,F

(1,15)=31.15,p

<0.001;在悲伤韵律水平上,积极词比消极词诱发了更负的N300,F

(1,15)=13.99,p

<0.01。这一交互作用不受电极位置和半球的调节(p

s>0.05)。在350~550 ms,韵律效价的主效应显著,F

(1,15)=27.039,p

<0.001,悲伤韵律比高兴韵律诱发了更负的N400。韵律效价、词汇效价和电极位置之间的交互作用显著,F

(2,30)=15.967,p

=0.001,简单效应检验结果显示,在高兴韵律水平上,效价一致性效应在整个头皮分布均显著,与韵律效价不一致的消极词比积极词诱发更负的N400成分(p

s<0.01);在悲伤韵律水平上,这一N400效应只在头皮后部(顶枕区)达到显著水平,F

(1,15)=10.66,p

<0.01。另外,效价一致性效应不受半球因素的调节,均为双侧化分布。在550~1000 ms,韵律效价的主效应显著,F

(1,15)=19.459,p

=0.001,悲伤韵律词比高兴韵律词的走向更负。韵律效价和词汇效价的交互作用达到显著水平,F

(1,15)=21.538,p

<0.001,简单效应检验结果显示,高兴韵律和悲伤韵律水平上均存在效价一致性效应,即效价不一致的语音词比效价一致的语音词诱发了更大的负波(p

s<0.01)。韵律效价、词汇效价与电极位置和半球之间的交互作用均不显著(p

s>0.05)。图4显示的差异波地形图与上述ERP结果相似。3.2.2 实验二ERP结果

重复测量方差分析结果显示,在90~150 ms,韵律效价的主效应显著,F

(1,15)=4.628,p

<0.05,悲伤韵律词比高兴韵律词诱发的走向更负的N1。韵律效价和词汇效价的交互作用没有达到显著水平(ps

>0.05),也不受半球和电极位置的调节(p

s>0.05)。在150~250 ms,韵律和词汇效价的主效应均不显著(p

s>0.05)。韵律效价和词汇效价的交互作用显著,F

(1,15)=11.851,p

<0.01,进一步的简单效应分析显示,在悲伤韵律水平上,消极词比积极词诱发更正走向的P2成分,F

(1,15)=7.03,p

<0.05;在高兴韵律水平上,积极词比消极词诱发更正的P2,但没有达到显著水平(p

>0.05)。该效应不受电极位置和半球的影响(p

s>0.05)。在250~350 ms,韵律效价的主效应显著,F

(1,15)=9.991,p

<0.01,悲伤韵律词比高兴韵律词诱发更负的N300。韵律效价和词汇效价的交互作用显著,F

(1,15)=29.562,p

<0.001。韵律效价、词汇效价和电极位置之间的交互作用边缘显著,F

(2,30)=3.872,p

=0.051,简单效应检验结果显示,高兴韵律水平上,在整个头皮上均存在效价一致性效应,效价不一致的消极词比积极词诱发了更负走向的N300(p

s<0.05);而在悲伤韵律水平上,在额区和中央顶区存在效价一致性效应(p

s<0.05),在顶枕区,虽然积极词比消极词诱发的N300走向更负,但没有达到显著水平(p

>0.05)。在350~550 ms,韵律和词汇效价的主效应均不显著(p

s>0.05)。韵律效价和词汇效价的交互作用显著,F

(1,15)=31.413,p

<0.001,简单效应检验结果显示,在高兴韵律水平上,消极词比积极词诱发更负走向的N400成分,F

(1,15)=11.65,p

<0.01;在悲伤韵律水平上,积极词比消极词诱发更负走向的N400,F

(1,15)=6.64,p

<0.05。这一效价一致性效应不受电极位置和半球的调节(p

s>0.05)。在550~1000 ms,韵律效价的主效应显著,F

(1,15)=6.601,p

<0.05,悲伤韵律词诱发的波形比高兴韵律词的走向更负。词汇效价的主效应显著,F

(1,15)=5.039,p

<0.05,积极词比消极词诱发走向更负的波形。韵律效价和词汇效价之间的交互作用显著,F

(1,15)=10.081,p

<0.01,简单效应检验结果显示,在高兴韵律水平上,效价一致性效应不显著(p

>0.05);在悲伤韵律水平上,效价一致性效应显著,F

(1,15)=13.99,p

<0.01,效价不一致的积极词比效价一致的效价词诱发了更负走向的负波。该效应不受电极位置和半球因素的调节(p

s>0.05)。上述结果与图6显示的差异波地形图的趋势相似。4 讨论

本研究采用ERP技术考察了情绪韵律调节情绪词识别的时间进程。实验一和实验二的ERP结果均显示,与情绪韵律效价不一致的情绪词诱发了走向更负的P2、N300和N400成分,尽管实验二的P2效应仅在体现悲伤韵律水平上。

4.1 P2效应

Schirmer等人(2002,2005)以及Schirmer和Kotz(2003)的ERP研究仅发现了效价一致性的N400效应。本研究除了N400效应之外,还发现了情绪韵律对听觉情绪词诱发的早期P2成分的影响,在150~250 ms,效价一致的语音词比效价不一致语音词诱发了走向更正的P2成分,这一P2效应头皮分布广泛。就我们所知,前人对该问题的研究还没有发现过P2效应。Schirmer和Kotz(2003)的研究使用的实验材料与本研究相似,但实验任务是要求被试忽略韵律信息去判断词汇效价,被试可能需要有意识地抑制情绪韵律的干扰,这种自上而下的认知控制可能导致韵律信息对情绪词的识别的影响相应减弱。而本研究中,被试在视觉词呈现之前只需注意情绪词的内容,无需有意识地排斥情绪韵律,因而相对于效价判断任务而言,本研究中的情绪韵律信息得到了更高程度的加工。

在言语知觉的ERP研究中,P2与言语的音韵编码(Phonological processing)有关(Kelly,Kravitz,&Hopkins,2004;Savill,&Thierry,2011)。研究显示,在词汇真伪判断任务中,普通伪词(如rofe)比伪同音异形词(如roze)诱发了波幅更正的P200(Braun,Hutzler,Ziegler,Dambacher,&Jacobs,2009)。在词汇启动研究中,与启动项目同音或者押韵的目标项目要比与启动项目在语音上不相关的目标项目诱发更正的中顶分布的P200(Kong et al.,2010)。另外,正常个体在言语加工过程中产生的P200波幅要比失读症患者更正(Meyler&Breznitz,2005)。由此可见,刺激诱发更正的P200成分反映了个体更容易进行对言语刺激的音韵加工。在本实验中,与情绪韵律效价一致的口语情绪词诱发了波幅更正的P200,可能表明效价一致的情绪韵律可以促进口语词的早期的音韵编码。

实验一的P2效应强于实验二表明,P2效应的表现还可能与韵律类型的呈现方式有关。在实验一中,不同类型的情绪韵律是分组呈现的,这种情况与正常的生活场景更相似,因为在日常的言语交流过程中,个体的情绪状态通常不是随机变化的,情绪韵律的表达也具有一定的连贯性,此时情绪韵律的背景效应会比随机呈现时更强,情绪韵律对情绪词的影响也相应更强,因此在实验一中,在高兴和悲伤韵律条件下都出现了较强的P2效应。在实验二中,不同类型的情绪韵律是随机呈现的,此时情绪韵律的作用主要体现在单个词汇上,由于韵律的不断变化而缺乏连续性,导致情绪韵律的背景效应相对较弱,因此实验二的P2效应减弱,仅在悲伤韵律水平上表现出来。

4.2 N300/N400效应

本研究的ERP结果显示效价不一致的情绪词比效价一致情绪词诱发了更负的、广泛分布的N300和N400成分。N300是一个出现较早的峰值在300 ms左右,功能与N400相似,且与N400相重叠的负走向的ERP成分(Federmeier&Kutas,2001;Sitnikova,Holcomb,Kiyonaga,&Kuperberg,2008;Wu&Coulson,2007),因此将N300成分看作是一个早期的N400成分,与N400成分一并进行讨论。

关于N400的意义,传统的观点认为N400反映了刺激与背景的整合(Holcomb,1993;Holcomb,Anderson,&Grainger,2005),这种整合观点的基本假设是背景产生的促进效应只有在刺激已经通过自下而上的过程得到识别之后出现。但这一观点受到了越来越多的质疑。比如,van Petten,Coulson,Rubin,Plante和Parks(1999)发现口语词汇诱发的N400效应早在词汇识别的关键点(Isolation point)之前就已经出现。Stenberg,Lindgren,Johansson,Olsson和Rosén(2000)的词汇启动研究结果显示,没有受到外显识别的视觉掩蔽词汇也能导致N400效应的出现。另外,心理词典中不存在的表征(如假词)也能诱发N400效应(Deacon,Dynowska,Ritter,&Grose-Fifer,2004)。以上结果表明,N400可能反映的是背景信息对刺激较早阶段的加工的影响,即刺激的意义提取阶段(Kutas&Federmeier,2011)。

在情绪言语加工研究中,前人使用跨通道启动范式(Schirmer et al.,2002,2005)以及韵律/词汇干扰范式(Schirmer&Kotz,2003)均发现,与韵律背景效价不一致的情绪词诱发了更负的N400成分,研究者认为情绪韵律可以像句子背景一样,调节情绪词汇的意义加工。本研究得到的N400效应与Schirmer等人(2002,2005)以及Schirmer和Kotz(2003)的研究结果相似。此外,本研究还与Kotz和Paulmann(2007)以及Paulmann和Kotz(2008)使用句子水平上的“预期违反(Expectancy violation)”范式的情绪言语加工研究结果类似,他们将两种不同情绪的韵律/语义模式并列放到一起,以观察韵律/语义联合的不一致条件与一致条件之间的ERP差异,其结果显示,情绪韵律和语义信息的联合违反在350~650 ms诱发了走向更负的类似于N400的成分。因此,结合前人研究及本研究的结果,我们认为这种N400效应反映的是情绪韵律对口语情绪词意义提取的影响,N400波幅的增加可能反映了个体提取词汇意义的难度的增加。

4.3 后期负波效应

除了N400的典型时窗外,在550~1000 ms,语音词诱发的波形受到情绪词与情绪韵律之间的效价一致性的影响,效价不一致语音词诱发了走向更负的负波。这一后期负波效应与N300/N400效应相似,呈双侧化趋势,且头皮分布较为广泛。以往研究表明,听觉词通常诱发双侧化、对称的N400成分,且N400持续时间通常要比视觉词及其他刺激更长(Holcomb&Anderson,1993),其原因可能是听觉词是随时间展开的,一个音位接着一个音位出现(Holcomb&Neville,1991)。与听觉词相似,与背景信息不一致的动态影片诱发的N400效应的持续时间也较长(Sitnikova et al.,2008)。因此,我们认为这一后期负波效应是N400效应的延续。

综上所述,本研究ERP结果表明,与非声调语言相似,汉语中的情绪韵律无论是在多个词汇上连续呈现,还是在单个词汇上随机呈现,均能够实时调节口语情绪词的识别,表现为当口语情绪词与情绪韵律效价一致时,情绪词的音韵编码和语义加工得到易化。

图7 情绪言语加工的时间进程

4.4 情绪言语的多阶段加工

许多研究者将情绪言语加工看作是一个多阶段的加工过程(Schirmer&Kotz,2006;Paulmann,Ott,&Kotz,2011)。首先,个体需要分析语音中的声学线索,加工刺激的频率和音强等感觉信息(Engelien,Schulz,Ross,Arolt,&Pantev,2000),这一阶段出现在100 ms左右;其次,听话人完成对复杂的声学线索的整合,识别刺激的情绪意义,这一阶段出现在200 ms左右(Paulmann&Kotz,2008);最后,将韵律的情绪意义应用到更高层次的认知加工,比如与词汇/语义信息的相互作用,这一加工过程与N300和N400成分有关(Bostanov&Kotchoubey,2004)。

根据本研究的ERP结果,情绪韵律和情绪词之间的效价关系除了能够调节情绪词诱发的N300和N400成分之外,还能够调节P200成分。这表明,情绪韵律对情绪词识别的影响出现的更早,在听话人加工情绪言语的第二个阶段,即韵律特征的情绪意义得到提取的时候,就能对听觉情绪词的音韵特征加工产生影响。说明在情绪言语加工过程中,个体在词汇加工过程中能够及时的利用情绪韵律特征。图7显示了汉语情绪言语加工涉及的三个基本过程。听话人平行加工了情绪言语中的情绪韵律和情绪词这两个维度的信息,在100 ms左右,分别对韵律和词汇的声学特征进行早期的感觉加工;在200 ms左右,韵律的情绪意义得到识别的同时,听话人也在对情绪词的语音特征进行加工,并且情绪韵律能够调节情绪词的音韵编码;随后情绪韵律还对情绪词的语义加工产生影响,情绪韵律可以像语义上下文一样被作为一种背景信息使用,以自上而下的方式对词汇在语义记忆中的激活和选择进行约束。

5 结论

本研究采用韵律/词汇干扰范式和事件相关电位技术考察了情绪言语加工的时间进程。结果表明,与非声调语言相似,汉语中的情绪韵律能够实时地调节口语情绪词的识别。这一调节作用在早期的音韵编码阶段就已经出现,表现为当口语情绪词与情绪韵律效价一致时,情绪词的音韵编码得到易化;此外,情绪韵律还调节口语情绪词的语义加工,使得对与情绪韵律效价一致的情绪词的语义加工难度降低。

Banse,R.,&Scherer,K.R.(1996).Acoustic profiles in vocal emotion expression.Journal of Personality and Social Psychology,70

(3),614–636.Boersma,P.,&Weenink,D.(2011).Praat:Doing phonetics by computer(Version 5.2.25)[Computer program].Retrieved May 3,2011,from http://www.praat.org/

Bostanov,V.,& Kotchoubey,B.(2004).Recognition of affective prosody: Continuous wavelet measures of event-related brain potentials to emotional exclamations.Psychophysiology,41

,259–268.Braun,M.,Hutzler,F.,Ziegler,J.C.,Dambacher,M.,&Jacobs,A.M.(2009).Pseudohomophone effects provide evidence of early lexico-phonological processing in visual word recognition.Human Brain Mapping,30

,1977–1989.Deacon,D.,Dynowska,A.,Ritter,W.,&Grose-Fifer,J.(2004).Repetition and semantic priming of nonwords:Implications for theories of N400 and word recognition.Psychophysiology,41

,60–74.Engelien,A.,Schulz,M.,Ross,B.,Arolt,V.,&Pantev,C.(2000).A combined functional in vivo measure for primary and secondary auditory cortices.Hearing Research,148

,153–160.Federmeier,K.D.,&Kutas,M.(2001).Meaning and modality:Influences of context,semantic memory organization,and perceptual predictability on picture processing.Journal of

Experimental Psychology: Learning, Memory and Cognition,27

,202–224.Grimshaw,G.M.(1998).Integration and interference in the cerebral hemispheres: Relations with hemispheric specialization.Brain and Cognition,36

,108–127.Holcomb,P.J.(1993).Semantic priming and stimulus degradation:Implications for the role of the N400 in language processing.Psychophysiology,30

,47–61.Holcomb,P.J.,&Anderson,J.E.(1993).Cross-modal semantic priming: A time-course analysis using event-related brain potentials.Language and Cognitive Processes,8

,379–412.Holcomb,P.J.,Anderson,J.,&Grainger,J.(2005).An electrophysiological study of cross-modal repetition priming.Psychophysiology,42

,493–507.Holcomb,P.J.,&Neville,H.J.(1991).Natural speech processing:An analysis using event-related brain potentials.Psychobiology,19

,286–300.Kelly,S.D.,Kravitz,C.,&Hopkins,M.(2004).Neural correlates of bimodal speech and gesture comprehension.Brain and Language,89

,253–260.Kitayama,S.,& Ishii,K.(2002).Word and voice:Spontaneousattention to emotionalutterancesin two Languages.Cognition and Emotion

,16

,29–59.Kong,L.Y.,Zhang,J.X.,Kang,C.P.,Du,Y.C.,Zhang,B.,&Wang,S.P.(2010).P200 and phonological processing in Chinese word recognition.Neuroscience Letters,473

,37–41.Kotz,S.A.,&Paulmann,S.(2007).When emotional prosody and semantics dance cheek to cheek:ERP evidence.Brain Research,1151

,107–118.Kutas,M.,&Federmeier,K.D.(2011).Thirty years and counting:Finding meaning in the N400 component of the event-related brain potential(ERP).Annual Review of Psychology,62

,621–647.Lin,T.,&Wang,L.J.(1992).A course in phonetics

.Beijing:Peking University Press.[林焘,王理嘉.(1992).语音学教程

.北京:北京大学出版社.]Meyler,A.,&Breznitz,Z.(2005).Impaired phonological and orthographic word representations among adult dyslexic readers: Evidence from event-related potentials.The Journal of Genetic Psychology,166

,215–238.Min,C.S.,&Schirmer,A.(2011).Perceiving verbal and vocal emotions in a second language.Cognition&Emotion,25

(8),1376–1392.Nygaard,L.C.,&Queen,J.S.(2008).Communicating emotion:Linking affective prosody and word meaning.Journal of Experimental Psychology:Human Perception and Performance,34

(4),1017–1030.Paulmann,S.,&Kotz,S.A.(2008).An ERP investigation on the temporal dynamics of emotional prosody and emotional semantics in pseudo-and lexical-sentence context.Brain and Language,105

,59–69.Paulmann,S.,Ott,D.V.M.,&Kotz,S.A.(2011).Emotional speech perception unfolding in time:The role of the basal ganglia.PloS ONE,6

(3),e17694.Savill,N.J.,& Thierry,G.(2011).Electrophysiological evidence for impaired attentional engagement with phonologically acceptable misspellings in developmental dyslexia.Frontiers in Psychology,2

,139.Scherer,K.R.(2003).Vocal communication of emotion:A review of research paradigms.Speech Communication,40

,227–256.Scherer,K.R.,Banse,R.,&Wallbott,H.G.(2001).Emotion inferences from vocal expression correlate across languages and cultures.Journal of Cross-Cultural Psychology,32

,76–92.Schirmer,A.,&Kotz,S.A.(2003).ERP Evidence for a sex-specific stroop effect in emotional speech.Journal of Cognitive Neuroscience,15

,1135–1148.Schirmer,A.,& Kotz,S.A.(2006).Beyond theright hemisphere:Brain mechanisms mediating vocal emotional processing.Trends in Cognitive Sciences,10

,24–30.Schirmer,A.,Kotz,S.A.,&Friederici,A.D.(2002).Sex differentiates the role of emotional prosody during word processing.Cognitive Brain Research,14

,228–233.Schirmer,A.,Kotz,S.A.,&Friederici,A.D.(2005).On the role of attention for the processing of emotions in speech:Sex differences revisited.Cognitive Brain Research,24

,442–452.Schirmer,A.,Liu,M.,Maess,B.,Escoffier,N.,Chan,M.,&Penney,T.B.(2006).Task and sex modulate the brain response to emotionalincongruity in Asian listeners.Emotion

,6

,406–417.Sitnikova,T.,Holcomb,P.J.,Kiyonaga,K.A.,&Kuperberg,G.R.(2008).Two neurocognitive mechanisms of semantic integration during the comprehension of visual real-world events.Journal of Cognitive Neuroscience,20

,2037–2057.Stenberg,G.,Lindgren,M.,Johansson,M.,Olsson,A.,&Rosén,I.(2000).Semantic processing without conscious identification: Evidence from event-related potentials.Journal of Experimental Psychology:Learning,Memory,and Cognition,26

,973–1004.van Petten,C.,Coulson,S.,Rubin,S.,Plante,E.,&Parks,M.(1999).Time course of word identification and semantic integration in spoken language.Journal of Experimental Psychology: Learning, Memory, and Cognition,25

,394–417.Wang,Y.N.,Zhou,L.M.,&Luo,Y.J.(2008).The pilot establishment and evaluation of Chinese affective words system.Chinese Mental Health Journal,22

,608–612.[王一牛,周立明,罗跃嘉.(2008).汉语情感词系统的初步编制及评定.中国心理卫生杂志,22

,608–612.]Wu,Y.C.,&Coulson,S.(2007).How iconic gestures enhance communication:An ERP study.Brain and Language,101

,234–245.Wurm,L.H.,Vakoch,D.A.,Strasser,M.R.,Calin-Jageman,R.,&Ross,S.E.(2001).Speech perception and vocal expression of emotion.Cognition and Emotion,15

,831–852.