基于IHS和小波变换的可见光与红外图像融合

李洋,焦淑红,孙新童

(哈尔滨工程大学信息与通信工程学院,黑龙江哈尔滨150001)

图像融合就是将不同传感器在同一时间(或者不同时间)获得同一目标的2幅或者多幅影像通过一种特定算法合成为一幅新图像的技术[1].随着科技的发展,图像融合在自动目标识别、遥感、医学图像处理、计算机视觉等领域有着广泛的应用.

红外图像与可见光图像融合是图像融合领域的重要组成部分,红外图像主要反映目标和场景的红外辐射特性,不易受环境影响,但缺乏对目标场景纹理细节的表现,不利于人眼的判读.而可见光图像能较好地显示对比度、形状、彩色和纹理细节,但它却受光照条件和环境条件的约束.因此可以利用红外图像获取场景中的非自然(冷或热)目标,而利用可见光图像获取场景的背景细节信息,这使得红外图像与可见光图像的融合可以很好地提高对目标的探测和识别能力,在军事作战、电子产品检测、资源探测等众多领域中都有广泛的实用价值[2].

图像融合可分为3级,即像素级融合、特征级融合和决策级融合[3-5].目前的融合方法大多为像素级融合,常用方法包括IHS变换、PCA、金字塔变换、小波变换、Contourlet变换等融合方法[6-11]其中PCA法是一种选取最优像素权值的方法,但无法突出光谱特性,不适用于相关性弱的图像融合;金字塔变换法是多分辨率分析方法,有较好的融合效果,但是该类方法计算量大,并且融合结果为灰度图像,无法保持可见光图像的光谱特性;Contourlet变换是小波变换的一种扩展,是一种多分辨率、多方向的分析方法,能较好地保持图像的光谱特性.

IHS变换因其计算简单,并能极大地提高图像空间分辨率,而被广泛应用,但会出现光谱扭曲现象[12].而小波变换将图像分解为水平、垂直及对角方向的高频分量和相应分辨率下的低频分量,在进行融合时,对高频分量和低频分量使用不同的融合规则,这样它就能较好地保持原始图像的光谱信息,但会出现分块效应,计算速度比IHS变换相对慢一些.因此将IHS和小波变换结合的图像融合方法既可以保留光谱信息,又可以保持空间信息.目前此方法普遍应用于遥感影像融合.

针对可见光图像和红外图像的特点,本文提出一种基于IHS和小波变换的图像融合方法,该方法不仅能较好地保持图像光谱信息和提高空间细节信息,而且还可以获得红外图像中的热目标信息.实验结果证明,该方法优于传统的IHS变换法和小波变换等方法,取得了很好的融合效果.

1 基于IHS和小波变换的图像融合方法

1.1 IHS变换融合方法

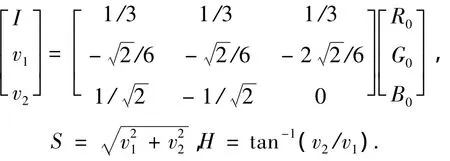

常用的色彩空间有RGB色彩空间和IHS色彩空间[13],RGB色彩空间常用于计算机彩色显示器的显示系统中,RGB中R代表红色,G代表绿色,B代表蓝色,3种色彩叠加形成其他的色彩.而IHS色彩空间包含亮度I、色度H与饱和度S三要素,这三要素相关性很低,这就使IHS空间中的3个分量可以单独地被处理.而且这种模型面向视觉感知,更适合基于人的视觉对彩色感知特性进行处理分析,所以在图像融合中被广泛使用.传统IHS变换公式如下:

1)IHS正变换公式:

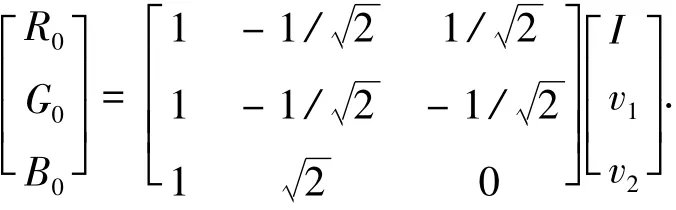

2)IHS逆变换公式:

式中:R0、G0、B0代表RGB空间的3种色彩.

传统IHS变换融合原理:在已配准可见光图像与红外图像下,对可见光图像进行IHS正变换,提取I分量,然后用红外图像替换掉可见光图像的I分量,保持可见光图像的H分量和S分量不变,然后进行IHS逆变换,最后便得出融合的新图像.

1.2 小波变换融合方法

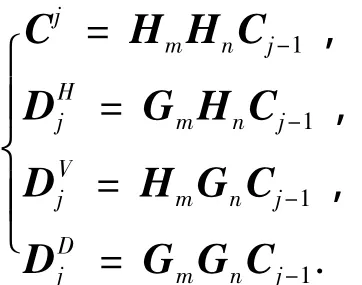

通常使用的是二维的Mallat小波算法[14],它是一种常用的离散小波变换的快速实现算法,它将图像分解为水平、垂直及对角方向的高频信息和相应分辨率下的低频分量.由于小波基的正交性,所以图像小波分解过程中不产生冗余数据[15].这样,就可以方便地分析信号在不同频带上的频域特性.根据算法,图像的第j次小波分解后生成3个高频分量分别为水平方向对角方向DDj和一个低频分量Cj,j表示小波分解尺度,H表示低通滤波器,G表示高通滤波器.分解公式为:

式中:下标m和n分别表示图像的行与列,重构公式如下:

式中:H*、G*分别为H、G的共轭转置矩阵.

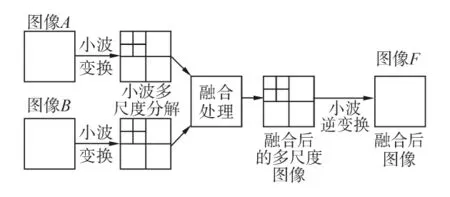

基于小波变换的图像融合基本步骤为:首先对已配准的源图像A、B分别进行N层小波分解,得到3N个高频子带图和一个低频子带图;接下来分别对每一层、每一方向的相应子带图进行融合处理,产生融合后的各子带图;最后对融合后的子带图进行小波重构得到融合图像F.图1为基于小波变换的图像融合原理图.

图1 基于小波变换的图像融合原理Fig.1 Image fusion principles for wavelet transforms

1.3 基于IHS和小波变换的图像融合方法

由于红外成像器件本身存在的缺陷和环境因素的影响,造成了成像效果不理想,主要表现为红外图像中噪声较大、对比度较低、视觉效果不好、分辨图像细节能力比较差等缺点,这些都将影响后续与可见光图像的配准效果以及融合质量[16].所以,本文方法先对红外图像进行增强处理,改善红外图像的视觉效果,在这里采用的增强方法是灰度变换方法.它能够使图像的动态范围加大,增大图像对比度,使目标更加清晰明显,更方便融合.

在图像融合中,融合规则非常重要.一般情况下,图像所含信息不是一个像素所能表现的,而是由局部区域中多个像素共同表征和体现的.在人类视觉感知对象中,对单个像素的灰度值并不能很好地感知,而是对图像特定区域内像素比较敏感地感知.另外,图像中某一局部区域各像素之间往往具有较强的相关性[17-18].综上可知,基于像素的融合规则有片面性,所以融合效果往往不够理想.然而基于区域窗口的融合规则相比于基于像素的融合规则更复杂,花费时间更长,但可以获得更好的融合效果.为得到更好的融合效果,本文低频和高频融合规则都采用基于窗口的融合规则.

本文提出了一种基于IHS和小波变换的图像融合算法,该算法步骤如下:

1)对红外图像和可见光图像进行严格配准.

2)对可见光图像进行IHS变换,得到I、H、S分量,对红外图像进行灰度变换.

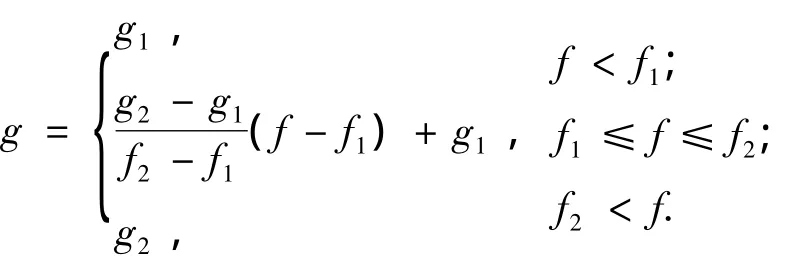

灰度变换采用的是三段线性变换法,表示为

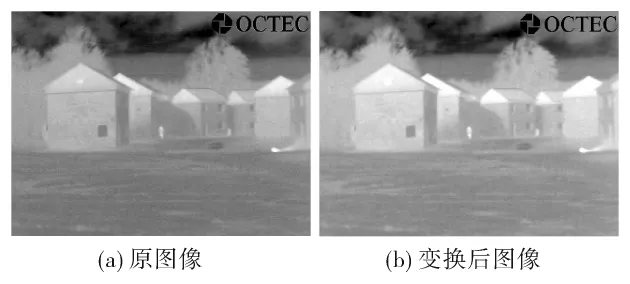

式中:f和g分别是灰度变换前和变换后的灰度值,[f1,f2]为实际图像的灰度范围,[g1,g2]为灰度变换后图像的灰度范围.图2为灰度变换对比图像.

图2 灰度变换对比图像Fig.2 The comparison images of gray-scale transformation

3)对可见光图像的I分量和已增强的红外图像进行二次小波分解,得到各自高频和低频子图.

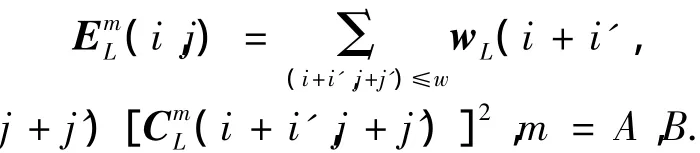

4)对小波分解后的低频近似分量采用基于窗口能量的低频子带图融合准则.小波系数的低频分量,包含了图像信息的主要轮廓信息,它相当于在一定尺度下对原始信号的近似.而低频能量是图像强度的一种有效测度,在某种程度上反应图像基本信息,因此可以用局部能量作为低频系数重要性的度量.本文采用基于窗口能量的低频子带图融合方法,其思想是:用低频子带图的窗口能量表征系数的重要性,根据窗口能量的大小决定融合源图像子带系数.

源图像A、B的低频子带图在位置(i,j)处的窗口局部能量(i,j)定义为

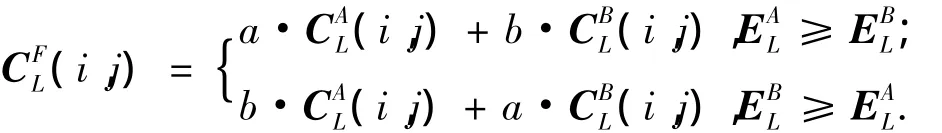

比较2幅图像对应的窗口能量,得出新的低频分量:

5)小波系数分解后的高频分量包含图像的显著细节特征,如边缘、纹理、细节等信息.因此对高频部分处理的主要目的是尽可能增强融合图像的细节信息.而图像局部区域的标准差能够反映各像素灰度对应于区域灰度均值的离散情况,标准差越大,则灰度级分别越分散,从而可以更好地反映图像的纹理、边缘等信息.因此本文采用了基于窗口标准差取大法的融合规则.此融合方法的思想是,选定M×N的窗口,计算窗口内像素点灰度值标准差,比较2幅图像高频分量对应窗口的标准差,取标准差较大的高频分量作为新的高频分量.高频分量窗口标准差的定义为

得出标准差后按照下式确定新的高频分量.

6)对新分块图像进行小波重建,得到新强度分量图像Inew,然后再进行IHS逆变换得到融合图像F.

2 融合实验及评价

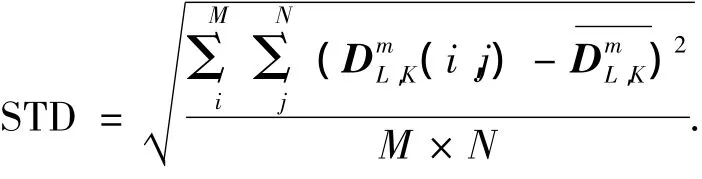

图3(a)、(b)给出了一组同一场景的彩色可见光图像和红外图像.图3(a)亮度较高、可视性好、细节信息丰富,但是由于有烟雾的存在,观察不到烟雾后面的目标人物和发热源.图3(b)中2个目标人物、发热源和房屋都清晰可见,但是周围其他景物很模糊,细节信息缺失严重,只能看到大概轮廓.

图3 不同图像融合方法的实验结果Fig.3 The results of different image fusion methods

为了验证本方法的有效性,还采用了其他5种图像融合算法进行对比实验,如图3(c)~(h).图3(c)能够观察到红外目标,但是光谱失真并且细节信息缺失严重;图3(d)整体偏暗,虽然光谱效果较好,但却丢失了红外图像中重要的信息,只能观察到一个目标人物,而且红外目标不清晰;图3(e)与图3(c)效果接近,但是细节信息保留较好;图3(f)、(g)视觉效果较好、清晰度高、边缘清晰、光谱失真较小,但是红外图像中的重要信息却表现不够明显,只能观察到一个目标人物.利用本文算法融合的图像3(h)视觉效果最好,图像整体亮度高、色彩鲜明并且图像边缘清晰,既保留了可见光图像中背景信息(树、房子、烟雾等)又保留了红外图像中的重要信息,2个目标人物与发热源均清晰可见.综上比较本文算法优于上述其他算法,获得了很好的融合效果.

本文还采用均值、信息熵、标准差和平均梯度等客观评价标准将文中提出的方法与其他的方法进行了对比,以下为评价标准的计算公式.

1)均值(average value).它指的是像素的灰度平均值,对人眼反应为平均亮度,其定义为

式中:图像大小是M×N,F(i,j)表示的是在点(i,j)的灰度值.

2)标准差(standarn deviation).它反映了图像相对于平均灰度值的离散情况.标准差越大,图像的灰度级分布越分散,说明融合效果越好.

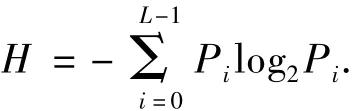

3)信息熵(information entropy).它是图像信息量的度量,其定义为

式中:Pi为灰度i的分布概率,L为灰度级总数,熵值越大说明图像信息量越大.

4)平均梯度(mean grade).它反映了图像中的微小细节反差与纹理变化特征以及图像的清晰度,其定义为

式中:Δxf(i,j)、Δyf( i,j)分别为像素(i,j)在 x、y方向上的一阶差分值.

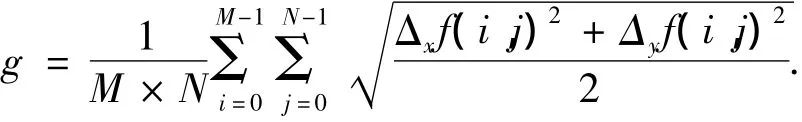

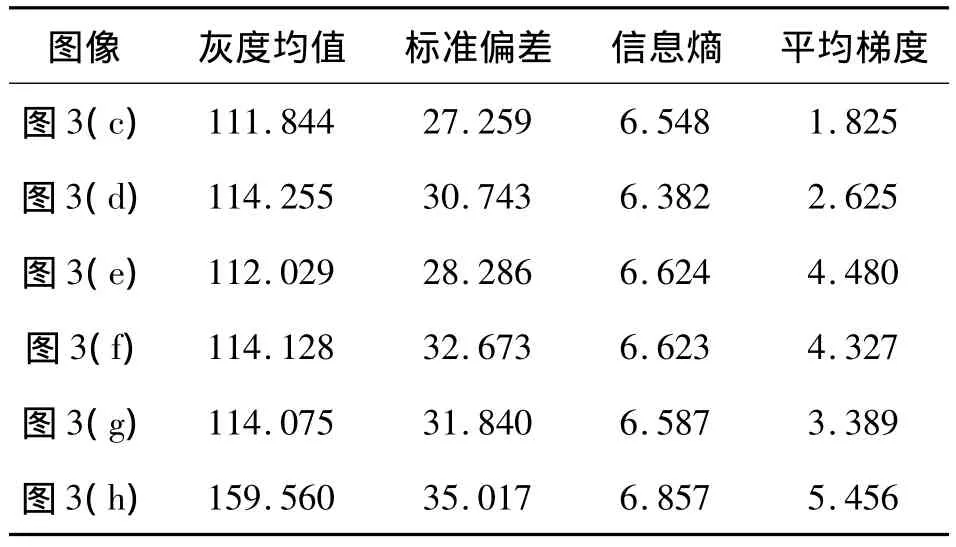

从表1中可看出,本文所提出的方法在灰度均值、信息熵、平均梯度上优于其他算法,其中灰度均值和平均梯度优势明显.这表明对比其他算法,利用本文的算法,融合后的图像亮度更高,微小细节及纹理反映更好,图像的清晰度更高,融合图像携带的信息更丰富.

表1 图像融合试验结果Table 1 Results of image fusion

3 结束语

针对可见光与红外图像融合,本文提出了一种基于IHS变换和小波变换的方法.首先对红外图像进行适当的灰度变换,并对可见光进行IHS变换,然后对可见光图像中I亮度分量和红外图像进行小波分解得到低频和高频分量,对于低频和高频分量分别采用基于窗口能量的加权平均法和基于窗口区域标准差取大法.实验仿真结果表明,本文方法不仅能够大大增强融合图像的亮度与清晰度,并且能够保留可见光图像中的光谱信息与红外图像中的重要信息,是一种有效的图像融合方法.

[1]POHL C,Van GENDEREN J L.Multisensor image fusion in remote sensing:concepts,methods and applications[J].International Journal of Remote Sensing,1998,9(5):823-854.

[2]葛小青.红外与可见光图像融合的研究[D].重庆:重庆大学,2010:1-3.GE Xiaoqing.Research on fusion of infrared and visible images[D].Chongqing:Chongqing University,2010:1-3.

[3]蒋晓瑜.基于小波变换和伪彩色方法的多重图像融合算法研究[D].北京:北京理工大学,1997:1-5.JIANG Xiaoyu.Multiple image fusion algorithm based on wavelet transform and pseudo-color method[D].Beijing:Beijing Institute of Technology,1997:1-5.

[4]胡江华,柏连发,张保民.像素级多传感器图像融合技术[J].南京理工大学学报,1996,20(5):453-456.HU Jianghua,BAI Lianfa,ZHANG Baomin.Pixel level multisensor image fusion technique[J].Journal of Nanjing University of Science and Technology,1996,20(5):453-456.

[5]张加友,王江安.红外图像融合[J].光电子·激光,2000,11(5):337-539.ZHANG Jiayou,WANG Jiang’an.Infrared image fusion[J].Journal of Optoelectronics· Laser,2000,11(5):537-539.

[6]CARPER W J,LILLESAND T M,KIEFER R F.The use of intensity-hue-saturation transformations for merging SPOT panchromatic and multispectral image data[J].Photogrammetric Engineering& Remote Sensing,1990,56(4):459-467.

[7]Jr CHAVEZ P S,SIDES S C,ANDERSON J A.Comparison of three difference methods to merge multiresolution and multipectral data:landsat TM and SPOT panchromatic[J].Photogrammetric Engineering& Remote Sensing,1991,57(3):295-303.

[8]BURT P J,ADELSON E H.The Laplacian pyramid as a compact image code[J].IEEE Trans Commun,1983,31(4):532-540.

[9]LAINE I K A,TAYLOR F.Image fusion using steerable dyadic wavelet transform[C]//Proc of the IEEE Int'l Conf on Image Processing.Washington DC,USA,1995:232-235.

[10]DO M N,VETTERLI M.The contourlet transform:an efficient directional multi-resolution image representation[J].IEEE Transactions on Image Processing,2005,14(12):2091-2106.

[11]吴怀群,黄宵宁,王建,等.一种基于熵值的自动阈值图像分割方法[J].应用科技,2011,38(8):1-4.WU Huaiqun,HUANG Xiaoning,WANG Jian,et al.A method of image segmentation for automatically calculating threshold based on entropy[J].Applied Science and Technology,2011,38(8):1-4.

[12]TU T,SU S,SHYN H,et al.A new look at IHS-like image fusion methods[J].Information Fusion,2001(2):177-186.

[13]张晓煜,李向.基于IHS变换与小波变换的图像融合[J].计算机与现代化,2007(8):48-53.ZHANG Xiaoyu,LI Xiang.Image fusion based on IHS and wavelet transforms[J].Computer and Modernization,2007(8):48-53.

[14]MALLAT S.A theory for multiresolution signal decomposition:the wavelet representation[J].IEEE Transactions on Pattern Analysis and Machine Intellience,1989,11(7):674-693.

[15]唐国良,普杰信,黄心汉.一种基于IHS和小波变换的彩色图像融合算法[J].计算机应用研究,2006(10):174-175.TANG Guoliang,PU Jiexin,HUANG Xinhan.Color image fusion algorithm based on IHS and wavelet transformation[J].Application Research of Computers,2006(10):174-175.

[16]郭佳.红外与可见光图像融合技术的研究[D].西安:西安工业大学,2009:7-16.GUO Jia.Research on fusion technology of infrared and visible image[D].Xi'an:Xi'an Technological University,2009:7-16.

[17]孙即祥.图像处理[M].北京:科学出版社,2009:25-27.

[18]曲昆鹏,郑丽颖.基于目标、背景比例的灰度图像自动阈值选取法[J].应用科技,2011,37(2):52-54.QU Kunpeng,ZHENG Liying.Automatic thresholding of gray-scale image based on the proportion of object and background[J].Applied Science and Technology,2010,37(2):52-54.