基于相关区域约束的SURF特征点匹配

王海丽, 张 良

(中国民航大学 a.工程技术训练中心;b.智能信号与图像处理天津市重点实验室,天津 300300)

0 引言

局部特征检测与匹配是计算机视觉研究的热点。局部特征可以是对图像尺度、光照、视角变化、噪声等不敏感的角点、直线、边缘、随机点等,才能有效地进行目标跟踪。基于几何模板的方法难以解决目标之间的遮挡;基于纹理的算法对尺度变化敏感,可重现性低,在目标跟踪中容易丢失目标。结合基于鲁棒特征点进行定位,基于分布的特征向量进行匹配可以有效地解决这一难题。

局部特征点检测器有 Harris, SUSAN, Harris-Laplacian, SIFT[1]、GLOH等被广泛用于目标跟踪[2],移动博物馆向导[3]等,高维的特征提取和基于距离的匹配计算量大,复杂度高。SURF[4]速度快,可结合 Harris角点进行机器人定位导航[5]。基于运动相关性匹配帧间SURF特征,根据特征向量的NN/SN,误匹配率较高;增加随机抽样一致性估计算法[6]可有效去除孤立点;在连续帧间增加约束条件进行特征匹配,有效估计运动目标,实现准确的特征匹配和目标跟踪。

1 常用局部特征点检测算法及特点

局部特征点检测算法中,Harris角点检测计算亮度变化进行近似,可重现性高,对旋转、光照变化具有不变性,但对尺度变化敏感。SUSAN比较模板中的像素值与模板中心的相对变化计算USAN面积,适合低层次图像处理,受阈值影响大,定位精度低。Harris-Lapalcian建立Harris角点的多尺度空间,计算Laplacian算子极值,最终定位出多尺度的Harris角点。SIFT算法在高斯差分尺度空间中,计算极值进行定位,利用梯度方向指定主方向,在邻域内生成128维的特征向量,采用NN/SN进行匹配,提取特征数目多,稳定性好,可扩展性强。但图像构造层数和高维特征向量都使其计算量较大,实时性较差。

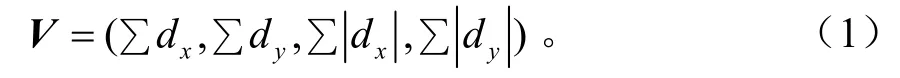

2 基于区域相关约束的SURF算法

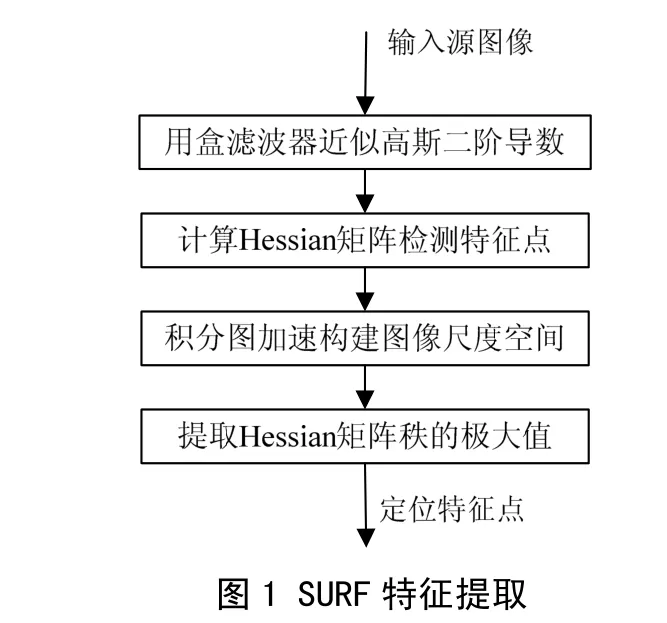

SURF速度优于SIFT算法,区别如表1所示。SURF算法的特征定位,如图1所示,然后在邻域内指定主方向;计算Harr小波响应的和,将每一个子区域内的小波响应dx和dy相叠加,形成该子区域的特征向量V的元素,每个子区域有4个特征元素,如式(1)所示,4×4的子区域可生成64维的特征向量。核实拉普拉斯符号检索策略来加速匹配,采用基于欧式距离的相似度匹配。

SURF的速度增益源于使用积分图,采用盒滤波器进行卷积,与图像尺度无关;特征向量维数小,拉普拉斯符号加快了匹配。

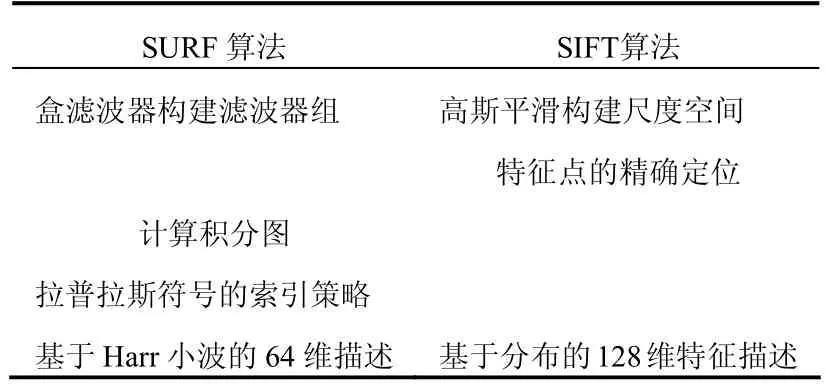

SURF算法和SIFT 算法实现的比较如表1所示。

表1 SURF算法和SIFT 算法实现的比较

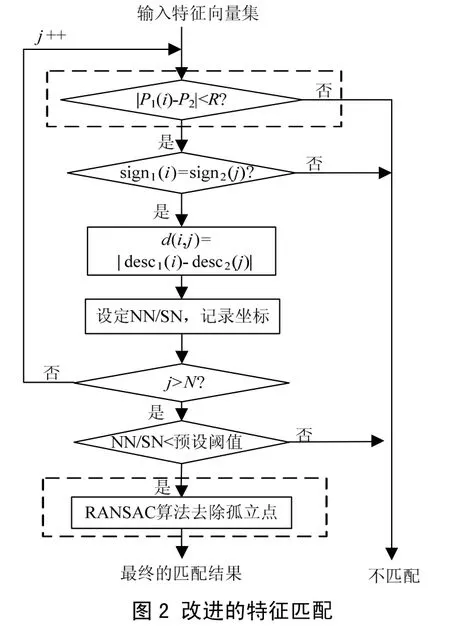

特征匹配中,采用NN/SN作为唯一的匹配标准,忽略了特征向量之间的统计规律。随机抽样一致性估计在进行参数估计时,并非不加区分地对待所有输入数据,而是针对具体问题设计搜索引擎,利用它剔除与所估计的参数不一致的数据,利用正确的输入数据来估计参数,可以去除孤立点,减少后续距离的计算量,可提高匹配正确率。

在连续视频帧间,目标的运动是有限的,运动目标上特征点位置的连续性可用于特征匹配前剔除孤立点。SURF特征在两帧中可能会出现在相同或相近的位置,因此特征匹配应在其邻域内进行。邻域大小R的设定跟运动目标的运动速度和处理时跳过帧的多少有关。改进的特征匹配,如图2所示,增加的约束条件,如虚线所示,将当前帧的第i个特征点的特征向量P1(i)与下一帧所有特征向量P2匹配,NN/SN越小,匹配越准确。

3 仿真结果分析

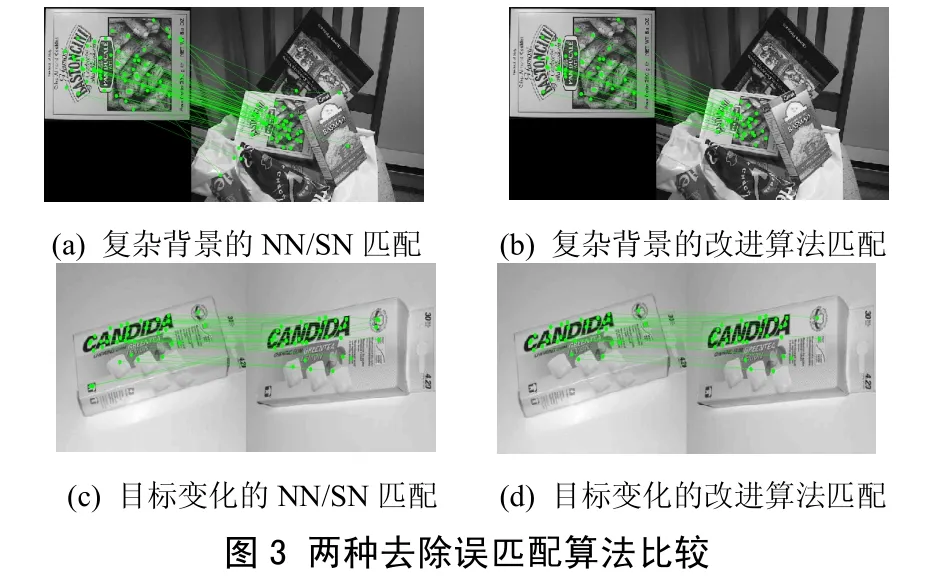

第1组源数据为338×289、512×384和320×240JPEG的灰图像,在凌乱和存在部分遮挡的背景下,图像发生视角、光线、尺度变化后,比较仅采用 NN/SN和增加随机抽样一致性估计算法的匹配结果,如图3所示,NN/SN=0.75,耗时为3.7 s和0.54 s。仿真表明:随机抽样一致性估计可以有效地去除孤立点,提高正确匹配率,鲁棒地识别目标。

第 2组源数据为 737飞机和 PETS数据库576×720视频帧。假设运动目标已分割,跳过3帧作为待匹配帧,图4(a)和图4(b)采用NN/SN进行匹配,约90%的特征点重现,但在运动目标或背景上存在很多误匹配。增加随机抽样一致性估计减少误匹配的同时,原来正确匹配的特征对也可能被误作为孤立点,因此,在特征匹配之前,增加运动目标的区域约束,提高了匹配精度,如图 4(c)和图 4(d)所示。

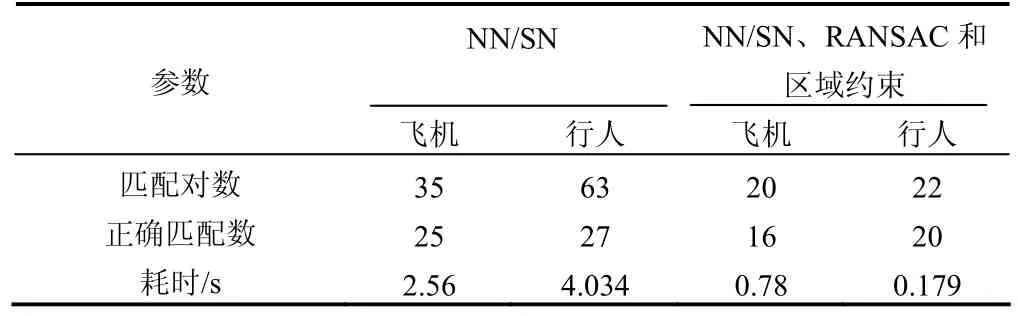

在保证算法性能的前提下,改进的方法加速了匹配过程,提高了正确匹配率,如表2所示,为后续目标跟踪提供了必要的前提。

表2 特征匹配分析

4 结语

改进的视频帧间SURF特征匹配,结合像素位置相关性和随机抽样一致性估计在匹配正确率和匹配速度上都明显提高,为后期的目标跟踪提供了可靠的前提。SURF特征向量的可扩展性强,可以结合颜色向量、全局变量、或特征关联[7-8]等方面进行进一步的研究,易于检测、稳定性高和独特性好的局部特征对于机器人视觉[9]、视频处理等研究具有重要的研究价值,对机场低密度人群的目标跟踪,提高机场安全保障具有重要的应用价值。

[1] LOWE D. Distinctive Image Features from Scaleinvariant Keypoints[J]. International Journal of Computer Vision, 2004, 60(02):91-110.

[2] CHEN A H, ZHU M, WANG Y H,et al. Mean Shift Tracking Combining SIFT[C]//IEEE.9th International Conference on ICSP. Germany:IEEE,2008: 1532-1535.

[3] RUF B, KOKIOPOULOU E, DETYNIECKI M. Mobile Museum Guide based on Fast SIFT Recognition[C]//6th International Workshop on Adaptive Multimedia Retrieval. Berlin, Germany:Computer Science,2008:26–27.

[4] BAY H, ESS A, TUYTELAARS T, et al. Speeded-Up Robust Features (SURF)[J]. Computer Vision and Image Understanding, 2008, 110(03):346-359.

[5] RODRIGUEZ D, AOUF N.Robust Harris-SURF Features for Robotic Vision based Navigation[C]//IEEE.International IEEE Conference on Intelligent Transportation Systems. Madeira Island, Portugal:IEEE,2010: 1160-1165.

[6] FISCHLER M A, BOLLES R C. Random Sample Consensus:a Paradigm Model Fitting with Applications to Image Analysis and Automated Cartography[J].Communications of the Association of Computing Machinery, 1981, 24(06):381–395.

[7] 周新宇,杨风暴,吉琳娜. 一种新的地面目标多特征关联方法[J]. 通信技术, 2011, 44(09): 132-134.

[8] 黎蔚,杨凯鹏,陈家新,等. 一种基于特征自动选取的跟踪算法[J].通信技术, 2010,43(03):128-130.

[9] ZHANG Z J, CAO C X, ZHANG R J, et al. Video Copy Detection based on Speeded Up Robust Features and Locality Sensitive Hashing[C]//IEEE.IEEE International Conference on Automation and Logistics.USA:IEEE, 2010: 13-18.