不同视场的多源图像融合技术研究

田思,张俊举,袁轶慧,常本康

(1.宁波大红鹰学院 应用科技研究院,浙江 宁波315175;2.南京理工大学 电光学院,江苏 南京210094)

像素级融合[1]是直接对源图像的像素数据进行融合处理,能更多地保留场景的原始信息,是应用比较广泛的图像融合方法。对源图像配准、视场的重合度要求较高,一般来讲在源图像的光学系统视场相同的情况下,采集到的图像更容易实现配准,也更有利于融合图像质量提高,也保证了融合图像的信息量。

但在实际应用中,往往会有一些多源图像采集设备的光学系统视场相差比较大,而每个源图像各有其特点(如可见光图像、微光图像和红外图像),融合图像更能体现场景的细节、突出场景目标[2]。对于这种情况,在图像配准算法和图像融合算法的应用上又有一些不同特点。图1为不同视场图像融合示意图,两套不同视场的光学系统采集到得图像分别是图像A 和图像B,图像B 只对应于图像A 中一部分,图像C 是图像A 和图像B 的融合结果。实际上图像C 中只有虚线部分才是融合图像,而其余部分只有图像A 的信息。

图1 2 个不同视场图像融合示意图Fig.1 Image fusion in two FOVs

1 不同视场的多源图像融合的频域分析

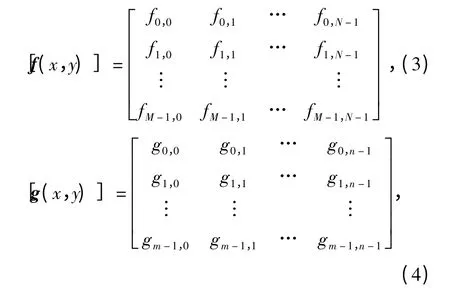

考虑2 个不同图像传感器的情况,假如2 个图像传感器产生两幅图像f(x,y)和g(x,y),图像f(x,y)是小视场图像大小M ×N,大视场图像g(x,y)大小m×n 中区域部分(m <M,n <N),一幅数字化的图像可以用矩阵来表达它不同位置上的灰度分布函数,即

用矩阵表达则为

频域(u,v)的离散傅里叶变换可以表示为

对于一般的图像来讲,二维频域(u,v)内图像的主体是低频部分,它表达的是总体形状、特征轮廓、对比度特征等,而那些边缘、波纹是图像的高频部分。图1中,图像A 中对应于图像B 的部分往往是关注的焦点,也是频率能量集中的地方。图像传感器采集得到的两幅图像进行融合时,小视场的图像完全参与融合,大视场的图像参与融合以外的部分得到保留。这样既增强了图像的主体特征,又保留了图像的细节信息。

讨论一种简单的加权平均融合方法,融合图像r(x,y)可以表示为

式中:a+b=1,a,b 分别为两幅图像的加权系数。

根据傅里叶变换的加法定理,融合图像的傅里叶变换为

式(8)中,如果aF(u,v)+bG(u,v)是图像中所关心的主体,它表述的是观察目标的总体形状、特征轮廓、对比度特征等低频分量,那么整个融合图像质量就得到了保障。

2 不同视场的多源图像的配准方法

由于多源图像的成像机制不同、光学系统光轴不平行且成像分辨率不同,目标在不同图像中的位置存在差异或畸变,如平移、旋转、比例变化及噪声引起的畸变等。对于不同视场的多源图像,在实际应用中设计了一种基于仿射变换查找表的快速图像配准方法。对应图1,以图像A 为基准,对图像B 进行对正,由红外图像到微光图像选择2 对匹配点,确定图像间对应点的匹配关系,以消除或减小目标的位置差别及噪声引起的畸变。

同一场景的双源图像必然满足仿射变换模型,设仿射变换模型为

式中:R 为旋转矩阵;T 为平移矩阵。一个坐标点经平移、旋转、缩放后的坐标可用仿射变换表示为

式中:(x,y)、(x',y')分别为2 幅图像中对应点的坐标。其中4 个参数(平移像素Δx 和Δy、旋转角θ、行列缩放倍数k)的向量将决定两幅图像坐标之间的转换关系。

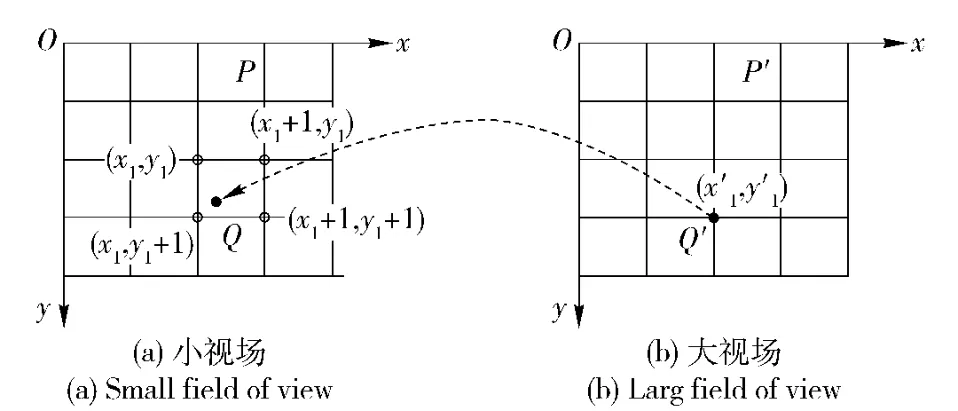

对于同一目标对象的确定信息,由于大视场图像融合区域像素数量小于小视场图像,导致大视场图像待融合区域的每一像素点包含小视场图像相邻至多4 个像素点的信息,因此在小视场图像向大视场图像进行仿射变换的过程中,需要加权平均计算对应的若干小视场图像像素点灰度值,即为双线性数字插值计算,如图2所示。

图2 灰度插值示意图Fig.2 Sketch of gray interpolation

用Q 点周围4 个相邻的网格点灰度值加权内插作为Q 点的灰度值,也就是f(x1,y1)的值。如图2所示,这4 个点值为(x1,y1),(x1+1,y1),(x1,y1+ 1),(x1+1,y1+1),为简单起见,设(x1,y1)=(0,0),则,(x1+1,y1)=(0,1),(x1,y1+1)=(0,1),(x1+1,y1+ 1)=(1,1).Q 点和(0,0)点的距离为x,在y 方向的距离为y,显然Q 点的值为f(x,y).在实际应用中,由于大、小视场的图像系统的光学参数是固定的,Q 点和Q'的位置参数可通过缩放后两幅图像在x、y 方向的相对偏移量求出。

在x 方向作一次线性内插后得

再在y 方向作第2 次线性内插,得到Q 点的值,即

合并后化简得

式中:a、b、c、d 为常数,可见双线性内插实际上是用4 个已知点的双曲抛物面来拟合的。至此,可以得到配准后大视场图像每个像素在待配准小视场图像中对应的4 个点的地址和相应权值。

3 图像融合过程

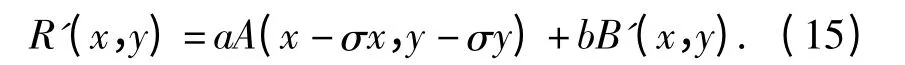

对于一套光轴固定的红外与可见光融合系统,图像系统视场是确定的。在实验系统中采集到的大视场图像是红外图像,可见光图像是小视场,它们的相对位置已经确定,假设可见光图像和红外图像表示为A(x,y)、B(x,y),可见光图像相对于红外图像的偏移量σx 和σy,像素A(σx,σy)匹配的像素点就是由B(0,0),B(0,1),B(1,0),B(1,1)经过插值运算后的结果,如果其结果表示为B'(0,0),在应用加权平均融合算法(权系数分别为a,b)进行融合时,其融合结果R'就可表示为

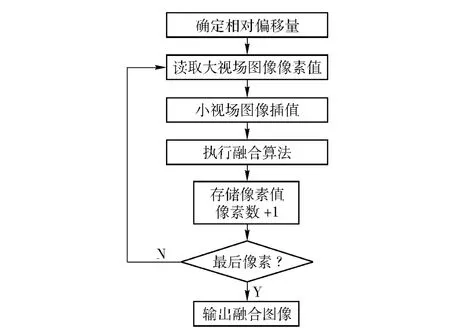

在实际应用中,融合程序流程如图3所示。

图3 融合程序流程图Fig.3 Flowchart of fusion program

4 实验结果分析

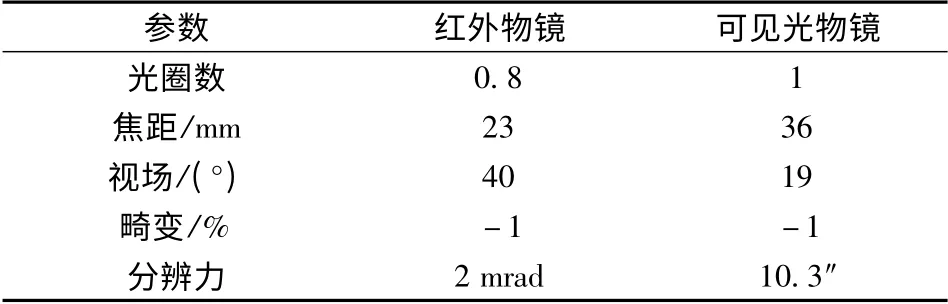

采用的实验系统组成原理如图4所示,表1为红外和可见光物镜的主要技术指标。

图4 系统原理框图Fig.4 Block diagram of system

图像采集系统由可见光CCD(小视场,传感器分辨率1 024 ×768)和长波红外摄像机(大视场,传感器分辨率324 ×256)组成,图像融合处理单元是由基于DSP 芯片TMS320DM642 设计的硬件电路组成。图5、图6是可见光图像与红外图像的融合实验图像,实验地点在南京理工大学实验楼顶,图5中实验目标是远处视场中的建筑和活动的人,图6中实验目标是视场中温度较高的路灯和场地中活动的人,图像采集于2007年7月,地表温度大于40 ℃.实验中融合算法采用的是加权平均(两幅图像权重各为50%).

表1 红外和可见光物镜的主要技术指标Tab.1 Main qualifications of visible light and infrared lens

二维图像进行傅里叶变换的过程如下:先对图像的每一行做一维傅里叶变换,然后对每列做一维傅里叶变换。对于一幅M ×N 的图像来说,先对第0 行的N 个点做傅里叶变换(实部有值,虚部为0),将傅里叶变换输出的实部放回原来第0 行的实部,傅里叶变换输出的虚部放回第0 行的虚部,对行计算结束后用同样的方法进行列方向傅里叶变换,M×N 的图像经过傅里叶变换就得到一个M ×N 的频谱。

对采集得到图像,用MATLAB 进行处理得到相应傅里叶频谱、灰度直方图,图5是一个远目标(大于2 km)图像,场景中目标轮廓明显、细节较少,图5(a)为采集到得红外图像和计算得到的傅里叶频谱、灰度直方图,图5(b)为采集得到可见光图像和计算得到的傅里叶频谱、灰度直方图,图5(c)为融合图像和计算得到的傅里叶频谱、灰度直方图。由于天气温度较高,楼面温度较高,楼顶上的人相对温度较低,红外图像中的人几乎与天空溶为一体不能分辨,由于视场较大,红外图像频谱图中不仅有低频的轮廓信息,也有一些高频的细节信息,灰度直方图峰值明显。可见光图像视场小、包含较多的低频成分,灰度范围宽,可以分辨出目标视场中的人。融合图像具有两幅源图像频谱和灰度直方图特征,峰值有所减少,特别是融合部分更加平滑。傅里叶频谱图上低频、高频信号都有所提高,其主要原因是融合图像的目标轮廓、细节都有所增强。融合图像中楼面的温度特征(红外图像特征)和目标视场中的人都比较容易分辨。

图5 室外远距离可见光红外融合实验图像Fig.5 Outdoor long-distance visible and infrared image fusing

对图5中的实验图像,采用同样的Sobel 算子进行边缘细化处理,图6为处理后的图像,由图6(a)红外图像、图6(b)可见光图像和图6(c)融合图像的边缘细化图像可以很明显地看出,可见光图像缺少温度细节特征,而红外图像中又没有光线明暗产生的细节特征,融合图像中的边缘细节部分综合了两者的特征,图像信息量增加。

图7为近目标(小于500 m)图像,场景中目标散乱、细节较多,图7(a)为采集到得红外图像和计算得到的傅里叶频谱、灰度直方图,图7(b)为采集到得可见光图像和计算得到的傅里叶频谱、灰度直方图,图7(c)为融合图像和计算得到的傅里叶频谱、灰度直方图。由于温度高,屋面和墙面的温度差较大,红外图像中线条、棱角比较多,傅里叶频谱图中反映为放射状线条,一些细节由于对比度较大在频谱图上呈点状分布,由于温度的关系,画面中的人无法分辨,灰度直方图峰值突出。可见光图像中细节较多,能清晰地分辨目标,在傅里叶频谱中高频成分连续性较好,表明图像中目标层次感强,由于图像目标对比度较大,灰度直方图也有一定峰值,比红外图像的灰度直方图相对平滑些。融合图像由部分红外图像和可见光图像融合而成,人和一些温度相对较低的目标也能清晰地分辨,由它们的频谱图可以很明显看出这一点,融合图像灰度直方图也比红外图像灰度直方图要平滑一些。对比图5和图7融合前后的图像,显然,相对于原来的红外图像和可见光图像,大小视场融合图像更易于人们对目标场景的观察、理解。

图6 室外远距离可见光红外融合实验图像Sobel 算子边缘细化图Fig.6 Outdoor long-distance visible and infrared image fusing and edge refinement by using Sobel operator

对图7中的实验图像采用相同的Sobel 算子进行边缘细化处理,也能得到一致的结论,图8为处理后的图像。融合图像信息量得到了加强,只是由于融合图像背景复杂,并不像图6中图像的边缘细节对比那么强烈。

5 图像融合结果评价

相关信息(MI)是来源于信息论的一个指标,它表示一个变量包含另一个变量的信息数量,如果A和B 两个随机变量的边界分布pA(a)和pB(b)、联合概率分布pAB(a,b),相关信息表示2 个随机变量A 和B 相关程度的测量,表达式为

图7 室外近距离可见光红外融合实验图像Fig.7 Indoor short-distance visible and infrared image fusing

融合图像应该包含所有源图像的重要信息,由相关信息的定义不难看出,它非常适合评价融合图像的质量和融合算法的优劣。对于源图像f(x,y),g(x,y),融合图像r(x,y),可以计算出融合图像R包含源图像F,G 信息量。由(16)式可得:

评价一幅融合图像的融合性能指标可以由以下公式算出:

Ramesh 等[3]把MI 称为融合因数(FF),较大的FF 表示从源图像传递到融合图像更多的信息,也在一定程度上说明融合图像质量更好。

融合对称度(FS)用下式表示:

融合对称度越小表示融合性能越好。

图8 室外近距离可见光红外融合实验图像Sobel 算子边缘细化图Fig.8 Outdoor short-distance visible and infrared image fusing and edge refinement by using Sobel operator

在MATLAB 下选择几种测试的融合算法:加权平均融合算法(AVG),离散小波融合算法(DWT)[4],拉普拉斯金字塔融合算法(LAP)[5],平移不变离散小波融合算法(SiDWT)[6],对比度金字塔融合算法(CONTR)[7]。红外图像和融合图像中只有融合的部分参与评价。当源图像都是质量很高的情况下,应该选择FS 较小的融合算法。由表2的数据可以看出融合图像与红外图像的相关性更强。

6 结论

本文对大小视场不同的多源图像的配准方法、融合方法进行探讨、研究。由于视场的不同,在进行配准时也就不同于一般的图像融合,它要先进行大比例缩放,然后才进行常规的配准。为了更好保留图像信息、达到精确配准的目的,采用了双线性插值的方法来保证配准后的图像质量。通过对实验结果时域、空域的分析,最终的融合图像兼具红外和可见光两幅图像的特征,增强了人眼对图像识别能力,达到令人满意的效果。

表2 融合算法评价结果Tab.2 Evaluation results for fusion algorithms

图像传感器技术的应用领域越来越广,不同视场的多源传感器的应用场合也会越来越多,不同特性的不同视场的图像融合结果使人更容易在繁杂的环境中识别目标。不同视场的图像融合技术在未来相当长的时间内会有很好的应用前景,尤其适用于军事、航空航天等实时性要求较高的应用领域[2]。

References)

[1] Pajares G,Cruz J M.A wavelet-based image fusion tutorial[J].Patten Recognition,2004,37(9):1855-1872.

[2] 田思,张俊举,袁轶慧,等.图像融合的开窗处理技术研究[J].兵工学报,2009,30(4):438-441.TIAN Si,ZHANG Jun-ju,YUAN Yi-hui,et al.Research of image fusion technology based on windowing[J].Acta Armamentarii,2009,30(4):438-441.(in Chinese)

[3] Ramesh C,Ranjith T.Fusion performance measures and a lifting wavelet transform based algorithm for image fusion[C]∥Proceedings of the 5th International Conference on Information Fusion.Maryland:International Society and Information Fusion,2002:317-320.

[4] Nikolov S,Hill P R,Bull D R,et al.Wavelets for image fusion[C]∥Petrosian A,Meyer F.Wavelets in Signal and Image Analysis,from Theory to Practice.Dordrecht,Kluwer Academic Publishers,2001:213-244.

[5] Burt P J,Adelson E H.The Laplacian Pyramid as a compact image code[J].IEEE Transaction on Communications,1983,31(4):532-540.

[6] Toet A,Van Ruyven L J,Valeton J M.Merging thermal and visual images by a contrast pyramid[J].Optical Engineering,1989,28(7):789-792.

[7] Rockinger O.Image sequence fusion using a shift invariant wavelet transform[C]∥Proceedings of the International Conference on Image Processing.Washington:IEEE Computer Society,1997:288-291.