用跟踪器报告虚拟声源位置的精度分析与验证*

张承云 谢菠荪

(华南理工大学声学研究所,广东广州510640)

自Wightman等[1]用头相关传输函数(HRTF)进行信号处理并通过耳机重放出虚拟的三维空间声源以来,虚拟听觉技术得到快速发展,现已广泛应用于科学研究、工程技术等领域[2].为满足不同的应用需求,虚拟听觉信号处理发展出了稳态和动态两种方法.虚拟听觉重放的一个重要性能指标是虚拟声源位置(包括方向和距离)的准确度.为验证和评价虚拟听觉重放的性能,常用的方法是通过主观心理声学实验进行虚拟声源定位,包括方向定位和距离定位.定位实验一般采用绝对判断法,即由受试者直接判断出虚拟声源的空间位置.

受试者报告虚拟声源方向的方法有多种,如口头直接报告、在计算机中用鼠标点击二维或三维图形、将跟踪器探头放在球体模型上、鼻子朝向虚拟声源(有动态处理的情况)等[1,3-6].

对于虚拟声源距离,可采用直接口头报告、量值估计、成对比较以及倾听者走到感知到的虚拟声源位置等方法进行判断[7].由于虚拟声源距离指的是虚拟声源到受试者头部中心的距离,所以需要受试者对数据进行估计,实验难度较大.也有的研究只对虚拟声源距离作定性判断,比如头内/头外,或判断虚拟声源落在哪个区域[8-9],这样降低了实验难度,但不能得到定量的实验数据.

上述各种方法在进行虚拟声源定位时,需将虚拟声源方向与距离分开判断,因此虚拟声源定位实验需花费大量的时间和精力,实验难度大.文献[10]中提出了一种用跟踪器直接指向虚拟声源的方法,可大大缩短实验时间,但只能得到虚拟声源方向数据,不报告虚拟声源距离,且文献中没有详细说明该方法的实现流程,也没有对该方法的精度及重复性进行分析.实际上虚拟声源定位的实验误差有两个来源:一是受试者的感知误差,二是虚拟声源定位方法带来的误差.实验前应明确定位方法带来的误差.文中设计了一种采用跟踪器的虚拟声源定位方法,并对实验数据的精度和重复性进行了分析和验证.该方法能同时得到虚拟声源方向和距离的定量数据,使用简便,实验时间短,可用于各种虚拟声源定位实验.

1 用跟踪器报告虚拟声源位置的原理

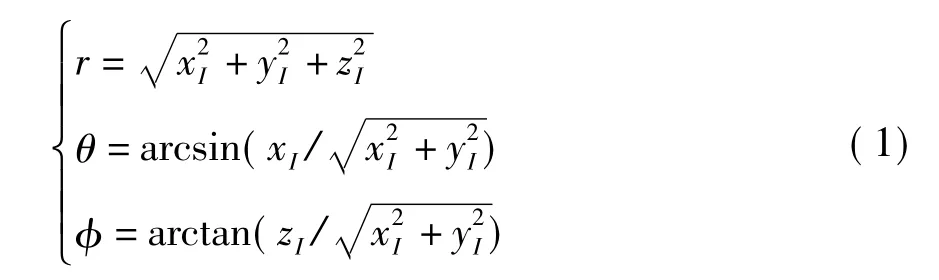

以受试者的头部中心位置为原点建立图1所示的Oxyz坐标系,虚拟声源位置可用直角坐标(x,y,z)或球坐标(r,θ,φ)来表示,其中r为虚拟声源与原点的距离,仰角φ的范围为-90°≤φ≤90°,方位角θ的范围为 0°≤θ<360°,(θ,φ)=(0°,0°)代表水平面正前方向,(90°,0°)代表水平面正右方向,(0°,90°)代表正上方向.若图1中虚拟声源I的直角坐标为(xI,yI,zI),则其球坐标(r,θ,φ)可通过式(1)计算得到:

图1 倾听者头部的坐标系统Fig.1 Coordinate system of listener's head

头部中心位置不易确定,因此(xI,yI,zI)难以直接测量,但可以通过坐标变换的方法来获取.构建如图2所示的系统,其中跟踪器为 Polhemus FASTRAK,包括处理单元、发射器各1个,接收器2个.两个接收器独立工作,均可提供其相对于发射器的平移自由度和转动自由度各3个(精度分别为0.8mm、0.15°),每个接收器的数据刷新率均为60Hz.跟踪器处理单元和声卡都通过通用串行总线(USB)与计算机连接.

图2 测试系统组成框图Fig.2 Block diagram of measurement system

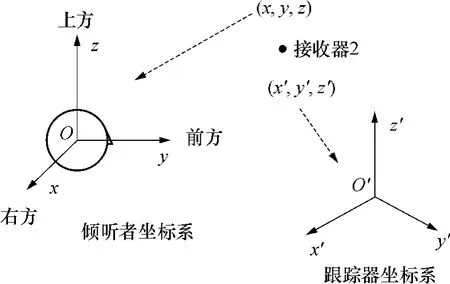

接收器1用于跟踪受试者的头部转动情况,接收器2用于指示虚拟声源所在位置.设跟踪器默认的坐标系用O'x'y'z'来表示,接收器2所在位置的坐标为(x',y',z'),如图 3 所示.

图3 测试系统的两个坐标系Fig.3 Two coordinate systems used in measurement system

将接收器2指到虚拟声源所在位置,则虚拟声源在跟踪器坐标系中的坐标(x'I,y'I,z'I)可由计算机直接读出.受试者头部中心的坐标值则需通过间接的方法测量,如图4所示,用接收器2分别测出左、右耳及鼻子上与头部中心齐高位置的坐标(x'L,y'L,z'L)、(x'R,y'R,z'R)、(x'F,y'F,z'F),则根据左右耳的坐标可以计算出头部中心位置O的坐标(x'O,y'O,z'O)为其中分别代表图1中x、y轴的方向.

图4 坐标校准图Fig.4 Coordinate calibration diagram

由于目前得到的虚拟声源坐标值(x'I,y'I,z'I)是相对于O'x'y'z'坐标系的,因而需通过坐标平移和旋转将其变换到Oxyz坐标系中的(xI,yI,zI).

先考虑坐标平移,虚拟声源的坐标变为:x″I=x'I-x'O,y″I=y'I-y'O,z″I=z'I-z'O.再考虑坐标旋转,设α、β、γ分别为绕z'、x'、y'轴旋转的角度,令x=x'F-x'O,y=y'F-y'O,z=z'F-z'O,z1=z'R-z'O,x1=x'R-x'O,则有利用式(3) -(5)进行坐标旋转,计算出(xI,yI,zI):

其中x*、y*、z*为中间变量.最后由式(1)算出虚拟声源的方位(r,θ,φ).

其实上述方法只适合虚拟听觉的动态处理,由于虚拟声源位置固定不变,实验初始时刻建立的Oxyz坐标系也不用变,因此实验过程中受试者头部转动不会影响测量结果.但对于稳态处理,由于实验时受试者的头部难免会转动,而虚拟声源也会随着一起动,相当于Oxyz坐标系会改变,这时式(3)-(5)需考虑图2中接收器1的旋转自由度的变化量.

2 实现方法和结果验证

2.1 实验方法

通过Visual C++软件实现跟踪器数据的接收与处理,图5为软件流程图.

为方便实验人员监控实验数据,虚拟声源方位(r,θ,φ)实时显示在软件界面上,同时以文件的形式保存到计算机硬盘,方便后续的实验数据处理.保存数据时需调用fflush()函数进行刷新,以免数据丢失.

2.2 结果验证

为验证上述方法的准确性,利用一个半径为0.0875m的刚球来模拟人头,以球心为原点建立坐标系,如图6所示.图6中,x1、y1轴分别为x、y轴在地面上的投影.空间中某点A的坐标用激光测距仪(Leica DISTO A3)测定,测量精度为3mm,则A点的方位(r,θ,φ)可通过其坐标计算得到.然后再用文中方法测量A点的方位(r,θ,φ),并将其与计算结果进行对比,以验证测量结果的准确性.

对于三维空间的虚拟声源,经常采用球统计法对定位实验结果进行分析.用坐标原点指向(θ,φ)方向的单位矢量rS表示虚拟声源方向的理论值,用rI表示其实验值,则平均的感知虚拟声源方向可用N个实验值的矢量之和来表示:

图5 软件流程图Fig.5 Software flow chart

图6 实验验证方案图Fig.6 Diagram of experimental verification scheme

虚拟声源方向的平均角度错误定义为虚拟声源方向的实验值与理论值之间夹角的无符号平均:矢量的长度R=可用于表示感知虚拟声源方向数据离散性,而实际的球统计中大多采用κ-1来表示实验数据的离散性,对于小样本(N<16),近似计算公式为

κ-1越小表示实验数据的离散性越小[1,11].

取15个点进行实验,这些点分布在右半空间上,包括高、中、低仰角,每个点重复测量6次,实验结果见表1,其中测量结果对应的(r,θ,φ)数据指的是6次测量的平均值,它们的标准差分别用σ(r)、σ(θ)、σ(φ)表示.根据激光测距计算的结果只列出了平均值,并将其(θ,φ)作为虚拟声源方向的理论值,用于计算平均角度错误.

表1 实验测量与激光测距得出的结果Table 1 Results of experimental measurement and laser ranging

为分析采用文中方法测量与根据激光测距的坐标进行计算两种方法得到的结果是否有明显差异,对实验数据进行方差分析[12],将显著性水平设为0.05.结果表明,对于距离(r)、水平角(θ)及仰角(φ),两种方法得出的结果均无显著差异,对应的P值分别为0.894、0.966及0.978,说明文中方法准确有效.

3 对比实验

设计一个虚拟声源定位实验,对采用文中跟踪器方法及传统的口头报告法的实验结果进行比较.实验分为稳态与动态信号处理两种情况,受试者共需判断16个声源方向,这些方向均分布在右半球,φ= -30°,0°,30°,60°,每个φ对应的纬度面都取4 个方位角(θ=0°,45°,135°,180°).实验信号为一段20s的管弦乐(J.Strauss,《蓝色多瑙河》),通过耳机(Sennheiser HD250)循环播放,用美国麻省理工学院(MIT)媒体实验室的KEMAR人工头HRTF数据[13]进行信号处理.

实验分为4组:(1)稳态处理,口头报告;(2)动态处理,口头报告;(3)稳态处理,跟踪器报告;(4)动态处理,跟踪器报告.

对每组实验,每个虚拟声源方位受试者需判断3次,共需判断48次,实验中各方向的信号按随机顺序进行播放.实验在一间混响时间为0.15 s、本底噪声不大于30dBA的听音室内进行,受试者坐在听音室中心位置的椅子上.参加实验的受试者共8名,其中声学专业的研究生6名,男女各3名,光电专业本科生2名,男女各1名.

使用文中跟踪器方法进行虚拟声源定位,每位受试者都能较快地完成对虚拟声源方位的判断,实验过程中受试者较为轻松,只需将跟踪器的接收器2放到虚拟声源所在位置;方位参数(r,θ,φ)由计算机处理得到并保存到文件中,实验人员只需监控系统是否正常工作.而采用口头报告时,受试者较紧张,除了需判断虚拟声源在什么位置外,更难的是要将此空间位置的方向和距离估计出来,受试者需花费较大的精力和较长的时间,并且实验人员的工作量也更大,需人工记录实验结果.

表2列出了虚拟声源方向的实验统计结果,表中的数据均为所有方向的平均值,其中每次判断时间指的是判断一次虚拟声源(包括方向和距离)需要的时间.实验结果显示:两种报告虚拟声源的方法对应的虚拟声源混乱率(包括前后、上下)基本相同,显著性水平为0.05的方差分析对应的P值分别为0.894、0.961;而采用跟踪器报告方法对应的角度错误及实验数据离散性均稍小一些,但并不显著(显著性水平为0.05的方差分析对应的P值分别为0.752、0.578),对于平均每次判断的时间则明显低于采用口头报告的方法.

由表3可见,对于虚拟声源距离,两种报告方法所得数据有明显差别,采用口头报告时数据离散性大,表明采用跟踪器方法报告虚拟声源距离的结果一致性更好.由于动态与稳态处理的情况有类似的特性,因此表3只列出了动态处理的实验结果,其中设定的虚拟声源方向用(θ,φ)表示.

表2 虚拟声源方向实验数据统计结果Table 2 Statistical results of the experimental data of virtual sound source direction

表3 虚拟声源距离实验数据统计结果Table 3 Statistical results of the experiment data of virtual sound source distance

4 结语

文中设计的跟踪器方法只需受试者将跟踪器的接收器指到虚拟声源位置,计算机即可实时显示其方向和距离,同时将数据保存到文件中.经验证文中提出的方法重复性好,虚拟声源方位(r,θ,φ)数据对应的标准差最大值分别为0.4 cm、0.6°、0.5°,方差分析表明测量结果准确有效.与口头报告法相比,采用文中提出的方法大大缩短了实验花费的时间,每次判断虚拟声源位置的时间由19.8 s降至7.2 s(稳态与动态处理的平均结果),降低了实验难度.

[1]Wightman F L,Kistler D J.Headphone simulation of freefield listening,II:psycho-physical validation [J].Journal of the Acoustical Society of America,1989,85(2):868-878.

[2]谢菠荪.头相关传输函数与虚拟听觉[M].北京:国防工业出版社,2008:313-324.

[3]石蓓,谢菠荪.虚拟听觉重放与听觉声源宽度的扩展[J].华南理工大学学报:自然科学版,2009,38(3):148-155.Shi Bei,Xie Bo-sun.Virtual auditory replay and broadening of auditory source width [J].Journal of South China University of Technology:Natural Science Edition,2009,38(3):148-155.

[4]Bronkhorst A W.Localization of real and virtual sound sources[J].Journal of the Acoustical Society of America,1995,98(5):2542-2553.

[5]Wenzel.Effect of increasing system latency on localization of virtual sounds with short and long duration[C]∥Proceedings of the 2001 International Conference on Auditory Display.Espoo:ICAD,2001:185-190.

[6]Djelani T,Pörschmann C,Sahrhage J,et al.An interactive virtual-environment generator for psychoacoustic research II:collection of head related impulse responses and evaluation of auditory localization [J].Acta Acustica,2000,86(6):1046-1053.

[7]Zahorik P.Auditory display of sound source distance[C]∥Proceedings of the 2002 International Conference on Auditory Display.Kyoto:ICAD,2002:1-7.

[8]Kim S M,Choi W.On the externalization of virtual sound images in headphone reproduction:a Wiener filter approach [J].Journal of the Acoustical Society of America,2005,117(6):3657-3665.

[9]Begault D R,Wenzel E M,Anderson M R.Direct comparison of the impact of head tracking,reverberation,and individualized head-related transfer functions on the spatial perception of a virtual speech source[J].Journal of the Audio Engineering Society,2001,49(10):904-916.

[10]Pernaux J M,Emerit M,Nicol R.Perceptual evaluation of binaural sound synthesis:the problem of reporting localization judgments[C]∥114th Convention.Amsterdam:AES,2003.

[11]Fisher N I,Lewis T,Embleton B J J.Statistical analysis

of spherical data[M].Cambridge:Cambridge University Press,1993:86-94.

[12]谭荣波,梅晓仁.SPSS统计分析实用教程[M].北京:科学出版社,2007:92-98.

[13]Gardner W G,Martin K D.HRTF measurements of a KEMAR [J].Journal of the Acoustical Society of America,1995,97(6):3907-3908.