融合注意力机制与改进ResNet50的服装图像属性预测方法

摘 要: 为了解决人工标注服装图像属性效率低下的问题,提出了一种融合注意力机制与改进ResNet50的服装图像属性预测方法。首先对传统多标签分类方法中的模型进行了改进,改进后的方法能更充分利用任务之间的相关性,并减少数据稀缺问题带来的影响;接着引入CBAM注意力机制,用于捕捉服装属性上的细节特征。结果表明:在未引入注意力机制的情况下,基于改进ResNet50的方法在多项评价指标上均优于传统多标签分类方法,准确率提高了25.96%;与ResNet34、EfficientNet_V2、VGG16模型相比,ResNet50模型在服装图像属性预测方面整体表现更佳;引入CBAM注意力机制后,基于改进ResNet50的方法的准确率再提高了1.72%。所提的融合注意力机制与改进ResNet50的服装图像属性预测方法,能够有效预测服装图像属性,为实现服装图像属性的自动化标注提供了新的思路。

关键词: 服装图像;属性预测;注意力机制;ResNet50;深度学习

中图分类号:" TP391.41;TS102.3""" 文献标志码:" A""" 文章编号: 1009-265X(2025)01-0058-07

近年来, 随着在线购物的普及,互联网上涌现了大量的服装图像。如何从这些海量的服装图像中自动提取关键信息成为当前研究的热点[1]。通过分析和识别这些服装图像的相关属性,并结合价格、销量、用户评论等信息,可以进一步实现智能推荐和趋势预测。这不仅可以帮助商家提前把握市场需求,制定更精准的营销策略和商业决策,还可为设计师提供了宝贵的创意灵感[2]。然而,对大量服装图像进行属性标注,对在线服装销售商而言是一项繁琐且成本高昂的任务。因此,开展服装图像属性的分类预测研究具有重要的实际意义和应用价值。

服装图像属性预测本质上属于计算机视觉领域的图像分类问题。在早期的研究中,服装图像属性分类主要依赖人工提取特征[3-4]。然而,这些方法在处理细粒度的服装图像时存在局限性,其分类结果受光照、扭曲等因素的影响较大。随着人工智能技术的广泛应用,尤其是深度学习技术的快速进步,越来越多研究表明,基于深度学习分类算法能够显著提高服装属性预测的准确性。孙秀秀[5]和刘和娟[6]对现有的深度学习模型进行改进,采用Sigmoid激活函数和二元交叉熵损失函数,实现服装属性的多标签分类。然而,这些方法在进行多标签分类时,未能解决服装属性标签之间的强相关性问题[7],这限制了预测性能的提升。雷冬冬等[8]在DFA算法基础上引入了循环十字交叉注意力和高效通道注意力,从而实现服装关键点定位及属性预测算法。然而,由于评价指标中未考虑top-1的分类准确率和召回率,因此预测效果难以确定。Ferreira等[9]基于深度学习模型, 研究了服装目录及属性的多任务分类方法。该方法测试结果显示平均准确率为59.41%, 表明其分类精度仍有待提升。Shajini等[10]提出了结合知识共享和基于深度学习的T-S对模型的方法, 该方法属于一种半监督多任务学习方法,其top-3" 平均准确率可达91.99%,但在属性预测方面的top-3 平均准确率只有51.89%。综上所述,服装图像属性预测的研究需进一步深入探讨和改进。

为提升服装图像属性预测精度,并解决人工标记服装图像属性效率低的问题,本文提出一种融合注意力机制与改进ResNet50的服装图像属性预测方法。该方法对ResNet50模型的网络结构进行改进,以适应服装多属性预测任务,同时在改进后的ResNet50模型中引入注意力机制,用于捕捉服装属性上的细节特征,以期提高预测精度。

1 研究方法

1.1 实验数据集

DeepFashion数据集已被广泛用于计算机视觉研究,包括目录与属性预测、店内服装检索、消费者到商店的服装检索和关键点检测共4项任务。该数据集包含大量时尚图像及相关标注信息,可用于模型的训练、验证和测试。本文选取了“目录与属性预测”任务中的高质量图像和标注数据,共计2万张图像,其中包括14000张训练数据,2000张验证数据和4000张测试数据。数据集中的部分图像如图1所示。从图1中可以看出,图像来源广泛,包括专业拍摄的模特图像和野外拍摄的生活图像,这些图像构成了一个跨域图像集合。

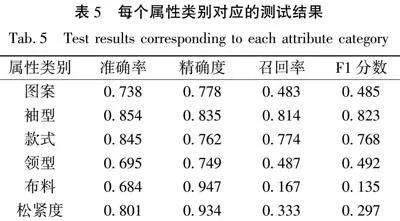

此外, 本文数据集包含服装对应的6个属性类别,分别是图案、袖型、款式、领型、布料和松紧度。表1中列出了数据集各属性类别及其相应的取值。

1.2 传统基于ResNet50的多标签分类方法

ResNet50是一种深度卷积神经网络,被广泛应用于各种计算机视觉任务,特别是在图像分类、目标检测和语义分割等领域表现出色。ResNet50模型主要由多个残差块组成,每个残差块内部包含多个卷积层。与传统的卷积神经网络不同,ResNet50在每个残差块中引入了跳跃连接,即将输入直接添加到输出,从而构成了残差学习的结构。这种结构有助于缓解深层网络训练过程中的梯度消失和梯度爆炸问题[11],使其适用于训练更深的网络。

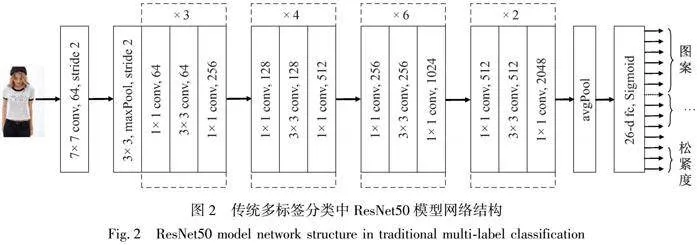

服装属性预测通常被视为多标签分类任务。为了实现对服装多个属性的预测,一种常见的方法是将ResNet50模型最后一层的Softmax激活函数替换为Sigmoid激活函数[5-6]。这种替换使得每个属性的输出为0到1之间的单个概率值,每个属性的值都对应一个独立的概率值。然后,从每组属性输出值中选择最大的概率值作为属性预测的结果。例如,对于松紧度属性,若输出值为{0.6,0.5,0.4},分别对应紧、松和常规,那么松紧度的预测结果就是“紧”。具体的网络结构如图2所示。

1.3 CBAM注意力机制

CBAM注意力机制是一种用于增强卷积神经网络性能的机制,通过通道和空间注意力模块来提取和利用重要的特征信息。其结构如图3所示,其中通道注意力模块关注每个通道的重要性,而空间注意力模块则关注不同位置的重要性,从而使网络能够有选择地增强或抑制不同通道和位置的特征响应。CBAM模块可以嵌入到常见的卷积神经网络架构中,能够显著提升网络性能[12]。

1.4"" 融合CBAM注意力机制与改进ResNet50 的分类方法

图像多任务分类是将图像分类任务视为一个多任务学习问题,同时预测图像的多个相关但不同的属性或类别。其优点是可利用任务之间的相关性来提高模型的泛化能力,同时可以减少数据稀缺问题,"从而提高模型的训练效率[13]。为了解决服装图像属性预测的多标签多任务分类问题,本文提出了一种融合CBAM注意力机制与改进ResNet50的分类"" 方法。图4展示了该方法的网络结构。由图4可知,该方法共享了特征提取部分网络和参数,同时各任务拥有独立的分类层,属于一种多任务学习方法。具体改进之处主要包括:

a)特征提取部分:在图2网络结构的基础上,在最后一个卷积层后面引入了CBAM注意力机制。

b)输出部分:在图2网络结构中,只有一个单一的全连接输出,激活函数采用采用Sigmoid;而本文方法采用多个独立的全连接层输出,每个类别标签对应一个分类部分,激活函数采用Softmax。

2 实验和结果分析

2.1 实验环境

后续实验的软硬环境包括:

a)硬件环境:CPU为Intel(R) Core(TM) i7-9700 CPU@3.00 GHz 3.00 GHz、内存16 GB、固态硬盘,未使用GPU。

b) 软件环境:Python 3.10.1语言、PyTorch 2.0.0 框架、VS Code 1.70.0编辑器。

2.2 评价指标

由于本文方法用于解决多标签问题,涉及多个属性的预测,因此评价方法不仅要考虑模型整体性能的评估,还需对每个类别进行评估。为了评估模型整体性能以及每个类别的表现,本文采用了准确率、精确度、召回率和F1分数这4个指标。各指标说明如下:

准确率:表示模型正确分类的样本数量与总样本数量之比。计算公式为:

VAcc= VTP+VTN VTP+VFN+VFP+VTN" (1)

式中:VTP表示真正为正类别且被模型预测为正类别的样本数量,VFP表示实际为负类别但被模型错误预测为正类别的样本数量,VFN表示实际为正类别但被模型错误预测为负类别的样本数量,VTN表示实际为负类别且但被模型正确预测为负类别的样本数量。

在本文中,每张测试图像都包含6个属性类别,而每个类别又是一个样本,因此,总样本数为测试图像数量的6倍。

精确度:又被称为查准率,表示模型预测为正类别且真正为正类别的样本数量与所有预测为正类别的样本数量之比。计算公式为:

VP= VTP VTP+VFP" (2)

召回率:也被称为查全率,表示模型预测为正类别且真正为正类别的样本数量与所有真正为正类别的样本数量之比。计算公式为:

VR= VTP VTP+VFN" (3)

F1分数(F1-score):综合考虑模型的准确性和召回率。计算公式为:

VF1-score=(1+β2) (VP×VR) β2×VP+VR" (4)

式中:β的取值为1。

2.3 训练过程及结果分析

为了验证方法的有效性,本文对3种模型分别进行训练:a) 模型1对应于前文1.2中所使用的传统多标签分类方法的模型;b) 模型2对应于前文1.3中本文提出的方法的模型;c) 模型3则是在模型2的基础上去除了CBAM注意机制的模型。

在模型训练前,训练程序设置了如下的训练参数:学习率为0.0005、批次大小为16、线程数量为8、总的迭代次数为50次。此外,还选择交叉熵损失函数来计算损失值,并采用Adam优化器函数来优化模型的参数。

训练过程中,程序交替进行训练和验证。在训练阶段,程序循环处理每个批次,包括梯度清零、前向传播、损失计算以及反向传播和参数优化等步骤。而在验证阶段,程序将模型设置为评估模式,执行前向传播并计算损失。在每完成一个批次后,程序都会检查准确率是否达到最佳水平。若是,则保存当前模型参数,并将其视为最优模型;否则,不做任何操作。

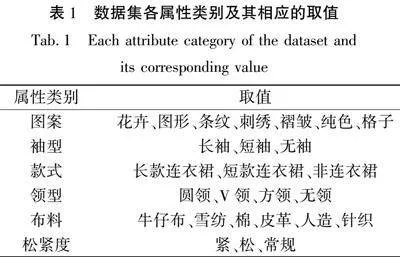

训练完成后,得到了如图5所示的各模型对应的准确率及损失率变化情况。由图5可知,模型2和模型3在训练过程中的准确率和损失率明显优于模型1,这表明改进后的ResNet50模型训练效果更好。此外,引入CBAM注意机制后,模型训练过程中的准确率得到了进一步的提高,而损失率无明显变化。

2.4 模型测试结果与分析

为了评估本文方法模型的整体性能,设计了3种测试方案:

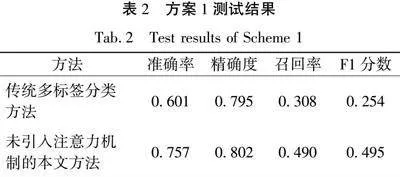

方案1:将前文1.2中的传统基于ResNet50的多标签分类方法与同样未引入注意力机制的改进ResNet50方法进行测试,并比较它们的性能。

方案2:在不引入不同注意力机制的情况下,针对本文提出的方法,在不同深度学习模型上继续训练,并评价各模型的属性预测效果。除了使用ResNet50模型,本文还选择了ResNet34、EfficientNet_V2[14]、 VGG16[15]这3个模型。

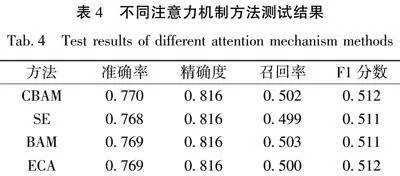

方案3:引入不同的注意力机制方法,对方法进行对比测试。本文选取的注意力机制方法包括CBAM、SE[16]、BAM[17]及ECA[18]4种。

2.4.1 方案1测试结果与分析

为了验证改进模型在服装图像属性预测上的有效性,方案1对前文1.2中的传统多标签分类方法和前文1.3中的本文方法进行了对比测试。由于 传统方法未引入注意力机制,因此这里的基于改进的ResNet50的方法也未引入注意力机制,且模型均选择ResNet50模型。测试的结果见表2。由表2可知,未引入注意力机制的基于改进的ResNet50模型的方法在准确率、精确度以及召回率等各项指标均优于传统多标签分类方法,其中准确率提高了25.96%。

2.4.2 方案2测试结果与分析

除了方案1中使用的ResNet50模型外,方案2还与ResNet34、EfficientNet_V2和VGG16多种深度学习模型进行了对比。需要注意的是,方案2同样未引入注意力机制,具体的测试结果见表3。由表3可知,ResNet50模型在准确率、精确度、召回率以及F1分数指标上均表现更佳。

2.4.3 方案3测试结果与分析

注意力机制方法众多,本文选用了几种常见的注意力机制方法,具体包括CBAM、SE、BAM、ECA方法。通过分别引入不同的注意力机制,完成对本文方法的测试,其结果见表4。由表4可知,CBAM方法在准确率、精确度、召回率以及F1分数各项指标上整体表现更佳。与表3中未引入CBAM注意力机制的本文方法相比,引入了CBAM注意力机制的基于改进ResNet50的方法在准确率上提高了1.72%。

2.5 服装类别测试结果与分析

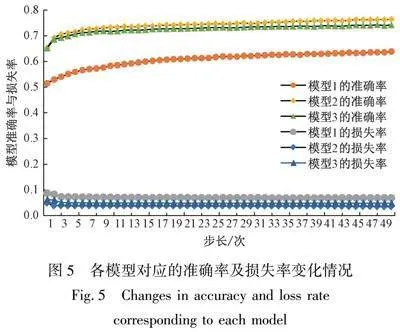

采用本文提出方法对服装图像的每个类别进行测试,测试结果见表5。由表5可知,对袖型进行预测的准确率最高,达到了0.854,而布料预测的准确率最低,仅为0.684。需要注意的是,尽管布料和松紧度在精确度上表现较好,分别是0.947和0.934,但召回率只有0.167和0.333。产生精确度高、召回率低的主要原因是属性类别之间的数量极度不平衡导致的。例如,松紧度3种属性值(紧、松、常规)所对应的样本数分别为2001、758和11241。这种不平衡导致模型无法有效捕捉到少数类别样本的特征。针对上述问题,可采用生成部分合成样本、类别加权或者集成学习等方法,以提高布料和松紧度的预测精度。

2.6 方法可视化设计

为了让用户可以直观地了解本文方法在服装属性预测方面的表现,本文采用flask框架开发了一套基于Web的服装属性预测应用程序。该应用程序能够接收用户上传的服装图像,并对测试集中图像的服装属性进行预测。软件的运行界面如图6所示。用户上传图像后,点击“开始预测”按钮,应用程序会自动调用前面训练好的模型进行属性预测,并将真实结果和预测结果展示在界面上。根据图6中的预测结果,用户可以清楚地看到图像中服装的各种属性,包括图案、袖型、款式、领型、布料和松紧度。其中,图6(a)中的6个属性全部预测正确;图6(b)中图案和领型预测错误,标记的图案为花卉,预测为纯色,实际上是上身为纯色、裤子为花卉,说明数据集标定并不十分准确,此外,衣领也预测错误,将无领预测成为圆领;图6(c)中领型和布料预测错误,裤子标记为白色牛仔裤,但由于这类牛仔裤在样本集中偏少,导致模型对该类别训练不足,从而出现识别错误。同样,这里的领型预测也出现了错误。

3 结论

本文提出了一种融合注意力机制与改进ResNet50 的服装图像属性预测方法。该方法首先通过对传统多标签分类方法中的模型进行改进,充分利用了任务之间的相关性来提高模型的泛化能力,同时解决了部分样本数据稀缺问题;其次,引入CBAM注意力机制,增强了模型的表征能力,进而提升了模型的预测性能。主要得出以下结论:

a)在未引入注意力机制的情况下,基于改进ResNet50的方法在准确率、精确度、召回率以及 F1 分数等各项指标均优于传统的多标签分类方法,其中准确率提高了25.96%。

b)在未引入注意力机制的情况下,相较于ResNet34、EfficientNet_V2、VGG16模型,ResNet50模型在准确率、精确度、召回率以及F1分数各项指标上表现均更佳。

c)与未引入CBAM注意力机制的方法相比,引入CBAM注意力机制的基于改进ResNet50的方法在准确率上提高了1.72%。

d)在对各个属性类别的预测中,图案、袖型和款式表现较好,而领型的准确率仅为0.684,表现不佳。此外,布料和松紧度出现了精确度高而召回率低的情况。

综上所示,融合了注意力机制与改进ResNet50的服装图像属性预测方法能够有效提升服装图像属性预测精度,为实现服装图像属性的自动化标注提供了新的思路。在未来的研究中,可以构建更高质量的数据集进行训练,也可以选择对某些服装属性类别进行单独研究,以提高模型的预测精度。

参考文献:

[1] 李圆,于淼.基于深度学习图像处理的服装推荐研究进展[J].毛纺科技,2023,51(12):119-126.

LI Yuan, YU Miao. Research progress of clothing recommendation based on deep learning image processing[J]. Wool Textile Journal, 2023, 51(12):119-126.

[2] 王静,王小艺,兰翠芹, 等.服装个性化定制中信息技术的应用与展望[J].丝绸,2024, 61(1):96-108.

WANG Jing, WANG Xiaoyi, LAN Cuiqin, et al.Application and prospect of information technology in personalized clothing customization[J]. Journal of Silk, 2024, 61(1): 96-108.

[3] 刘聪,丁贵广.基于视觉的服装属性分类算法[J].微电子学与计算机,2016,33(1):28-33.

LIU Cong, DING Guiguang.Visual-based clothing attribute classification algorithm[J]. Microelectronics amp; Computer,2016, 33(1):28-33.

[4] CHEN H, GALLAGHER A, GIROD B. Describing Clothing by Semantic Attributes[C]//European Conference on Computer Vision. Berlin, Heidelberg: Springer, 2012: 609-623.

[5] 孙秀秀. 基于深度学习的多标签服装图像分类研究[D]. 北京: 华北电力大学, 2020: 24-26.

SUN Xiuxiu. Research on Multi-Label Clothing Image Classification Based on Deep Learning[D]. Beijing: North China Electric Power University, 2020: 24-26.

[6] 刘和娟. 基于深度学习的姐妹装图像检索技术研究[D]. 昆明: 云南大学,2019:23-34.

LIU Hejuan. Research on Sister Outfit Image Retrieval Technology Based on Deep Learning[D]. Kunming: Yunnan University,2019:23-34.

[7] 杨小童,陈月明,杨坤.融合多标签特征在心电异常事件分类上的应用[J].计算机仿真,2022,39(8):508-513.

YANG Xiaotong, CHEN Yueming, YANG Kun. Applica-tion of multi-label features fusion in ECG anomaly classifi-cation[J]. Computer Simulation, 2022, 39(8): 508-513.

[8] 雷冬冬,王俊英,董方敏, 等.基于混合域注意力机制的服装关键点定位及属性预测算法[J]. 东华大学学报(自然科学版),2022,48(4):28-35.

LEI Dongdong, WANG Junying, DONG Fangmin,et al. Clothing key points location and attribute prediction algorithm based on mixed domain attention mechanism[J]. Journal of Donghua University(Natural Science),2022,48(4):28-35.

[9] FERREIRA B Q, BAA L, FARIA J, et al. A unified model with structured output for fashion images classifi-cation[EB/OL]. 2018: 1806.09445.http://arxiv.org/abs/1806.09445v1.

[10] SHAJINI M, RAMANAN A. A knowledge-sharing semi-supervised approach for fashion clothes classification and attribute prediction[J]. The Visual Computer, 2022, 38(11): 3551-3561.

[11] 曹涵颖,妥吉英.基于改进YOLOv5和ResNet50的女装袖型识别方法[J].现代纺织技术,2024,32(1): 45-53.

CAO Hanying, TUO Jiying. A method for identifying" women '" s sleeves based on improved YOLOv5 and ResNet50 [J]. Advanced Textile Technology,2024,32(1): 45-53.

[12] WOO S, PARK J, LEE J Y, et al. CBAM: Convolutional Block Attention Module[C]//European Conference on Computer Vision. Cham: Springer, 2018: 3-19.

[13] 张钰,刘建伟,左信.多任务学习[J].计算机学报,2020,43(7):1340-1378.

ZHANG Yu, LIU Jianwei, ZUO Xin. Survey of multi-task learning[J]. Chinese Journal of Computers, 2020, 43(7): 1340-1378.

[14] TAN M, LE Q V. EfficientNet: Rethinking Model Scaling for Convolutional Neural Networks[C]// 36th Interna-tional Con-ference on Machine Learning (ICML). Los Angeles: Proceedings of Machine Learning Research, 2019:6105-6114.

[15] SIMONYAN K, ZISSERMAN A.Very deep convolutional networks for large-scale image recognition[J]. 3rd Inter-national Conference on Learning Representations, ICLR 2015-Conference Track Proceedings, 2015:1-14.

[16] HU J, SHEN L, ALBANIE S, et al. Squeeze-and-excitation networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2020, 42(8): 2011-2023.

[17] PARK J, WOO S, LEE J Y, et al. BAM:bottleneck attention module[EB/OL]. (2018-07-18)[2024-04-30]. https://arxiv.org/pdf/1807.06514.

[18] WANG Q, WU B, ZHU P, et al. ECA-Net: Efficient Channel Attention for Deep Convolutional" Neural Networks[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Seattle, WA, USA. IEEE, 2020: 11531-11539.

A clothing image attribute prediction method integrating attention mechanism and improved ResNet50

YOU" Xiaorong1a,2," LI" Shufang1b," SHAO" Hongyan1a,2

(1a.School of Intelligent Manufacturing; 1b. School of Intelligent Textiles and Materials, Changzhou VocationalInstitute of Textile and Garment, Changzhou 213164, China; 2.Jiangsu Research Center of Intelligent Manufacturing Technology for Carbon Fiber and Advanced Material, Changzhou 213164, China)

Abstract:

In recent years, with the popularity of online shopping, a large number of clothing images have emerged on the Internet. How to automatically extract key information from these massive clothing images has become a hot topic in current research. Through analyzing and identifying the relevant attributes of these clothing images and combining them with information such as price, sales volume and user comments, intelligent recommendations and trend predictions can be further achieved. This not only helps merchants grasp market demand in advance and formulate more accurate marketing strategies and business decisions but also provides designers with valuable creative inspiration. However, labeling the attributes of a large number of clothing images is also a tedious and costly task for online clothing sellers. Therefore, researching the classification and prediction of clothing image attributes has important practical significance and application value.

To improve the prediction accuracy of clothing image attributes and to address the inefficiency of manual labeling of clothing image attributes, this paper proposes a clothing image attribute prediction method integrating the attention mechanism and improved ResNet50. This method improves the network structure of the ResNet50 model to adapt to the clothing multi-attribute prediction task and introduces the attention mechanism into the improved ResNet50 model to capture the detailed features of clothing attributes to improve the prediction accuracy. The method not only applies the improved deep learning algorithm to clothing attribute prediction, but also verifies the effectiveness of the method in clothing attribute prediction. It can effectively improve the accuracy of clothing image attribute prediction and identify attribute categories with superior prediction outcomes, providing new ideas for realizing the automatic labeling of clothing image attributes. The experimental results show that in the absence of the attention mechanism, the method based on the improved ResNet50 outperforms the traditional multi-label classification method in terms of accuracy, precision, recall, and F1 score, with the accuracy increasing by 25.96%. On the whole, the ResNet50 model performs better than the ResNet34, EfficientNet_V2, and VGG16 models in terms of accuracy, precision, recall, and F1 score. Compared with the method without the introduction of the CBAM attention mechanism, the ResNet50 method enhanced with CBAM improves the accuracy by 1.72%. In the prediction of each attribute category, the pattern, sleeve type, and style performed well, while the accuracy of the collar type is only 0.684, which is not good. In addition, the fabric and tightness show high accuracy but low recall. In future research, higher quality datasets can be built for training, and certain clothing attribute categories can also be studied separately to improve the prediction accuracy of the model.

Keywords:

clothing images; attribute prediction; attention mechanism; ResNet50; deep learning

基金项目: 常州纺织服装职业技术学院2023年院学术科研基金项目(应用技术类)(CFK202316)

作者简介: 游小荣(1981— ),男,江西临川人,副教授,硕士,主要从事纺织服装智能化和人工智能应用方面的研究