行道树靶标点云在线分割方法

摘要:【目的】针对行道树对靶施药技术中的靶标实时在线分割需求,研究基于移动激光扫描(mobile laser scanning,MLS)的行道树靶标点云在线实时分割方法,建立能够实时在线准确分割行道树靶标点云的点云实例分割算法。【方法】本研究以300 m长街道一侧的行道树为研究对象,通过建立FIFO(first input first output)缓冲区,每隔一段时间读取MLS采集到的三维街道点云数据中的若干帧街道点云数据。将读取过后FIFO缓冲区中的街道点云数据转换为三通道街道图像,使用图像实例分割模型对街道图像进行分割,得到行道树候选实例。然后,对行道树候选实例与已检测到的行道树实例进行实例融合,对已检测到的行道树实例进行完整性检测,对检测完整的行道树实例执行图像-点云映射,得到行道树点云实例。最后,使用阈值滤波与K最近邻(K-nearest neighbor,KNN)两种方法在点云层面对行道树点云实例进行优化。【结果】在阈值滤波参数设置为0.65 m、KNN的半径参数设置为0.5 m时,行道树靶标点云实例分割结果最优,准确率为0.986 5,召回率为0.940 7,F1分数为0.957 6,平均每帧分割时间为5.261 ms。【结论】本研究提出的行道树靶标点云在线分割方法有效,可以满足行道树靶标实时在线分割的要求。

关键词:行道树靶标喷雾;行道树在线分割;实例分割;K近邻;二维激光雷达(LiDAR)

中图分类号:S758;TP391"""""" 文献标志码:A开放科学(资源服务)标识码(OSID):

文章编号:1000-2006(2024)04-0141-09

Online segmentation method of target point cloud in roadside tree

YAN Yu,LI Qiujie*

(College of Mechanical and Electronic Engineering, Nanjing Forestry University, Nanjing 210037,China)

Abstract: 【Objective】 Aiming at" meeting the needs of real-time online segmentation of target in the target application technology of street trees, an online real-time segmentation method of street tree target point cloud based on mobile laser scanning (MLS) was studied, and a point cloud instance segmentation algorithm that can accurately segment the target point cloud of street trees in real time and online was established. 【Method】 A street tree on one side of a 300 m long street was used as the research object. By establishing a FIFO (first input, first output) buffer, several frames of three-dimensional street point cloud data collected by MLS were read at regular intervals. The street point cloud data in the FIFO buffer after reading was converted into a three-channel street image, and the street image was segmented by image instance segmentation model to obtain street tree candidate instances. Subsequently, the street tree candidate instances were fused with the detected street tree instances, the integrity of the detected street tree instances was determined, and image-point cloud mapping was performed on the detected complete street tree instances to obtain the street tree point cloud instances. Finally, threshold filtering and K-nearest neighbor (KNN) were used to optimize the point cloud instances of street trees facing point clouds. 【Result】 When the threshold filter parameter was set to 0.65 m and the radius parameter of KNN was set to 0.5 m, the segmentation results of the street tree target point cloud instance were optimal, with an accuracy rate of 0.986 5, a recall rate of 0.940 7, an F1 score of 0.957 6, and an average segmentation time of each frame of 5.261 ms. 【Conclusion】 The online segmentation method of street tree target cloud proposed in this study is effective and meets the requirements of real-time online segmentation of street tree targets.

Keywords:targeted spraying of roadside tree; online segmentation of roadside trees; instance segmentation; K-nearest neighbor; light detection and ranging(LiDAR)

行道树是城市生态系统的重要组成部分,具有缓解温室效应、遮阴降噪、提升城市美观性等重要作用,是城市绿化建设的重点对象[1-2]。近年来随着病虫害的加剧,行道树的养护治理成为了城市绿化建设中的重点问题,在行道树的养护治理手段中,对行道树进行农药喷洒是常规的手段之一,但若采取人工喷洒的方式[3],农药的用量难以把握,易导致大量的农药挥发到空气中,对城市的生态环境造成影响[4]。针对人工施药存在的问题,有学者提出了靶向施药的概念,即通过传感器获取城市街道数据,通过计算确定街道中行道树靶标的空间信息,依据行道树靶标的空间信息对行道树靶标进行精准施药,可以有效解决人工施药存在的问题[5-7]。

对靶施药技术采用的众多传感器中,二维激光雷达(light detection and ranging,LiDAR)通过激光测距可以快速获取周边环境的信息[8-10],采集到的点云数据不仅具有高分辨率、高精度等优点,而且可以通过第1回波和第2回波测量的总网格面积来估计单个树冠的叶总面积[11],为行道树靶标施药提供有力数据支持,因此在对靶施药中得到了广泛的应用[12-14]。

在点云中确定行道树靶标的空间信息,需要对行道树进行实例分割。在点云实例分割的方法中,基于超体素的方法,将空间划分为三维体素,对体素进行超体素分割,在超体素的基础上滤除非行道树点,最后对剩余的超体素进行聚类实现行道树实例分割[15-17]。基于深度学习的一类方法是将原始点云直接作为输入,自动挖掘点云数据的深层特征,最后输出点云的实例分割模型[18-21]。上面这两类方法虽分割精度较高,但时间/空间复杂度都较高。基于深度学习的另一类时间/空间复杂度较低的方法是将点云无损转换为二维图像,在图像实例分割的基础上建立点云实例分割模型[22-23]。已有研究提出的方法将二维LiDAR采集到的点云数据无损转换为三通道图像,然后使用图像实例分割算法训练行道树靶标图像实例分割模型,此方法虽实现了行道树靶标的快速准确分割,但离线处理点云数据不能实现行道树靶标在线分割[23]。

将二维LiDAR用于行道树对靶施药,LiDAR与施药装置装载在同一移动设备上,通过分析LiDAR实时采集到的点云数据来确定行道树的信息从而实现靶向施药。这就要求对当前采集到的数据进行实时在线处理,才能对行道树进行精准施药。移动激光扫描(mobile laser scanning,MLS)前后采集到的点云数据是一段连续的场景,若是单独对当前采集到的点云数据进行处理难以取得好的效果,需要将当前采集到的点云数据与之前采集到的点云数据联合构成一段连续的街道点云数据进行处理。FIFO(first input first output)缓冲区是一种先进先出的数据缓存器[24],先进入的数据先从FIFO缓存器中读出,可以用于存储MLS前后采集到的一小段街道的点云数据。针对上述问题,本研究在文献[23]的基础上,研究了基于MLS的行道树靶标点云在线分割算法,提出了行道树靶标点云的在线分割框架,同时,对行道树点云实例在点云层面进行了优化,提升了点云行道树实例分割的精度,满足行道树靶标点云的在线分割的需求。

1 材料与方法

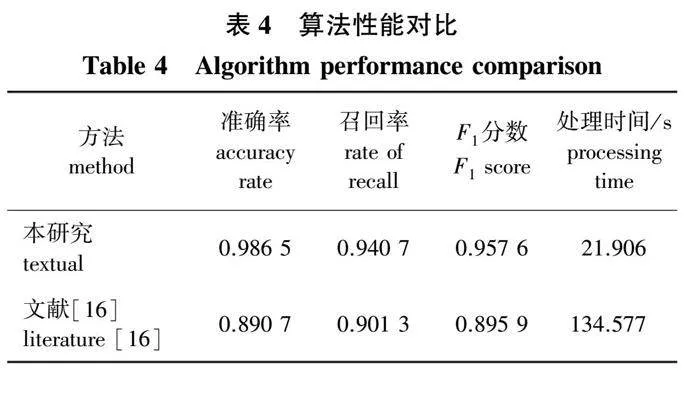

本研究方法包括缓冲区更新、点云-图像映射、行道树图像实例分割、行道树图像实例融合、图像-点云映射、行道树点云实例优化6个步骤,具体流程如图1所示。

首先,利用MLS采集街道点云数据,更新FIFO缓冲区,使之保存最近采集的若干帧点云数据;其次,将FIFO缓冲区中的点云数据转换为二维图像;之后,对二维图像进行图像行道树实例分割,得到行道树候选实例;然后,将得到的行道树候选实例与已检出的行道树实例进行实例融合;融合完成后对行道树实例进行完整性检测,对于检测完整的行道树实例执行图像-点云映射得到行道树点云实例;最后,使用阈值滤波与K最近邻(K-nearest neighbor,KNN)[25]在点云层面对行道树点云实例进行优化。

1.1 缓冲区更新

为了能够在线处理采集到的街道点云数据,采用了构建FIFO缓冲区的方法,用于存储当前一小段街道的点云数据。首先,从采集到的MLS街道点云数据中读取N帧扫描线数据写入FIFO缓冲区,初始化处理时刻t=1,FIFO缓冲区首次写满后执行下一步。在后续处理中,为了防止相邻两张街道图像对应到街道点云中的区域跨度过大,从而导致行道树实例的漏检,选择每次向FIFO缓冲区更新ΔN帧点云数据,ΔN的数值设置不应过大。

FIFO缓冲区数据更新过程如图1所示,更新一帧数据首先要将当前FIFO缓冲区中最先读入的一帧点云数据读出,读出后将整体的后一位数据向前移一位,再将更新的一帧数据写入FIFO中,依照此步骤依次向FIFO缓冲区更新ΔN帧数据。

N帧街道点云数据和ΔN帧街道点云更新数据采用下述公式(1)获取:

N=LvΔt

ΔN=ΔLvΔt。(1)

式中:L为每次在线分割的街道长度;v是二维激光雷达的移动速度;ΔL为街道更新长度;Δt是二维LiDAR获取一帧点云数据的时间。

初次写入FIFO缓冲区的点云数据默认其为非行道树点,为其分配标签TP=0,用于接下来进行图像-点云映射与行道树点云实例优化,TP的值代表点所属行道树实例的序号。

1.2 行道树点云-图像映射、图像分割、实例融合及图像-点云映射

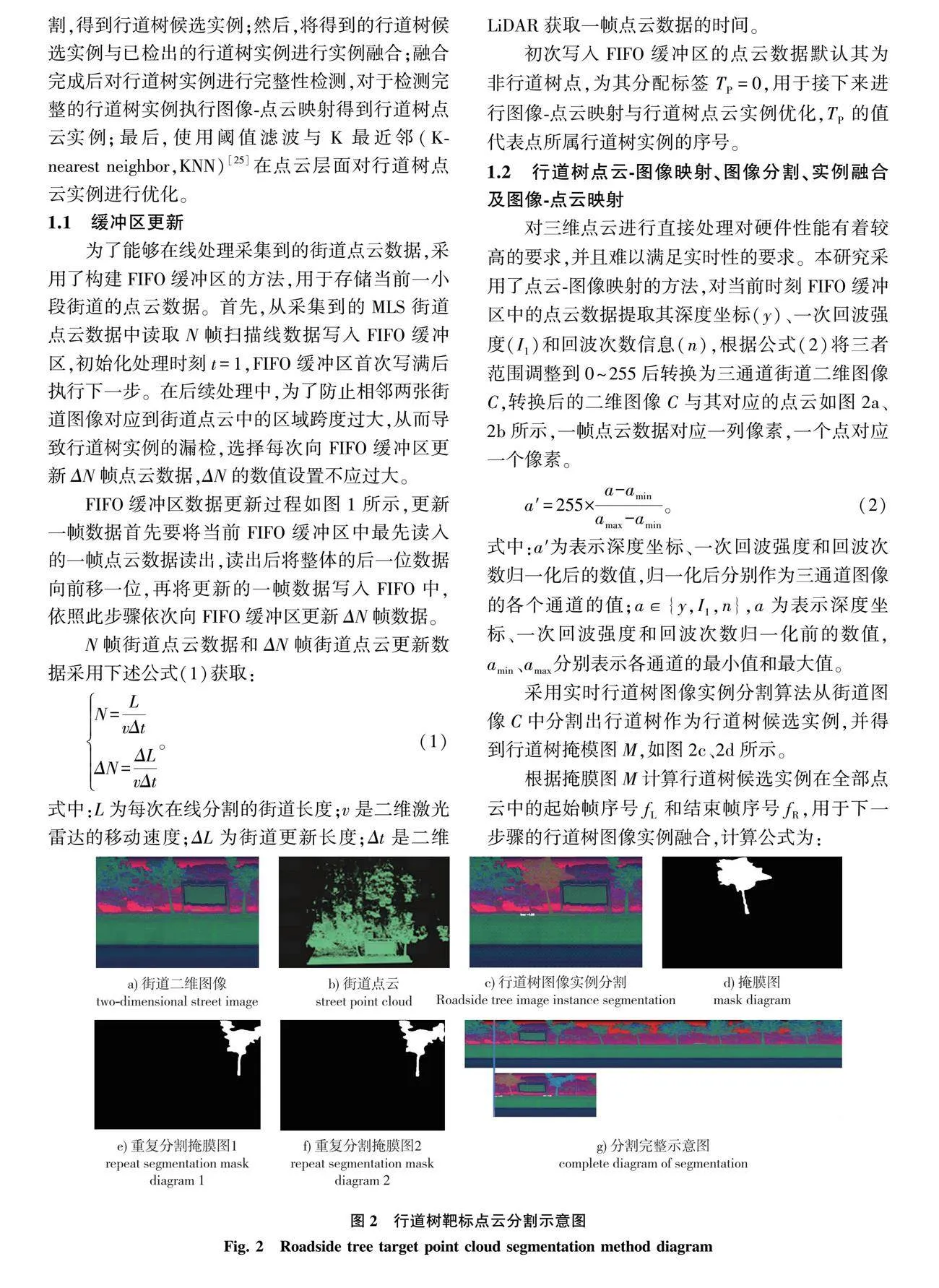

对三维点云进行直接处理对硬件性能有着较高的要求,并且难以满足实时性的要求。本研究采用了点云-图像映射的方法,对当前时刻FIFO缓冲区中的点云数据提取其深度坐标(y)、一次回波强度(I1)和回波次数信息(n),根据公式(2)将三者范围调整到0~255后转换为三通道街道二维图像C,转换后的二维图像C与其对应的点云如图2a、2b所示,一帧点云数据对应一列像素,一个点对应一个像素。

a′=255×a-aminamax-amin。(2)

式中:a′为表示深度坐标、一次回波强度和回波次数归一化后的数值,归一化后分别作为三通道图像的各个通道的值;a∈{y,I1,n},a为表示深度坐标、一次回波强度和回波次数归一化前的数值,amin、amax分别表示各通道的最小值和最大值。

采用实时行道树图像实例分割算法从街道图像C中分割出行道树作为行道树候选实例,并得到行道树掩模图M,如图2c、2d所示。

根据掩膜图M计算行道树候选实例在全部点云中的起始帧序号fL和结束帧序号fR,用于下一步骤的行道树图像实例融合,计算公式为:

fL=CL+ΔN(t-1)

fR=CR+ΔN(t-1)。(3)

式中:CL和CR分别为行道树候选实例在掩膜图M中的起始列和结束列序号。

由于街道图像间存在重叠,同一棵行道树在相邻图像间可能有多个重复分割,其在相邻时刻图像上实例分割出的掩膜图如图2e、2f所示。从图中可知,两张掩膜图虽对应于同一棵行道树,但明显可以观察到右图比左图分割得更加完整,依据右图提取到的行道树实例信息相比于左图也更能代表此棵行道树,所以要对当前分割出来的行道树候选实例与已有行道树实例进行重复性检测,将同一行道树实例的重复分割结果进行比较,保留最优实例的信息以用于下阶段的图像-点云映射。

将当前时刻各行道树候选实例的帧范围与所有行道树实例进行帧重叠对比,若存在帧重叠,对于存在重叠的行道树候选实例,依据公式(4)计算该行道树候选实例和与之重叠的行道树实例的帧交并比(fIoU),并进行实例融合,否则,将该行道树候选实例作为新的行道树实例。

fIoU=min(fR,fTR)-max(fL,fTL)max(fR,fTR)-min(fL,fTL)。(4)

式中:T表示行道树实例的计数标签;fTL和fTR分别为第T棵行道树实例在全部点云中的起始帧序号和结束帧序号。

若fIoUgt;0.5,则判定此行道树候选实例为行道树实例的重复分割,需要对行道树候选实例与行道树实例进行实例融合,根据此行道树候选实例与行道树实例掩膜图计算各自占据的像素面积,分别记为A和AT。将A与AT进行比较,若Agt;AT,则判定此行道树候选实例比行道树实例更完整,将行道树实例的掩膜图、列范围、帧范围以及分割时刻替换为该行道树候选实例的掩膜图、列范围、帧范围以及分割时刻,删除该行道树候选实例。否则,判定此行道树候选实例不如行道树实例完整,删除该行道树候选实例。

图像实例融合后,检测是否存在已分割完整的行道树实例及何时分割完整通过图2g来说明。图2g中的长图是街道点云的前一部分通过点云-图像映射转换得到的截取图,其下是某时刻的街道图像经过图像行道树实例分割所得到的截图,共分割出两棵行道树候选实例。图2g中上图与下图的摆放在空间上是上下对齐的,蓝线是街道图像的第1列像素所处的位置,从图中可以观察到此时蓝线的位置恰好大于第1棵行道树实例的CL所处的位置。这种情形下,在下一时刻,街道图像在空间上对应到长图的位置会向右移动ΔN列像素,那么上一时刻街道图像中的第1棵行道树实例在此时刻会丢失左边的一部分区域,依此类推,在后续的缓冲区更新处理中,该行道树实例在街道图像中的区域会越来越少直至消失。综上,当更新后街道图像的第1列像素在全部点云中的帧序号首次大于已有行道树实例的FL时,认定此行道树实例已分割完整。

根据公式(5)计算当前时刻t街道图像C的第1列像素在全部点云中的帧序号f1:

f1=ΔN(t-1)+1。(5)

对于时刻t所有的未映射回点云的各行道树实例,若f1大于其fL,通过公式(6)为该行道树实例覆盖的所有像素查找对应点的帧内序号s和帧序号f,依据掩膜图中的像素与点云中点的对应关系,执行图像-点云映射,将图像分割结果映射回点云,得到行道树点云实例。

s=r

f=c+ΔN(t′-1)。(6)

式中:r表示掩膜图M中像素的行号;c表示掩膜图M中像素的列号;t′表示行道树实例的分割时刻;当像素值为255,令点的标签TP等于该行道树实例的计数标签T,否则,不做处理。

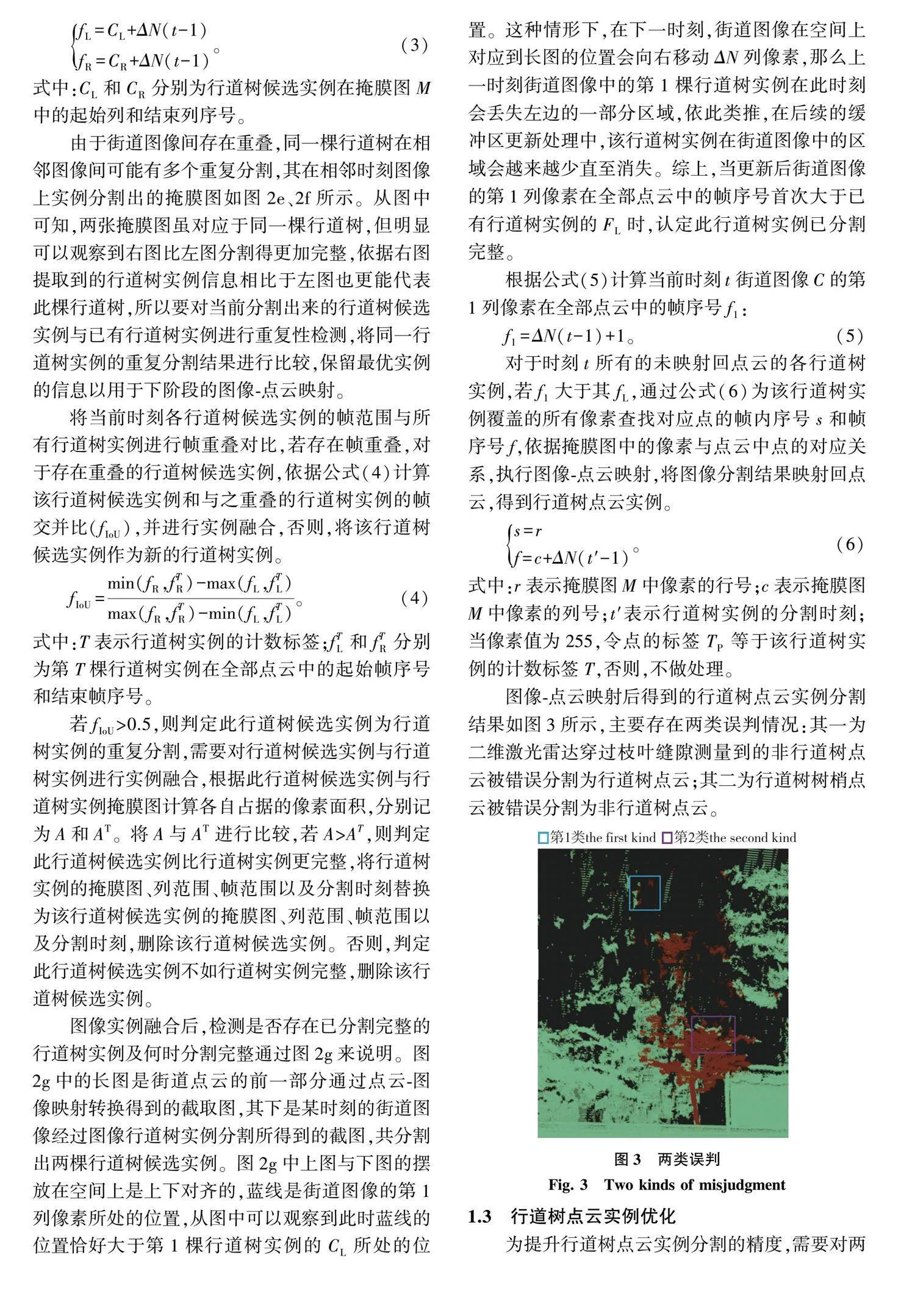

图像-点云映射后得到的行道树点云实例分割结果如图3所示,主要存在两类误判情况:其一为二维激光雷达穿过枝叶缝隙测量到的非行道树点云被错误分割为行道树点云;其二为行道树树梢点云被错误分割为非行道树点云。

1.3 行道树点云实例优化

为提升行道树点云实例分割的精度,需要对两类点云误判进行纠正。对于第1类误判,考虑到此类误判的点云在深度距离上与点云行道树实例有较大的差别,选择采用阈值滤波的方法对此类误判的点云进行滤除,即滤除行道树点云中深度坐标超过设定区域的点云,令其标签TP=0。

对于第2类误判,在阈值滤波结果的基础上,采用限定半径KNN分类器对行道树点云实例进行优化。根据当前行道树点云实例的帧范围{fTL,fTR}与前一棵行道树点云实例的帧范围{fT-1L,fT-1R},fTL和fTR初始为0,对满足以下3个条件的点云,采用限定半径最近邻分类器重新分配标签TP。

1)帧序号在fT-1L+fT-1R2,fTL+fTR2范围内,如果直接对当前行道树点云实例进行KNN优化,若当前行道树点云实例与下一颗行道树点云实例间存在黏连,则会导致黏连部分未被分类的点云倾向于被分类到当前行道树点云实例,为避免这种情况,使用KNN进行优化时,将帧范围限定在fT-1L+fT-1R2,fT-1L+fTR2间。

2)高度坐标z≥2 m,由于树根部分较为规则,图像实例分割模型的分割精度较高,而树冠部分形状差异较大,图像实例分割模型对其分割精度较低,因此当前行道树点云实例的误判主要发生在树冠部位;其次,高度较低的区域有较多紧贴行道树的物体,如地面、广告牌、垃圾桶等,在使用KNN进行优化时,此类物体会被错误归类到当前行道树点云实例。综上,选择高度不低于2 m的区域进行KNN优化。

3)标签TP=0。分类规则为:统计以待分类点为中心、半径为r的球内所有点的标签,令待分类点的标签等于点数最多的标签。

1.4 试验平台和数据

本研究试验设备为搭载Windows 11 64位操作系统的计算机,运行内存16 GB,CPU为Intel i5-11400F,GPU为NVIDIA GeForce RTX 3060,GPU加速为CUDA 11.5+cuDNN 8.3.1。使用Spyder设计程序。

采用与文献[23]相同的点云数据集来进行实验,采集该点云数据集的二维LiDAR的型号为UTM-30LX-EW[26]。该LiDAR每次发射一帧扫描线的激光束,扫描线的扫描范围为[-135°, 135°],相邻两帧扫描线发射的时间间隔为25 ms,每帧扫描线包含1 081个激光束,一帧扫描线中的相邻两个激光束之间的角度相差0.25°,该款雷达记录前3次回波的距离和强度信息,记为r1、r2、r3和I1、I2、I3,如果没有接收到回波,距离为最大测量距离60 m,强度为0。

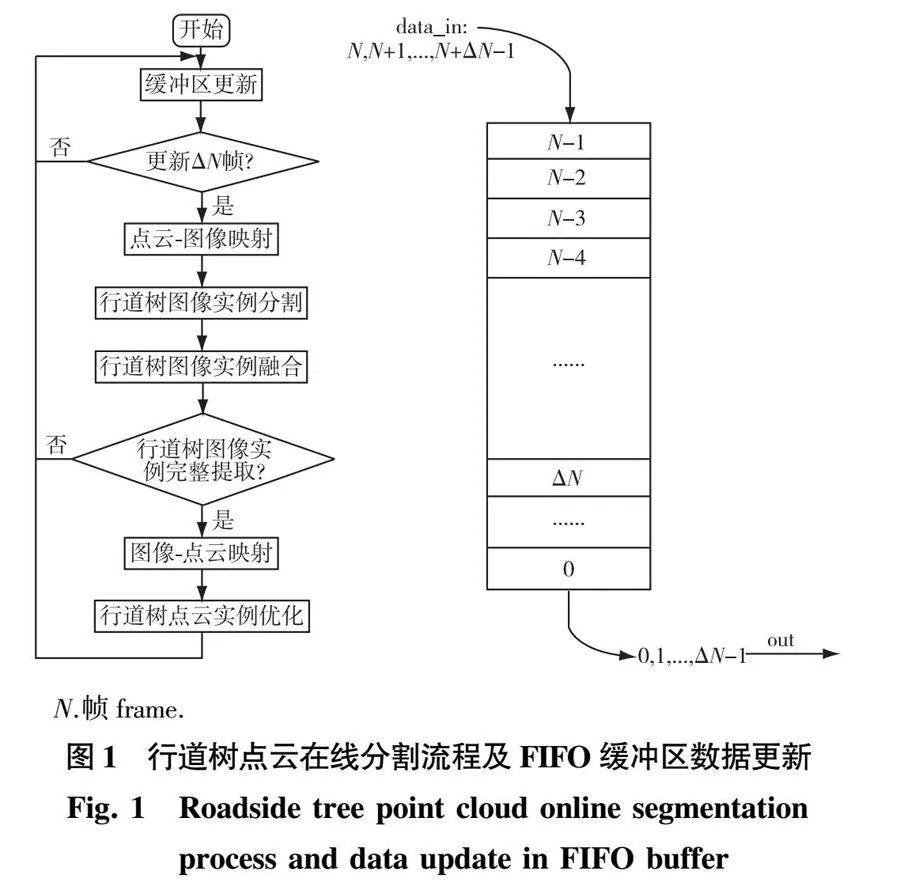

以LiDAR的初始位置为坐标原点建立坐标系,如图4所示,其中x轴为小车行驶方向,y轴为深度方向,z轴垂直地面向上。一帧扫描线保留其内[-90°, 90°]之间720个测量点。数据集采集于一段长300 m的校园街道,LiDAR的扫描方向沿y轴垂直于地面,通过控制小车按0.4 m/s的速度沿道路方向匀速直线行驶,得到30 000帧扫描线的数据,共21 600 000个测量点。

将LiDAR采集到的点云转换为三维点云数据,第i帧扫描线内第j个测量点的三维坐标为:

x(i,j)=ivΔt

y(i,j)=r1(i,j) cos θ(j)

z(i,j)=r1(i,j) sin θ(j)。(7)

式中:r1(i,j)为第i帧扫描线中第j个测量点的一次回波距离;θ(j)为扫描线内第j个测量点的扫描角度,Δt是二维激光雷达获取一帧点云数据的时间。

2 结果与分析

2.1 试验数据处理与实例分割实验

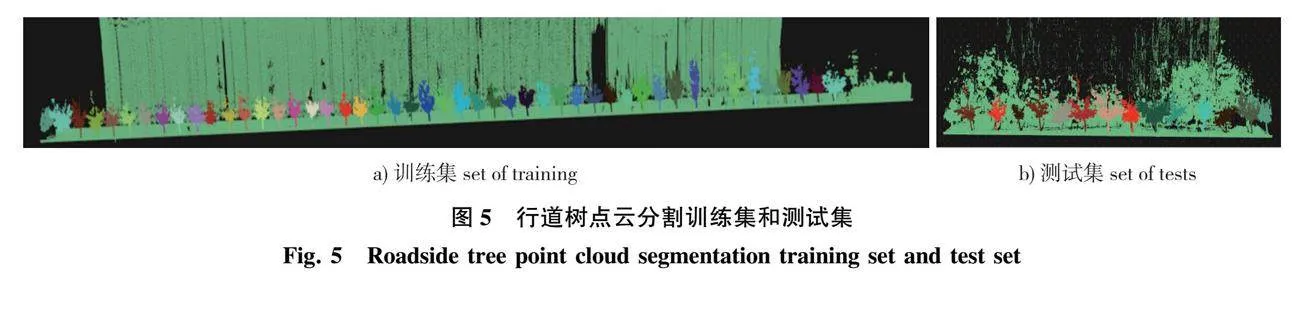

使用CloudCompare对300 m街道点云数据中的行道树进行手动实例标注,然后按1.5∶8.5的比例将点云数据划分为测试集和训练集,训练集用于学习行道树图像实例分割模型,测试集用于评价行道树点云在线分割算法性能。其中训练集长度为254.988 m,包含46棵行道树,共计25 498 797个点;测试集的长度为45.012 m,包含14棵行道树,共计4 501 203个点,分别如图5所示。

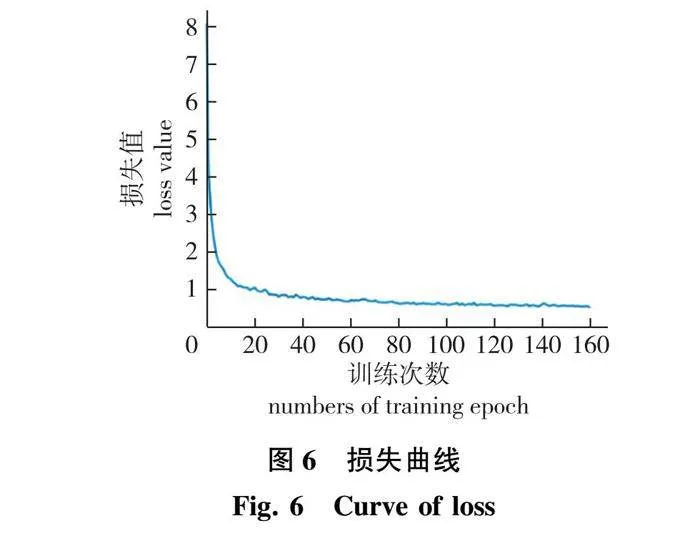

按照文献[23]描述的步骤训练行道树图像实例分割模型。首先,将训练集转换为三通道图像,对三通道长图切片,得到的每张图像上包含1~2棵行道树,之后对切片得到的图像进行水平翻转扩充,最终得到1 144张720×720的街道点云图像。通过Labelme对街道图像中的行道树进行实例标注,使用标注好的数据训练YOALCT[27]行道树图像实例分割模型,训练参数为默认参数,经过160轮迭代后得到行道树图像实例分割模型,共计迭代23 115次,损失曲线如图6所示。

2.1.1 分割精度评价指标

本研究方法要实现行道树靶标点云在线准确分割,需在点云层面对分割精度进行评价。另一方面,本研究的行道树靶标点云分割要借助图像实例分割来实现,图像实例分割模型精度决定了点云行道树实例分割的精度。因此,需要在图像层面和点云层面分别评价模型的分割精度。

在图像层面对训练的图像实例分割模型进行精度评价,令检测掩膜与真值掩膜的交并比阈值为0.5~0.9,以0.05为步长增加,若检测掩膜与真值掩膜的交并比(intersection over union,IoU)大于阈值,判定为正确检出的行道树,否则判定为错误检出,并以此计算各IoU阈值下的精度(mean average precision,mAP),最后得到在全部IoU阈值下的mAP。以得到的mAP来衡量图像实例分割模型的精度。

在点云层面,本试验使用准确率Pr、召回率Re和F1分数作为评估行道树点云实例分割精度的性能指标。准确率、召回率、F1分数的计算方式如公式(8)、(9)和(10)所示。

Pr=PT/(PT+PF);(8)

Re=PT/(PT+NF);(9)

F1=2×Pr×Re/(Pr+Re)。(10)

式中:PT为预测是行道树点云实例且真实为行道树点云实例的点数;PF为预测是行道树点云实例但不是行道树点云实例的点数;NF为预测不是行道树点云实例但真实为行道树点云实例的点数。

2.1.2 分割精度评价结果

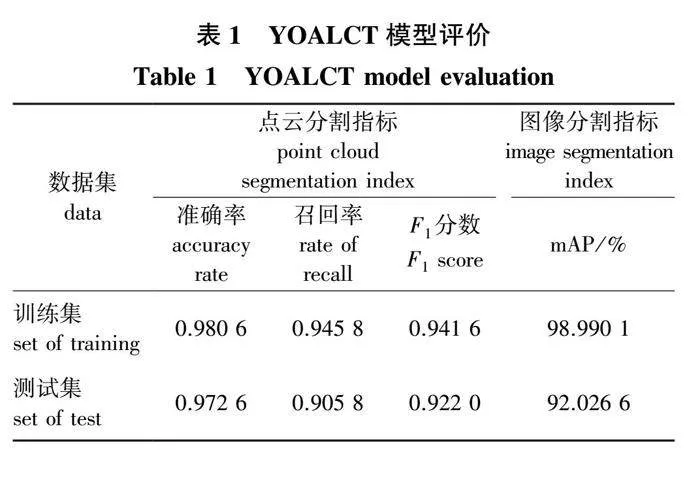

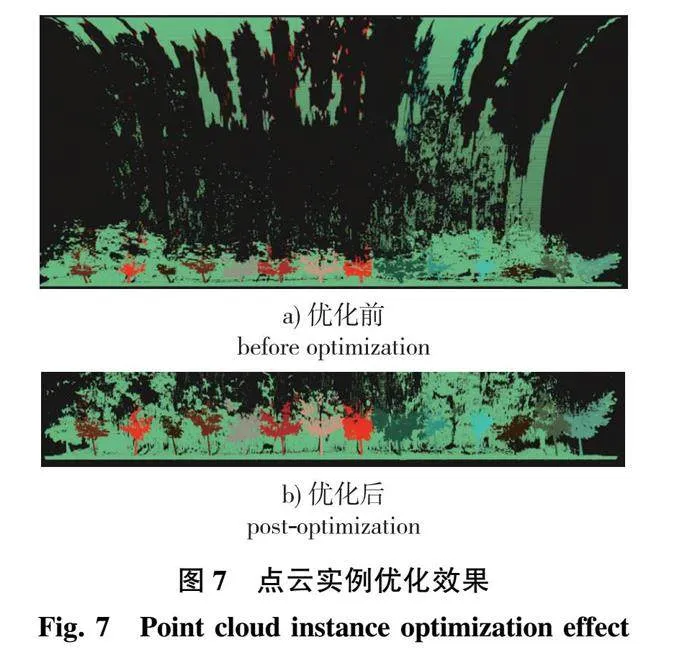

设置L、ΔL分别为10 m与0.4 m,用此模型在训练集上进行行道树靶标点云实例分割,之后,为测试模型的泛化能力,使用模型对测试集进行测试,得到的分割结果见图7a。

从图中可以明显观察到图3所示的两类误判。使用mAP、准确率、召回率、F1分数分别对模型进行图像分割与点云分割两个层面的精度评价,具体如表1所示。

2.2 行道树点云实例优化实验

为提升行道树点云实例分割的精度,采用阈值滤波优化与KNN优化对两类点云误判进行纠正,并通过实验对比为两种优化方法选择合适的参数。

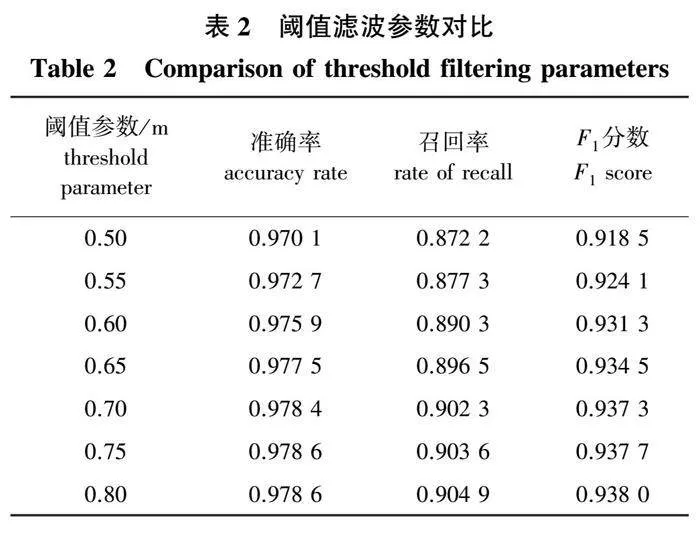

2.2.1 阈值滤波优化实验

通过对比不同阈值下阈值滤波的优化结果来选定合适的阈值参数,结果如表2所示。从表2看出,阈值大于0.50 m时,准确率、F1分数都能得到提升,召回率与表1相比略微下降是因为阈值滤波会滤除掉一部分真实属于行道树点云实例的点,但此类错误可以通过下一阶段的KNN优化进行纠正,所以召回率的略微下降不影响阈值的选定。在阈值设置大于0.60 m之后,优化效果趋于稳定;当不同阈值下的优化结果进行点云可视化后观察发现,在阈值设置大于0.65 m之后,阈值滤波不能很好地滤除行道树背后的物体,于是最终选择0.65 m作为阈值滤波中阈值的给定参数。

2.2.2 KNN优化实验

以0.65 m作为阈值滤波中阈值的给定参数对行道树点云实例实行阈值滤波优化,为选定合适的半径参数,对阈值滤波后的行道树点云实例进行KNN优化,并设置不同的半径参数对结果进行对比,结果如表3所示。由表3可知,使用KNN优化后,准确率、召回率、F1分数都得到了提升,但在KNN半径参数大于0.30 m后优化效果趋于稳定,并且在KNN半径参数大于0.50 m后,准确率与F1分数呈下降趋势,同时考虑到在线分割的实时性,选择0.50 m作为KNN的半径参数,最终的优化结果如图7b的效果所示,可见,图3所示的两类误判情况得到了明显的改善。

2.3 行道树在线分割实时性测试

为验证本研究的行道树靶标点云在线分割算法的实时性,将分割算法分为点云-图像映射与行道树图像实例分割、行道树图像实例融合与图像-点云映射、行道树点云实例优化3个阶段,对分割算法各阶段的处理速度进行测试,得到的3个阶段的帧平均处理速度分别为3.354、0.808与1.099 ms/帧,合计5.261 ms/帧。结果表明,本研究的在线分割算法平均到每帧的处理时间仅为5.261 ms,小于二维激光雷达获取一帧点云数据的时间25 ms,满足在线分割实时性的要求。

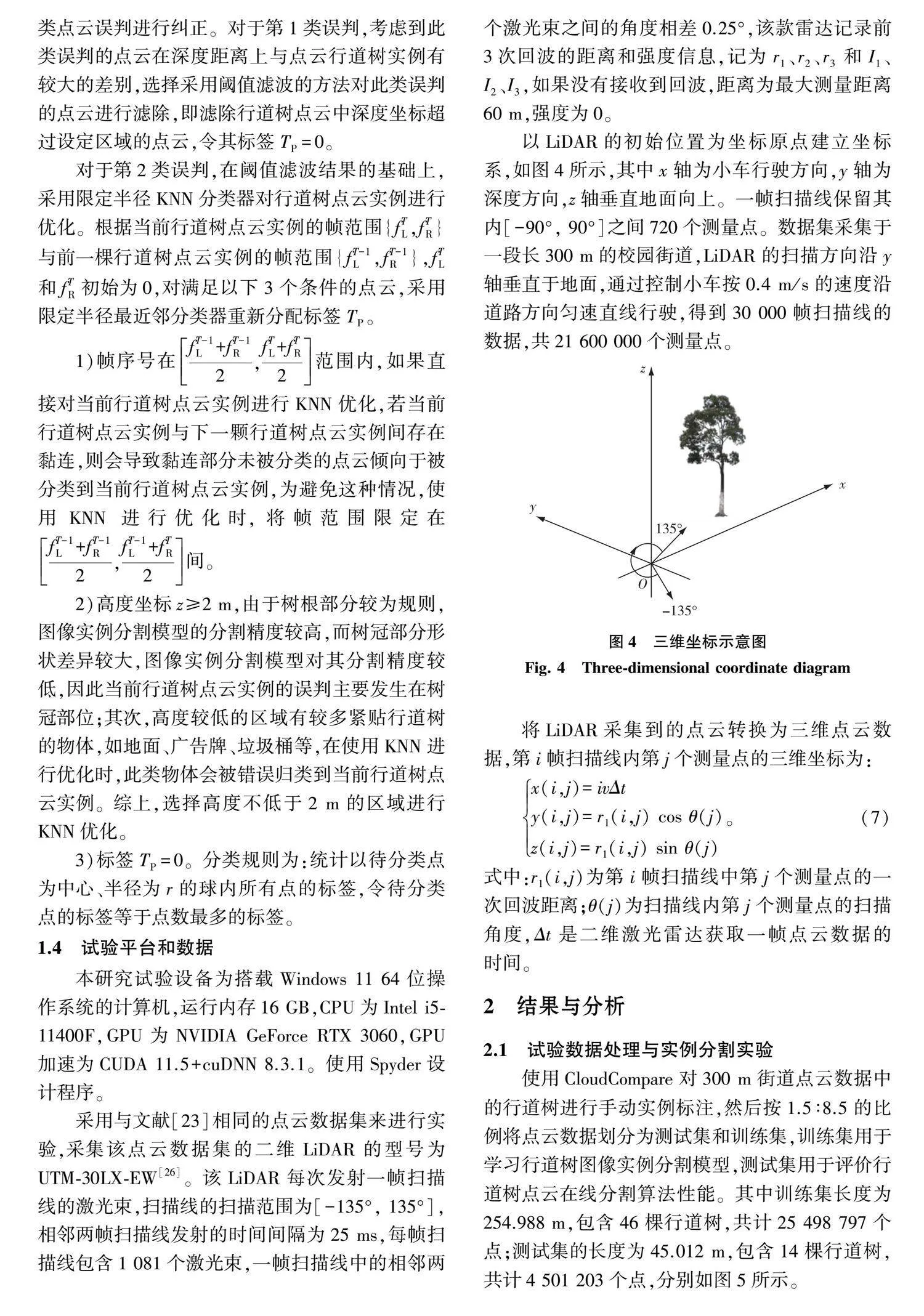

已有研究通过将整体点云转换为体素,在体素的基础上进行超体素分割,对生成的超体素进行区域生长,进而滤除点云中的平面物体与杆状物体,接下来对剩余的超体素进行聚类筛选出树冠后将树冠与检测到的杆状物体进行匹配,即可完成行道树的实例分割,此方法能有效地在测试集中滤除地面、广告牌等物体,从而能对测试集中的行道树实现精准分割[16]。为验证本研究的行道树靶标点云在线分割算法在分割精度与效率的优势,将本研究方法与文献[16]方法在测试集上进行对比,表明本研究方法在测试集上的分割精度与速度完全优于文献[16]中的方法(表4)。

3 讨 论

将二维LiDAR用于行道树对靶施药,LiDAR与施药装置置于同一移动设备上,LiDAR随着移动设备移动不断地采集数据,分割算法对当前采集到的数据进行在线分割。为保证算法准确分割出行道树时移动设备并没有远离该行道树,要求分割算法平均到每帧数据的处理速度要小于每帧数据的采集时间,这样才能及时使用施药装置对该行道树进行精准施药。

本研究提出了一种基于MLS的行道树靶标点云在线分割框架,该方法先通过建立FIFO缓冲区,FIFO缓冲区读取MLS采集到的点云数据转换为三通道图像,然后使用图像实例分割模型对图像进行分割,最后将分割结果映射回点云,并在点云层面对分割结果进行了优化。

通过点云层面的优化提高了点云行道树实例分割的精度,结果准确率为0.986 5、召回率为0.940 7、F1分数为0.957 6,相比于未优化分别提高了0.013 9、0.034 9、0.035 6,两类误判情况得到了明显改善。同时,实现了实时分割,整个分割过程平均到每帧的处理时间为5.261 ms,满足在线分割准确性与实时性的要求。

对比已有算法[16],本研究的方法对行道树的分割精度更优于文献,对其进行分析,可将原因归结为两点:首先,文献[16]的方法对树冠点云进行聚类从而实现对行道树的分割,最后的两棵树的树冠由于过于贴近从而导致了两个树冠被误分割成一个;其次,本研究的方法最后在点云层面对分割结果进行了优化,对易存在的误分割进行了修正,从而能使本研究方法最后的行道树分割精度高于文献[16]的结果。

本研究方法并未在实际中进行在线分割试验,而是通过建立FIFO缓冲区读取已采集到的街道点云数据中的数据并对其实时处理来模拟实际在线分割的过程,若要投入实际应用还需要考虑如下问题:本研究用于训练图像实例分割模型的数据偏少,虽在背景相似的测试集上取得了好的分割效果,但若要应对不同背景下的城市街道,还需要采集更多的数据来训练模型。

参考文献(reference):

[1]金小军,张军,杨凡,等.城市行道树生长健康状况与种植形式的相关性分析[J].城市建筑,2021,18(34):188-192.JIN X J,ZHANG J,YANG F,et al.Correlation analysis between the growth and health of urban street trees and their planting forms[J].Urban Archit,2021,18(34):188-192.DOI: 10.19892/j.cnki.csjz.2021.34.42.

[2]姚丽敏,孙永明,骞军彦.晋中市榆次区行道树常见病虫害防治技术[J].山西林业,2019(2):46-47.YAO L M,SUN Y M,QIAN J Y.Control techniques of common diseases and pests of street trees in Yuci District of Jinzhong City[J].For Shanxi,2019(2):46-47.DOI: 10.3969/j.issn.1005-4707.2019.02.022.

[3]商艳上,苏田,李臻,等.园林行道树复壮技术[J].现代农业科技,2021(12):176-177.SHANG Y S,SU T,LI Z,et al.Rejuvenation technology of garden street trees[J].Mod Agric Sci Technol,2021(12):176-177.DOI: 10.3969/j.issn.1007-5739.2021.12.071.

[4]许秋颖.城市行道树种植存在的问题及其养护管理措施[J].现代园艺,2019(22):180-181.XU Q Y.Problems existing in urban street tree planting and its maintenance and management measures[J].Xiandai Hortic,2019(22):180-181.DOI: 10.14051/j.cnki.xdyy.2019.22.116.

[5]权龙哲,郦亚军,王旗,等.考虑风扰的对靶喷雾机械臂药液喷洒动力学建模与试验[J].农业机械学报,2018,49(6):48-59.QUAN L Z,LI Y J,WANG Q,et al.Modeling and testing on liquid pesticide spray of serial manipulator target weeding robot considering wind disturbance[J].Trans Chin Soc Agric Mach,2018,49(6):48-59.DOI: 10.6041/j.issn.1000-1298.2018.06.006.

[6]ZHOU M C,JIANG H Y,BING Z S,et al.Design and evaluation of the target spray platform[J].Int J Adv Rob Syst,2021,18(2):1729881421996146.DOI: 10.1177/1729881421996146.

[7]DOU H J,ZHAI C Y,CHEN L P,et al.Comparison of orchard target-oriented spraying systems using photoelectric or ultrasonic sensors[J].Agriculture,2021,11(8):753.DOI: 10.3390/agriculture11080753.

[8]谷趁趁,翟长远,陈立平,等.基于激光雷达的树形靶标冠层叶面积探测模型研究[J].农业机械学报,2021,52(11):278-286.GU C C,ZHAI C Y,CHEN L P,et al.Detection model of tree canopy leaf area based on LiDAR technology[J].Trans Chin Soc Agric Mach,2021,52(11):278-286.DOI: 10.6041/j.issn.1000-1298.2021.11.030.

[9]MARSELIS S M,ABERNETHY K,ALONSO A,et al.Evaluating the potential of full-waveform lidar for mapping pan-tropical tree species richness[J].Global Ecol Biogeogr,2020,29(10):1799-1816.DOI: 10.1111/geb.13158.

[10]JASKIERNIAK D,LUCIEER A,KUCZERA G,et al.Individual tree detection and crown delineation from unmanned aircraft system (UAS) LiDAR in structurally complex mixed species eucalypt forests[J].ISPRS J Photogramm Remote Sens,2021,171:171-187.DOI: 10.1016/j.isprsjprs.2020.10.016.

[11]LI Q J,XUE Y X.Total leaf area estimation based on the total grid area measured using mobile laser scanning[J].Comput Electron Agric,2023,204:107503.DOI: 10.1016/j.compag.2022.107503.

[12]HOSSEIN S A,HEIDAR R,ALIREZA S,et al.Automated street tree inventory using mobile LiDAR point clouds based on Hough transform and active contours[J].ISPRS J Photogramm Remote Sens,2021,174:19-34.

[13]BIENERT A,GEORGI L,KUNZ M,et al.Automatic extraction and measurement of individual trees from mobile laser scanning point clouds of forests[J].Ann Bot,2021,128(6):787-804.DOI: 10.1093/aob/mcab087.

[14]XU S,SUN X Y,YUN J Y,et al.A new clustering-based framework to the stem estimation and growth fitting of street trees from mobile laser scanning data[J].IEEE J Sel Top Appl Earth Obs Remote Sens,2020,13:3240-3250.DOI: 10.1109/JSTARS.2020.3001978.

[15]LI J T,CHENG X J,XIAO Z H.A branch-trunk-constrained hierarchical clustering method for street trees individual extraction from mobile laser scanning point clouds[J].Measurement,2022,189:110440.DOI: 10.1016/j.measurement.2021.110440.

[16]LI J T,CHENG X J.Supervoxel-based extraction and classification of pole-like objects from MLS point cloud data[J].Opt Laser Technol,2022,146:107562.DOI: 10.1016/j.optlastec.2021.107562.

[17]HAO W,WANG Y H,LI Y,et al.Hierarchical extraction of pole-like objects from scene point clouds[J].Opt Eng,2018,57(8):1.DOI: 10.1117/1.oe.57.8.083106.

[18]WANG W Y,YU R,HUANG Q G,et al.SGPN:Similarity group proposal network for 3D point cloud instance segmentation[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Salt Lake City,UT,USA:IEEE,2018:2569-2578.DOI: 10.1109/CVPR.2018.00272.

[19]PHAM Q H,NGUYEN T,HUA B S,et al.JSIS3D:joint semantic-instance segmentation of 3D point clouds with multi-task pointwise networks and multi-value conditional random fields[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR).Long Beach,CA,USA:IEEE,2019:8819-8828.DOI: 10.1109/CVPR.2019.00903.

[20]YANG B,WANG J N,CLARK R,et al.Learning object bounding boxes for 3D instance segmentation on point clouds[C]//Vancouver, Canada:33rd Conference on Neural Information Processing Systems(Neur IPS 2019),2019:arXiv:1906.01140.http://arxiv.org/abs/1906.01140.

[21]GUO M H,CAI J X,LIU Z N,et al.PCT: point cloud transformer[J].Comput Vis Medium,2021,7(2):187-199.DOI: 10.1007/s41095-021-0229-5.

[22]WU B C,WAN A,YUE X Y,et al.Squeeze Seg:convolutional neural nets with recurrent CRF for real-time road-object segmentation from 3D LiDAR point cloud[C]//2018 IEEE International Conference on Robotics and Automation (ICRA).Brisbane,QLD,Australia:IEEE,2018:1887-1893.DOI: 10.1109/ICRA.2018.8462926.

[23]李秋洁,童岳凯,薛玉玺,等.基于YOLACT的行道树靶标点云分割方法[J].林业工程学报,2022,7(4):144-150.LI Q J,TONG Y K,XUE Y X,et al.Point cloud segment method for street tree target based on YOLACT[J].J For Eng,2022,7(4):144-150.DOI: 10.13360/j.issn.2096-1359.202110034.

[24]郑志旺.基于国产FPGA的数据采集存储系统的研究与设计[D].太原:中北大学,2021.ZHENG Z W.Research and design of data acquisition and storage system based on domestic FPGA[D].Taiyuan:North University of China,2021.

[25]WEINMANN M,URBAN S,HINZ S,et al.Distinctive 2D and 3D features for automated large-scale scene analysis in urban areas[J].Comput Graph,2015,49:47-57.DOI: 10.1016/j.cag.2015.01.006.

[26]LI Q J,YUAN P C,LIU X,et al.Street tree segmentation from mobile laser scanning data[J].Int J Remote Sens,2020,41(18):7145-7162.DOI: 10.1080/01431161.2020.1754495.

[27]BOLYA D,ZHOU C,XIAO F Y,et al.YOLACT:real-time instance segmentation[C]//2019 IEEE/CVF International Conference on Computer Vision (ICCV).Seoul,Republic of Korea: IEEE,2019:9156-9165.DOI: 10.1109/ICCV.2019.00925.

(责任编辑 孟苗婧 郑琰燚)

收稿日期Received:2022-10-28""" 修回日期Accepted:2023-11-22

基金项目:国家自然科学基金项目(31901239)。

第一作者:严宇(1356324910@qq.com)。

*通信作者:李秋洁(liqiujie_1@163.com),副教授。

引文格式:严宇,李秋洁.

行道树靶标点云在线分割方法[J]. 南京林业大学学报(自然科学版),2024,48(4):141-149.

YAN Y,LI Q J.

Online segmentation method of target point cloud in roadside tree[J]. Journal of Nanjing Forestry University (Natural Sciences Edition),2024,48(4):141-149.

DOI:10.12302/j.issn.1000-2006.202210039.